中文标题:基于神经4D光场的高效新视角合成

创新点

- 在我们的方法中,一个3D场景被表示为一个光场,即一组射线,每条射线在到达图像平面时都有相应的颜色。为了实现高效的新视图渲染,我们采用了光场的双平面参数化,其中每条射线都有一个四维参数.

- 与NeRF相比:通过将新的视点限制在物体的凸包之外,可以将5D辐射场简化为较低维的光场,例如4D。

提出的算法

4D 光场表示

- 空间中所有可能的光线都可以用五维多光函数来描述。但是如果从场景的凸包外观察,沿光线的辐射是恒定的,这个5D函数可以简化为4D光场。

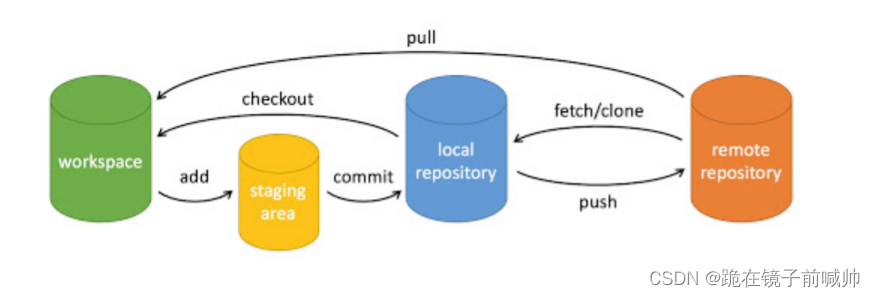

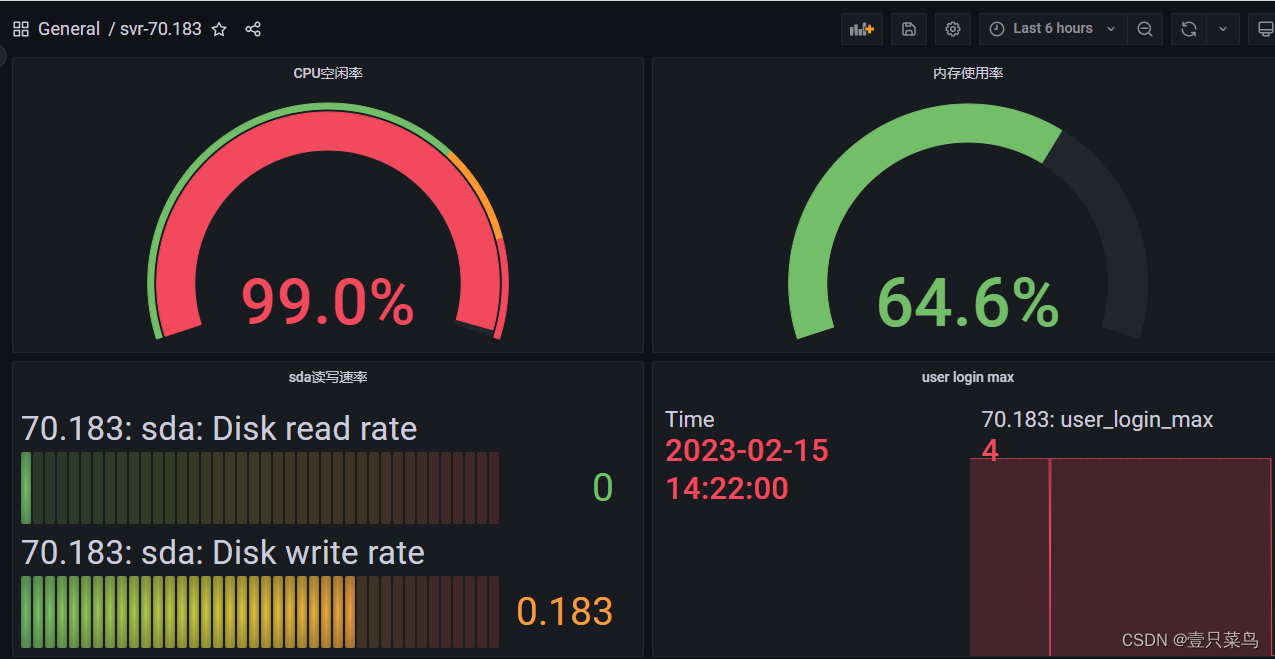

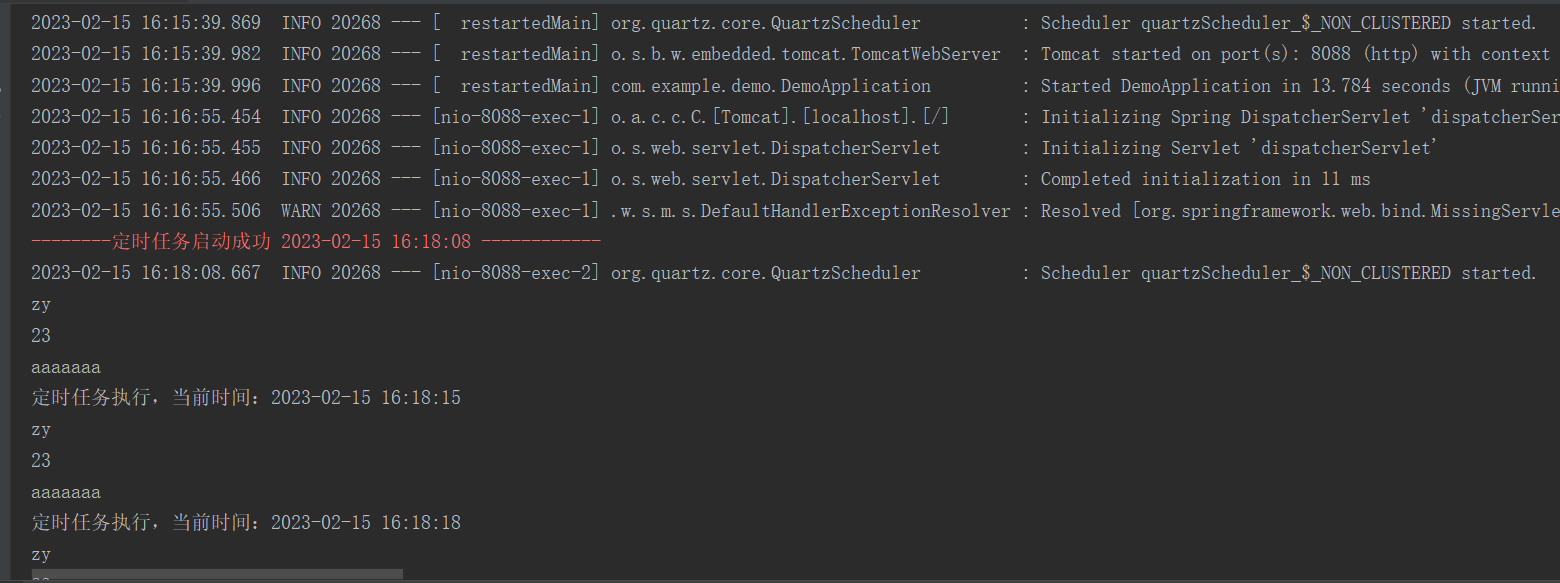

- 最常见的参数化方法是如图所示的双平面模型。从照相机到场景的每条光线都将与这两个平面相交。

- 可以用交点 ( u , v ) (u,v) (u,v)和 ( s , t ) (s,t) (s,t)的坐标来表示每条光线。使用这种表示方式,从对象到两个平面的一侧的所有光线都可以由一个四维坐标唯一地确定。

双平面模型:可以看到只要记录了光线经过两平面的坐标就能推出其方向信息,在光场相机中可以以像面、镜头瞳面与主透镜平面可以两两组合,得到光线的位置信息和方向信息。参见光场相机整理。

- 基于这种表示方式,可以通过查询从投影中心到相机图像平面上的每个像素的所有光线来渲染一个新的视图。

神经4D光场重建

- 将映射函数 f c f_c fc表示为一个多层感知器(MLP)。

- Inputs: 4D坐标 Outputs:RGB颜色

- 所有的4D坐标: { ( u 1 k , v 1 k , s 1 k , t 1 k ) , . . . , ( u N k k , v N k k , s N k k , t N k k ) } \{(u^k_1,v^k_1,s^k_1,t^k_1),...,(u^k_{N_k},v^k_{N_k},s^k_{N_k},t^k_{N_k})\} {(u1k,v1k,s1k,t1k),...,(uNkk,vNkk,sNkk,tNkk)},k是图像序号(k= 1,…,M), N k N_k Nk是第K张图的总像素数量。

- 光度损失函数:

- 渲染:

- 给出一个视点 V V V,渲染一个 R ( V ) R(V) R(V)。

场景深度估计

-

为了使用光场模拟可变焦点和可变场深,之前的工作通过手动将焦点表面作为一个平面来动态地重新参数化光场。为了优化和自动选择一个给定像素位置的焦平面,我们的目标是解决Lambertian场景假设下的场景几何。

-

使用MLP同时预测每条射线的深度。对于射线 ( u i k , v i k , s i k , t i k ) (u^k_i,v^k_i,s^k_i,t^k_i) (uik,vik,sik,tik),预测与表面的距离 Z i k Z^k_i Zik,然后计算与目标表面的交点 ( X i k , Y i k , Z i k ) (X^k_i,Y^k_i,Z^k_i) (Xik,Yik,Zik)。然后在用其他视角的相关帧完成对其的自监督。

参考文献

[1] Li Z, Song L, Liu C, et al. Neulf: Efficient novel view synthesis with neural 4d light field[J]. arXiv preprint arXiv:2105.07112, 2021.