前言

只用一部手机,现实中的 2D 照片就能渲染出 3D 模型?

没错,无需再手动上传电脑或安装激光雷达,苹果手机自带 App 就能生成 3D 模型。

这个名叫 Luma AI 的“NeRF APP”,正式上架 App Store 后爆火:

小如 3D 装饰模型,兼具灯光和形状细节:

大到整个墓园的 3D 场景渲染版,都能被很好捕捉:

这样无论是风景、3D 物体还是人物,都可以被很好地保存进手机,并快速生成对应的 3D 模型。

所以这个 App 究竟包含什么功能,它又具体要如何使用?

NeRF 手机 App 是什么?

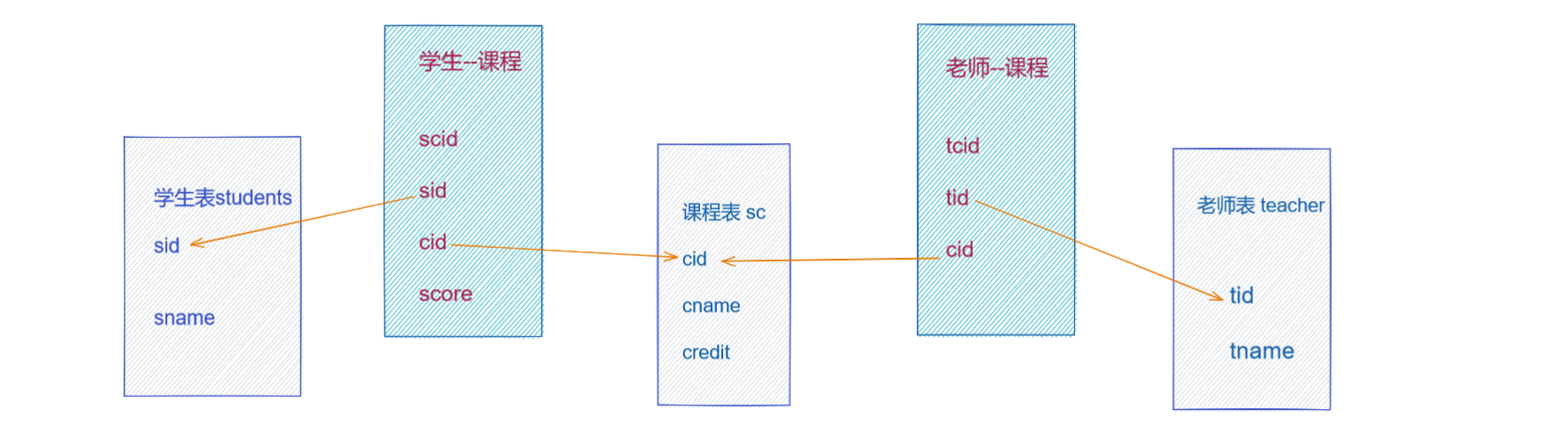

Luma AI 是一个基于 NeRF 打造的 APP,目前能在苹果商店中搜到:

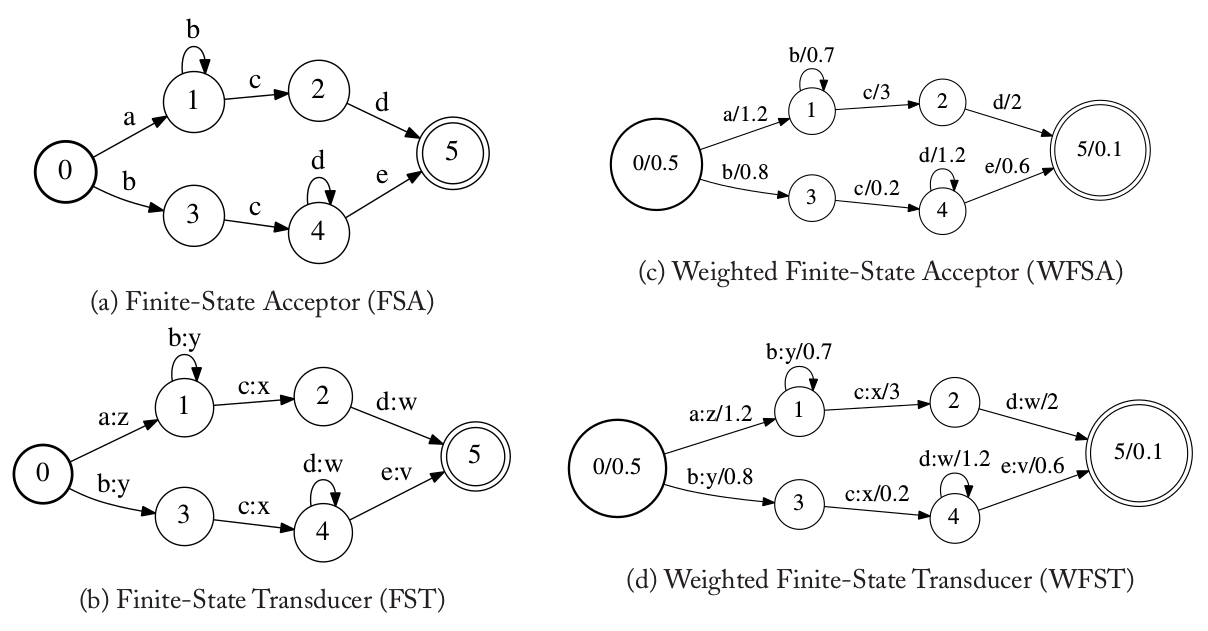

NeRF 是少量 2D 照片生成 3D 场景的经典 AI 模型,最初版本由 UC 伯克利和谷歌开发,只需要输入少量静态图片,就能做到多视角的逼真 3D 效果。

最初 NeRF 需要专业相机拍几百张照片,并在拍照时严格遵守参数坐标,但由于它的代码数据开源,目前已经有不少简化版模型被开发出来。

不仅照片数量有所下降,从几百张到几十张甚至几张,对拍照位置和照相机的要求也有所降低。

但能直接通过 App 导引、随时随地可用的 NeRF,几乎还没出现过。

现在,Luma AI 团队基于云服务器,实现了这个可以实时渲染 3D 物体、产品或风景和场景的 APP。

它包含自动调整焦距、视角和画面比例调整等不同功能,捕捉到的 3D 场景则包含复杂形状、反射和照明等细节。

同时,制作得到的 3D 模型既可以直接分享到网上,比 2D 照片更全方位地展示细节:

也可以放进 Blender 等游戏引擎中,让它“动起来”:

现在,你也可以试一试了。

支持 iPhone 11 或以上机型

目前 Luma AI 支持 iPhone 11 或以上的机型,操作方法也很简单。

在苹果商店下载 App 后,只需要跟着导引,围绕 3D 物体一步步完成拍摄,NeRF 就能在后台将这些照片合成出一个 3D 模型,并实时导出:

支持的玩法也很多样,从调整焦距、效果预览都包括:

实际拍出来的效果,可以直接放进电影中,有运镜内味了:

所以,没有苹果手机怎么办?

在网页端上传照片也可以,视频和照片集二选一:

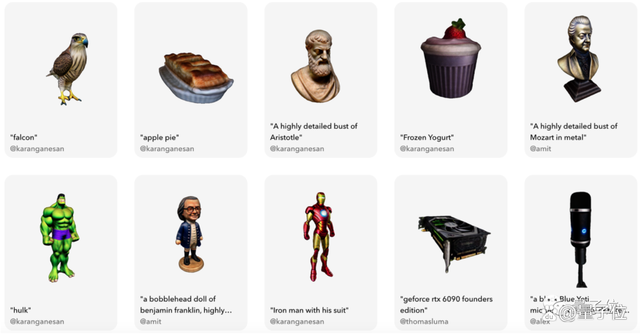

在 Luma AI 公开的 3D 模型分享库中,已经有不少网友上传了自己随手拍的 3D 模型:

目前支持导出的 3D 模型格式,主要包括 obj 和 gltf 两种。

你想好用它来拍出大片效果、做游戏模型,还是把家里的 3D 手办“电子化”了吗?

参考链接:

-

[1]https://twitter.com/LumaLabsAI/status/1611466398546690048

-

[2]https://captures.lumalabs.ai/imagine

-

[3]https://apps.apple.com/us/app/luma-ai/id1615849914