支持向量机与集成学习

文章目录

- 支持向量机与集成学习

- 支持向量机的基本原理

- 线性可分

- 支持向量

- 常用核函数

- 集成学习概述

- 集成学习的两种方式

- 集成学习的基本类型

- 弱学习其合成方式

- AdaBoost算法

- 训练过程

- 简例

一类按监督学习方式对数据进行二元分类的广义线性分类器

文章目录

- 支持向量机与集成学习

- 支持向量机的基本原理

- 线性可分

- 支持向量

- 常用核函数

- 集成学习概述

- 集成学习的两种方式

- 集成学习的基本类型

- 弱学习其合成方式

- AdaBoost算法

- 训练过程

- 简例

支持向量机的基本原理

线性可分

一维空间存在一个点将集合分成两个点集合,二维空间需要找到一条分类直线,三维空间需要找到一个分类面

在n维空间中,需要找到一个超平面。

“正中间”的超平面健壮性最佳称为划分超平面

支持向量

距离超平面最近的几个训练样本点

常用核函数

为解决线性不可分的情况(非线性组合)

为解决线性不可分的情况(非线性组合)

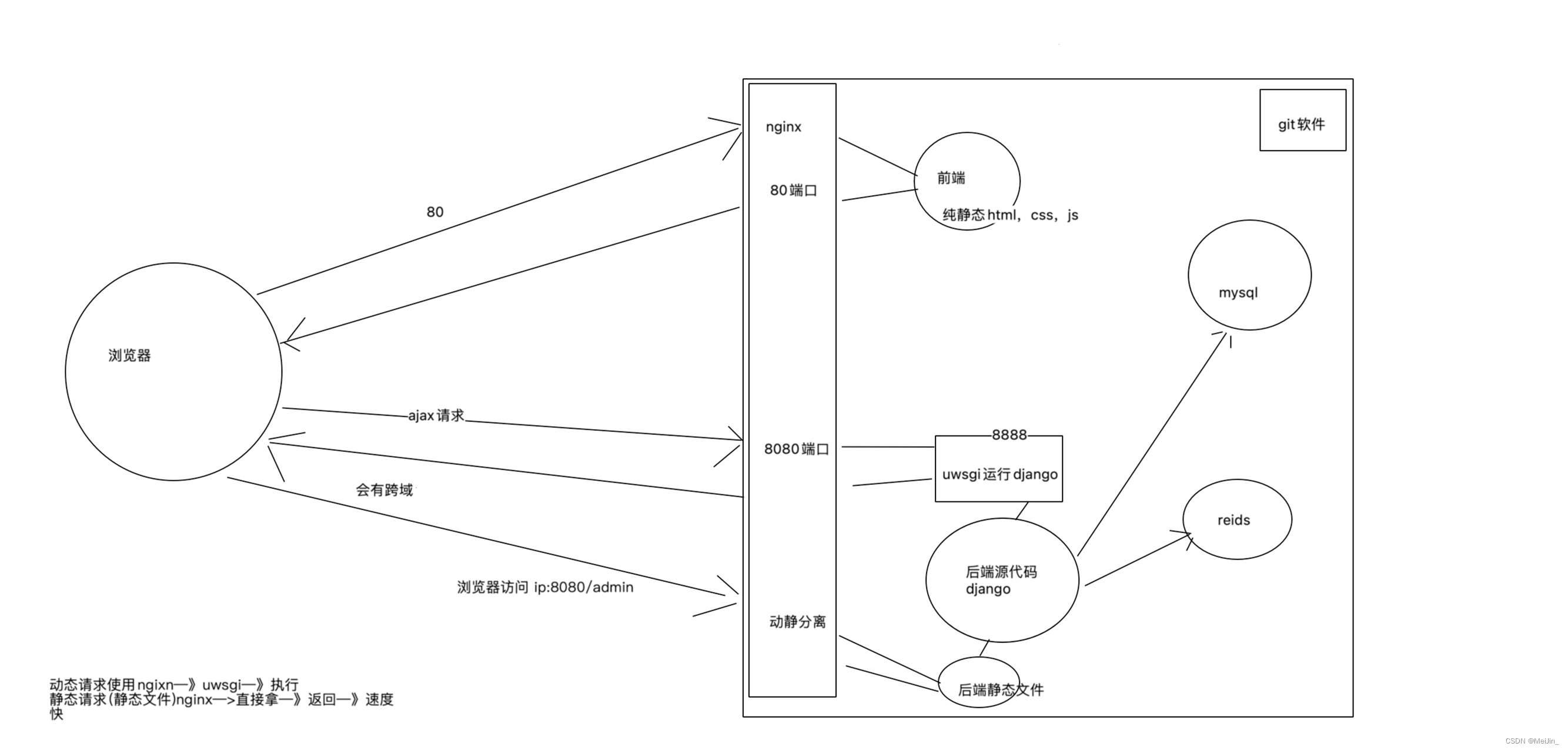

集成学习概述

集成学习是指为解决同一问题,先训练出一系列个体学习器(或称弱学习器),然后再根据某种规则把这些个体学习器的学习结果整合到一起,得到比单个个体学习器更好的学习效果。集成学习的基本结构如图5.11所示。

集成学习包括两大基本问题,一个是个体学习器的构造,另一个是个体学习器的合成。

集成学习的两种方式

-

同质学习

要求构造个体学习器时使用相同类型的学习方法,构造出来的多个个体学习器为同质学习器。

-

异质学习

所谓异质,是指不同类型,例如可以同时使用决策树和神经网络去构造个体学习器。

集成学习的基本类型

-

Boosting方法

Boosting方法的基本思想是从初始训练集开始,先为每个训练样本平均分配初始权重,并训练出弱学习器1;然后通过提高错误率高的训练样本的权重,降低错误率低的训练样本的权重,得到训练样本的新的权重分布,并在在该权重分布上训练出弱学习器2;依此逐轮迭代,直至达到最大迭代轮数,最后再将训练出来的这些弱学习器合成到一起,形成最终的强学习器。其典型代表是AdaBoost算法和提升树(boosting tree)算法。

-

bagging方法

基本思想是在给定初始训练集和弱学习算法的前提下,每轮迭代都使用可重采样的随机抽样方法式从初始训练集产生出本轮的训练子集,并利用选定的弱学习算法训练出本轮迭代的弱学习器,依此逐轮迭代,直至达到最大迭代轮数,最后再按照某种合成方式将这这些训练出来的弱学习器合成到一起,形成最终的强学习器。其典型代表包括bagging算法和随机森林(Random Forest)算法等。

弱学习其合成方式

-

代数合成法

-

投票法

AdaBoost算法

训练过程

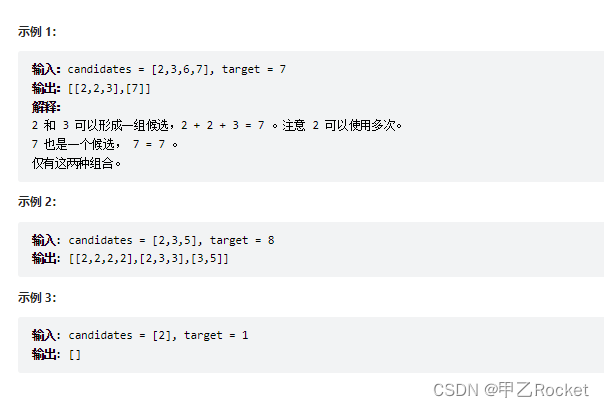

简例

-1iiMsFd0-1669000888534)]

[外链图片转存中…(img-SbKoEd6r-1669000888535)]