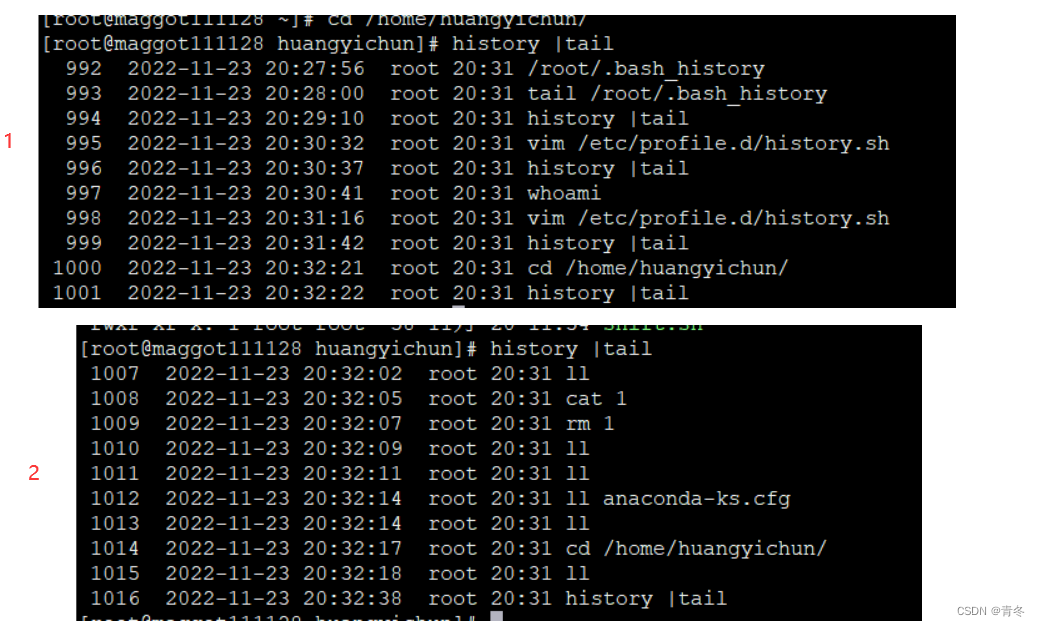

该文章主要为完成实训任务及总结,详细实现过程及结果见【参考文章】

参考文章:https://howard2005.blog.csdn.net/article/details/127170478

文章目录

- 一、 三种Shell命令方式

- 二、FileSystem Shell文档

- 三、常用Shell命令

- 四、实例练习

- 1、创建目录

- 2、查看目录

- 3、上传本地文件到HDFS

- 4、查看文件内容

- 5、下载HDFS文件到本地

- 6、删除HDFS文件

- 7、删除HDFS目录

- 8、移动目录或文件

- 9、文件合并下载

- 10、检查文件信息

- 11、创建时间戳文件

- 12、复制文件或目录

- 13、查看文件大小

- 14、上传文件

- 15、下载文件

- 16、查看某目录下文件个数

- 17、检查hadoop本地库

- 18、进入和退出安全模式

一、 三种Shell命令方式

hadoop fs:适用与任何不同的文件系统,比如本地文件系统和HDFS文件系统hadoop dfs:只能适用于HDFS文件系统hdfs dfs:只能使用与HDDS文件系统

二、FileSystem Shell文档

- 文档链接

三、常用Shell命令

hdfs dfs -ls <path>:显示指定的文件或目录的详细信息。 hdfs dfs -ls -R <path>:ls命令的递归版本。hdfs dfs -cat <path> 将<path>:指定文件的内容输出到标准输出。hdfs dfs chgrp [-R] group <path>:将指定文件所属的组改为group,使用-R对 指定目录内的文件进行递归操作。这个命令只适合于超级用户。 hdfs dfs -chown [-R] [owner][:[group]] <path>:改变指定文件或目录的拥有者,-R用于递归改变目录内的文件或目录的拥有者。 这个命令只适合于超级用户。 hdfs dfs -chmod [-R] <mode> <path>:将指定文件或目录的权限更改为。这个命令只适合于超级用户和文件或目录的拥有者。 hdfs dfs -tail [-f] <path> 将<path>:指定文件最后1KB的内容输出到标准输出上,-f选项用于持续检测新添加到文件中的内容。hdfs dfs -stat [format] <path>:以指定格式返回指定文件的相关信息。当不指定format的时候,返回文件 的创建日期。 hdfs dfs -touchz <path>:创建一个指定的空文件。 hdfs dfs -mkdir [-p] <paths>:创建指定的一个或多个目录,-p选项用于递归创建子目录。hdfs dfs -copyFromLocal <localsrc> <dst>:将本地源文件复制到路径指定的文件或目录中。hadoo fs -copyToLocal [-ignorcrc] [-crc] <target> <localdst>:将目标文件复制到本地文件或目录中,可用-ignorecrc选项复制CRC校验失败的文件,使用-crc选项复制文件以及CRC信息。hdfs dfs -cp <src> <dst>:将文件从源路径复制到目标路径。hdfs dfs -du <path>:显示指定文件或目录内所有文件的大小。 hdfs dfs -expunge:清空回收站。hdfs dfs -get [-ignorcrc] [-crc] <src> <localdst>:复制指定的文件到本地文件系统指定的文件或目录内,可用-ignorecrc选项复制CRC校验失败的文件,使用-crc选项复制文件以及CRC信息。hdfs dfs -getmerge [-nl] <src> <localdst> 对<src>:指定目录内所有文件进行合并,写入指定的本地文件。-nl是可选的,用于指定在每个文件结尾添加一个换行符。hdfs dfs -put <localsrc> <dst>:从本地文件系统中复制指定的单个或多个源文件到指定的目标文件系统中。hdfs dfs moveFromLocal <localsrc> <dst>:与put命令功能相同,但是文件上传结束后会从本地文件系统中删除指定的文件。hdfs dfs -mv <src> <dst>:将文件或目录从源路径移到目标路径。hdfs dfs -rm <path>:删除指定的文件或目录(非空目录)。 hdfs dfs -rm -r <path>:删除指定的目录及其下的所有文件,-r选项表示递归删除子目录。 hdfs dfs -setrep [-R] <path>:改变指定文件的副本数,-R选项用于递归改变目录下所有文件的副本数。 hdfs dfs -test [-ezd] <path>:检查指定文件或目录的相关信息。

-e (exist)检查文件是否存在,如果存在则返回0,否则返回1

-z (zero)检查文件是否是零字节,如果是则返回0,否则返回1

-d(directory)检查路径是否是目录,如果是则返回0,否则返回1hdfs dfs -text <path>:指定的文件输出为文本格式,文件格式允许是zip和TextRecordInputStream。

四、实例练习

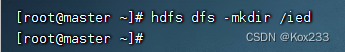

1、创建目录

1.1 创建单纯目录

- 执行命令:

hdfs dfs -mkdir /ied

仅支持创建单个目录,多个目录会报错

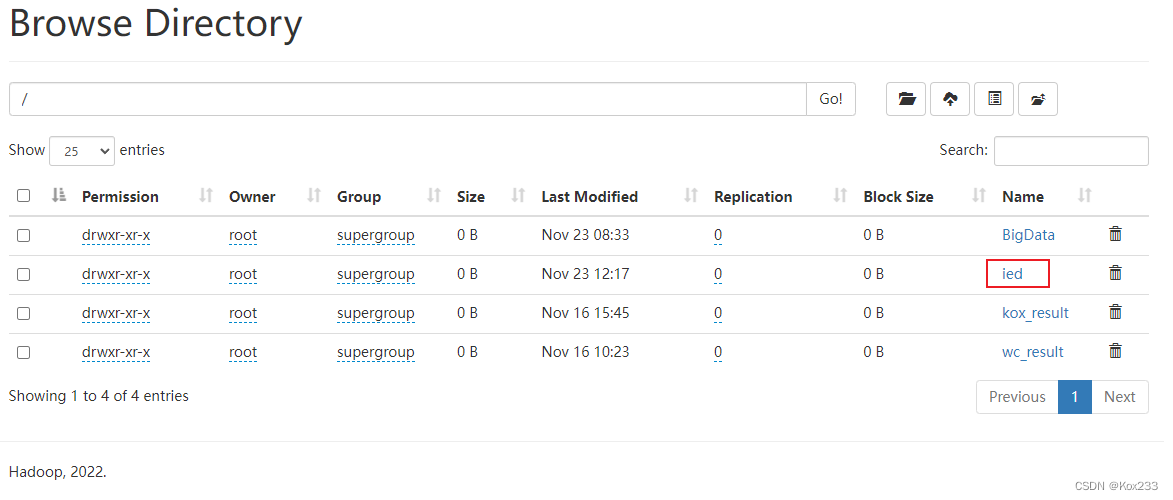

- 利用Hadoop WebUI查看创建的目录

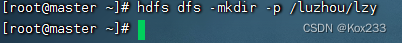

1.2创建多层目录 - 执行命令:

hdfs dfs -mkdir -p /luzhou/lzy

- 利用Hadoop WebUI查看创建的多层目录

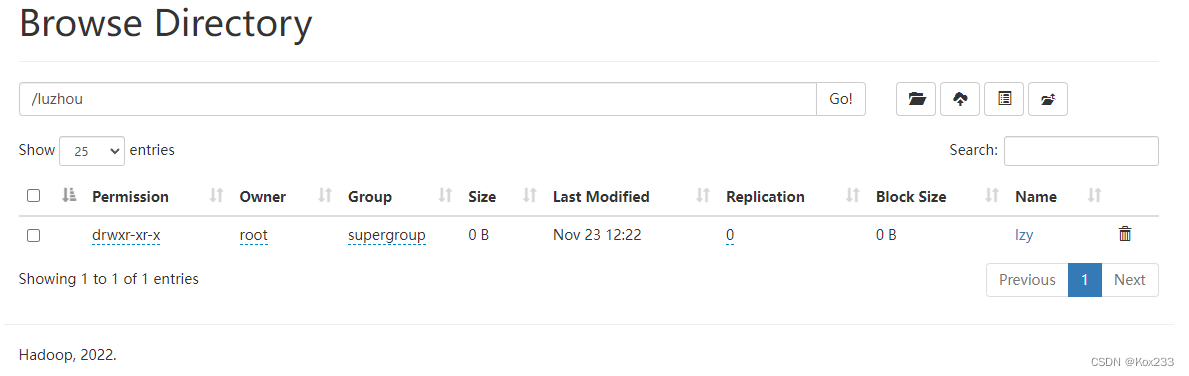

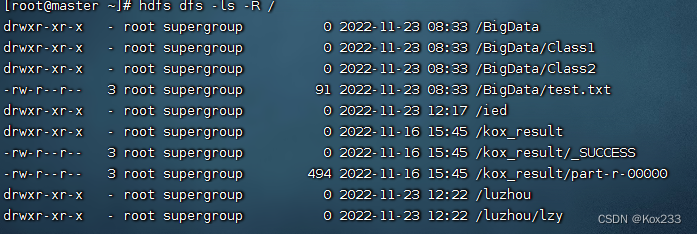

2、查看目录

- 执行命令:

hdfs dfs -ls /,查看根目录

如果要查看根目录里全部的资源,那么要用到地柜参数-R

- 执行命令:

hdfs dfs -ls -R /

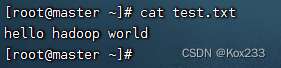

3、上传本地文件到HDFS

- 创建test.txt文件,执行命令:

echo "hello hadoop world" > test.txt - 查看test.txt文件内容

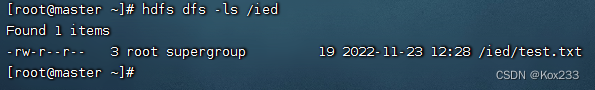

- 上传test.txt文件到HDFS的/ied目录,执行命令:

hdfs dfs -put test.txt /ied - 查看是否上传成功

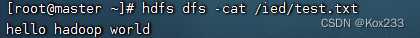

4、查看文件内容

- 执行命令:

hdfs dfs -cat /ied/test.txt

5、下载HDFS文件到本地

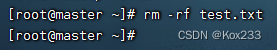

- 先删除本地的test.txt文件

- 下载HDFS文件系统的/ied/test.txt到本地当前目录不改名,执行命令:

hdfs dfs -get /ied/test.txt

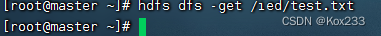

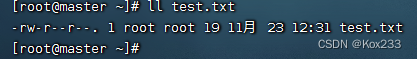

- 检查是否下载成功

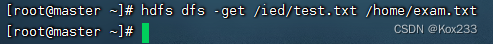

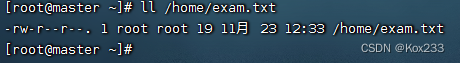

- 可以将HDFS上的文件下载到本地指定位置,并且可以更改文件名,执行命令:

hdfs dfs -get /ied/test.txt /home/exam.txt

- 检查是否下载成功

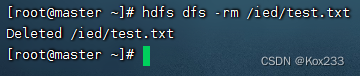

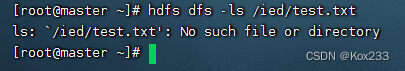

6、删除HDFS文件

- 执行命令:

hdfs dfs -rm /ied/test.txt

- 检查是否删除成功

使用通配符

*,可以删除满足一定特征的文件

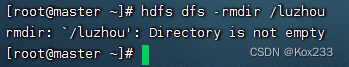

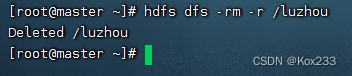

7、删除HDFS目录

- 执行命令:

hdfs dfs -rmdir /luzhou

-rmdir命令只能删除空目录

- 执行命令:

hdfs dfs -rm -r /luzhou

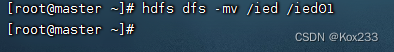

8、移动目录或文件

- 将/ied目录更名为/ied01,执行命令:

hdfs dfs -mv /ied /ied01

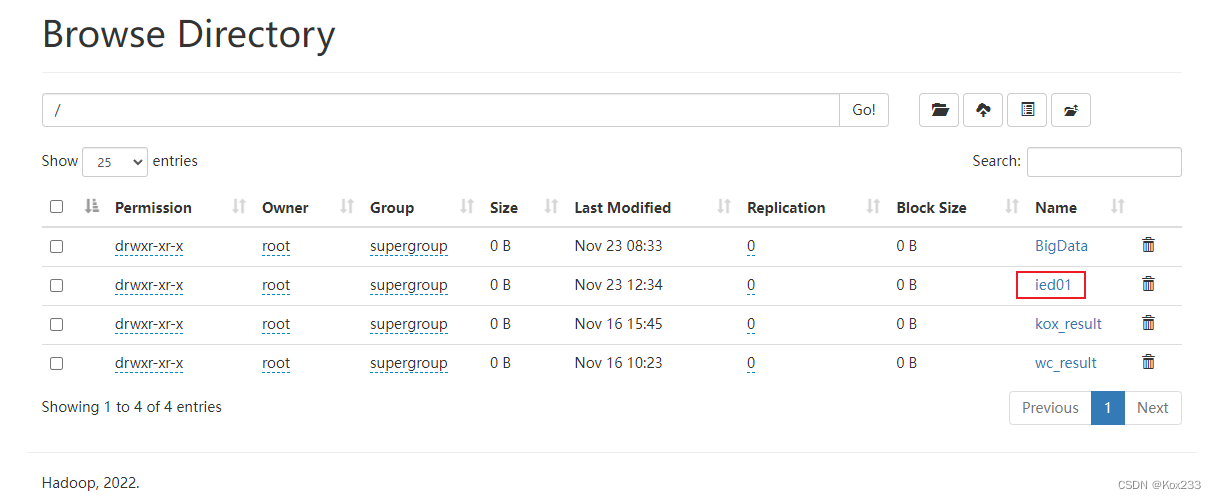

- 利用Hadoop WebUI查看是否更名成功

9、文件合并下载

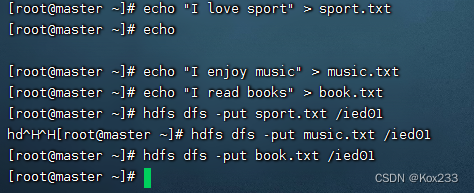

- 创建sport.txt、music.txt和book.txt并上传

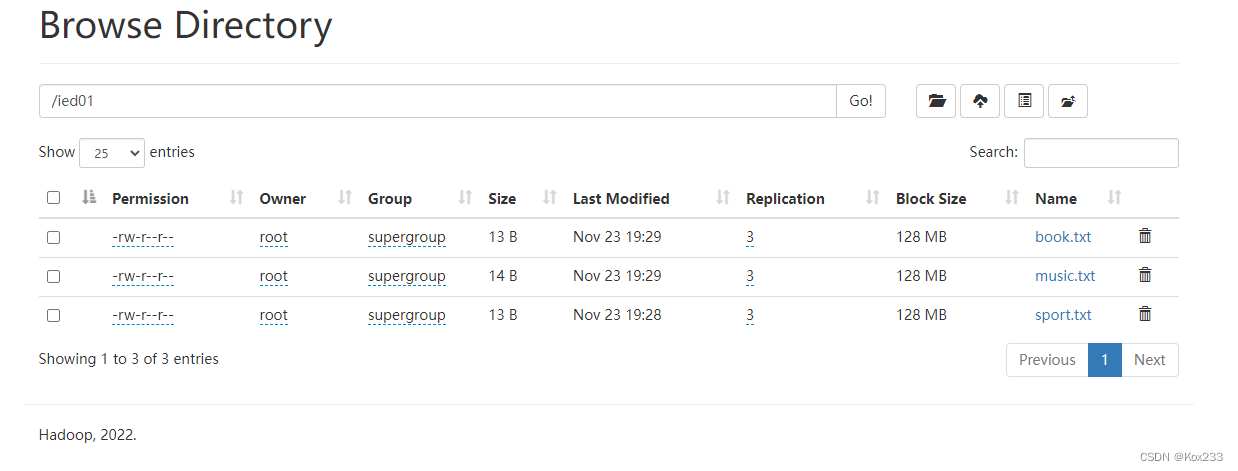

- 在Hadoop WebUI界面查看上传的三个文件,注意文件名是按字典排序了的

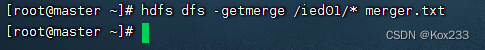

- 合并/ied01目录的文件下载到本地当前目录的merger.txt,执行命令:

hdfs dfs -getmerge /ied01/* merger.txt

- 查看本地的merger.txt,看是不是三个文件合并后的内容

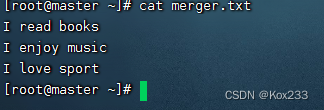

10、检查文件信息

- 检查/ied01/book.txt文件,执行命令:

hdfs fsck /ied01/book.txt -files -blocks -locations -racks

- 执行命令:

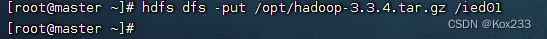

hdfs dfs -put /opt/hadoop-3.3.4.tar.gz /ied01,将hadoop压缩包上传到HDFS的/ied01目录

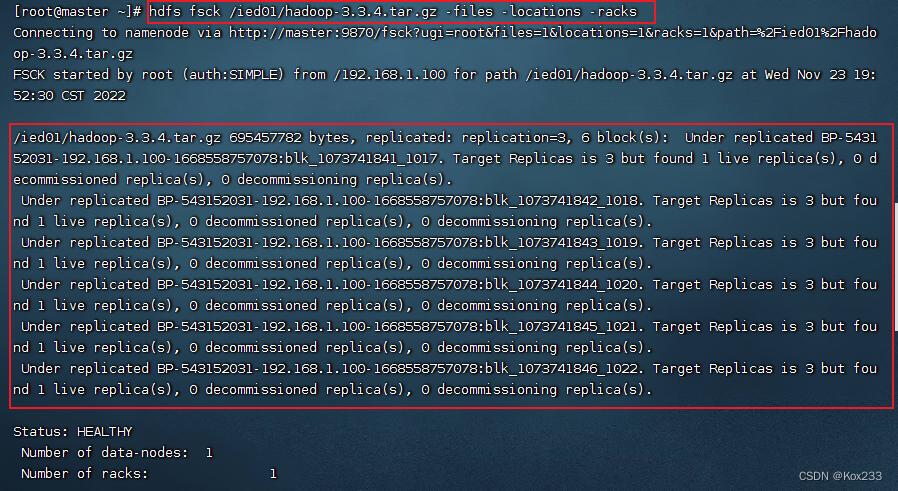

- 查看HDFS上hadoop-3.3.4.tar.gz文件信息,执行命令:

hdfs fsck /ied01/hadoop-3.3.4.tar.gz -files -locations -racks

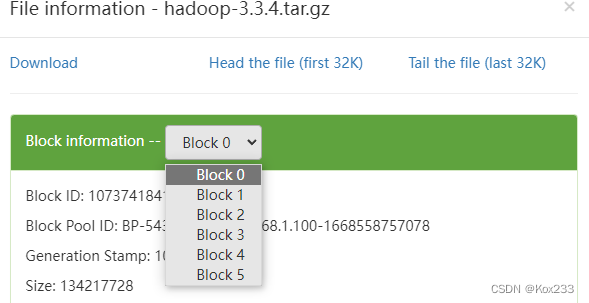

- 利用Hadoop WebUI来查看文件块信息更加方便,总共有6个文件块:Block0、Block1、Block2、Block3、Block4、Block5

11、创建时间戳文件

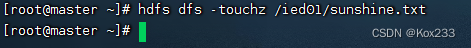

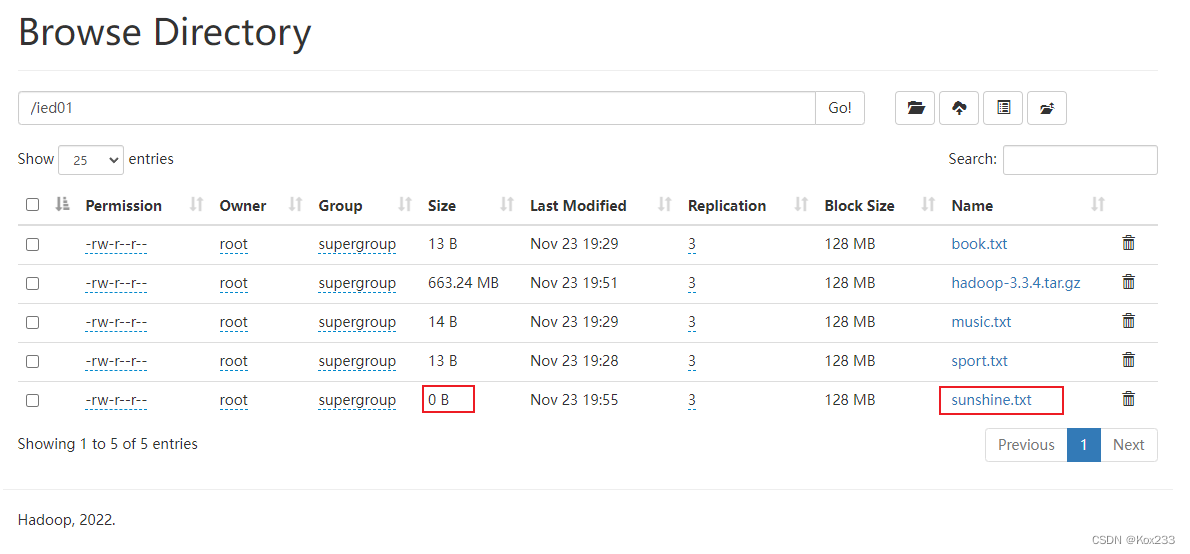

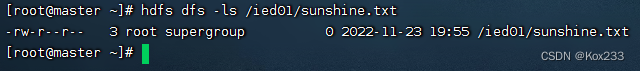

- 在/ied01目录里创建一个文件sunshine.txt,执行命令:

hdfs dfs -touchz /ied01/sunshine.txt

- 创建的是一个空文件,大小为0字节

- 这种空文件,一般用作标识文件,也可叫做时间戳文件,再次在/ied01目录下创建sunshine.txt同名文件

12、复制文件或目录

- cp: copy - 拷贝或复制

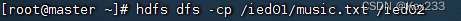

(1)同名复制文件

- 将/ied01/music.txt复制到/ied02里,执行命令:

hdfs dfs -cp /ied01/music.txt /ied02

(2)改名复制文件

- 将/ied01/book.txt复制到/ied02目录,改名为read.txt,执行命令:

hdfs dfs -cp /ied01/book.txt /ied02/read.txt

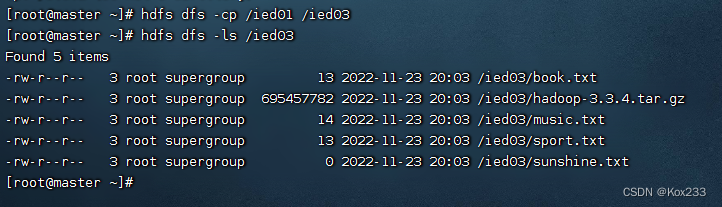

(3)复制目录

将/ied01目录复制到/ied03目录,执行命令:hdfs dfs -cp /ied01 /ied03

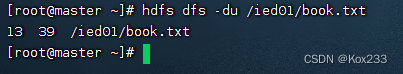

13、查看文件大小

- du: disk usage

执行命令:hdfs dfs -du /ied01/book.txt

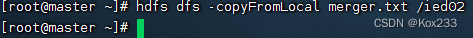

14、上传文件

- -copyFromLocal类似于-put,执行命令:

hdfs dfs -copyFromLocal merger.txt /ied02

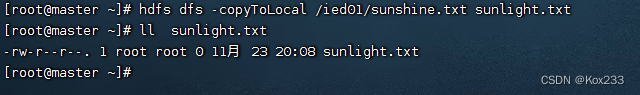

15、下载文件

- copyToLocal类似于-get,执行命令:

hdfs dfs -copyToLocal /ied01/sunshine.txt sunlight.txt

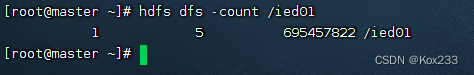

16、查看某目录下文件个数

- 执行命令:

hdfs dfs -count /ied01

17、检查hadoop本地库

- 执行命令:

hdfs checknative -a

18、进入和退出安全模式

(1)进入安全模式

- 执行命令:

hdfs dfsadmin -safemode enter, 注意:进入安全模式之后,只能读不能写

(2)退出安全模式

- 执行命令:

hdfs dfsadmin -safemode leave