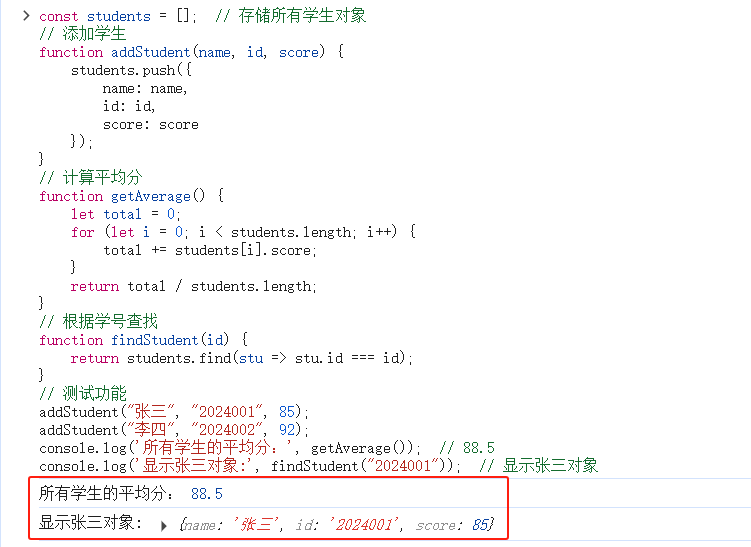

读书笔记

定义

1. 大数据(Big Data)

- 指传统数据处理工具难以处理的海量、高速、多样的数据集合,通常具备3V特性(Volume体量大、Velocity速度快、Variety多样性)。扩展后还包括Veracity(真实性)和Value(价值)。

2. Hadoop

- 一个开源的分布式计算框架,用于存储和处理大规模数据集。核心组件包括HDFS(存储)和MapReduce(计算),具有高容错性和横向扩展能力。

3. HDFS(Hadoop Distributed File System)

- Hadoop的分布式文件系统,设计用于**廉价硬件集群**。特点:

- 分块存储(默认128MB/块)

- 多副本机制(默认3副本)

- 主从架构(NameNode管理元数据,DataNode存储实际数据)

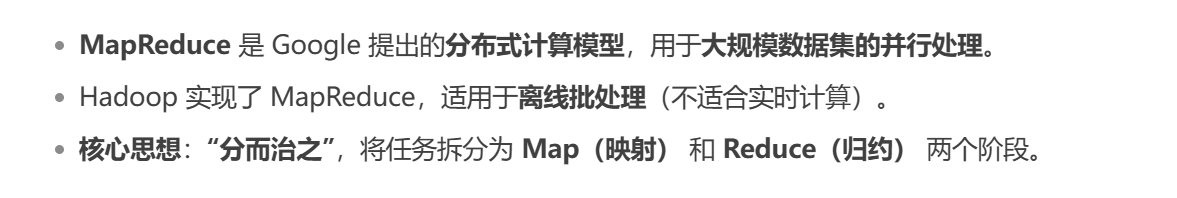

4. MapReduce

- 一种批处理编程模型,分为两个阶段:

- Map阶段:将任务分割成更小任务交给每台服务器分别运行,也就是并行处理输入数据(映射)

- Reduce阶段:聚合Map结果(归约)

- 适合离线大规模数据处理,但磁盘I/O开销较大。

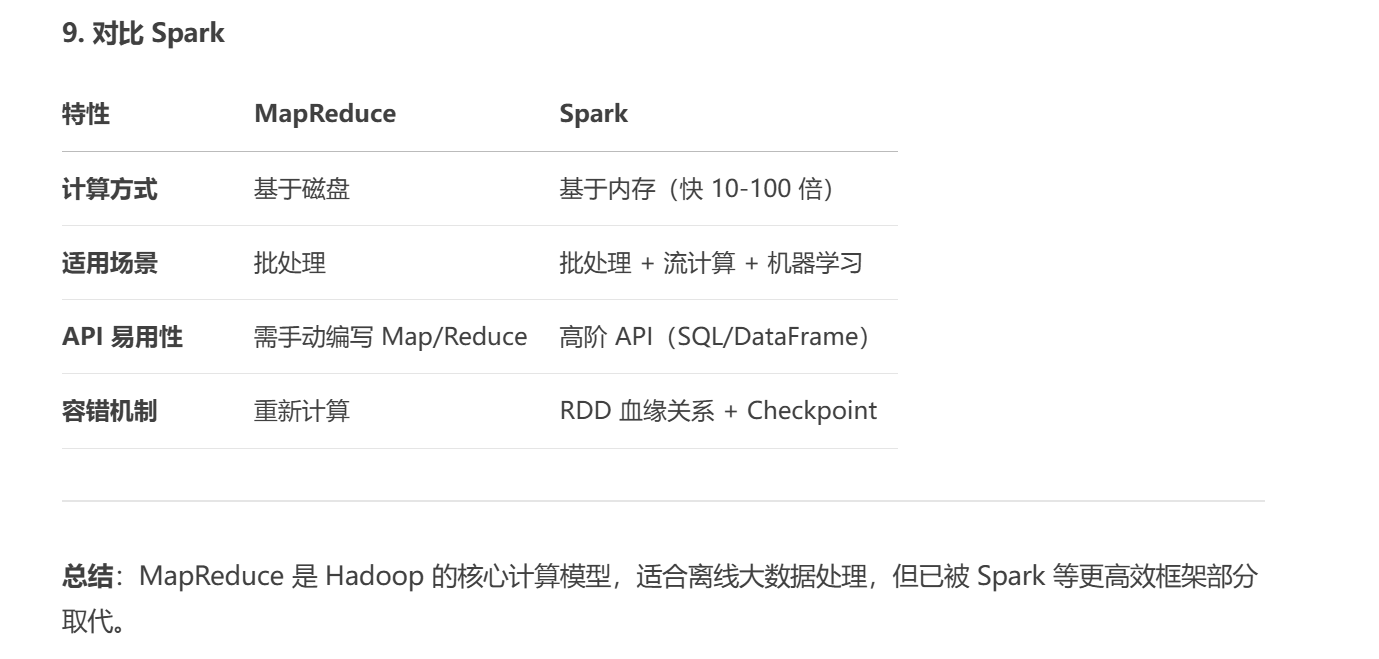

5. Spark

- 基于内存的分布式计算引擎,相比MapReduce优势:

- 内存计算(比Hadoop快10-100倍)

- 支持DAG(有向无环图)优化执行计划

- 提供SQL、流处理、图形处理、机器学习等统一API(Spark SQL/Streaming/GraphX/MLlib)

6. 机器学习(Machine Learning)

- 通过算法让计算机从数据中自动学习规律并做出预测/决策,主要分为:

- 监督学习(如分类、回归)

- 无监督学习(如聚类、降维)

- 强化学习(通过奖励机制学习)

关键区别:Hadoop基于磁盘批处理,Spark基于内存迭代计算,机器学习则是数据分析的高级应用方法。

安装Hadoop

1.虚拟机软件安装(搭建Hadoop cluster集群时需要很多台虚拟机)

2.安装Ubuntu操作系统(hadoop最主要在Linux操作系统环境下运行)

3.安装Hadoop Single Node Cluster(只以一台机器来建立Hadoop环境)

- 安装JDK(Hadoop是java开发的,必须先安装JDK)

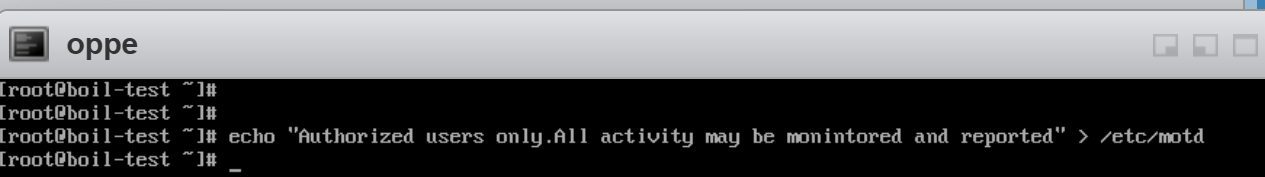

- 设置SSH无密码登录(Hadoop必须通过SSH与本地计算机以及其他主机连接,所以必须设置SSH)

- 下载安装Hadoop(官网下载Hadoop,安装到Ubuntu中)

- 设置Hadoop环境变量(设置每次用户登录时必须要设置的环境变量)

- Hadoop配置文件的设置(在Hadoop的/usr/local/hadoop/etc/hadoop的目录下,有很多配置设置文件)

- 创建并格式化HDFS目录(HDFS目录是存储HDFS文件的地方,在启动Hadoop之前必须先创建并格式化HDFS目录)

- 启动Hadoop(全部设置完成后启动Hadoop,并查看Hadoop相关进程是否已经启动)

- 打开Hadoop Web界面(Hadoop界面可以查看当前Hadoop的状态:Node节点、应用程序、任务运行状态)

常用命令:

启动HDFS

start-dfs.sh启动YARN(启动Hadoop MapReduce框架YARN)

start-yarn.sh同时启动HDFS和YARN

start-all.sh使用jps查看已经启动的进程(查看NameNode、DataNode进程是否启动)

PS:因为只有一台服务器,所以所有功能都集中在一台服务器中,可以看到:

- HDFS功能:NameNode、Secondary NameNode、DataNode已经启动

- MapReduce2(YARN):Resource Manager、NodeManager已经启动

jps

监听端口上的网络服务:

打开Hadoop Resource-Manager Web界面

http://localhost:8088/NameNode HDFS Web界面

http://localhost:50070/

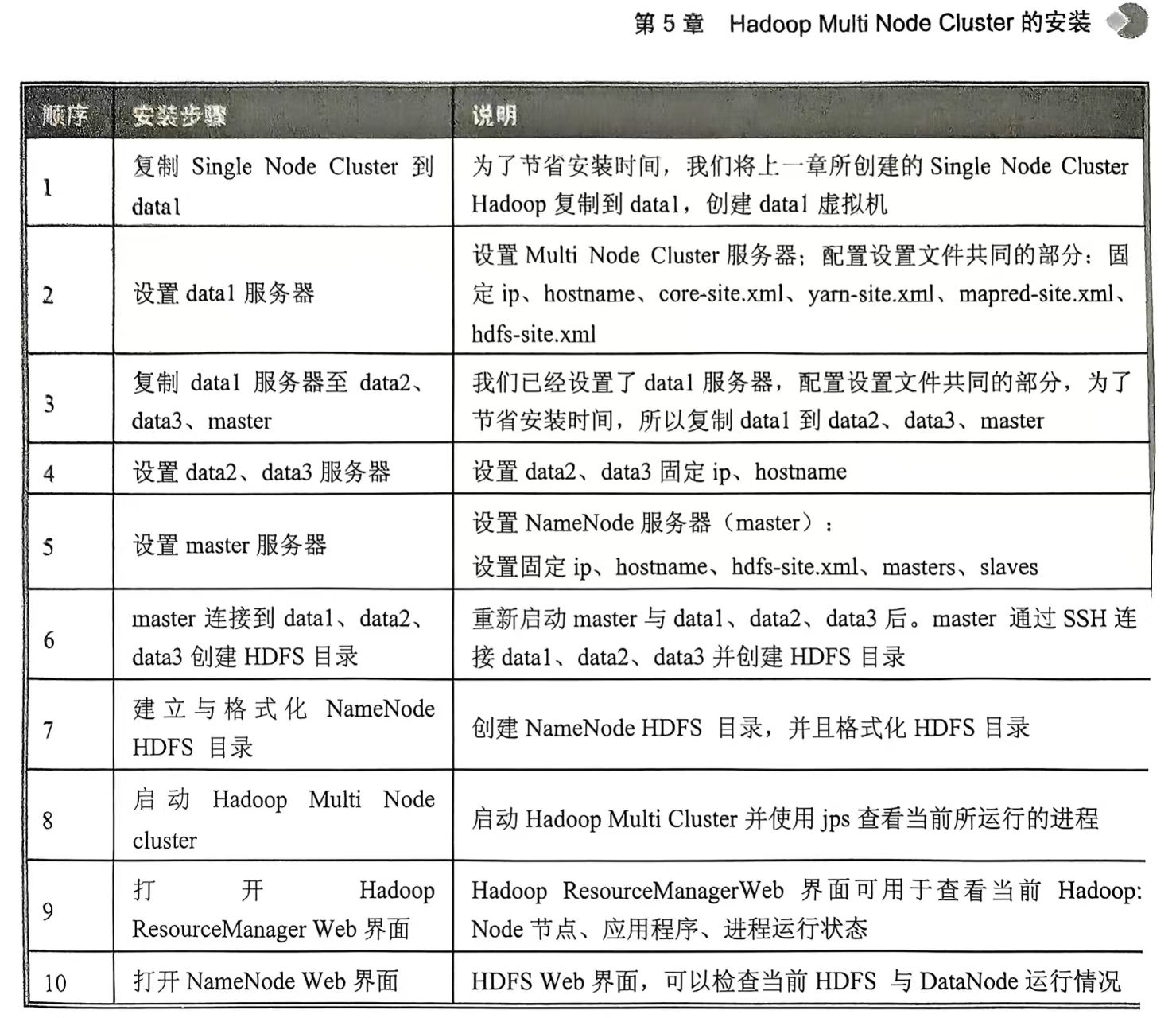

4.Hadoop Multi Node Cluster的安装(至少有四台服务器,才能发挥多台计算机并行的优势。不过我只有一个电脑,只能创建四台虚拟主机演练)

Hadoop的基本功能

1.HDFS

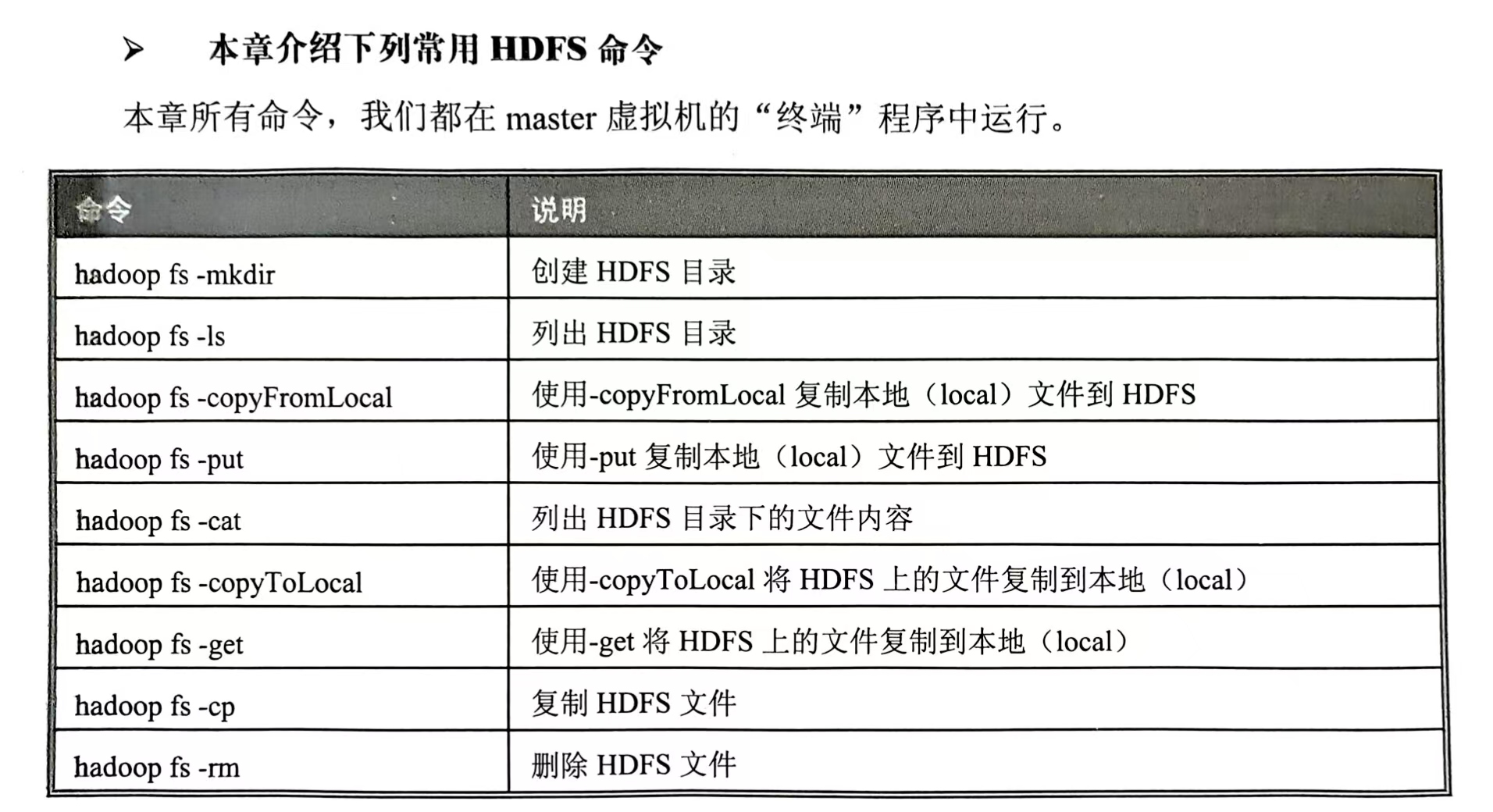

常用HDFS命令:

HDFS 常见命令 -CSDN博客

回头再写那些常用命令

2.MapReduce

以批处理为主。

首先使用Map将待处理的数据分割成很多的小份数据,由每台服务器分别运行。

再通过Reduce程序进行数据合并,最后汇总整理出结果。

单词计数

Spark

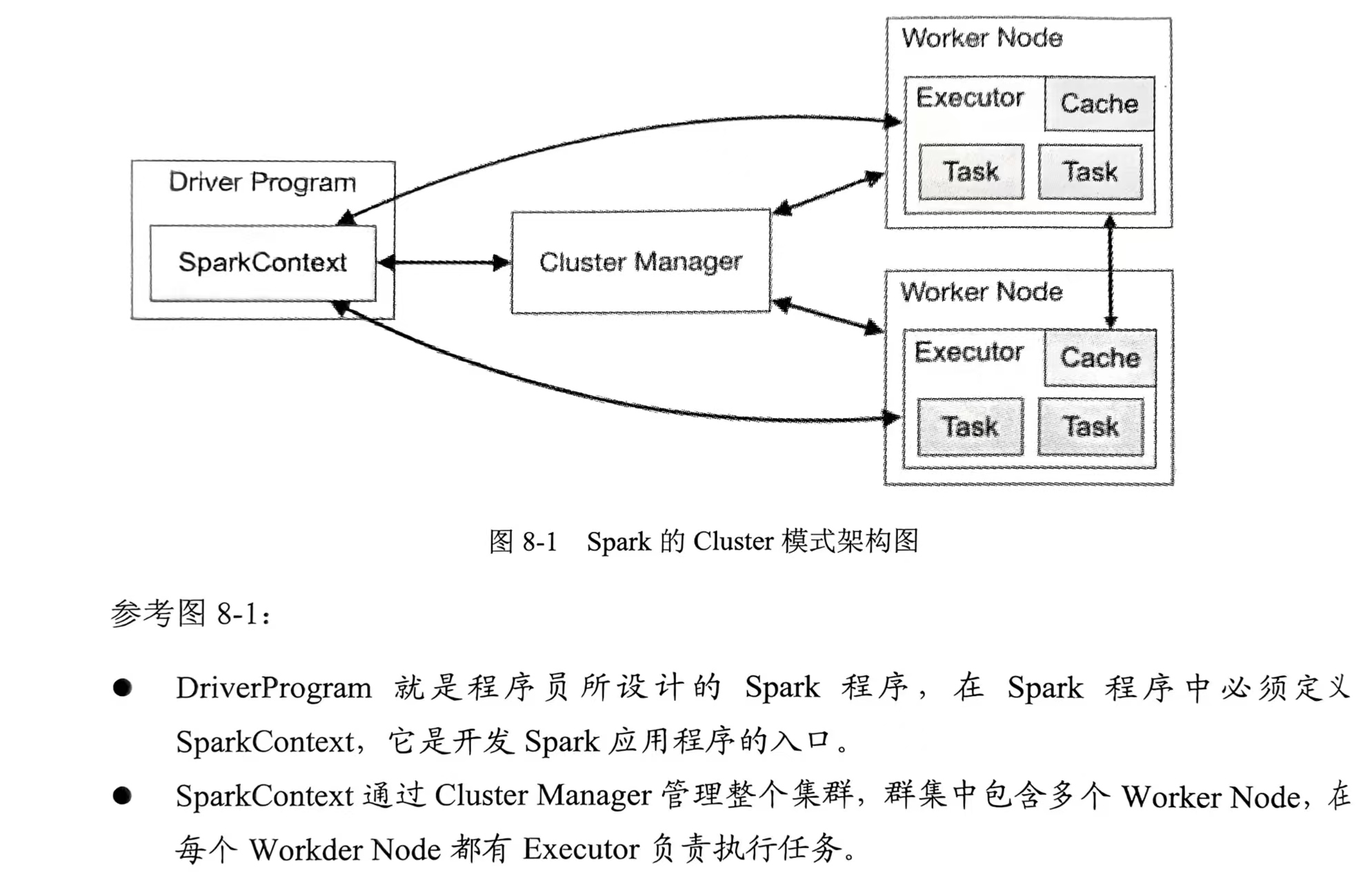

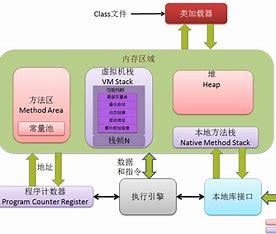

Spark的Cluster模式架构图👇

- 安装Spark

- 安装Scale

- 启动spark-shell交互界面

- 启动Hadoop(start-all.sh命令)

- 本地运行spark-shell(比如spark-shell --master local[4]->读取本地文件->读取HDFS文件)

- 在Hadoop YARN运行spark-shell(spark可以在Hadoop YARN上运行,让Yarn帮助它进行多台机器资源的管理。在Hadoop Yarn运行spark-shell->读取本地文件->读取HDFS文件->在Hadoop Web界面可以查看spark-shell APP,8080端口)

- 构建Spark Standalone Cluster执行环境(在master虚拟机设置spark-env.sh->复制spark程序到data1、data2、data3->在master虚拟机编辑slaves文件)

- 在Spark Standalone运行spark-shell(启动Spark Standalone Cluster也就是start-all.sh->在Spark Standalone运行Spark-shell->Spark Standalone Web UI界面->读取本地文件->读取HDFS文件->停止Spark stand alone cluster)

Spark本身是以Scala开发的,所以先安装Scala。试着安装在master虚拟机上。

安装:官网下载->解压缩并移动->配置环境变量->启动

PS:spark-shell默认显示很多信息,可以自己手动改,让它只显示警告信息。(cp复制log4j.properties.template模板到log4j.properties)👇

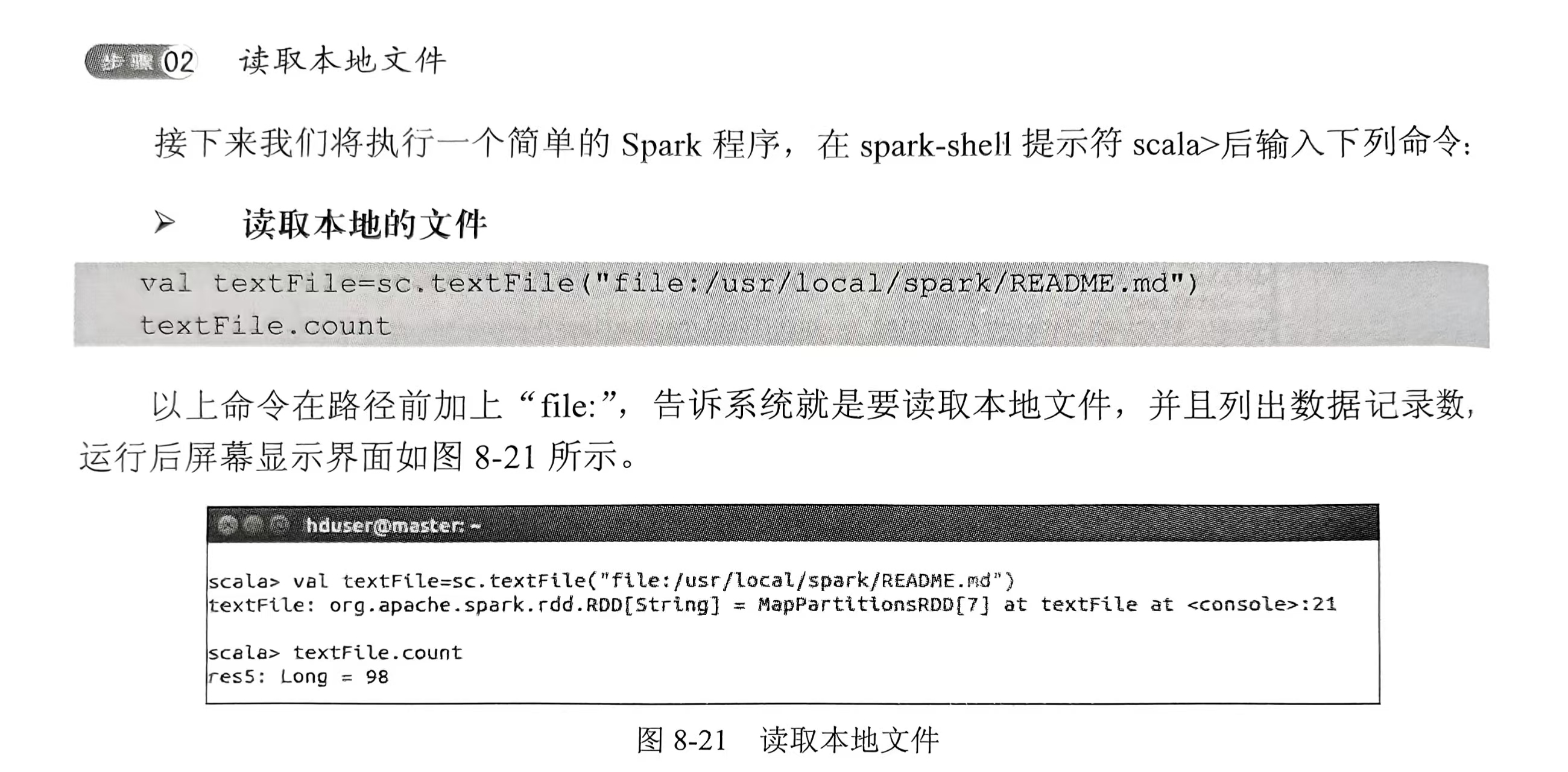

spark-shell --master local[4] 其中local[N]表示本地运行,使用N个线程,也就是说可以同时执行N个程序。

读取本地文件👇

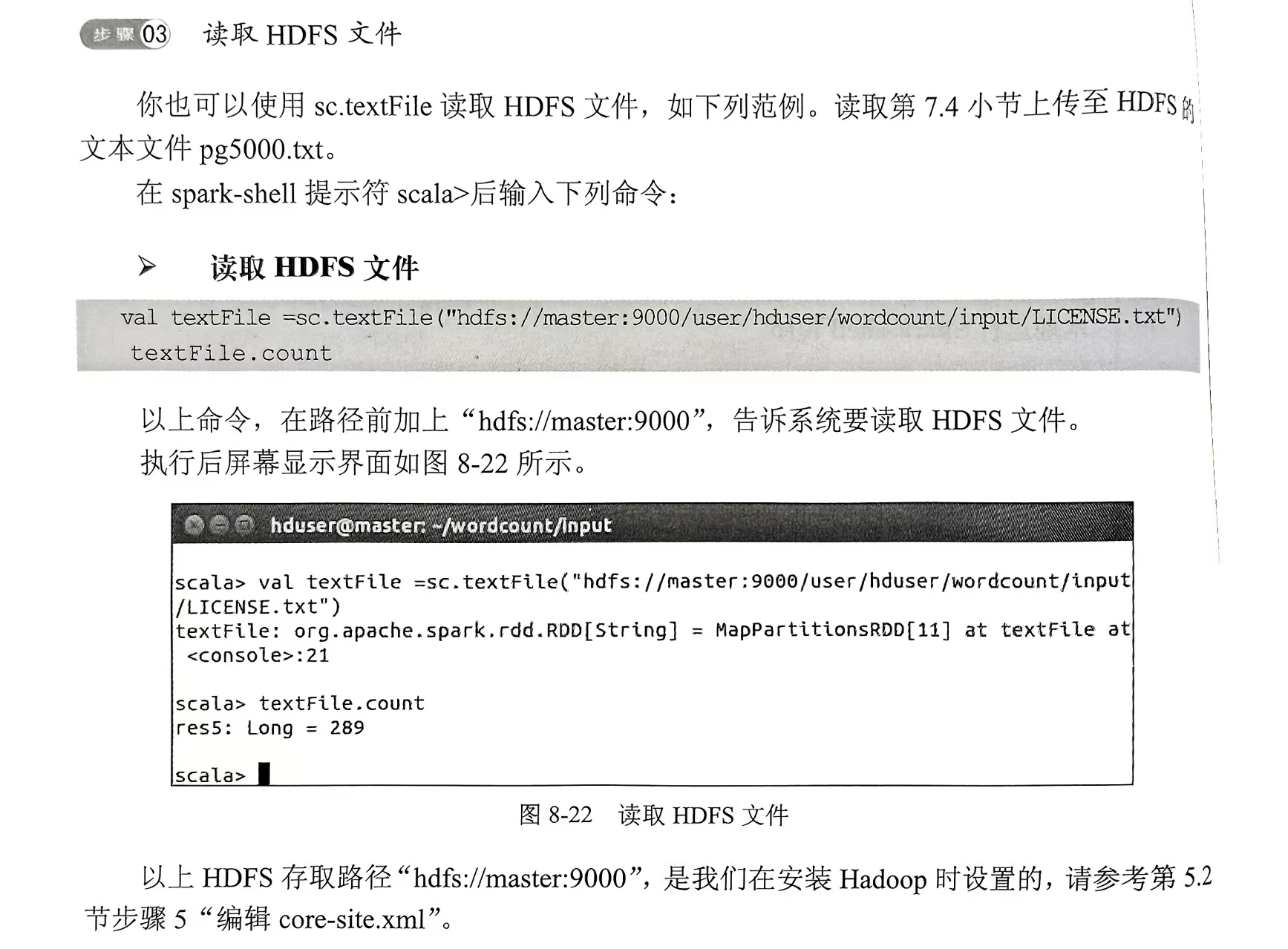

读取HDFS文件👇

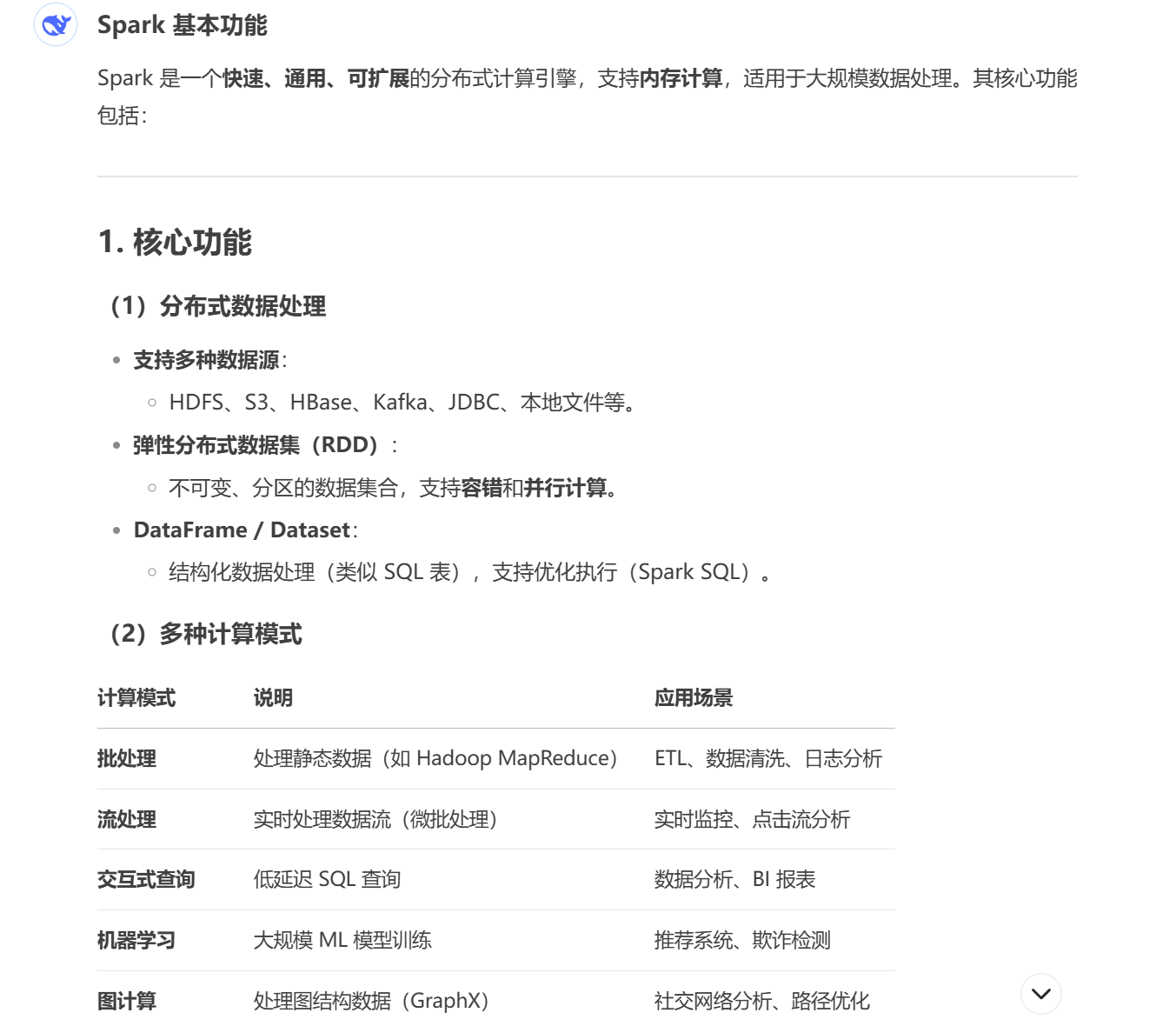

Spark的基本功能

1.RDD的特性

spark的核心是RDD(弹性分布式数据集),属于一种分布式的内存系统的数据集应用,RDD也是spark的主要优势。

RDD能与其他系统兼容,可以导入外部存储系统的数据集,如HDFS、Hbase或其他Hadoop数据源。

RDD的三种基本运算:转换Transformation、动作Action、持久化Persistence

2.基本RDD“转换”运算

- 先进入spark-shell

- 创建intRDD

- 创建stringRDD

- map运算

- map字符串运算

- filter数字运算

- filter字符串运算

- distinct运算

- randomSplit运算

- groupBy运算

命令就不写了,下面也是

3.多个RDD“转换”运算

- 先创建3个RDD来示范

- union并集运算

- intersection交集运算

- subtract差集运算

- cartersian笛卡尔乘积运算

4.基本“动作”运算

- 读取元素

- 统计功能

5.RDD Key-Value基本“转换”运算

- 创建范例Key-Value RDD

- 列出keys值

- 列出values值

- 使用filter筛选key运算

- 使用filter筛选value运算

- mapValues运算

- sortByKey从小到大按照key排序

- sortByKey从大到小按照key排序

- reduceByKey(如(3,4)(3,5)(1,1)相同key进行合并(3,9)(1,1))

6.多个RDD Key-Value“转换”运算

- 创建Key-Value RDD范例

- Key-Value RDD join运算

- Key-Value leftOuterJoin运算

- Key-Value rightOuterJoin运算

- Key-Value subtractByKey运算

7.Key-Value“动作”运算

- Key-Value first运算

- 读取第一条数据的元素

- Key-Value countByKey运算

- Key-Value collectAsMap运算

- 使用对照表转换数据

8.Broadcast广播变量

9.accumulator累加器

共享变量包括:

- Broadcast广播变量

- accumulator累加器

10.RDD Persistence持久化

Spark RDD持久化机制,可以用于将需要重复运算的RDD存储在内存中,以便大幅提升运算效率。

使用方法:

- RDD.persist()——可指定存储等级

- RDD.unpersist()——取消持久化

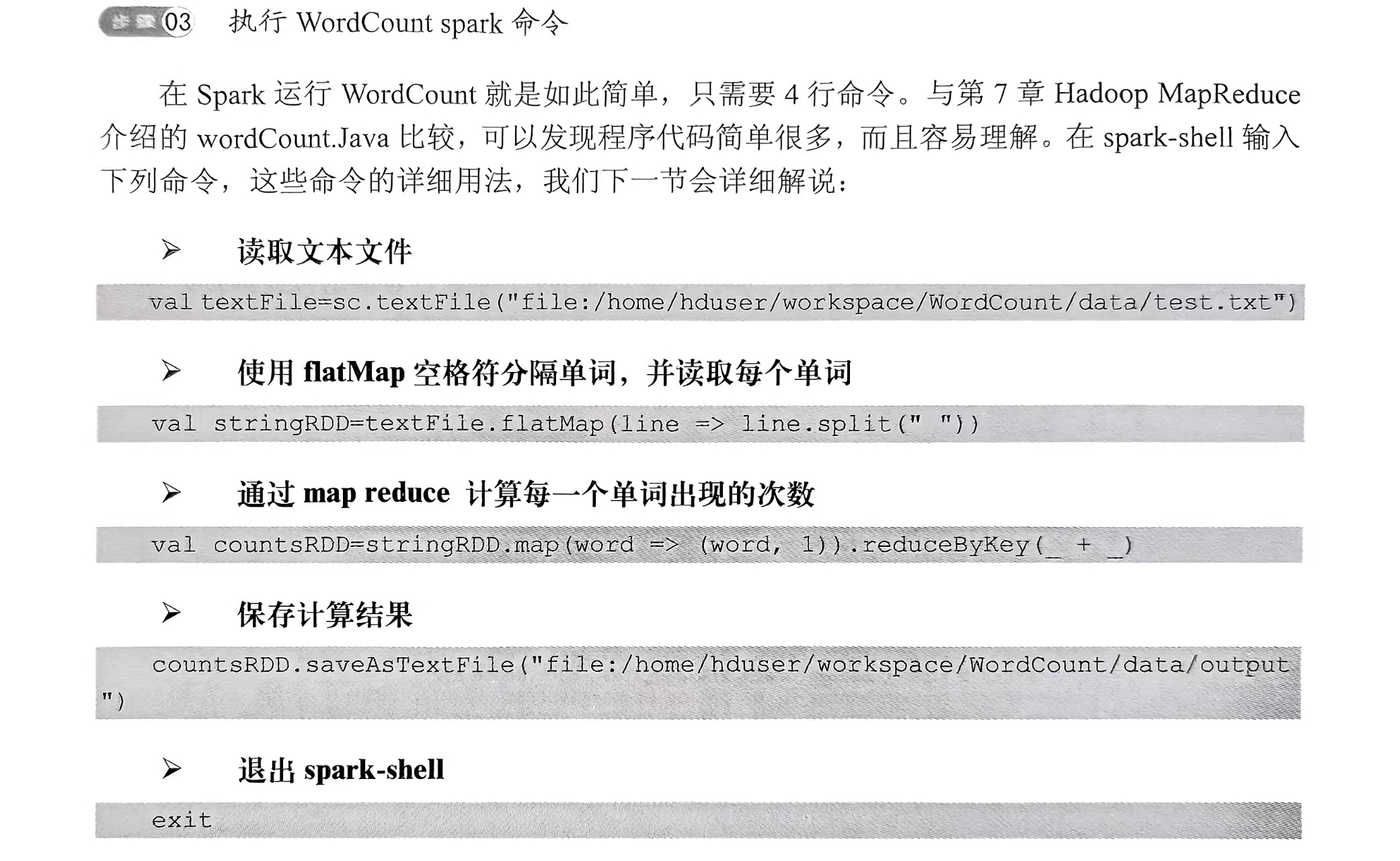

11.用Spark创建WordCount

- 创建测试文件(mkdir -p ~workspace/WordCount/data,cd到刚刚创建的文件夹,编辑test.txt)

- 进入spark-shell(~workspace/WordCount/data下输入spark-shell)

- 执行WordCount spark命令

- 查看data目录(ll)

- 查看output目录(cd output,ll,因为结果保存在/data/output)

- 查看part-00000输出文件(cat part-00000)

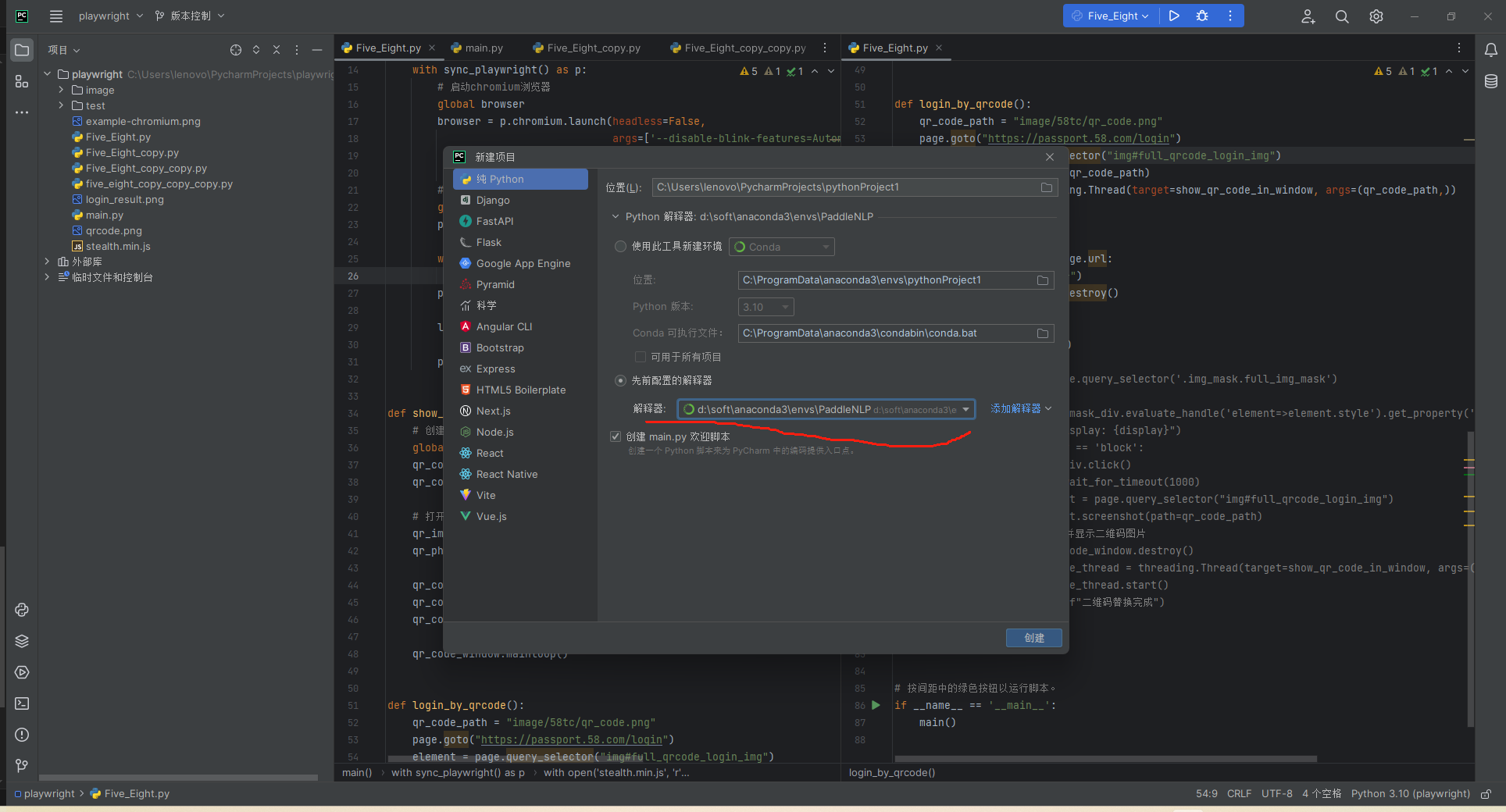

Spark的集成开发环境

使用eclipse集成开发环境(IDE)开发Spark应用程序。

- 下载与安装eclipse Scala IDE,安在master服务器上

- 下载项目所需要的Library

- 启动eclipse

- 创建新的Spark项目(要添加外部Jar或者创建后像第五步一样添加,设置scala library版本)

- 设置项目链接库

- 新建scala程序

- 创建WordCount测试文本文件

- 创建WordCount.scala

- 编译WordCount.scala程序

- 运行Word.scala程序

- 导出jar文件

- spark-submit介绍

- 在本地local模式运行WordCount程序(记得删除之前的/data/output目录,切换到WordCount目录,本地运行WordCount——spark-submit...代码巴拉巴拉,查看结果/data/output里)

- 在Hadoop yarn-client运行WordCount程序(介绍如何用spark-submit,在Hadoop YARN上运行WordCount Spark程序:启动集群start-all.sh->在HDFS创建data目录,复制LICENSE.txt文件到HDFS,查看HDFS->修改环境配置文件bashrc并使其生效->切换到WordCount项目目录,在Hadoop YARN上运行WordCount(spark-submit),查看HDFS产生的目录和文件,看完删除,因为一会还要测试)

- 在Spark Standalone Cluster上运行WordCount程序(仍然是启动Standalone Cluster->运行程序->看结果)

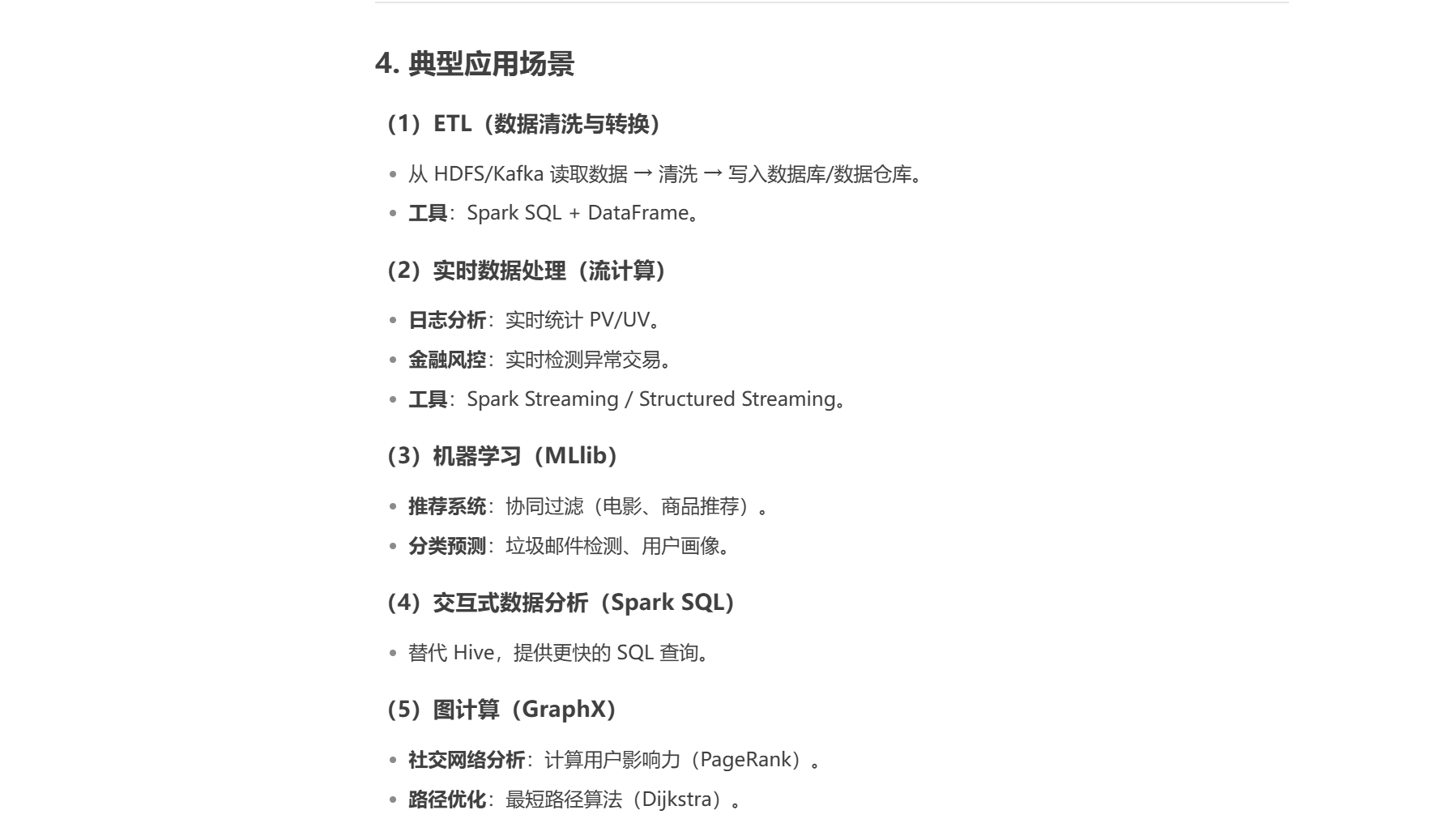

机器学习(推荐引擎)

几个概念和目录,实战。简写,主播也第一次学

- 推荐算法是啥

- 推荐引擎在大数据分析的几个使用场景:电影推荐

- ALS推荐算法

- ml-100k推荐数据(一个数据集)的下载

- 使用spark-shell导入ml-100k数据

- 查看导入的数据

- 使用ALS.train训练(ALS.train命令)

- 使用模型进行推荐

- 显示推荐电影名

- 创建Recommend项目(刚刚是用spark-shell学习的,它的缺点是无法重复使用,这次启动eclipse演示:启动eclipse->创建Recommend项目->创建Recommend.scala文件->起个名字吧->创建完成的Scala程序,接下来开始输入程序代码)

- Recommend.scala程序代码(Import导入链接库->main主函数代码(数据准备、训练、推荐)->SetLogger可设置不显示log信息)

- 创建PrepareData()数据准备(创建PrepareData()函数->创建用户评分数据->创建电影ID与名称对照表->显示数据记录数)

- recommend()推荐程序代码(recommend()推荐程序代码、RecommendMovies()针对此用户推荐电影)

- 运行Recommend.scala

- 创建AIsEvaluation.scala调校推荐引擎参数(前面使用的ALS.train命令训练,会返回model训练完成的模型,其中rank、Iterations、lambda这些参数值的设置会影响结果的准确度,以及训练所需的时间。接下来将进行调校找出最佳的参数组合)

- 创建PrepareData()数据准备(共有4步,前3部与Recommend.scala完全相同:1.创建用户评分数据;2.创建电影ID与名称对照表;3.显示数据记录数;4.以随机方式将数据分为3个部分并且返回(以8:1:1比例分成训练数据、验证数据、测试数据))

- 进行训练评估(1.train Validation训练评估:评估rank参数、评估numIterations参数、评估lambda参数、所有参数交叉评估。2.evaluateParamter评估单个参数。3.Chart.plotBarLineChart绘制出柱形图与折线图。4.trainModel训练模型。5.计算RMSE,表示预测与实际的误差平均值,通常RMSE越小误差越小。6.evaluateAllParameter程序将三个参数交叉评估找出最好的参数组合)

- 运行AlsEvaluation(运行AlsEvaluation,评估rank参数,评估lambda参数、所有参数交叉评估找出最好的参数组合)

- 修改Recommend.scala为最佳参数组合(刚刚我们已经找出了最佳参数组合)

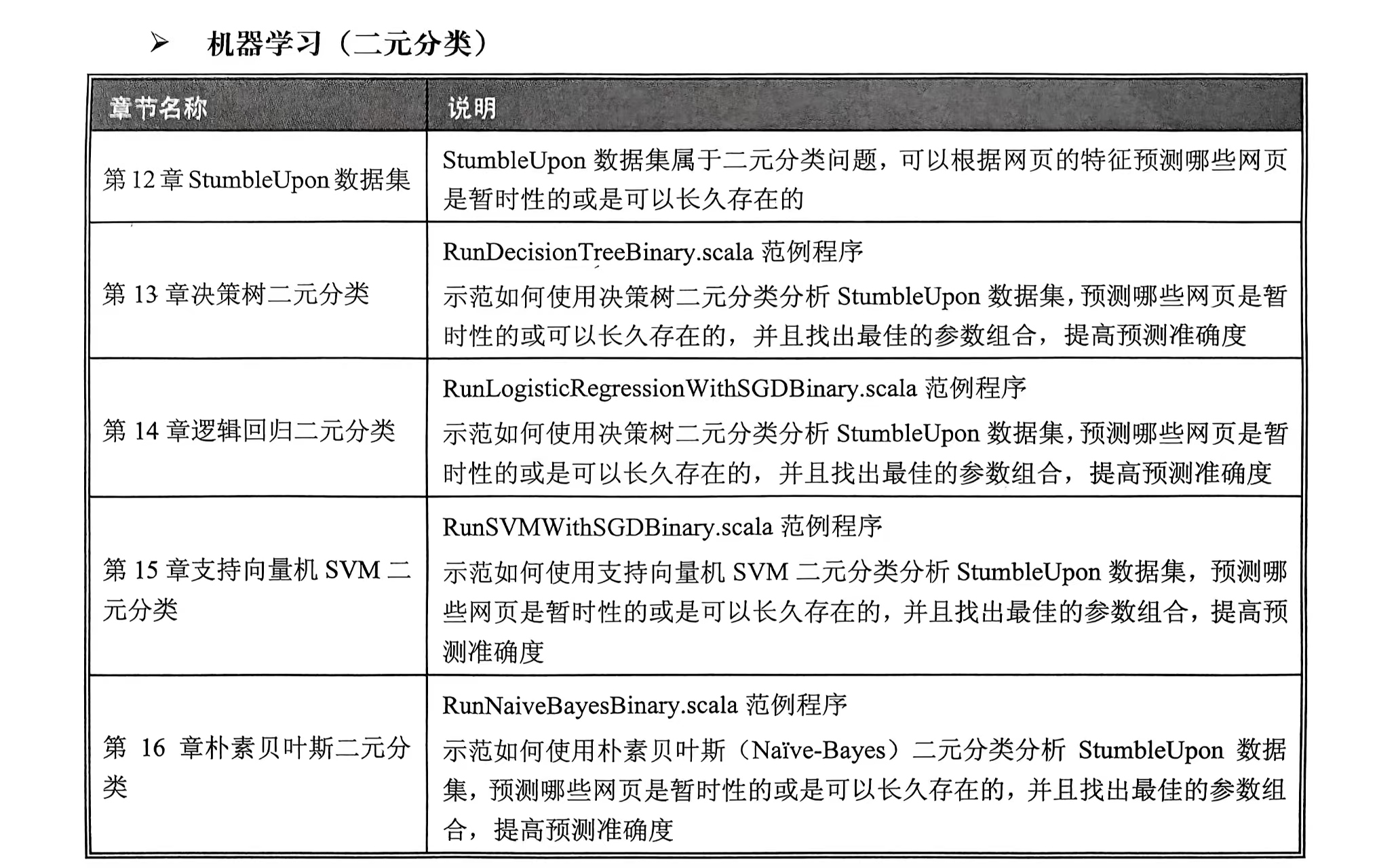

机器学习(二元分类)

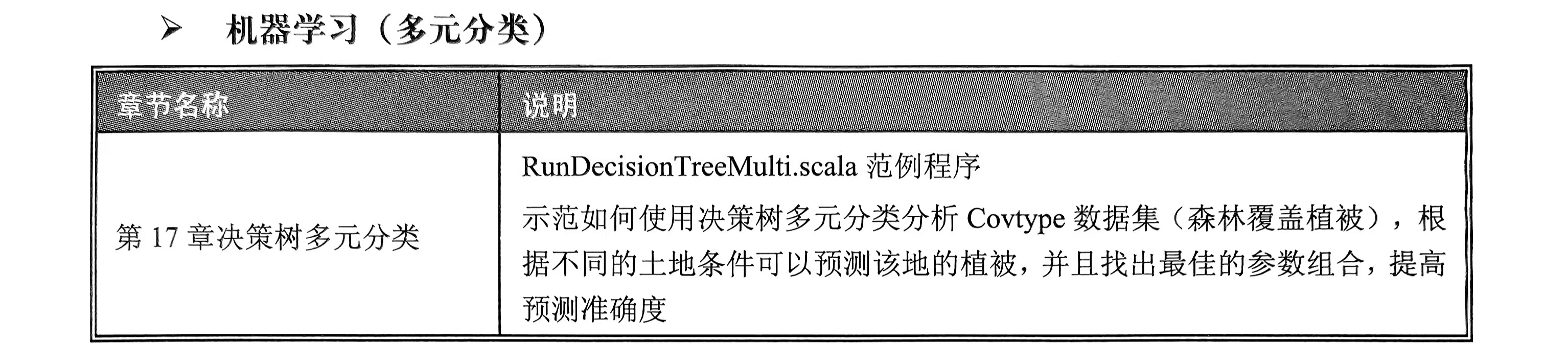

机器学习(多元分类)

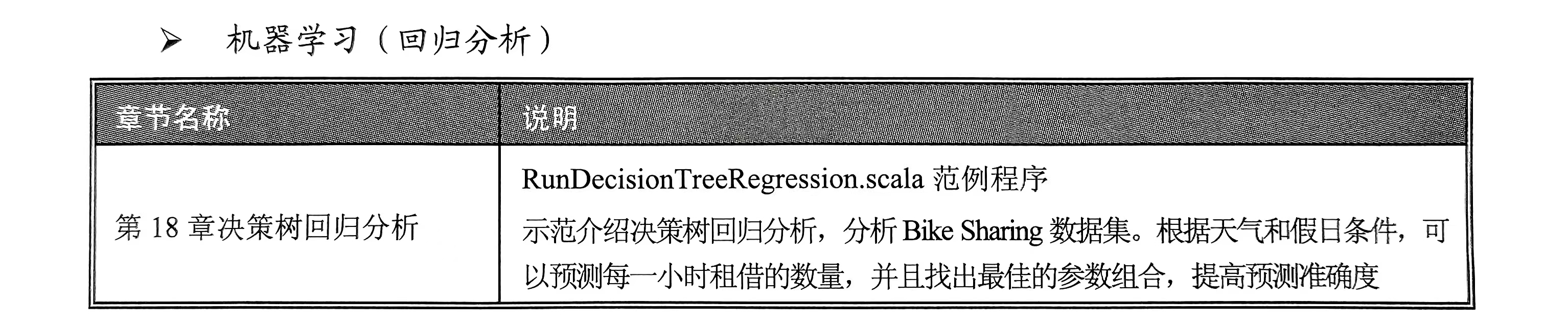

机器学习(回归分析)

数据可视化

使用Apache Zeppelin数据可视化。

![[Java · 铢积寸累] 数据结构 — 数组类型 - 增 删 改 查](https://i-blog.csdnimg.cn/direct/6104fcecf60e445999cf0e525c22499f.png)