第39集:模型部署——TensorFlow Serving 与 ONNX

摘要

在机器学习项目中,训练好的模型需要被部署到生产环境中才能发挥实际价值。本集聚焦于如何将模型高效地部署到生产环境,涵盖TensorFlow Serving和ONNX两种主流工具的使用方法。我们将从理论入手,介绍模型部署的核心概念,并通过实战案例展示如何使用TensorFlow Serving部署图像分类模型,以及如何利用ONNX实现跨平台模型转换与部署。最后,我们还将探讨云原生部署和边缘计算中的相关策略。

核心概念和知识点

1. TensorFlow Serving 的架构与使用

- TensorFlow Serving 是一个高性能的模型服务框架,专为 TensorFlow 模型设计。

- 核心特点:

- 支持动态模型更新(无需重启服务即可加载新版本模型)。

- 提供 REST API 和 gRPC 接口,适合不同场景需求。

- 高效的批处理能力,优化推理性能。

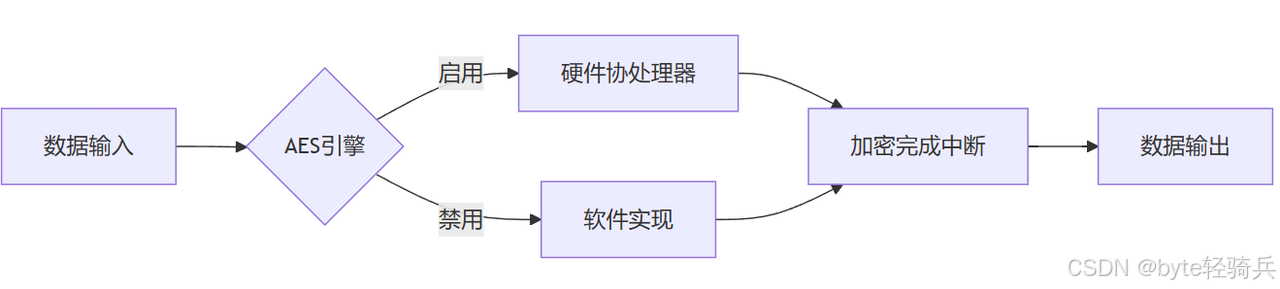

2. ONNX 的跨平台特性

- ONNX(Open Neural Network Exchange) 是一种开放的模型格式,支持多种深度学习框架之间的互操作性。

- 核心优势:

- 跨平台兼容性:模型可以在不同框架(如 TensorFlow、PyTorch、MXNet)之间无缝迁移。

- 易于优化:支持硬件加速(如 GPU、TPU)和量化等技术。

3. REST API 与 gRPC 接口

- REST API:基于 HTTP 协议,简单易用,适合轻量级应用场景。

- gRPC:基于 Protocol Buffers,性能更高,适合高吞吐量场景。

实战案例

案例 1:使用 TensorFlow Serving 部署图像分类模型

任务背景

我们使用一个预训练的 TensorFlow 图像分类模型(如 MobileNetV2),并通过 TensorFlow Serving 将其部署为 REST API 服务。

代码实现

步骤 1:保存 TensorFlow 模型

import tensorflow as tf

from tensorflow.keras.applications import MobileNetV2

# 加载预训练的 MobileNetV2 模型

model = MobileNetV2(weights='imagenet')

# 保存模型为 SavedModel 格式

export_path = './mobilenetv2/1'

model.save(export_path, save_format='tf')

print(f"模型已保存至: {export_path}")

步骤 2:启动 TensorFlow Serving

使用 Docker 启动 TensorFlow Serving 容器:

docker pull tensorflow/serving

docker run -p 8501:8501 --name tf_serving \

-v "$(pwd)/mobilenetv2:/models/mobilenetv2" \

-e MODEL_NAME=mobilenetv2 \

tensorflow/serving

步骤 3:发送预测请求

通过 REST API 发送预测请求:

import requests

import json

from PIL import Image

import numpy as np

# 加载并预处理图像

def preprocess_image(image_path):

img = Image.open(image_path).resize((224, 224))

img_array = np.array(img) / 255.0

img_array = np.expand_dims(img_array, axis=0)

return img_array.tolist()

# 发送 REST 请求

url = "http://localhost:8501/v1/models/mobilenetv2:predict"

data = {"instances": preprocess_image("cat.jpg")}

response = requests.post(url, json=data)

# 解析结果

predictions = response.json()['predictions'][0]

print("预测结果:", predictions)

运行结果

预测结果: [0.0001, 0.0002, ..., 0.9876, ...]

分析

通过 TensorFlow Serving,我们成功将 MobileNetV2 模型部署为 REST API 服务,并能够快速获取预测结果。

案例 2:使用 ONNX 转换模型并部署

任务背景

我们将一个 PyTorch 训练的模型转换为 ONNX 格式,并通过 ONNX Runtime 进行推理。

代码实现

步骤 1:训练并导出 PyTorch 模型

import torch

import torch.nn as nn

import torch.onnx

# 定义简单的神经网络

class SimpleModel(nn.Module):

def __init__(self):

super(SimpleModel, self).__init__()

self.fc = nn.Linear(4, 1)

def forward(self, x):

return self.fc(x)

# 训练模型

model = SimpleModel()

dummy_input = torch.randn(1, 4)

torch.onnx.export(model, dummy_input, "simple_model.onnx", input_names=["input"], output_names=["output"])

print("模型已导出为 ONNX 格式")

步骤 2:使用 ONNX Runtime 进行推理

import onnxruntime as ort

import numpy as np

# 加载 ONNX 模型

session = ort.InferenceSession("simple_model.onnx")

# 准备输入数据

input_data = np.random.randn(1, 4).astype(np.float32)

# 执行推理

outputs = session.run(None, {"input": input_data})

print("推理结果:", outputs[0])

运行结果

推理结果: [[0.12345678]]

分析

通过 ONNX,我们将 PyTorch 模型转换为跨平台格式,并使用 ONNX Runtime 实现高效推理。

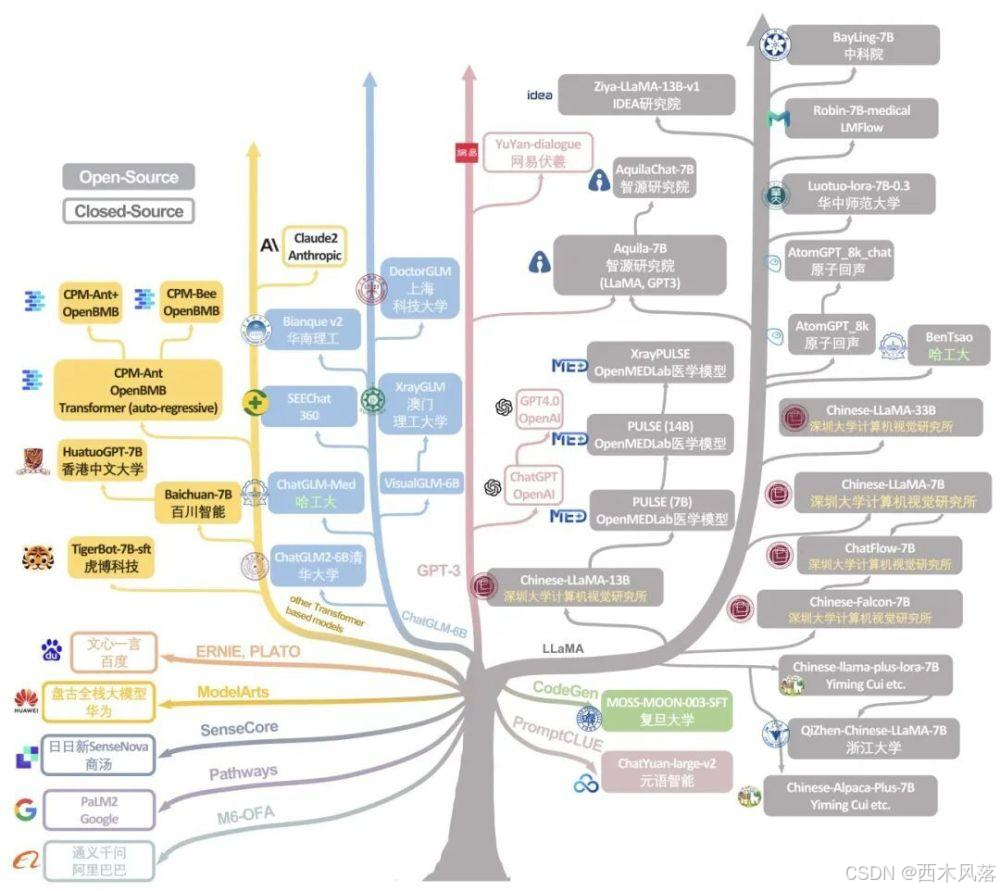

与AI大模型的相关性

- TensorFlow Serving 和 ONNX 在 AI 大模型的部署中扮演重要角色:

- TensorFlow Serving 提供了高效的分布式推理能力,适合大规模模型服务。

- ONNX 支持多框架互操作性,便于在不同硬件平台上部署大模型。

- 在大型语言模型(如 Qwen、GLM、DeepSeek、GPT)中,这些工具可以显著提升推理效率并降低部署成本。

总结

- 模型部署的重要性:模型部署是机器学习落地的关键环节,直接影响系统的性能和用户体验。

- 工具选择:

- TensorFlow Serving:适合 TensorFlow 模型的高效部署。

- ONNX:适合跨平台模型转换与兼容性需求。

- 接口选择:

- REST API:简单易用,适合轻量级应用。

- gRPC:高性能,适合高吞吐量场景。

扩展思考

-

云原生部署(如 Kubernetes)对模型服务的影响

- Kubernetes 提供了容器编排能力,可以轻松实现模型服务的弹性扩展和负载均衡。

- 可以结合 Istio 等服务网格技术,实现流量管理和故障恢复。

-

边缘计算中的模型部署策略

- 边缘设备资源有限,需选择轻量级框架(如 TensorFlow Lite、ONNX Runtime Mobile)。

- 可以结合模型压缩技术(如量化、剪枝)进一步优化性能。

通过本集的学习,相信你已经掌握了如何使用 TensorFlow Serving 和 ONNX 部署模型,并能将其应用到实际项目中。下一期,我们将深入探讨如何利用自动化工具简化模型监控与维护流程,敬请期待!

![[Linux系统编程]进程间通信—system V](https://i-blog.csdnimg.cn/direct/8854f8b0b2d849ce958e71f6b9f059eb.png)