今天和大家聊聊嵌入式开发中让无数新手头疼,但又避不开的HardFault。

还记得我刚入行那会儿,信誓旦旦改了几行代码,信心爆棚地烧录进板子。结果呢?灯!没!亮!调试器显示程序卡在了HardFault_Handler里。屏幕上密密麻麻的代码仿佛在嘲笑我的无知。当时我的内心是崩溃的:“这…这啥玩意儿?下一步咋办?” 相信不少小伙伴都经历过这种“人生滑铁卢”时刻。今天就来系统性地扒一扒HardFault。

1. HardFault是啥?为啥老是"搞事情"?

简单粗暴地说,HardFault就是处理器“罢工”了!它通常发生在你的代码试图做一些“出格”的事情时,比如:

- 非法闯入“禁区”: 访问没有权限或者根本不存在的内存地址 (内存越界、空指针等)

- 指令“耍流氓”: 执行处理器压根不认识的指令 (代码跑飞)

- 数学“作死”: 经典的除以零错误

- 硬件“罢工”: 访问了未使能的外设或协处理器

不同的处理器架构对故障的处理方式和叫法可能不一样,这里我们主要聊 ARM Cortex-M 系列,因为用得最广。但原理是通用的,学会Cortex-M,其他也都触类旁通!

Cortex-M 的故障类型主要有四种,记住它们,调试时才能快速定位:

- 总线故障 (Bus Fault): 内存或外设访问出了岔子

- 内存管理故障 (Memory Management Fault): 触碰了 MPU/MMU 划定的内存红线

- 使用故障 (Usage Fault): 代码本身有问题,比如指令错误、对齐错误、除零等

- 硬故障 (Hard Fault): 最“高级别”的故障,前面三种故障没处理好,或者处理故障的过程中又出幺蛾子,就会升级成HardFault。

2. 默认故障处理函数:while(1)?简直是新手陷阱!

很多芯片厂商提供的SDK,像 STM32的Hal和 Nordic 的 nrfx (除了用Zephyr内核的 nRF Connect SDK),都会把HardFault处理函数默认设置成一个死循环 while(1)。

void HardFault_Handler(void)

{

while (1)

{

// 程序就卡死在这里,啥也不干

}

}

厂商的本意是好的,想让你程序卡住,方便你接上调试器慢慢分析。但这个默认设置对于产品级应用来说绝对是个坑!

为啥?因为你总不能让你的产品在用户手里,遇到故障就原地去世,永不超生吧? 想象一下用户抓狂的表情…

3. 手动HardFault调试:菜鸟的步步惊心

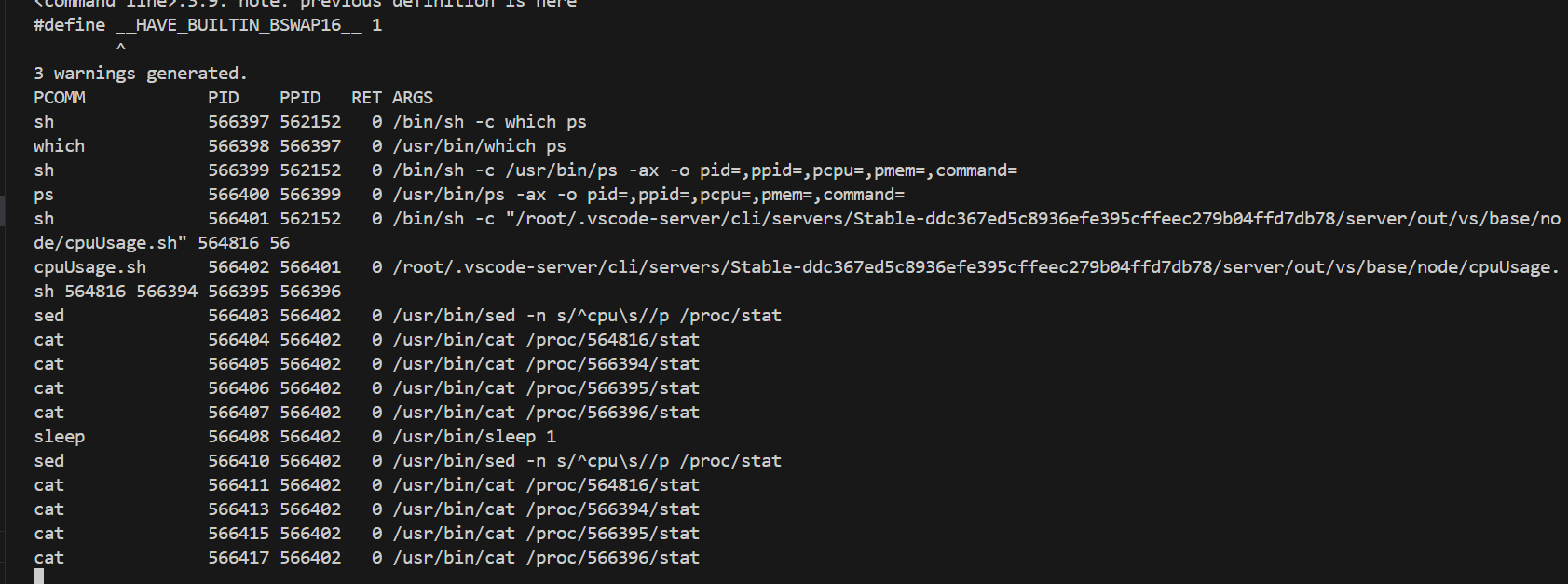

刚开始,大家可能都会用最原始的手动调试方法。就像我当年一样,对着调试器一脸茫然。熟练之后,大概会按以下步骤操作:

- 连接调试器 (废话)

- 看 CFSR 寄存器,判断是哪种故障 (Bus Fault? Usage Fault?)

- 查芯片手册,搞清楚 UFSR、BFSR、MMFSR 这些缩写都是啥意思

- 对着手册解读寄存器标志位,尝试定位错误原因 (眼都看花了)

- 分析 BFAR 和 MMFAR 寄存器,看能不能找到更多线索

- 回忆堆栈结构,看看故障发生时的上下文 (头大)

- 搞清楚 MSP 和 PSP 的区别,确定故障发生时用的是哪个堆栈 (晕)

- … (省略一万步)

这个过程,说白了就是 “人肉Debug”,非常考验你的功底和耐心。你需要:

- 对处理器架构有深入理解 (寄存器是啥?堆栈是啥?ABI又是啥?)

- 熟练查阅芯片参考手册 (几千页的手册,想想就…)

- 精通调试器操作 (GDB命令?IDE操作?各种窗口看得眼花缭乱)

- 具备反汇编能力 (必要时还得撸汇编代码…)

手动调试,练练基本功可以,但想靠它高效解决问题,尤其是复杂问题,简直是天方夜谭! 而且,你有没有发现,每次手动调试,都得重复很多繁琐的步骤,效率极低!

4. 调试工具来帮忙:效率瞬间起飞!

为了摆脱 “人肉Debug” 的苦海,我开始寻找更高效的工具。 果然,科技改变命运!下面这几款工具,让我的调试效率直接提升了一个level:

- PyCortexMDebug: GDB 的 Python 脚本扩展,能让你更方便地查看寄存器,并且把寄存器的值以更友好的方式展示出来,告别对着十六进制数懵圈的时代!

- Segger Ozone: 专业的 J-Link 调试器配套软件, 简直是HardFault调试神器!它能自动收集和分析故障信息,并以图形化的方式呈现给你,大大降低了HardFault调试的门槛。

有了这些工具加持,调试效率确实提高了不少。但新的问题又来了…

5. 手动调试的局限性:不升级思路就OUT了!

随着项目越来越复杂,我发现单纯依靠手动调试,遇到以下几个问题就彻底抓瞎了:

-

while(1)死循环: 产品量产后,绝对不能容忍while(1)这种“自杀式”的故障处理方式!设备卡死,用户差评,老板扣钱,想想都可怕!- 正确姿势: 生产环境要用 重启设备 代替

while(1), 或者更优雅一点,检测是否连接调试器,连接了就断点,没连接就重启。

- 正确姿势: 生产环境要用 重启设备 代替

-

线上问题难追踪: 产品到了用户手里,运行环境千奇百怪,bug 就像“薛定谔的猫”,时有时无,难以复现。没有 故障信息自动收集机制,线上问题根本没法查!

- 正确姿势: 故障发生时,自动保存关键的调试信息! 就像飞机上的黑匣子一样,关键时刻能救命!

-

远程调试无力: 设备卖到全球各地,客户反馈bug,你总不能飞过去现场调试吧? 没有 远程故障信息收集和分析能力,远程调试就是一句空话!

- 正确姿势: 建立 远程故障信息收集通道。 设备通过网络、蓝牙等方式,把故障信息传回云端,你坐在办公室就能分析问题!

-

专家瓶颈: HardFault调试门槛高,只有少数 “大神” 才能搞定。 团队遇到HardFault,所有人都得等着 “大神” 救场,效率低下,严重拖慢项目进度!

- 正确姿势: 把HardFault调试流程 标准化、自动化, 降低门槛,让团队里的 每个人 都能参与到故障分析中来!

6. 老司机都在用的HardFault自动化调试方案!

那么,老司机是如何解决这些问题的呢?HardFault自动化调试方案, 主要分为以下五个阶段:

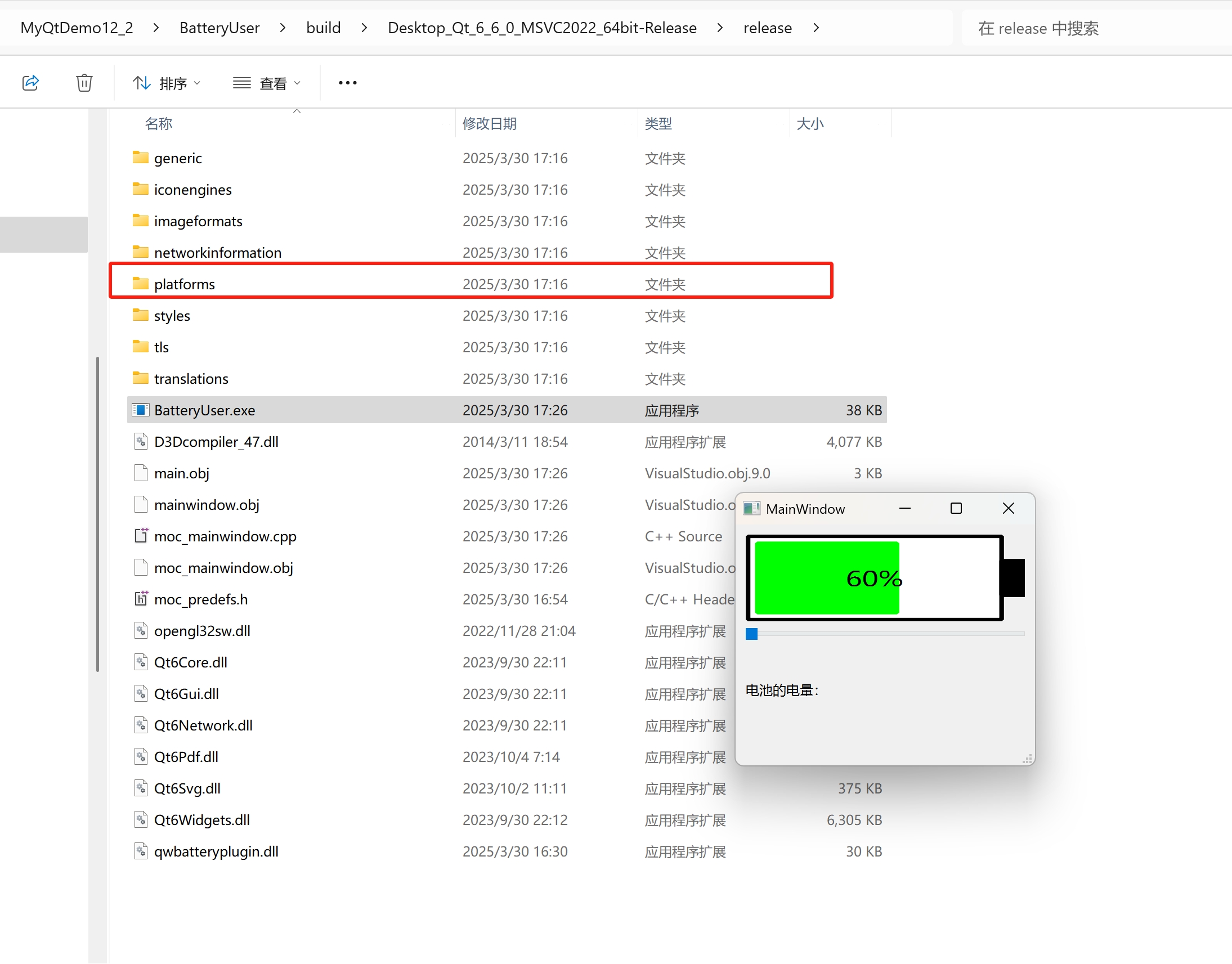

Stage 1: 打造轻量级 coredump 生成器

告别简单的 while(1), 第一步是构建一个 智能故障信息采集器, 替换默认的 HardFault_Handler。 它可以:

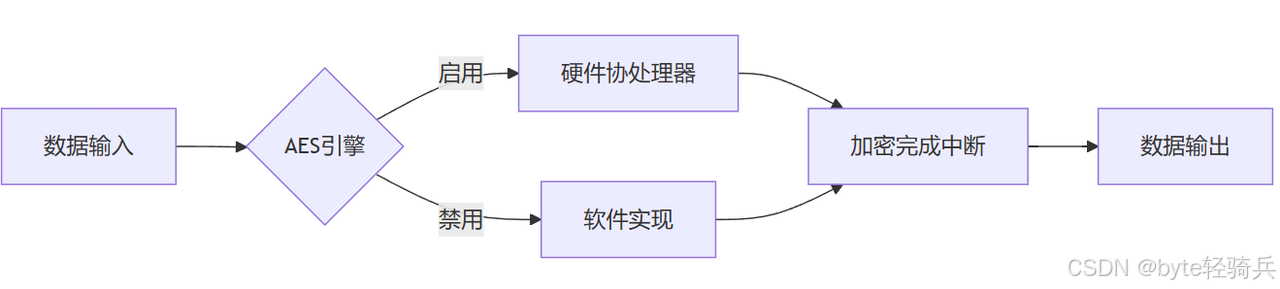

- 解析故障状态寄存器 (CFSR),告诉你故障类型 (总线故障?使用故障?)

- 记录关键处理器状态,例如:

- 通用寄存器 (R0-R12, SP, LR, PC, PSR)

- 堆栈指针 (SP) 和堆栈内容

- 尝试生成函数调用栈回溯 (通过堆栈中的 LR 值)

- 记录 RTOS 线程信息 (如果使用了RTOS)

- 保存关键变量值和日志信息

void HardFault_Handler(void)

{

uint32_t cfsr = SCB->CFSR; // 获取故障状态

// 解析故障类型

if (cfsr & SCB_CFSR_USGFAULTSR_Msk) {

// 处理使用故障...

}

// 收集关键信息

capture_register_state();

generate_stack_trace();

log_thread_info();

// 存储coredump

save_coredump();

// 若无调试器连接,则重启

if (!is_debugger_connected()) {

NVIC_SystemReset();

}

}

Stage 2: 让 coredump “开口说话” (后处理)

原始的 coredump 数据,通常只是一堆十六进制地址, 对开发者来说,就像天书一样难懂。

***** USAGE FAULT *****

Attempted to execute an undefined instruction.

Faulting instruction address: 0x0003dc4c

我们需要对 coredump 进行 后处理, 将地址转换为 函数名、变量名、行号 等更有意义的信息。

***** USAGE FAULT *****

尝试执行未定义指令

故障指令地址: prv_fault_handling_assert+20 (0x0003dc4c)

这个过程,通常需要借助 符号表文件 (例如 .map 文件、 .elf 文件) 和 后处理脚本 (例如 Python 脚本)。 后处理后的 coredump 才能真正 “开口说话”, 帮助你快速定位代码问题。

Stage 3: 想方设法 “留住” coredump (存储)

故障发生后,coredump 数据是宝贵的 “第一现场” 证据,一定要想办法 保存下来, 方便后续分析。 存储方案需要考虑以下因素:

- 存储位置: RAM? Flash? (RAM易失, Flash持久)

- 存储空间: 分配多少空间给 coredump? (空间有限,需要精打细算)

- 存储格式: 原始数据? 压缩数据? (压缩可以节省空间)

- 多次故障: 如果连续发生多次故障,如何存储多个 coredump?

在一个资源紧张的 MCU 项目中,尝试将 coredump 压缩后存储在 Flash 中。

Stage 4: 建立 coredump “回家” 的通道 (收集)

coredump 保存下来了,下一步就是要 把 coredump 从设备上 “弄” 回来, 传给开发团队进行分析。 数据收集方式取决于你的产品类型和应用场景:

- USB 连接: 设备通过 USB 连接电脑时,自动上传 coredump

- 串口/调试接口: 通过串口或 JTAG/SWD 调试接口,使用特定命令读取 coredump

- 网络 (Wi-Fi/蜂窝): 设备联网后,自动将 coredump 上传到服务器

- 蓝牙: 手机 App 通过蓝牙连接设备,下载 coredump 并上传

Stage 5: 让故障 “自动归案” (故障关联与分析)

收集到大量的 coredump 数据后,如何高效地管理和分析这些数据,又是一个新的挑战。 我们需要建立一套 故障关联与分析系统, 它可以:

- 自动解析 coredump,提取关键信息

- 将 coredump 与问题跟踪系统关联 (例如 Jira, Bugzilla)

- 对故障进行分类和去重,避免重复分析相同的问题

- 统计故障发生频率和趋势, 帮助你发现潜在的系统性问题

7. 寻找适合你的解决方案

打造一套完善的HardFault自动化调试系统, 确实需要一定的投入。 很多公司可能会觉得成本太高,不如把资源投入到新功能开发上更划算。

但我要告诉你的是,磨刀不误砍柴工!一个高效的HardFault调试系统, 可以 大幅提升开发效率, 降低维护成本, 提高产品质量, 最终带来的收益远超你的投入!

如果你不想重复造轮子, 可以考虑以下方案:

- 商业解决方案: 例如 Memfault 提供的设备监控和故障诊断平台, 功能强大,开箱即用, 但可能需要一定的费用。

- 开源方案: 例如 Zephyr RTOS 内置了 coredump 功能, FreeRTOS-Plus-TCP 和 mbed OS 也有相关的库和示例代码。你可以基于这些开源方案进行二次开发, 定制化你的HardFault调试系统。

选择哪种方案,取决于你的项目需求、预算和团队技术能力。 但无论如何, 拥抱自动化, 告别 “人肉Debug”, 是嵌入式开发者提升效率, 进阶大神的必经之路!

8. HardFault调试进阶阅读清单

- Cortex-M Fault Debugging: 强烈推荐! Memfault 团队出品的HardFault调试指南,内容深入浅出,实战性强。

- PyCortexMDebug: PyCortexMDebug 的 GitHub 仓库, 可以学习如何使用 Python 脚本扩展 GDB 调试器。

- Segger Ozone - Fault Analysis: Segger Ozone 故障分析功能介绍, 了解专业调试工具的强大之处。

FAQ:常见问题

Q1: 为啥我的程序老是卡在 HardFault_Handler 里面?

A1: 默认的

HardFault_Handler就是个死循环。 你需要重写它, 添加故障信息收集和重启逻辑。

Q2: 不接调试器, 怎么分析HardFault?

A2: 实现 coredump 机制, 将故障信息保存到 Flash 等非易失性存储器中, 后续再读取分析。

Q3: RTOS 环境下, HardFault调试有啥不一样?

A3: RTOS 环境下, 需要收集 线程信息、任务堆栈 等 RTOS 特有的上下文信息, 才能更准确地定位问题。

Q4: 间歇性HardFault, 最难搞定, 有啥技巧吗?

A4: 建立完善的日志系统, 记录系统运行状态和环境数据, 长期跟踪, 找出故障发生的规律。

Q5: 除了重启, HardFault还有别的恢复手段吗?

A5: 高级操作可以尝试 错误处理和容错机制, 例如 任务级重启、 降级运行 等, 但实现起来比较复杂。

![[Linux系统编程]进程间通信—system V](https://i-blog.csdnimg.cn/direct/8854f8b0b2d849ce958e71f6b9f059eb.png)