2024.7.18

1.A gated cross-domain collaborative network for underwater object detection

对图像进行增强

摘要:水下存在低对比度和低光的问题,有的学者通过水下图像增强来提高图片质量,但会移除或者改变水下物体的细节。所以作者探索两个领域的互补信息,提出了Gated Cross-domain Collaborative Network (GCC-Net)解决低对比度和低光的问题。第一:实时生成增强图像;第二:对原始图像和增强图像的特征进行交互和互补,引入了一个跨域特征交互模块;第三:第三,为了防止不可靠生成结果的污染,提出了一种门控特征融合模块来自适应地控制跨域信息的融合比。

2.PE-Transformer: Path enhanced transformer for improving underwater object detection

关注水下小目标检测

摘要:提出path-augmented Transformer检测框架,探索小目标的语义信息。embedded local path detection information scheme对高级和低级特征进行交互,因此增强了水下小尺寸目标不同特征之间的语义表示。在CSWin-Transformer框架下,获得的高级和低级特征之间建立了丰富的依赖关系。从而在编码阶段加强了语义表示。此外,采用个性化损失函数对不同层次的特征进行优化和微调。另一方面,设计了一种不同于传统平方检测方法的灵活自适应点表示的检测模块。该模块从任意方向的水下目标,分类定位和特征选择中的显著点样本实现了特征选择,同时提高了水下目标的检测精度。我们设计了一个新的加权损失函数来鼓励网络更好地收敛。

7.19

1.A lightweight YOLOv8 integrating FasterNet for real‑time underwater object detection

摘要:首先,a lightweight FasterNet module替代backbone,减少计算量和提高性能。第二:通过减少不必要特征层和改变融合方法,将现有的双向特征金字塔网络(BiFPN)改进为快速的特征金字塔网络。最后,提出了一种轻量级的C2f结构,分别将GSConv替换为C2f的瓶颈模块和部分卷积,以获得更轻、更快的块。

创新点:轻量化网络

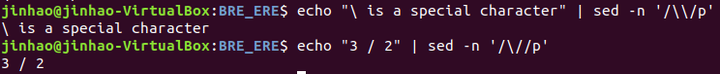

整体图:

而yolov8的结构图:

一.Fasternet

主要由PConv组成。PConv利用不同通道之间更高的相似性来优化成本。具体地说,空间特征是通过对部分输入通道应用常规的conv操作,同时对其余通道保持不变来提取的。

yolov8的CSP_layer:

PConv的浮点数是常规卷积的16分之1。h*w*k*Cp,Cp=c*r,这里使用的激活函数是GELU。

二.FBiFPN

BiFPN---加权双向特征金字塔网络(附代码)

我觉得这里主要用的是BiFPN对PANet优化的第二点,如果原始输入与输出节点处于同一级别,则在原始输入和输出节点之间添加一条额外的边,以便在不增加成本的情况下融合更多功能。

论文:BiFPN [19]采用了一种跨尺度连接的优化方法,将原始输入输出节点统一到一个单一的层次中,添加一个额外的输入路径,可以在不增加计算代价的情况下获得更多的特征。对于输入图像的4x、8x、16x和32x降采样特征矩阵,即主干中上一阶段i、i = 1、...,4的输出,BiFPN将其与快速归一化融合方法进行融合。然而,由于有太多的多层融合,网络的检测速度急剧下降。对于需要更快探测速度的水下目标,我们提出了FBiFPN结构。我们去掉了特征图大小为160×160(4倍下采样)的跨层特征融合(如图1中主干和颈部的连接所示),在特征图大小为20×20×20(32倍下采样)后添加一个SPPF对特征进行放大。来自骨干的80×80、40×40和20×20的特征图被Conv模块统一到256个通道,并融合到颈部,显著提高了模型的速度。除了减少交叉融合的层外,我们在我们的方法中使用了不同于BiFPN 的融合策略,使用Concat融合方法对小目标有更高的准确度。

我觉得主要的改进是:1.对于每个输出的特征加了Conv;2.第二个特征加了额外的一条边;3.Concat融合方法。

三.Lightweight‑C2f

GSConv包括标准卷积(SC)、深度可分离卷积(DSC)和shuffle。使用DSC操作可以极大地提高模型的速度,但特征信息部分丢失,导致精度降低。另一方面,GSConv使用SC、DSC和shufe的混合卷积来平衡速度和精度。

7.20

1.基于显著增强特征融合的多尺度RGB-D显著目标检测网络

摘要:在本文中,提出了一个特定的特征融合模块,称为Saliency Enhanced Feature Fusion(SEFF),用于RGB-D显著性检测。SEFF利用相邻尺度的显著性映射来增强融合所需的特征,从而得到更具有代表性的融合特征。我们的多尺度RGB-D显著性检测器使用SEFF,并处理三种不同尺度的图像。SEFF用于融合RGB和深度图像的特征,以及不同尺度下的解码器的特征。

1.我们创建了一个有效的显著性增强特征融合(SEFF)模块,它利用显著性映射来提高融合特征的代表性能力

主要解决有效融合不同尺度的特征

2.论基于CNN的对象检测算法中大对象的重要性

摘要:在本文中,我们强调了大型物体在学习特征中的重要性,这些特征对所有大小的物体都至关重要。鉴于这些发现,我们建议在训练损失中引入一个加权项。这个术语是对象区域大小的函数。

3.DEYO: DETR with YOLO for End-to-End Object Detection

摘要:我们介绍了第一个实时端到端目标检测模型,它利用了一个纯卷积结构编码器,DETR与YOLO(DEYO)。

结论:在本文中,我们创新性地开发了一种训练策略,不仅避免了对额外数据集的需要,而且成功地解决了以前的方法无法克服的一个问题:由于多尺度特征层训练不足而导致的性能下降。这种方法不仅提高了模型的性能,而且还显著降低了培训成本。通过将我们精心设计的轻量级编码器与这一革命性的策略集成,我们引入了DEYO,它超越了所有现有的实时对象检测器,而不依赖于补充数据集。

4.基于Few-Shot Object Detection的精粒度原型蒸馏

Fine-Grained Prototypes Distillation for Few-Shot Object Detection

摘要:Few-Shot Object Detection(FSOD)的目的是扩展一种通用的新目标检测的检测器。Meta-learning已被证明是这项任务的有效范例。一般来说,基于Meta-learning的方法使用一个额外的支持分支来编码新的例子(a.k.a.支持图像)到类原型,然后与查询分支融合,以促进模型预测。然而,类级的原型很难精确地生成,而且它们也缺乏详细的信息,这导致了性能的不稳定。需要新的方法来捕获独特的局部上下文,以实现更鲁棒的新目标检测。为此,我们建议将最具代表性的支持特性提炼为细粒度的原型。然后根据匹配结果将这些原型分配到查询特征图中,对两个分支之间的详细特征关系进行建模。这个过程是通过我们的细粒度特征聚合(FFA)模块来实现的。此外,在高级特征融合方面,我们从不同的角度提出了平衡类不可知抽样(B-CAS)策略和非线性融合(NLF)模块。它们相互互补,更有效地描述了高级特征关系。

5.通过合作的基础模型来增强新的目标检测

摘要:在这项工作中,我们解决了新对象检测(NOD)的挑战性和紧急的问题,重点是在推理过程中准确检测已知和新的对象类别。传统的目标检测算法本质上是封闭集的,限制了它们处理NOD的能力。我们提出了一种将现有的闭集检测器转换为开集检测器的新方法。这种转换是通过利用预先训练好的基础模型的互补优势,特别是CLIP和SAM,通过我们的合作机制来实现的。此外,通过将这种机制与GDINO等最先进的开放集检测器集成,我们建立了新的目标检测性能的基准。

7.21

1.Assisting Blind People Using Object Detection with Vocal Feedback

摘要:对于视障人士来说,在室内和室外环境中都很难进行独立运动和安全运动。此外,这些身体上和视觉上的挑战使他们无法在白天的现场活动。同样,它们在感知周围环境中可能对它们构成风险的物体时也存在问题。该方法建议使用网络摄像机对实时视频中的物体进行检测,以进行物体识别和过程。你只看一次(YOLO)模型被使用,这是基于cnn的实时目标检测技术。此外,还使用Python的OpenCV库来实现软件程序,并执行深度学习过程。图像识别结果通过谷歌文本到语音库以听觉形式传输给视障用户,并确定对象相对于其在屏幕上的位置。利用平均平均精度(mAP)对所得结果进行了评价,发现该方法与以往的方法相比取得了良好的效果。

2.目标检测中的类别不均衡:对缓解策略的实验性诊断和研究

3.实时开放词汇表对象检测

摘要:然而,YOLO对预定义和训练过的对象类别的依赖限制了它们在开放场景中的适用性。为了解决这个限制,我们引入了YOLO-World,这是一种创新的方法,通过视觉语言建模和在大规模数据集上的预训练来增强YOLO的开放词汇表检测能力。具体来说,我们提出了一个Re-parameterizable Vision Language Path Aggregation Network (RepVL-PAN) 和区域-文本对比损失,以促进视觉和语言信息之间的交互作用。我们的方法擅长于以零射击的方式高效地检测广泛的物体。

4.在开放场景中进行半监督检测的Credible Teacher

半监督目标检测(SSOD)通过利用未标记的数据来提高检测性能,取得了巨大的成功。然而,在开放场景半监督对象检测(O-SSOD)中,未标记的数据可能包含未在已标记的数据中观察到的未知对象,这将增加模型对已知对象的预测的不确定性。这不利于目前主要依赖自我训练的方法,不确定性越大,伪标签的定位和分类精度较低。为此,我们和端到提出了Credible Teacher和端到端的框架。Credible Teacher采用使用灵活标签的交互式教学机制,防止不确定的伪标签误导模型,并通过对其他可信的伪标签的引导,逐步减少模型的不确定性。

7.22

1.数据开发:对部分标注数据的目标检测和语义分割的多任务学习

摘要:如果网络可以利用任务间的关系,那么每个任务部分注释的数据点只注释一个任务,这可能有助于数据稀缺。在本文中,我们研究了目标检测和语义分割的联合学习,这两个最流行的视觉问题,从多任务数据的部分注释。当多任务网络不能同时优化两个任务时,我们进行了大量的实验来评估每个任务的性能,并探索它们的互补性。我们建议使用知识蒸馏来利用联合任务优化。实验结果表明,多任务学习和知识蒸馏比单任务学习甚至全监督场景有良好的效果。

2.基于深度学习的海上无人机图像目标检测:综述与实验比较

摘要:为了进一步促进基于海上无人机的目标探测技术的发展,本文对其挑战、相关方法和无人机空中数据集进行了全面的回顾。

3.航空图像的创新视野: 为了跟好的目标检测,LSKNet满足DiffusionDet

摘要:本研究解决了这一领域的固有挑战,特别是对小物体的检测,管理密集排列的元素,并解释不同的方向。我们提出了一个目标检测模型的深入评估,该模型将the Large Selective Kernel Network (LSKNet)(LSKNet)作为其主干与DiffusionDet头集成,利用iSAID数据集进行实证分析。

4.基于无人机深度学习的热图像目标检测

摘要:这项工作提出了一种神经网络模型,能够识别无人机收集的热图像中的微小物体。包括backbone、neck、head。Backbone是基于YOLOv5的结构,结合末端使用变压器编码器开发的。Neck包括BI-FPN,结合使用滑动窗口和变压器来增加输入到head的信息。head通过sigmoid函数评估特征映射来进行检测。使用具有注意度和滑动窗口的变压器可以提高识别精度,同时保持模型在合理数量的参数和计算要求。

5.雷达提取:通过激光雷达特征的知识提取,提高基于雷达的目标检测性能

摘要:雷达数据固有的噪声和稀疏特性对寻找三维目标检测的有效表示提出了挑战。在本文中,我们提出了RadarDistill,一个新的knowledge distillation,可以通过利用激光雷达数据来改进雷达数据的表示方式。雷达蒸馏技术成功地将激光雷达特征的理想特征转移到雷达特征中:跨模态对准(CMA)、基于激活的特征蒸馏(AFD)和基于提议的特征蒸馏(PFD)。CMA通过多层的扩张操作增强了雷达特征的密度,有效地解决了从激光雷达到雷达的知识转移效率低下的挑战。AFD的设计目的是从激光雷达特征的重要区域转移知识,特别是那些激活强度超过预定阈值的区域。PFD指导雷达网络模拟目标提案中的激光雷达网络特征,以准确检测结果,同时调节误检测建议的特征,如假阳性。

6.Improved YOLOv7 Underwater Object Detection Based on Attention Mechanism

摘要:在yolov7的基础上,提出了YOLOv7-RNCA水下目标检测技术。在backbone的结尾加入了residual models、coordinate attention mechanisms和partial convolution modules。这三部分的结合,是模型在目标检测过程中更加精准,同时减少不必要的计算和内存。这允许在深度网络训练过程中进行更好的优化,并保留更多的特征信息。此外,在neck,重建了SPPCSPC结构并引入全局注意力机制,提高了CNN的表现力并且在训练期间,确保了良好的数据能力鲁棒性。因此增强了目标检测能力。同时,通过引入PConv提高了neck的ELAN模块,在没有扰乱原始梯度路径的情况下持续增强网络学习能力。PConv减少了冗余计算和内存访问,使ELAN-PConv模块在提取空间特征时更加有效。

结论:通过在ELAN中引入PConv,有效的提高了计算效率和内存访问速度。此外,原来的SPPCSPC模块被加强后,提高了提取特征的能力。此外,将ResNet_CA_PConv模块引入到主网络中,进一步提高了检测模型整体的准确度。

一:引言

整体结构:

1.ResNet_CA_PConv的融合在核心网络结构中意味着实质性的提高。在PConv模块的帮助下,计算和内存访问被有效减少。此外,通过完美的嵌入CA模块,既能提高网络准确度又没有增机额外的计算。然后,这种协同方法被战术地应用于残差结构,从而产生一个细化的集成过程,以防止特征损失,提高检测精度,并简化计算复杂度。

2.在neck,SPPCSPC模块被重建,并且加入了GAM来替代CBS,在训练过程中获得良好的特征检测和弹性能力。

3.在neck,通过增强ELAN-W模块,PConv被并入到ELAN模块,替换Conv_BN_SiLu结构中的一个Conv模块,提高了ELAN-W在特征提取的有效性。

二:提高

对移动网络设计的研究表明,通道注意在提高模型性能方面具有重要意义,但会忽视位置信息。为了弥补这一差距,我们提出了一个开创性的、计算上简化的CA机制。这种创新的方法无缝地将位置的细微差别与通道数据集成在一起,使移动网络能够有效地集中在不同的区域,而不造成大量的计算负担。

为了克服2D整体池化中丢失的潜在位置细节,通过分解全局平均池化来定义通道注意力机制,这种分解涉及到使用两个一维全局池操作。这些操作鼓励注意力块识别空间遥远的依赖,同时保持准确的位置上下文。

CA模块和PC模块加入到ResNet,PConv替代1*1卷积,便于快速提取输入分支特征,减少冗余计算,并提高内存存取速度。CA模块替代3*3卷积,这允许沿着两个空间维度聚集输入特征,捕获长距离的依赖关系和精确的位置信息。

2.SPPCSPC

注意机制是一种通过将不同的权重分配到神经网络输入的不同部分来增强复杂特征识别环境的技术。GAM由通道注意力模块和空间注意力模块组成。在通道注意阶段,GAM首先转换输入特征图的维数,然后将其输入两层多层感知器(MLP),然后进行Sigmoid处理。同时,空间注意机制利用空间信息两个卷积层和s型处理,允许网络对图像中的上下文敏感区域进行优先排序。

三:实验

1.评价指标

Precision, Recall, IoU, AP, mAP, the weighted harmonic average F1, and the number of parameters (Params).

我们可以通过考虑模型的计算复杂度来评估水下海洋生物检测的有效性,并通过FLOP计数进行量化。

7.24

1.PE-Transformer:通过transformer增强路径来改进水下目标检测

摘要:很难获得水下小目标的细节,因此提出了path-augmented Transformer检测框架来探索水下小目标尺寸的细节。另一方面,设计了一种嵌入式局部路径检测信息方案(an embedded local path detection information scheme),以方便高低特征之间的交互,从而增强了小规模水下目标特征特征的语义表征。在CSWin-Transformer framework中获得的高级和低级特征之间建立了丰富的依赖关系,从而加强了在编码阶段的语义表示。此外,采用个性化损失函数对不同层次的特征进行优化和微调。另一方面,设计了一种不同于传统平方检测方法的灵活自适应点表示的检测模块该模块从任意方向覆盖水下目标,分类定位和点间特征选择中的显著点样本实现了特征选择,同时提高了水下目标的检测精度。我们设计了新的权重损失函数鼓励网络收敛的更好

7.25

1.Underwater object detection in noisy imbalanced datasets

摘要:我们观察到不平衡检测问题可能是由数据分布或标签噪声引起的。为了解决这些挑战,我们首先提出了a noise removal (NR) 算法,移除数据中的标签噪声。然后,提出a factor-agnostic gradient re-weighting algorithm (FAGR)解决不均衡检测问题。FAGR为每一个类提供了重新均衡的梯度,鼓励检测网络平等的对待所有类,同时消除检测差异。

2.Real-time underwater object detection technology for complex underwater environments based on deep learning

摘要:基于yolov8,提出了underwater optical detection network(UODN),通过the cross stage multi-branch(CSMB)和large kernel spatial pyramid(LKSP)模块解决水下问题。CSMB模块为了提取更多的特征解决水下图像质量问题,而LKSP模块的设计目的是为了提高网络探测不同尺度的水下物体的能力。此外,由CSMB和LKSP建立的CSMBDarknet作为backbone。

3.Reparameterized underwater object detection network improved by cone-rod cell module and WIOU loss

摘要:我们提出了一种基于人类视网膜结构的创新解决方案。这个方法引入了cone-rod cell module来抵消复杂光照影响并为了提取精确的小目标特征引入a reparameterized multiscale module。此外,应用了the Wise Intersection Over Union(WIOU)技术来增强伪检测。我们的方法使用不同大小的深核和普通卷积核来模拟人眼的锥细胞cone和杆细胞rod的亮度和颜色感知。我们通过结构重新参数化,结合多分支和多尺度模块,进一步增强了网络的学习能力,并保持了模型的亮度。通过用WIOU替换完整的交叉点超过Union(CIOU),我们增加了对低质量样本的惩罚,减轻了伪装信息对检测的影响。我们的模型在真实世界的水下物体检测(RUOD)数据集上达到了72.75%的MAP_0.75,超过了领先的YOLOv8s模型5.8%。.此外,该模型的FLOPs和参数分别仅为10.62 M和4.62B,低于大多数基准模型。

4.对于前视声纳图像的轻量化水下目标检测网络

摘要:FLSD-Net包括3个模块:轻量化下采样模块来减少信息损失;轻量化特征提取模块从参数冗余中减少过拟合;一个优化的网络结构优先把高分辨率的shallow layers来提高检测的效率。

5.Weighted multi-error information entropy based you only look once network for underwater object detection

摘要:提出了一种基于加权多误差信息熵的YOLO网络来解决影响检测精度的水下照明噪声问题。水下照明本质上是结构和不均匀的,它被建模为一个独立的分段相同分布,这是描述复杂水下照明环境的通用噪声模型,并适应传统的高斯分布作为特殊情况。其次,在提出的照明噪声模型的辅助下,将信息理论学习方法引入最小加权误差熵准则到YOLO网络的损失函数中,然后对网络参数进行训练和优化,以提高检测性能。此外,采用多误差处理策略同时处理信息反向传播过程中的向量误差,以加速收敛。

7.26

1.DeepSeaNet: Improving Underwater Object Detection using EfficientDet

摘要:首先,在Brackish-Dataset上,评估EfficientDet,YOLOv5,YOLOv8和Detectron2,其中YOLOv8的mAP98.2%,EfficientDet的mAP是98.56%。其次,提供了一种改进的BiSkFPN机制(带有跳过连接的BiFPN颈部),在对抗噪声中执行复杂特征融合,使改进的EfficientDet对扰动具有鲁棒性。第三,通过对抗性学习(98.04% mAP)分析了EfficientDet(98.63%mAP)和YOLOv5对准确性的影响。最后,为这两个模型提供了基于class-activation-map(CAM)的解释,以促进黑盒模型中的可解释性。

2.An Underwater Organism Image Dataset and a Lightweight Module Designed for Object Detection Networks

摘要:首先,建立了the Multiple Kinds of Underwater Organisms (MKUO) datase。其次,基于此数据集,评估了目前的目标检测算法。最后,提出了Sparse Ghost Module,a novel lightweight module。用我们提供的卷积代替标准卷积,可以显著降低网络复杂度,大大提高推理速度,而不会造成明显的检测精度损失。

3.Dual Refinement Underwater Object Detection Network

摘要:首先,提出了一个具有特征增强和anchor细化的水下探测框架。它有一个复合连接主干来增强特征表示,并引入了一个接受域增强模块来利用多尺度的上下文特征。新的水下目标检测框架还提供了一种基于六个预测层的预测细化方案,通过偏移学习来细化多尺度特征,更好地与anchors对齐,在一定程度上解决了样本不平衡问题。其次,建立了UWD数据集。

4.G-Net: An Efficient Convolutional Network for Underwater Object Detection

摘要:首先,提出了Global-net,结合了图像增强和目标检测,与其他方法不一样,G-Net实现了图像增强与目标检测的集成。此外,feature map learning module(FML)有效的提取去雾的特征。

5.Self-attention and long-range relationship capture network for underwater object detection

摘要:提出了一种基于self-attention(自注意)和long-range relationship capture(远程关系捕获)的大型核卷积目标检测网络。

首先,a hybrid dilated large kernel attention mechanism被提出,它采用了hybrid dilated convolution(混合扩张卷积)的思想,并结合了large kernel attention mechanism(大核注意机制)和self-attention的优点。这种注意机制可以避免自我注意缺陷,同时实现自我注意的适应性和长期相关性。

其次,提出了residual reconstructed module残差重构模块,用于特征增强,该模块捕获网络中的长期依赖关系,提取更关键的上下文信息,解决了网络退化和精度退化的问题。

第三,构建了an adaptive spatial feature fusion object detection head自适应空间特征融合目标检测头,可以直接学习如何对不同特征层的不同特征进行空间过滤;过滤掉无用信息,只保留有用信息进行组合,进一步提高网络的检测能力。

最后,基于以上三个技术构建了水下目标检测框架。该模型通过对局部细节应用self-attention,以及掌握全局长期关系、优先重要数据和空间过滤无关信息的能力。

7.27

1.AM YOLO: adaptive multi‑scale YOLO for ship instance segmentation

摘要:本文提出了一种自适应多尺度YOLO(AM YOLO)算法来提高海洋环境中多尺度船舶目标的实例分割性能。首先,算法提出了a multi-grained adaptive feature enhancement module(MAEM),利用分组加权和多种自适应机制来提高细节的提取,提高多尺度和全局信息的准确性。然后,提出了a refne bidirectional feature pyramid network (RBiFPN)结构,采用跨通道注意自适应机制,充分整合不同尺度的特征信息和上下文细节。

7.28

1.Underwater object detection and temporal signal detection in turbid water using 3D-integral imaging and deep learning

摘要:本文介绍了一种集成的基于双函数深度学习的基于三维三维积分成像(InIm)的水下目标检测、分类和时间信号检测算法。该系统是一种有效的目标分类和时间信号检测系统,适用于浊度和部分遮挡等退化环境,并提供了场景中的目标范围。摄像机阵列捕捉场景中的水下物体和为通信目的而传输的时间编码的二进制信号。该网络使用无遮挡的清晰水下场景进行训练,而测试数据是在部分遮挡的混浊水中收集的。重建的三维数据是输入到一个你只看一次(YOLOv4)神经网络用于目标检测,一个基于卷积神经网络的双向长短期记忆网络(CNN-BiLSTM)用于时间光信号检测。最后,对传输的信号进行解码。

2.Underwater small target detection based on dynamic convolution and attention mechanism

摘要:在本研究中,我们使用一艘配备了SSS的无人驾驶船收集了水下小目标的数据,并提出了一种基于YOLOv7模型的增强方法,用于检测SSS图像中的小目标。首先,为了获得更准确的初始锚盒,我们将原始的k均值算法替换为k均值++算法。接下来,我们用全维动态卷积(ODConv)替换了骨干网络中的普通卷积块,以增强对小目标的特征提取能力。随后,我们在颈部网络中插入了一个全局注意机制(GAM),以关注全局信息,提取目标特征,有效地解决了SSS图像中的稀疏目标特征问题。最后,我们采用Wise-IoU(WIoU)来降低低质量标注数据产生的检测精度,降低SSS图像中小目标的有害梯度。

3.Underwater Target Detection Using Deep Learning: Methodologies, Challenges, Applications, and Future Evolution

综述

摘要:本文研究了水下无线传感器网络(UWSNs)的最新目标(目标)检测算法。为了确保选择最新和最先进的算法,只考虑了过去七年开发的、现有调查没有完全解决的算法。

4.Boosting R-CNN: Reweighting R-CNN samples by RPN’s error for underwater object detection

摘要:uncertainty modeling and hard example mining.我们提出了一种名为增强R-CNN的两级水下探测器,它由三个关键部件组成。首先,提出了一种新的区域建议网络RetinaRPN,该网络提供了高质量的建议,并考虑了客观性和客观性预测,对目标先验概率进行建模。其次,引入概率推理管道,结合第一阶段先验不确定性和第二阶段分类评分,对最终检测评分进行建模。最后,我们提出了一种新的硬示例挖掘方法,即增强重加权。具体来说,当区域建议网络对样本的对象先验概率计算错误时,增强重加权会增加训练过程中R-CNN头中样本的分类损失,同时减少具有准确估计先验的容易样本的损失。因此,可以获得第二阶段的鲁棒检测头。

7.29

1.A gated cross-domain collaborative network for underwater object detection

摘要:我们认为,探索来自这两个领域的互补信息对UOD是有益的。原始图像保留了场景的自然特征和物体的纹理信息,而增强后的图像提高了水下物体的可见性。所以,作者提出a Gated Cross-domain Collaborative Network (GCC-Net),为了解决水下环境中能见度低和对比度低的挑战,其中包括三个专用组件。首先,采用实时UIE方法生成增强图像,可以提高物体在低对比度区域的可见性。其次,引入了一个跨域特征交互模块,便于原始图像特征和增强图像特征之间的交互和挖掘互补信息。第三,为了防止不可靠生成结果的污染,提出了一种门控特征融合模块来自适应地控制跨域信息的融合比。

2.Underwater object detection algorithm based on feature enhancement and progressive dynamic aggregation strateg

摘要:本文设计了一种新的特征增强和渐进式动态聚合策略,并提出了一种基于YOLOv5s的水下目标检测器。首先,设计了a feature enhancement gating module,有选择性地抑制或增强多级特征,减少水下复杂环境噪声对特征融合的干扰。然后,设计了the adjacent feature fusion mechanism and dynamic fusion module,动态学习融合权值,逐步进行多级特征融合,从而抑制多尺度特征融合中的冲突信息,防止小物体被冲突信息淹没。最后,提出了基于相同尺寸的快速混合池层的a spatial pyramid pool structure (FMSPP),这可以使网络获得更强的纹理和轮廓特征的描述能力,减少参数,进一步提高泛化能力和分类精度。

8.26

1.侧扫描声纳目标检测中YOLOX-ViT的Knowledge Distillation

Knowledge Distillation in YOLOX-ViT for Side-Scan Sonar Object Detection

摘要:在本文中,我们提出了一种新的目标检测模型YOLOX-ViT,并研究了知识蒸馏在不牺牲性能的情况下减少模型尺寸的有效性。我们的研究集中于水下机器人技术,解决了关于较小模型的可行性和YOLOX中视觉变压器层的影响的关键问题。此外,我们引入了一个新的侧扫描声纳图像数据集,并使用它来评估我们的目标探测器的性能。结果表明,知识蒸馏能有效地降低壁检测的误报。此外,引入的视觉变压器层显著提高了在水下环境中的目标检测精度。

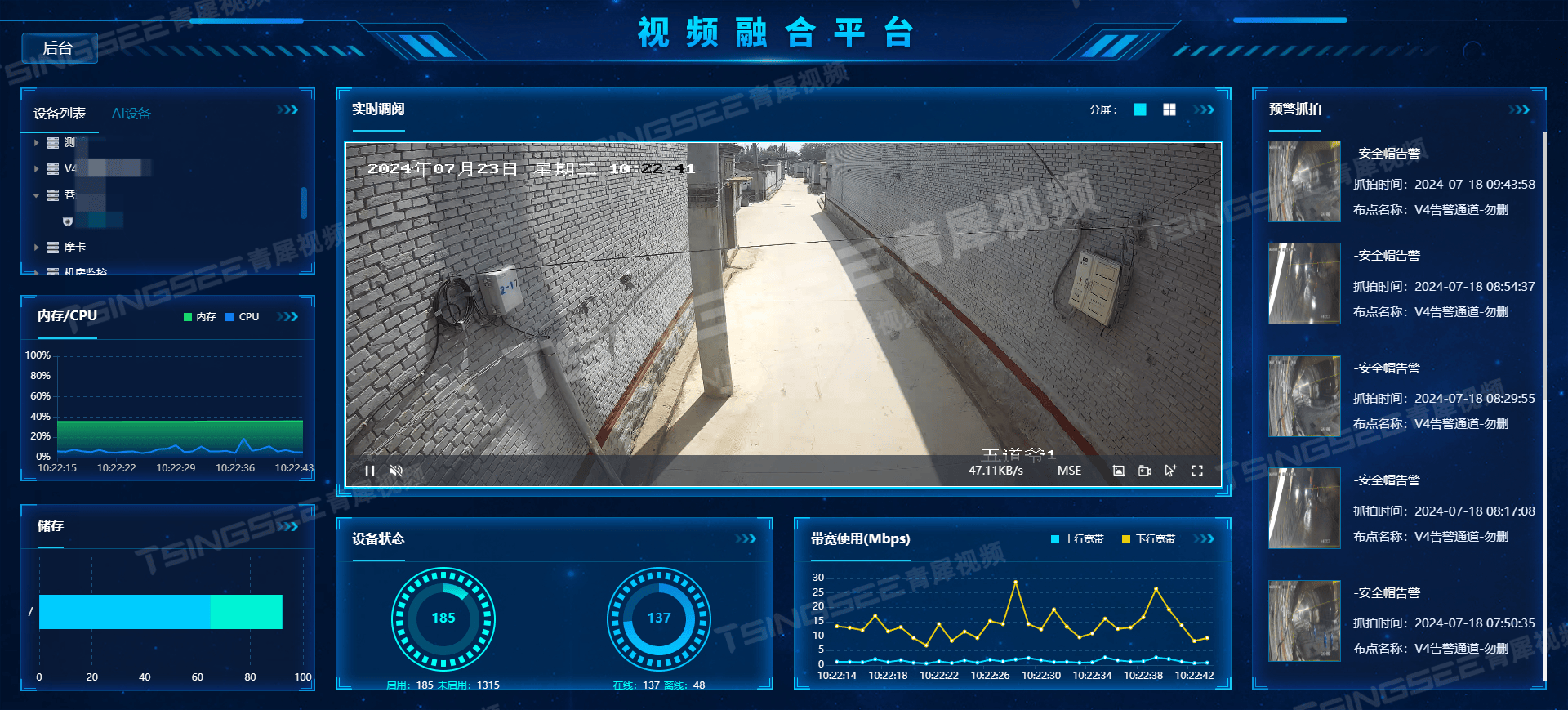

一:引言

1.通过引入一个vision transformer,生成YOLOX-ViT模型

2.通过knowledge distillation方法提高小模型YOLOX-ViT,比如YOLOX-Nano-ViT,如图一。

3.为了墙检测,引入侧扫图像数据集

section2回顾目标检测和knowledge distillation相关工作;section3介绍YOLOX和YOLOX-ViT模型并介绍新的数据集;section4解释如何应用knowledge distillation

二:相关工作

knowledge distillation:G.Hinton在图像分类中引入知识蒸馏,将知识通过一个新的损失函数从一个训练好的模型(teacher)转移到小模型(student)。损失函数包括地面真实损失和蒸馏损失,前者引导预测到地面真实标签,而后者利用来自较大模型的知识来对齐较小模型的行为。

𝜆作为一个正则化硬损失项和软损失项的参数。

三:YOLOX-ViT

将Transformer和CNNs结合,增强目标检测的特征提取,将CNN的空间层次结构和Transformers的全局背景相结合。本文建议通过在SPPBottleneck层末端的主干和颈部之间加入一个变压器层(见图2)来增强YOLOX模型,以提高特征提取能力。ViT层由4个多头自注意(MHSA)子层组成。

ViT位于主干和颈部之间,用红色箭头表示,而基本的YOLOX架构用蓝色虚线表示。

这篇文章使用的数据增强包括噪声、翻转、噪声和翻转的结合。图像剪裁为640*640

四:knowledge Distillation

考虑YOLOX's的结构,KD被应用到特征金字塔的解耦头[1]。由于结构的特殊性,KD过程包括计算每个FPN输出的不同损失函数,包括分类bounding box回归和学生和教师模型之间的目标分数。

对于每种类型的损失(分类、客观性、边界框),损失函数通过每个FPN的输出进行分解

在实验中,ℒKD包括硬损失和软损失,软损失项(ℒKD_cls、ℒKD_bbox和ℒKD_obj)各按0.5的系数进行缩放,𝜆bbox = 𝜆obj = 𝜆cls = 0.5,这个方法确保了虽然soft loss对于将细微差别的知识从教师模型转移到学生模型则至关重要,但hard loss仍然是指导学生模式学习过程的主要因素,确保它不会偏离基本任务目标。

在实验中,ℒKD包括硬损失和软损失,软损失项(ℒKD_cls、ℒKD_bbox和ℒKD_obj)各按0.5的系数进行缩放,𝜆bbox = 𝜆obj = 𝜆cls = 0.5,这个方法确保了虽然soft loss对于将细微差别的知识从教师模型转移到学生模型则至关重要,但hard loss仍然是指导学生模式学习过程的主要因素,确保它不会偏离基本任务目标。

此外,这个论文使用YOLOX-L模型作为老师,YOLOX-Nano作为学生。因为YOLIX-Nano的在线随机数据增强,the online KD 的过程:1.训练YOLOX-L;2.开始YOLOX-Nano的培训;3.对于每个batch,使用YOLOX-L运行推理;4.计算YOLOX-L和YOLOX-Nano的FPN的ℒsoft;5.combine ℒsoft with ℒhard。The online KD方法花费一周,由于在每次迭代过程中都需要推理。在YOLOX-Nano训练过程中,为了减少时间投入,应用离线KD方法,即没有随机数据增强。工作流程是:训练YOLOX-L;2.执行YOLOX-L推理,为每个训练样本保存FPN日志;3.开始YOLOX-Nano训练4;检索每个图像对应的FPN日志记录;5.计算来自YOLOX-L和YOLOX-Nano的每个FPN输出的对数之间的ℒsoft;6.combine ℒsoft with ℒhard。

[1]解耦头:采用两个不同的头解耦输出分类和位置,成为decoupled。

为什么用到解耦头? 因为分类和定位的关注点不同,分类更关注目标的纹理内容,定位更关注目标的边缘信息。

视觉目标检测及分割任务中使用解耦头的好处

五:实验分析

这种差异表明,去除在线数据增强可以产生更好的模型性能,而有限的数据集大小的约束可能会不成比例地影响诸如YOLOX-L等大型模型的效率。实验表明,虽然YOLOX-L-noAug维持检测的时间更长,但false positives增加了8.13%。此外,视觉实验说明了YOLOX-L-ViT表现较好的检测效果。此外,ViT层增加了YOLOX模型的能力。在没有在线数据增强的情况下,使用ViT增强的模型并没有基础模型表现较好。虽然检出率增加了,但假阳性也增加了,这表明该模型可能过度地将明亮的物体概括为墙壁。

目的是利用L和L-ViT的knowledge distillation作为“教师”,在较小的模型Nano-noAug和Nano-ViT-noAug作为“学生”,降低假阳性率。KD有效的降低了False Positive。此外,ViT层在学生模型中减少了False Positives。尤其是,对于Nano-noAug,该基本模型将假阳性率降低了约0.3%,而ViT变形减少了6%。Nano-ViT-noAug,采用基本的模型作为老师,False Positives减少了12.95%,而ViT版本设法减少了20.35%。这些结果强调ViT的能力是帮助模型聚焦在更有效的特征提取。

六:结论

通过在YOLOX的backbone中引入visual transformer,在decoupled heads中应用knowledge distillation。knowledge distillation有效的减少了墙检测中的false positives。ViT层的集成显示了整体精度的显著提高,强调了这种架构增强在水下图像分析中的潜力。

关于vision transformer,观看这篇文章

逐步解析Vision Transformer各细节,附带源码与微调讲解,让你不再担心只会原理而写不出来代码!(最后附原论文详细阅读)~