自《黑神话:悟空》面世以来,不少小伙伴们被其中的3D场景所惊艳!

在人工智能时代,NeRF(Neural Radiance Fields,神经辐射场)与3DGS(3D Gaussian Splatting,3D高斯溅射)技术成为完成三维重建、新视角合成、3D生成等任务不可或缺的重要工具。

这两种技术不仅在学术界引起了广泛关注,更在多个行业中展现出巨大的应用潜力,甚至面试技术岗位的第一道面试题就是NeRF与3DGS!

那么,NeRF与3DGS到底是什么技术,应用场景有哪些?

一、什么是NeRF

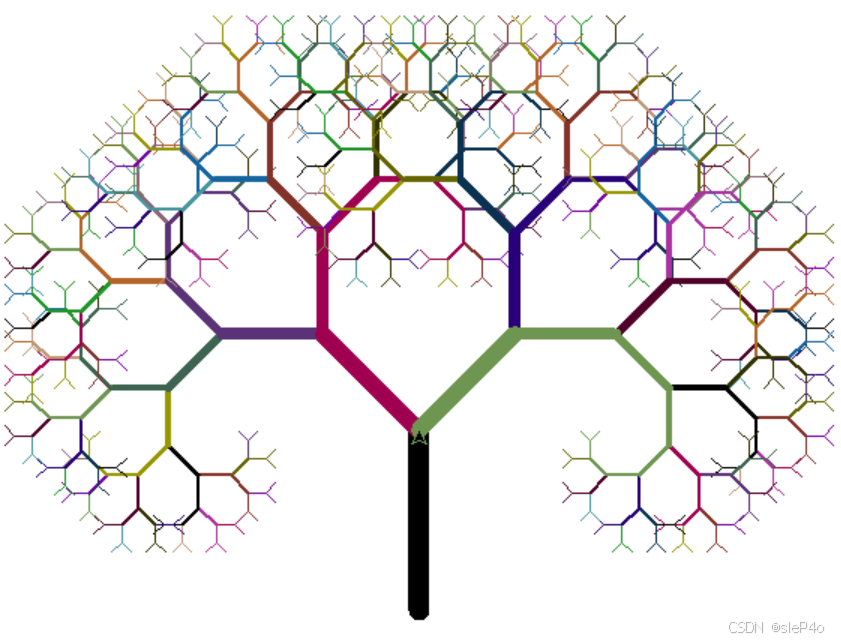

NeRF英文全称为Neural Radiance Field,意为神经辐射场,是一种可微的、自动生成的, 连续的三维隐式表达方法,最初用于解决新视角生成(Novel View Synthesis,NVS)这个计算视觉里的基础问题。

从2020年其框架被提出到2024年初,仅仅三年半,NeRF已经成为一种重要的高质量三维表达方法,被不断拓展到众多应用场景中。

Neural Radiance Field三个词准确地诠释了整个方法的核心。

Neural指通过神经网络模型实现三维表达,Radiance指神经网络描述了场景空间中每个点在每个方向发射的辐射情况,Field指这种表达是一个连续的五维函数。

NeRF以多视角图像为输入,使用神经网络技术,自动将场景中的几何与纹理信息训练成连续的三维神经辐射场模型。

在渲染时,通过任意角度查询神经网络,使用体渲染生成高真实感的新视角图像。

NeRF的三维渲染效果如图下图所示。

二、NeRF的应用

第一类是用在3D资产扫描生成方向。这一类的领军公司是Luma AI,它们可能是全行业最早把NeRF推向商业化,并发展成为独角兽的公司。目前,相关应用有Luma AI,用来做Object-centric的扫描建模和FlyThrough,用来做场景级别的建模。

第二类是大场景应用。影响力最大的就是Google在Google Map里demo过的基于block-nerf的3D真实感街景产品,当时发布会的demo效果挺棒的。

第三类是在自动驾驶里的应用。从Waabi、Argo AI到国内的几家自动驾驶公司,包括长安、理想等都在做这块,以及基于NeRF相关技术的自动驾驶场景仿真工作,用来模拟一些真实世界里不太好测试的场景,进行闭环测试。

第四类是电商类。明确提出在使用的,是2023年Google在Google Shopping里,在美国iOS设备中,搜索鞋的产品时,会有很多鞋使用NeRF建模,并提供360度查看的功能,并在搜索结果上标“360”字样。这个项目是Jon Barron团队有支持的,Ricardo牵头的项目,2023年的时候上线,并有过发布。

第五类是AIGC方向。文本生成3D应用里,国内外很多家公司在使用相关技术进行3D资产的生成,包括太极图形的Meshy,VAST的Tripo3D。Luma AI发布的第一个Genie发布版本,以及一些垂直行业里的模型生成应用。

第六类是虚拟数字人方向。大部分真实感数字人合成之前都是基于GAN的,也有不少商业公司有很好的短视频和直播数字人就是用GAN产品上线的。后来随着NeRF和3DGS技术的发展,很多公司探索NeRF替换升级的。

第七类是游戏方向。游戏里,主要是生成3D模型之后转为Mesh之后的使用。另外Luma AI在Unreal Engine里有一个插件,可以加载NeRF模型,而且在3DGS之后,在Unity、 Unreal Engine里都有插件可以用,所以可实现性是越来越好的状态。

三、什么是3DGS

3DGS,三维高斯喷溅(3DGaussian Splatting,3DGS)。

这项技术在 2023 年的 ACM Siggraph 会议上由INRIA和马克斯·普朗克研究所的研究者提出。

在接下来的几个月里,它凭借与NeRF相似的表现力、数百倍于NeRF的训练和推理速度,以及在高分辨率图像和场景中的超实时渲染等特性,迅速成为有竞争力的技术路径。

相较于NeRF,3DGS是显式的三维表达方式,其设计遵循“大道至简”的原则,用简捷的逻辑构造了三维空间。