8 月 12 日,上海交通大学 AI for Bioengineering 暑期学校正式开幕,吸引了来自国内外 30 余所高校和 27 家企业的百余名业内人士。在为期 3 天的学习交流中,多位行业专家、企业界代表及优秀青年学者,围绕 AI 与生物工程的融合与创新发展带来了深度分享。

12 日上午,上海交通大学自然科学研究院 & 上海国家应用数学中心(上海交通大学分中心)助理研究员周冰心以「人工智能的前世今生」为主题, 生动形象地为大家梳理了 AI 的发展历程,并总结了里程碑模型的特点。

下午,在「人工智能前沿进展」的特邀专家报告中,周冰心博士还以「图神经网络与蛋白质结构表征」为主题, 向大家分享了图神经网络的定义、优势、及其在蛋白质预测与生成等领域的前沿应用。HyperAI超神经在不违原意的前提下,对周冰心博士的这个主题分享进行了整理汇总,以下是演讲实录。

经过几十年的高速发展,深度学习已经出现了卷积神经网络、递归神经网络、Transformer 等各种模型,可被用于处理具有不同特征的数据。其中,由于可以输入和处理结构数据,图神经网络被广泛应用到社交网络、轨迹预测、分子建模等多种场景。

然而,很多人认为图神经网络就是图卷积网络 (GCN),它无法拟合复杂的函数,多叠几层还会出现过平滑问题,存在很多局限性。此外,既然基于 Transformer 的大模型在大数据集上具有强大的学习能力,那为什么还要持续研究和发展图神经网络?

对于这些疑问,我把答案总结为:「It’s SEXY」。

第一「S」,基于图神经网络的研究是健康、可持续的。 如下图所示,对比人类各种行为的碳消耗可以得到,大模型拥有强大能力的前提是巨大的能源消耗。另外,过分集中计算资源和研究重心到大模型上,也会挤占其他模型研究的生存空间,长此以往,只有那些垄断计算资源或话语权的大公司才能维持人工智能研发,非大公司研究人员的科研空间将受到极大限制。

第二「E」,自然科学数百年的积累不应被人工智能的快速发展所忽视,图神经网络除了学习特征表示,还能优雅地加入来自人类的先验知识(归纳偏差)。 此外,和其他数据驱动的模型相比,图神经网络背后还有更多的理论支持,比如信号处理、社会动力学等。

第三「X」,图神经网络有助于推动深度学习网络的可解释性。 随着人工智能的发展,人们越来越关注模型结果的意义与合理性,通过深入研究图神经网络可解释性,能够更好地理解模型决策背后的逻辑与依据,提升模型的可靠性与信任度。

第四「Y」,图神经网络作为一个年轻且快速发展的领域,仍存在大量未解决的问题与挑战,为研究人员提供了广阔的探索空间。 此外,就像卷积神经网络对于图像处理,自注意力机制对于自然语言处理,图神经网络在也将为生物学上的很多问题(尤其是数据量不足、先验知识重要的问题)提供好的解决方案。

接下来我将从分子数据与图表征、经典图神经网络简介、图神经网络与更多生物学问题这 3 个方面来给大家分享图神经网络的具体应用价值。

分子数据与图表征:生物数据图形化的 3 个组成元素

想要把一个生物学数据转换成图表示,首先要回答:图是什么,它由哪些基本元素组成。通常来说,一个图包含 3 个元素:节点;边(节点之间的连接关系);图(由节点和边共同构成的完整主体)。

我们如何使用这 3 个元素来定义生物学中的研究对象呢?下图有 4 个案例:

对于一个小分子(图), 每个原子可定义为一个节点,原子间的距离关系或化学键关系可用边来表示。

如果从氨基酸层面观察蛋白质, 可以把蛋白质整体视为一个图,每个氨基酸作为图中的一个节点。当不同氨基酸在空间位置上较为接近时,可假定它们之间存在某种相关性,并通过边将这些空间上相近的氨基酸节点连接起来。

类似地,如果以二级结构为基本单元来观察蛋白质, 则每个二级结构在蛋白质图中可作为一个节点,其相邻或空间距离较近的二级结构通过边来连接。

最后,对于疾病知识图谱, 不同疾病、基因、用药及患者等元素均可视为节点,节点之间的连接代表它们之间的复杂关系,如某种药物能治疗特定疾病,或某个基因导致某种疾病等。

在定义出一个图之后,下一步需要考虑如何描述图上的信息,比如节点和边的特征?

如下图所示,4 个节点间存在一定的相互关系,为准确刻画这些关系,可以定义一个邻接矩阵 A。 在处理不同生物数据时,邻接矩阵可用来表征原子之间是否存在共价键,或确定某一氨基酸的 k 阶邻居。

此外,每个节点和边都可以附带一系列属性。 以氨基酸节点为例,节点属性可包括其类型、物理化学性质等特征信息。边作为连接节点的桥梁,同样可以承载特征信息,比如每条边上的特征向量,涵盖 2 个氨基酸间的距离(包括序列距离和空间距离)、边建立的依据(基于空间结构或原子化学键等),这些边特征为理解节点间关系提供了更细致和深入的视角。

总结来说,每一个有结构的主体(比如一个蛋白质)都可以被表示成一个图, 如下图所示:可以使用 G 表示图,v 表示节点,ε 表示边,Xv 表示节点上的特征,邻接矩阵 A 表示节点连接情况,Xe 表示边的特征。

基于图的 3 个基本元素(节点、边、图),可以对图上的向量表征和预测任务进行分类,如下:

-

节点预测 (node-level prediction)。 比如做蛋白质序列设计,即在已知蛋白质图的情况下,预测图中每个节点所代表的氨基酸类型。

-

连接预测 (link prediction)。 在给定图和所有节点的前提下,推断节点间是否存在相互关系,比如基因调控网络、药物知识图谱等预测任务。

-

图预测 (graph-level prediction)。 在节点与边均确定的情况下,同步对多个图进行学习和分析,从而对每个图的标签进行预测。

什么是图神经网络:不止GCN,还有GAT、GraphSAGE、EGNN,以及更多

图神经网络是在给定节点间连接关系的基础上,去寻找每个节点隐层表示,给每个节点找一个向量表示。相较于其他类型的数据,图最大的特征是它能够明确指示哪些节点之间存在直接关联,以及不同节点间关系的紧密程度。所以图神经网络的本质就在于运用这些归纳偏差,并在相连节点之间进行消息传递,离得越近的邻居节点对中心节点影响力越大。

接下来我向大家分享几个经典的图卷积神经网络。

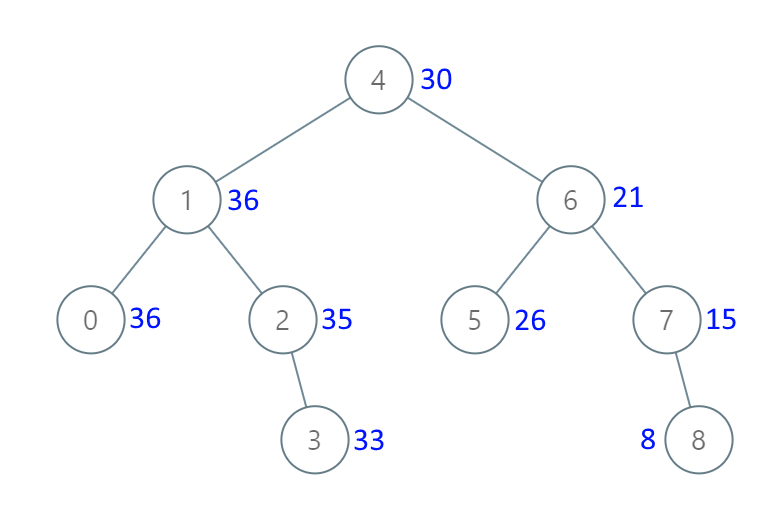

第一个是图卷积神经网络 GCN, 如下图所示,其核心是每一层 GCN 会把 1 阶邻居的信息平均聚合到中心节点上,并用聚合后的信息作为中心节点的全新的表示。

从表达式可以看出,GCN 和 MLP 的区别是,GCN 加入邻接矩阵,并使用一阶邻居信息更新节点表示。此外,它在聚合信息时会加入自连接 (self-loop) 来强化自己本身的信息,并根据每个邻居节点的邻居数量进行加权平均。

- 一阶邻居:中心节点直接和其他节点连接,即经过 1 条边即可到达的点被称作 1 阶邻居

第二个是图注意力网络 GAT。 相较于 GCN,GAT 的主要变化是在聚合邻居信息时权重的计算方式上。GCN 使用基于邻接矩阵计算的权重,而 GAT 根据邻居节点的特征算出一个可以学习的权值。

以上两种方法是 transductive methods 的典型代表,它们在输入时需要给出完整的图,导致计算复杂度增加。对此,GraphSAGE 提出 inductive 方式, 每次信息传导只需要了解中心节点的一阶邻居,且只随机选择一部分的邻居信息作聚合。

上面 3 种方法是对二维拓扑结构图进行节点上的表征更新,后续消息传递网络 (MPNN) 再把这一类信息聚合方法整合成一个框架。但生物上的很多数据(比如分子)还要考虑三维空间结构,为了整合空间信息,可以采用等变图神经网络 (EGNN)。 如下图所示,该方法的核心在于,除了节点本身的特征信息外,还引入了节点之间的相对位置关系,保证学习表征的旋转等变和平移不变性。

此外,还有很多先进的图神经网络设计,有些设计不仅能够提升模型的预测性能,还会聚焦提升效率、降低过平滑、加入多尺度表征等需求,通过引入连续消息传递、谱图卷积方法等,还能为具体问题提供表达能力更强的图神经网络。

图神经网络的重要应用:以蛋白质性质预测和序列生成为例

接下来,我将向大家分享图神经网络在蛋白质表征学习方面的应用,这里我分成预测类模型和生成类模型两大类。

蛋白质的特征编码与属性预测

在预测类任务上,我们考虑突变体性质预测、溶解度预测、以及子图匹配 3 类任务,具体有 4 个工作。

第一个工作,在突变任务预测上, 如下图所示,我们曾使用等变图神经网络去刻画蛋白质氨基酸的内部空间关系,其中每个节点代表一个氨基酸,在点位上表示该氨基酸的类型、理化性质等特征,图上的边连接体现氨基酸之间的相互关系,比如共同进化潜力与互相作用力影响。

随后,我们使用预测模型给不同的突变体打分,并识别出最有可能优化蛋白质性质的高分突变组合,这种轻量图神经网络通过整合氨基酸以及氨基酸之间的相互关系,能够显著降低训练成本与数据成本,在保持高效能的同时,实现了模型的小而美。另外,在多种蛋白质性质上进行湿实验验证,可证明这种模型能够显著提升定向进化效果和成功率。该研究以「Protein Engineering with Lightweight Graph Denoising Neural Networks」为题,发表在 ACS JCIM 上。

论文地址:

https://pubs.acs.org/doi/10.1021/acs.jcim.4c00036

第二个工作,在结构编码的基础上进一步加入蛋白质序列编码。 这是因为,结构信息假设邻近氨基酸间相互作用更强,而距离远的相互关系极其微弱,这种假设并不能完全贴切实际情况,因此需要序列信息补充对远程相互作用的考量。另外,不同生物学特性的信息侧重不同,对于结合能与热稳定性来说,结构信息占据主导地位,但在涉及催化活性等性质时,氨基酸的类型信息更为关键。

如下图所示,我们在 ProteinGym 上的 200 多种 assay 上进行实验测试,获得了非 MSA 方法的最好表现。该研究以「Semantical and Geometrical Protein Encoding Toward Enhanced Bioactivity and Thermostability」为题,发表在 eLife 上。

论文地址:

https://elifesciences.org/reviewed-preprints/98033

第三个工作的氨基酸层面编码模块与第二个工作一致, 基于蛋白质序列和结构进行信息整合,区别在于还整合了多种基于先验知识的蛋白质层面信息,如蛋白质的长度、20 种氨基酸的比例分布等。

如下图所示,我们测试了模型对于蛋白质溶解度的预测效果,并在基于计算和实验的几千条测试数据上达到了 SOTA 效果。该研究以「ProtSolM: Protein Solubility Prediction with Multi-modal Features」为题,已被 IEEE BIBM2024(CCF B类会议)接收。

预印版论文地址:

https://www.arxiv.org/abs/2406.19744

第四个工作是探索蛋白质结构的局部相似性。 如下图所示,尽管蛋白质整体庞大,但其核心可能在于某些局部结构特征,另外,从宏观视角观察,两个蛋白质可能在序列和结构层面截然不同,但却拥有相似甚至相同的核心功能模块。

因此,我们为每个蛋白质的局部结构找到一个隐式表达,并计算这些向量之间的相似度,除了比较结构间的一对一相似关系外,还评估了 2 个完整蛋白质间是否存在可对齐的局部结构片段。该研究以「Protein Representation Learning with Sequence Information Embedding: Does it Always Lead to a Better Performance?」为题,已被 IEEE BIBM2024 接收。

预印版论文地址:

https://arxiv.org/abs/2406.19755

序列生成

接下来向大家分享两个工作,即为蛋白质结构设计合适的氨基酸序列,这两项工作的核心模型都是扩散概率模型 (Diffusion)。

第一个工作,根据已知氨基酸骨架设计完整的蛋白质序列,提升蛋白质性能, 模型框架如下图所示。和定向进化不同,我们一次性修改几百个氨基酸,得到了更高多样性的蛋白质序列。一方面,这种方式可能找到全新的进化起点,避免定向进化中常见的局部最优、负向上位效应等问题;另一方面,通过修改更多氨基酸来获取更低序列相似度但相同功能的蛋白质,使得打破专利封锁成为可能。

我们以两种 Argonaute 蛋白质(分别在中温和超高温下工作)为设计模板,生成的 40 余条蛋白质大都可以在室温环境下进行 DNA 剪切,其中最好的设计比野生型剪切活性提升 10 倍以上,热稳定性也显著提升。研究以「Conditional Protein Denoising Diffusion Generates Programmable Endonucleases」为题,发表在 Cell Discovery 上。

预印版论文地址:

https://www.biorxiv.org/content/10.1101/2023.08.10.552783v1

第二个工作,如下图所示,在不严格限制氨基酸骨架结构的情况下,根据二级结构自主决定氨基酸的填充数量及位置。 相比较基于骨架的生成方式,这种更加粗粒度的生成条件能够为生成序列引入序列多样性,也能满足改造和全新设计蛋白质的具体需求(如对于跨膜蛋白质而言,仅约束跨膜部分为 helix 结构,但不严格限制这部分的长度和具体骨架)。该研究以「Secondary Structure-Guided Novel Protein Sequence Generation with Latent Graph Diffusion」为题,被 ICML AI4Science 接收,全文在审稿中。

预印版论文地址:

https://arxiv.org/html/2407.07443v1

以上两个基于 Diffusion 的蛋白质序列设计工作,既可以根据蛋白质骨架生成一整条序列,也可以固定部分关键氨基酸和骨架结构,并以此为生成条件,填充未固定部分的氨基酸序列。

图神经网络在更多生物问题上的应用

除了常规的分子图建模,图神经网络还可以应用到其他类型的数据和问题上,推动更多生物问题的研究,接下来我将分享两个例子。

第一个例子是生物社交网络分析与简化。 类似于人类社交网络的复杂关系,各种层级的生物社交网络(比如微生物网络、基因网络等)都存在很多值得探索的内容。

我们曾以基因共现网络进行社交网络简化研究。如下图所示,a, b 两图分别是来自深海和高山的相同基因的不同网络,其原始形态复杂且杂乱无章,通过构建类似人类社交网络的图神经网络,我们对两个网络进行简化,识别出占据绝对主导地位的基因,并区分哪些基因间存在更为紧密的联系,哪些基因间的联系相对较弱。简化后的网络能够帮助生物学家利用专业知识对网络及生物群落进行分析。该研究的初步版本题为「A unified view on neural message passing with opinion dynamics for social networks」。

预印版论文地址:

https://arxiv.org/abs/2310.01272

第二个例子是基于图神经网络的可解释性研究, 一个直观的例子是,图神经网络可以帮助识别分子内的关键局部结构。这个结果一方面可用于检验模型的合理性,例如,在预测蛋白质功能时,若模型能在一定程度上将关键原子或氨基酸定位至活性中心附近,则表明该模型具备一定的合理性,反之,若模型的注意力随机离散分布在蛋白质表面的多个氨基酸上,则模型可能存在问题。另一方面,在理想情况下,一个合理、强大的解释性模型,通过分析各节点对于功能预测的作用,在未来甚至可能帮忙识别出全新蛋白的口袋区域。

尽管大模型在很多应用场景中提供了丰富的成功经验,但它并不是所有问题的唯一解,作为天然存在各种结构性数据的领域,图神经网络在生物学中的很多问题都能提供可能的解决方案。无论是分子、复合物、基因、微生物网络,或是更大更复杂的系统,图神经网络通过植入归纳偏差,即使在少量数据情况下也能通过最大化借助人类先验知识,提供一个简洁的解决方案。

关于周冰心

周冰心

周冰心目前任上海交通大学,国家应用数学中心(上海交大分中心)助理研究员。她于 2022 年在澳大利亚悉尼大学获得博士学位,后出访英国剑桥大学访问学者。其研究主要关注利用深度学习(特别是几何深度学习)解决生物学中的挑战,如酶工程、代谢基因网络和蛋白质结构组进化分析。开发的深度学习算法用于处理静态、动态、异质和噪声图等,部分发表在 IEEE TPAMI、JMLR、ICML、NeurIPS 等国际顶级期刊和会议上;用于蛋白质工程和序列设计的通用的深度学习框架能够有效设计并显著提升复杂蛋白活性,部分成果发表于 eLife、Chem. Sci.、ACS JCIM 等期刊。

个人主页:

https://ins.sjtu.edu.cn/peoples/ZhouBingxin

Google Scholar:

https://scholar.google.com/cita