一、SD模型简介

Stable Diffusion的绘图风格主要由模型来控制,基础模型主要由二次元图片训练获得,所以在不安装其他模型的情况下,只能生成二次元风格的图像。

二、SD模型分类和作用

2.1 Checkpoint模型

Checkpoint模型是Stable Diffusion的核心。它包含了神经网络的所有权重和参数,是生成图像的基础。这些模型通常体积较大,因为它们包含了大量的参数,这些参数是在大量图像数据上训练得到的。通过微调这些参数,可以对模型进行改进,以生成具有特定风格的图像。微调Checkpoint模型的方法有多种,包括附加训练、Dreambooth和文本反转等。

2.2 LoRA模型

LoRA模型是一种轻量级的微调方法。与直接修改Checkpoint模型的参数不同,LoRA模型通过添加一些小的补丁文件来修改模型的输出。这些补丁文件通常体积较小,可以与Checkpoint模型一起使用,而不需要对整个模型进行大量的修改。

例如:下面对人物的修饰模型

林鹤-妆容,美颜,磨皮,滤镜,四合一差异炼丹功能性lora。-LoRA-林鹤_AIGC-LiblibAI

2.3 Hypernetworks

Hypernetworks是一种特殊的网络结构,它可以被添加到Checkpoint模型中。Hypernetworks不是直接生成图像,而是生成其他网络的权重。通过这种方式,它们可以为Checkpoint模型提供额外的灵活性,使其能够根据不同的输入生成不同的图像。

2.4、VAE

VAE是一种将特定风格或属性集成到Checkpoint模型中的方法。它可以被看作是一种特殊的微调技术,用于向模型注入某种风格或属性。一旦AVE被集成到checkpoint中,它就可以像滤镜一样作用于生成的图像,使其呈现出特定的风格或特征。

这些模型和微调技术为Stable Diffusion用户提供了广泛的灵活性,使用户可以根据自己的需求定制和改进模型,生成更符合期望的图像。

在实际使用过程中我们主要使用到模型类型有:Checkpoint模型、LORA、VAE等类型。

三、SD模型下载与使用

3.1 Checkpoint模型下载与使用

这里我选择一款比较真实的人物模型AWPortrait(AWPortrait-Checkpoint-DynamicWang-LiblibAI)

将AWPortrait_v1.4.safetensors文件到stable-diffusion-webui/models/Stable-diffusion/目录下

AWPortrait真的是一台美颜相机:

然后在界面上选择模型,如果没有出现就点击右边的刷新按钮。

测试一下效果:

生成图片

3.2 Lora模型下载与使用

LoRa的作用包括:

自然语言处理(NLP):帮助大型语言模型适应特定任务。

计算机视觉(CV):优化图像分类、对象检测等模型性能。

个性化推荐系统:快速适应用户反馈,提供定制化推荐。

语音识别和合成:提高识别或合成的准确度。

长距离传输能力:适用于远距离通信。

低功耗:适合长时间运行的应用。

抗干扰能力强:提高网络稳定性和可靠性。

多设备连接:构建大规模物联网网络。

开放性和生态系统:支持解决方案的扩展、捆绑和演进。

模型一:

选择一个和人物有关的模型:林鹤-妆容,美颜,磨皮,滤镜,四合一差异炼丹功能性lora。-LoRA-林鹤_AIGC-LiblibAI

将下载模型放到stable-diffusion-webui/models/Lora目录下

在上面文本生成图片后直接转到图生图,当然也可以单独直接进入图生图,编写你自定义的图片,给相关提示词和反对提示词

几秒后就出现了现在这种界面显示:

如果没有显示Lora就点击刷新按钮进行刷新显示列表:

下面是该Lora模型坐着给出的推荐设置

推荐lora权重:0.2-0.6,可以看上图来参考加入权重参数~

推荐出图尺寸:512·768,512·960,512·1024.

推荐采样方法:DPM++2M以上版本,

推荐CFG:5-7

推荐开启高清修复,算法:R-ESRGAN 4x+,4x-UltraSharp,重绘幅度:0.3

推荐正面提示词:无需特殊提示词,加入lora即可使用。

推荐负面提示词:(NSFW:1.3),teeth,(cleavage),(worst quality:1.65),(low quality:1.2),(normal quality:1.2),low resolution,watermark,dark spots,blemishes,dull eyes,wrong teeth,red teeth,bad tooth,Multiple people,broken eyelashes,(badhandv4-AnimeIllustDiffusion_badhandv4:1.2),(EasyNegative:1.2),

对于人物的Lora调制

<lora:LH_zrV2:-0.2>

upper body portrait of 1girl wear a black color turtleneck sweater,A proud and confident expression,long hair,look at viewers,studio fashion portrait,studio light,pure white background,

<lora:LH_zrV2:-0.2>

<lora:LH_zrV2:-1>生成图片:

<lora:LH_zrV2:-0.2>生成图片:

<lora:LH_zrV2:1>生成结果:

从上面的图片效果看,该lora的瘦脸、美白功能非常显现

还原拍立得照片风格的LoRA

建议大家在使用时,将 lora 的权重选为 0.6 至 0.8

LEOSAM's Instant photo 拍立得/Polaroid LoRA-LoRA-LEOSAM是只兔狲-LiblibAI

upper body portrait of 1girl wear a black color turtleneck sweater,A proud and confident expression,long hair,look at viewers,studio fashion portrait,studio light,pure white background,

<lora:LEOSAM_Instant_photo_拍立得_Polaroid_LoRA_InspX_Borderless_Version:0.8>

作者推荐0.6-0.8,但是我生成的效果是

我采用 <lora:LEOSAM_Instant_photo_拍立得_Polaroid_LoRA_InspX_Borderless_Version:-0.2>

从上面的结果看效果需要自己调节,作者给出的结果是最好的,但是不一定是我们核实的

3.3 VAE模型下载与使用

主要功能就是一个滤镜和微调。

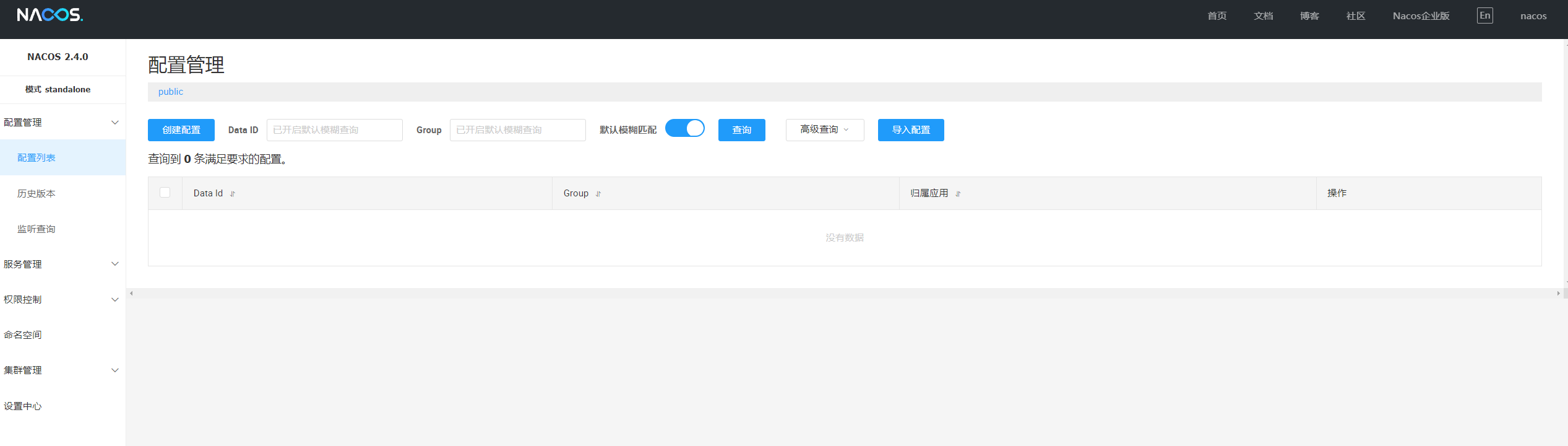

这里先把需要显示设置的加上,「sd_vae」、「CLIP_stop_at_last_layers」

分别是显示vae模型和CLIP终止层数,CLIP终止层数看是否需要添加

VAE模型有多重格式: *.safetensors,*.ckpt,*.pt

*.safetensors,*.ckpt模型放置到:stable-diffusion-webui/models/Stable-diffusion

*.pt模型放置到stable-diffusion-webui/models/VAE

下载地址:https://civitai.com/models/4201?modelVersionId=501286

还可以将主模型和vae进行合并

点击合并后会生成一个my-vae的主模型,选中即可集成之前的主模型和vae模型

下面讲讲vae的局部重绘:

为了试验,将一张图片的脸部去掉一部分:

在图生图的inpaint下面上传改图,并且将面部涂抹,并且选中inpaint的模型

生成的图片有点丑,但这里只做试验,说明一下vae的功能

![[Office] Word 特殊字符](https://i-blog.csdnimg.cn/direct/bfab2b9225094d9c91cb695f23b7eb73.png)