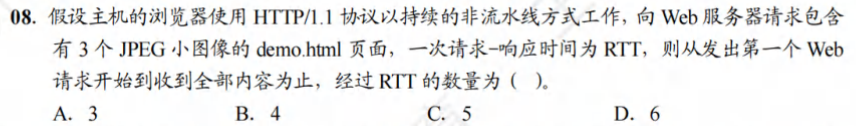

引言

在互联网时代,数据的价值日益凸显。网页爬虫作为一种自动化获取网页内容的工具,广泛应用于数据挖掘、市场分析、内容聚合等领域。Scrapy是一个强大的网页爬虫框架,而BeautifulSoup则是一个灵活的HTML和XML文档解析库。本文将探讨如何将这两个工具深度整合,开发出高级的网页爬虫。

为什么选择Scrapy和BeautifulSoup

Scrapy以其灵活性和强大的网络请求处理能力著称。它支持异步处理,能够同时处理多个请求,从而提高爬取效率。同时,Scrapy还提供了丰富的中间件支持,使得在请求发送和响应处理过程中可以灵活地添加自定义逻辑。

BeautifulSoup则以其简洁的API和强大的解析能力被广泛使用。它能够轻松地从复杂的HTML文档中提取出所需的数据。尽管Scrapy自带了强大的选择器,但在某些复杂情况下,BeautifulSoup提供了更多的灵活性和控制力。

环境准备

在开始之前,确保你的开发环境中已经安装了Python和pip。然后,通过pip安装Scrapy和BeautifulSoup4。

bash

pip install scrapy

pip install beautifulsoup4

创建Scrapy项目

首先,创建一个新的Scrapy项目。

bash

scrapy startproject mycrawler

这将创建一个名为mycrawler的目录,其中包含了Scrapy项目的基本结构。

定义Item

在Scrapy中,Item是存储爬取数据的容器。定义一个Item来指定你想要抓取的数据字段。

python

# mycrawler/items.py

import scrapy

class MyItem(scrapy.Item):

title = scrapy.Field()

link = scrapy.Field()

description = scrapy.Field()

编写Spider

Spider是Scrapy中负责发送请求并解析响应的类。编写一个Spider来定义爬取的逻辑。

python

# mycrawler/spiders/myspider.py

import scrapy

from mycrawler.items import MyItem

class MySpider(scrapy.Spider):

name = 'my_spider'

start_urls = ['http://example.com']

def parse(self, response):

for article in response.css('div.article'):

item = MyItem()

item['title'] = article.css('h2::text').get()

item['link'] = article.css('a::attr(href)').get()

item['description'] = article.css('p.description::text').get()

yield item

使用BeautifulSoup进行数据清洗

在某些情况下,你可能需要对Scrapy提取的数据进行进一步的清洗或提取更复杂的数据结构。这时,可以使用BeautifulSoup。

python

# mycrawler/pipelines.py

import scrapy

from bs4 import BeautifulSoup

class MyPipeline(scrapy.Pipeline):

def process_item(self, item, spider):

soup = BeautifulSoup(item['description'], 'html.parser')

item['description'] = soup.get_text()

return item

配置项目

在settings.py中启用Pipeline,并设置下载延迟和并发请求的数量。

python

# mycrawler/settings.py

ITEM_PIPELINES = {

'mycrawler.pipelines.MyPipeline': 300,

}

DOWNLOAD_DELAY = 3

CONCURRENT_REQUESTS_PER_DOMAIN = 8

处理JavaScript渲染的页面

如果目标网站使用JavaScript动态加载内容,Scrapy可能无法直接提取这些内容。这时,可以使用Scrapy的中间件或Selenium来处理。

python

# mycrawler/middlewares.py

import scrapy

from selenium import webdriver

class SeleniumMiddleware(scrapy.Middleware):

def process_request(self, request, spider):

if request.meta.get('download_delay'):

time.sleep(request.meta['download_delay'])

def process_response(self, request, response, spider):

if request.meta.get('download_delay'):

driver = webdriver.PhantomJS()

driver.get(request.url)

body = driver.page_source

driver.quit()

return scrapy.http.HtmlResponse(request.url, body=body, encoding='utf-8', request=request)

return response

遵守Robots协议

在爬取前,检查目标网站的robots.txt文件,确保遵守网站的爬取规则。

存储数据

将提取的数据存储到文件或数据库中。Scrapy提供了多种存储选项,如JSON、CSV、XML等。

python

# mycrawler/pipelines.py

class JsonPipeline:

def open_spider(self, spider):

self.file = open('items.json', 'w')

def close_spider(self, spider):

self.file.close()

def process_item(self, item, spider):

line = json.dumps(dict(item), ensure_ascii=False) + "\n"

self.file.write(line)

return item

结论

通过深度整合Scrapy和BeautifulSoup,我们可以构建一个功能强大、灵活高效的网页爬虫。Scrapy负责处理网络请求和响应,而BeautifulSoup则用于数据的解析和清洗。这种结合不仅提高了数据抓取的效率,也增强了数据提取的灵活性。