(作者:陈玓玏)

开源项目,欢迎star哦,https://github.com/data-infra/cube-studio

训练AI模型以及部署模型推理服务时,GPU往往是必不可少的,但当我们机器上没有足够的GPU卡可使用时,多任务并行就会有困难。针对这个问题,cube-studio上可以使用VGPU,相当于将一张GPU卡当成多张来使用,从而实现多卡多应用占用。

以下我们举例说明,如何通过VGPU配置,实现推理服务的VGPU占用。

1. 进入训练平台

体验环境可以直接使用,也可以根据https://github.com/data-infra/cube-studio/wiki来部署之后使用。

2. 配置VGPU

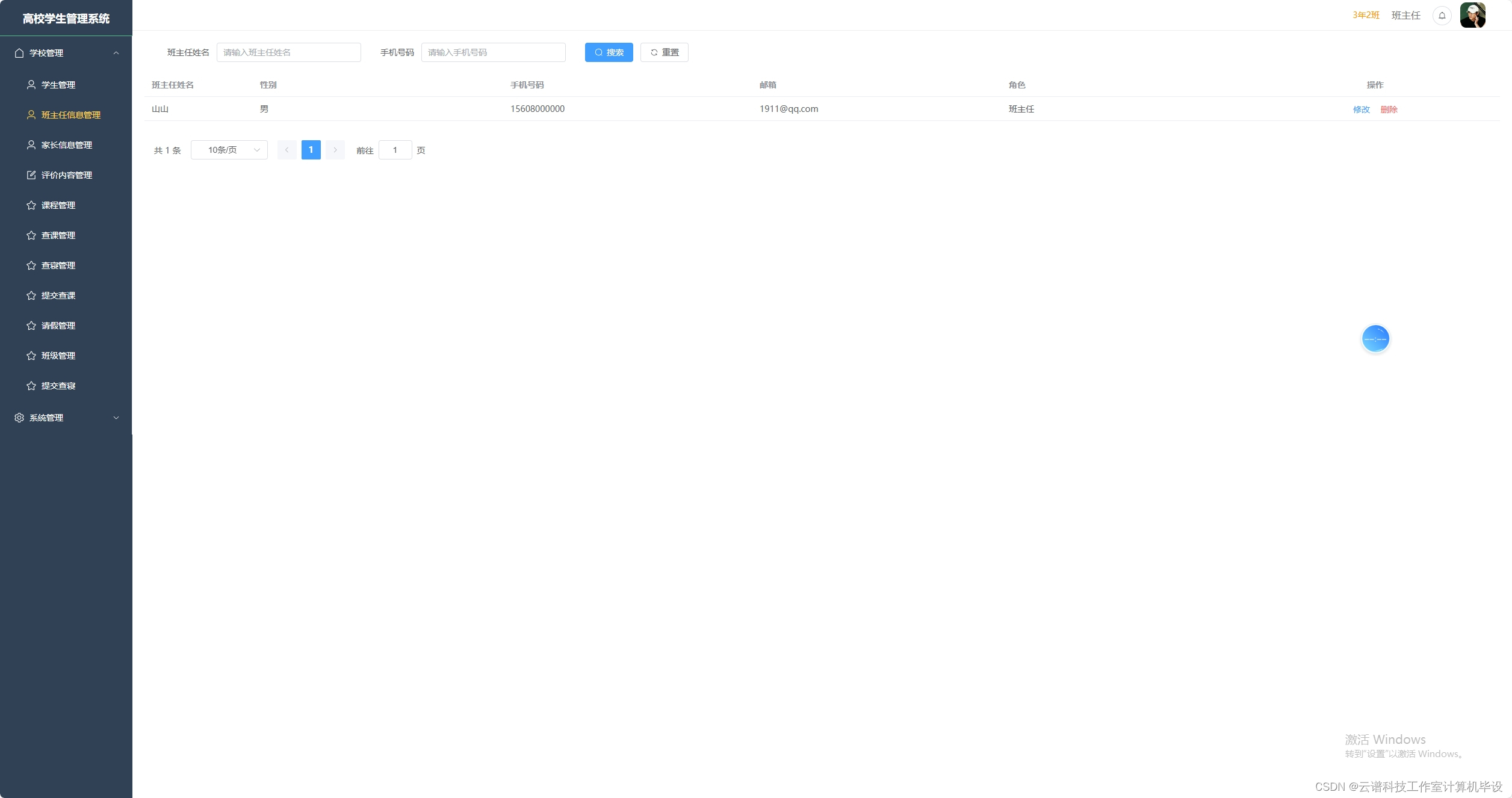

选择一个已经部署好的推理服务(有模型接口即可)。

-

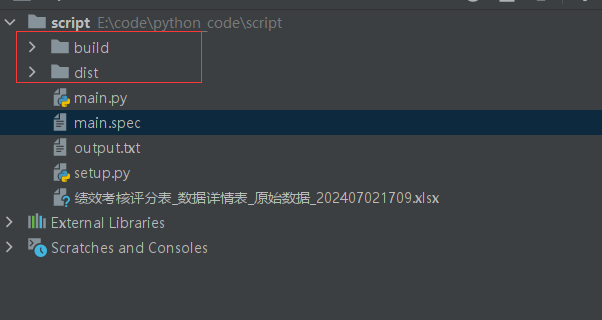

“服务化”-“推理服务”-“更多”-“修改”,修改推理服务的GPU申请为0.1、最大最小副本数为3,修改确认后,推理服务信息如下;

-

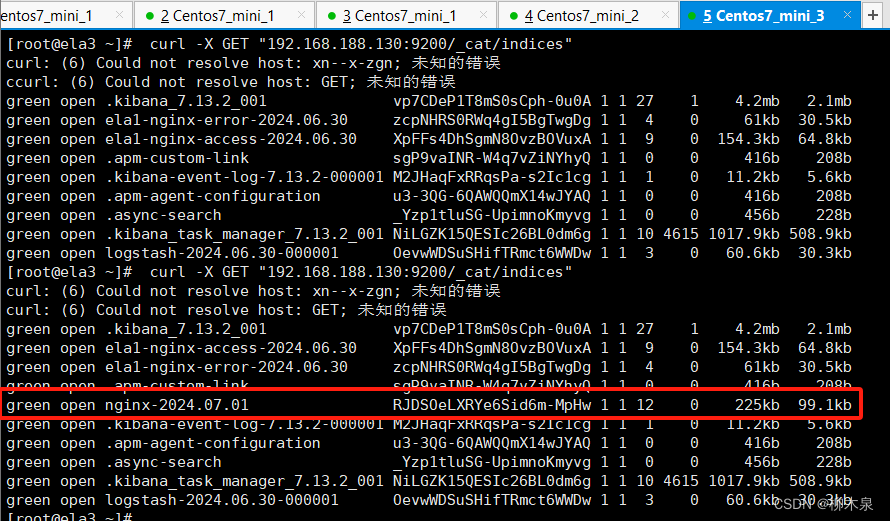

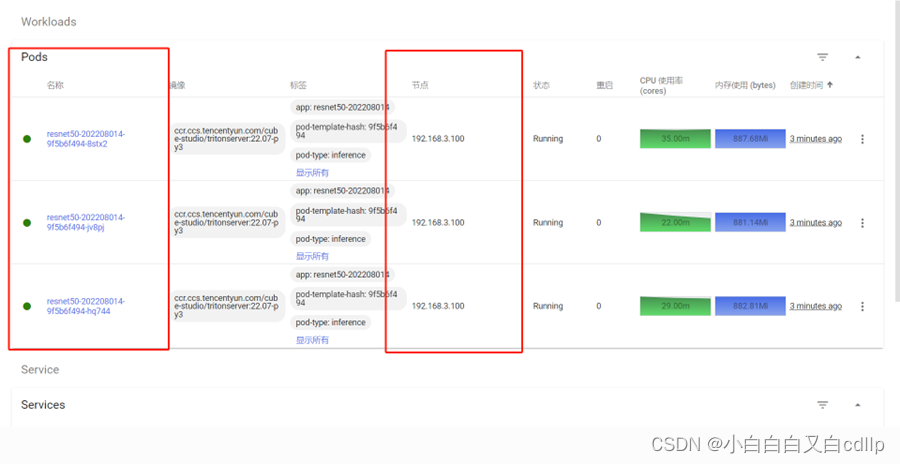

点击服务的“部署生产”,部署服务,并点击模型名称链接查看其pod,可以看到同一服务的3个pod是在同一台机器上;

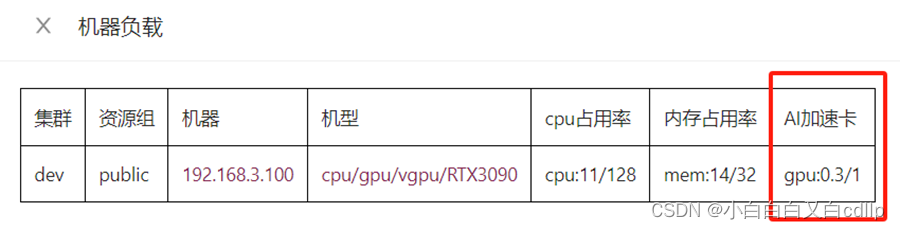

- “服务化”-“整体资源”,可看到机器仅1张GPU卡,目前占用0.3张。

以上可证明该推理服务以VGPU模式占用了GPU卡。