【论文原文】:ECCV2022 - BEVFormer: Learning Bird’s-Eye-View Representation from Multi-Camera Images via Spatiotemporal Transformers

论文:https://arxiv.org/abs/2203.17270

代码:https://github.com/fundamentalvision/BEVFormer

博主关键词: 小样本学习,语义分割,图注意力网络,互监督,目标检测,三维视觉

推荐相关论文:

【论文速递】CoRL2021 - DETR3D:通过 3D 到 2D 查询从多视图图像中检测 3D 对象

https://bbs.csdn.net/topics/612489503

摘要

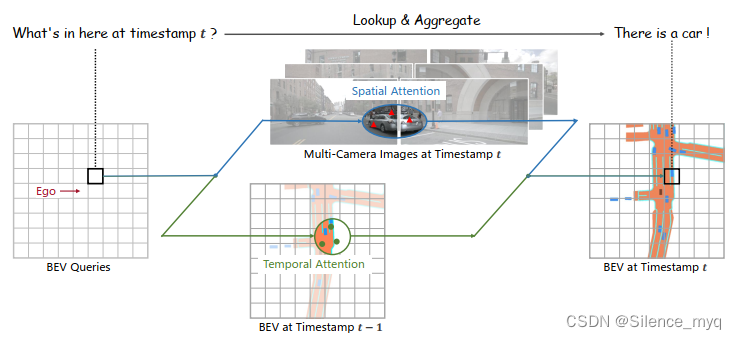

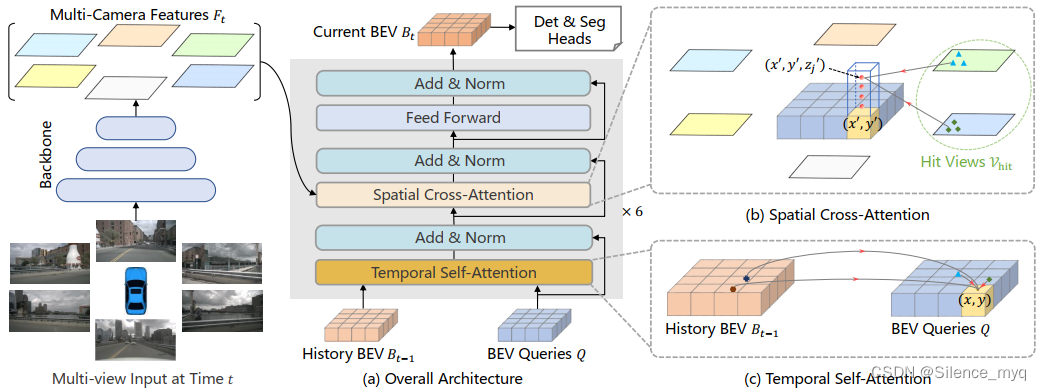

3D 视觉感知任务,包括基于多相机图像的 3D 检测和地图分割,对于自动驾驶系统至关重要。在这项工作中,文章提出了一个名为 BEVFormer 的新框架,它使用时空变换器学习统一的 BEV 表示,以支持多个自动驾驶感知任务。 简而言之,BEVFormer 通过预定义的网格状 BEV 查询与空间和时间交互,从而利用空间和时间信息。 为了聚合空间信息,文章设计了空间交叉注意力(Spatial Cross Attention),每个 BEV 查询都从相机视图中的感兴趣区域中提取空间特征。 对于时间信息,文章提出时间自我注意(Temporal Self Attention)以循环融合历史 BEV 信息。 方法在 nuScenes 测试集的 NDS 指标方面达到了新的最先进的 56.9%,比以前的最佳技术高 9.0 分,与基于 LiDAR 的基线的性能相当。 进一步表明,BEVFormer 在低能见度条件下显着提高了速度估计和对象召回的准确性。

简介

3D 空间中的感知对于自动驾驶、机器人技术等各种应用至关重要。尽管基于 LiDAR 的方法取得了显着进步,但基于相机的方法近年来引起了广泛关注。 与基于 LiDAR 的对应物相比,除了部署成本低之外,摄像头还具有检测远距离物体和识别基于视觉的道路元素(例如,交通信号灯、停车线)的理想优势。

自动驾驶中周围场景的视觉感知有望根据多个摄像头给出的 2D 线索预测 3D 边界框或语义图。 最直接的解决方案是基于单目框架和跨相机后处理。 该框架的缺点是它分别处理不同的视图并且无法跨相机捕获信息,从而导致性能和效率低下。

作为单目框架的替代方案,一个更统一的框架正在从多相机图像中提取整体表示。 鸟瞰图 (BEV) 是一种常用的周围场景表示,因为它可以清楚地呈现物体的位置和规模,适用于各种自动驾驶任务,例如感知和规划。 尽管以前的地图分割方法证明了 BEV 的有效性,但基于 BEV 的方法在 3D 对象检测中并未显示出优于其他范例的显着优势。 根本原因是 3D 对象检测任务需要强大的 BEV 特征来支持准确的 3D 边界框预测,但是从 2D 平面生成 BEV 是不适定的。 生成 BEV 特征的流行 BEV 框架是基于深度信息的,但这种范式对深度值或深度分布的准确性很敏感。 因此,基于 BEV 的方法的检测性能容易受到复合误差的影响,不准确的 BEV 特征会严重损害最终性能。 因此,我们有动力设计一种不依赖深度信息的 BEV 生成方法,并且可以自适应地学习 BEV 特征,而不是严格依赖 3D 先验。 Transformer使用注意力机制动态聚合有价值的特征,从概念上满足了我们的需求。

使用 BEV 特征执行感知任务的另一个动机是 BEV 是连接时空空间的理想桥梁。 对于人类视觉感知系统,时间信息在推断物体的运动状态和识别被遮挡物体方面起着至关重要的作用,视觉领域的许多工作已经证明了使用视频数据的有效性。 然而,现有的最先进的多相机 3D 检测方法很少利用时间信息。 重大挑战是自动驾驶是时间关键的,场景中的物体变化很快,因此简单地堆叠交叉时间戳的 BEV 特征会带来额外的计算成本和干扰信息,这可能不是理想的。 受循环神经网络 (RNN) 的启发,我们利用 BEV 特征循环传递从过去到现在的时间信息,这与 RNN 模型的隐藏状态具有相同的精神。

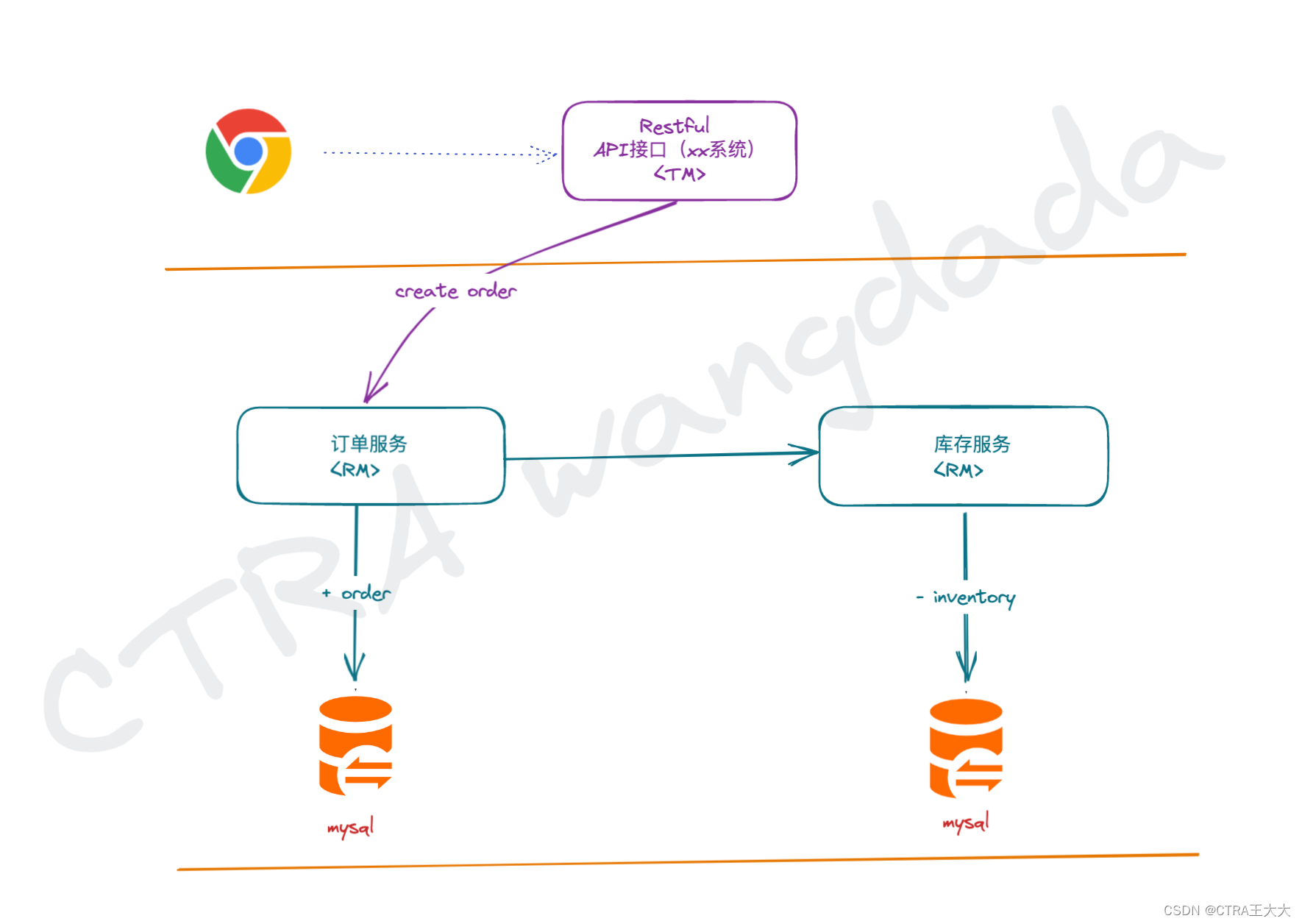

为此,文章提出了一种基于变换器的鸟瞰图 (BEV) 编码器,称为 BEVFormer,它可以有效地聚合来自多视图相机的时空特征和历史 BEV 特征。 BEVFormer 生成的 BEV 特征可以同时支持 3D 物体检测和地图分割等多种 3D 感知任务,这对自动驾驶系统具有重要价值。 如图 1 所示,我们的 BEVFormer 包含三个关键设计,即(1)网格状 BEV 查询以通过注意力机制灵活地融合空间和时间特征,(2)空间交叉注意力模块以聚合来自多个空间特征,和(3)时空自注意力模块,从历史BEV特征中提取时间信息,这有利于运动物体的速度估计和严重遮挡物体的检测,同时带来可忽略的计算开销。 借助 BEVFormer 生成的统一特征,该模型可以与不同的任务特定头(如 Deformable DETR 和掩码解码器)协作,进行端到端 3D 对象检测和地图分割。

文章的主要贡献如下:

• 提出BEVFormer,一种时空变换器编码器,可将多摄像头和/或时间戳输入投射到BEV 表示。 凭借统一的 BEV 功能,我们的模型可以同时支持多个自动驾驶感知任务,包括 3D 检测和地图分割。

• 文章设计了可学习的 BEV 查询以及空间交叉注意层和时间自注意层,以查找来自交叉摄像头的空间特征和来自历史的时间特征BEV,然后将它们聚合成统一的 BEV 特征。

• 文章在多个具有挑战性的基准测试中评估提议的 BEVFormer,包括 nuScenes 和 Waymo。 与现有技术相比,我们的 BEVFormer 始终如一地实现了改进的性能。 例如,在可比较的参数和计算开销下,BEVFormer 在 nuScenes 测试集上实现了 56.9% NDS,比之前的最佳检测方法 DETR3D高出 9.0 个百分点(56.9% 对 47.9%)。 对于地图分割任务,我们也实现了最先进的性能,在最具挑战性的车道分割上比 Lift-Splat高出 5.0 多分。 我们希望这个简单而强大的框架可以作为后续 3D 感知任务的新基线。

【社区访问】

【论文速递 | 精选】

【论文速递 | 精选】

阅读原文访问社区

阅读原文访问社区

https://bbs.csdn.net/forums/paper