在现代Java开发中,流(Streams)和链表(LinkedList)都是强大且常用的数据处理工具。java.util.stream提供了高效的方式来处理数据流,而LinkedList则是java.util包中的经典集合实现。本文将探索它们的交汇点,展示如何将二者结合使用,并通过代理IP技术实现网络爬虫的实例。

概述

流(Streams)是一种用于处理数据序列的抽象,可以执行大规模数据操作如过滤、排序和聚合。链表(LinkedList)是双向链表的实现,适用于频繁插入和删除操作的数据结构。在实际开发中,结合使用流和链表,可以编写出简洁且高效的代码。

细节

LinkedList的基本操作

LinkedList是Java集合框架的一部分,提供了丰富的操作方法。以下是一些基本的使用示例:

import java.util.LinkedList;

public class LinkedListExample {

public static void main(String[] args) {

LinkedList<String> list = new LinkedList<>();

// 添加元素

list.add("A");

list.add("B");

list.add("C");

// 遍历元素

for (String element : list) {

System.out.println(element);

}

// 删除元素

list.remove("B");

// 输出修改后的列表

System.out.println("Updated List: " + list);

}

}

使用Stream处理LinkedList

结合Stream可以更高效地处理LinkedList中的数据。以下示例展示了如何对LinkedList进行过滤和映射操作:

import java.util.LinkedList;

import java.util.List;

import java.util.stream.Collectors;

public class StreamWithLinkedList {

public static void main(String[] args) {

LinkedList<String> list = new LinkedList<>();

list.add("A");

list.add("B");

list.add("C");

list.add("D");

// 使用Stream过滤并映射元素

List<String> filteredList = list.stream()

.filter(element -> !element.equals("B"))

.map(String::toLowerCase)

.collect(Collectors.toList());

System.out.println("Filtered List: " + filteredList);

}

}

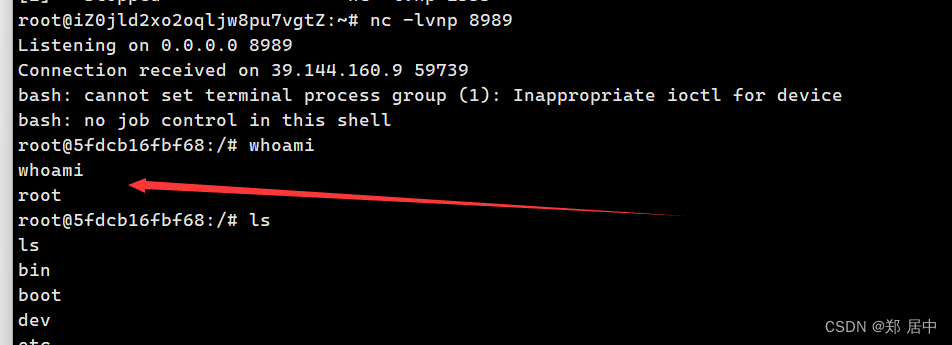

实现网络爬虫

为了实现网络爬虫并使用代理IP,我们需要用到HttpClient库。以下示例展示了如何使用HttpClient结合代理IP抓取网页内容:

首先,添加依赖项(如果使用Maven):

<dependency>

<groupId>org.apache.httpcomponents.client5</groupId>

<artifactId>httpclient5</artifactId>

<version>5.1.2</version>

</dependency>

然后,编写代码实现爬虫功能:

import java.net.URI;

import java.net.http.HttpClient;

import java.net.http.HttpRequest;

import java.net.http.HttpResponse;

import java.net.ProxySelector;

import java.net.InetSocketAddress;

import java.net.Proxy;

import java.util.LinkedList;

import java.util.List;

import java.util.stream.Collectors;

public class ProxyCrawler {

public static void main(String[] args) {

// 使用亿牛云爬虫代理的配置信息

String proxyHost = "www.16yun.cn";

int proxyPort = 12345;

String proxyUser = "your_username";

String proxyPass = "your_password";

// 设置代理

HttpClient client = HttpClient.newBuilder()

.proxy(ProxySelector.of(new InetSocketAddress(proxyHost, proxyPort)))

.authenticator(new ProxyAuthenticator(proxyUser, proxyPass))

.build();

// 目标URL列表

LinkedList<String> urls = new LinkedList<>();

urls.add("http://example.com/page1");

urls.add("http://example.com/page2");

urls.add("http://example.com/page3");

// 抓取网页内容

List<String> results = urls.stream()

.map(url -> fetchContent(client, url))

.collect(Collectors.toList());

// 输出抓取结果

results.forEach(System.out::println);

}

private static String fetchContent(HttpClient client, String url) {

try {

HttpRequest request = HttpRequest.newBuilder()

.uri(URI.create(url))

.build();

HttpResponse<String> response = client.send(request, HttpResponse.BodyHandlers.ofString());

return "URL: " + url + ", Content: " + response.body();

} catch (Exception e) {

return "Error fetching " + url + ": " + e.getMessage();

}

}

}

class ProxyAuthenticator extends java.net.Authenticator {

private final String user;

private final String password;

public ProxyAuthenticator(String user, String password) {

this.user = user;

this.password = password;

}

@Override

protected java.net.PasswordAuthentication getPasswordAuthentication() {

return new java.net.PasswordAuthentication(user, password.toCharArray());

}

}

代理IP技术

在上述代码中,通过ProxySelector和ProxyAuthenticator设置代理IP,并通过HttpClient发送请求。这种方式可以有效绕过目标网站的反爬虫机制。

性能对比

使用Stream处理LinkedList能够简化代码,提高可读性和维护性。而在网络爬虫中使用代理IP技术,可以提高爬取成功率。

结论

Java流(Streams)和链表(LinkedList)在数据处理上各具优势,结合使用能够发挥更大的威力。在实现网络爬虫时,通过代理IP技术,可以有效提高爬虫的稳定性和效率。希望本文的介绍和示例代码能够帮助您更好地理解并应用这些技术,从而提升您的开发效率和代码质量。

![[排序算法]插入排序+希尔排序全梳理!](https://img-blog.csdnimg.cn/direct/f487f33f117e41af81f31bfe9d4d993e.png)