3D 生成重建012-Magic123早期使用不同SDS相减的探索

文章目录

- 0论文工作

- 1论文方法

- 2效果

0论文工作

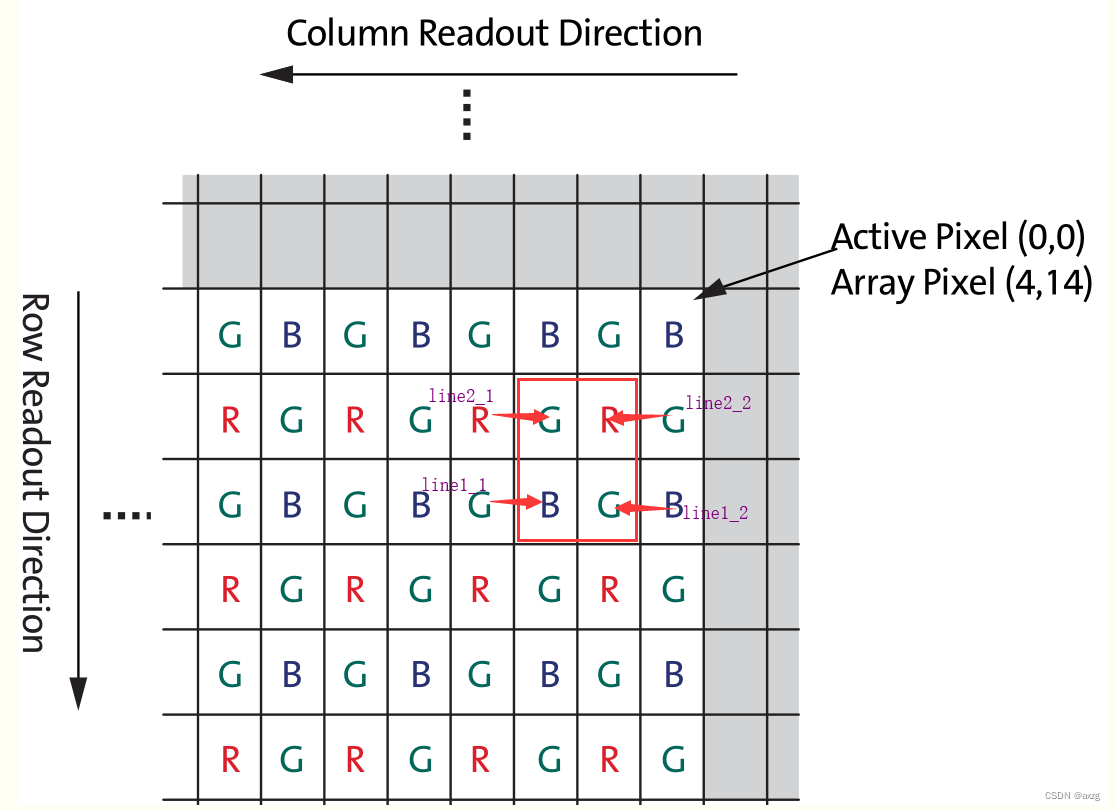

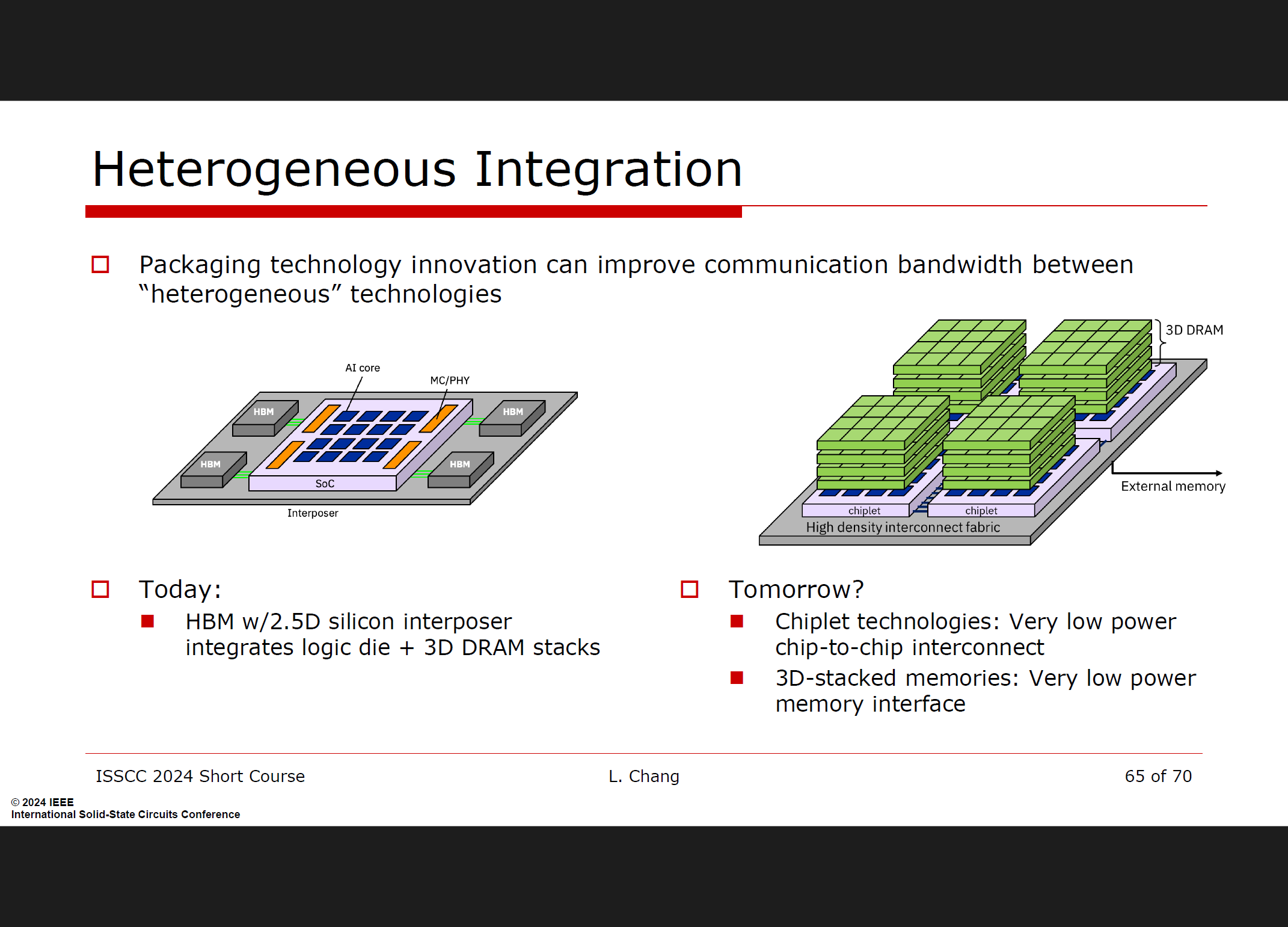

Magic123提出了一种两阶段粗到细的方法,用于使用2D和3D先验从野外未曝光图像生成高质量的纹理3D网格。在第一阶段,优化一个神经辐射场,以产生一个粗糙的几何形状。在第二阶段,采用记忆高效的可微网格表示来产生具有视觉吸引力的高分辨率网格线条纹理。在这两个阶段中,三维内容都是通过参考视图监督和由二维和三维扩散先验相结合的新视角来学习的。

这篇论文属于早期尝试使用两种sds优化3d表示的方法,同期使用相近的思路的还有3DStyle-Diffusion,TextureDreamer,Sparse3D等,但尽量尝试找一个理论去解释这种做法的还是这个LucidDreamer的写法更为感人。

虽然从最终的生成效果来看,magic123这种方法很快被很多基于优化或者多视图扩散模型和feed-forwar生成模型的算法超越了,但是这种对sds优化的探索,除了这个相减,就是3dfuse的3d先验知识引入和ProlificDreamer的理论扩展。基本上来说这个三种策略贯穿了所有基于优化的方法。无论是nerf表达,还是instant-ngp还是3d gaussian splatting。

magic123链接

1论文方法

Magic123致力于解决从单张图像生成高质量三维模型的挑战,这是一个长期存在的难题。该论文指出,以往的方法通常难以平衡生成细节的保真度和三维结构的准确性。Magic123通过引入一个新颖的框架来克服这些限制,该框架有效地结合了二维和三维扩散先验。

以下是其核心组件和工作原理的细分:

- 现有方法的局限性:

细节不足: 许多从单张图像生成三维模型的方法难以捕捉精细的纹理和几何细节,导致生成结果缺乏真实感。

三维结构不准确: 准确推断三维结构需要从二维图像中提取丰富的信息,这对许多现有方法来说是一个挑战,常常导致生成对象出现扭曲或不自然的形状。 - Magic123 的解决方案:

a) 结合2D和3D扩散先验: 这是Magic123的核心创新。该方法不是依赖单一扩散模型,而是利用二维和三维扩散模型分别学习图像和形状的先验知识。

-

2D扩散先验: 一个二维扩散模型在大量图像数据集上进行训练,学习自然图像的分布,并捕捉丰富的纹理和外观细节。

-

3D扩散先验: 一个三维扩散模型在三维形状数据集上进行训练,学习三维物体的结构和几何规律。

-

b) 两阶段生成过程: Magic123采用两阶段生成过程,有效地利用学习到的二维和三维先验。

-

-

阶段一:粗略三维生成:

- 从输入图像中提取特征。

- 利用三维扩散模型,以提取的图像特征和一个随机噪声张量为条件,生成一个粗略的三维模型。这一阶段侧重于建立合理的三维结构。

-

阶段二:细节优化:

- 将粗略三维模型渲染成多个视图图像。

- 利用二维扩散模型,以渲染图像、输入图像和随机噪声张量为条件,对粗略模型进行优化,添加纹理细节和提升保真度。

- c) 视图一致性损失: 为了确保从不同视角生成一致的细节,Magic123引入了一个视图一致性损失函数。该损失鼓励模型生成在不同视角下都能与输入图像相匹配的三维模型。

- Magic123 的优势:

高质量细节: 通过利用二维扩散先验,Magic123能够生成具有精细纹理和真实感外观的三维模型。

准确的三维结构: 三维扩散先验的使用有助于生成具有合理几何形状和结构的三维对象。

高效的训练和生成: 两阶段生成过程和视图一致性损失使得模型能够高效地学习和生成高质量的三维模型。

2效果