目录

- x-cmd 发布 v0.3.6

- 新增了 jina 模块

- 新增了 ddgo 模块

- 新增了 se 模块

- wkp 模块

- 新增了 writer 模块

- cosmo 模块

x-cmd 发布 v0.3.6

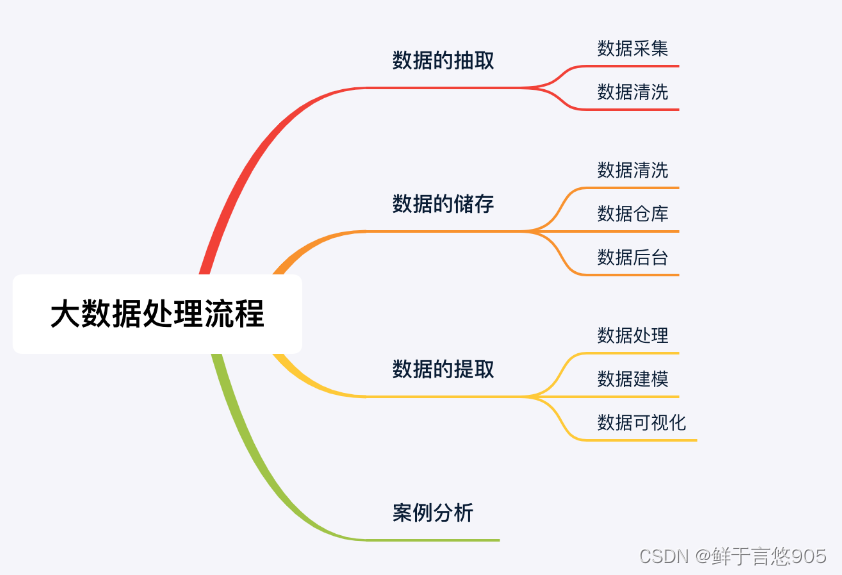

本次版本的最新引入的功能都是目的为了进一步探索 LLM 的使用。

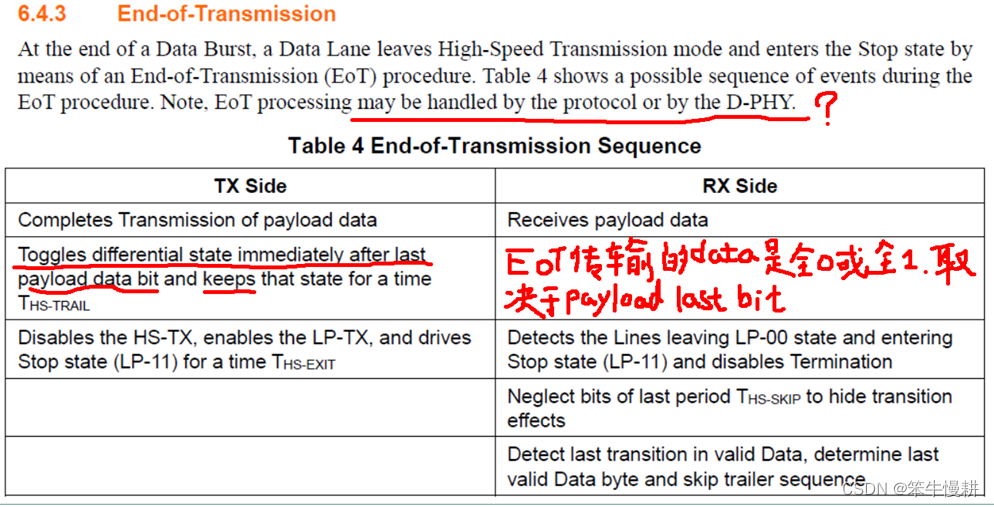

本版本的改进分为两类:资讯类模块(Wikipedia,StackExchange,Duckduckgo),LLM 模块( writer,gemini,openai,moonshot)。

用户在 CLI 上实现资讯的引用,并利用命令行 pipe 的便利,或者环境变量整合上下文,以探索 LLM 的可能。

新增了 jina 模块

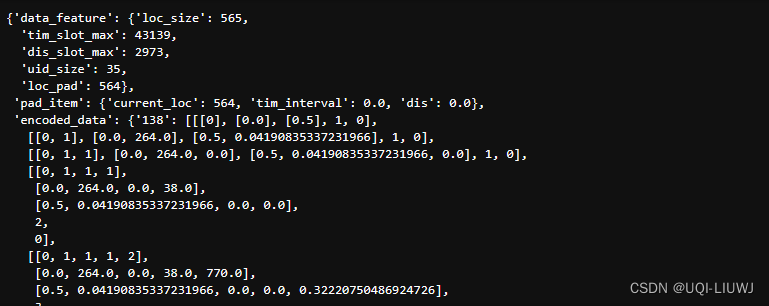

jina 模块基于 Jina.AI 公司的接口,我们提供了网址内容获取,生成文本向量和相关信息检索排序检索的功能。

使用案例:

新增了 ddgo 模块

借助 elinks,用户可以浏览 duckduckgo 内容,并根据链接获取相关的内容,作进一步处理 – 例如作为 context 提供给 LLM 。

使用案例:

新增了 se 模块

现在,借助 StackExchange 的 API,x-cmd的用户可以快速在 Stack Exchange 和 Stack Overflow 检索问题。借助 x-cmd 的一众 llm 模块,用户可以组合借助 ai 的力量,来实现信息的检索和处理。

使用案例:

wkp 模块

wikipedia 最终更名为 wkp,并调整 search、extract 功能的 UI。

维基百科的内容质量非常高;非常适合作为 LLM 的 context 。

使用案例:

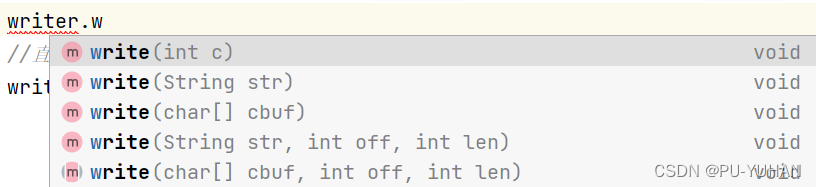

新增了 writer 模块

writer 模块可以自由选择不同的 AI 模型和语言风格,提供了翻译,摘要,总结,解释,扩写的功能。

writer 模块默认会有 @en 和 @zh 两个 alias,并按照命令界面中的 LANG,按需增加其它语种支持。用户可以借助这些 alias 快速使用不同语种的 writer 来翻译,改写,总结文本。

cosmo 模块

增加 --ls --local 查看所有下载的二进制。

另外,引入了 llamafile-0.8.4 和 llamafile-tokenize。

上述不少功能在一年前的版本都已实验形态存在,但在最近一周才完成最终的设计。se,wkp,ddgo,gtb 最终在流程上(包括术语,交互)可以做到近乎一致,这样用户可以用最低的认知成本,来整合这些高质量的内容,辅以 x-cmd 上500 多个现代化命令行工具,自由组合释放 LLM 的强大潜力。

遗憾的是,因为精力有限,以及受限于当前相关项目的发展水平:

gtb 模块因未完成测试而无法正式发布;

我们还未来得及整合 x-cmd 自身的本地LLM 模块 – 虽然功能都能用,但在实际测试发现有 llama.cpp 本身就有不少局限之处;llamafile 项目昨天更新的版本也是一波三折的(详见昨天新闻);虽然本次版本已经加入了最新版,但尚未应用里面的新功能。

我们还需不断测试和开发,以让 LLM agent 以 func call 的方式自主调用 x-cmd(536个pkg,200+模块,1000+ install);

这些都是往后版本重点探索的功能。

关注微信官方公众号 : oh my x

获取开源软件和 x-cmd 最新用法

![[单机]成吉思汗3_GM工具_VM虚拟机](https://img-blog.csdnimg.cn/img_convert/ee9be78a18d7d5bc082500017469ba5b.webp?x-oss-process=image/format,png)