提示:MATLAB版本需要R2023a以上

基于自注意力机制的长短期记忆神经网络(LSTM-SelfAttention)是一种用于时序数据预测的模型。这个模型结合了两个不同的结构,即长短期记忆网络(LSTM)和自注意力机制,从而在时序数据预测中发挥各自的优势。

1. 长短期记忆网络(LSTM)

长短期记忆网络(LSTM)是一种循环神经网络(RNN),它旨在解决传统RNN在处理长序列数据时存在的“遗忘问题”。LSTM通过引入记忆细胞和多个门控单元(输入门、遗忘门、输出门),可以更好地控制信息的流动和保持状态的持久性。

LSTM在时序数据预测中表现出色,因为它可以捕捉到数据中的长期依赖关系。例如,在股票价格预测、气象预测、销售数据预测等任务中,LSTM可以利用历史数据中的模式来预测未来。

2. 自注意力机制

自注意力机制是一个用于捕捉输入序列中不同部分之间关系的技术。它通过计算每个元素与其他元素之间的注意力权重,来确定哪些部分在给定任务中更为重要。这种机制使模型能够专注于输入序列中最相关的信息。

自注意力机制在时序数据预测中有助于更好地理解输入数据的依赖关系和模式。例如,某些数据点可能对预测未来值更为关键,而其他数据点则可能相对不太重要。自注意力机制可以帮助模型自动地识别这些重要数据点。

3. LSTM-SelfAttention

将LSTM和自注意力机制结合起来的模型通常被称为LSTM-SelfAttention。这个模型的结构一般如下:

输入层:接受时序数据作为输入。

LSTM层:处理输入数据,并生成每个时间步的输出。

自注意力层:在LSTM层之后,引入自注意力机制,以关注时序数据中的不同部分。

全连接层:将自注意力层的输出传递到全连接层,进行预测。

输出层:生成最终的预测结果。

LSTM-SelfAttention模型的优势在于它既能捕捉到时序数据中的长期依赖关系(通过LSTM),又能关注输入数据中的关键部分(通过自注意力机制)。这使得模型在时序数据预测任务中表现更好。

总结

基于自注意力机制的长短期记忆神经网络(LSTM-SelfAttention)是一种强大的时序数据预测模型。它结合了LSTM和自注意力机制的优势,可以有效地处理时序数据中的长期依赖关系和关键部分。通过这种组合,模型在预测任务中可以表现出更高的准确性和稳定性。

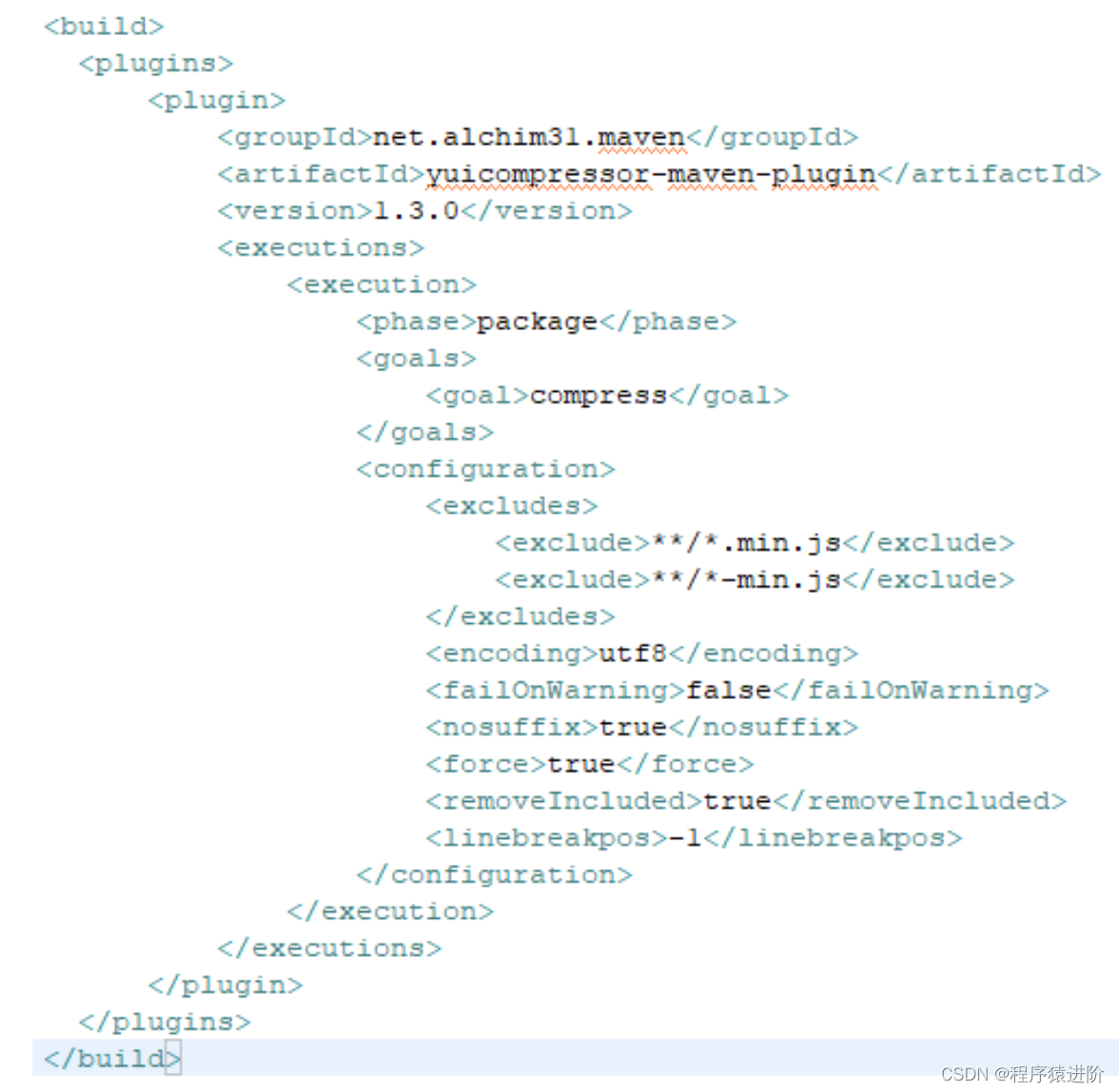

部分源代码:

%% 清空环境变量

clc;

clear;

close all;

warning off;

tic

%% 导入数据

load testdata.mat;

%% 数据分析

[trainInd,valInd,testInd] = dividerand(size(X,2),0.7,0,0.3); %划分训练集与测试集

P_train = X(:,trainInd); %列索引

T_train = Y(:,trainInd);

P_test = X(:,testInd);

T_test = Y(:,testInd);

M = size(P_train, 2);

N = size(P_test, 2);

L = size(P_train, 1);

lstmnumber = 100;

%% 数据归一化

[p_train, ps_input] = mapminmax(P_train, 0, 1);

p_test = mapminmax('apply', P_test, ps_input);

[t_train, ps_output] = mapminmax(T_train, 0, 1);

t_test = mapminmax('apply', T_test, ps_output);

%% 数据平铺

%将数据平铺成1维数据只是一种处理方式

%也可以平铺成2维数据,以及3维数据,需要修改对应模型结构

%但是应该始终和输入层数据结构保持一致

p_train = double(reshape(p_train, L, 1, 1, M));

p_test = double(reshape(p_test , L, 1, 1, N));

t_train = double(t_train)';

t_test = double(t_test )';

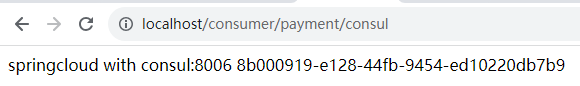

训练图:

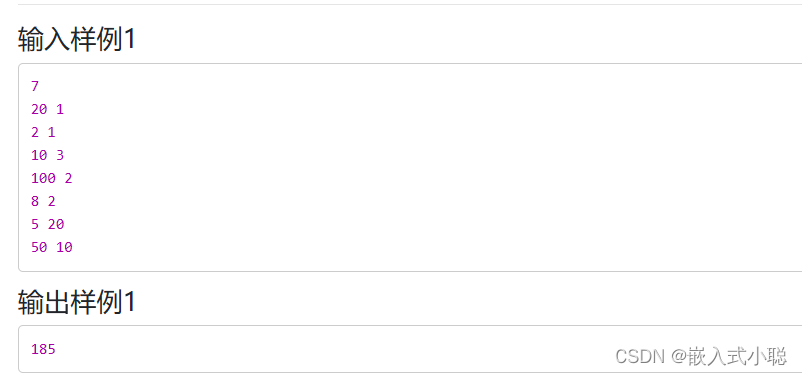

效果图:

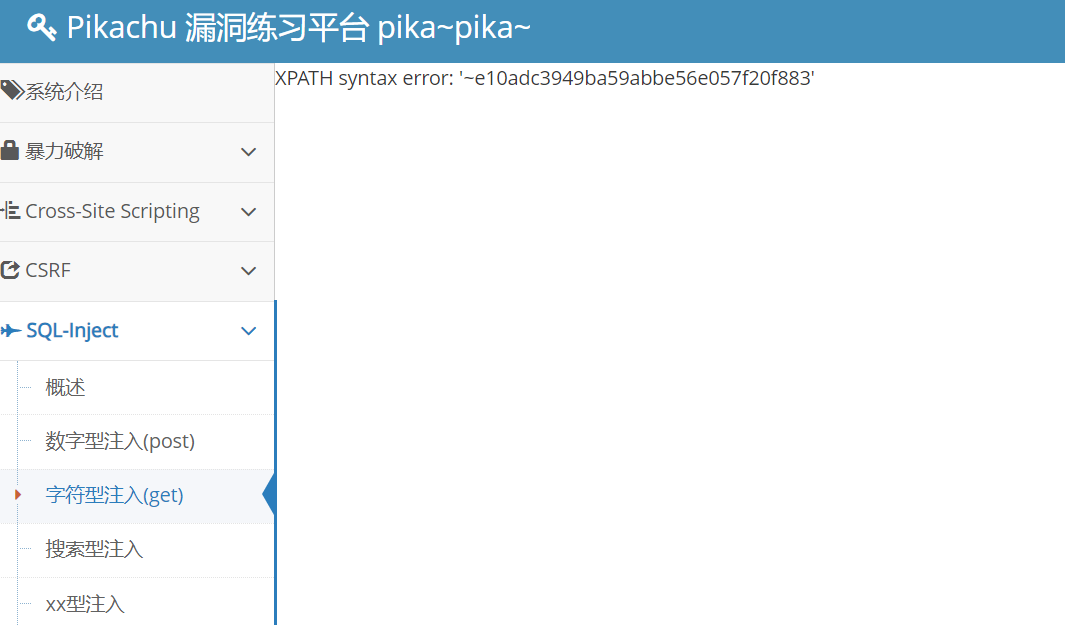

误差分析:

完整源代码和数据:LSTM-SelfAttention完整代码(https://mbd.pub/o/bread/ZpWVlJZp)