文章目录

- 论文介绍

- 问题描述

- 交待准备工作

- GAN模型

- 数据集

- 评价指标

- Photorealism

- Faithfulness

- Editability

- 论文方法

- 隐空间介绍

- Z空间

- W和W+空间

- S空间

- P空间

- 三种方法

- 1 基于学习的GAN Inversion

- 2 基于优化的GAN inversion

- 3 混合GAN inversion

- GAN inversion方法的特性

- 所支持的分辨率

论文介绍

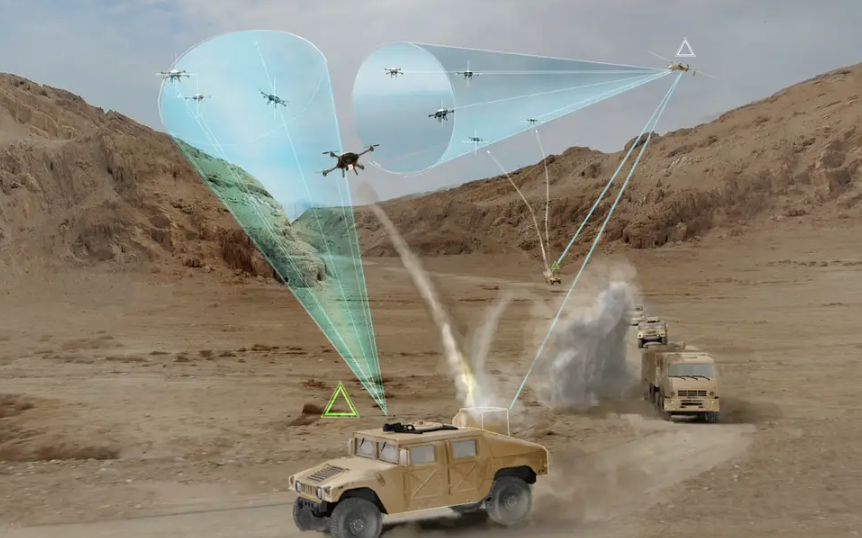

Gan逆映射操作的目的就是将图像逆映射到预训练Gan模型的潜在空间,之后图像可以由生成器从逆映射的代码中可信的重建,使得可以在现有训练的GAN的潜在空间的可控方向上进行图像编辑。具体流程见下图,我们将真实图像逆映射到潜空间后,可以沿着一个特定方向改变代码来编辑图像属性。

最后作者提及了给定图像获得的潜在隐空间应该具有的特性:可信逼真的重建图像以及促进下游任务,这也是GAN逆映射的目标。

问题描述

Gan的生成器表达式为G:Z->X,当z1和z2在z空间无限接近时,那么生成的x1和x2也会很相似,那么我们可以利用这一点,将x逆映射回潜表示z*,之后放入生成器得到一个图像x*,保持接近真实的图像x。具体任务如下:(其中x是真实图像,z是隐空间向量,l是特征空间或者图像的距离度量函数,改变z*可以进一步获取经过处理的图像)

z

∗

=

a

r

g

min

z

l

(

G

(

z

)

,

x

)

z* = arg\min_{z} l(G(z),x)

z∗=argzminl(G(z),x)

作者在下文介绍了很多逆映射gan的模型以及方法,为了评估不同方法的性能,主要考虑两方面:重建图像的真实感(感知质量)和可信性(逆映射精度),其中第一个方面取决于如何求解公式,第二个方面取决于利用那些潜空间。

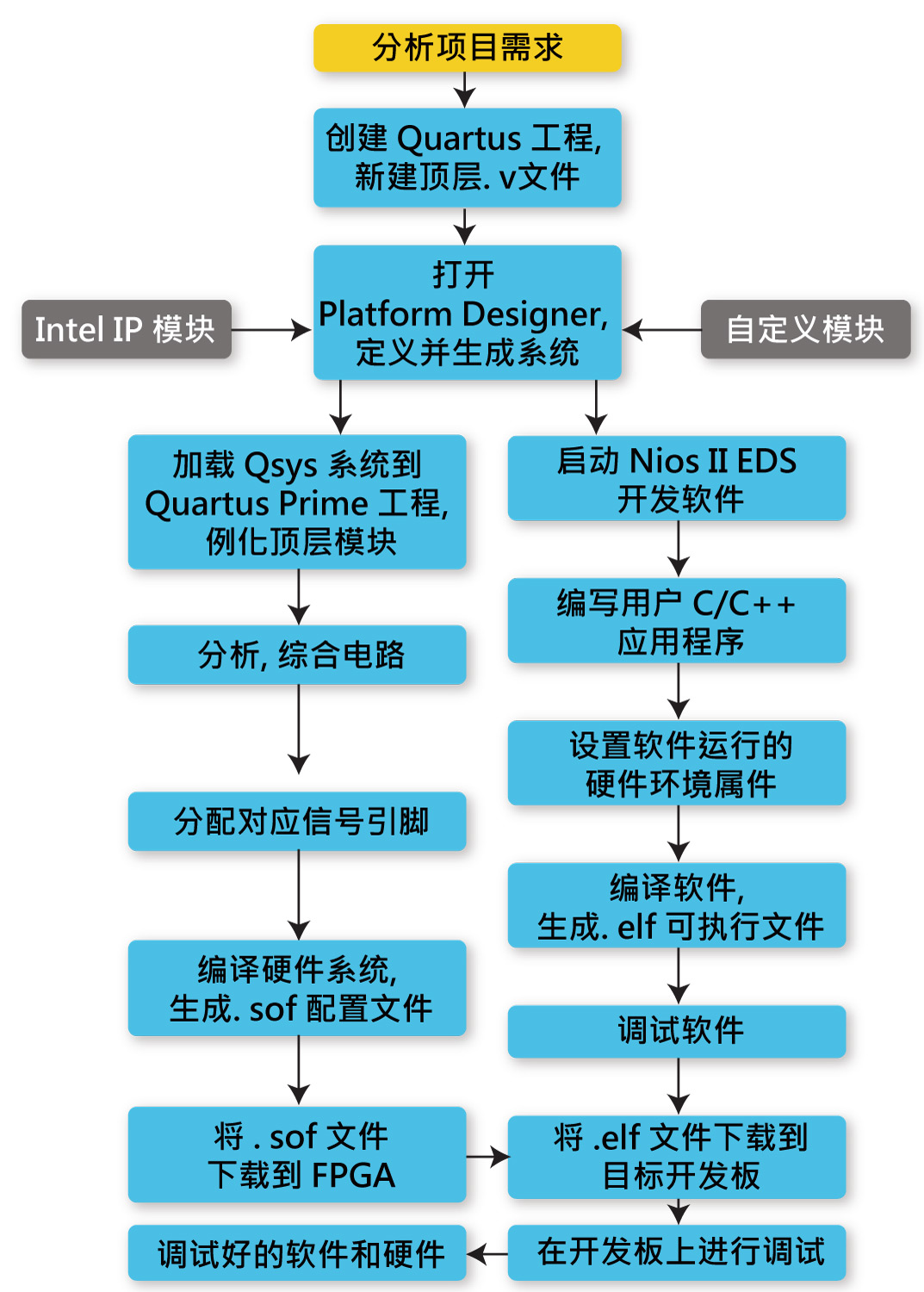

交待准备工作

GAN模型

1.DCGGAN 在鉴别器使用了卷积,在生成器中使用了分步卷积。

2 WGAN 将生成的数据分布与真实数据之间的Wasserstein距离最小化,这样就可以提供更多的模型稳定性,使得训练更容易。

3 BigGAN 生成高质量图像,通过对缩放、正交正则化进行修改,来提高大规模GAN的可伸缩性稳定性和鲁棒性。

4 PGGAN 也被称为proGAN和渐进式GAN,在训练中使用了增长策略,从生成器和鉴别器的低分辨率开始,然后逐渐添加新层,对越来越细粒度的细节进行建模,该方法提高了训练速度和稳定性。

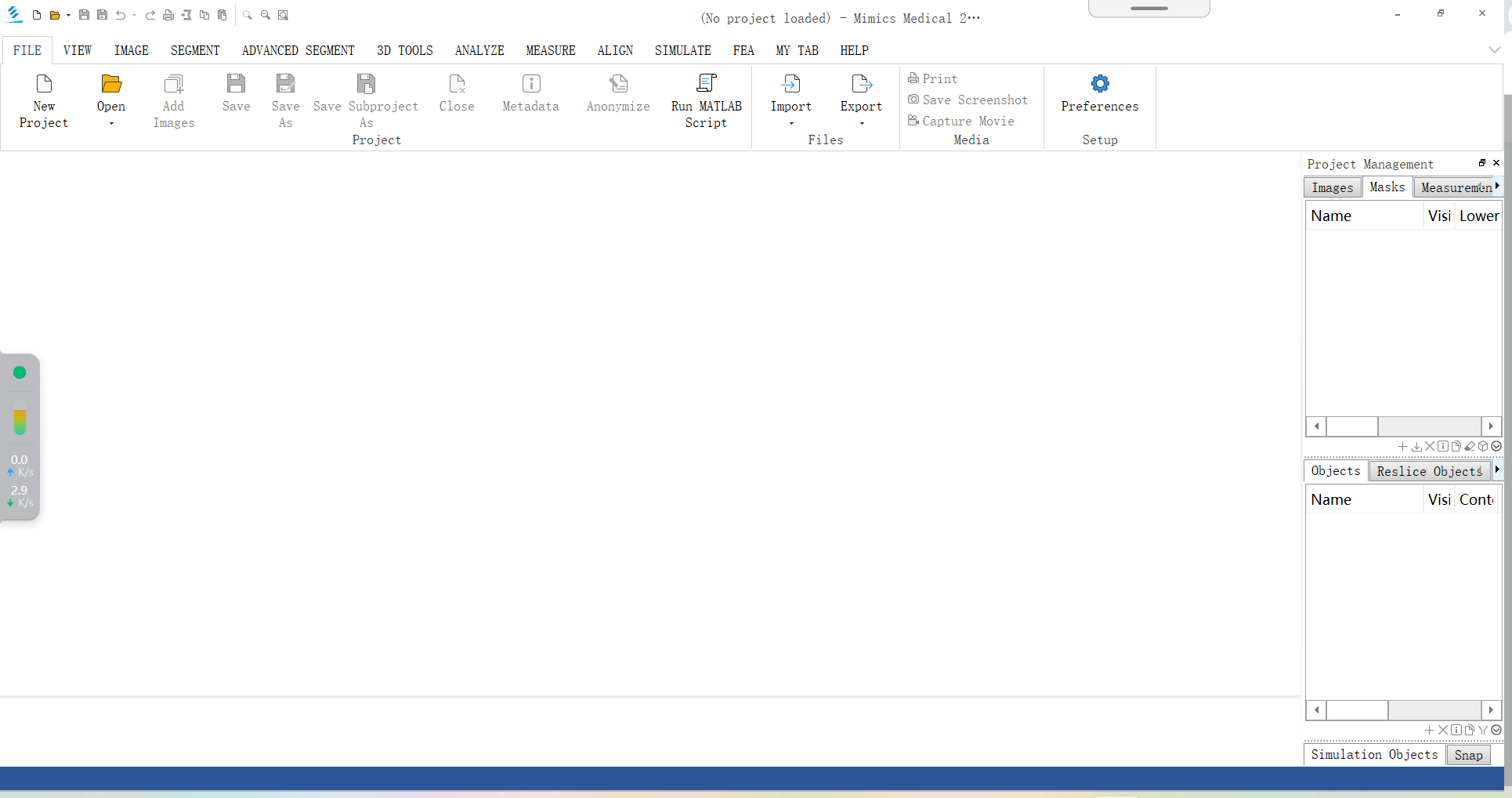

5 styleGAN 隐式的学习用于图像生成的潜在风格。该模型操作每通道的均值和方差来控制图像风格,如下图所示,风格生成器将风格特征(由映射网络f定义)和随机噪声作为图像合成的输入。styleGAN2模型通过提出权重解调,路径长度正则化,生成器重设置和去除渐进增长,进一步提高了感知质量。styleGAN2-Ada提出了自适应鉴别器增强机制,可以以稳定的有限数据进行训练。styleGAN3观察到了GAN中存在的纹理粘连问题,通过在连续域中考虑混叠效应对结果进行适当的低通滤波,更适合于动画和视频。

对上图部分解释:z空间通过f映射到w空间,再输入生成网络得到生成图像x

(其中w空间就是z空间上建立的隐空间,在继承z空间功能的情况下获得更好的解耦能力,其中解耦能力简单说就是仅改变一个方向上的隐码,就可以改变面部的部分属性,而其他的整体属性不会被影响)

数据集

1 ImageNet 是一个用于视觉对象识别研究的大规模手工注释数据集,包含超过1400万幅图像,超过2万个类别。

2 CelebA 一个大规模的人脸属性数据集,由200k张名人图像组成,每个图像有40个属性注释。

3 Flickr-Faces-HQ (FFHQ) 是一个从Flickr中抓取的高质量人脸图像数据集,由70,000张1024×1024像素的高质量人脸图像组成,包含了相当大的年龄、种族和图像背景差异。

4 LSUN 包含10个场景类别(例如,卧室、教堂或塔楼)和20个对象类别(例如,鸟、猫或公共汽车)中每一个的大约100万个标记图像。 GAN反演方法中常用的是教堂和卧室场景图像以及汽车和鸟类物体图像。 一些GAN反演研究也在实验中使用其他数据集,如DeepFashion、AnimeFaces和Streetscapes。

评价指标

对GAN反演方法的评价有不同的维度,如photorealism, faithfulness of 生成图像、逆映射潜码的editability等。

Photorealism

1 Inception score (IS) 一个被广泛用于测量从GaN模型生成的图像的质量和多样性的度量。 它使用在ImageNet上预先训练的Inception-V3网络计算合成图像的统计量。 分数越高越好。

2 Fr´echet inception distance (FID) 由基于inception-v3 pool3层的真实图像和生成图像的特征向量之间的frechet距离定义的。较低的FID表示较好的知觉质量。

3 Learned perceptual image patch similarity (LPIPS) 使用在ImageNet上预先训练的VGG模型测量图像感知质量。 较低的值意味着图像补丁之间的相似度较高。

Faithfulness

Faithfulness衡量真实图像与生成图像之间的相似性。 它可以通过图像的相似度来近似。 最广泛使用的指标是PSNR和SSIM。 一些方法使用像素重建距离,如平均绝对误差(MAE)、均方误差(MSE)或均方根误差(RMSE)。

1 Peak signal-to-noise ratio (PSNR) 是衡量重建质量应用最广泛的标准之一。 真值图像与重建图像之间的PSNR由图像的最大可能像素值和图像间的均方误差定义。

2 Structural similarity (SSIM) 基于亮度、对比度和结构方面的独立比较,测量图像之间的结构相似性。

Editability

这个主要度量反向潜在码相对于生成器的输出图像的某些属性的可编辑灵活性。现有的方法就是使用余弦或者欧氏距离或分类精度来评估输入x和输出x之间的属性。

论文方法

作者在下文主要介绍了GAN模型的不同2隐空间以及有代表性的逆映射方法。除了用于一般GAN的Z空间之外,还专门为StyleGAN设计了几个潜在空间,包括W、W+、S和P空间。

隐空间介绍

无论哪种gan逆映射的方法都包含一个重要步骤:将图像嵌入到哪个潜在空间。好的隐空间应该具备以下性质:易于解耦,好嵌入,可以忠实的逼近真实图像以及方便下游任务去编辑图像。

Z空间

GAN中的生成器学习将简单分布的值映射到生成的图像。这些直接从分布中采样的值一般叫做潜在代码或者潜在表示(用z表示),Z空间适用于所有无条件GaN模型,如DCGAN,PGGAN,BigGAN,Stylegans。 然而,Z空间服从正态分布的约束限制了它对语义属性的表示能力和解耦性。

W和W+空间

这是StyleGAN采用的隐空间,具有更高的自由度和解耦能力,因此肯定比z空间有更好的表达能力。styleGAN中是通过8个mlp实现的非线性网络映射将z转换为风格向量w。然而W空间也有缺陷,就是限制了能够忠诚表达重建图像的范围,因此出现了W+空间,在W+空间中,不同的隐向量W通过AdaIN被输入到生成器的每一层,这种将图像逆映射到W+空间的方法以牺牲可编辑性为代价减轻了失真。

S空间

风格空间S通过生成器的每一层使用不同的学习仿射变换,从w开始变换,s空间是为了在语义层面之外的空间维度上实现更好的解耦能力。空间耦合主要由于基于风格生成器的固有复杂性和AdaIN归一化的空间不变性引起的,现在有人使用编码器学习的解耦多级视觉替换原始风格code,这些风格参数所跨越的空间称为y空间,实际上也是S空间的一种类型,通过直接插入风格code s,基于S空间的方法,实现了对局部翻译的细粒度控制。

P空间

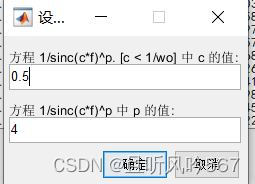

p = leaklyrelu5.0(w) Z->W->p->x 优点是这种变换将分布归一化,也就导致p空间所有方向都是各向同性的。

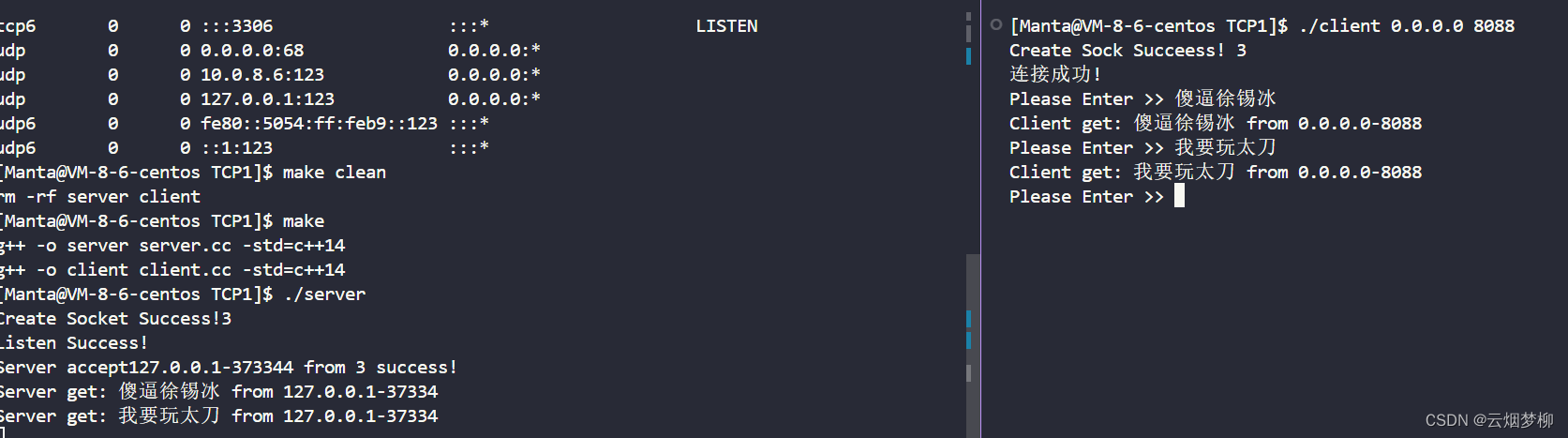

三种方法

图像中蓝色块表示可训练或迭代模块,红色虚线箭头表示监督。

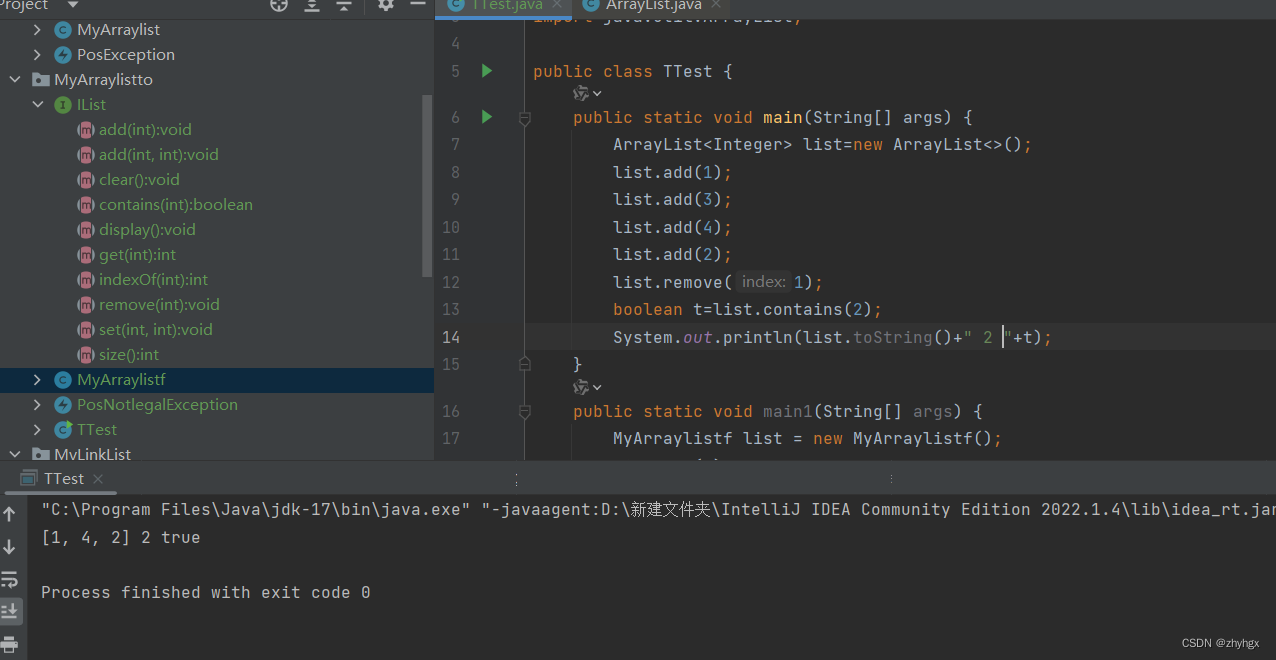

1 基于学习的GAN Inversion

基于学习的反演方法旨在学习编码器网络以将图像映射到潜在空间中,使得基于潜在代码的重建图像看起来尽可能类似于原始图像。这里的基于学习的GAN inversion主要涉及到训练编码器E(x;θE)来将图像x映射到潜在空间z中,注意在训练时解码器G的参数冻结。

θ

E

∗

=

a

r

g

min

θ

E

∑

n

L

(

G

(

E

(

x

n

;

θ

E

)

)

,

x

n

)

\theta _{E}^{*} = arg\min_{\theta_{E}} \sum_{n}^{} L(G(E(x_{n};\theta _{E})),x_{n})

θE∗=argθEminn∑L(G(E(xn;θE)),xn)

Perarnau等人提出了这种种早期的基于学习的GAN反演方法,真实图像x由潜在空间的z和属性向量y来编码,通过改变y来合成x,该方法包括了Ez以及Ey,为了训练Ez,该方法使用生成器来创建x和z的数据集,并且通过最小化z和Ez(G(z,y))之间的均方损失,并且通过使用

∥

y

−

E

y

(

x

)

∥

2

2

\left \| y-E_{y}(x) \right \| _{2}^{2}

∥y−Ey(x)∥22作为目标函数来训练提高Ey,Ey最初使用生成的图像x和其他信息y来训练。

由于现在styleGAN的流行,很多人提出了基于学习的styleGAN优化,Richardson提出了MAP2Style模块从相应的特征图去学习风格,其中18个潜在码被单独预测;Wei等人提出了有效的头,它由平均池化和全连接层组成,给定由FPN获得的三个不同语义级别的特征,这三个头分别从浅、中和深特征产生w15、…、w18、w10、…、w14和w1、…、w9;后面Tov分析了styleGAN潜在空间失真,感知质量和可编辑性之间的权衡;为了提高逆映射精度,Alaluf et al为编码器引入了细化迭代机制:在第t步,编码器对通过将给定图像x和预测图象进行级联获得的扩展输入进行操作,而不是前向传递直接进行预测潜在码,更细点说,∆t = E(x, yt),其中yt = G(wt),之后步骤t+1处的潜在码设置为wt+1 = Δ t +wt,w0和y0的初始值分别被设置为平均潜在码以及对应的图像。

总之所有GAN inversion的目标都是确定训练GAN模型的潜在空间。

2 基于优化的GAN inversion

基于优化的反演方法通过反向传播直接求解目标函数,以找到使逐像素重建损失最小化的潜在代码。现有的基于优化的GAN inversion方法基本都是通过优化隐向量来重建目标图像:

z

∗

=

a

r

g

min

z

l

(

x

,

G

(

z

;

θ

)

)

z^{*} = arg\min_{z} l(x,G(z;\theta ))

z∗=argzminl(x,G(z;θ))

其中选择优化器至关重要,好的优化器可以缓解局部极小值问题,有两种类型优化器:基于梯度的方法(ADAM,LBFGS等等)和无梯度的方法(CMA),其中不同GAN反演方法选择不同的优化器。

另一个重要的问题是潜在code的初始化。由于GAN inversion公式是非凸的,所以重建质量强烈依赖于z的良好初始化(在styleGAN是w),实验表明,不同初始值导致生成的图像显著感知差异,直观的几个解决方式是从几个随即初始值开始,以最小的成本获得最佳结果。StyleGAN研究了两种初始化选择,一种基于随机选择,另一种基于平均潜在码w。注意,基于优化的方法,通常需要内存和允许两方面钢轨的迭代过程,因此他们必须独立于的应用于每个潜在码。

3 混合GAN inversion

混合方法首先使用编码器来生成初始潜在代码,然后用优化算法对其进行细化。如虚线E所示,E中包含了经过良好训练的编码器,作为优化的正则化器。(d图)

GAN inversion方法的特性

这节作者讨论了GAN inversion方法的重要特性:支持的分辨率,语义感知,逐层处理和超出分布的泛化能力

所支持的分辨率

GAN inversion所支持的图像分辨率主要取决于生成单元的容量和选区的反演机制。