ChatGPT

GPT-3是OpenAI开发的一个自然语言处理(NLP)预训练模型。GPT代表“生成式预训练变换器”(Generative Pretrained Transformer)。GPT-3是GPT系列的第三代模型,是一种采用了深度学习技术的强大语言模型,这项技术被设计来理解和生成类似人类的文字。

以下是关于GPT-3的一些关键特点:

1. 规模:

GPT-3是迄今为止最大的语言模型之一,拥有1750亿个参数。参数多意味着模型可以学习和存储更多的语言知识,这不仅包括词汇、语法和句型,还包括细致的语境和概念。

2. 无监督学习:

GPT-3是在海量的文本数据中进行无监督学习的。换句话说,在训练期间,它只是尝试预测下一个词是什么,而不需要特别的标签或指导来告诉它什么是正确的。

3. 多样性应用:

GPT-3可用于各种应用,如文本生成、翻译、摘要、问答系统、对话系统等。它的输出常常和真人的写作难以区分。

4. API接入:

OpenAI提供了GPT-3的API,允许开发者将这一语言模型的能力接入到各种应用程序中,不需要进行复杂的机器学习流程。

5. 少量调整(Few-shot Learning):

GPT-3在处理问题时不需要大量的训练样本。通过Few-shot Learning,它能通过看到少数几个例子就能理解任务,并尝试生成类似的输出。

6. 问题与争议:

尽管GPT-3有着惊人的生成能力和适应性,但它也面临着一些争议和技术挑战,如生成的偏置、不准确或有误导性的信息、以及环境成本(由于其巨大规模的计算需求)等问题。

由于其广泛的适用性,GPT-3常常被用来展示人工智能在自然语言处理领域的进步,也引起了关于AI未来的许多思考和讨论。

讯飞星火

GPT-3是OpenAI开发的一种自然语言处理(NLP)预训练模型,代表了当前最先进和规模最大的语言模型之一。

GPT-3的预训练过程采用了两阶段的策略:

- 无监督预训练:在无标注的大量文本数据上进行预训练,使用语言建模目标函数来学习网络的初始参数。这个过程的目的是让模型学会预测下一个单词的概率分布。

- 有监督微调:在具体的下游任务上,利用对应的监督目标函数对模型进行进一步的训练,以适应特定任务的需求。

GPT-3的特点包括:

- 大规模参数量:GPT-3的参数量达到了1750亿(175B),这是目前公开报道的最大规模的NLP模型之一。

- 庞大的训练数据:为了训练这样一个大规模的模型,需要大量的数据。GPT-3使用了约570GB的文本数据进行训练。

- 强大的生成能力:GPT-3具有强大的文本生成能力,能够执行广泛的语言任务,包括文本补全、翻译、问答等。

- 单向语言模型训练方式:GPT-3延续了单向语言模型的训练方式,这意味着它在生成文本时是基于之前出现的文本序列。

- 性能表现:得益于其巨大的模型规模和训练数据的广泛性,GPT-3展示了在多种语言任务上的良好性能。

总的来说,GPT-3的成功不仅在于其技术和规模上的突破,还在于它开启了超大规模预训练模型的研究和应用浪潮。这种模型的出现极大地推动了自然语言处理领域的发展,为未来的研究和应用提供了新的可能性。

文心一言

GPT-3是由OpenAI于2024年公布的一种NLP(自然语言处理)预训练模型,它是机器学习算法的新版本,设计用于自然语言处理任务。GPT-3是一个基于深度学习技术的生成式预训练模型,它通过收集大量的原始文本并使用深度神经网络模型进行建模,从而能够从这些文本中推断出有用的信息。

GPT-3的设计采用了新的预训练技术,即AutoML。通过对数百万份已标注文本的反复训练,GPT-3能够学习语言模型,并在各种NLP任务中展现出卓越的性能。GPT-3的应用领域十分广泛,包括文本生成、对话机器人、自动写作服务等。例如,它可以根据给定的训练文本,自动生成新的、高质量的文本内容。

在评估GPT-3的性能时,可以采用人工评估和自动评估两种方法。人工评估依赖于预设的标准对生成的文本进行评分,虽然直接和具体,但消耗时间和人力,且存在主观性和不一致性。自动评估方法则利用机器学习和自然语言处理技术,以自动化的方式对文本进行评估,具有高效、客观等优点,但可能无法完全反映文本的流畅性和逻辑性。

GPT-3的核心思想是使用无监督的预训练模型做有监督的任务。作者认为,当语言模型的容量足够大时,它可以覆盖所有的有监督任务。GPT-3通过Masked multi-head attention提取文本信息,并利用MLP和softmax预测当前序列后应该接什么字符,从而生成长的文本。

在实际应用中,GPT-3在很多任务上取得了良好的性能,包括翻译、问答、完型填空,以及一些需要动态推理或域适应的任务。此外,GPT-3甚至能够生成出让人难辨真假的新闻文章,显示出其强大的文本生成能力。

总的来说,GPT-3作为NLP预训练模型的重要突破,以其卓越的性能和广泛的应用领域,为自然语言处理领域的发展带来了新的可能。然而,随着技术的不断发展,我们也期待GPT-3在未来能够进一步优化和提升,以更好地服务于各种实际场景和需求。

Kimi

GPT-3(Generative Pre-trained Transformer 3)是由OpenAI开发的第三代生成式预训练变换器模型。作为目前最大的语言处理模型之一,GPT-3以其强大的语言理解和生成能力而闻名,能够执行各种自然语言处理(NLP)任务,如文本生成、翻译、问答和摘要等。

架构和训练

GPT-3建立在Transformer架构之上,这是一种依赖于自注意力机制的深度学习模型,能够处理长距离依赖关系的数据序列。与之前的版本GPT-2相比,GPT-3拥有更多的参数,据估计大约有1750亿个。这使得GPT-3在理解和生成语言方面更加精准和流畅。

GPT-3通过无监督学习的方式进行预训练。它在大规模的文本数据集上进行训练,这些数据覆盖了互联网上的多种语言和广泛的主题。预训练的目标是让模型学会预测文本序列中的下一个单词,从而理解语言的结构和语义。

应用

GPT-3因其强大的性能和灵活性,在多个领域都有广泛的应用:

- 文本生成:GPT-3可以生成连贯、多样化的文本,用于创作文章、诗歌、故事等。

- 问答系统:模型能够理解问题并生成准确的答案,适用于构建智能问答系统。

- 语言翻译:GPT-3能够进行多语言翻译,虽然不是专门为翻译任务设计,但其性能仍然令人印象深刻。

- 文本摘要:模型可以提取长篇文章的关键信息,生成简洁的摘要。

- 代码生成:GPT-3能够理解编程语言,并生成代码片段或整段代码。

- 教育和学习:GPT-3可以辅助语言学习,提供个性化的学习材料和练习。

挑战和限制

尽管GPT-3在多个方面表现出色,但它也面临着一些挑战和限制:

- 偏见和不准确性:由于训练数据的偏差,GPT-3可能会生成有偏见或不准确的内容。

- 计算成本:GPT-3的运行需要大量的计算资源,这限制了其在资源受限的环境中的应用。

- 可解释性:作为一个深度学习模型,GPT-3的决策过程缺乏透明度,这在某些应用场景中可能是一个问题。

- 道德和法律问题:GPT-3生成的内容可能涉及版权、隐私和伦理问题,需要谨慎处理。

未来展望

GPT-3的成功预示着NLP领域将继续朝着更大、更复杂的模型发展。未来的研究可能会集中在提高模型的可解释性、减少计算成本、以及更好地理解和管理模型潜在的偏见和道德风险上。随着技术的不断进步,我们可以期待更加智能和可靠的NLP工具来辅助人类的语言交流和信息处理。

通义灵码

GPT-3(Generative Pre-trained Transformer 3)是由美国人工智能研究实验室OpenAI于2020年推出的大型自然语言处理(NLP)预训练模型。作为GPT系列的最新版本,GPT-3以其巨大的规模、强大的语言理解和生成能力以及广泛的应用潜力,在学术界和工业界引起了广泛关注。以下是关于GPT-3的详细介绍:

-

模型架构与规模:

- GPT-3基于Transformer架构,这是一种自回归式神经网络模型,最初由Google在2017年提出,专为处理序列数据(如文本)而设计。Transformer通过自我注意力机制捕获输入序列中长距离依赖关系,实现高效并行计算。

- 规模:GPT-3是当时最大规模的预训练语言模型之一,拥有约1750亿个参数。其参数数量远超前代模型(如GPT-2的1.5亿参数),这使得GPT-3能够学习到更复杂的语言结构和丰富的世界知识。

-

预训练任务与数据:

- 无监督预训练:GPT-3采用无监督学习方式进行预训练,即在大规模未标注文本数据上进行自回归语言建模。具体来说,模型被训练来预测给定文本序列中下一个单词的概率分布,从而学会捕捉语言的统计规律和上下文依赖。

- 训练数据:GPT-3使用的训练数据集极为庞大,包括Common Crawl、WebText2、Books1、Books2等多个来源的文本,涵盖各种主题、风格和语种。总体数据量超过4000亿个词,确保模型具有广泛的知识覆盖和语言理解能力。

-

零样本学习与微调:

- 零样本学习:GPT-3的一大亮点是其出色的零样本学习(Zero-Shot Learning)能力。这意味着无需针对特定任务进行额外训练或微调,只需通过调整输入提示(prompt)的方式,即可让模型执行多种NLP任务,如问答、翻译、文本摘要、代码生成等。这种能力源于其庞大的规模和丰富的预训练知识,使得模型能够在无特定任务训练的情况下理解并响应复杂指令。

- 微调:尽管GPT-3在零样本设置下表现出色,但对于某些任务或需要更高精度的场景,仍然可以通过微调(Fine-tuning)进一步提升性能。微调是指在预训练模型的基础上,使用特定任务的数据对其进行有监督学习,调整部分或全部模型参数以适应新任务。

-

技术挑战与应对:

- 训练效率与成本:由于GPT-3的巨大规模,其训练过程对计算资源需求极高,涉及巨大的计算量、内存消耗和能源消耗。OpenAI采用了分布式训练、混合精度计算等技术手段,以及强大的硬件基础设施来应对这些挑战。

- 过拟合与泛化:为了避免过拟合,GPT-3在训练过程中采用了多种正则化技术,如权重衰减、层归一化、截断式自回归(Truncated Backpropagation Through Time, BPTT)等,以保持模型的良好泛化能力。

-

应用与影响:

- GPT-3的发布推动了NLP领域对大规模预训练模型的研究热潮,引发了对模型可解释性、公平性、伦理问题以及大模型潜在风险的深入探讨。

- 在实际应用中,GPT-3已被广泛应用于文本生成、对话系统、内容创作、编程辅助、搜索引擎增强、自动文档摘要等多种场景,展现出强大的通用性和灵活性。

总结而言,GPT-3是一款具有里程碑意义的大型预训练语言模型,其创新之处在于通过前所未有的模型规模、先进的Transformer架构以及高效的无监督预训练方法,实现了卓越的零样本学习能力和广泛的应用潜力,对自然语言处理领域产生了深远影响。

很抱歉,目前GPT-3作为OpenAI的模型,并没有直接适用于Radeon GPU或MIGraphX的官方实现版本。MIGraphX主要用于优化和执行机器学习模型,特别是针对AMD的GPU。

不过,如果您要在支持Radeon GPU的机器上使用预训练的NLP模型(类似GPT-3),您可以使用支持ONNX模型的机器学习库,如ONNX Runtime,并尝试将模型转换为ONNX格式,有可能利用MIGraphX的一些优化。然而,请注意GPT-3由于许可和技术限制,并不公开可用,所以这个案例指向的是类似GPT-3的模型,而不是GPT-3本身。

下面是使用MIGraphX运行ONNX模型的大致步骤,这里假设您已经拥有或者可以获取一个转换为ONNX格式的NLP模型,例如GPT-2的简化版本。

1. 安装MIGraphX:

请遵循[安装MIGraphX](https://rocm.github.io/migraphx/install.html)的指南来在您的系统上安装MIGraphX及其依赖项。

2. 准备ONNX模型:

确保您有一个预训练的ONNX模型文件。以下代码将使用这个文件来进行模型预测。

3. 编写Python程序:

您可以用以下样例代码作为起点,这个代码加载一个ONNX模型文件并使用MIGraphX进行预测。由于模型和实际应用可能有所不同,请根据您的具体情况调整输入输出处理。

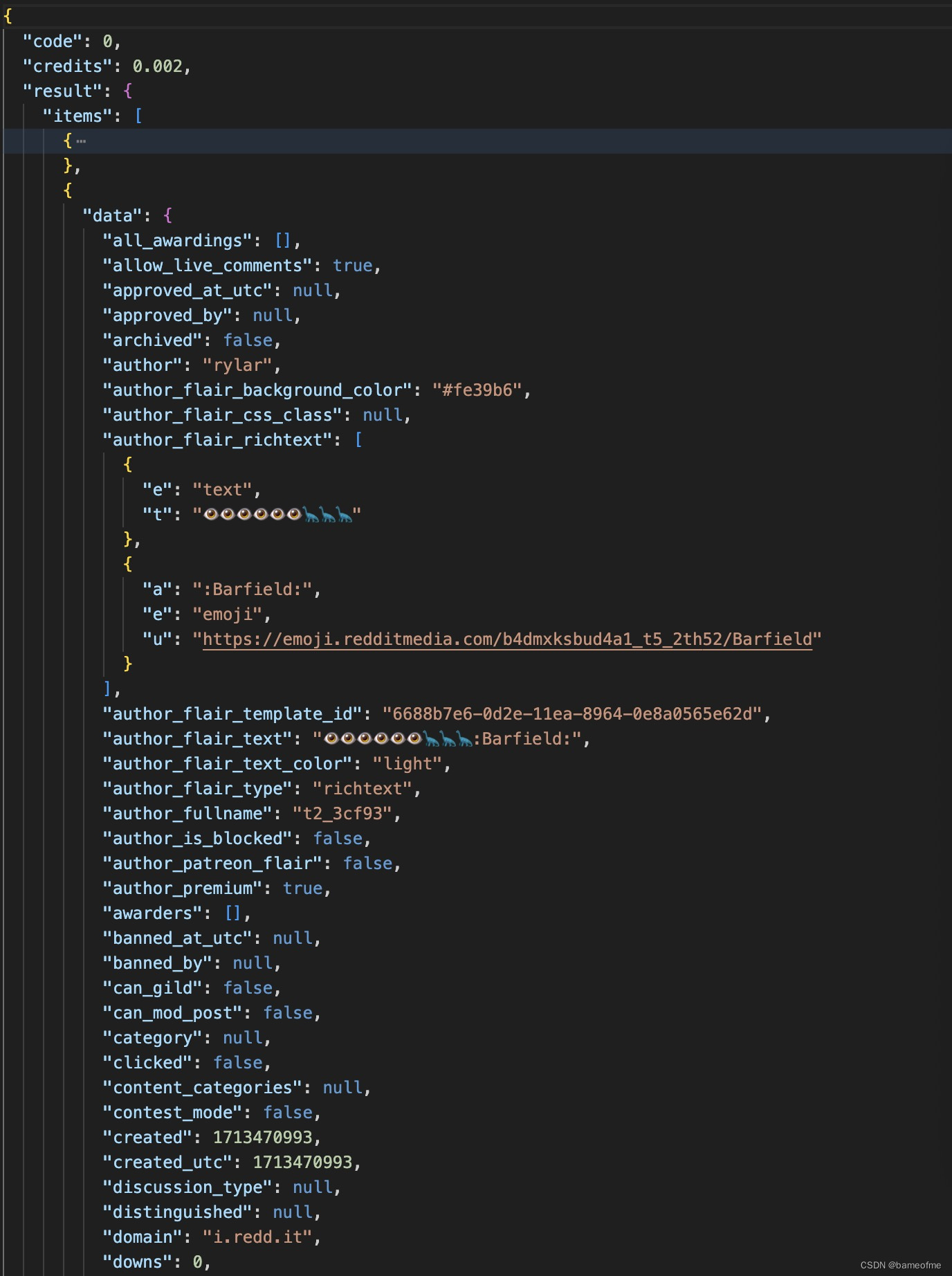

import numpy as np

import migraphx

# 模型路径

onnx_model_path = "您的ONNX模型文件路径.onnx"

# 加载模型

model = migraphx.parse_onnx(onnx_model_path)

# 将模型编译在GPU上

model.compile(migraphx.get_target("gpu"))

# 准备输入数据, 假设模型需要一个名为'input_ids'的输入

input_data = {"input_ids": np.random.randint(1000, size=(1, 128)).astype(np.float32)}

# 输入数据需要转换为MIGraphX的参数格式

params = {}

for name, param in input_data.items():

params[name] = migraphx.argument(param)

# 运行模型

result = model.run(params)

# 输出结果处理

prediction = result[-1].to_numpy() # 假设模型输出是最后一个参数

print("模型输出(部分):", prediction[:10])请注意,以上代码是一个示例模板,您需要根据实际情况(如模型输入输出的实际结构和类型)对代码进行相应的修改。

如果您需要使用NLP特定模型,例如GPT-2或GPT-3的简化版本,并且希望在Radeon GPU上运行,请尝试找到或训练一个适合您需求的ONNX模型,并相应地在代码中调整输入输出处理。