特征工程

Filter

1)移除低方差特征

假设某特征的特征值只有0和1,并且在所有输入样本中,95%的实例的该特征取值都是1,那就可以认为这个特征作用不大。如果100%都是1,那这个特征就没意义了。当特征值都是离散型变量的时候这种方法才能用,如果是连续型变量,就需要将连续变量离散化之后才能用。而且实际当中,一般不太会有95%以上都取某个值的特征存在,所以这种方法虽然简单但是不太好用。可以把它作为特征选择的预处理,先去掉那些取值变化小的特征,然后再从接下来提到的的特征选择方法中选择合适的进行进一步的特征选择。

from sklearn.feature_selection import VarianceThreshold

X = [[0, 0, 1], [0, 1, 0], [1, 0, 0], [0, 1, 1], [0, 1, 0], [0, 1, 1]]

sel = VarianceThreshold(threshold=(.8 * (1 - .8)))

sel.fit_transform(X)2)单变量特征选择

单变量特征选择的原理是分别单独的计算每个变量的某个统计指标,根据该指标来判断哪些变量重要,剔除那些不重要的变量。

对于分类问题(y离散),可采用:

- 卡方检验

- f_classif

- mutual_info_classif

- 互信息

对于回归问题(y连续),可采用:

- 皮尔森相关系数

- f_regression,

- mutual_info_regression

- 最大信息系数

这种方法比较简单,易于运行,易于理解,通常对于理解数据有较好的效果(但对特征优化、提高泛化能力来说不一定有效)。

- SelectKBest 移除得分前 k 名以外的所有特征(取top k)

- SelectPercentile 移除得分在用户指定百分比以后的特征(取top k%)

- 对每个特征使用通用的单变量统计检验: 假正率(false positive rate) SelectFpr, 伪发现率(false discovery rate) SelectFdr, 或族系误差率 SelectFwe.

- GenericUnivariateSelect 可以设置不同的策略来进行单变量特征选择。同时不同的选择策略也能够使用超参数寻优,从而让我们找到最佳的单变量特征选择策略。

卡方(chi2)检验

经典卡方检验是定性自变量对定性因变量的相关性。

对样本进行一次chi2测试来选择最佳两项:

from sklearn.datasets import load_iris

from sklearn.feature_selection import SelectKBest

from sklearn.feature_selection import chi2

iris = load_iris()

X, y = iris.data, iris.target

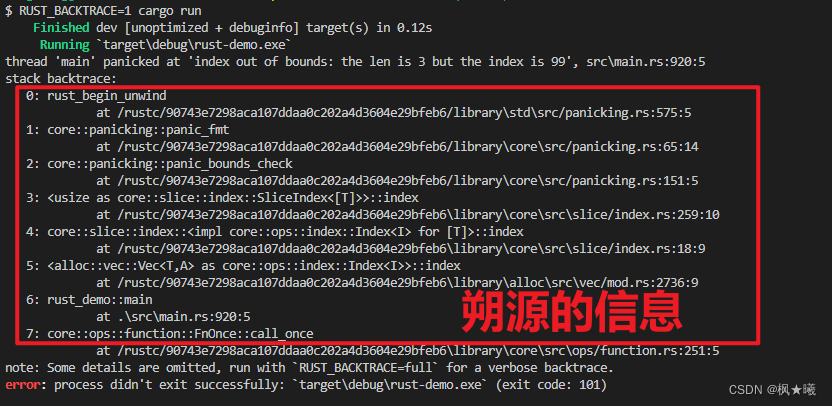

X.shapeout

![]()

X_new = SelectKBest(chi2, k=2).fit_transform(X, y)

X_new.shapeout

![]()

Peaeson相关系数

是一种最简单的,帮助理解特征与响应变量关系的方法,此方法衡量的是变量之间的相关性,结果的取值区间[-1,1],-1代表负相关,+1代表正相关,0代表无线性相关

import numpy as np

from scipy.stats import pearsonr

np.random.seed(0)

size = 300

x = np.random.normal(0, 1, size)

# pearsonr(x, y)的输入为特征矩阵和目标向量,能够同时计算 相关系数 和p-value.

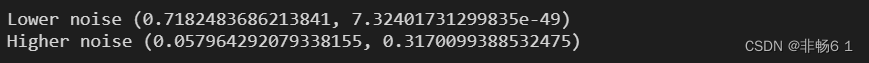

print("Lower noise", pearsonr(x, x + np.random.normal(0, 1, size)))

print("Higher noise", pearsonr(x, x + np.random.normal(0, 10, size)))

这个例子中,我们比较了变量在加入噪音之前和之后的差异。当噪音比较小的时候,相关性很强,p-value很低。我们使用Pearson相关系数主要是为了看特征之间的相关性,而不是和因变量之间的。

Wrapper递归特征消除

递归特征消除法是使用一个 基模型进行多轮训练,每轮训练后,移除若干权值系数的特征,再基于新的特征集进行下一轮训练。

对特征含有权重的预测模型(例如,线性模型对应参数coefficients),RFE通过递归减少考察的特征集规模来选择特征。首先,预测模型在原始特征上训练,每个特征指定一个权重。之后,那些拥有最小绝对值权重的特征被踢出特征集。如此往复递归,直至剩余的特征数量达到所需的特征数量。

RFECV 通过交叉验证的方式执行RFE,以此来选择最佳数量的特征:对于一个数量为d的feature的集合,他的所有的子集的个数是2的d次方减1(包含空集)。指定一个外部的学习算法,比如SVM之类的。通过该算法计算所有子集的validation error。选择error最小的那个子集作为所挑选的特征。

from sklearn.feature_selection import RFE

from sklearn.ensemble import RandomForestClassifier

from sklearn.datasets import load_iris

rf = RandomForestClassifier()

iris=load_iris()

X,y=iris.data,iris.target

rfe = RFE(estimator=rf, n_features_to_select=3)

X_rfe = rfe.fit_transform(X,y)

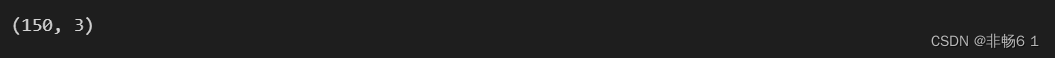

X_rfe.shape

X_rfe[:5,:]

#### Embedded

使用SelectFromModel选择特征 (Feature selection using SelectFromModel)#### 基于L1的特征选择 (L1-based feature selection)

使用L1范数作为惩罚项的线性模型(Linear models)会得到稀疏解:大部分特征对应的系数为0。当你希望减少特征的维度以用于其它分类器时,可以通过 feature_selection.SelectFromModel 来选择不为0的系数。

特别指出,常用于此目的的稀疏预测模型有 linear_model.Lasso(回归), linear_model.LogisticRegression 和 svm.LinearSVC(分类)

from sklearn.feature_selection import SelectFromModel

from sklearn.svm import LinearSVC

lsvc = LinearSVC(C=0.01, penalty="l1", dual=False).fit(X,y)

model = SelectFromModel(lsvc, prefit=True)

X_embed = model.transform(X)

X_embed.shape

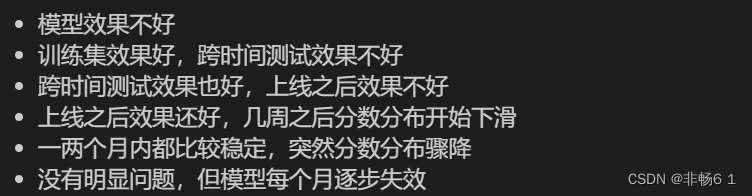

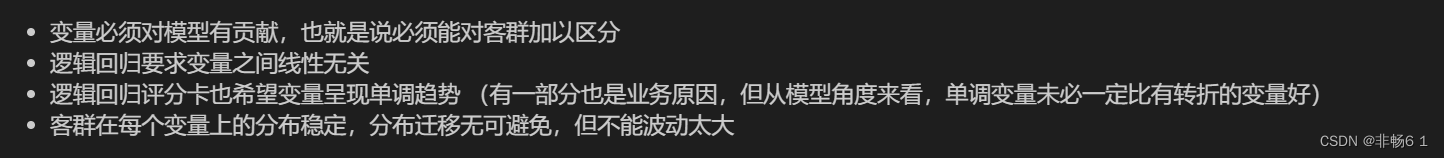

模型再业务中会遇到的问题

业务所需变量

最贴合使用场景的几种方法

最贴合使用场景的几种方法

import pandas as pd

import numpy as np

df_train = pd.read_csv('train.csv')

df_train.head()

a = 0.4

b = 0.6

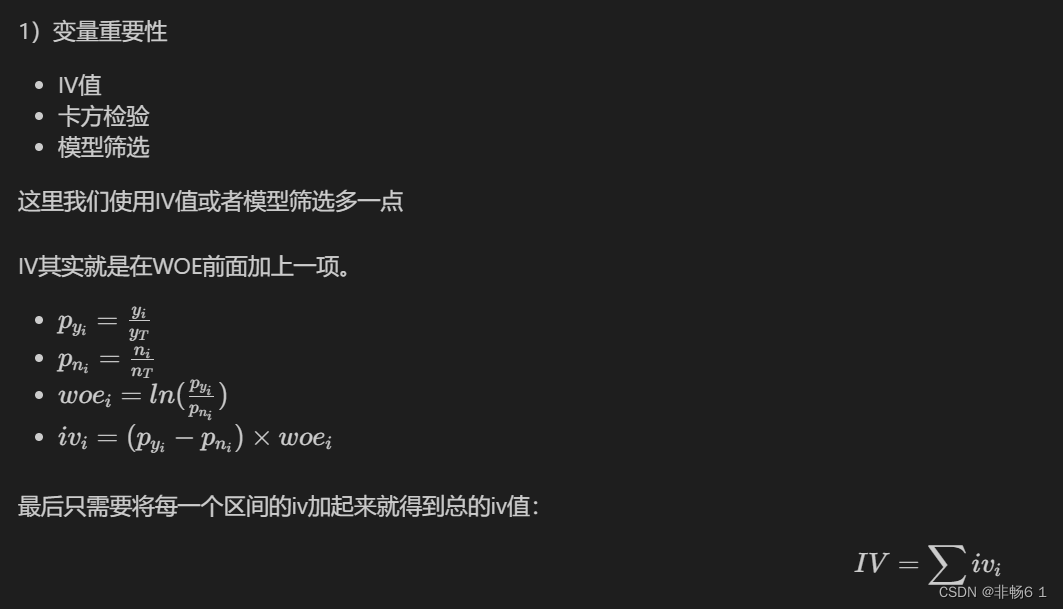

iv = (a - b) * math.log(a / b)分箱 WOE iV

import numpy as np

import pandas as pd

from scipy import stats

def mono_bin(Y,X,n=20):

r=0

good = Y.sum()

bad = Y.count()-good

while np.abs(r)< 1:

d1=pd.DataFrame({"X":X,"Y":Y,"Bucket":pd.qcut(X,n)})

d2=d1.groupby('Bucket',as_index=True)

r,p=stats.spearmanr(d2.mean().X,d2.mean().Y)

n=n-1

d3=pd.DataFrame(d2.X.min(),columns=['min'])

d3['min']=d2.min().X

d3['max']=d2.max().X

d3['sum']=d2.sum().Y

d3['total']=d2.count().Y

d3['rate']=d2.mean().Y

d3['woe']=np.log((d3['rate']/(1-d3['rate']))/(good/bad))

d3['iv']=(d3['rate']/(1-d3['rate']) - (good/bad)) * np.log((d3['rate']/(1-d3['rate']))/(good/bad))

d4=(d3.sort_index(by='min')).reset_index(drop=True)

print("="*60)

print(d4)

return d4集成模型的输出特征

#lightGBM中的特征重要性

feature = pd.DataFrame(

{'name' : model.booster_.feature_name(),

'importance' : model.feature_importances_

}).sort_values(by = ['importance'],ascending = False)

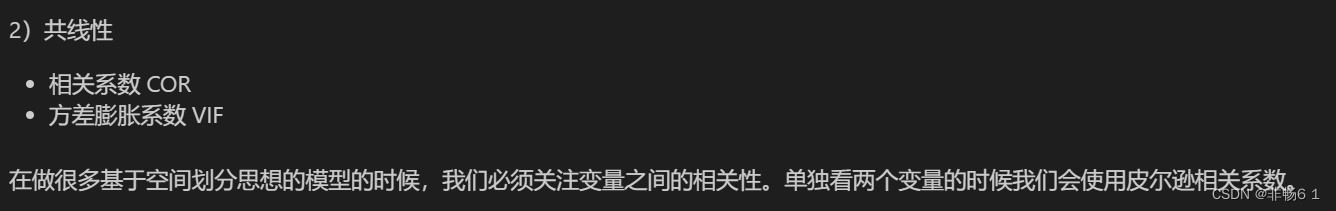

df_train.corr()

import seaborn as sns

sns.set(color_codes=True)

np.random.seed(sum(map(ord, "distributions")))

sns.pairplot(df_train)#对角线上是单维度分布

VIF

from statsmodels.stats.outliers_influence import variance_inflation_factor

import numpy as np

data = [[1,2,3,4,5],

[2,4,6,8,9],

[1,1,1,1,1],

[2,4,6,4,7]]

X = np.array(data).T

variance_inflation_factor(X,0)bivar图

# 等频切分

df_train.loc[:,'fare_qcut'] = pd.qcut(df_train['Fare'], 10)

df_train.head()

df_train = df_train.sort_values('Fare')

alist = list(set(df_train['fare_qcut']))

badrate = {}

for x in alist:

a = df_train[df_train.fare_qcut == x]

bad = a[a.label == 1]['label'].count()

good = a[a.label == 0]['label'].count()

badrate[x] = bad/(bad+good)

f = zip(badrate.keys(),badrate.values())

f = sorted(f,key = lambda x : x[1],reverse = True )

badrate = pd.DataFrame(f)

badrate.columns = pd.Series(['cut','badrate'])

badrate = badrate.sort_values('cut')

print(badrate)

badrate.plot('cut','badrate')群体稳定性指标PSI

def var_PSI(dev_data, val_data):

dev_cnt, val_cnt = sum(dev_data), sum(val_data)

if dev_cnt * val_cnt == 0:

return None

PSI = 0

for i in range(len(dev_data)):

dev_ratio = dev_data[i] / dev_cnt

val_ratio = val_data[i] / val_cnt + 1e-10

psi = (dev_ratio - val_ratio) * math.log(dev_ratio/val_ratio)

PSI += psi

return PSI