引言

在人工智能和自然语言处理领域,预训练语言模型的发展一直在引领着前沿科技的进步。Meta AI(前身为Facebook)在2023年2月推出的LLaMA(Large Language Model Meta AI)模型引起了广泛关注。LLaMA模型以其独特的架构设计和对Transformer模型的有效改进,展示出在各种自然语言任务上的卓越性能。本文将简单介绍LLaMA模型的架构特性,并说明其相比传统Transformer模型所做出的关键改进。

一. LLaMA模型简介

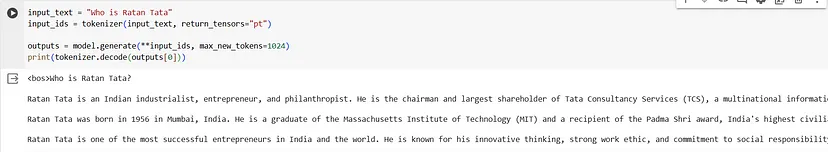

LLaMA模型代表了一种先进的人工智能技术,能够在自然语言处理(NLP)任务上表现出卓越的能力,如文本生成、问答、对话交互、机器翻译以及其他基于语言的理解和生成任务。

LLaMA模型家族的特点在于包含了不同参数规模的多个模型版本,参数量从70亿(7B)至650亿(65B)不等。这些模型设计时借鉴了Chinchilla模型的研究成果,注重在有限的训练数据和计算资源条件下实现最佳性能表现。值得注意的是,虽然LLaMA模型在参数量上可能小于某些其他顶尖模型,但在实际应用中展现了极高的效率和性能,例如,130亿参数的LLaMA模型在很多基准测试上的性能可与OpenAI的GPT-3相媲美,而更大规模的650亿参数模型甚至超越了Google的PaLM模型的部分性能。

LLaMA模型的一个重要贡献是证明了仅使用公开可用的数据集也可以训练出最前沿的自然语言处理模型,从而降低了研究者获取和利用高质量语言模型的门槛,促进了相关研究领域的开放性和可访问性。此外,LLaMA的源代码和模型已经开源,允许研究者和开发者在本地环境(包括个人电脑如MacBook)上运行和微调这些模型,进一步推动了AI技术在更广泛社群中的应用和发展。

二、LLaMA模型架构概览

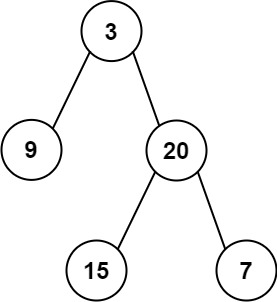

LLaMA模型本质上是一个基于Transformer Decoder结构的大规模语言模型家族,其核心组件包括自注意力层、前馈神经网络层以及多种创新性的优化技术。

2.1 Transformer Decoder结构

LLaMA模型摒弃了Transformer Encoder部分,专注于Decoder结构,使其更适合文本生成任务。Decoder层由一系列堆叠的Decoder Blocks构成,每个Block内部又包含多头自注意力机制(Multi-Head Self-Attention,MHSA)和前馈神经网络(Feed-Forward Network,FFN)两个主要组件。

这里仅展示下Decoder Block部分的代码:

(代码出自“大模型与ChatGPT系列专栏的”LLaMA的解读与其微调(含LLaMA 2):Alpaca-LoRA/Vicuna/BELLE/中文LLaMA/姜子牙一文,其中还有关于MSHA与FFN部分的实现的代码,有兴趣的读者可直接查看原文)

import torch

import torch.nn as nn

from typing import Optional

class DecoderBlock(nn.Module):

def __init__(self, layer_id: int, args: ModelArgs):

super().__init__()

# 初始化参数

self.n_heads = args.n_heads # 注意力头的数量

self.dim = args.dim # 模型维度

self.head_dim = args.dim // args.n_heads # 每个注意力头的维度

self.attention = Attention(args) # 注意力机制模块

self.feed_forward = FeedForward(

dim=args.dim, hidden_dim=4 * args.dim, multiple_of=args.multiple_of

) # 前馈神经网络模块

self.layer_id = layer_id # 当前层的ID

self.attention_norm = RMSNorm(args.dim, eps=args.norm_eps) # 注意力模块的归一化

self.ffn_norm = RMSNorm(args.dim, eps=args.norm_eps) # 前馈神经网络模块的归一化

def forward(self, x: torch.Tensor, start_pos: int, freqs_cis: torch.Tensor, mask: Optional[torch.Tensor]):

# 输入x经过self-attention之后,做Add&Norm

h = x + self.attention.forward(self.attention_norm(x), start_pos, freqs_cis, mask)

# 上一步的输出h作为输入,经过前馈神经网络Feed forward之后,做Add&Norm

out = h + self.feed_forward.forward(self.ffn_norm(h))

return out

2.2 LLaMA模型改进之处:Pre-Normalization与RMSNorm

Pre-Normalization(Pre-Norm,层前归一化):与原始Transformer的Post-Norm(层后归一化)不同,LLaMA采用了Pre-Norm策略,即将层归一化层置于自注意力和前馈神经网络层之前。这种方法有助于稳定训练过程,尤其是在深层网络中,可以缓解梯度消失或爆炸的问题。

RMSNorm(Root Mean Square Layer Normalization,均方根层归一化):LLaMA采用了RMSNorm作为一种替代或补充的归一化方案,相比于Layer Normalization,RMSNorm依据均方根准则调整输入特征,以适应大规模模型训练时的动态范围问题。

这里列出LayerNorm与RMSNorm归一化的表达式:

- LayerNorm

在给定一个输入特征向量 a i a_i ai 后,先计算 x x x 的均值 μ μ μ 和标准差 σ σ σ:

μ = 1 n ∑ i = 1 n a i \mu = \frac{1}{n}\sum_{i=1}^{n}{a_i} μ=n1i=1∑nai

σ = 1 n ∑ i = 1 n ( a i − μ ) 2 \sigma = \sqrt{\frac{1}{n}\sum_{i=1}^{n}{(a_i-\mu)}^2} σ=n1i=1∑n(ai−μ)2

然后进行归一化操作: a ‾ = a i − μ σ g i + b i \overline{a}= \frac{{a_i}-\mu}{\sigma}g_i+b_i a=σai−μgi+bi

其中的 g i g_i gi 是可学习的缩放参数,来调整每个特征在归一化后的尺度或权重,最终作用是恢复归一化操作可能损失的信息,如数据的比例和分布等;而 b i b_i bi 是偏移因子,可以对归一化并放缩后的数据进行偏移,使模型可以学习到一个最优的数值范围,比如在ReLU激活函数中,我们可能希望值在0以上。 - RMS Norm

首先,计算输入特征向量 a a a 的均方根值 (其中, n n n 是向量 a a a 的元素数量):

R M S ( a ) = 1 n ∑ i = 1 n a i 2 RMS(a) = \sqrt{\frac{1}{n}\sum_{i=1}^{n}{a_i}^2} RMS(a)=n1i=1∑nai2

然后,对输入特征向量 a a a 进行归一化: a ‾ = a i R M S ( a ) g i \overline{a}= \frac{a_i}{RMS(a)}g_i a=RMS(a)aigi

此外,可选地,RMSNorm 还可以引入可学习的放缩参数 g i g_i gi 和偏移参数 b i b_i bi,即: a ‾ = a i R M S ( a ) g i + b i \overline{a}= \frac{a_i}{RMS(a)}g_i+b_i a=RMS(a)aigi+bi。

三、LLaMA对Transformer的革新点

3.1 旋转位置编码(RoPE)

LLaMA在位置编码方面引入了旋转位置编码(Rotary Positional Encoding, RoPE)技术。旋转位置编码(RoPE)是一种动态的位置编码机制,不同于经典的Transformer模型中使用的固定位置编码,例如正弦余弦函数形式的位置编码。在RoPE中,位置编码不是直接加到词嵌入向量上,而是与查询和键向量进行旋转操作,从而引入了位置信息。

具体来说,在每个自注意力层中,对于每一个维度,查询(Query)和键(Key)向量会根据它们各自的位置进行旋转。对于维度 i i i 和位置 j j j,查询向量 Q j Q_j Qj 和键向量 K j K_j Kj 的第 i i i 维分别与基于位置 j j j 的旋转矩阵进行左乘和右乘运算。旋转矩阵的参数由预计算好的角度决定,这个角度与位置和维度有关,通常按照某种衰减函数来设置。

数学表达上,对于维度

i

i

i 和位置

j

j

j 的旋转角

θ

i

j

\theta_{ij}

θij,

Q

Q

Q 和

K

K

K 向量的旋转可以表示为:

Q

j

′

=

Q

j

⊙

R

(

−

θ

i

j

)

Q_j' = Q_j \odot R(-\theta_{ij})

Qj′=Qj⊙R(−θij)

K

j

′

=

K

j

⊙

R

(

θ

i

j

)

K_j' = K_j \odot R(\theta_{ij})

Kj′=Kj⊙R(θij)

其中,

R

(

θ

)

R(θ)

R(θ) 是一个由

θ

θ

θ 角确定的旋转矩阵,

⊙

⊙

⊙ 表示逐元素相乘(Hadamard积)。这种旋转操作实际上改变了查询和键向量的方向,使得模型能够根据位置差异更好地捕捉序列中词与词之间的相对位置关系。

通过这种方式,LLaMA模型能够在无需增加额外参数的情况下,更加灵活且有效地将位置信息融入到模型的自注意力机制中,提升模型对顺序依赖结构的理解能力。

代码示例如下所示:

def rotate_qk(q, k, pos_encodings):

theta = pos_encodings[:, :, None, :]

q_prime = torch.einsum('bid,bijd->bji', q, R(theta))

k_prime = torch.einsum('bid,bjid->bji', k, R_inv(theta))

return q_prime, k_prime

此处R和R_inv分别为旋转矩阵及其逆矩阵,它们依据位置编码产生。

3.2 参数效率与计算优化

- 稀疏注意力(Sparse Attention):LLaMA可能利用了局部窗口注意力或者稀疏注意力机制来减少计算开销,特别是针对长序列输入。

- SwiGLU激活函数:LLaMA在某些层中也许采用了SwiGLU(Switched Gated Linear Units)激活函数,这种动态门控机制能够更灵活地处理输入信号,从而提升模型表达能力和计算效率。

3.3 数据驱动与训练策略

LLaMA强调使用公开数据集进行训练,证明了即使没有专有数据,也能训练出最先进的模型。其在训练过程中也可能采用了先进的训练技巧,如动态批处理、混合精度训练及高效的微调策略。

四、总结

LLaMA模型通过对Transformer架构的精巧改造和对位置编码机制的创新运用,不仅提升了模型在各类NLP任务上的性能表现,同时也实现了在参数规模和计算成本方面的有效平衡。 LLama模型的成功实践为后续研究者提供了宝贵的实践经验和技术启示,持续推动着大模型时代的深度学习进步。

尽管本文并未详细列出完整代码实现,但上述简化的代码片段和描述已勾勒出LLaMA模型在架构层面的主要特色和改良方向。在未来,LLaMA模型及其衍生技术将继续丰富和完善大语言模型的设计与应用,赋能更为广阔的人工智能应用场景。