整理了ICLR2019 LEARNING DEEP REPRESENTATIONS BY MUTUAL INFORMATION ESTIMATION AND MAXIMIZATION)论文的阅读笔记

- 背景

- 模型

论文地址:DIM

code:代码地址

背景

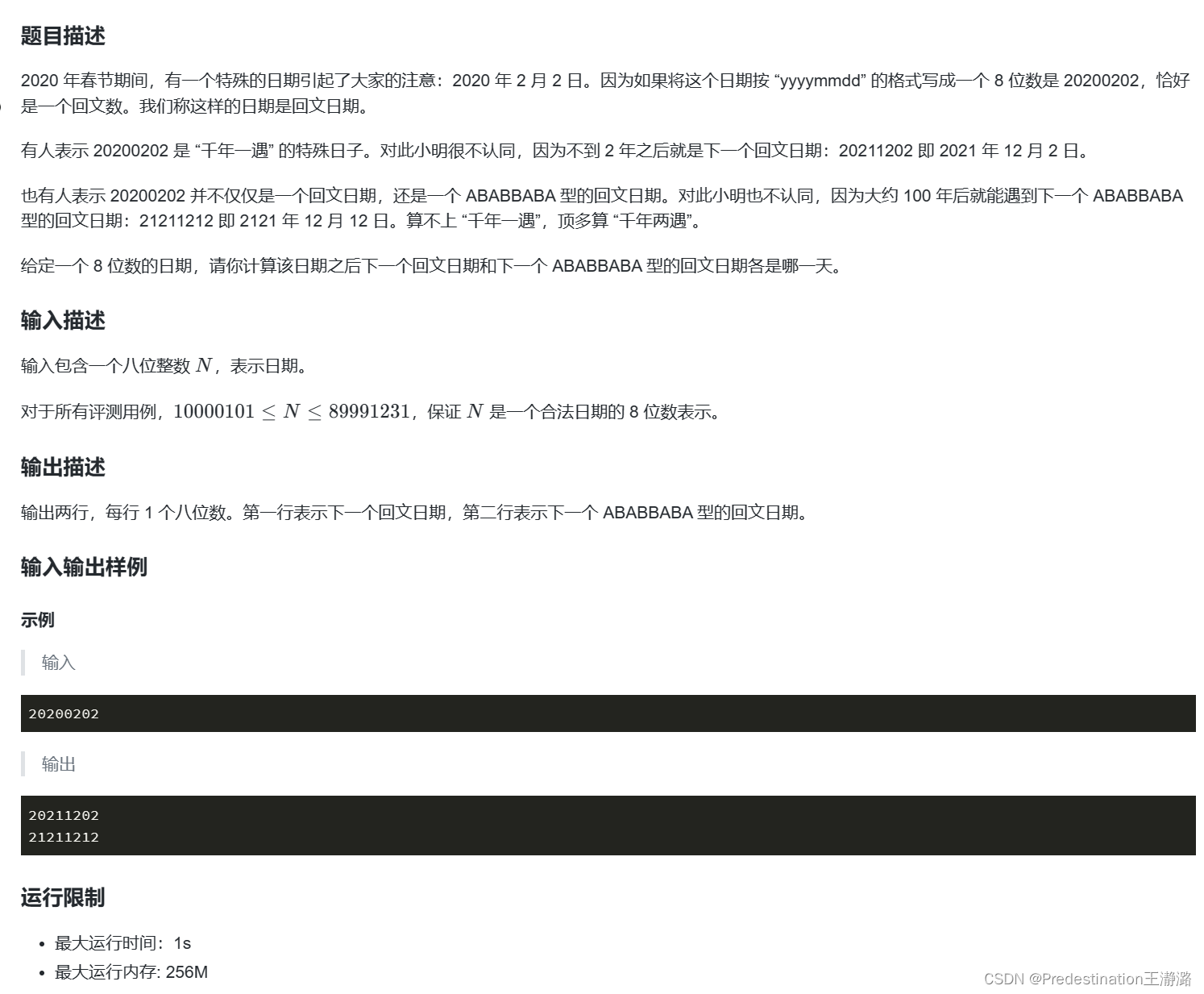

发现有用的表示是深度学习的一个核心目标,由于之前的工作已经可以有效的估计深度学习网络的输入/输出对之间的MI,作者提出最大化输入与输出全局和局部MI学习到更好的表示。作者还提到,直接最大化全部输入和编码器的输出(即全局的MI)更适合于重建性的任务,而在分类的下游任务上效果不太好。最大化输入的局部区域(例如图片中的一块)和输出的平均互信息在下游任务(如图像分类)上的效果更好。因此,互信息最大化的过程可以优先考虑全局或局部信息,文章表明,这可以用来调整学习表征对分类或重建风格任务的适用性。

表征的有用性不仅仅是信息内容的问题,独立性等表征特征也起着重要作用。作者以类似于对抗性自编码器(AAE)的方式将MI最大化与先验匹配结合起来,根据所需的统计属性约束表示。这种方法与信息最大化优化原则密切相关,所以方法称为Deep InfoMax (DIM)。

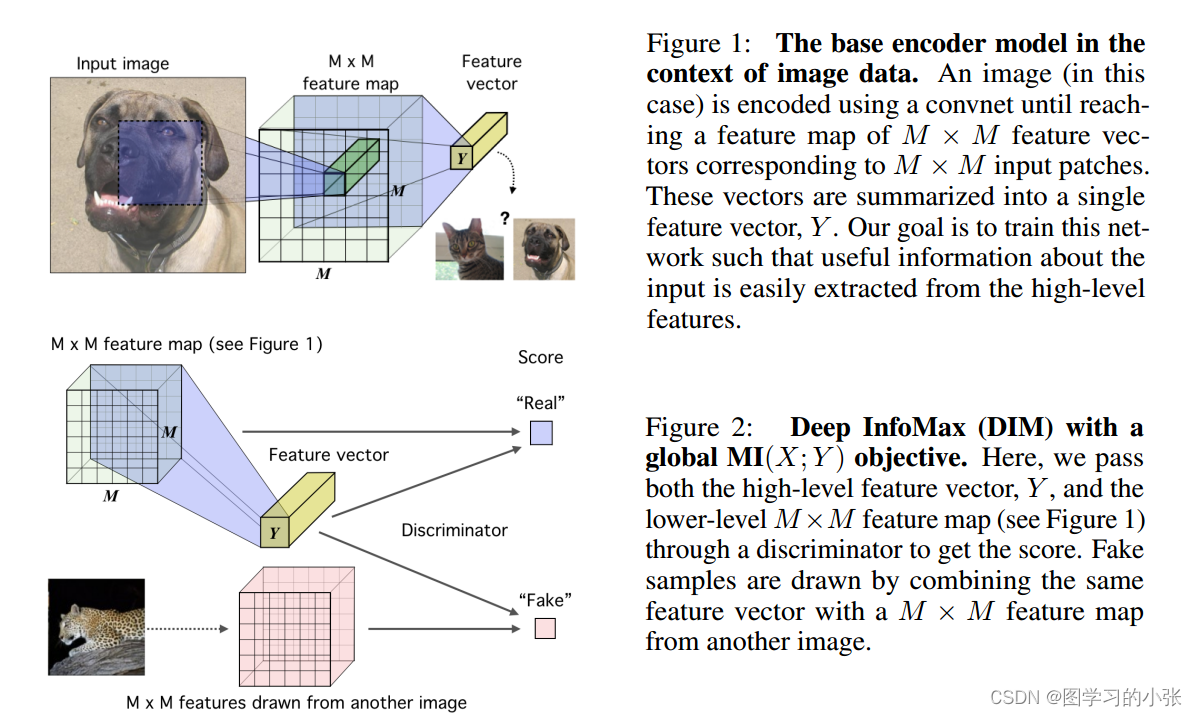

模型

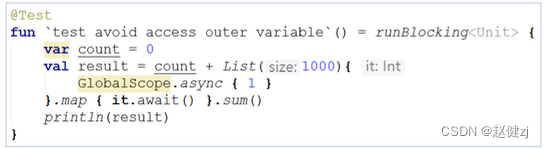

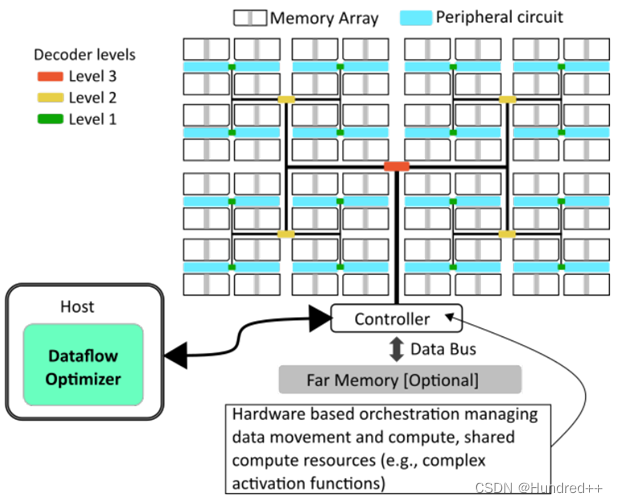

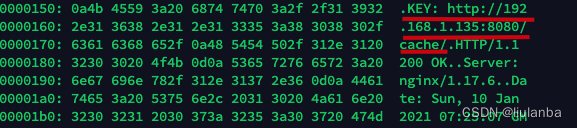

图一是基本的编码器模型,我们的目标是使得向量y包含更多的有用特征,图二是训练鉴别器的过程,使用另一张图片为假样本,训练鉴别器使得它可以分开补丁的特征与向量y是否来自于同一张图片,注意,这里的鉴别器就是估计互信息时使用的神经网络,这是训练这个鉴别器的目的。