目录

1 数据

1.1 数据预处理

2 模型构建

2.1 自定义算子实现

2.2 Pytorch框架实现

2.3 测试两个网络的运算速度

2.4 两个网络加载同样的权重,两个网络的输出结果是否一致?

2.5 计算模型的参数量和计算量。

3 模型训练

4 模型评价

5 模型预测

总结

参考文献

在本节中,我们实现经典卷积网络LeNet-5,并进行手写体数字识别任务。

首先建立一个nndl.py文件存储我们需要的自定义模块

from torch.nn.init import constant_

import torch

import torch.nn as nn

class Conv2D(nn.Module):

def __init__(self, in_channels, out_channels, kernel_size, stride=1, padding=0):

weight_attr = constant_(torch.empty(size=(out_channels, in_channels, kernel_size, kernel_size)), val=1.0)

bias_attr = constant_(torch.empty(size=(out_channels, 1)), val=0.0)

super(Conv2D, self).__init__()

# 创建卷积核

self.weight = torch.nn.parameter.Parameter(weight_attr, requires_grad=True)

# 创建偏置

self.bias = torch.nn.parameter.Parameter(bias_attr, requires_grad=True)

self.stride = stride

self.padding = padding

# 输入通道数

self.in_channels = in_channels

# 输出通道数

self.out_channels = out_channels

# 基础卷积运算

def single_forward(self, X, weight):

# 零填充

new_X = torch.zeros([X.shape[0], X.shape[1] + 2 * self.padding, X.shape[2] + 2 * self.padding])

new_X[:, self.padding:X.shape[1] + self.padding, self.padding:X.shape[2] + self.padding] = X

u, v = weight.shape

output_w = (new_X.shape[1] - u) // self.stride + 1

output_h = (new_X.shape[2] - v) // self.stride + 1

output = torch.zeros([X.shape[0], output_w, output_h])

for i in range(0, output.shape[1]):

for j in range(0, output.shape[2]):

output[:, i, j] = torch.sum(

new_X[:, self.stride * i:self.stride * i + u, self.stride * j:self.stride * j + v] * weight,

dim=[1, 2])

return output

def forward(self, inputs):

feature_maps = []

# 进行多次多输入通道卷积运算

p = 0

for w, b in zip(self.weight, self.bias): # P个(w,b),每次计算一个特征图Zp

multi_outs = []

# 循环计算每个输入特征图对应的卷积结果

for i in range(self.in_channels):

single = self.single_forward(inputs[:, i, :, :], w[i])

multi_outs.append(single)

# 将所有卷积结果相加

feature_map = torch.sum(torch.stack(multi_outs), dim=0) + b # Zp

feature_maps.append(feature_map)

p += 1

# 将所有Zp进行堆叠

out = torch.stack(feature_maps, 1)

return out

class Pool2D(nn.Module):

def __init__(self, size=(2, 2), mode='max', stride=1):

super(Pool2D, self).__init__()

# 汇聚方式

self.mode = mode

self.h, self.w = size

self.stride = stride

def forward(self, x):

output_w = (x.shape[2] - self.w) // self.stride + 1

output_h = (x.shape[3] - self.h) // self.stride + 1

output = torch.zeros([x.shape[0], x.shape[1], output_w, output_h])

# 汇聚

for i in range(output.shape[2]):

for j in range(output.shape[3]):

# 最大汇聚

if self.mode == 'max':

output[:, :, i, j] = torch.max(

x[:, :, self.stride * i:self.stride * i + self.w, self.stride * j:self.stride * j + self.h])

# 平均汇聚

elif self.mode == 'avg':

output[:, :, i, j] = torch.mean(

x[:, :, self.stride * i:self.stride * i + self.w, self.stride * j:self.stride * j + self.h],

dim=[2, 3])

return output

class RunnerV3(object):

def __init__(self, model, optimizer, loss_fn, metric, **kwargs):

self.model = model

self.optimizer = optimizer

self.loss_fn = loss_fn

self.metric = metric # 只用于计算评价指标

# 记录训练过程中的评价指标变化情况

self.dev_scores = []

# 记录训练过程中的损失函数变化情况

self.train_epoch_losses = [] # 一个epoch记录一次loss

self.train_step_losses = [] # 一个step记录一次loss

self.dev_losses = []

# 记录全局最优指标

self.best_score = 0

def train(self, train_loader, dev_loader=None, **kwargs):

# 将模型切换为训练模式

self.model.train()

# 传入训练轮数,如果没有传入值则默认为0

num_epochs = kwargs.get("num_epochs", 0)

# 传入log打印频率,如果没有传入值则默认为100

log_steps = kwargs.get("log_steps", 100)

# 评价频率

eval_steps = kwargs.get("eval_steps", 0)

# 传入模型保存路径,如果没有传入值则默认为"best_model.pdparams"

save_path = kwargs.get("save_path", "best_model.pdparams")

custom_print_log = kwargs.get("custom_print_log", None)

# 训练总的步数

num_training_steps = num_epochs * len(train_loader)

if eval_steps:

if self.metric is None:

raise RuntimeError('Error: Metric can not be None!')

if dev_loader is None:

raise RuntimeError('Error: dev_loader can not be None!')

# 运行的step数目

global_step = 0

# 进行num_epochs轮训练

for epoch in range(num_epochs):

# 用于统计训练集的损失

total_loss = 0

for step, data in enumerate(train_loader):

X, y = data

# 获取模型预测

logits = self.model(X)

loss = self.loss_fn(logits, y) # 默认求mean

total_loss += loss

# 训练过程中,每个step的loss进行保存

self.train_step_losses.append((global_step, loss.item()))

if log_steps and global_step % log_steps == 0:

print(

f"[Train] epoch: {epoch}/{num_epochs}, step: {global_step}/{num_training_steps}, loss: {loss.item():.5f}")

# 梯度反向传播,计算每个参数的梯度值

loss.backward()

if custom_print_log:

custom_print_log(self)

# 小批量梯度下降进行参数更新

self.optimizer.step()

# 梯度归零

self.optimizer.zero_grad() #无clear_grad

# 判断是否需要评价

if eval_steps > 0 and global_step > 0 and \

(global_step % eval_steps == 0 or global_step == (num_training_steps - 1)):

dev_score, dev_loss = self.evaluate(dev_loader, global_step=global_step)

print(f"[Evaluate] dev score: {dev_score:.5f}, dev loss: {dev_loss:.5f}")

# 将模型切换为训练模式

self.model.train()

# 如果当前指标为最优指标,保存该模型

if dev_score > self.best_score:

self.save_model(save_path)

print(

f"[Evaluate] best accuracy performence has been updated: {self.best_score:.5f} --> {dev_score:.5f}")

self.best_score = dev_score

global_step += 1

# 当前epoch 训练loss累计值

trn_loss = (total_loss / len(train_loader)).item()

# epoch粒度的训练loss保存

self.train_epoch_losses.append(trn_loss)

print("[Train] Training done!")

# 模型评估阶段,使用'paddle.no_grad()'控制不计算和存储梯度

@torch.no_grad()

def evaluate(self, dev_loader, **kwargs):

assert self.metric is not None

# 将模型设置为评估模式

self.model.eval()

global_step = kwargs.get("global_step", -1)

# 用于统计训练集的损失

total_loss = 0

# 重置评价

self.metric.reset()

# 遍历验证集每个批次

for batch_id, data in enumerate(dev_loader):

X, y = data

# 计算模型输出

logits = self.model(X)

# 计算损失函数

loss = self.loss_fn(logits, y).item()

# 累积损失

total_loss += loss

# 累积评价

self.metric.update(logits, y)

dev_loss = (total_loss / len(dev_loader))

dev_score = self.metric.accumulate()

# 记录验证集loss

if global_step != -1:

self.dev_losses.append((global_step, dev_loss))

self.dev_scores.append(dev_score)

return dev_score, dev_loss

# 模型评估阶段,使用'paddle.no_grad()'控制不计算和存储梯度

@torch.no_grad()

def predict(self, x, **kwargs):

# 将模型设置为评估模式

self.model.eval()

# 运行模型前向计算,得到预测值

logits = self.model(x)

return logits

def save_model(self, save_path):

torch.save(self.model.state_dict(), save_path)

def load_model(self, model_path):

model_state_dict = torch.load(model_path)

self.model.load_state_dict(model_state_dict)

class Accuracy():

def __init__(self, is_logist=True):

# 用于统计正确的样本个数

self.num_correct = 0

# 用于统计样本的总数

self.num_count = 0

self.is_logist = is_logist

def update(self, outputs, labels):

if outputs.shape[1] == 1: # 二分类

outputs = torch.squeeze(outputs, dim=-1)

if self.is_logist:

# logist判断是否大于0

preds = torch.tensor((outputs >= 0), dtype=torch.float32)

else:

# 如果不是logist,判断每个概率值是否大于0.5,当大于0.5时,类别为1,否则类别为0

preds = torch.tensor((outputs >= 0.5), dtype=torch.float32)

else:

# 多分类时,使用'torch.argmax'计算最大元素索引作为类别

preds = torch.argmax(outputs, dim=1)

# 获取本批数据中预测正确的样本个数

labels = torch.squeeze(labels, dim=-1)

# batch_correct = torch.sum(torch.tensor(preds == labels, dtype=torch.float32)).numpy()

batch_correct = torch.sum((preds == labels).to(dtype=torch.float32)).detach().cpu().numpy()

batch_count = len(labels)

# 更新num_correct 和 num_count

self.num_correct += batch_correct

self.num_count += batch_count

def accumulate(self):

# 使用累计的数据,计算总的指标

if self.num_count == 0:

return 0

return self.num_correct / self.num_count

def reset(self):

# 重置正确的数目和总数

self.num_correct = 0

self.num_count = 0

def name(self):

return "Accuracy"

import matplotlib.pyplot as plt

# 可视化

def plot(runner, fig_name):

plt.figure(figsize=(10, 5))

plt.subplot(1, 2, 1)

train_items = runner.train_step_losses[::30]

train_steps = [x[0] for x in train_items]

train_losses = [x[1] for x in train_items]

plt.plot(train_steps, train_losses, color='#8E004D', label="Train loss")

if runner.dev_losses[0][0] != -1:

dev_steps = [x[0] for x in runner.dev_losses]

dev_losses = [x[1] for x in runner.dev_losses]

plt.plot(dev_steps, dev_losses, color='#E20079', linestyle='--', label="Dev loss")

# 绘制坐标轴和图例

plt.ylabel("loss", fontsize='x-large')

plt.xlabel("step", fontsize='x-large')

plt.legend(loc='upper right', fontsize='x-large')

plt.subplot(1, 2, 2)

# 绘制评价准确率变化曲线

if runner.dev_losses[0][0] != -1:

plt.plot(dev_steps, runner.dev_scores,

color='#E20079', linestyle="--", label="Dev accuracy")

else:

plt.plot(list(range(len(runner.dev_scores))), runner.dev_scores,

color='#E20079', linestyle="--", label="Dev accuracy")

# 绘制坐标轴和图例

plt.ylabel("score", fontsize='x-large')

plt.xlabel("step", fontsize='x-large')

plt.legend(loc='lower right', fontsize='x-large')

plt.savefig(fig_name)

plt.show()

- Conv2d:自定义的卷积层算子

- Pool2d:自定义的池化层算子

- RunnerV3:自定义的训练模块

- Accuary:计算模型的准确率

- plot:模型结果可视化

如果对哪个模块不理解,可以翻之前的前馈神经网络的博客,不是第一次调用了。

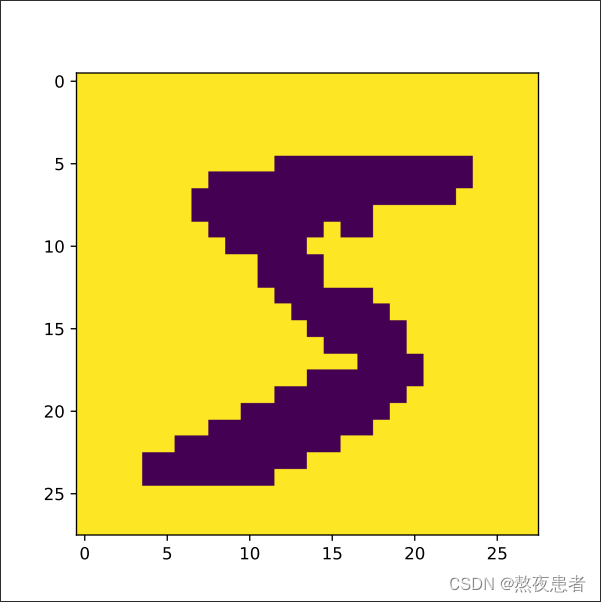

1 数据

手写体数字识别是计算机视觉中最常用的图像分类任务,让计算机识别出给定图片中的手写体数字(0-9共10个数字)。由于手写体风格差异很大,因此手写体数字识别是具有一定难度的任务。

我们采用常用的手写数字识别数据集:MNIST数据集。MNIST数据集是计算机视觉领域的经典入门数据集,包含了60,000个训练样本和10,000个测试样本。这些数字已经过尺寸标准化并位于图像中心,图像是固定大小( 像素)。下图给出了部分样本的示例。

为了节省训练时间,本节选取MNIST数据集的一个子集进行后续实验,数据集的划分为:

- 训练集:1,000条样本

- 验证集:200条样本

- 测试集:200条样本

MNIST数据集分为train_set、dev_set和test_set三个数据集,每个数据集含两个列表分别存放了图片数据以及标签数据。比如train_set包含:

- 图片数据:[1 000, 784]的二维列表,包含1 000张图片。每张图片用一个长度为784的向量表示,内容是

尺寸的像素灰度值(黑白图片)。

- 标签数据:[1 000, 1]的列表,表示这些图片对应的分类标签,即0~9之间的数字。

观察数据集分布情况,代码实现如下:

import json

import gzip

# 打印并观察数据集分布情况

train_set, dev_set, test_set = json.load(gzip.open('./mnist.json.gz'))

train_images, train_labels = train_set[0][:1000], train_set[1][:1000]

dev_images, dev_labels = dev_set[0][:200], dev_set[1][:200]

test_images, test_labels = test_set[0][:200], test_set[1][:200]

train_set, dev_set, test_set = [train_images, train_labels], [dev_images, dev_labels], [test_images, test_labels]

print('Length of train/dev/test set:{}/{}/{}'.format(len(train_set[0]), len(dev_set[0]), len(test_set[0]))) ![]()

可视化观察其中的一张样本以及对应的标签,代码如下所示:

import matplotlib.pyplot as plt

import numpy as np

import PIL.Image as Image

image, label = train_set[0][0], train_set[1][0]

image, label = np.array(image).astype('float32'), int(label)

# 原始图像数据为长度784的行向量,需要调整为[28,28]大小的图像

image = np.reshape(image, [28,28])

image = Image.fromarray(image.astype('uint8'), mode='L')

print("The number in the picture is {}".format(label))

plt.figure(figsize=(5, 5))

plt.imshow(image)

plt.savefig('conv-number5.pdf')![]()

1.1 数据预处理

图像分类网络对输入图片的格式、大小有一定的要求,数据输入模型前,需要对数据进行预处理操作,使图片满足网络训练以及预测的需要。本实验主要应用了如下方法:

- 调整图片大小:LeNet网络对输入图片大小的要求为

,而MNIST数据集中的原始图片大小却是

,这里为了符合网络的结构设计,将其调整为

;

- 规范化: 通过规范化手段,把输入图像的分布改变成均值为0,标准差为1的标准正态分布,使得最优解的寻优过程明显会变得平缓,训练过程更容易收敛。

import torchvision.transforms as transforms

transforms = transforms.Compose([

transforms.Resize(32),

transforms.ToTensor(),

transforms.Normalize(mean=[127.5], std=[127.5])

])将原始的数据集封装为Dataset类,以便DataLoader调用。

from torch.utils.data import Dataset

class MNIST_dataset(Dataset):

def __init__(self, dataset, transforms, mode='train'):

self.mode = mode

self.transforms = transforms

self.dataset = dataset

def __getitem__(self, idx):

# 获取图像和标签

image, label = self.dataset[0][idx], self.dataset[1][idx]

image, label = np.array(image).astype('float32'), int(label)

image = np.reshape(image, [28,28])

image = Image.fromarray(image.astype('uint8'), mode='L')

image = self.transforms(image)

return image, label

def __len__(self):

return len(self.dataset[0])# 加载 mnist 数据集

train_dataset = MNIST_dataset(dataset=train_set, transforms=transforms, mode='train')

test_dataset = MNIST_dataset(dataset=test_set, transforms=transforms, mode='test')

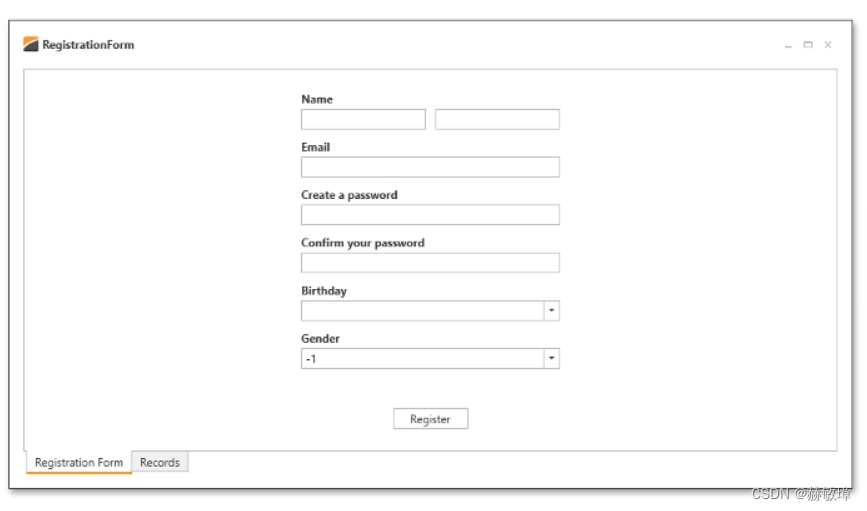

dev_dataset = MNIST_dataset(dataset=dev_set, transforms=transforms, mode='dev')2 模型构建

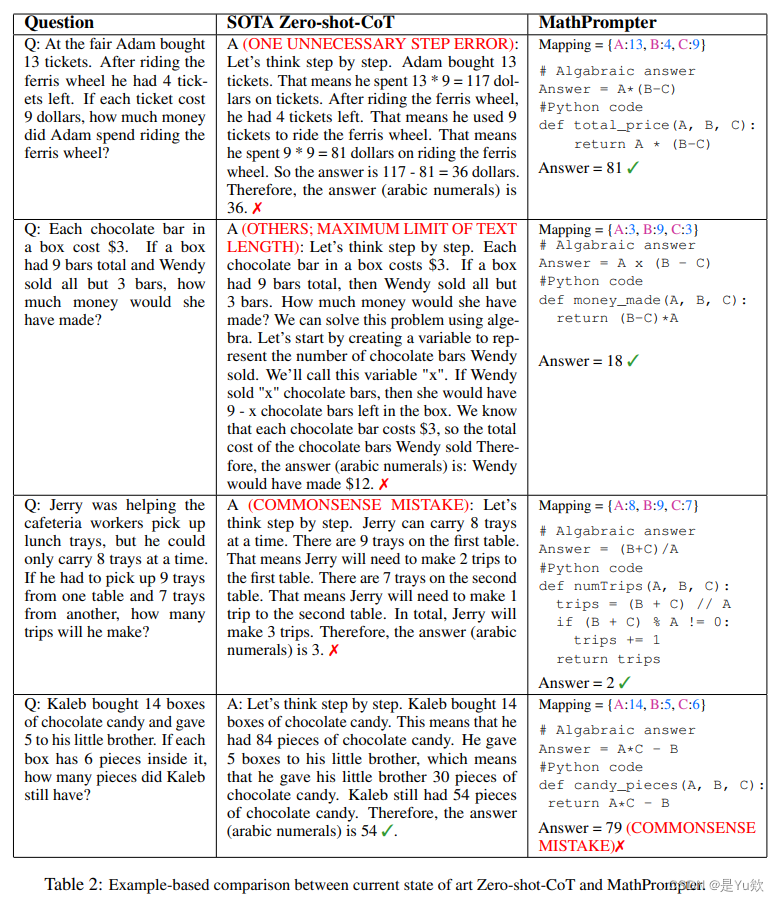

LeNet-5虽然提出的时间比较早,但它是一个非常成功的神经网络模型。基于LeNet-5的手写数字识别系统在20世纪90年代被美国很多银行使用,用来识别支票上面的手写数字。LeNet-5的网络结构如图所示。

我们使用上面定义的卷积层算子和汇聚层算子构建一个LeNet-5模型。

2.1 自定义算子实现

这里的LeNet-5和原始版本有4点不同:

- C3层没有使用连接表来减少卷积数量。

- 汇聚层使用了简单的平均汇聚,没有引入权重和偏置参数以及非线性激活函数。

- 卷积层的激活函数使用ReLU函数。

- 最后的输出层为一个全连接线性层。

网络共有7层,包含3个卷积层、2个汇聚层以及2个全连接层的简单卷积神经网络接,受输入图像大小为,输出对应10个类别的得分。

具体实现如下:

import torch

import torch.nn.functional as F

class Model_LeNet(nn.Module):

def __init__(self, in_channels, num_classes=10):

super(Model_LeNet, self).__init__()

# 卷积层:输出通道数为6,卷积核大小为5×5

self.conv1 = Conv2D(in_channels=in_channels, out_channels=6, kernel_size=5)

# 汇聚层:汇聚窗口为2×2,步长为2

self.pool2 = Pool2D(size=(2, 2), mode='max', stride=2)

# 卷积层:输入通道数为6,输出通道数为16,卷积核大小为5×5,步长为1

self.conv3 = Conv2D(in_channels=6, out_channels=16, kernel_size=5, stride=1)

# 汇聚层:汇聚窗口为2×2,步长为2

self.pool4 = Pool2D(size=(2, 2), mode='avg', stride=2)

# 卷积层:输入通道数为16,输出通道数为120,卷积核大小为5×5

self.conv5 = Conv2D(in_channels=16, out_channels=120, kernel_size=5, stride=1)

# 全连接层:输入神经元为120,输出神经元为84

self.linear6 = nn.Linear(120, 84)

# 全连接层:输入神经元为84,输出神经元为类别数

self.linear7 = nn.Linear(84, num_classes)

def forward(self, x):

# C1:卷积层+激活函数

output = F.relu(self.conv1(x))

# S2:汇聚层

output = self.pool2(output)

# C3:卷积层+激活函数

output = F.relu(self.conv3(output))

# S4:汇聚层

output = self.pool4(output)

# C5:卷积层+激活函数

output = F.relu(self.conv5(output))

# 输入层将数据拉平[B,C,H,W] -> [B,CxHxW]

output = torch.squeeze(output, dim=3)

output = torch.squeeze(output, dim=2)

# F6:全连接层

output = F.relu(self.linear6(output))

# F7:全连接层

output = self.linear7(output)

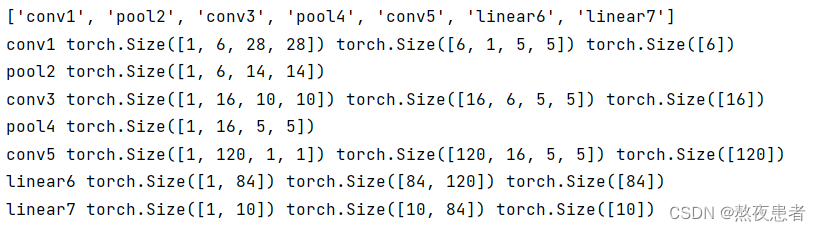

return output下面测试一下上面的LeNet-5模型,构造一个形状为 [1,1,32,32]的输入数据送入网络,观察每一层特征图的形状变化。代码实现如下:

# 这里用np.random创建一个随机数组作为输入数据

inputs = np.random.randn(*[1, 1, 32, 32])

inputs = inputs.astype('float32')

model = Model_LeNet(in_channels=1, num_classes=10)

c = []

for a, b in model.named_children():

c.append(a)

print(c)

x = torch.tensor(inputs)

for a, item in model.named_children():

try:

x = item(x)

except:

x = torch.reshape(x, [x.shape[0], -1])

x = item(x)

print(a, x.shape, sep=' ', end=' ')

for name, value in item.named_parameters():

print(value.shape, end=' ')

print()

再次复习一下pytorch查询模型内部信息,参考博客

modules()函数

这个函数返回模型的所有组成模块,包括子模块的组成模块。

named_modules()函数

此函数返回的东西和modules()差不多,只不过每个模块的实例的名称也返回了。

parameters()函数

通过此函数访问模型的可训练参数,例如卷积层的权重weights和偏置bias。(可以通过

p.requires_grad = False来冻结参数)named_parameters()函数

此函数相比于parameters(),还会返回每个参数的名称。

补充:state_dict()函数

这个函数在保存和加载模型权重时经常会用到。

从输出结果看,

- 对于大小为

的单通道图像,先用6个大小为

的卷积核对其进行卷积运算,输出为6个

大小的特征图;

- 6个

大小的特征图经过大小为

,步长为2的汇聚层后,输出特征图的大小变为

;

- 6个

大小的特征图再经过16个大小为

的卷积核对其进行卷积运算,得到16个

大小的输出特征图;

- 16个

大小的特征图经过大小为

,步长为2的汇聚层后,输出特征图的大小变为

;

- 16个

大小的特征图再经过120个大小为

的卷积核对其进行卷积运算,得到120个

大小的输出特征图;

- 此时,将特征图展平成1维,则有120个像素点,经过输入神经元个数为120,输出神经元个数为84的全连接层后,输出的长度变为84。

- 再经过一个全连接层的计算,最终得到了长度为类别数的输出结果。

2.2 Pytorch框架实现

考虑到自定义的Conv2D和Pool2D算子中包含多个for循环,所以运算速度比较慢。Pytorch框架中,针对卷积层算子和汇聚层算子进行了速度上的优化。代码如下:

class Torch_LeNet(nn.Module):

def __init__(self, in_channels, num_classes=10):

super(Torch_LeNet, self).__init__()

# 卷积层:输出通道数为6,卷积核大小为5*5

self.conv1 = nn.Conv2d(in_channels=in_channels, out_channels=6, kernel_size=5)

# 汇聚层:汇聚窗口为2*2,步长为2

self.pool2 = nn.MaxPool2d(kernel_size=2, stride=2)

# 卷积层:输入通道数为6,输出通道数为16,卷积核大小为5*5

self.conv3 = nn.Conv2d(in_channels=6, out_channels=16, kernel_size=5)

# 汇聚层:汇聚窗口为2*2,步长为2

self.pool4 = nn.AvgPool2d(kernel_size=2, stride=2)

# 卷积层:输入通道数为16,输出通道数为120,卷积核大小为5*5

self.conv5 = nn.Conv2d(in_channels=16, out_channels=120, kernel_size=5)

# 全连接层:输入神经元为120,输出神经元为84

self.linear6 = nn.Linear(in_features=120, out_features=84)

# 全连接层:输入神经元为84,输出神经元为类别数

self.linear7 = nn.Linear(in_features=84, out_features=num_classes)

def forward(self, x):

# C1:卷积层+激活函数

output = F.relu(self.conv1(x))

# S2:汇聚层

output = self.pool2(output)

# C3:卷积层+激活函数

output = F.relu(self.conv3(output))

# S4:汇聚层

output = self.pool4(output)

# C5:卷积层+激活函数

output = F.relu(self.conv5(output))

# 输入层将数据拉平[B,C,H,W] -> [B,CxHxW]

output = torch.squeeze(output, dim=3)

output = torch.squeeze(output, dim=2)

# F6:全连接层

output = F.relu(self.linear6(output))

# F7:全连接层

output = self.linear7(output)

return output测试一下模型的正确性和结构。

# 这里用np.random创建一个随机数组作为输入数据

inputs = np.random.randn(*[1, 1, 32, 32])

inputs = inputs.astype('float32')

model = Torch_LeNet(in_channels=1, num_classes=10)

c = []

for a, b in model.named_children():

c.append(a)

print(c)

x = torch.tensor(inputs)

for a, item in model.named_children():

try:

x = item(x)

except:

x = torch.reshape(x, [x.shape[0], -1])

x = item(x)

print(a, x.shape, sep=' ', end=' ')

for name, value in item.named_parameters():

print(value.shape, end=' ')

print() 和自定义卷积算子和池化算子的输出结果一致。

和自定义卷积算子和池化算子的输出结果一致。

2.3 测试两个网络的运算速度

import time

# 这里用np.random创建一个随机数组作为测试数据

inputs = np.random.randn(*[1,1,32,32])

inputs = inputs.astype('float32')

x = torch.tensor(inputs)

# 创建Model_LeNet类的实例,指定模型名称和分类的类别数目

model = Model_LeNet(in_channels=1, num_classes=10)

# 创建Paddle_LeNet类的实例,指定模型名称和分类的类别数目

torch_model = Torch_LeNet(in_channels=1, num_classes=10)

# 计算Model_LeNet类的运算速度

model_time = 0

for i in range(60):

strat_time = time.time()

out = model(x)

end_time = time.time()

# 预热10次运算,不计入最终速度统计

if i < 10:

continue

model_time += (end_time - strat_time)

avg_model_time = model_time / 50

print('Model_LeNet speed:', avg_model_time, 's')

# 计算Torch_LeNet类的运算速度

torch_model_time = 0

for i in range(60):

strat_time = time.time()

torch_out = torch_model(x)

end_time = time.time()

# 预热10次运算,不计入最终速度统计

if i < 10:

continue

torch_model_time += (end_time - strat_time)

avg_torch_model_time = torch_model_time / 50

print('Torch_LeNet speed:', avg_torch_model_time, 's')

可以看到,PyTorch框架优势巨大,速度远远快于自定义实现的网络,这还只是Hello world级别的LeNet。

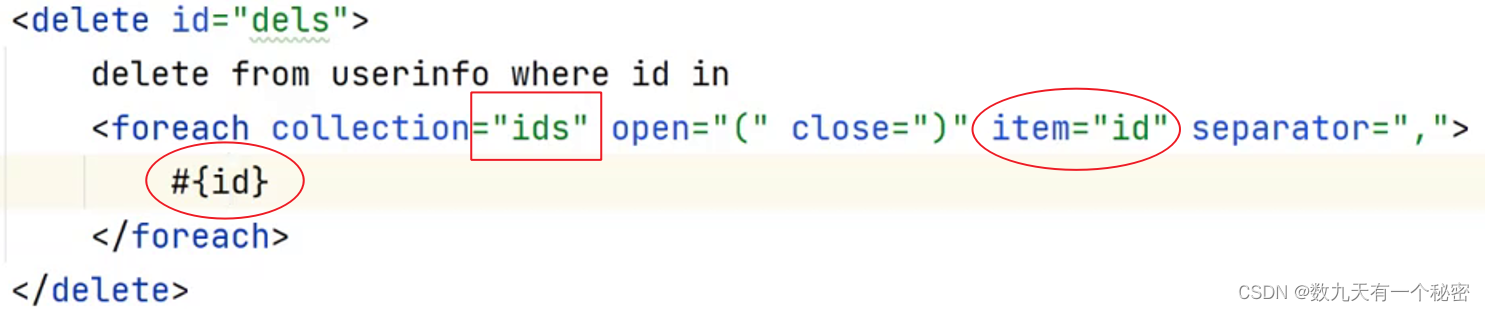

2.4 两个网络加载同样的权重,两个网络的输出结果是否一致?

# 这里用np.random创建一个随机数组作为测试数据

inputs = np.random.randn(*[1,1,32,32])

inputs = inputs.astype('float32')

x = torch.tensor(inputs)

# 创建Model_LeNet类的实例,指定模型名称和分类的类别数目

model = Model_LeNet(in_channels=1, num_classes=10)

# 获取网络的权重

params = model.state_dict()

# 自定义Conv2D算子的bias参数形状为[out_channels, 1]

# paddle API中Conv2D算子的bias参数形状为[out_channels]

# 需要进行调整后才可以赋值

for key in params:

if 'bias' in key:

params[key] = params[key].squeeze()

# 创建Paddle_LeNet类的实例,指定模型名称和分类的类别数目

torch_model = Torch_LeNet(in_channels=1, num_classes=10)

# 将Model_LeNet的权重参数赋予给Paddle_LeNet模型,保持两者一致

torch_model.load_state_dict(params)

# 打印结果保留小数点后6位

torch.set_printoptions(6)

# 计算Model_LeNet的结果

output = model(x)

print('Model_LeNet output: ', output)

# 计算Paddle_LeNet的结果

torch_output = torch_model(x)

print('Torch_LeNet output: ', torch_output)

可以看到,输出结果是一致的。

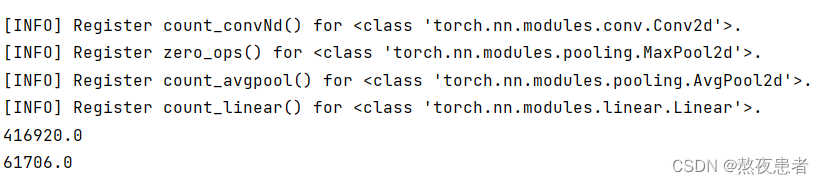

2.5 计算模型的参数量和计算量。

参数量

按照公式进行计算,可以得到:

- 第一个卷积层的参数量为:

;

- 第二个卷积层的参数量为:

;

- 第三个卷积层的参数量为:

;

- 第一个全连接层的参数量为:

;

- 第二个全连接层的参数量为:

;

所以,LeNet-5总的参数量为。

代码如下:

from torchsummary import summary

device = torch.device("cuda" if torch.cuda.is_available() else "cpu") # PyTorch v0.4.0

Torch_model= Torch_LeNet(in_channels=1, num_classes=10).to(device)

summary(Torch_model, (1,32, 32))

可以看到,结果与公式推导一致。

计算量

按照公式进行计算,可以得到:

- 第一个卷积层的计算量为:

;

- 第二个卷积层的计算量为:

;

- 第三个卷积层的计算量为:

;

- 平均汇聚层的计算量为:

;

- 第一个全连接层的计算量为:

;

- 第二个全连接层的计算量为:

;

所以,LeNet-5总的计算量为。

from thop import profile

model = Torch_LeNet(in_channels=1, num_classes=10)

dummy_input = torch.randn(1, 1, 32, 32)

flops, params = profile(model,(dummy_input,))

print(flops)

这块在搜索资料的时候发现,有个博主说计算量是需要flops*2因为profile函数返回的是Macs不是准确的flops,flops = Mac * 2,这里还不太确定搜了很多也没有很准确的讲出真的假的,博客放在这儿存疑

3 模型训练

import torch.optim as opt

import torch.utils.data as data

from nndl import Accuracy

from nndl import RunnerV3

# 学习率大小

lr = 0.1

# 批次大小

batch_size = 64

# 加载数据

train_loader = data.DataLoader(train_dataset, batch_size=batch_size, shuffle=True)

dev_loader = data.DataLoader(dev_dataset, batch_size=batch_size)

test_loader = data.DataLoader(test_dataset, batch_size=batch_size)

model = Model_LeNet(in_channels=1, num_classes=10)

# 定义优化器

optimizer = opt.SGD(lr=lr, params=model.parameters())

# 定义损失函数

loss_fn = F.cross_entropy

# 定义评价指标

metric = Accuracy(is_logist=True)

# 实例化 RunnerV3 类,并传入训练配置。

runner = RunnerV3(model, optimizer, loss_fn, metric)

# 启动训练

log_steps = 15

eval_steps = 15

runner.train(train_loader, dev_loader, num_epochs=10, log_steps=log_steps,

eval_steps=eval_steps, save_path="best_model.pdparams")

可视化观察训练集与验证集的损失变化情况。

4 模型评价

使用测试数据对在训练过程中保存的最佳模型进行评价,观察模型在测试集上的准确率以及损失变化情况。

# 加载最优模型

runner.load_model('best_model.pdparams')

# 模型评价

score, loss = runner.evaluate(test_loader)

print("[Test] accuracy/loss: {:.4f}/{:.4f}".format(score, loss))![]()

5 模型预测

同样地,我们也可以使用保存好的模型,对测试集中的某一个数据进行模型预测,观察模型效果。

# 获取测试集中第一条数据

X, label = next(iter(test_loader))

logits = runner.predict(X)

# 多分类,使用softmax计算预测概率

pred = F.softmax(logits,dim=1)

# 获取概率最大的类别

pred_class = torch.argmax(pred[2]).numpy()

label = label[2].numpy()

# 输出真实类别与预测类别

print("The true category is {} and the predicted category is {}".format(label, pred_class))

# 可视化图片

plt.figure(figsize=(2, 2))

image, label = test_set[0][100], test_set[1][100]

image= np.array(image).astype('float32')

image = np.reshape(image, [28,28])

image = Image.fromarray(image.astype('uint8'), mode='L')

plt.imshow(image)

plt.savefig('cnn-number2.pdf')![]()

总结

这次实验比较基础,老师也讲了毕竟LeNet是Hello world级别的深度学习模型,但是把越简单的事情要搞得越明白越透彻就越不容易,是这次使用自定义算子和框架库函数一对比,对明显体现了框架的巨大优越性。对LeNet的认识有了进一步的认知吧~正好近两天花大量时间阅览了一下深度学习入门这本书,也就是我们俗称的鱼书,这里总结一下吧~

全连接神经网络存在什么问题

那就是数据的形状被“忽视”了。比如,输 入数据是图像时,图像通常是高、长、通道方向上的3维形状。但是,向全 连接层输入时,需要将3维数据拉平为1维数据。

对于卷积操作的偏置,偏置通常只有1个,这个值 会被加到应用了滤波器的所有元素上。

并且发现了一个很好的图,这个图更有助于了解多通道卷积和偏置等等的概念,同时对于参数的标识也是严格按照顺序的。

池化池的特征

- 没有要学习的参数

- 通道数不发生改变

- 对微小的位置变化具有鲁棒性(健壮)

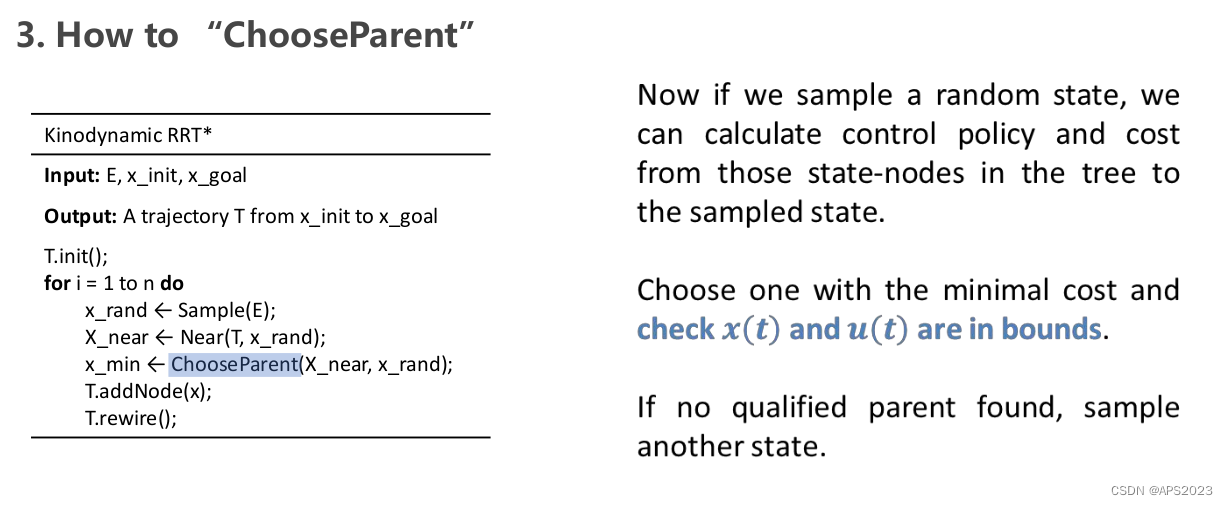

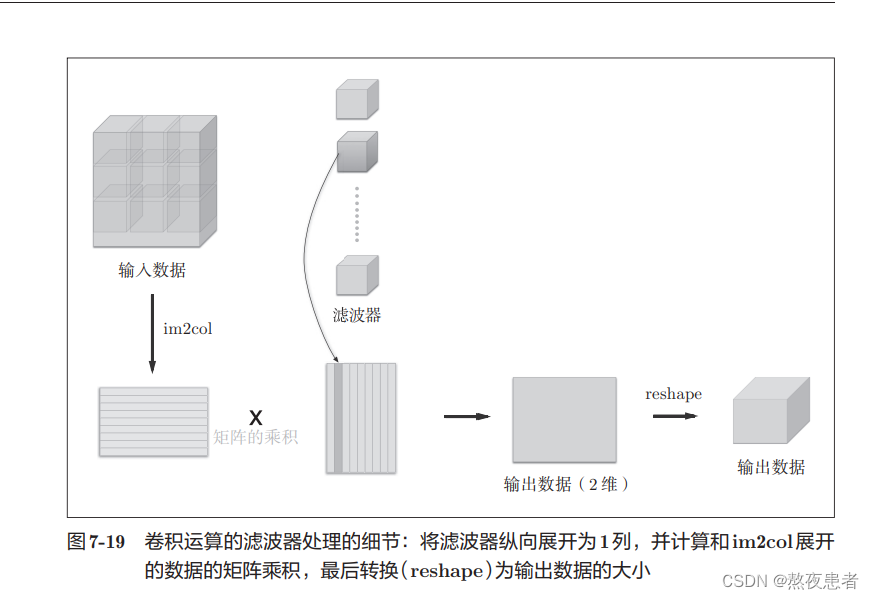

关于卷积池化等操作,鱼书中提到了一个全新的解决方式,通过调用im2col函数将四维变量压缩为二维,也可以叫做展开,因为老老实实进行卷积运算是要基于for循环来操作的,但是Numpy中使用过多的for循环有处理变慢的缺点,所以利用im2col的方法可以有效避免这个,但是使用im2col展开后,滤波器的应用区域重叠的情况下,展开后的元素个数会多于原方块的元素个数。因此,使用im2col的实现存在比普通的实现消耗更 多内存的缺点。但是,汇总成一个大的矩阵进行计算,对计算机的计算颇有 益处。因为矩阵计算的速度已经现在在被优化的很快了,展开的图形如下图所示。

这里对于卷积层和池化层都是由im2col函数为基础搭建的,但是还没找到资源,之后会补上这一块代码部分 。

鱼书中通过实验指出,第1层的卷积层中提取了边 缘或斑块等“低级”信息,根据深度学习的可视化相关的研究,随着层次加深,提取的信息(正确地讲,是反映强烈的神经元)也越来越抽象。最开始的层对简单的边缘有响应,接下来的层对纹理有响应,再后面的层对更加复杂的物体部件有响应。也就是说,随着层次加深,神经元从简单的形状向“高级”信息变化。换句话说,就像我们理解东西的“含义”一样,响应的对象在逐渐变化。

并且指出了两个具有特别代表性的CNN网络LetNet, AlexNet,和“现在的CNN”相比,LeNet有几个不同点。

- LeNet中使用sigmoid函数,而现在的CNN中主要使用ReLU函数。

- 原始的LeNet中使用子采样(subsampling)缩小中间数据的大小,而 现在的CNN中Max池化是主流

关于AlexNet网络,虽然结构上AlexNet和LeNet没有大的不同,但有以下几点差异

- 激活函数使用ReLU。

- 使用进行局部正规化的LRN(Local Response Normalization)层。

- 使用Dropout

参考文献

pytorch 计算网络模型的计算量FLOPs和参数量parameter参数数量 - emanlee - 博客园 (cnblogs.com)

Pytorch查看模型的参数量和计算量_pytorch查看pt参数大小-CSDN博客