论文地址:Dr.Deep:基于医疗特征上下文学习的患者健康状态可解释评估 (ict.ac.cn)

代码地址:GitHub - Accountable-Machine-Intelligence/Dr.Deep

简介:

深度学习是当前医疗多变量时序数据分析的主流方法。临床辅助决策关乎病人生命健康,因此 深度模型需要抽取患者个性化表示,保证较高的分析、预测准确率;同时还需提供足够的可解释性,即能 解释模型给出分析、预测结论的依据。而现有工作暂未能匹配医疗领域多变量时间序列数据的特性来进 行个性化表示学习,同时源于深度学习的黑盒性质,现有模型大都可解释性不足,难以满足临床应用的 需求。在此背景下,提出了基于医疗特征上下文学习的患者健康状态可解释评估方法 Dr.Deep,将各变 量的时序特征分别编码,利用多头去协同的自注意力机制,学习不同特征之间关联关系;提出了基于压 缩激励机制的特征跳连编码,提升模型对最新病情变化的敏感性并针对不同患者情况分析特征重要性。实验表明:Dr.Deep在重症监护患者脓毒症预测、新冠肺炎重症患者出院时间预测等任务中相比业界方 法性能提升,且可以针对不同患者的不同指标自适应学习其重要性作为可解释性的关键因素。同时设计 并实现了基于医疗多变量时序数据分析的医生临床辅助系统,该系统建立病人的健康表示学习和预后 预测模型并可视化患者病情进展以便医生分析。

创新点:

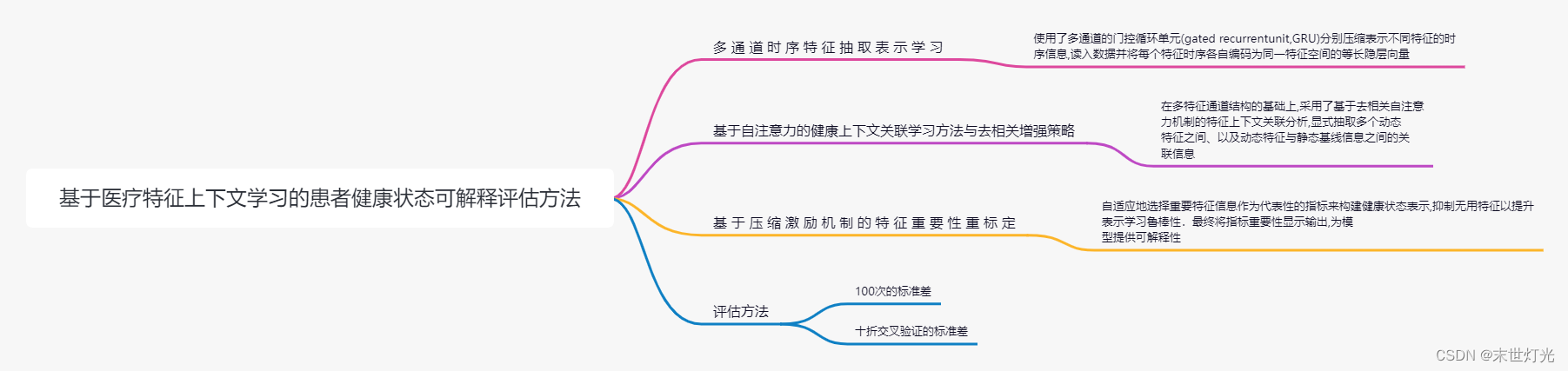

1. 面向多变量时序电子病历数据,提出基于特 征上下文表示学习的患者健康状态个性化表示学习 方法与可解释评估方法.技术贡献具体包括:

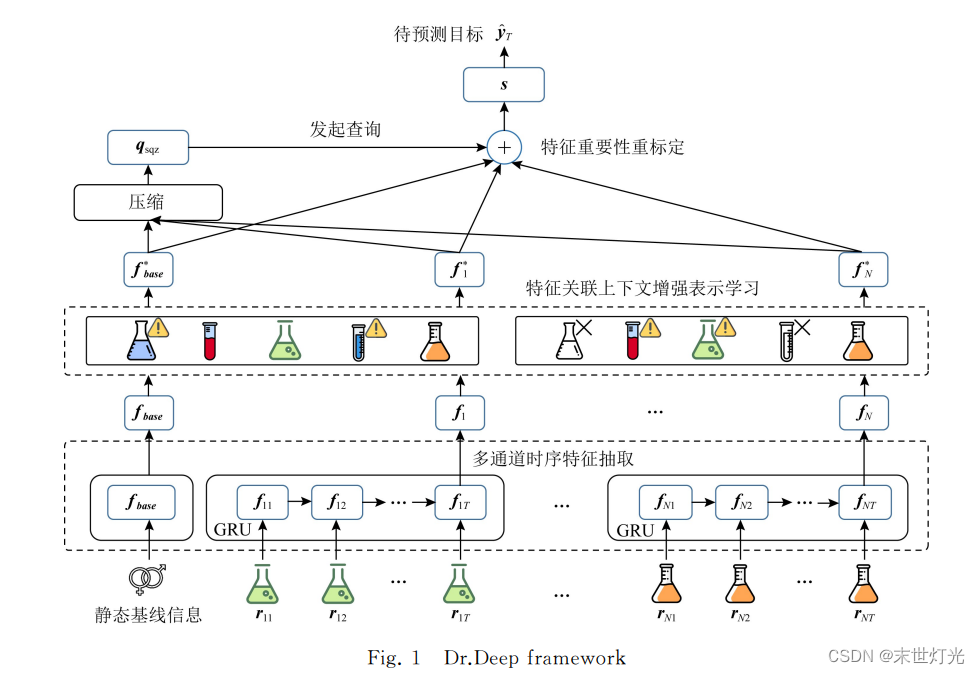

1)提出了一种多通道健康上下文表示学习方 法,有效编码医疗记录以构成患者的健康表示.在多 特征通道结构的基础上,采用了基于去相关自注意 力机制的特征上下文关联分析,显式抽取多个动态 特征之间、以及动态特征与静态基线信息之间的关 联信息;

2)提出了基于压缩激励机制的特征重要性重 标定方法,自适应地选择重要特征信息作为代表性 的指标来构建健康状态表示,抑制无用特征以提升 表示学习鲁棒性.最终将指标重要性显示输出,为模 型提供可解释性;

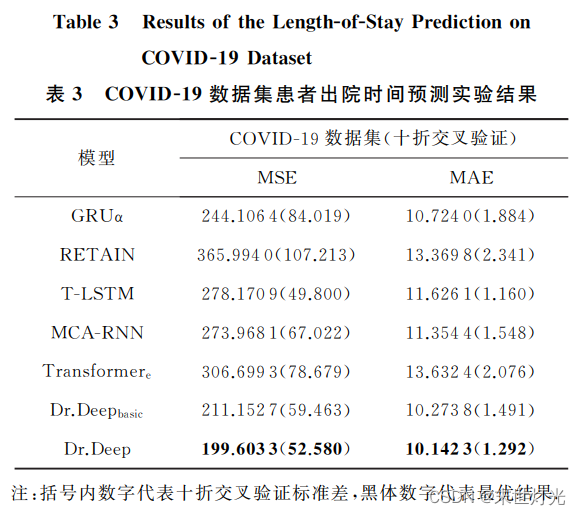

2. 在2个开放重症监护患者医疗数据集上进 行脓毒症预测、出院时间预测实验.实验证明本文方 法有效性显著高于同期其他方法:

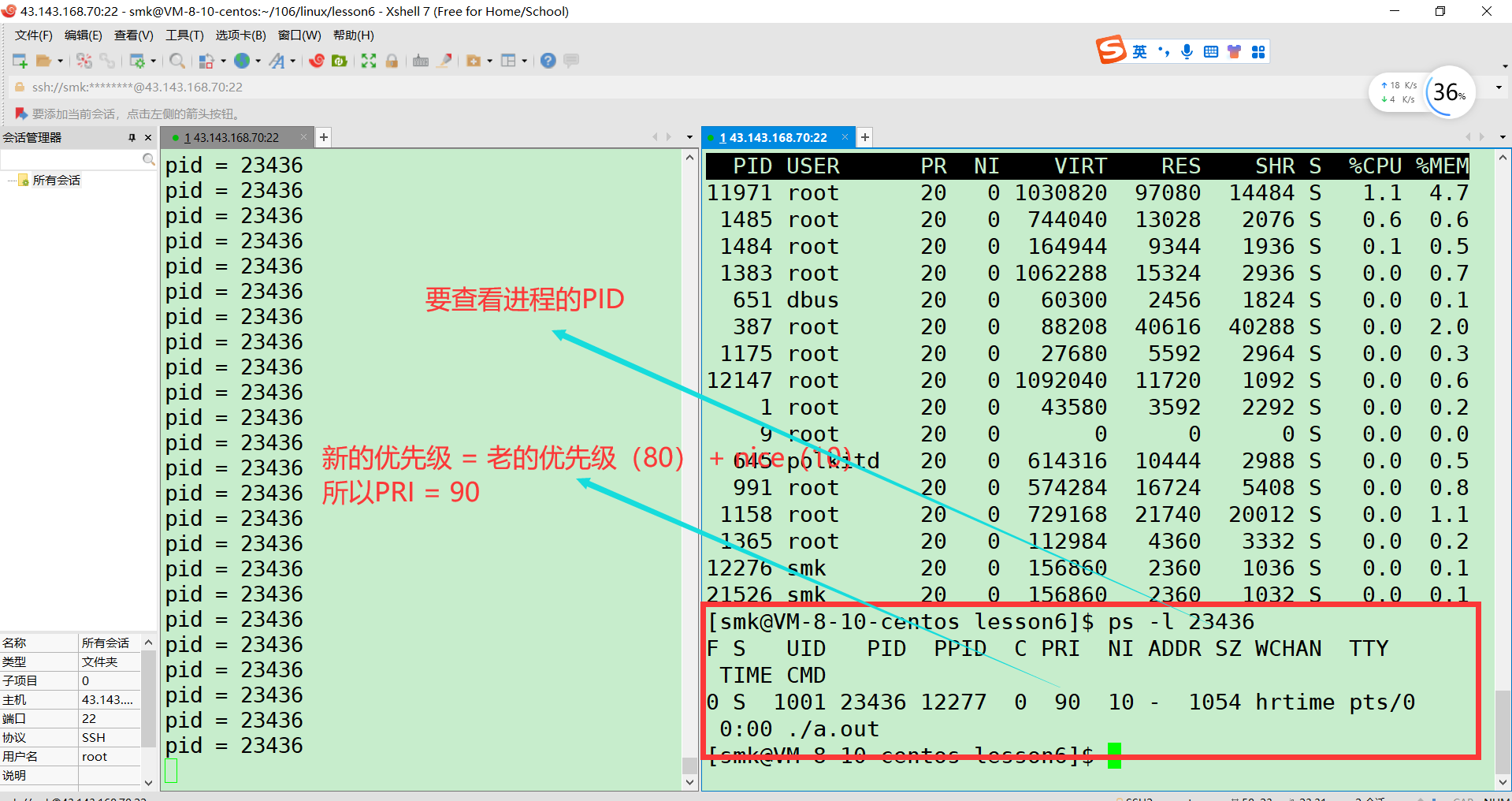

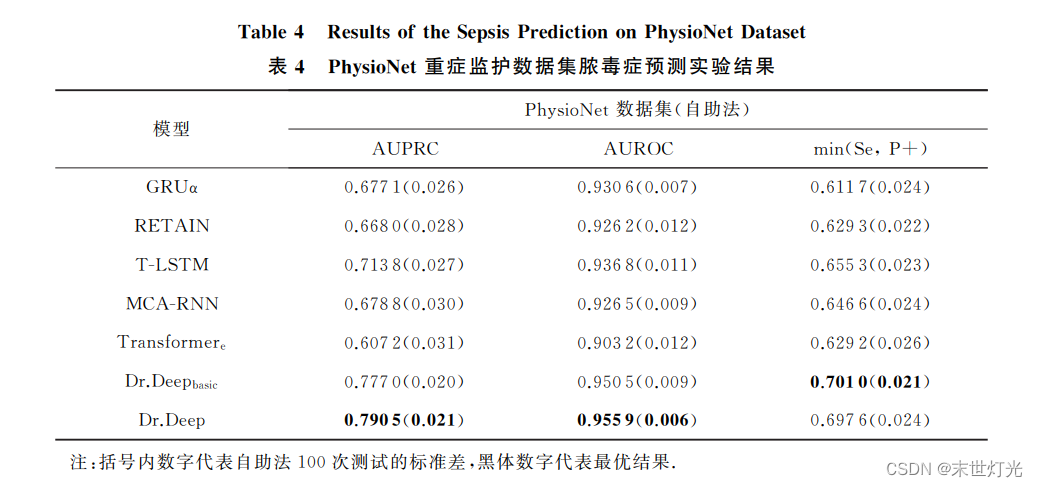

1)重症监护开放数据集(PhysioNetChallenge) 的脓毒症预测实验中,与医疗时序分析领域经典最佳基准模 型 TGLSTM(SIGKDD)相 比,Dr.Deep 在精准召回率曲线下面积(areaunderprecisionrecall curve,AUPRC)指标实现了10.7%的相对性能提 升,min(Se,P+)指标实现了6.4% 的相对提升.

2)同济医院开放的新冠肺炎重症监护患者数 据集出院时间预测实验中,此方法相比最佳基准模 型在均方误差(meansquareerror,MSE)和平均绝 对误差(meanabsoluteerror,MAE)指标上,分别 实现了18.2% 和5.4%的性能相对提升.

3. 设计并实现了一种基于医疗多变量时序数 据分析的人工智能医生在线临床辅助系统:该系统 可以展示每一位患者的健康状态动态评估结果、预 测依据等.经由医学专家试用系统并查阅医疗文献 验证,本文方法抽取的可解释性符合临床经验.

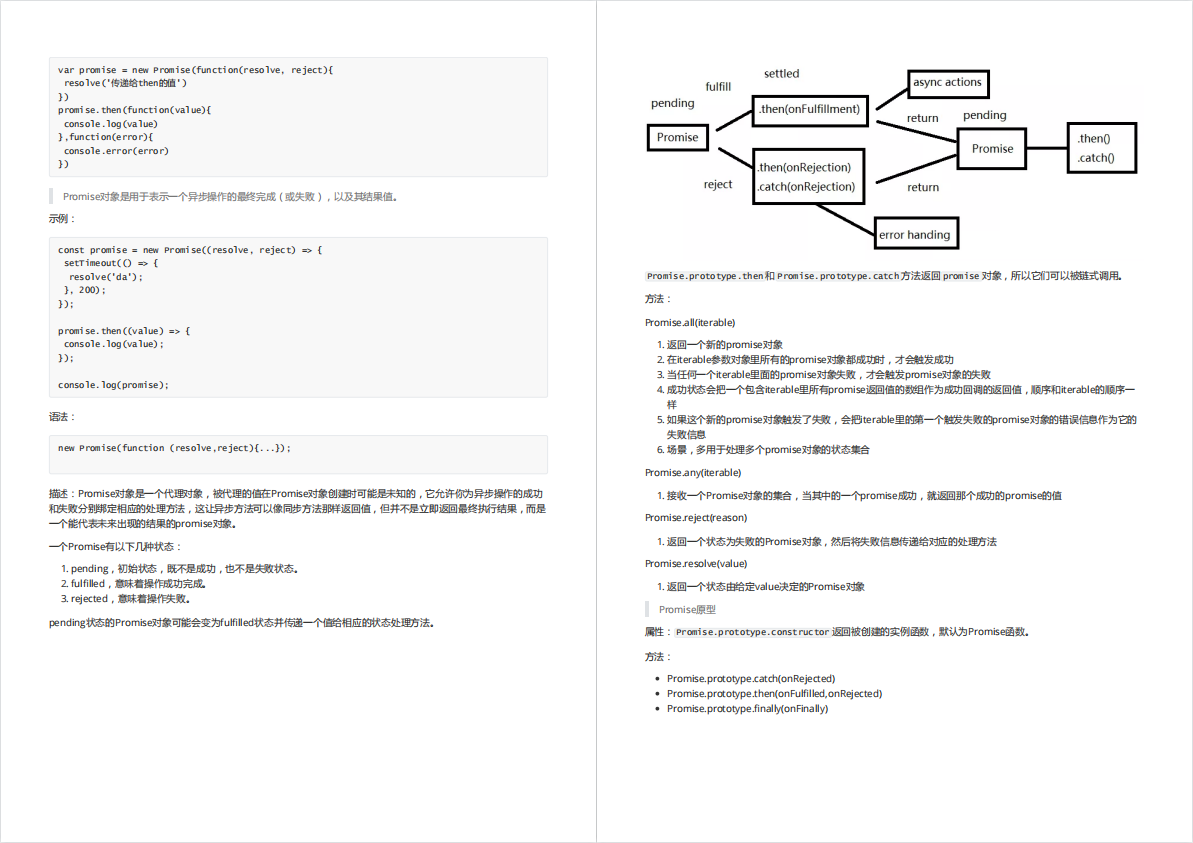

框架图:

思路:

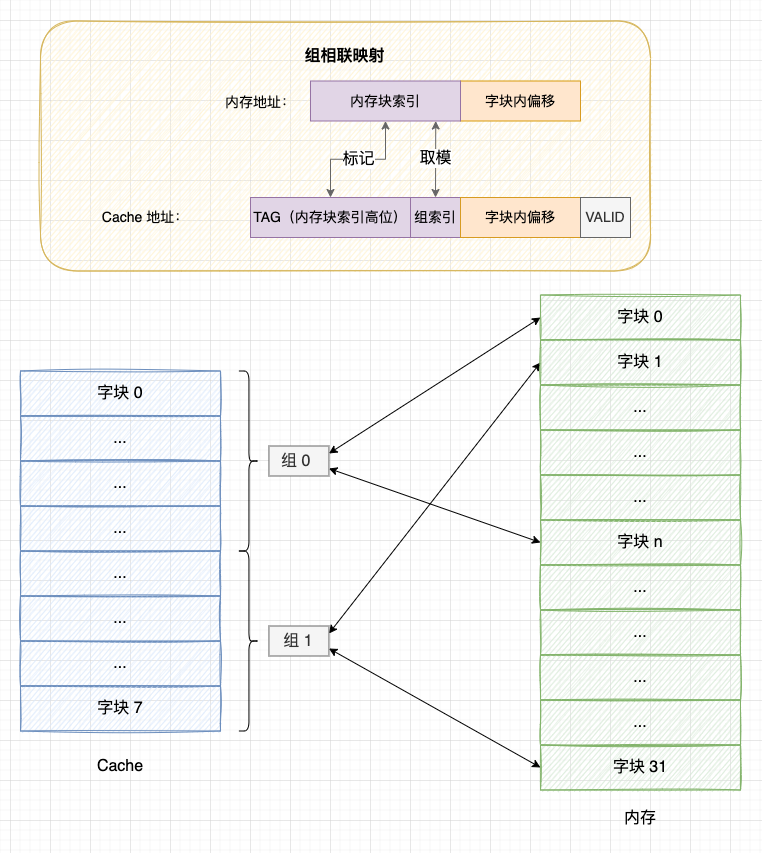

假设病人的动态临床记录由 T 次就诊记录组成.因此,这样的临床序列可以被表述为一个纵向的病人矩阵R,其中一个维度代表医疗特征,另一个维度表示访问时间戳:

多个患者的不同就诊、不同特征数据共同构成一个稀疏的张量.在真实临床应用中,电子病历数据 除时序数据R之外,一般还需要一并分析静态基线信息,包含人口统计信息(如性别、年龄等)和原发疾病(如慢性肾小球肾炎、慢性间质性肾炎等),记为base.

医疗预测的目标是使用EMR数据(即R 和base)来预测病人在治疗过程中是否会出现目标临床结果,表示为y.问题被表述为分类或回归任务,即:

![]()

量化结果:

结论:

针对结构化多变量时序电子病历数据分析工作当中个性化表示学习不足、可解释性缺乏的问题,本文提出了基于特征上下文表示学习的患者健康状态可解释评估方法 Dr.Deep.该方法针对不同患者情况自适应捕捉患者医疗特征上下文并利用去相关策略增强表示学习效果,同时基于压缩激励机制进行特征重要性重标定以输出可解释性因素.在公开数据集 PhysioNet重症监护患者脓毒症预测与同济医院 COVIDG19重症患者出院时间预测任务中,Dr. Deep性能均显著超越最佳基准方法.本文最终设计并实现了人工智能医生在线交互系统,可视化患者的疾病发展路径及模型所动态分析的特征重要性供医学专家参考.