文章目录

- datax 环境搭建使用

- 一、解压文件

- 二、配置 json 文件

- 三、执行命令

datax 环境搭建使用

用于全量同步

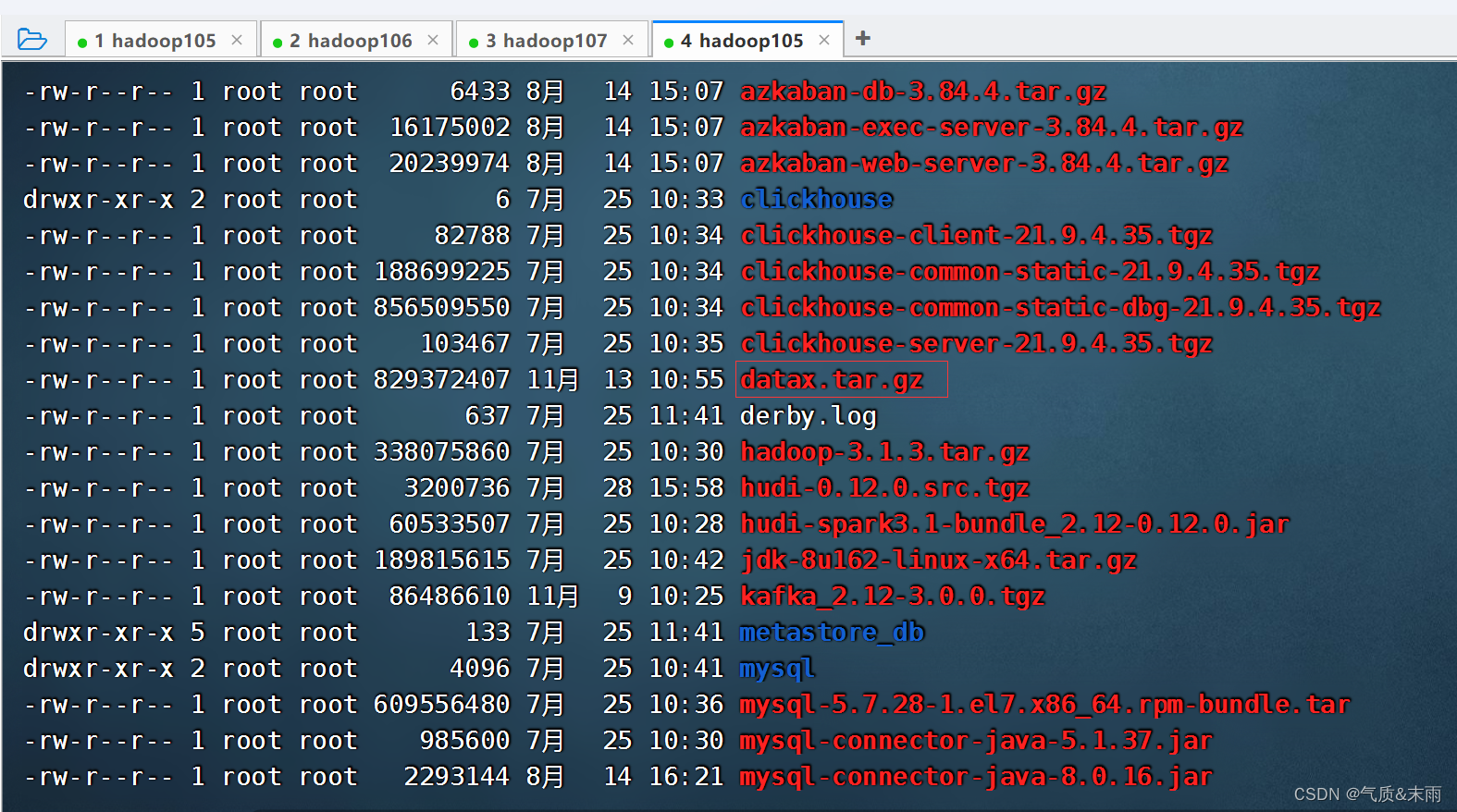

一、解压文件

将包上传至服务器

输入命令: tar -zxvf datax.tar.gz -C /opt/module/ 将包 解压到 /opt/module 目录

解压完之后,不需要任何的配置,直接就可以用

我们可以测试一下,

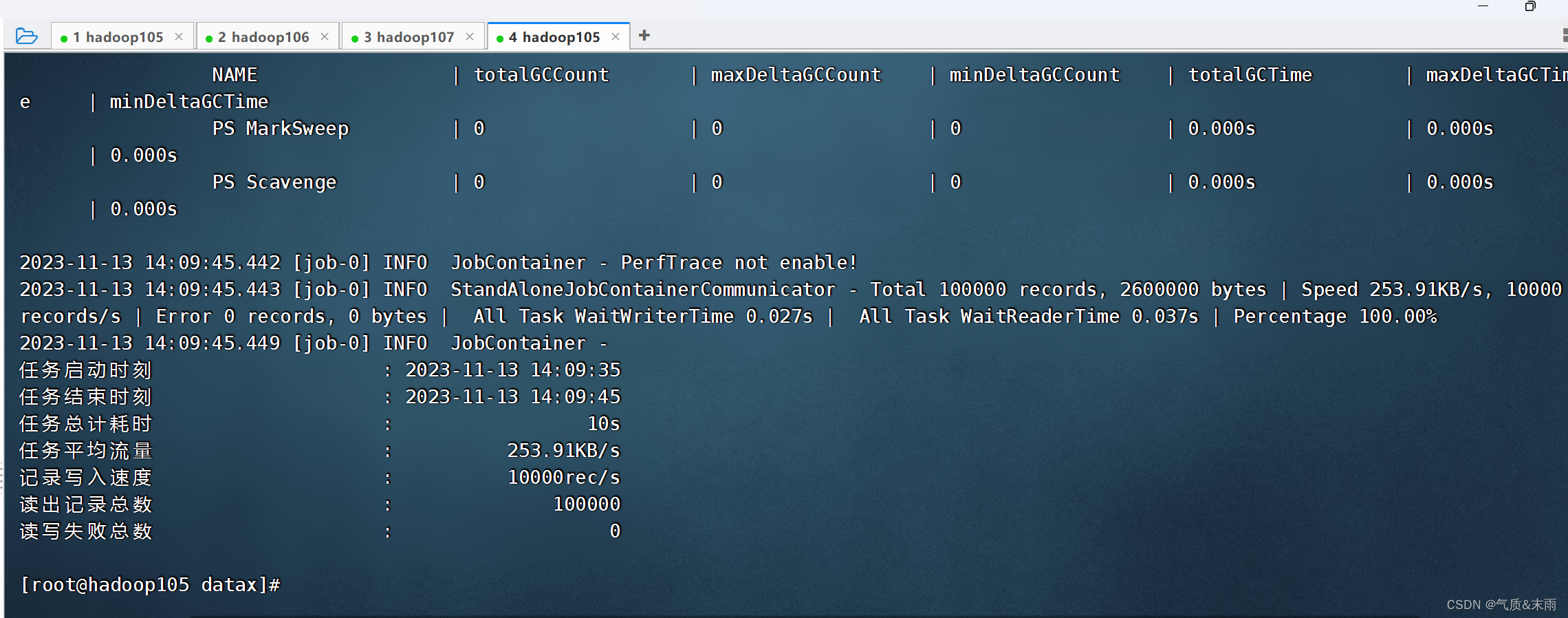

输入命令:/opt/module/datax/bin/datax.py /opt/module/datax/job/job.json 显示这些结果就表示成功了,这里面的 datax.py 文件是已经直接有的了,我们不用管,然后我们写数据只需要 编写 json 文件就可以了。

二、配置 json 文件

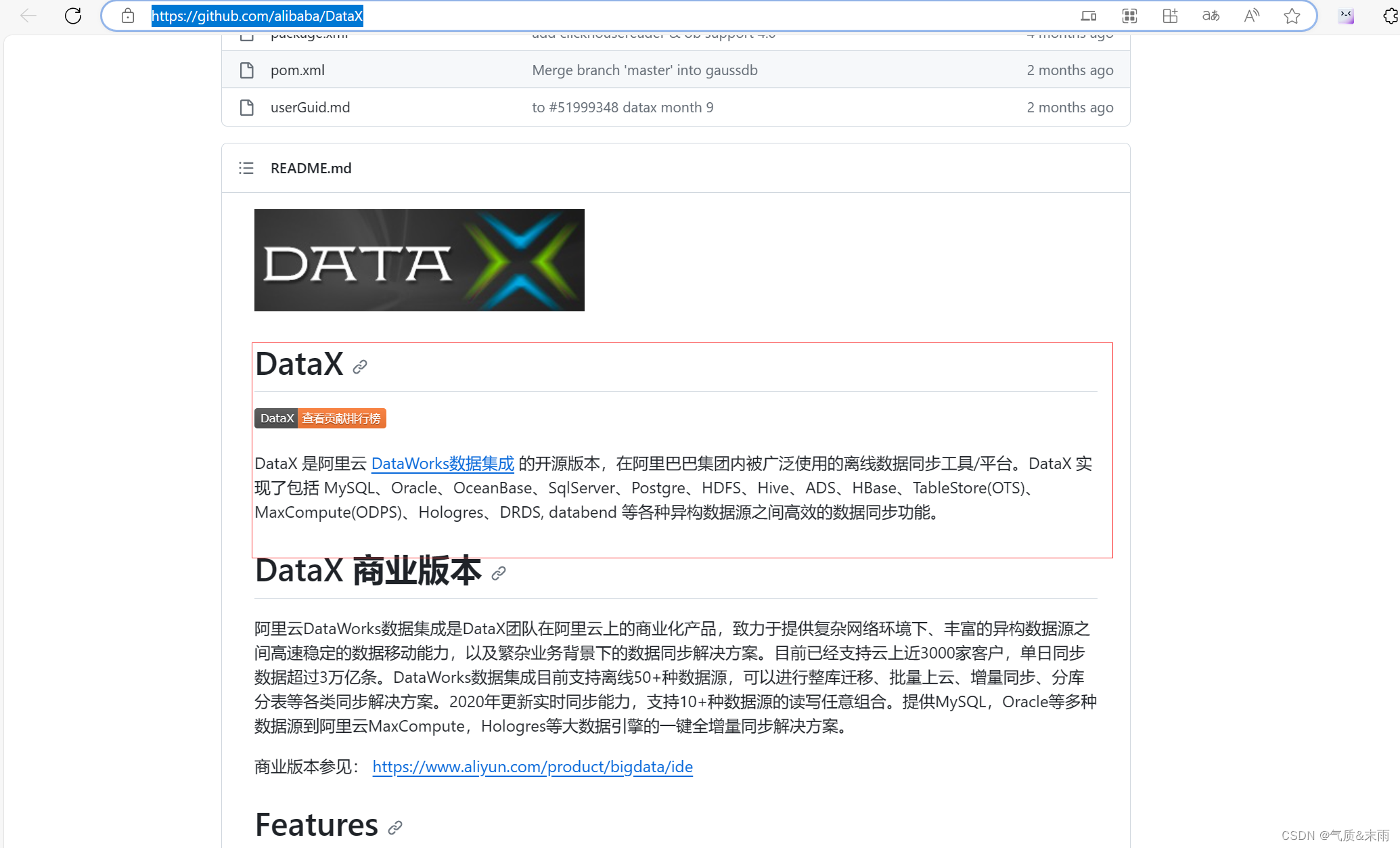

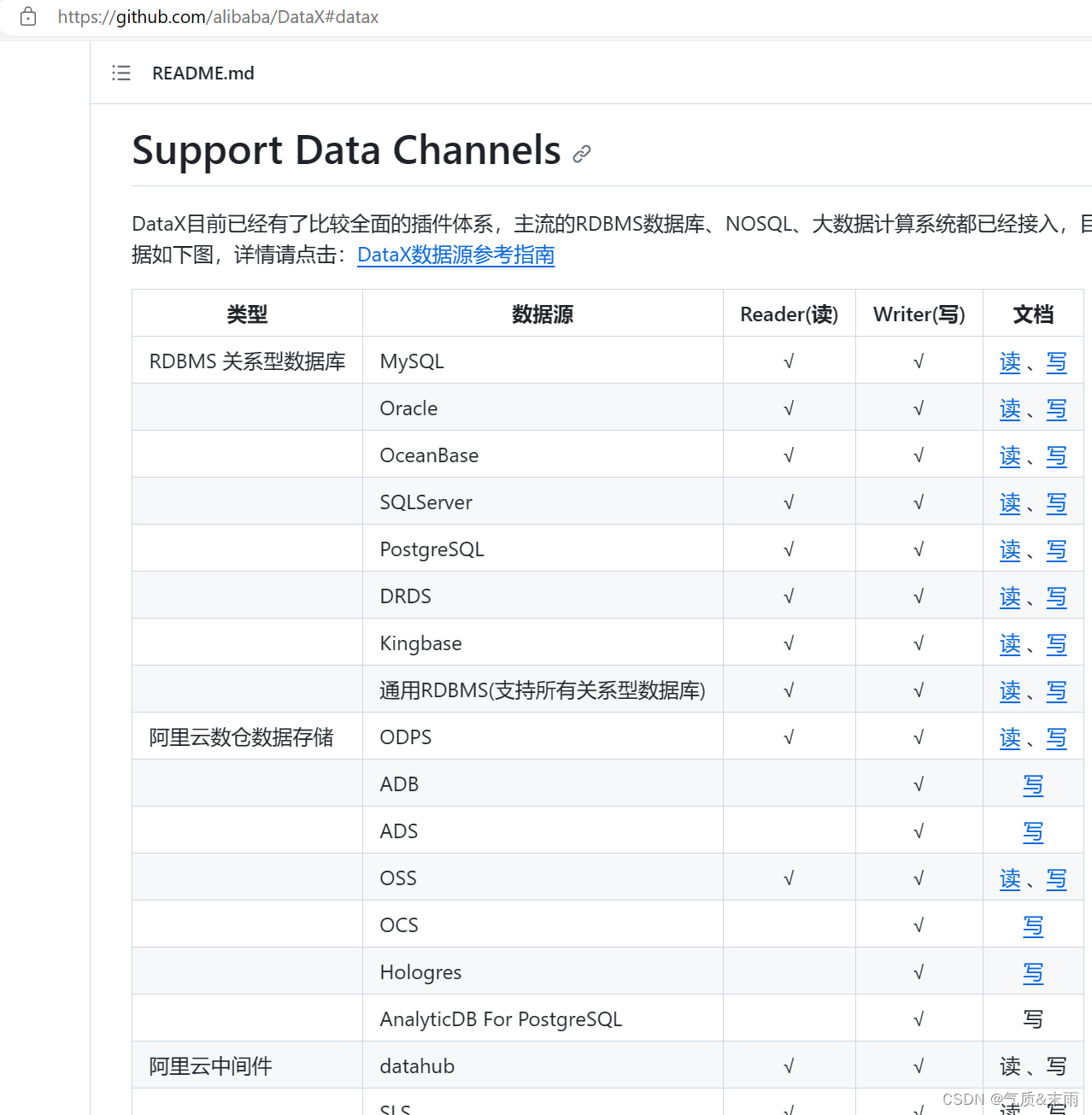

配置文件,可以直接进入这个网站:https://github.com/alibaba/DataX

然后打开之后,往下面翻

有各种读写的配置

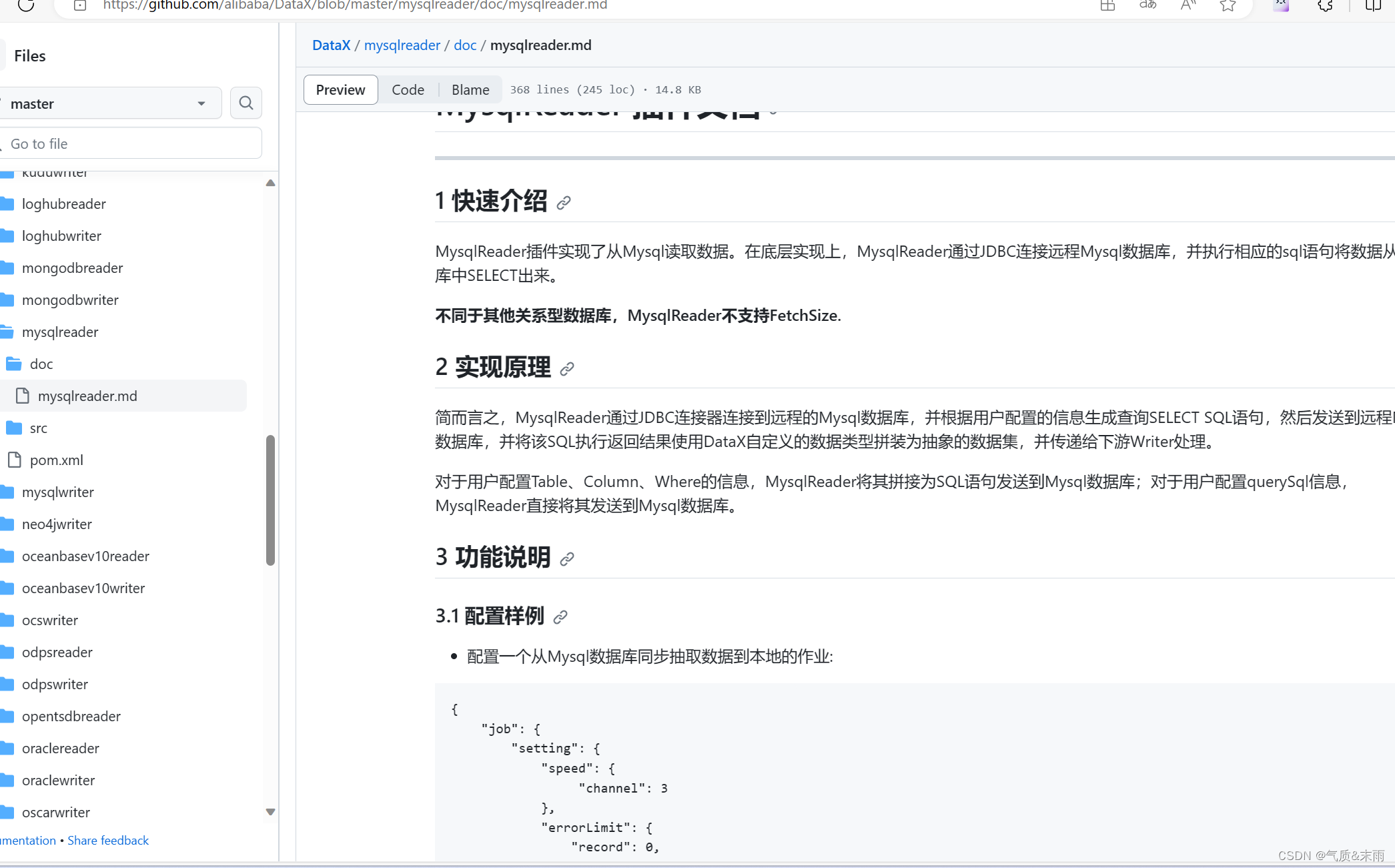

我们就是直接从 mysql 里面读,然后写到 hdfs 上面去,我们直接点 mysql 的读,然后可以查看 mysql 的文档

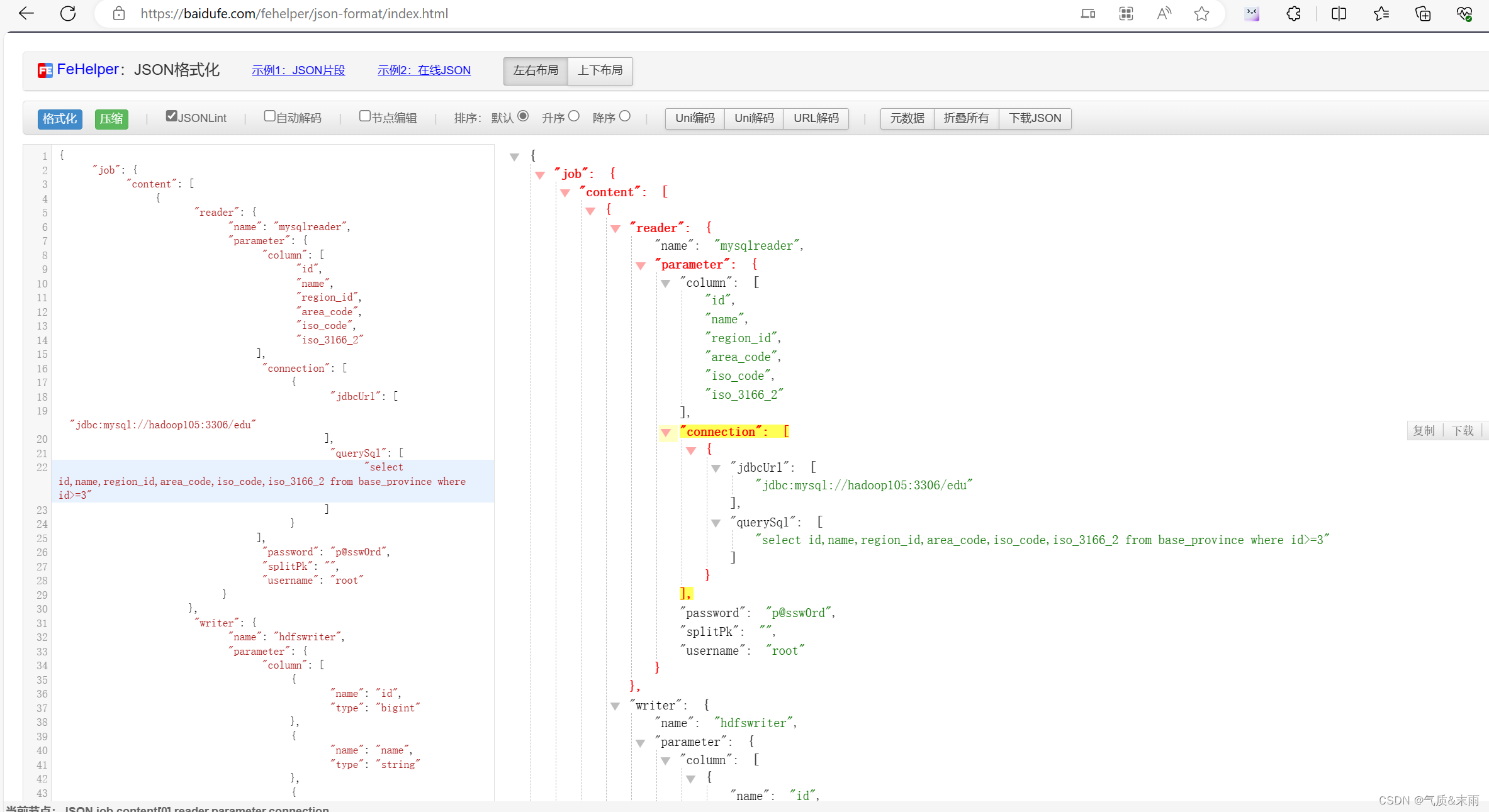

这里有一个,可以编辑 json 格式化的网站:https://baidufe.com/fehelper/json-format/index.html

这上面的json job有两部分,一个是mysql读的配置 mysqlreader 和 hdfswriter 这两个名字是不能随意更改的

这是 用 表的方式导入

{

"job": {

"content": [

{

"reader": {

"name": "mysqlreader",

"parameter": {

"column": [

"id",

"name",

"region_id",

"area_code",

"iso_code",

"iso_3166_2"

],

"connection": [

{

"jdbcUrl": [

"jdbc:mysql://hadoop105:3306/edu"

],

"table": [

"base_province"

]

}

],

"password": "p@ssw0rd",

"splitPk": "",

"username": "root"

}

},

"writer": {

"name": "hdfswriter",

"parameter": {

"column": [

{

"name": "id",

"type": "bigint"

},

{

"name": "name",

"type": "string"

},

{

"name": "region_id",

"type": "string"

},

{

"name": "area_code",

"type": "string"

},

{

"name": "iso_code",

"type": "string"

},

{

"name": "iso_3166_2",

"type": "string"

}

],

"compress": "gzip",

"defaultFS": "hdfs://hadoop105:9000",

"fieldDelimiter": "\t",

"fileName": "base_province",

"fileType": "text",

"path": "/user/hive/warehouse",

"writeMode": "append"

}

}

}

],

"setting": {

"speed": {

"channel": 1

}

}

}

}

这个是querySql方式,用sql的方式导入,建议使用这种,比如有时候需要复杂查询,然后筛选出来的数据再导入进去,然后 文件里面的 hdfs 路径,还有 mysql 连接的配置那些需要配置好。

{

"job": {

"content": [

{

"reader": {

"name": "mysqlreader",

"parameter": {

"column": [

"id",

"name",

"region_id",

"area_code",

"iso_code",

"iso_3166_2"

],

"connection": [

{

"jdbcUrl": [

"jdbc:mysql://hadoop105:3306/edu"

],

"querySql": [

"select id,name,region_id,area_code,iso_code,iso_3166_2 from base_province where id>=3"

]

}

],

"password": "p@ssw0rd",

"splitPk": "id",

"username": "root"

}

},

"writer": {

"name": "hdfswriter",

"parameter": {

"column": [

{

"name": "id",

"type": "bigint"

},

{

"name": "name",

"type": "string"

},

{

"name": "region_id",

"type": "string"

},

{

"name": "area_code",

"type": "string"

},

{

"name": "iso_code",

"type": "string"

},

{

"name": "iso_3166_2",

"type": "string"

}

],

"compress": "gzip",

"defaultFS": "hdfs://hadoop105:9000",

"fieldDelimiter": "\t",

"fileName": "base_province",

"fileType": "text",

"path": "${targetdir}",

"writeMode": "append"

}

}

}

],

"setting": {

"speed": {

"channel": 3

}

}

}

}

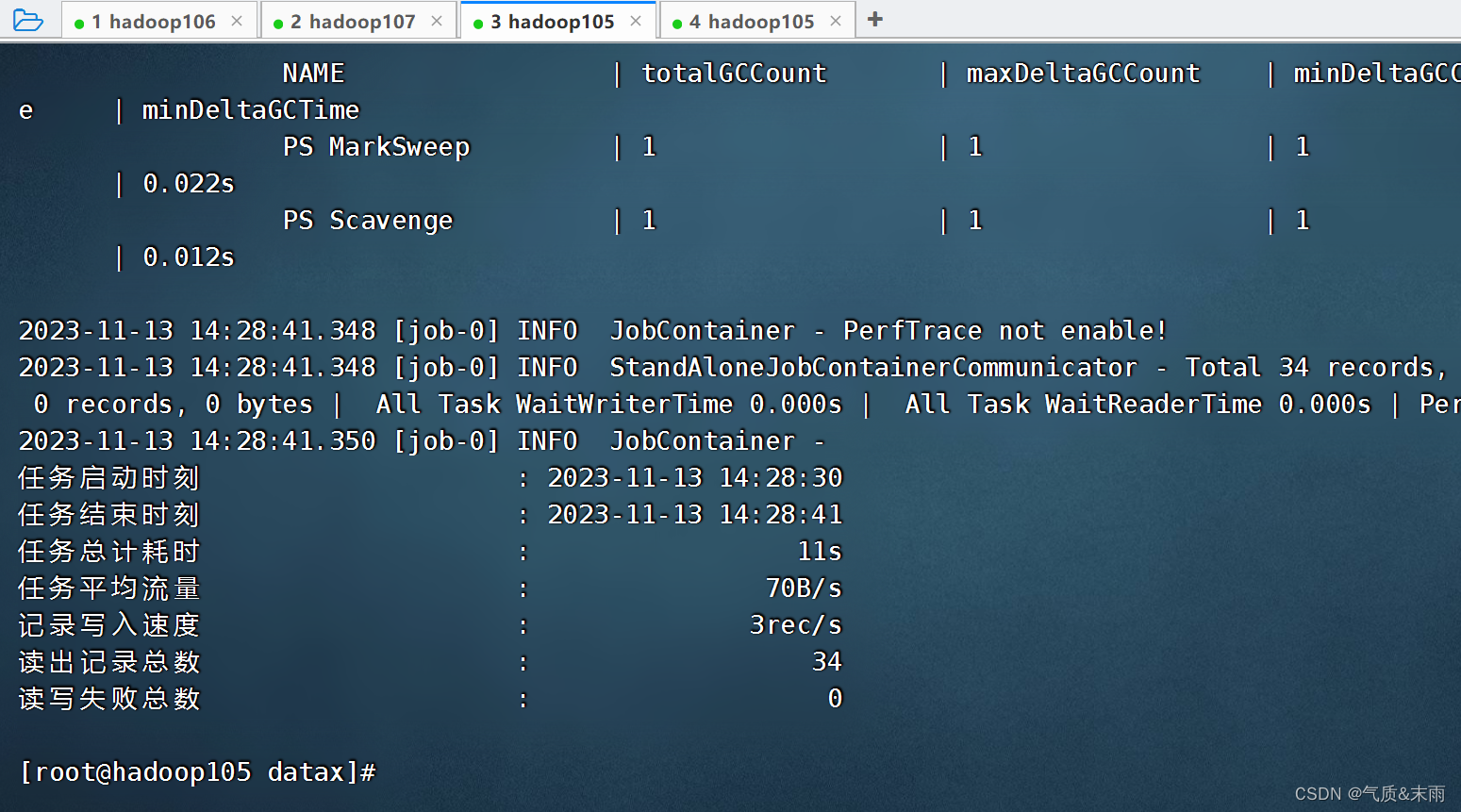

三、执行命令

我们将 json 文件写好之后,我们可以执行了

输入命令:/opt/module/datax/bin/datax.py /opt/module/datax/job/base_province.json

运行成功

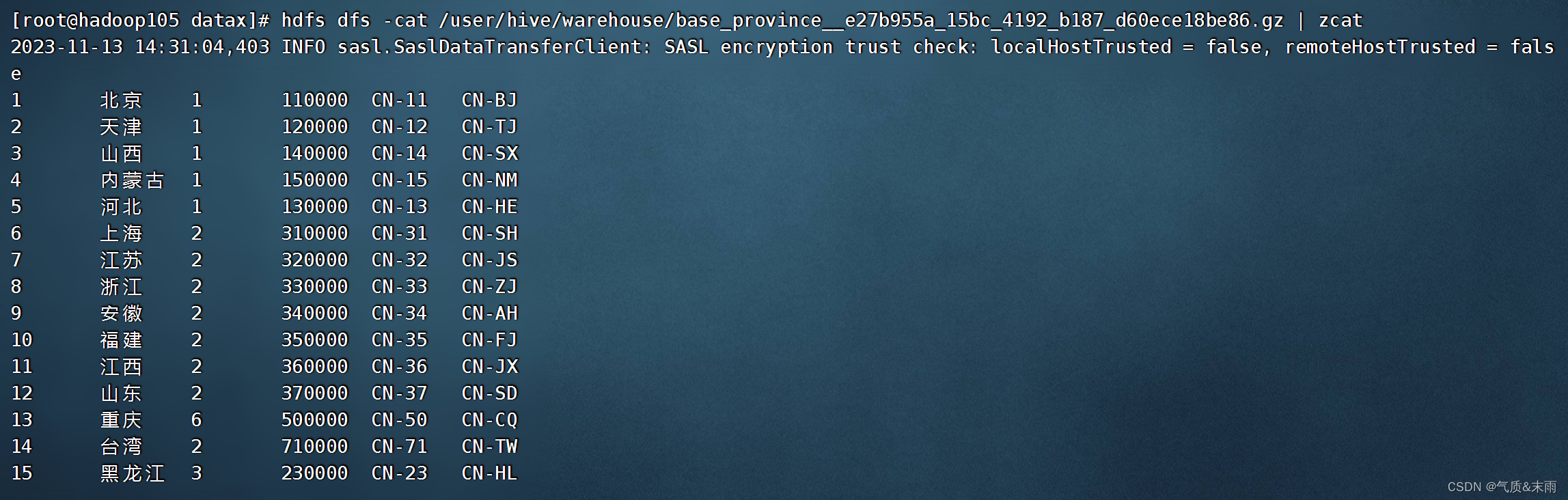

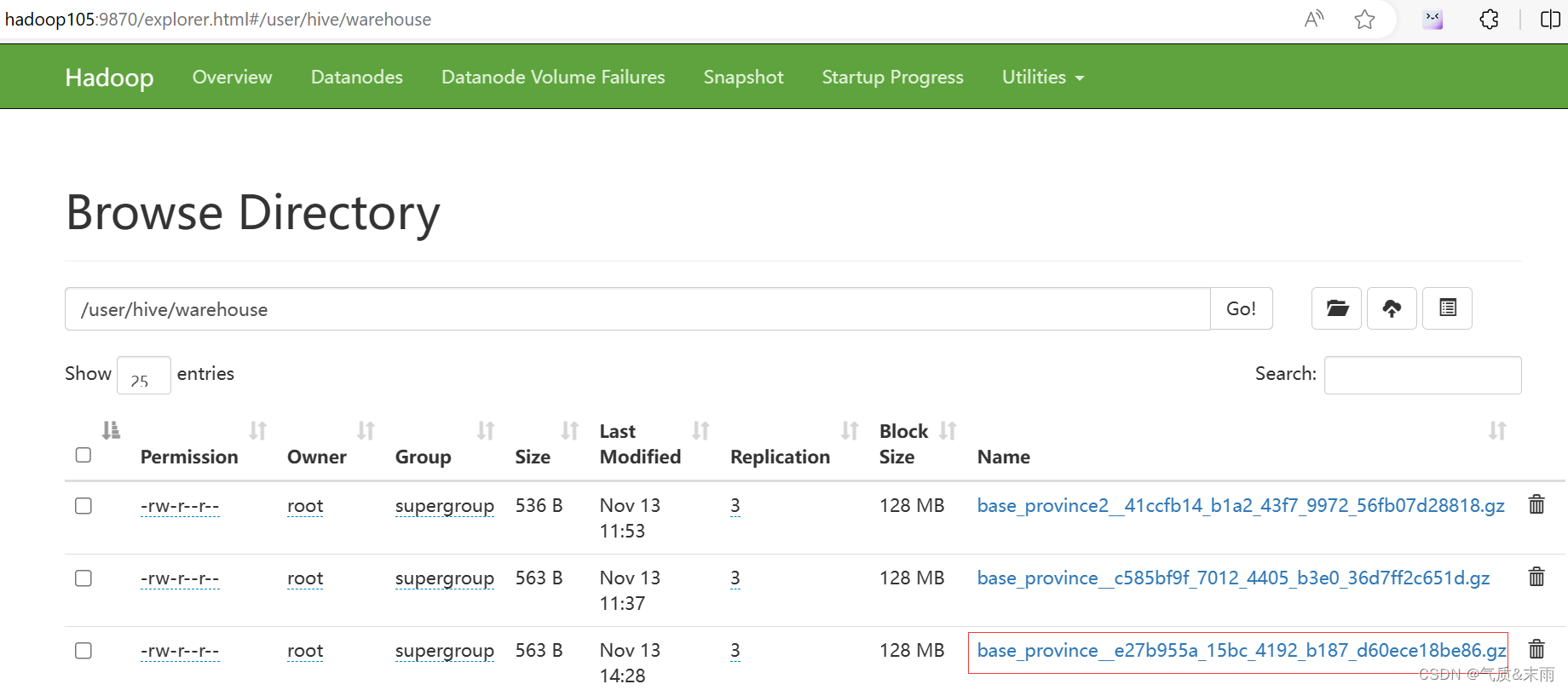

然后我们在 去查看一下hdfs 查看一下文件

然后我们来读取一下,查看里面的数据

输入命令:hdfs dfs -cat /user/hive/warehouse/base_province__e27b955a_15bc_4192_b187_d60ece18be86.gz | zcat