一、实验目的

通过本实验,旨在使用朴素贝叶斯算法实现垃圾邮箱分类,并能够理解并掌握以下内容:

了解朴素贝叶斯算法的基本原理和应用场景。

学习如何对文本数据进行预处理,包括去除标点符号、转换为小写字母、分词等操作。

理解特征提取的概念,掌握常见的特征提取方法,如词袋模型和TF-IDF。

学会使用Python中的机器学习库(如scikit-learn)来实现朴素贝叶斯分类器。

掌握如何评估分类器的性能,包括准确率、召回率和F1值等指标。

实践使用训练好的分类器对新的未知邮件进行分类预测。

通过完成本实验,将能够应用朴素贝叶斯算法解决文本分类问题,特别是垃圾邮箱分类。这种技术在实际生活中有广泛的应用,可以帮助我们自动过滤垃圾邮件,提高工作和生活的效率。此外,通过实践,你还将加深对机器学习算法和文本处理技术的理解和应用能力,为进一步探索更复杂的机器学习问题打下基础。

二、设备与环境

Jupyter notebook

Python=3.9

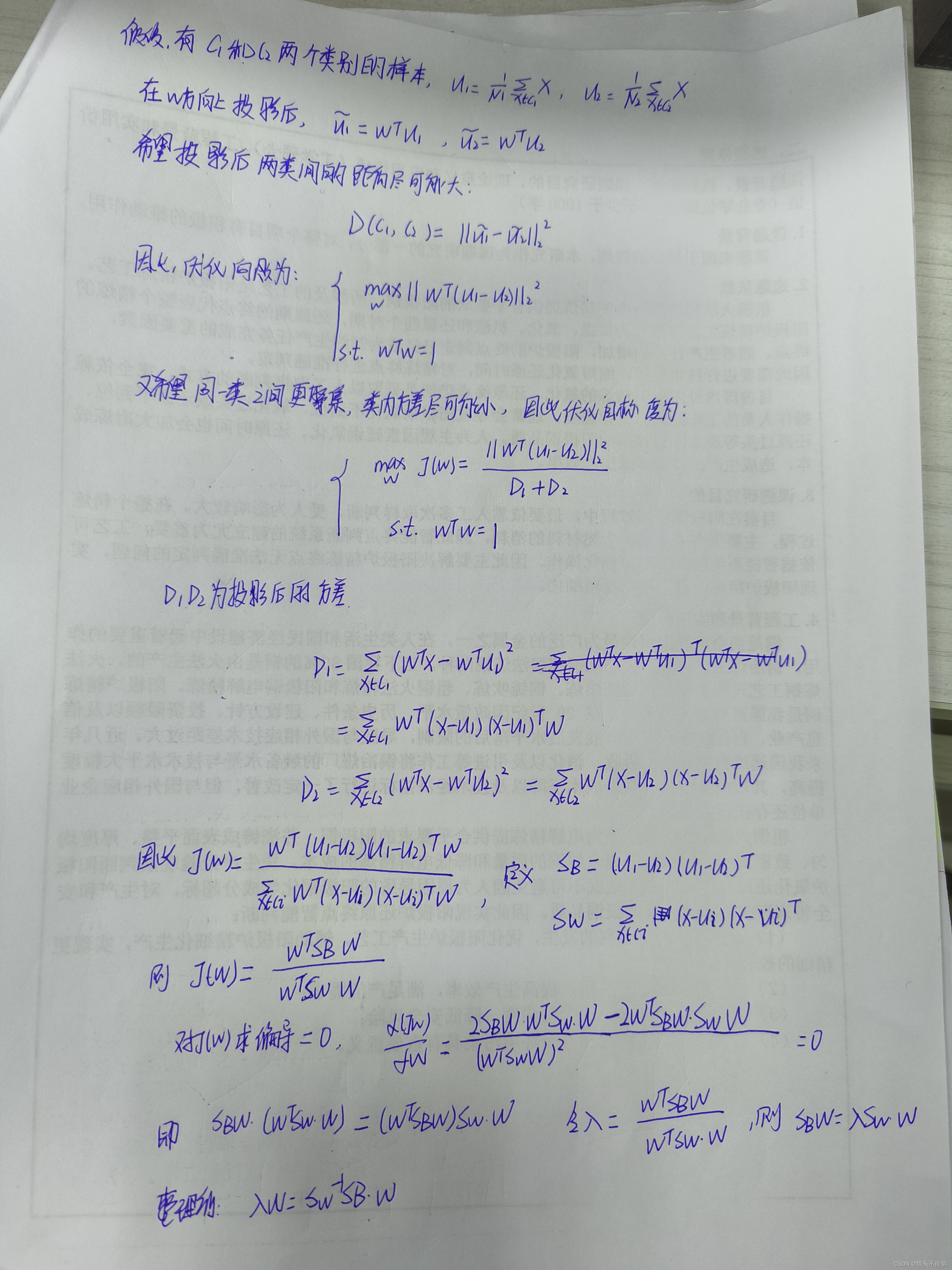

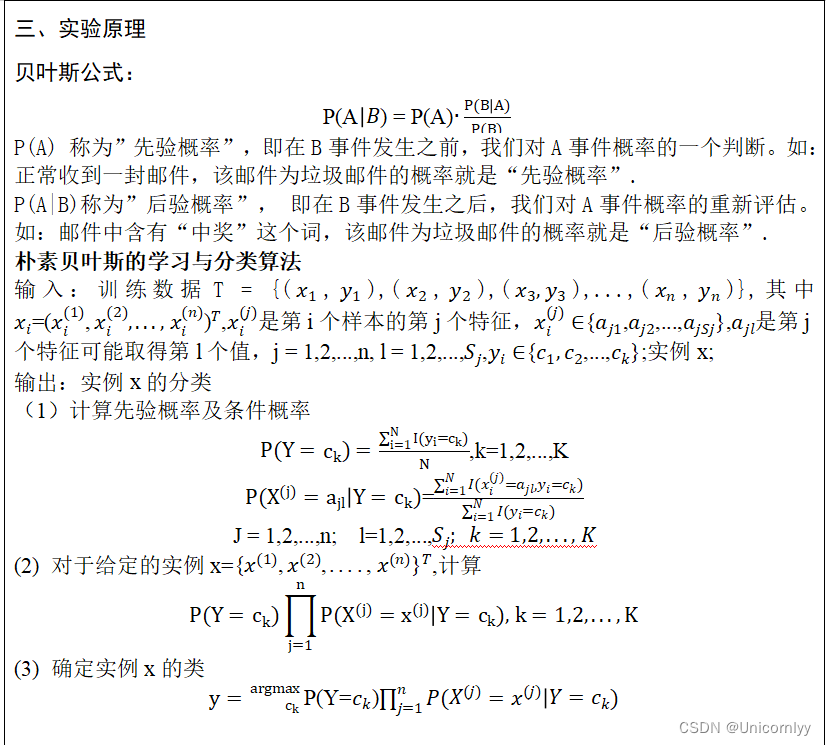

三、实验原理

四、实验内容

步骤1:准备数据集

首先,我们需要准备一个用于训练和测试朴素贝叶斯分类器的数据集。该数据集应包含标记为“垃圾邮件”和“非垃圾邮件”的电子邮件文本,以及它们对应的分类。

步骤2:数据预处理

在训练和测试之前,我们需要对数据进行预处理,以便将其转换为适合朴素贝叶斯算法使用的格式。这包括将文本数据转换为数字格式,去除停用词,进行词干提取等操作。

步骤3:训练模型

使用准备好的训练数据集,我们可以训练朴素贝叶斯分类器。训练过程包括计算“垃圾邮件”和“非垃圾邮件”的先验概率,以及每个单词在每个类别中出现的条件概率。

步骤4:测试模型

测试集是用于评估模型性能的独立数据集。我们将在测试集上测试训练好的朴素贝叶斯分类器,并计算其准确性、召回率、F1得分等指标,以评估其性能。

步骤5:模型应用

在完成训练和测试后,我们可以将训练好的朴素贝叶斯分类器应用于新的未知邮件文本,并根据其内容将其分类为“垃圾邮件”或“非垃圾邮件”。

五、实验结果分析

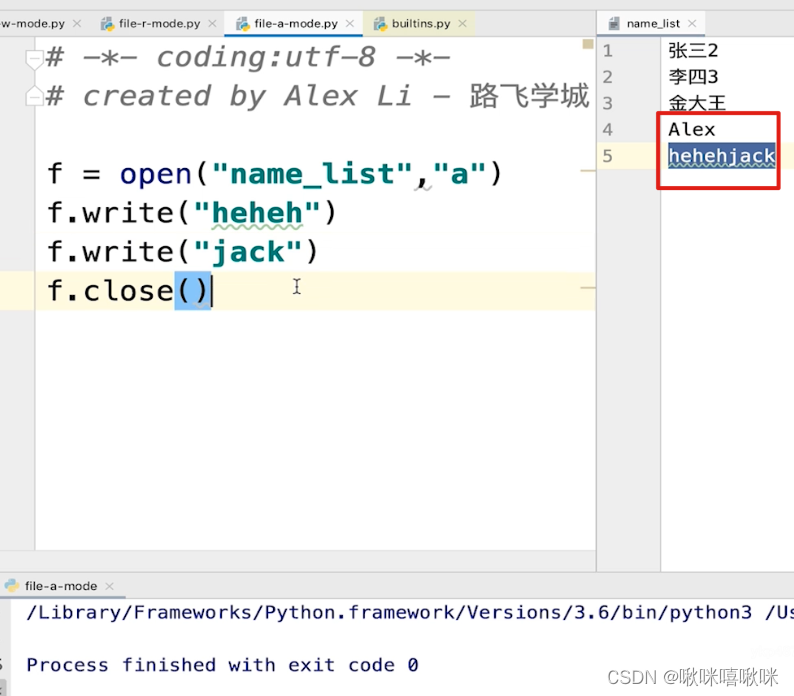

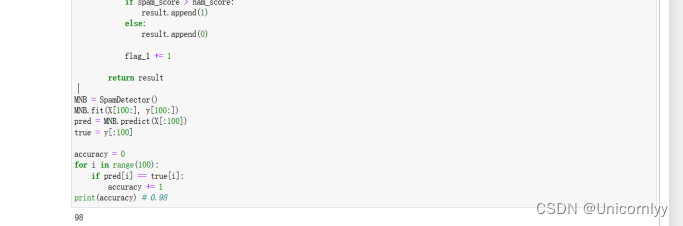

用朴素贝叶斯算法构建了一个垃圾邮件检测器,并对训练集进行训练和对测试集进行预测,最后计算了预测准确率。由下图可知准确率为0.98,表示该垃圾检测器的效果还是很好地。

完整代码及注释

数据集见资源~

#需要导入的包

import os

import re

import string

import math

#数据的读入

DATA_DIR = r'D:\D\Download\360安全浏览器下载\enron Email dataset\enron'

target_names = ['ham', 'spam']

def get_data(DATA_DIR):

subfolders = ['enron%d' % i for i in range(1,7)]

data = []

target = []

for subfolder in subfolders:

# spam

spam_files = os.listdir(os.path.join(DATA_DIR, subfolder, 'spam'))

for spam_file in spam_files:

with open(os.path.join(DATA_DIR, subfolder, 'spam', spam_file), encoding="latin-1") as f:

data.append(f.read())

target.append(1)

# ham

ham_files = os.listdir(os.path.join(DATA_DIR, subfolder, 'ham'))

for ham_file in ham_files:

with open(os.path.join(DATA_DIR, subfolder, 'ham', ham_file), encoding="latin-1") as f:

data.append(f.read())

target.append(0)

return data, target

X, y = get_data(DATA_DIR)#读取数据

#我们读入了所有邮件内容和标签,其中邮件内容存储在data中,标签存储在target当中,“1”表示为垃圾邮件,“0”表示为正常邮件。

#定义一个类对数据进行预处理

class SpamDetector_1(object):

"""Implementation of Naive Bayes for binary classification"""

#清除空格

def clean(self, s):

translator = str.maketrans("", "", string.punctuation)

return s.translate(translator)

#分开每个单词

def tokenize(self, text):

text = self.clean(text).lower()

return re.split("\W+", text)

#计算某个单词出现的次数

def get_word_counts(self, words):

word_counts = {}

for word in words:

word_counts[word] = word_counts.get(word, 0.0) + 1.0

return word_counts

#在我们开始实际算法之前,我们需要做三件事:计算(对数)类先验,即计算P(垃圾邮件)和P(正常邮件);词汇表(即正常邮件和垃圾邮件中出现的所有单词,方便进行拉普拉斯平滑);垃圾邮件和非垃圾邮件的词频,即给定词在垃圾邮件和非垃圾邮件中出现的次数。

class SpamDetector_2(SpamDetector_1):

# X:data,Y:target标签(垃圾邮件或正常邮件)

def fit(self, X, Y):

self.num_messages = {}

self.log_class_priors = {}

self.word_counts = {}

# 建立一个集合存储所有出现的单词

self.vocab = set()

# 统计spam和ham邮件的个数

self.num_messages['spam'] = sum(1 for label in Y if label == 1)

self.num_messages['ham'] = sum(1 for label in Y if label == 0)

# 计算先验概率,即所有的邮件中,垃圾邮件和正常邮件所占的比例

self.log_class_priors['spam'] = math.log(

self.num_messages['spam'] / (self.num_messages['spam'] + self.num_messages['ham']))

self.log_class_priors['ham'] = math.log(

self.num_messages['ham'] / (self.num_messages['spam'] + self.num_messages['ham']))

self.word_counts['spam'] = {}

self.word_counts['ham'] = {}

for x, y in zip(X, Y):

c = 'spam' if y == 1 else 'ham'

# 构建一个字典存储单封邮件中的单词以及其个数

counts = self.get_word_counts(self.tokenize(x))

for word, count in counts.items():

if word not in self.vocab:

self.vocab.add(word)#确保self.vocab中含有所有邮件中的单词

# 下面语句是为了计算垃圾邮件和非垃圾邮件的词频,即给定词在垃圾邮件和非垃圾邮件中出现的次数。

# c是0或1,垃圾邮件的标签

if word not in self.word_counts[c]:

self.word_counts[c][word] = 0.0

self.word_counts[c][word] += count

#可以利用下面的语句进行debug,判断是否运行正确,若正确,log_class_priors of spam应该为-0.6776,log_class_priors of ham应该为-0.7089。

#我们选取了第100封之后的邮件作为训练集,前面一百封邮件作为测试集。

MNB = SpamDetector_2()

# 选取了第100封之后的邮件作为训练集,前面一百封邮件作为测试集

MNB.fit(X[100:], y[100:])

#print("log_class_priors of spam", MNB.log_class_priors['spam']) #-0.6776

#print("log_class_priors of ham", MNB.log_class_priors['ham']) #-0.7089

#定义一个类spamDetector对测试集进行测试,主要的思路是判断lnP(垃圾)+ ,lnP(正常)+进行比较,从而判断是垃圾邮件还是正常邮件

class SpamDetector(SpamDetector_2):

def predict(self, X):

result = []

flag_1 = 0

# 遍历所有的测试集

for x in X:

counts = self.get_word_counts(self.tokenize(x)) # 生成可以记录单词以及该单词出现的次数的字典

spam_score = 0

ham_score = 0

flag_2 = 0

for word, _ in counts.items():

if word not in self.vocab: continue

#下面计算P(内容|垃圾邮件)和P(内容|正常邮件),所有的单词都要进行拉普拉斯平滑

else:

# 该单词存在于正常邮件的训练集和垃圾邮件的训练集当中

if word in self.word_counts['spam'].keys() and word in self.word_counts['ham'].keys():

log_w_given_spam = math.log(

(self.word_counts['spam'][word] + 1) / (sum(self.word_counts['spam'].values()) + len(self.vocab)))

log_w_given_ham = math.log(

(self.word_counts['ham'][word] + 1) / (sum(self.word_counts['ham'].values()) + len(

self.vocab)))

# 该单词存在于垃圾邮件的训练集当中,但不存在于正常邮件的训练集当中

if word in self.word_counts['spam'].keys() and word not in self.word_counts['ham'].keys():

log_w_given_spam = math.log(

(self.word_counts['spam'][word] + 1) / (sum(self.word_counts['spam'].values()) + len(self.vocab)))

log_w_given_ham = math.log( 1 / (sum(self.word_counts['ham'].values()) + len(

self.vocab)))

# 该单词存在于正常邮件的训练集当中,但不存在于垃圾邮件的训练集当中

if word not in self.word_counts['spam'].keys() and word in self.word_counts['ham'].keys():

log_w_given_spam = math.log( 1 / (sum(self.word_counts['spam'].values()) + len(self.vocab)))

log_w_given_ham = math.log(

(self.word_counts['ham'][word] + 1) / (sum(self.word_counts['ham'].values()) + len(

self.vocab)))

# 把计算到的P(内容|垃圾邮件)和P(内容|正常邮件)加起来

spam_score += log_w_given_spam

ham_score += log_w_given_ham

flag_2 += 1

# 最后,还要把先验加上去,即P(垃圾邮件)和P(正常邮件)

spam_score += self.log_class_priors['spam']

ham_score += self.log_class_priors['ham']

# 最后进行预测,如果spam_score > ham_score则标志为1,即垃圾邮件

if spam_score > ham_score:

result.append(1)

else:

result.append(0)

flag_1 += 1

return result

MNB = SpamDetector()

MNB.fit(X[100:], y[100:])

pred = MNB.predict(X[:100])

true = y[:100]

accuracy = 0

for i in range(100):

if pred[i] == true[i]:

accuracy += 1

print(accuracy) # 0.98