pdf | code

- 将3D人脸风格化问题拆分为几何风格化与纹理风格化。

- 提出StyleField,学习以风格/ID为控制信号的几何形变残差,实现几何风格化。通过对超分网络引入AdaIN,实现纹理风格化。

- 由于没有修改3D GAN空间,因此可以便捷实现Editing和Animation。

目录

摘要

方法

Geometry Toonification with StyleField

Texture Transfer with Adaptive Style Mixing

Training

实验

实验设置

Comparisons with Baselines

Applications

Inversion and Editing

Animatable Toonification

Toonification Style Control

摘要

- 3D人脸风格化;

- 3D GAN直接在艺术域(artistic domain)上fine-tuning,效果不错。但存在两个问题:1)会破坏3D GAN原有的隐空间,影响后续的语义编辑;2) 每种新风格需要额外训练,限制了部署。

- 为了解决上述两个问题,本文提出DeformToon3D。本文方法将3D卡通化(toonification)问题,分解为几何与纹理风格化。

- 本文提出StyleField,预测条件控制的3D形变(conditional 3D deformation),实现几何风格化;通过3D GAN的decoder实现纹理风格化。

方法

- DeformToon3D是一个堆叠模型 G = G1 o G0,其中G1是3D生成器,G2是2D超分解码器。G0输入instance code

和相机位姿

,和体渲染输出为中间特征图

。G1将

超分得到高分辨率图片

。

- 在考虑3D人脸卡通化时,现有方法将G视作一个整体进行fine-tune。DeformToon3D用StyleField作为几何风格化,fine-tune体渲染器实现纹理风格化。

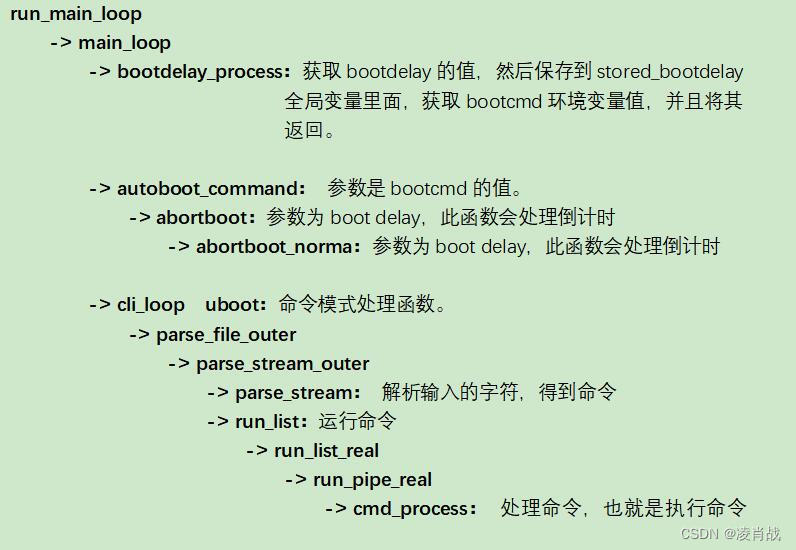

Geometry Toonification with StyleField

直接用跨域数据fine-tune G0,计算开销大且会破坏GAN的隐空间。

假设风格化NeRF是,真实域NeRF是

。本文冻结G0参数,并提出StyleField模块学习

到

的映射关系。

具体来说,假设中的任意3维点

,StyleField学习

到

中

的映射关系:

![]()

其中,是StyleField,受style code

和instance code

控制,前者决定风格,后者决定3D face的ID。

由4层SIREN组成,支持多种风格变换。相较于直接fine-tune G0,优化参数量减少了50%,同时还保留了3D GAN原有隐空间。在10种风格情况下,相较每种风格fine-tune一个G0,节省了98.5%的存储空间。

Texture Transfer with Adaptive Style Mixing

G0和StyleField实现了风格的几何变换。在此基础上,本文在超分网络G1实现风格的纹理变换。

G1是2D style-based architecture。本文通过AdaIN来逐步调整图片风格。

受style mixing启发,通过混合G1网络参数和目标风格,实现纹理信息的注入。

本文同时添加了一个轻量级MLP ,输入为

、

和w,调整风格强度。

Training

本文通过DualStyleGAN产生2D风格图像;

训练中,使用LPIPS loss作为重建损失;使用smoothness,确保是物理平滑的;同时,使用了GAN的对抗训练损失。

![]()

实验

实验设置

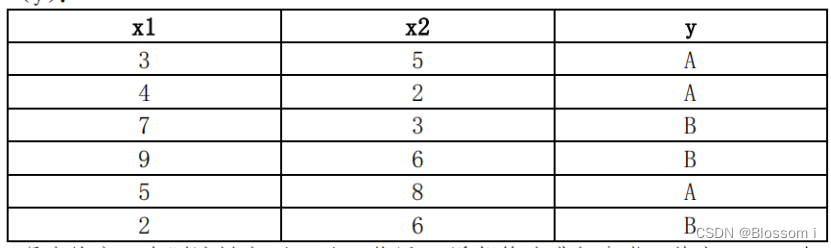

- Datasets:测试了10种风格:Pixar, Comic, Slam Dunk, The Croods, Fiona (Shrek), Rapunzel (Disney Princess), Hiccup Horrendous Haddock III (How To Train Your Dragon), and three different carica-ture styles;在CelebA-HQ上测试;

- Model:使用在FFHQ上预训练的StyleSDF作为3D GAN;

- Training:在8张V100上训练了24小时,bs=16;

- Baselines:和CIPS-3D、E3DGE、StyleGAN-NADA进行比较

Comparisons with Baselines

Applications

Inversion and Editing

使用E3DGE实现3D GAN inversion

Animatable Toonification

学习3DMM参数和3D GAN隐空间的双向映射关系。通过驱动视频拿到3DMM参数的变化,并映射回3D GAN中

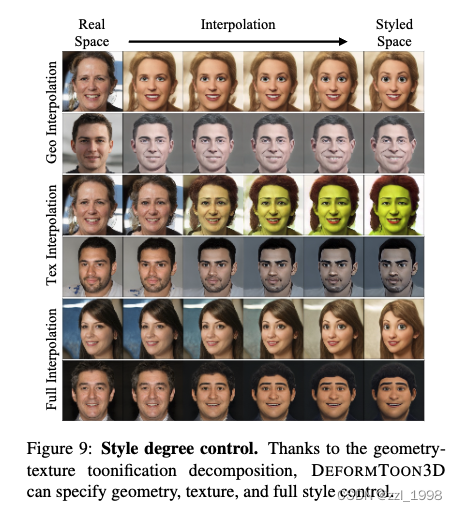

Toonification Style Control

![[idekCTF 2022]Paywall - LFI+伪协议+filter_chain](https://img-blog.csdnimg.cn/de16862f4dd14596a4c4862588715032.png#pic_center)