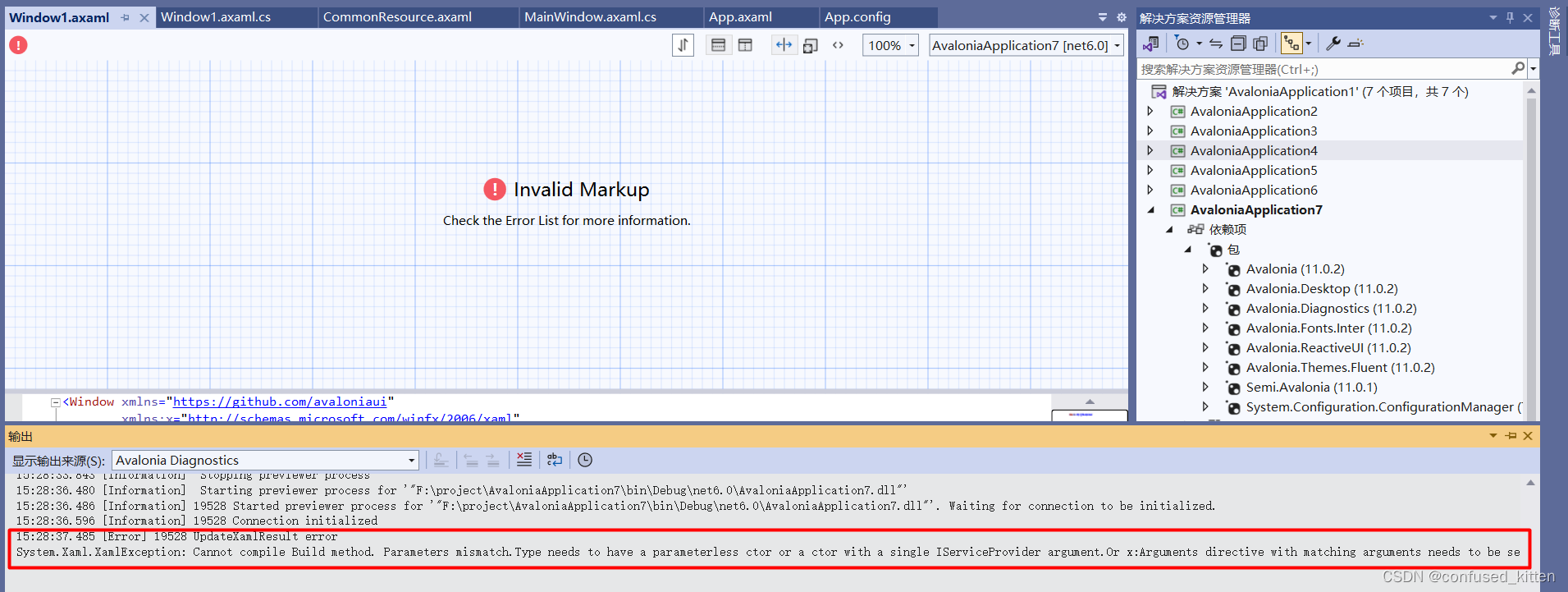

Ingress

- 一、作用

- 二、使外部应用能够访问集群内服务方案

- 1.NodePort

- 2.LoadBalancer

- 3.externalIPs

- 4.Ingress

- 三、Ingress的组成

- 1.ingress:nginx配置文件

- 2.ingress-controller: 当作反向代理或者说是转发器

- 四、Ingress工作原理

- 五、ingress暴露服务的方式

- 方式一:Deployment+LoadBalance模式的Service

- 方式二:DaemonSet+HostNetwork+nodeSelector

- 方式三: Deployment+NodePort模式的service

- 六、Ingress实验

- 部署 nginx-ingress-controller

- 1、部署ingress-controller pod及相关资源

- 2、修改 ClusterRole 资源配置

- 采用方式二:DaemonSet+HostNetwork+nodeSelector

- 3、指定 nginx-ingress-controller 运行在 node02 节点

- 4、修改 Deployment 为 DaemonSet ,指定节点运行,并开启 hostNetwork 网络

- 5.修改 kind

- 6. 删除Replicas

- 7、在所有 node 节点上传 nginx-ingress-controller 镜像压缩包 ingree.contro.tar.gz 到 /opt/ingress 目录,并解压和加载镜像

- 8、启动 nginx-ingress-controller

- 9.到 node02 节点查看

- 10、创建 ingress 规则

- 创建一个 deploy 和 svc

- 创建 ingress

- 方法一:(extensions/v1beta1 Ingress 在1.22版本即将弃用)

- 方法二:

- 11.

- 12、查看 nginx-ingress-controller

一、作用

1.对集群内部:不断跟踪pod的变化,更新endpoint中对应pod的对象,提供了ip不断变化pod的服务发现机制

2.对集群外部:类似负载均衡器,可以在集群内外部对pod进行访问

在k8s中,pod的ip地址和service的ClusterIP仅可以在集群网络内部使用,对于集群外的应用是不可用的。

二、使外部应用能够访问集群内服务方案

1.NodePort

将service暴露在节点网络上,NodePort背后就是Kube-Proxy,Kube-proxy是沟通service网络、pod网络和节点网络的桥梁

(注意:测试环境还行,当有几十上百的服务在集群中运行时,NodePort的端口管理就是灾难。因为每个端口只能是一种服务,端口范围只能是30000-32767)

2.LoadBalancer

通过设置LoadBalancer映射到云服务商提供的LoadBanlancer地址。这种用法仅用于在公有云服务提供商的平台上设置Service的场景。受限于云平台,且通常在云平台部署LoadBalancer还需要额外的费用。

在service提交后,Kubernetes就会调用CloudProvider在公有云上为你创建一个负载均衡服务,并且把被代理的Pod的IP地址配置给负载均衡服务做后端。

3.externalIPs

service允许为其分配外部IP,如果外部IP路由到集群中一个或多个Node上,Service会被暴露给这些externalIPs。通过外部IP进入到集群的流量,将会北路有到Service的Endpoint上。

4.Ingress

只需要一个或者商量的公网IP和LB,即可同时即将多个HTTP服务暴露到外网,七层反向代理。可以简单理解为service的service,它其实就是一组基于域名和URL路径,把用户的请求转发到一个或多个service的规则。

三、Ingress的组成

1.ingress:nginx配置文件

ingress是一个API对象,通过yaml文件来配置,ingress对象的作用就是定义请求如何转发到service的规则,可以理解为配置模板

ingress通过http或https暴露集群内部service,给service提供外部URL、负载均衡、SSL/TLS以及基于域名的反向代理。ingress要依靠ingress-controller来具体实现以上功能

2.ingress-controller: 当作反向代理或者说是转发器

ingress-controller并不是k8s自带的组件,实际上ingress-controller只是一个统称,用户可以选择不同的ingress-controller实现,目前,由k8s维护的ingress-controller只有google云的GCE与ingress-nginx两个,其他还有很多第三方维护的ingress-controller,具体可以参考官方文档。但是不管哪一种ingress-controller,实现的机制都大同小异,只是在具体配置上有差异。

一般来说,ingress-controller的形式都是一个pod,里面跑着daemon程序和反向代理程序。daemon负责不断监控集群的变化,根据ingress对象生成配置并应用新配置到反向代理,比如ingress-nginx就是动态生成nginx配置,动态更新upstream,并在需要的时候reload程序应用新配置。

Ingress-Nginx github地址:https://github.com/kubernetes/ingress-nginx

Ingress_Nginx 官方网站:https://kubernetes.github.io/ingress-nginx/

总结:ingress-controller才是负责具体转发的组件,通过各种方式将他暴露在集群入口,外部对集群的请求流量会先到ingress-controller,而ingress对象是用来告诉ingress-controller该如何转发请求,比如哪些域名、哪些URL要转发到哪些service等等。

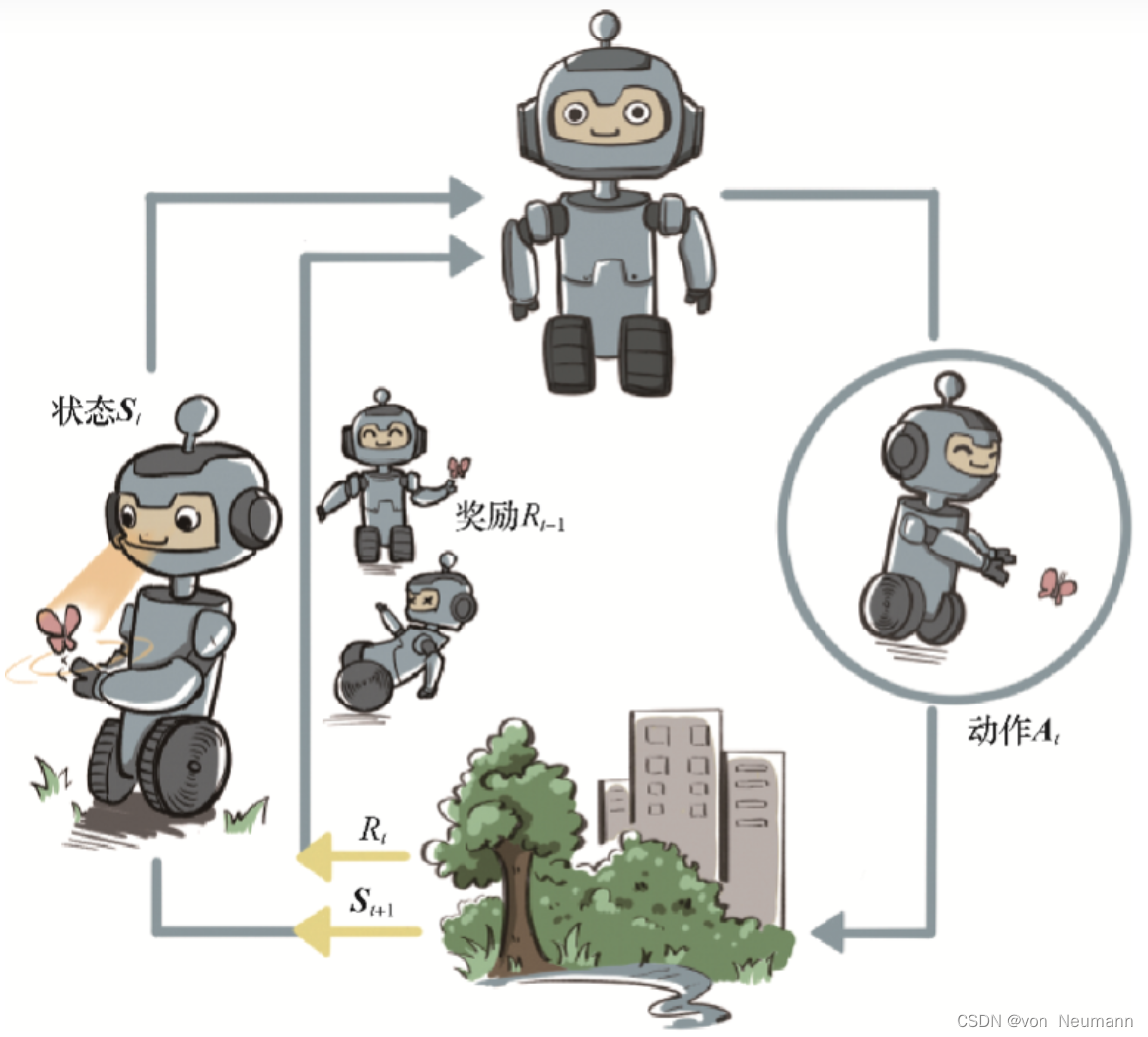

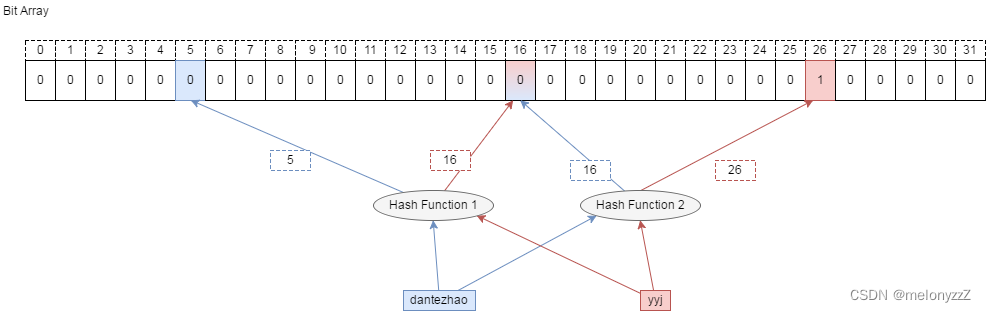

Ingress

Ingress Controller

流程:通过DNS客户端解析,到客户端发送http请求,ingress来接受;理论上是发送给每个pod,但实际上通过Ingress(配置文件)来发送给特定的service,然后service发送给指定的endpoints再去分发给每个pod。

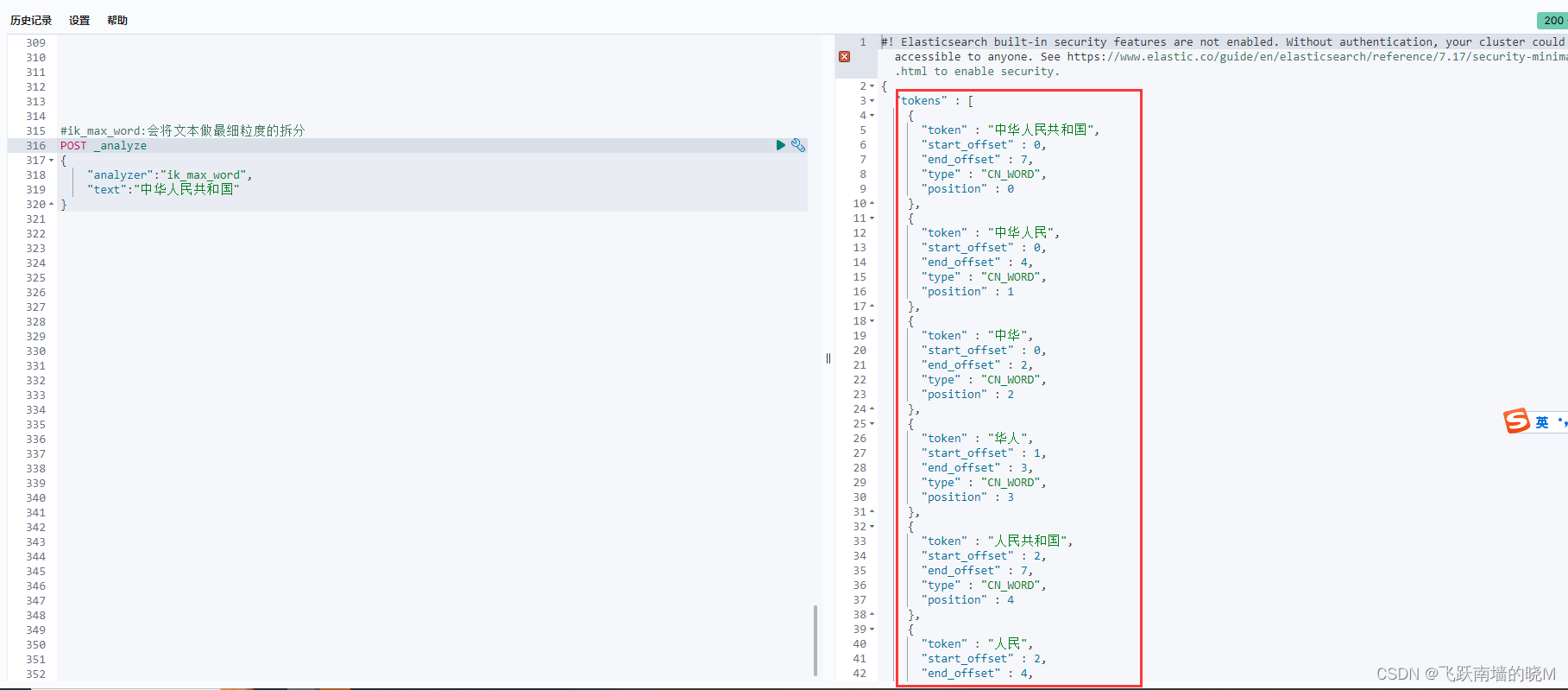

四、Ingress工作原理

(1) ingress-controller通过和 kubernetes APIServer 交互,动态的去感知集群中ingre

(2)然后读取它,按照自定义的规则,规则就是写明了哪个域名对应哪个service,生成一段nginx配置,

(3)再写到nginx-ingress-controller的pod里,这个ingress-controller的pod里运行着一个Nginx服务,控制器会把生成的nginx配置写入/etc/nginx.conf文件中,

(4)然后reload一下使配置生效。以此达到域名区分配置和动态更新的作用。

五、ingress暴露服务的方式

方式一:Deployment+LoadBalance模式的Service

适用于把ingress部署在公有云。用Deployment部署ingress-controller,创建一个type为LoadBalancer的service关联这组pod。大部分公有云,都会为LoadBalancer的service自动创建一个负载均衡器,通常还绑定了公网地址。只要把域名解析指向该地址,就实现了集群服务的对外暴露

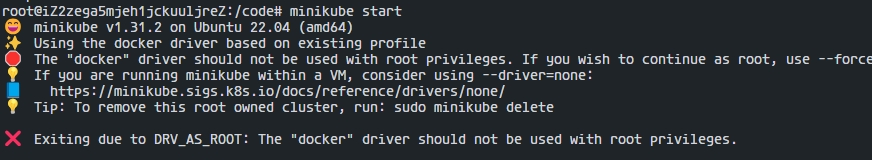

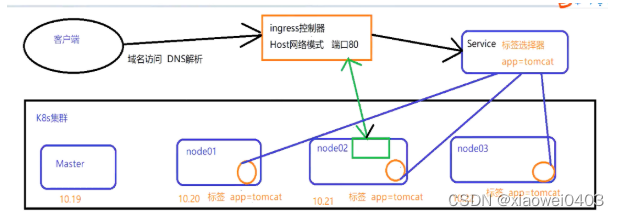

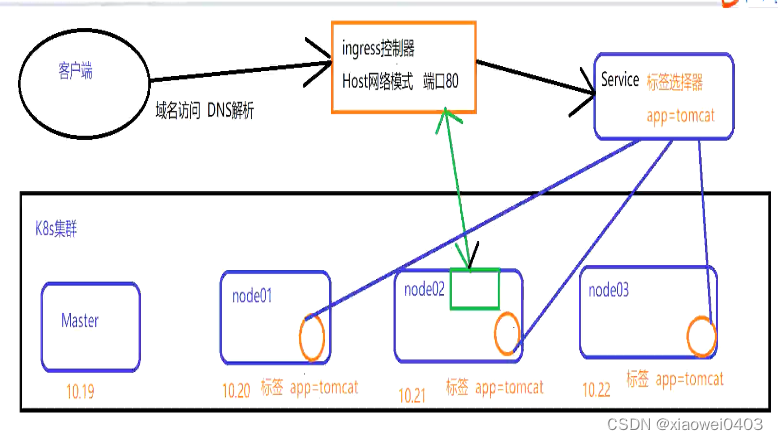

方式二:DaemonSet+HostNetwork+nodeSelector

用DaemonSet结合nodeselector来部署ingress-controller到特定的node上,然后使用HostNetwork直接把该pod与宿主机node的网络打通,直接使用宿主机的80/433端口就能访问服务。这时,ingress-controller所在的node机器就很类似传统架构的边缘节点,比如机房入口的nginx服务器。该方式整个请求链路最简单,性长相对NodePort模式更好。缺点是由于直接利用宿主机节点的网络和端口,一个node只能部署一个ingress-con.troller pod。比较适合大并发的生产环境使用。

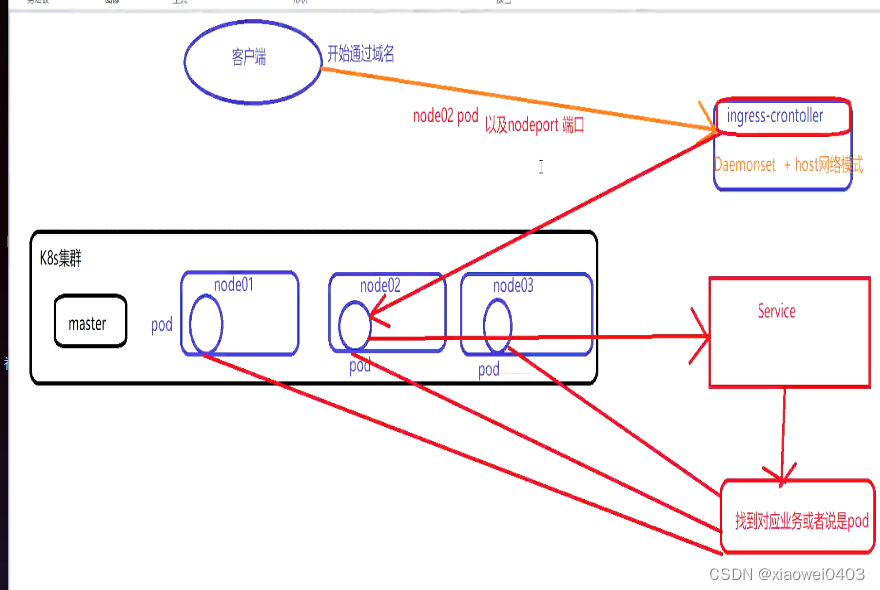

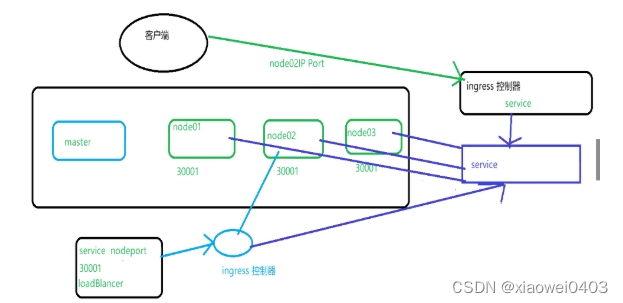

方式三: Deployment+NodePort模式的service

同样用deployment模式部署ingress-controller,并创建对应的service,但是type为NodePort。这样,ingress就会暴露在集群节点ip的特定端口上。由于nodeport暴露的端口是随机端口,一般会在前面再搭建一套负载均衡器来转发请求。该方式一般用于宿主机是相对固定的环境ip地址不变的场景。

NodePort方式暴露ingress虽然简单方便,但是NodePort多了一层NAT,在请求量级很大时可能对性能会有一定影响。

DaemonSet+HostNetwork+nodeSelector架构

daemonset + hostNetwork 模式部署 ingress-controller

客户端-----》ingress-controller(pod和Host共享IP和端口)-----》业务应用的Service----》业务的应用Pod

Deployment+NodePort模式的Service

六、Ingress实验

部署 nginx-ingress-controller

1、部署ingress-controller pod及相关资源

mkdir /opt/ingress

cd /opt/ingress

官方下载地址:

wget https://raw.githubusercontent.com/kubernetes/ingress-nginx/nginx-0.25.0/deploy/static/mandatory.yaml

上面可能无法下载,可用国内的 gitee

wget https://gitee.com/mirrors/ingress-nginx/raw/nginx-0.25.0/deploy/static/mandatory.yaml

wget https://gitee.com/mirrors/ingress-nginx/raw/nginx-0.30.0/deploy/static/mandatory.yaml

#mandatory.yaml文件中包含了很多资源的创建,包括namespace、ConfigMap、role,ServiceAccount等等所有部署ingress-controller需要的资源。

2、修改 ClusterRole 资源配置

vim mandatory.yaml

......

apiVersion: rbac.authorization.k8s.io/v1beta1

#RBAC相关资源从1.17版本开始改用rbac.authorization.k8s.io/v1,rbac.authorization.k8s.io/v1beta1在1.22版本即将弃用

kind: ClusterRole

metadata:

name: nginx-ingress-clusterrole

labels:

app.kubernetes.io/name: ingress-nginx

app.kubernetes.io/part-of: ingress-nginx

rules:

- apiGroups:

- ""

resources:

- configmaps

- endpoints

- nodes

- pods

- secrets

verbs:

- list

- watch

- apiGroups:

- ""

resources:

- nodes

verbs:

- get

- apiGroups:

- ""

resources:

- services

verbs:

- get

- list

- watch

- apiGroups:

- "extensions"

- "networking.k8s.io" # (0.25版本)增加 networking.k8s.io Ingress 资源的 api

resources:

- ingresses

verbs:

- get

- list

- watch

- apiGroups:

- ""

resources:

- events

verbs:

- create

- patch

- apiGroups:

- "extensions"

- "networking.k8s.io" # (0.25版本)增加 networking.k8s.io/v1 Ingress 资源的 api

resources:

- ingresses/status

verbs:

- update

采用方式二:DaemonSet+HostNetwork+nodeSelector

3、指定 nginx-ingress-controller 运行在 node02 节点

kubectl label node node02 ingress=true

kubectl get nodes --show-labels

4、修改 Deployment 为 DaemonSet ,指定节点运行,并开启 hostNetwork 网络

vim mandatory.yaml

...

apiVersion: apps/v1

5.修改 kind

kind: Deployment

kind: DaemonSet

metadata:

name: nginx-ingress-controller

namespace: ingress-nginx

labels:

app.kubernetes.io/name: ingress-nginx

app.kubernetes.io/part-of: ingress-nginx

spec:

6. 删除Replicas

replicas: 1

selector:

matchLabels:

app.kubernetes.io/name: ingress-nginx

app.kubernetes.io/part-of: ingress-nginx

template:

metadata:

labels:

app.kubernetes.io/name: ingress-nginx

app.kubernetes.io/part-of: ingress-nginx

annotations:

prometheus.io/port: "10254"

prometheus.io/scrape: "true"

spec:

# 使用主机网络

hostNetwork: true

# 选择节点运行

nodeSelector:

ingress: "true"

serviceAccountName: nginx-ingress-serviceaccount

......

7、在所有 node 节点上传 nginx-ingress-controller 镜像压缩包 ingree.contro.tar.gz 到 /opt/ingress 目录,并解压和加载镜像

cd /opt/ingress

tar zxvf ingree.contro.tar.gz

docker load -i ingree.contro.tar

8、启动 nginx-ingress-controller

//nginx-ingress-controller 已经运行 node02 节点

kubectl get pod -n ingress-nginx -o wide

NAME READY STATUS RESTARTS AGE IP NODE NOMINATED NODE READINESS GATES

nginx-ingress-controller-99h72 1/1 Running 0 93s 192.168.10.21 node02 <none> <none>

kubectl get cm,daemonset -n ingress-nginx -o wide

NAME DATA AGE

configmap/ingress-controller-leader-nginx 0 100s

configmap/nginx-configuration 0 102s

configmap/tcp-services 0 102s

configmap/udp-services 0 102s

NAME DESIRED CURRENT READY UP-TO-DATE AVAILABLE NODE SELECTOR AGE

nginx-ingress-controller 1 1 1 1 1 ingress=true 16m

9.到 node02 节点查看

netstat -lntp | grep nginx

tcp 0 0 0.0.0.0:80 0.0.0.0:* LISTEN 7131/nginx: master

tcp 0 0 0.0.0.0:8181 0.0.0.0:* LISTEN 7131/nginx: master

tcp 0 0 0.0.0.0:443 0.0.0.0:* LISTEN 7131/nginx: master

tcp6 0 0 :::10254 :::* LISTEN 7098/nginx-ingress-

由于配置了 hostnetwork,nginx 已经在 node 主机本地监听 80/443/8181 端口。其中 8181 是 nginx-controller 默认配置的一个 default backend(Ingress 资源没有匹配的 rule 对象时,流量就会被导向这个 default backend)。

这样,只要访问 node 主机有公网 IP,就可以直接映射域名来对外网暴露服务了。如果要 nginx 高可用的话,可以在多个 node

上部署,并在前面再搭建一套 LVS+keepalived 做负载均衡。

10、创建 ingress 规则

创建一个 deploy 和 svc

vim service-nginx.yaml

apiVersion: apps/v1

kind: Deployment

metadata:

name: nginx-app

spec:

replicas: 2

selector:

matchLabels:

app: nginx

template:

metadata:

labels:

app: nginx

spec:

containers:

- name: nginx

image: nginx

imagePullPolicy: IfNotPresent

ports:

- containerPort: 80

---

apiVersion: v1

kind: Service

metadata:

name: nginx-app-svc

spec:

type: ClusterIP

ports:

- protocol: TCP

port: 80

targetPort: 80

selector:

app: nginx

创建 ingress

方法一:(extensions/v1beta1 Ingress 在1.22版本即将弃用)

vim ingress-app.yaml

apiVersion: extensions/v1beta1

kind: Ingress

metadata:

name: nginx-app-ingress

spec:

rules:

- host: www.kgc.com

http:

paths:

- path: /

backend:

serviceName: nginx-app-svc

servicePort: 80

方法二:

vim ingress-app.yaml

apiVersion: networking.k8s.io/v1

kind: Ingress

metadata:

name: nginx-app-ingress

spec:

rules:

- host: www.kgc.com

http:

paths:

- path: /

pathType: Prefix

backend:

service:

name: nginx-app-svc

port:

number: 80

kubectl apply -f service-nginx.yaml

kubectl apply -f ingress-app.yaml

kubectl get pods

NAME READY STATUS RESTARTS AGE

nginx-app-7bffc778db-sw2hl 1/1 Running 0 42s

nginx-app-7bffc778db-xsd5q 1/1 Running 0 42s

kubectl get ingress

NAME HOSTS ADDRESS PORTS AGE

nginx-app-ingress www.kgc.com 80 39s

11.

vim /etc/hosts

192.168.10.19 master

192.168.10.20 node01

192.168.10.21 node02

192.168.10.21 www.kgc.com

curl www.kgc.com

12、查看 nginx-ingress-controller

kubectl get pod -n ingress-nginx -o wide

NAME READY STATUS RESTARTS AGE IP NODE NOMINATED NODE READINESS GATES

nginx-ingress-controller-99h72 1/1 Running 0 93s 192.168.10.21 node02 <none> <none>

kubectl exec -it nginx-ingress-controller-99h72 -n ingress-nginx /bin/bash

# more /etc/nginx/nginx.conf

//可以看到从 start server www.kgc.com 到 end server www.kgc.com 之间包含了此域名用于反向代理的配置