前言

爬虫在互联网数据采集、分析和挖掘中扮演着至关重要的角色,但是对于目标网站而言,频繁的爬虫请求可能会对其服务器产生不小的负担,严重的情况甚至会导致网站崩溃或者访问受限。为了避免这种情况的发生,同时也为了保护客户端的隐私和安全,爬虫使用HTTP代理IP是非常有必要的。本文将从HTTP代理IP的基本原理、爬虫使用HTTP代理IP的具体方法以及注意事项等方面进行讲解,以帮助读者更好地了解HTTP代理IP在爬虫中的应用。

一、HTTP代理IP简介

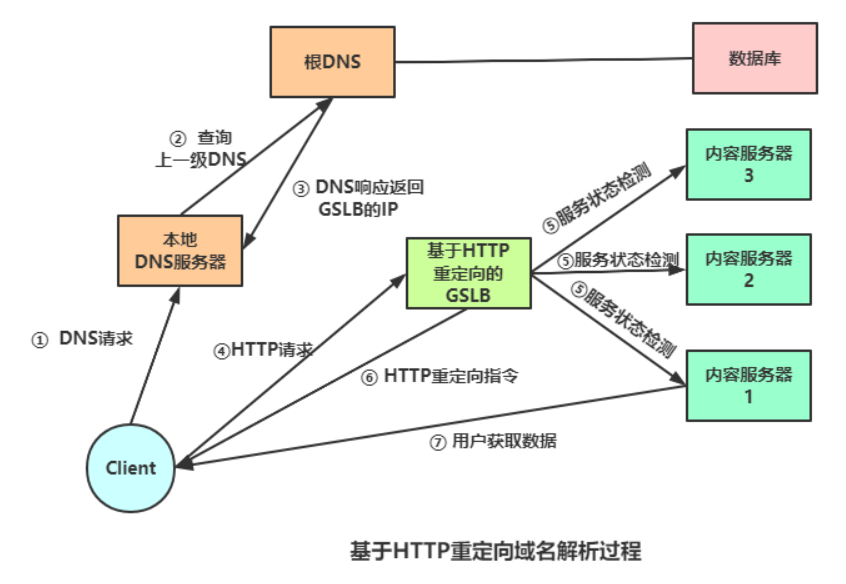

HTTP代理IP是一种网络代理技术,通过在客户端和目标服务器之间,充当中间人的角色,代理客户端向目标服务器发起请求。使用HTTP代理IP可以隐藏客户端的真实IP地址,实现匿名浏览和访问目标网站,同时也可以绕开一些网络限制。

二、爬虫为什么需要HTTP代理IP?

在爬虫过程中,爬虫程序会频繁地向目标网站请求数据,如果每次请求的IP地址都是相同的,那么会很容易被目标网站认为是恶意请求,从而封禁该IP地址或者不允许该IP地址的访问。此时,使用HTTP代理IP可以解决以上问题,同时还有以下好处:

- IP隐匿:使用HTTP代理IP可以隐藏客户端的真实IP地址,实现匿名浏览和访问目标网站。此时,目标网站无法通过IP地址来识别爬虫程序,从而降低被封禁的风险。

- 提高爬虫成功率:有些网站会对IP地址进行封禁或者限制访问次数,使用HTTP代理IP可以绕过这些限制,提高爬虫的成功率。

- 突破地域限制:有些网站会对不同地域的IP地址进行限制,使用HTTP代理IP可以绕过这些限制,访问目标网站。

三、HTTP代理IP的使用方法

1. 获取代理IP

目前有很多免费和付费的代理IP服务,可以通过API或者爬虫程序来获取代理IP。在此,我以一个免费的代理IP网站为例,来演示如何获取代理IP:

import requests

from bs4 import BeautifulSoup

def get_proxy():

url = 'https://www.zdaye.com/nn/'

headers = {

'User-Agent': 'Mozilla/5.0 (Windows NT 10.0; WOW64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/51.0.2704.63 Safari/537.36'

}

proxies = []

for i in range(1, 6):

r = requests.get(url + str(i), headers=headers)

soup = BeautifulSoup(r.text, 'html.parser')

trs = soup.select('table tr')

for tr in trs[1:]:

tds = tr.select('td')

ip = tds[1].text.strip()

port = tds[2].text.strip()

protocol = tds[5].text.strip()

proxy = {protocol: protocol + '://' + ip + ':' + port}

proxies.append(proxy)

return proxies

以上代码使用requests和BeautifulSoup库来爬取免费代理IP网站的IP地址、端口和协议类型,并将其保存在一个列表中,返回给调用者。

2. 使用代理IP

在使用代理IP时,需要将其设置为requests库的一个参数proxies。以下是使用代理IP的代码示例:

import requests

url = 'https://www.example.com'

proxies = {

'http': 'http://111.111.111.111:8080',

'https': 'https://111.111.111.111:8080'

}

headers = {

'User-Agent': 'Mozilla/5.0 (Windows NT 10.0; WOW64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/51.0.2704.63 Safari/537.36'

}

response = requests.get(url, proxies=proxies, headers=headers)在以上代码中,通过proxies参数将代理IP设置为requests库的一个参数。可以设置http和https两种协议的代理IP,如果只需要使用一种协议,可以只设置一种。headers参数是设置请求头的参数,可以自定义请求头,防止被目标网站发现是爬虫程序。

四、HTTP代理IP的注意事项

- 代理IP的质量:使用免费代理IP时,需要注意代理IP的质量和可用性。有些代理IP可能已经被目标网站封禁或者不可用,需要通过一些方法进行筛选和检验。

- 频率限制:即使使用代理IP,也需要注意请求频率的限制。如果频繁地请求同一个URL或者同一个IP地址,仍然会被目标网站认为是恶意请求。

- 长期稳定性:付费代理IP相比免费代理IP,稳定性和可用性更高,可以长期使用。免费代理IP则需要保持更新和监控,及时进行更换。

五、结论

HTTP代理IP是爬虫程序中不可或缺的一部分,可以提高爬虫程序的稳定性和成功率,同时也可以保护客户端的隐私和安全。在使用HTTP代理IP时,需要注意代理IP的质量、请求频率的限制和长期稳定性等问题,确保爬虫程序能够长期稳定地运行。