激活函数总结(二十七):激活函数补充

- 1 引言

- 2 激活函数

- 2.1 Multiquadratic激活函数

- 2.2 InvMultiquadratic激活函数

- 3. 总结

1 引言

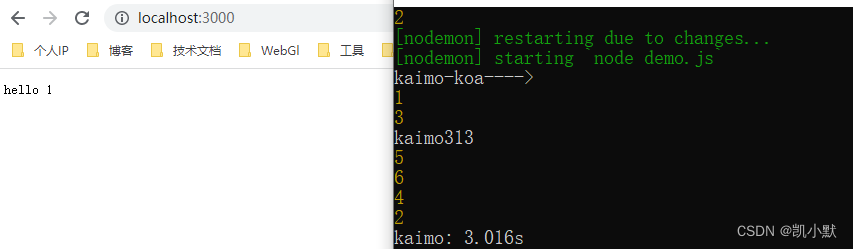

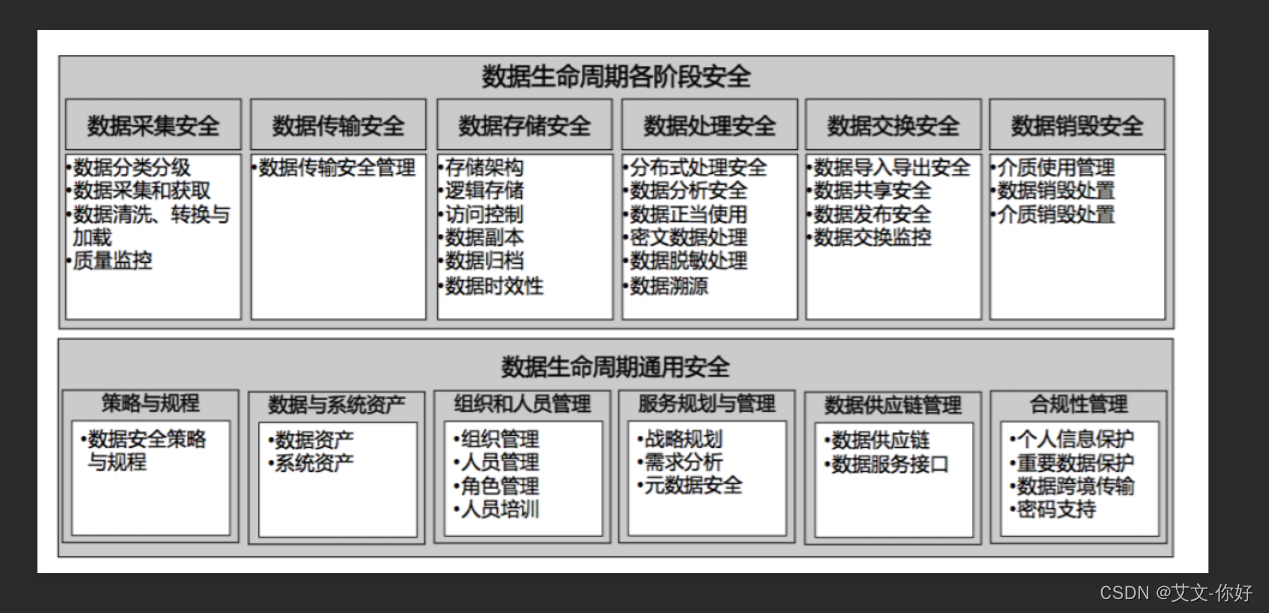

在前面的文章中已经介绍了介绍了一系列激活函数 (Sigmoid、Tanh、ReLU、Leaky ReLU、PReLU、Swish、ELU、SELU、GELU、Softmax、Softplus、Mish、Maxout、HardSigmoid、HardTanh、Hardswish、HardShrink、SoftShrink、TanhShrink、RReLU、CELU、ReLU6、GLU、SwiGLU、GTU、Bilinear、ReGLU、GEGLU、Softmin、Softmax2d、Logsoftmax、Identity、LogSigmoid、Bent Identity、Absolute、Bipolar、Bipolar Sigmoid、Sinusoid、Cosine、Arcsinh、Arccosh、Arctanh、LeCun Tanh、TanhExp、Gaussian 、GCU、ASU、SQU、NCU、DSU、SSU、SReLU、BReLU、PELU、Phish、RBF、SQ-RBF、ISRU、ISRLU、SQNL、PLU、APL、Inverse Cubic、Soft Exponential、ParametricLinear、Piecewise Linear Unit、CLL、SquaredReLU、ModReLU、CosReLU、SinReLU、Probit、Smish)。在这篇文章中,会接着上文提到的众多激活函数继续进行介绍,给大家带来更多不常见的激活函数的介绍。这里放一张激活函数的机理图:

2 激活函数

2.1 Multiquadratic激活函数

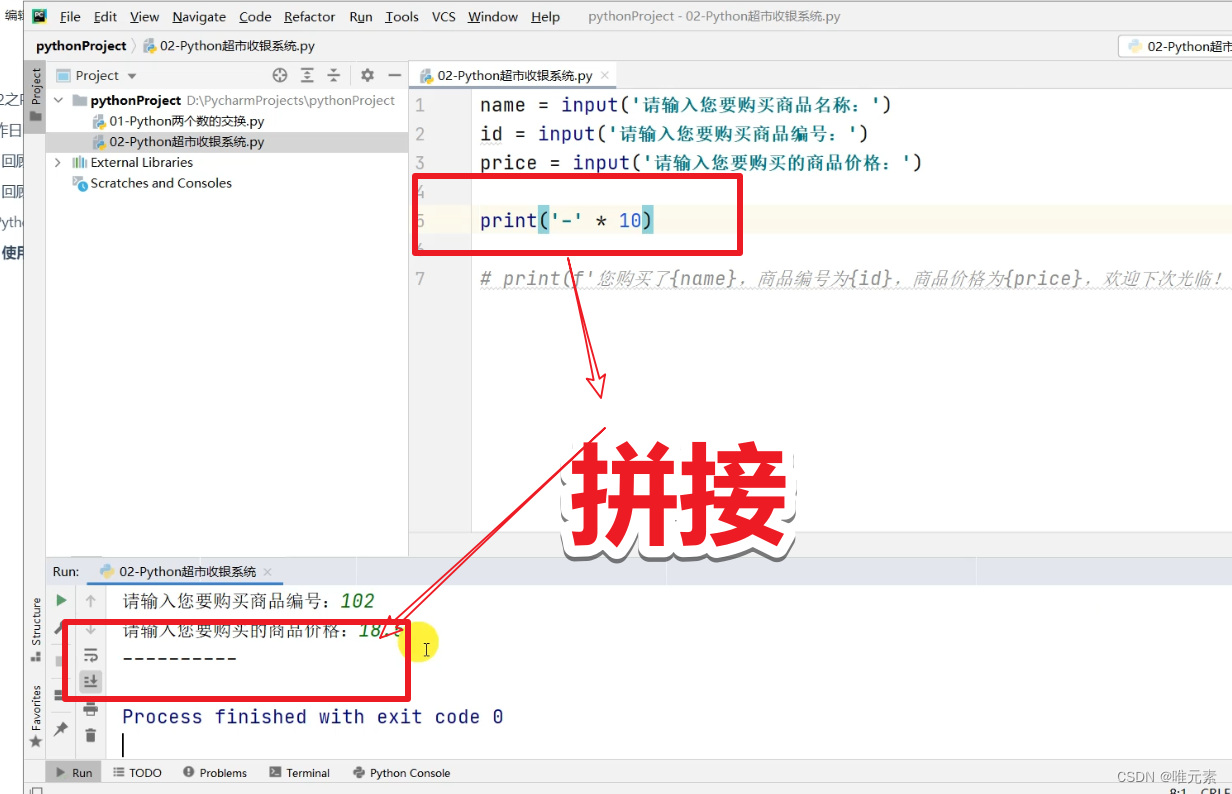

多次平方激活函数(Multiquadratic Activation Function)是一种用于神经网络的激活函数,它基于多次平方核(Multiquadratic Kernel)函数,用于引入非线性变换。这种激活函数在输入小于零时也具有非零输出,因此它不是一种常见的激活函数。其数学表达式和数学图像分别如下所示:

f

(

z

)

=

(

z

−

x

)

2

+

y

2

f(z)= \sqrt{(z-x)^2+y ^2}

f(z)=(z−x)2+y2

其中,

z

z

z 表示输入,

x

,

y

x, y

x,y 表示设置的数值,同图中的

p

x

,

p

y

px, py

px,py。

优点:

- 非线性特性: Multiquadratic 激活函数是一个

非线性函数,可以帮助神经网络捕捉数据中的复杂关系和模式。 - 平滑性: 这个激活函数是

平滑的,具有连续可微性,这在使用基于梯度的优化算法进行训练时是有利的。 - 适应能力: 通过调整参数 x 和 y,可以

调整激活函数的形状,使其适应不同的数据分布和模式。 - 适用范围: Multiquadratic 激活函数可以在

各种任务中使用,包括回归和分类等问题。

缺点:

- 额外参数: 引入的参数 x 和 y 增加了模型的

复杂性,需要额外的调参工作。 - 计算成本: 计算

平方根和乘法等运算可能会增加模型的计算成本,特别是在大规模数据上或深层网络中。 - 梯度消失: 在某些区域,激活函数的

导数可能会趋近于零,导致梯度消失问题。 - 解释性: Multiquadratic 激活函数的

物理意义不如某些其他激活函数(如 Sigmoid 或 ReLU)直观,因此在模型解释和理解方面可能会有挑战。

总的来说:有一定的优势,但是与当前流行的算法相比很难得到广泛应用。。。当前不怎么使用。。。。

2.2 InvMultiquadratic激活函数

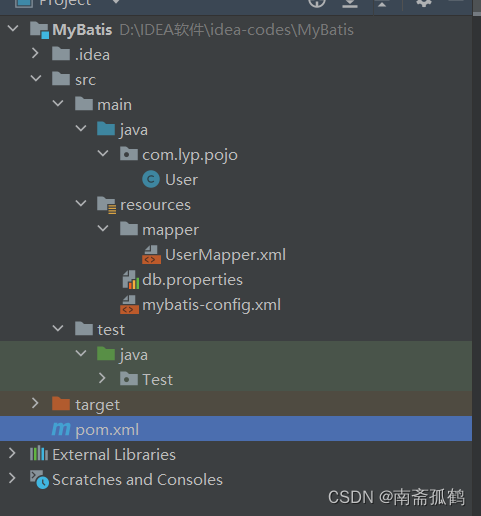

InvMultiquadratic 激活函数是 Multiquadratic 激活函数的一种变体,在Multiquadratic 激活函数的基础上进行了求倒数的操作。其数学表达式和数学图像分别如下所示:

f

(

z

)

=

1

(

z

−

x

)

2

+

y

2

f(z)= \frac{1}{\sqrt{(z-x)^2+y ^2}}

f(z)=(z−x)2+y21

优点:

- 非线性性质: InvMultiquadratic 激活函数是

非线性的,可以帮助神经网络模型捕捉数据中的非线性模式和关系。 - 适应性: 通过调整参数 x 和 y,可以

改变激活函数的形状,使其适应不同的数据分布和任务需求。 - 平滑性: InvMultiquadratic 激活函数在大部分区域内是

连续可微的,这对于基于梯度的优化算法进行训练是有益的。

缺点:

- 计算成本: 与 Multiquadratic 类似,计算

平方根和除法等操作可能会增加模型的计算成本。 - 梯度问题: 在某些区域,激活函数的

导数可能会变得非常大,这可能导致梯度爆炸问题。 - 解释性: 与一些常见的激活函数(如 Sigmoid 或 ReLU)相比,InvMultiquadratic 的

物理解释可能不太直观,可能会在模型解释和可解释性方面带来挑战。

总的来说:有一定的优势,但是与当前流行的算法相比很难得到广泛应用。。。当前不怎么使用。。。。

3. 总结

到此,使用 激活函数总结(二十七) 已经介绍完毕了!!! 如果有什么疑问欢迎在评论区提出,对于共性问题可能会后续添加到文章介绍中。如果存在没有提及的激活函数也可以在评论区提出,后续会对其进行添加!!!!

如果觉得这篇文章对你有用,记得点赞、收藏并分享给你的小伙伴们哦😄。