文章目录

- 一,显示文件内容

- (一)启动hadoop服务

- (二)创建并上传本地文件

- (1)创建students.txt文件

- (2)上传文件到HDFS

- (三)创建Maven项目:DisplayFile

- (1)添加相关依赖

- (2)创建日志属性文件

- (四)创建读取文件类:ReadFileOnHDFS

- (五)运行ReadFileOnHDFS类,查看结果

- 二,完成数据排序

- 三,计算最大利润和平均利润

一,显示文件内容

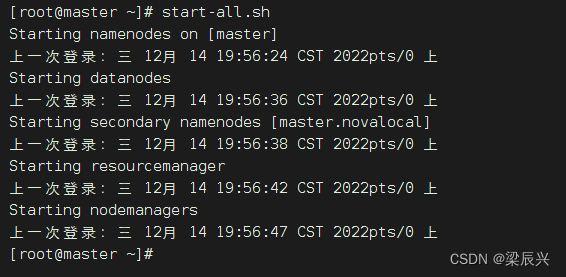

(一)启动hadoop服务

在master虚拟机上执行命令:start-all.sh

(二)创建并上传本地文件

(1)创建students.txt文件

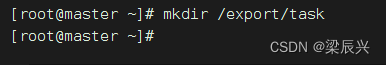

1.在master虚拟机上创建/export/task目录,输入命令:mkdir /export/task

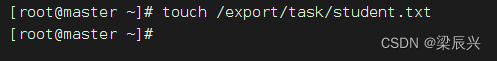

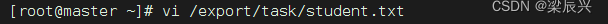

2.在/export/task目录下创建文件students.txt,输入命令:touch /export/task/student.txt

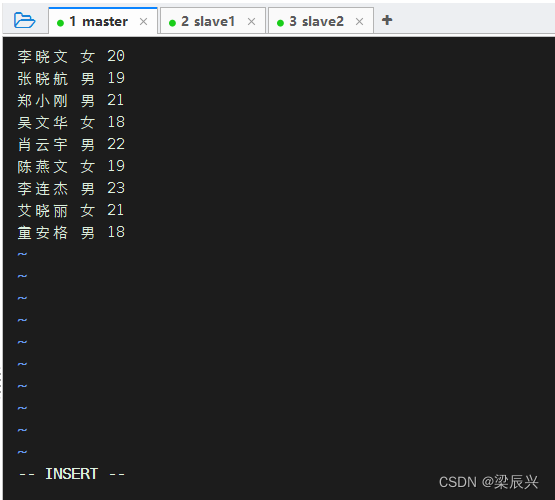

3.向student.txt文件添加如下内容:

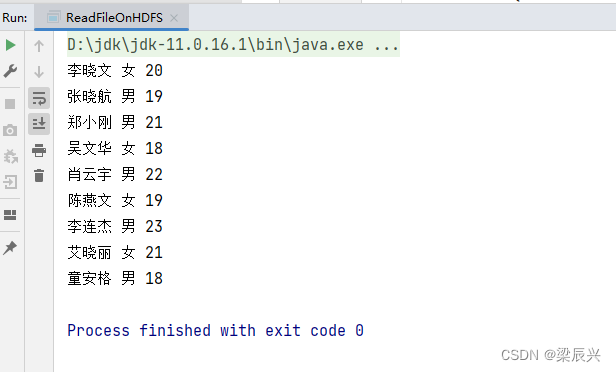

李晓文 女 20

张晓航 男 19

郑小刚 男 21

吴文华 女 18

肖云宇 男 22

陈燕文 女 19

李连杰 男 23

艾晓丽 女 21

童安格 男 18

(2)上传文件到HDFS

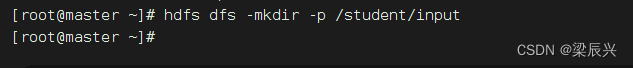

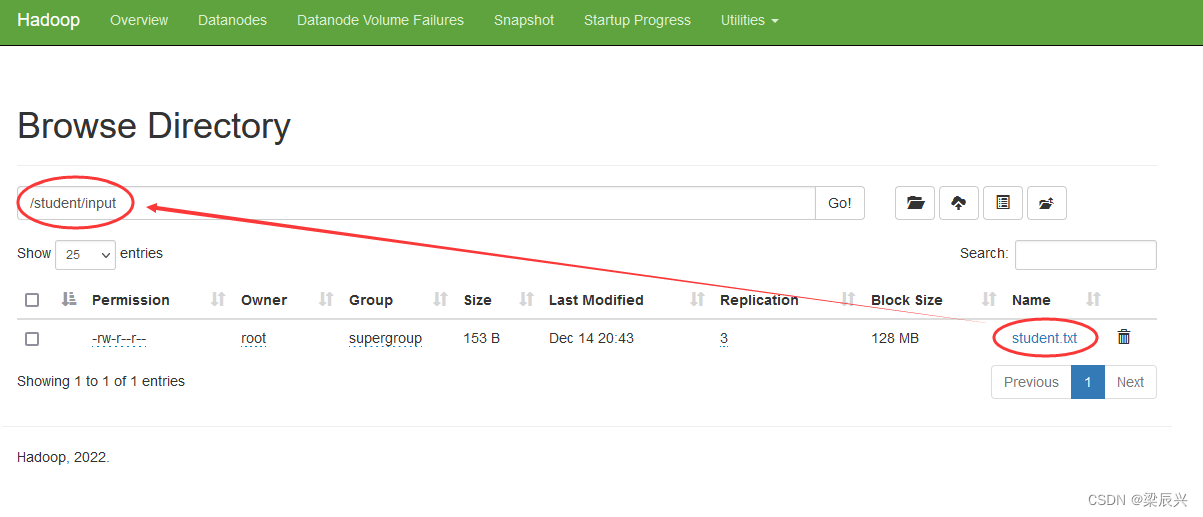

1.创建/student/input目录,输入命令:hdfs dfs -mkdir -p /student/input

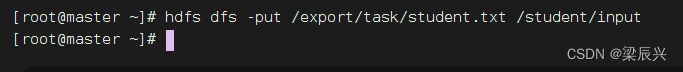

2.上传student.txt文件到HDFS上,输入命令:hdfs dfs -put /export/task/student.txt /student/input

3.在hadoop webui界面查看文件是否上传成功

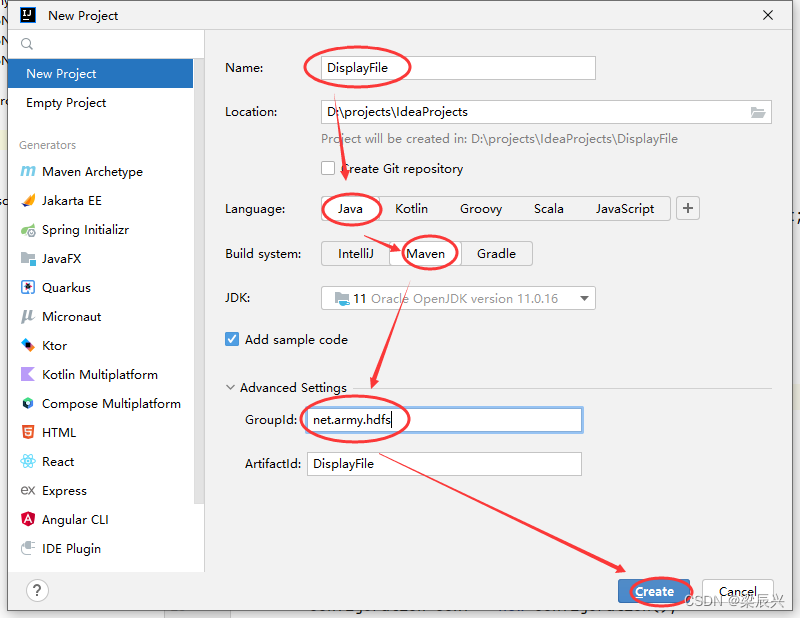

(三)创建Maven项目:DisplayFile

1.设置为下图所示,单击【Create】按钮

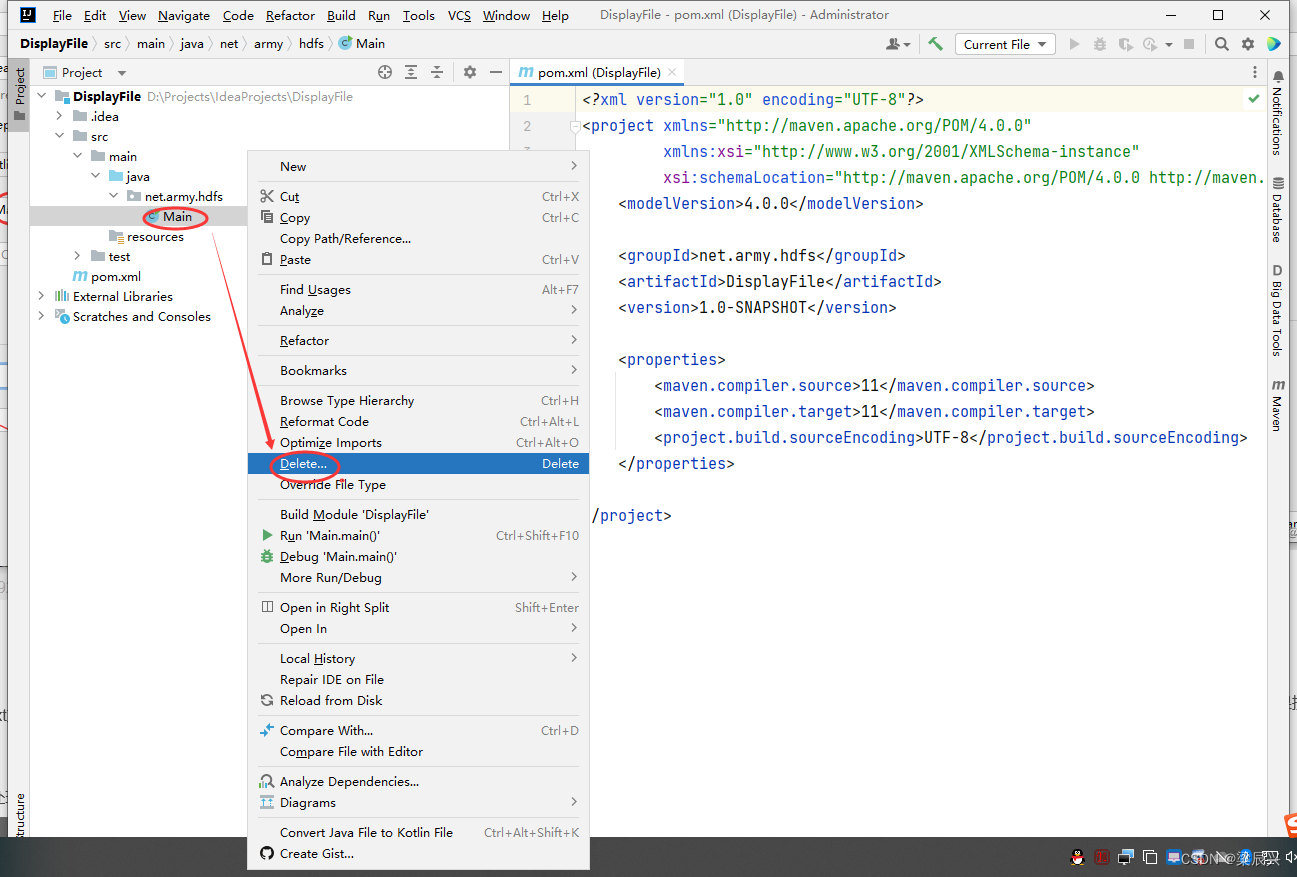

2.删除【Main】主类:右击【Main】类,单击【Delete】

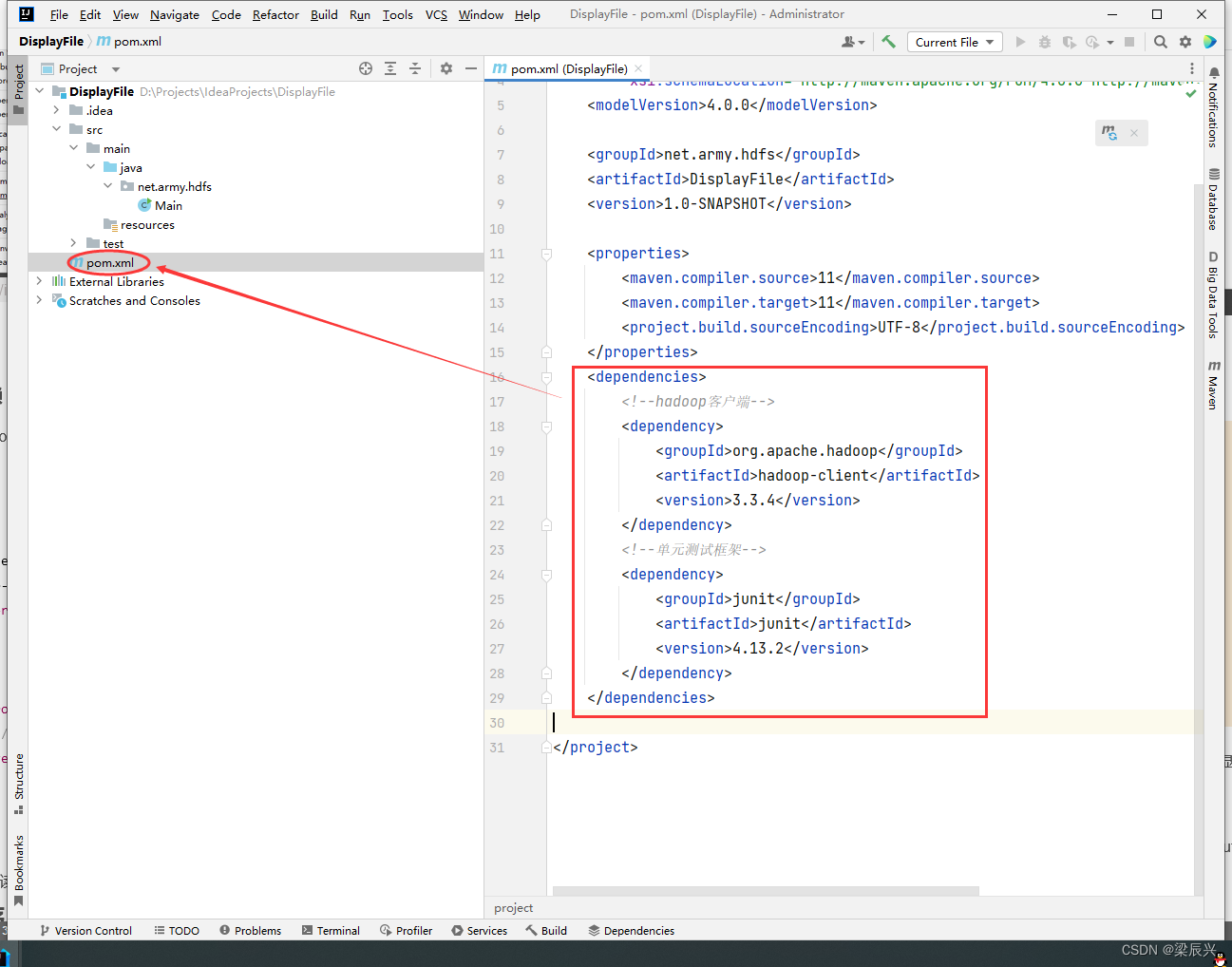

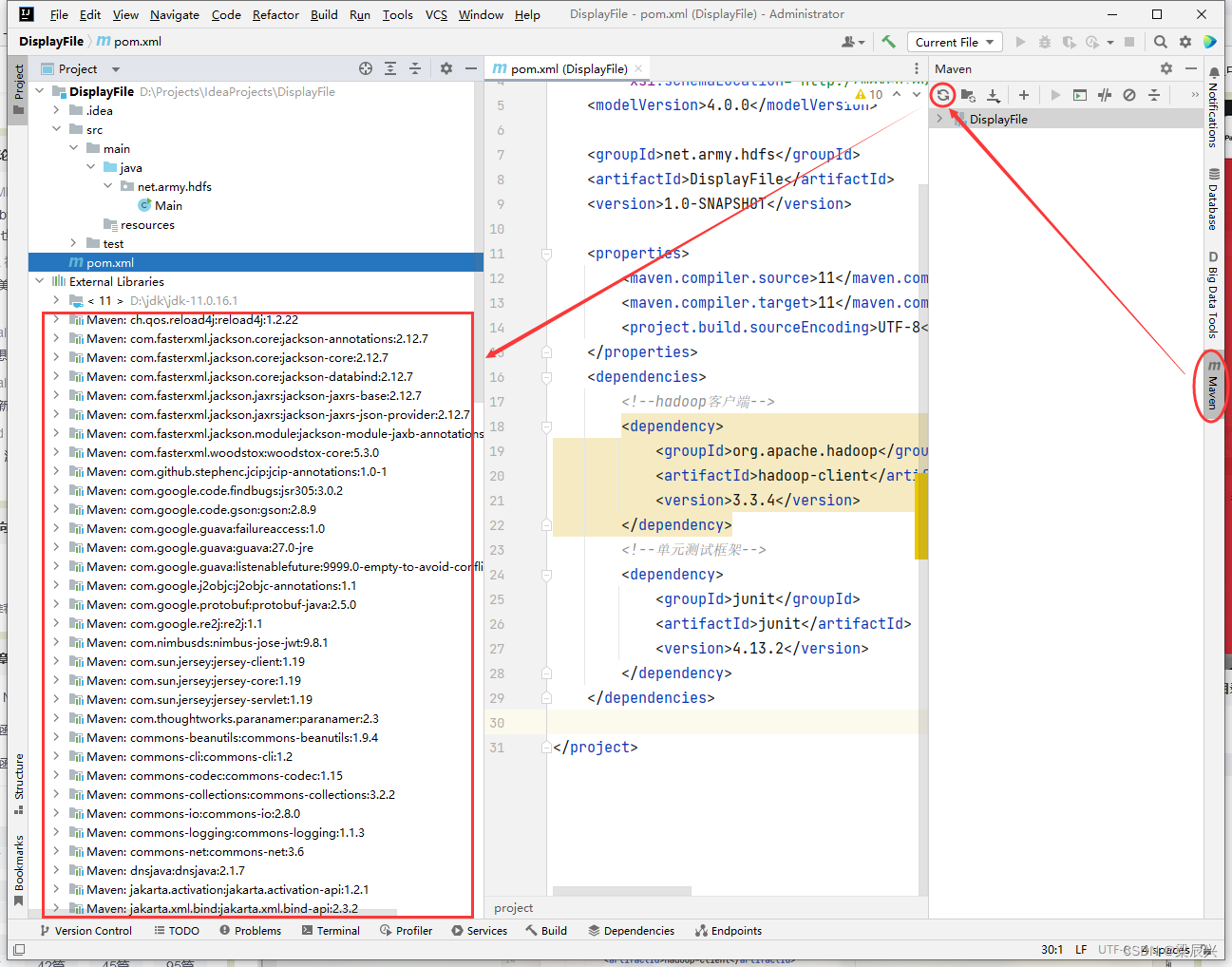

(1)添加相关依赖

1.在pom.xml文件里添加hadoop和junit依赖,内容如下:

<dependencies>

<!--hadoop客户端-->

<dependency>

<groupId>org.apache.hadoop</groupId>

<artifactId>hadoop-client</artifactId>

<version>3.3.4</version>

</dependency>

<!--单元测试框架-->

<dependency>

<groupId>junit</groupId>

<artifactId>junit</artifactId>

<version>4.13.2</version>

</dependency>

</dependencies>

2.单击【maven】,单击那个刷新按钮,它会自动下载相关依赖

2.单击【maven】,单击那个刷新按钮,它会自动下载相关依赖

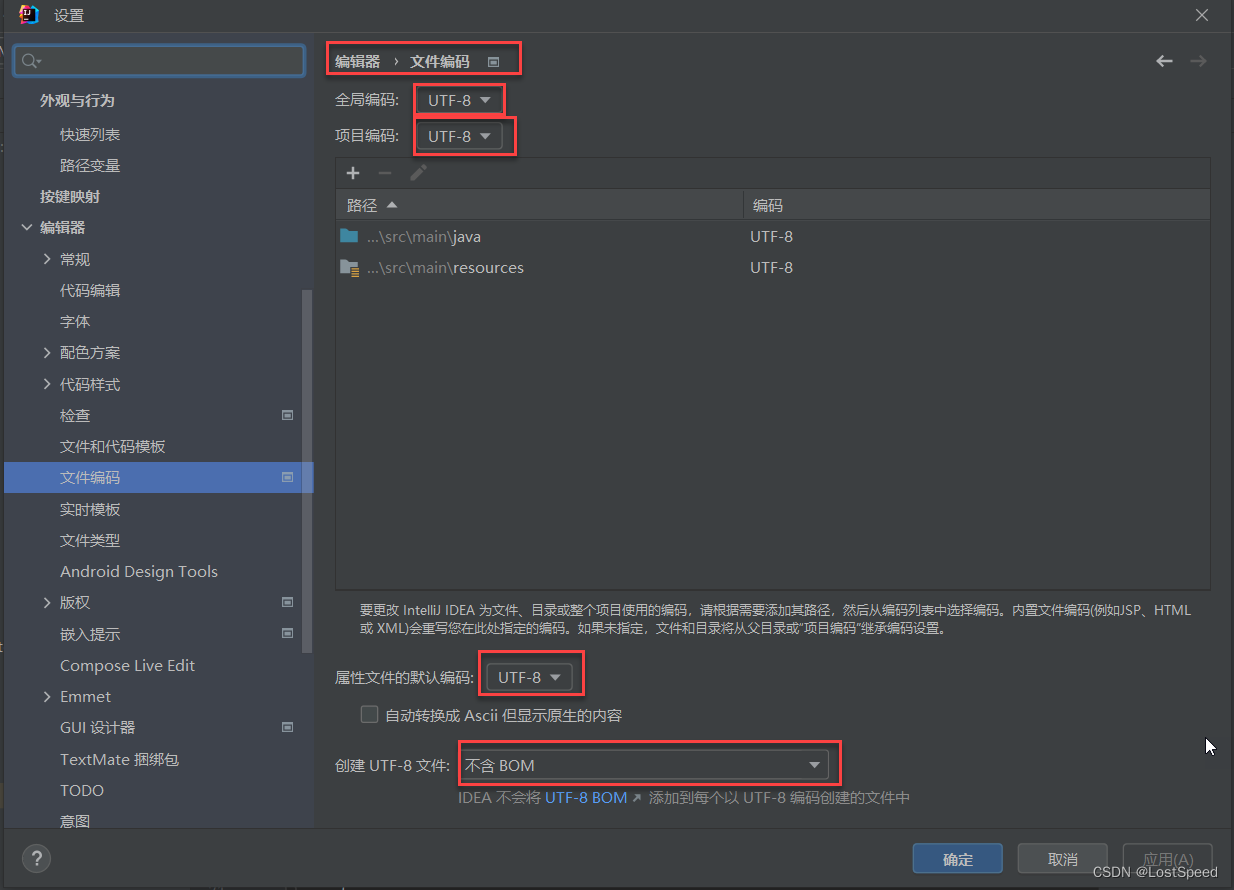

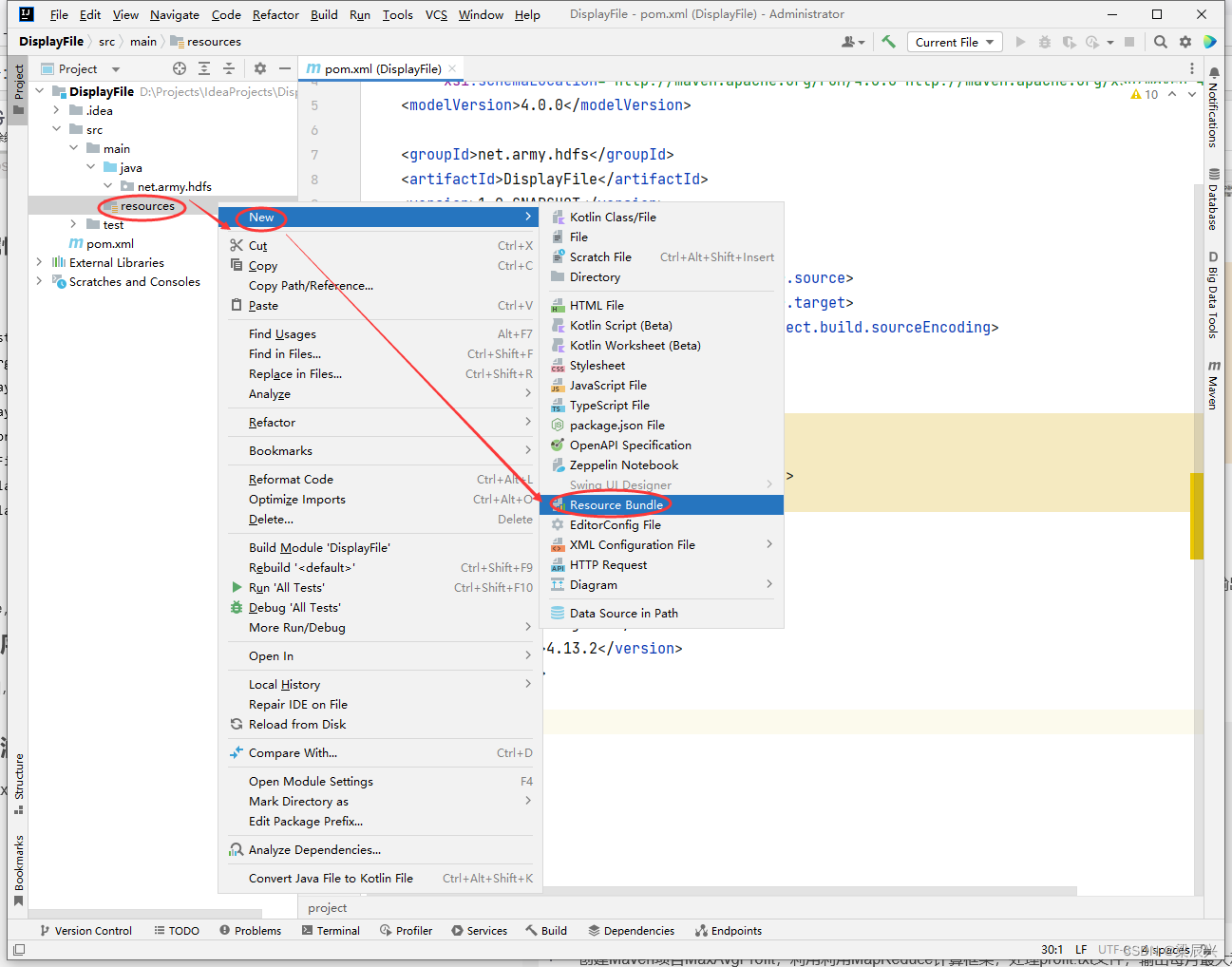

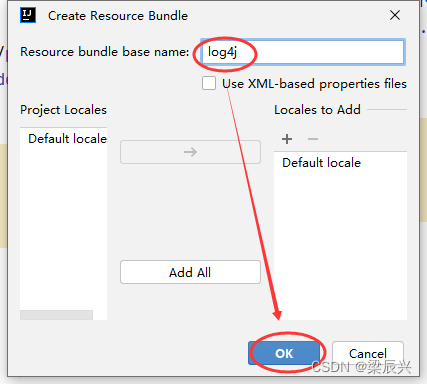

(2)创建日志属性文件

1.右击resources目录,单击【new】选择【resources bundle】,弹出下图界面输入log4j,单击【ok】按钮

2.在弹出的【Create Resource Bundle】对话框中输入:log4j,单击【OK】按钮

2.在弹出的【Create Resource Bundle】对话框中输入:log4j,单击【OK】按钮

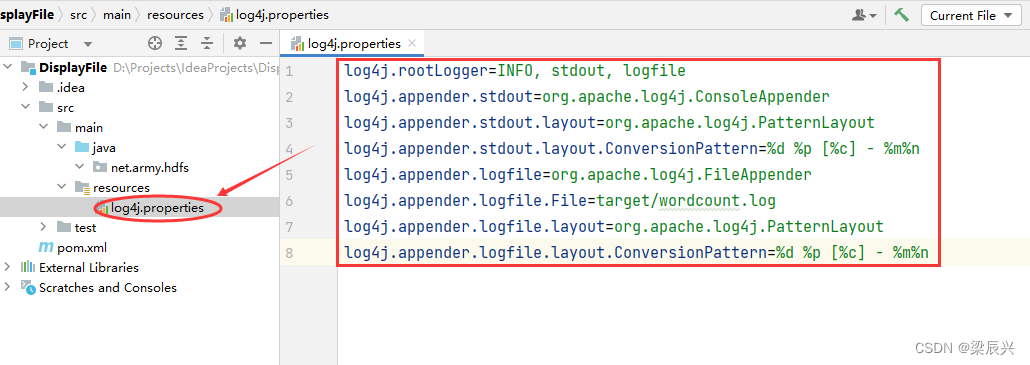

3.log4j.properties文件添加如下内容:

log4j.rootLogger=INFO, stdout, logfile

log4j.appender.stdout=org.apache.log4j.ConsoleAppender

log4j.appender.stdout.layout=org.apache.log4j.PatternLayout

log4j.appender.stdout.layout.ConversionPattern=%d %p [%c] - %m%n

log4j.appender.logfile=org.apache.log4j.FileAppender

log4j.appender.logfile.File=target/wordcount.log

log4j.appender.logfile.layout=org.apache.log4j.PatternLayout

log4j.appender.logfile.layout.ConversionPattern=%d %p [%c] - %m%n

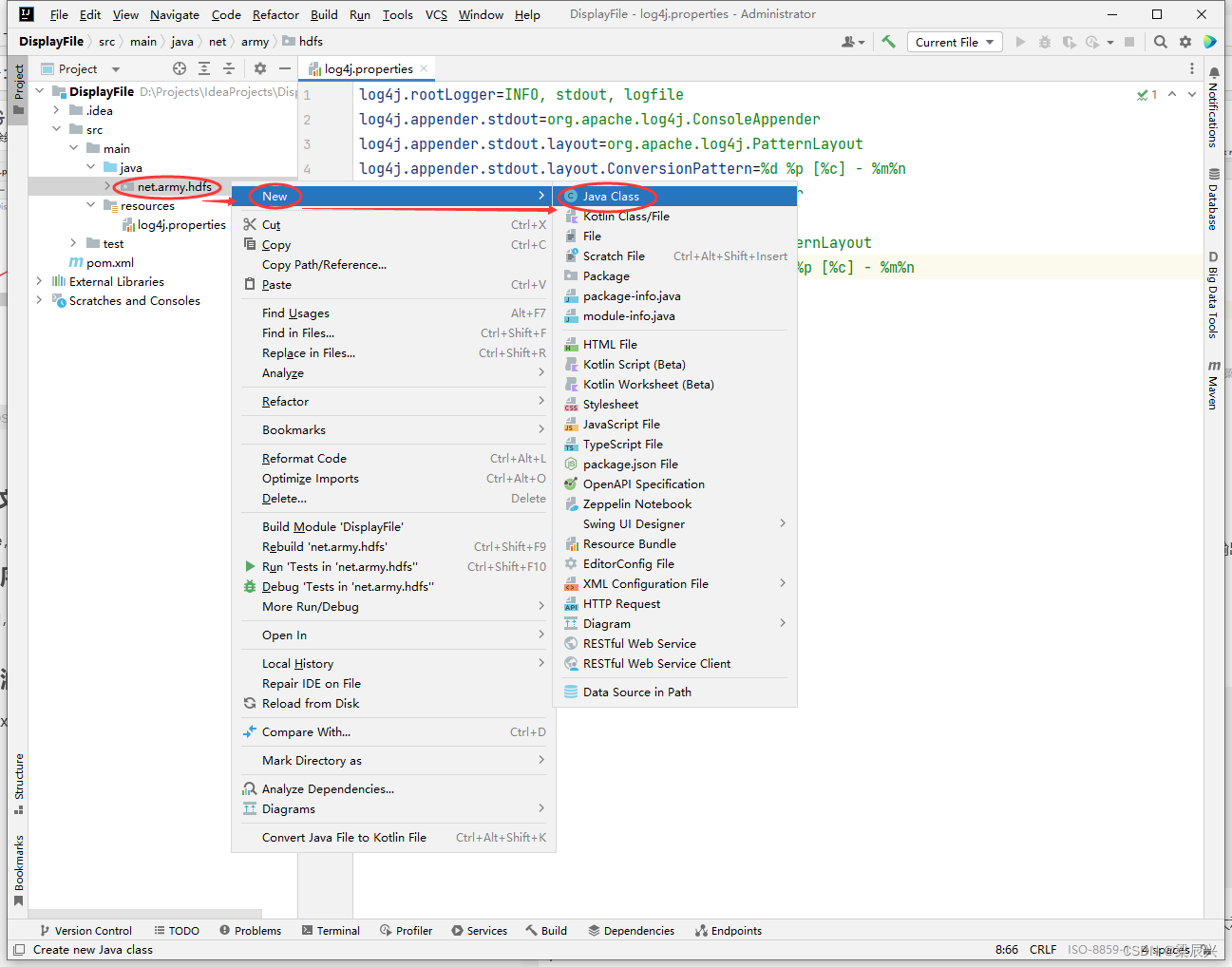

(四)创建读取文件类:ReadFileOnHDFS

1.右击【net.army.mr】包,选择【new】,单击【java class】

2.在弹出的对话框输入ReadFileOnHDFS,按下回车键

2.在弹出的对话框输入ReadFileOnHDFS,按下回车键

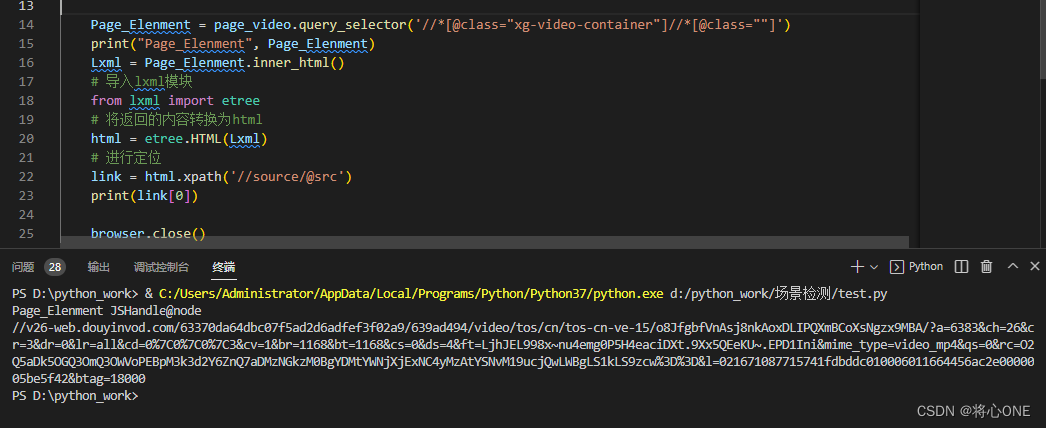

3.编写代码

package net.army.hdfs;

import org.apache.hadoop.conf.Configuration;

import org.apache.hadoop.fs.FSDataInputStream;

import org.apache.hadoop.fs.FileSystem;

import org.apache.hadoop.fs.Path;

import java.io.BufferedReader;

import java.io.InputStreamReader;

import java.net.URI;

/**

* 作者:梁辰兴

* 日期:2022/12/14

* 功能:读取HDFS上的文件

*/

public class ReadFileOnHDFS {

public static void main(String[] args) throws Exception {

// 创建配置对象

Configuration conf = new Configuration();

// 设置数据节点主机名属性

conf.set("dfs.client.use.datanode.hostname", "true");

// 定义统一资源标识符(uri: uniform resource identifier)

String uri = "hdfs://master:9000";

// 创建文件系统对象(基于HDFS的文件系统)

FileSystem fs = FileSystem.get(new URI(uri), conf, "root");

// 创建路径对象(指向文件)

Path path = new Path(uri + "/student/input/student.txt");

// 创建文件系统数据字节输入流(进水管:数据从文件到程序)

FSDataInputStream in = fs.open(path);

// 创建缓冲字符输入流,提高读取效率(字节流-->字符流-->缓冲流)

BufferedReader br = new BufferedReader(new InputStreamReader(in));

// 定义行字符串变量

String nextLine = "";

// 通过循环遍历缓冲字符输入流

while ((nextLine = br.readLine()) != null) {

// 在控制台输出读取的行

System.out.println(nextLine);

}

// 关闭缓冲字符输入流

br.close();

// 关闭文件系统数据字节输入流

in.close();

// 关闭文件系统

fs.close();

}

}

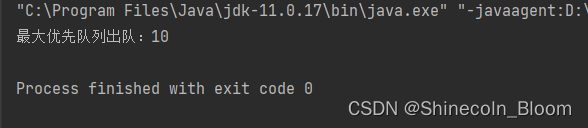

(五)运行ReadFileOnHDFS类,查看结果

二,完成数据排序

创建Maven项目SortByAge,利用MapReduce计算框架,处理/student/input/students.txt文件,输出结果按照年龄降序排列

三,计算最大利润和平均利润

有三个月的利润信息profit.txt

1 10000

1 15000

1 20000

2 2340

2 5640

2 6140

3 15000

3 2380

3 8900

创建Maven项目MaxAvgProfit,利用利用MapReduce计算框架,处理profit.txt文件,输出每月最大利润和平均利润