目录

1、概率和统计是一个东西吗?

2、贝叶斯公式到底在说什么?

3、似然函数

4、最大似然估计(MLE)

5、最大后验概率估计(MAP)

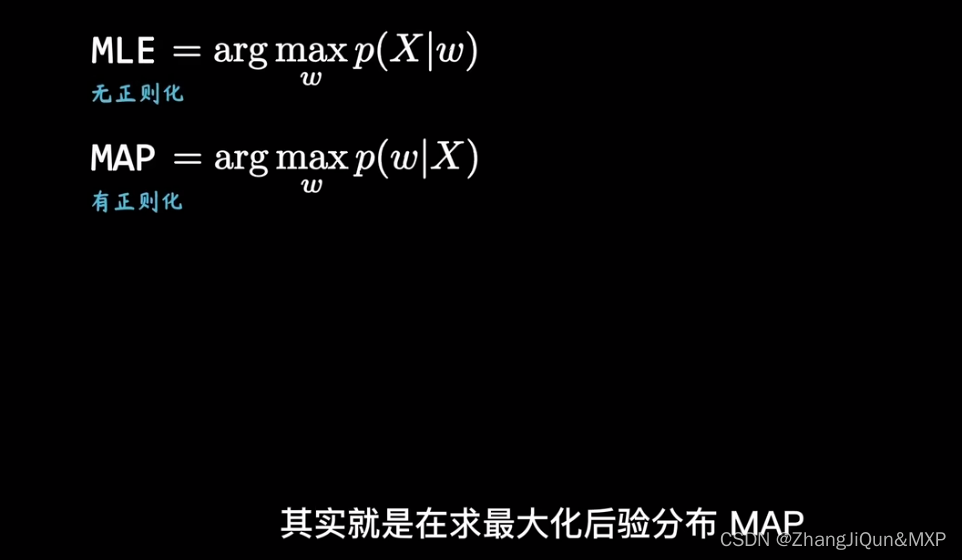

MLE VS MAP

总结

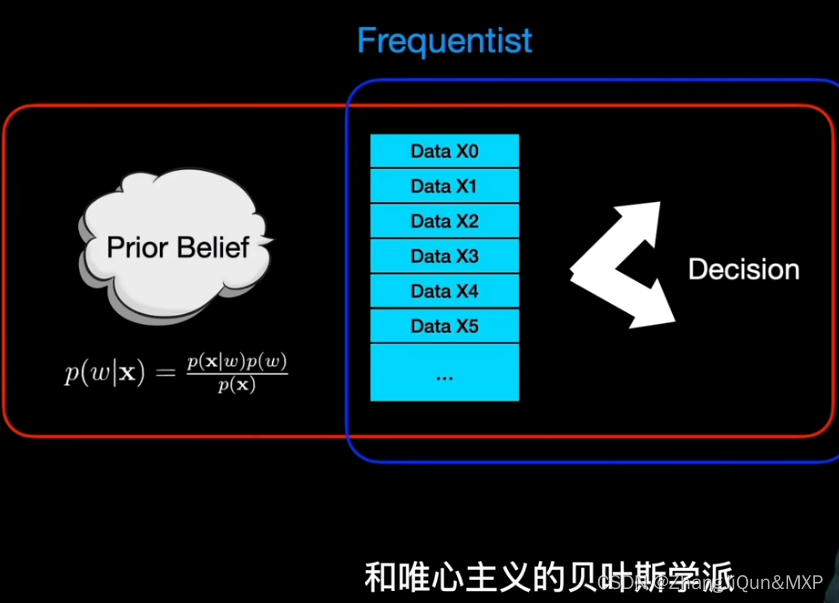

贝叶斯公式分成两派:唯物主义的频率学派,和唯心主义的贝叶斯学派编辑

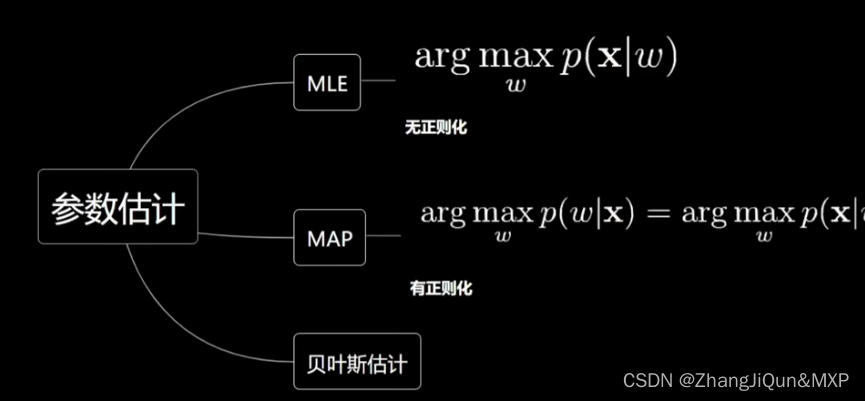

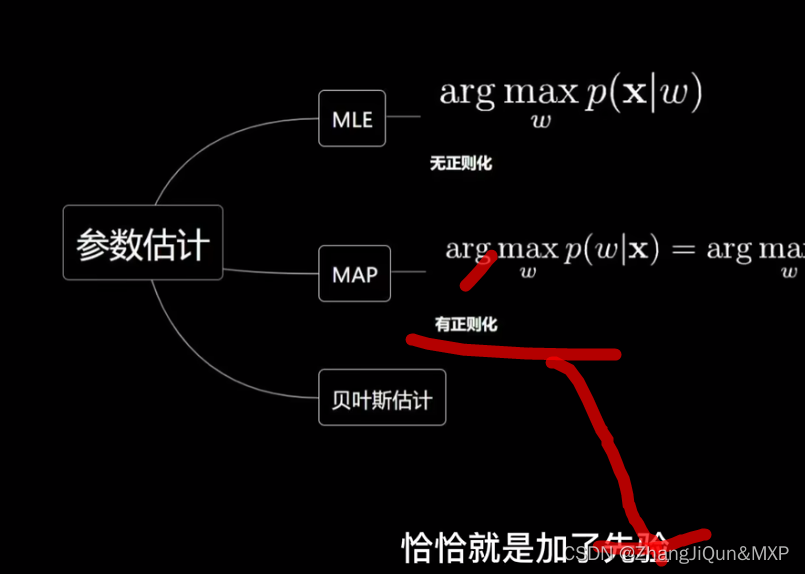

正则化==增加先验编辑

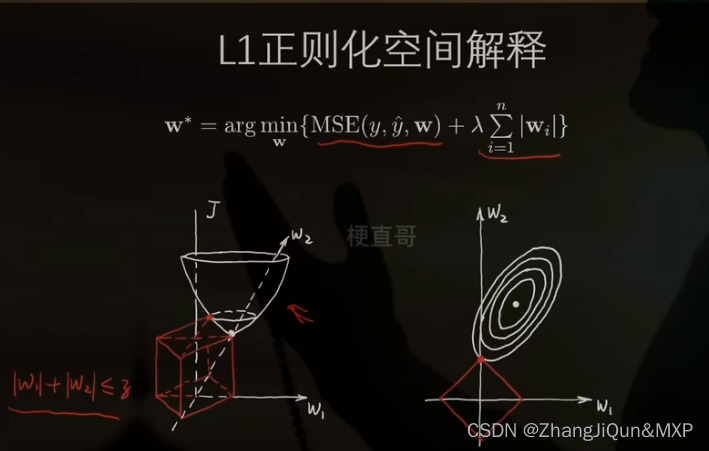

L1:绝对值 确保方向的正确性编辑

弹性网络正则:

最小化损失函数--最大化样本的似然概率分布

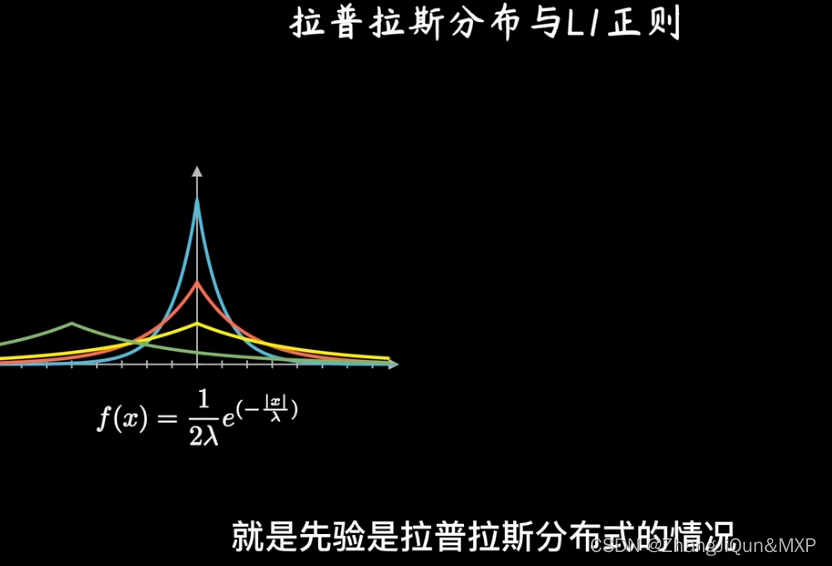

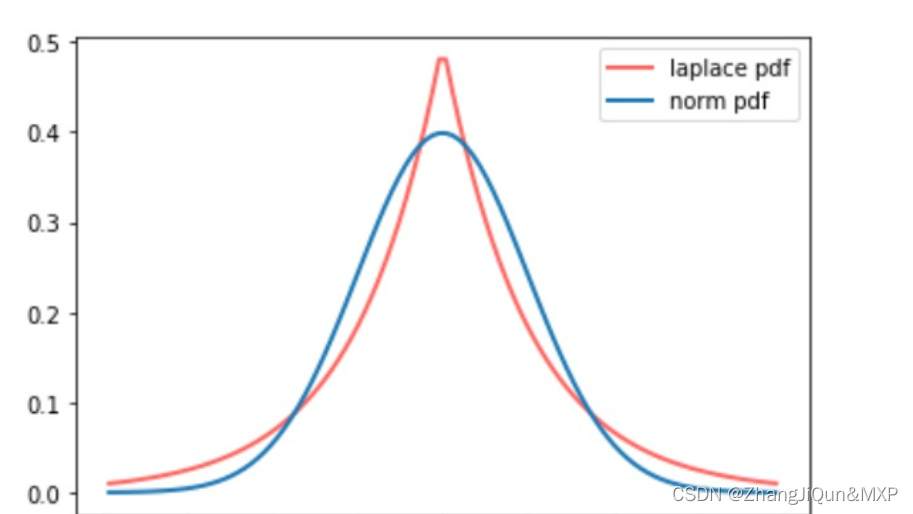

L1--先验是拉普拉斯分布式的情况编辑

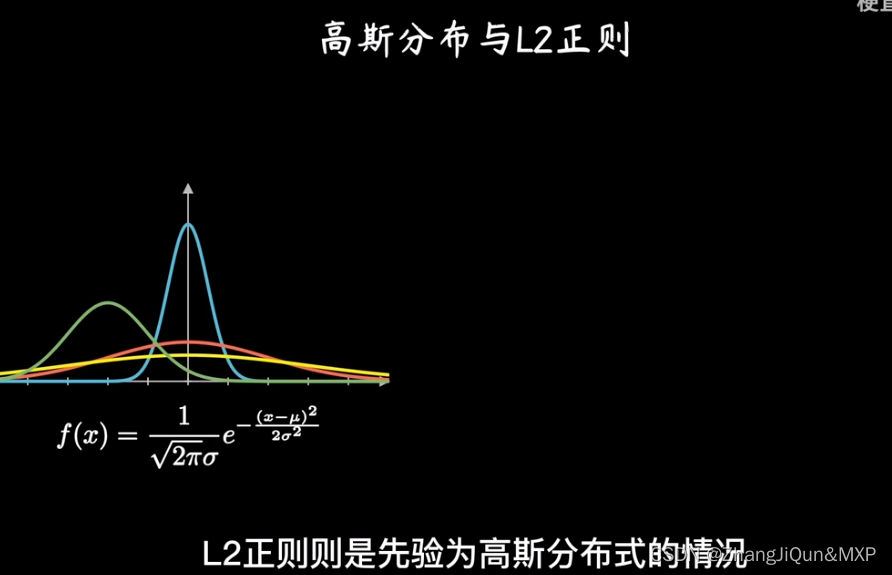

L2正则则是先验为高斯分布式的-高斯分布(正态分布) 编辑

正则化(增加模型参数,不要拟合的太真)

数学上解释正则化的作用

为什么参数小模型会简单

1、概率和统计是一个东西吗?

概率(probabilty)和统计(statistics)看似两个相近的概念,其实研究的问题刚好相反。

一句话总结:概率是已知模型和参数,推数据。统计是已知数据,推模型和参数。

显然,本文解释的MLE和MAP都是统计领域的问题。它们都是用来推测参数的方法。为什么会存在着两种不同方法呢?这需要理解贝叶斯思想。我们来看看贝叶斯公式。

2、贝叶斯公式到底在说什么?

贝叶斯公式就是在描述,你有多大把握能相信一件证据?(how much you can trust the evidence)

从这个角度总结贝叶斯公式:做判断的时候,要考虑所有的因素。 老板骂你,不一定是你把什么工作搞砸了,可能只是他今天出门前和太太吵了一架。

从这个角度思考贝叶斯公式:一个本来就难以发生的事情,就算出现某个证据和他强烈相关,也要谨慎。证据很可能来自别的虽然不是很相关,但发生概率较高的事情。 发现刚才写的代码编译报错,可是我今天状态特别好,这语言我也很熟悉,犯错的概率很低。因此觉得是编译器出错了。——别,还是先再检查下自己的代码吧。

3、似然函数

似然(likelihood)这个词其实和概率(probability)是差不多的意思,Colins字典这么解释:The likelihood of something happening is how likely it is to happen. 你把likelihood换成probability,这解释也读得通。但是在统计里面,似然函数和概率函数却是两个不同的概念(其实也很相近就是了)。

对于这个函数:

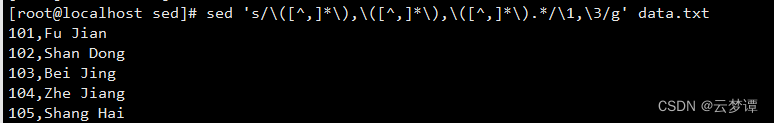

P(x|θ)

如果 θ 是已知确定的,x 是变量,这个函数叫做概率函数(probability function),它描述对于不同的样本点x,其出现概率是多少。

如果 x 是已知确定的,θ 是变量,这个函数叫做似然函数(likelihood function),它描述对于不同的模型参数,出现x这个样本点的概率是多少。

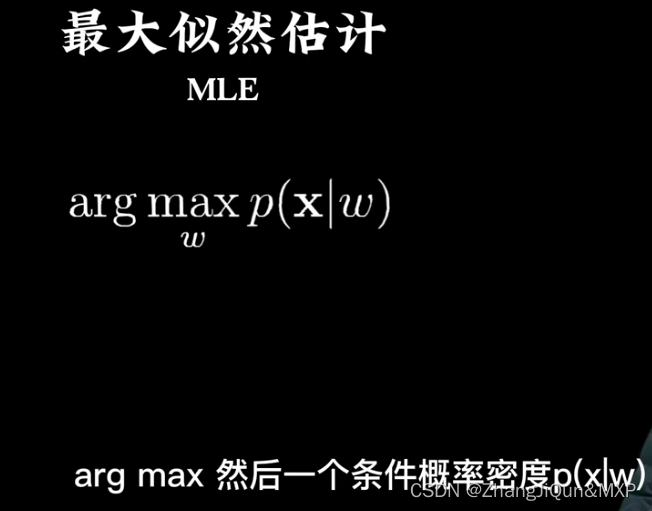

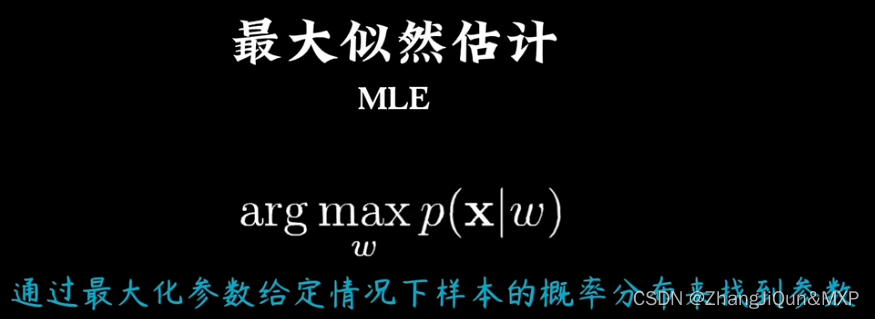

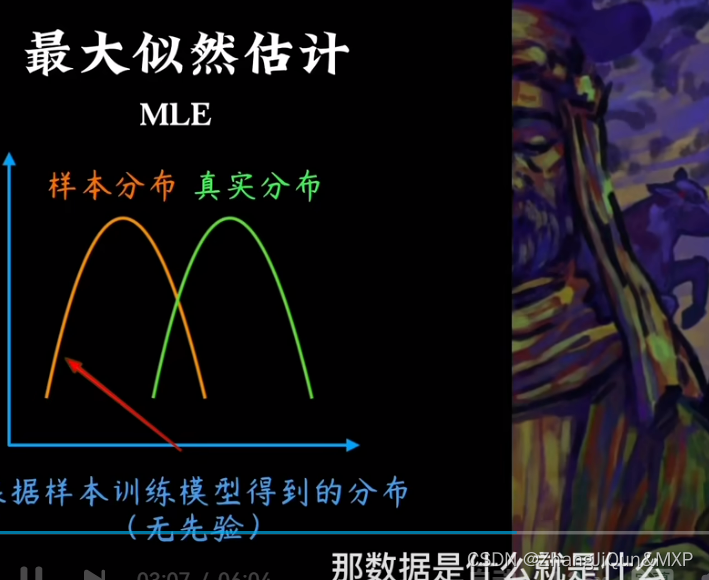

4、最大似然估计(MLE)

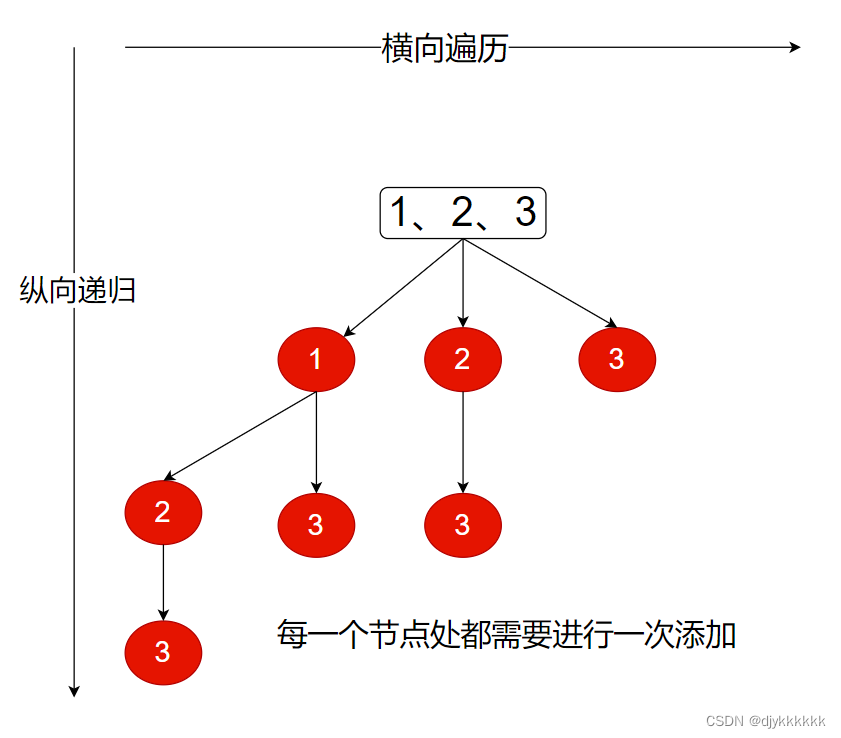

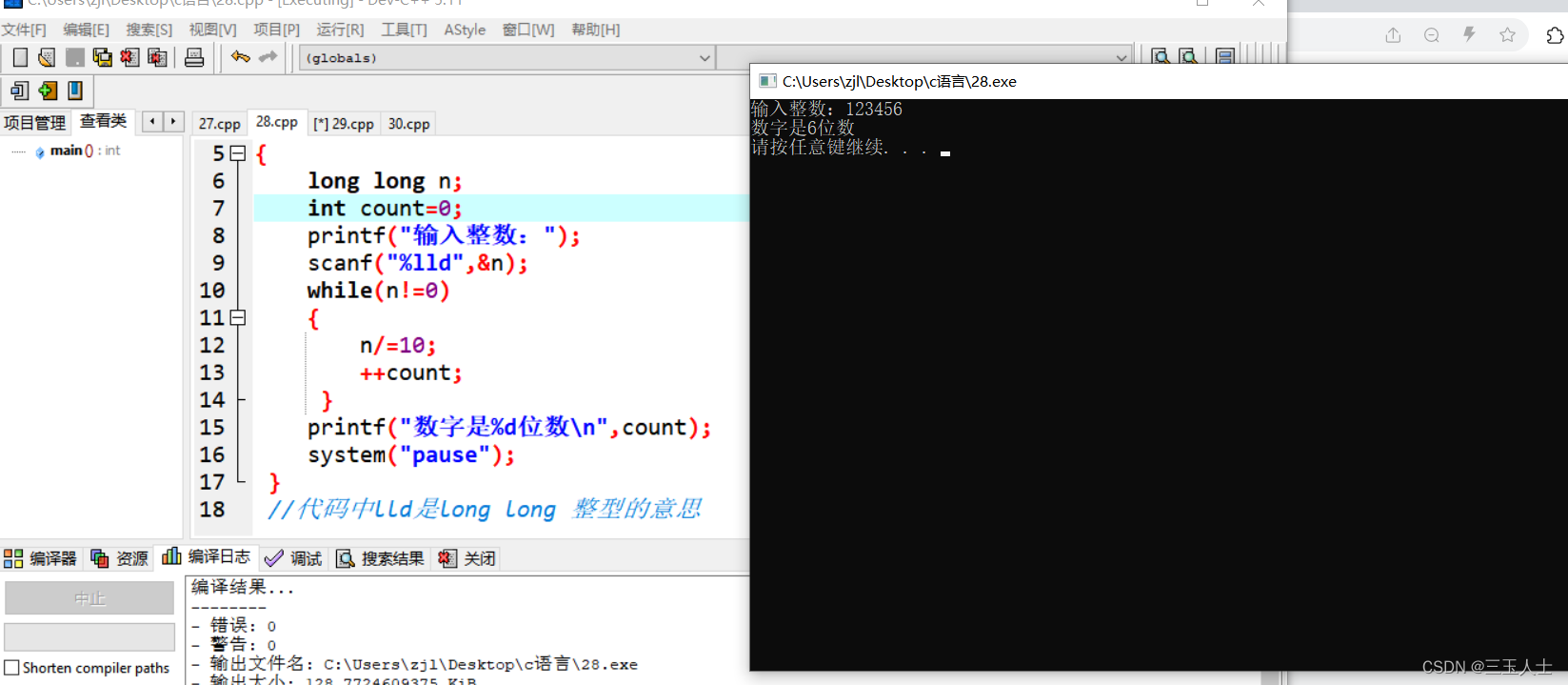

假设有一个造币厂生产某种硬币,现在我们拿到了一枚这种硬币,想试试这硬币是不是均匀的。这是一个统计问题,回想一下,解决统计问题需要什么?数据!

于是我们拿这枚硬币抛了10次,得到的数据是:反正正正正反正正正反。我们想求的正面概率 是模型参数,而抛硬币模型我们可以假设是二项分布。

那么,出现实验结果 (即反正正正正反正正正反)的似然函数是多少呢?

f(x,θ)=(1−θ)×θ...×θ×(1−θ)=θ7(1−θ)3

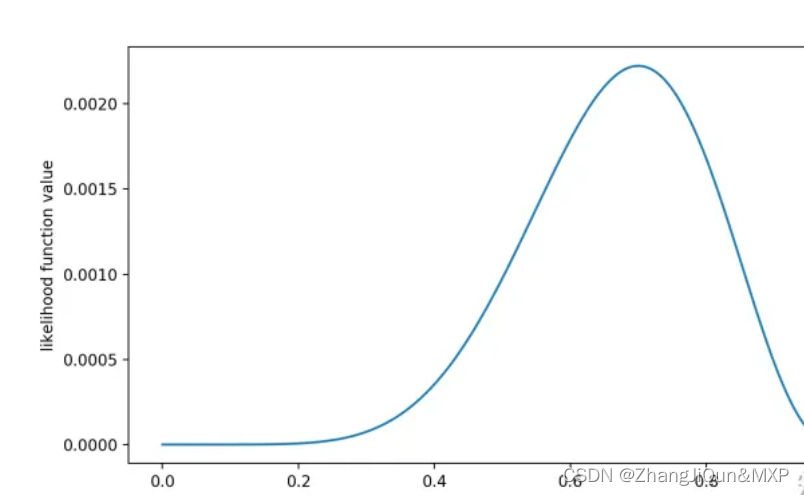

注意,这是个只关于 θ 的函数。而最大似然估计,顾名思义,就是要最大化这个函数。

对似然函数取对数,不会影响该函数的单调性,从而不会影响最后的计算的极值,也可以在一定程度上减少因计算而带来的误差,还可以极大的简化计算。

如果未知参数有多个,则需要用取对数的似然函数对每个参数进行求偏导,使得所有偏导均为0的值,即为该函数的极值点,一般也是其最大似然估计值。

可以看出,在 θ = 0.7 时,似然函数取得最大值。

我们已经完成了对 θ 的最大似然估计。

即,抛10次硬币,发现7次硬币正面向上,最大似然估计认为正面向上的概率是0.7。

似然:通过最大化参数给定情况下样本的概率分布来找到参数。根据已知概率求概率分布找到参数

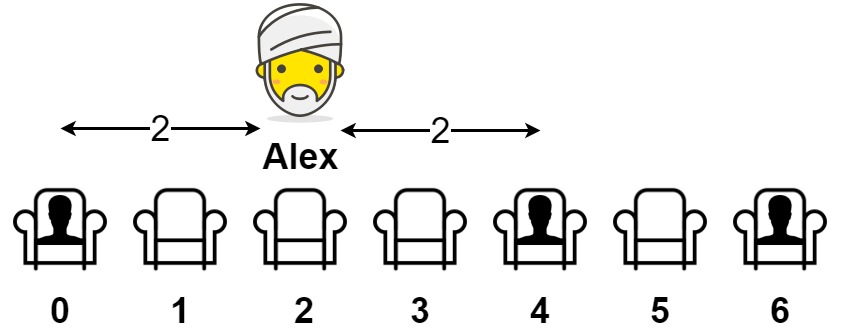

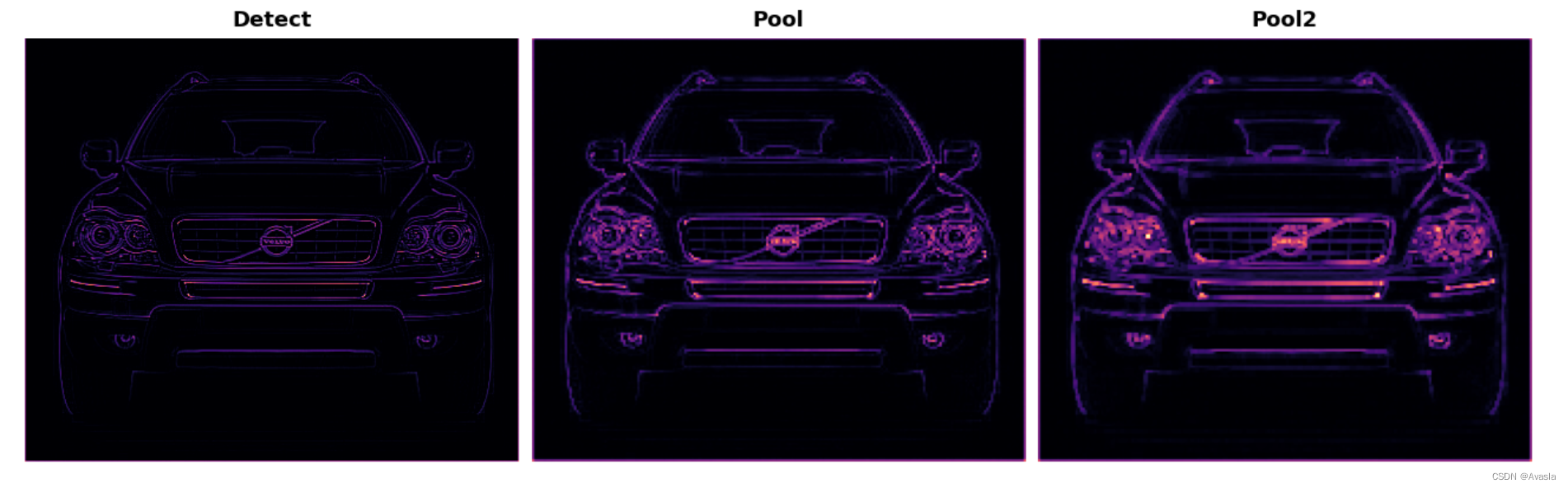

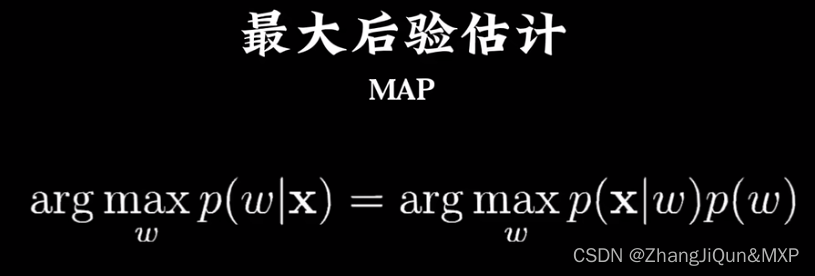

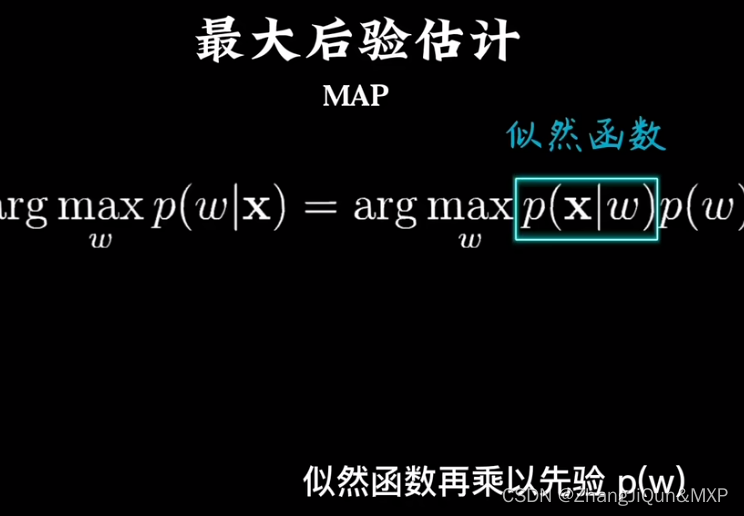

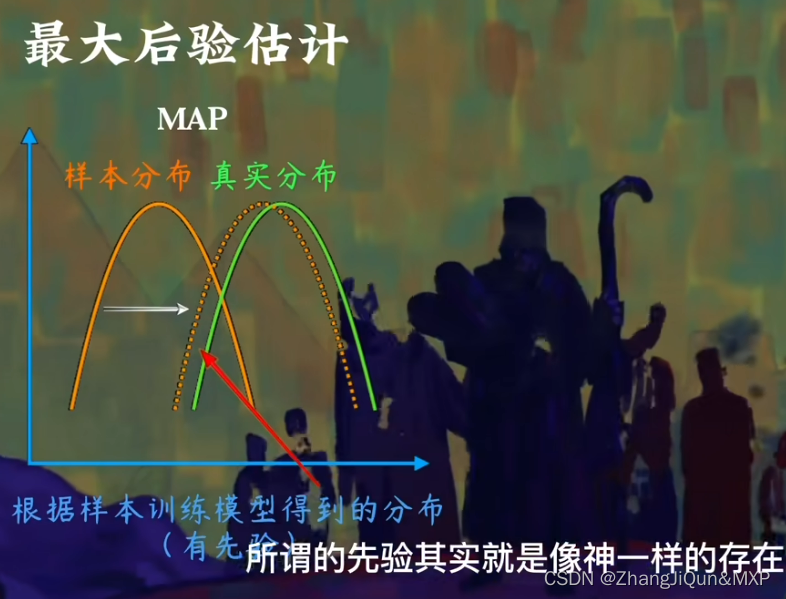

5、最大后验概率估计(MAP)

最大后验(Maximum A Posteriori,MAP)估计可以利用经验数据获得对未观测量的点态估计。它与Fisher的最(极)大似然估计(Maximum Likelihood,ML)方法相近,不同的是它扩充了优化的目标函数,其中融合了预估计量的先验分布信息,所以最大后验估计可以看作是正则化(regularized)的最大似然估计。 最大后验概率就是把他们的假设都进行计算(验算),然后选择其中假设最好的一个,当作最大后验概率。由于 θ 的取值范围在0到1之间,有无数种假设,但我们不可能每种假设都进行计算,这个时候,就需要利用一些简单的数学方法,求出最大的那一个,即为最大后验概率。

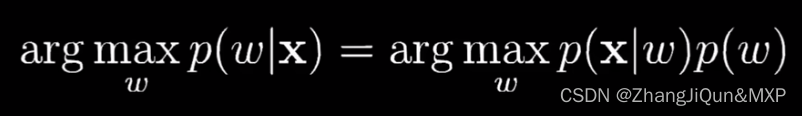

最大似然估计是求参数 θ ,使似然函数 P(x|θ) 最大。最大后验概率估计则是想求 θ 使 P(x|θ)P(θ) 最大。求得的 θ 不单单让似然函数大, θ 自己出现的先验概率也得大。(这有点像正则化里加惩罚项的思想,不过正则化里是利用加法,而MAP里是利用乘法)

P(θ|x)=P(x|θ)P(θ)P(x)

P(x) 是一个已知值(实验观察到的数据)假设“投10次硬币”是一次实验,实验做了1000次,“反反正正正反正正正反”出现了n次,则 P(x) = n/1000。总之,这是一个可以由数据集得到的值。

P(θ|x) 即后验概率,这就是“最大后验概率估计”名字的由来。

计算过程示例:将 θ 的概率分布假设为均值为0.5,方差为1的正态分布

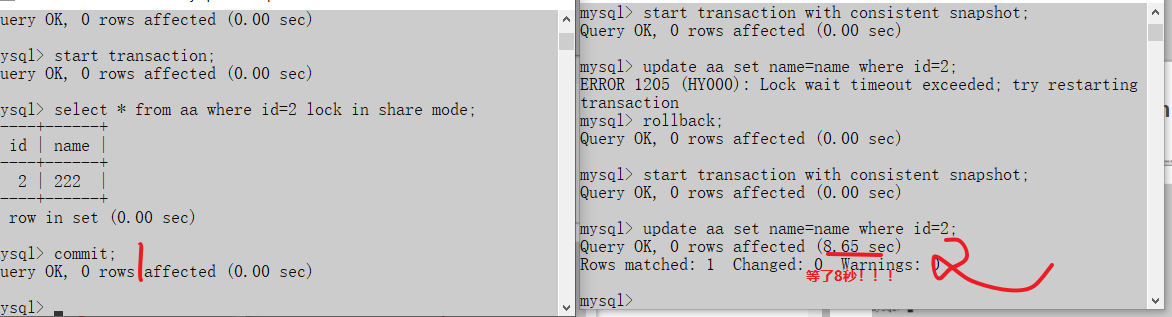

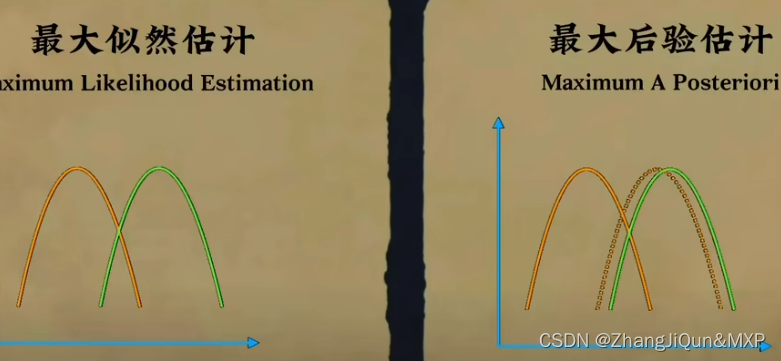

MLE VS MAP

最大似然函数(MLE)和最大后验概率估计(MAP)是两种完全不同的估计方法,最大似然函数属于频率派统计(认为存在唯一真值 θ)

最大后验估计属于贝叶斯统计(认为 θ 是一个随机变量,符合一定的概率分布),这是两种认识方法的差异。模型不变,概率是参数推数据,统计是数据推参数。

theta 为需要估计的参数,f 为概率,g 为先验估计,最大化后验估计通过 f·g 求得。当先验分布为常数时,最大后验估计与最大似然估计重合。

总结

最大似然估计与最大后验估计对比分析。

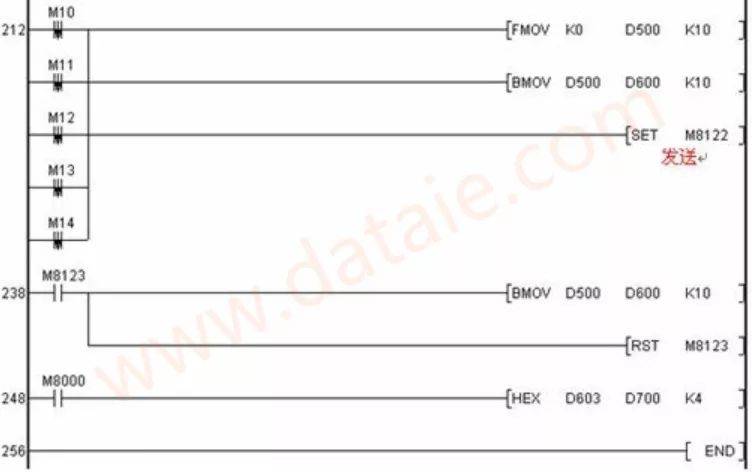

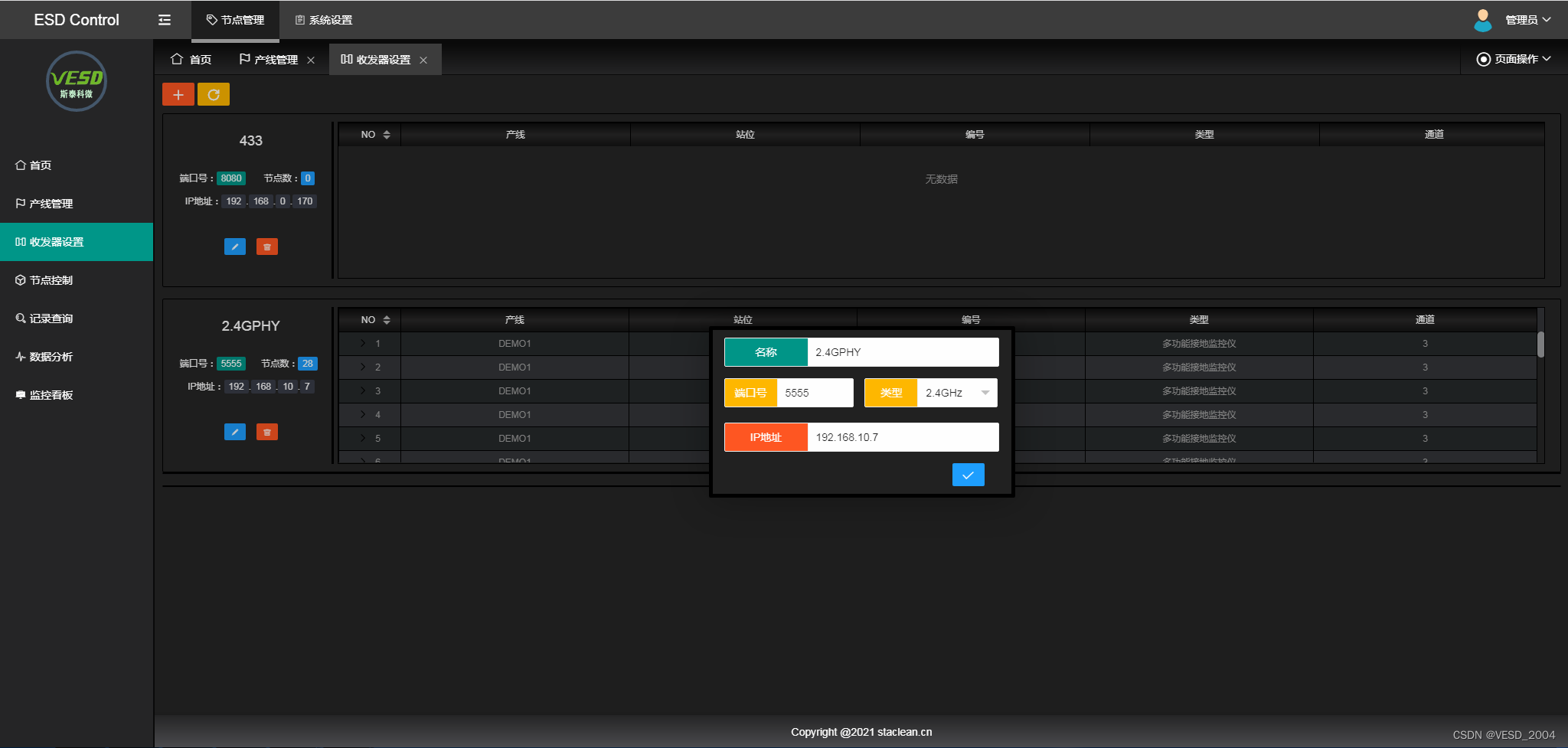

贝叶斯公式分成两派:唯物主义的频率学派,和唯心主义的贝叶斯学派

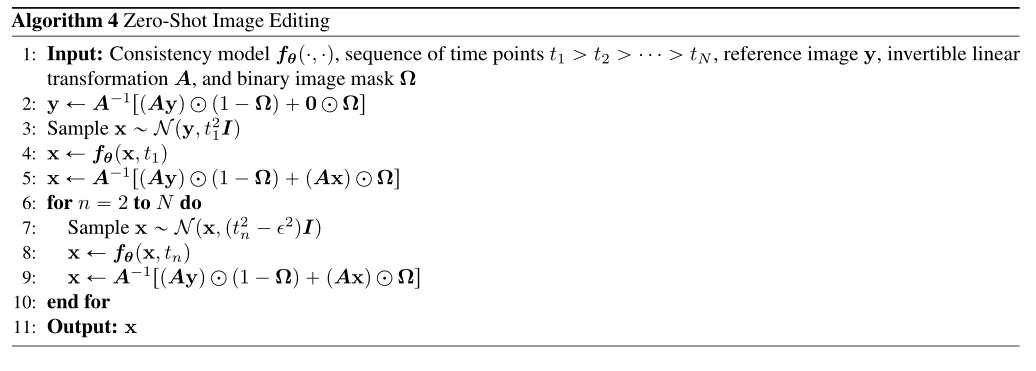

正则化==增加先验

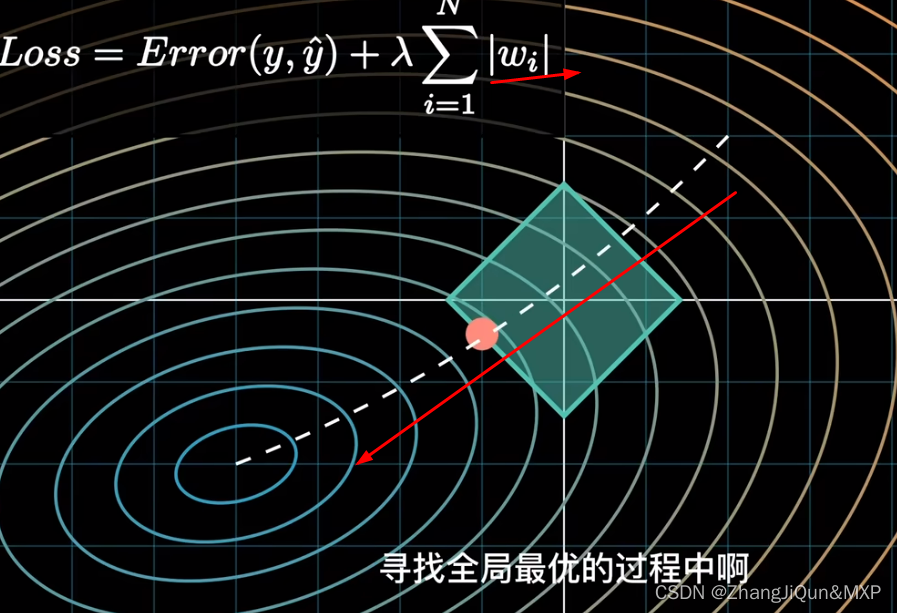

L1:绝对值 确保方向的正确性

弹性网络正则:

最小化损失函数--最大化样本的似然概率分布

L1--先验是拉普拉斯分布式的情况

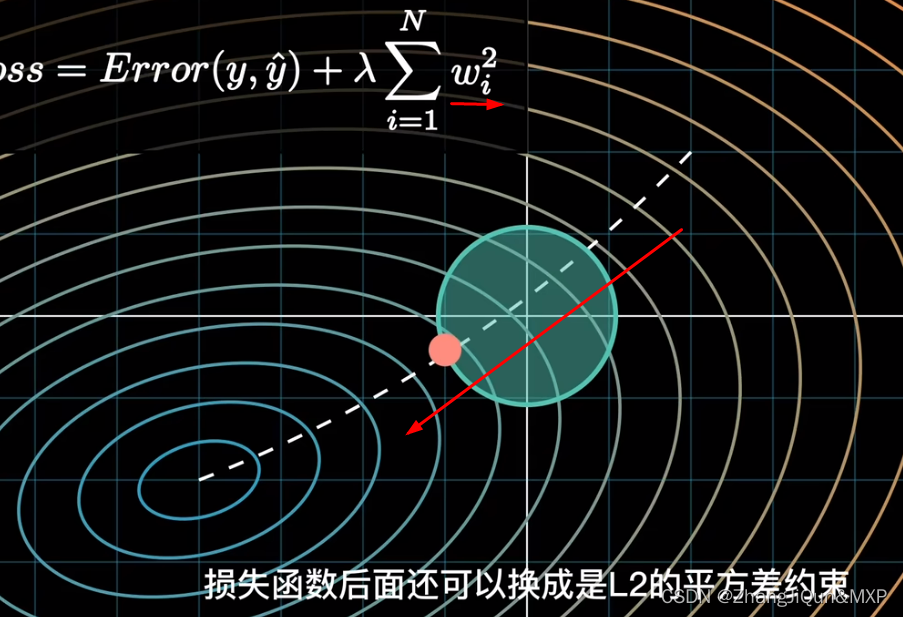

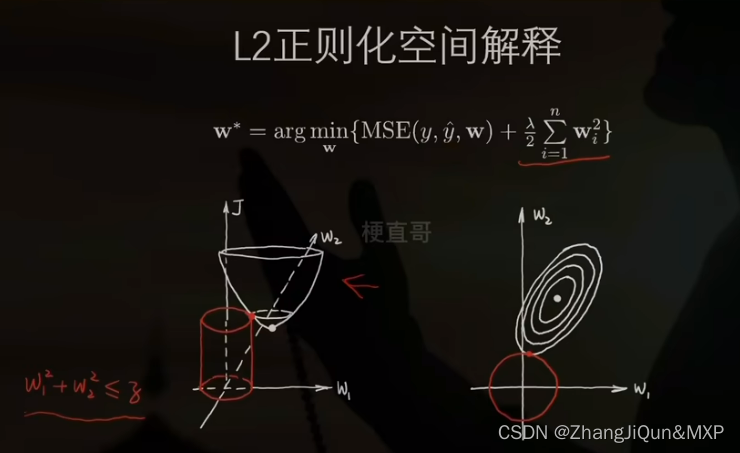

L2正则则是先验为高斯分布式的-高斯分布(正态分布)

正则化(增加模型参数,不要拟合的太真)

是一种常用的防止机器学习模型过拟合的技术。过拟合是指模型在训练数据上表现得太好,以至于它不能很好地推广到未见过的数据上。正则化通过引入一个惩罚项来限制模型的复杂度,使得模型在尽可能减小训练误差的同时,也要尽量保持模型的简单。

常见的正则化方法有L1正则化和L2正则化:

1. L1正则化(Lasso回归):L1正则化将模型的参数权重的绝对值之和作为惩罚项。这意味着模型的某些参数可能会变为零,从而使得模型更稀疏,也就是说模型会依赖于更少的特征。这也使得L1正则化具有特征选择的功能。

2. L2正则化(岭回归):L2正则化将模型的参数权重的平方和作为惩罚项。这使得模型的参数会被适度地缩小,但是不太可能变为零。这种方法可以防止模型的参数值过大,导致模型过于敏感。

在损失函数中引入这些正则项,模型在训练时不仅要最小化原始的损失函数(如均方误差、交叉熵等),还要尽量使得模型的复杂度(即参数的大小)保持较小。这种权衡使得模型在减小训练误差的同时,也要考虑模型的复杂度,从而防止过拟合。

正则化的选择和调整是一个重要的调参过程,选择合适的正则化方法和参数可以显著地提高模型的泛化性能。

数学上解释正则化的作用

假设我们有一个线性回归模型,其损失函数是均方误差(Mean Squared Error,MSE),表示为:

L(θ) = Σ(yi - θ*xi)^2

其中 θ 是模型的参数,xi 是输入,yi 是真实输出,Σ 是对所有训练样本的求和。

现在我们要在这个损失函数中引入一个正则化项。对于L2正则化(岭回归),我们添加的是参数的平方和;对于L1正则化(Lasso回归),我们添加的是参数的绝对值。我们将正则化参数表示为 λ,那么带有L2正则化的损失函数可以表示为:

L(θ) = Σ(yi - θxi)^2 + λΣθ^2

带有L1正则化的损失函数可以表示为:

L(θ) = Σ(yi - θxi)^2 + λΣ|θ|

现在我们的目标是最小化这个新的损失函数。这意味着我们不仅要使预测值与真实值之间的差异尽可能小,也要使模型的参数尽可能小。因为如果模型的参数较大,那么正则化项就会较大,损失函数就会较大。

这就是正则化如何在数学上鼓励模型保持较小的参数的原理。通过选择合适的正则化参数 λ,我们可以控制模型对拟合数据和保持参数小之间的取舍,从而防止过拟合。

需要注意的是,虽然正则化可以帮助防止过拟合,但如果正则化参数 λ 设置得过大,可能会导致模型过于简单,无法捕捉到数据的复杂性,这就是欠拟合。所以,选择合适的正则化参数是一个重要的任务,通常需要通过交叉验证或其他方式进行。

为什么参数小模型会简单

在机器学习中,模型的参数决定了模型的复杂性和拟合能力。参数的数量和大小都会影响模型的复杂性。

考虑一个线性模型的例子,该模型的形式为y = θ0 + θ1x1 + θ2x2 + ... + θn*xn。其中,θi是模型的参数,xi是输入特征。模型的输出y是输入特征和参数的线性组合。

如果参数θi的绝对值很大,那么对应的特征xi就会对模型的输出产生很大的影响。换句话说,模型对这个特征非常“敏感”。这可能会导致模型过于复杂,对训练数据中的噪声或异常值过度敏感,导致过拟合。

相反,如果参数θi的绝对值较小,那么对应的特征xi对模型的输出的影响就较小。这意味着模型对这个特征不那么敏感,模型的复杂性相对较低。

正则化就是通过添加一个与参数大小相关的惩罚项来鼓励模型保持较小的参数。这可以防止模型过于依赖某个或某些特征,使得模型对输入数据的各个方面都有适当的关注,从而提高模型的泛化能力。