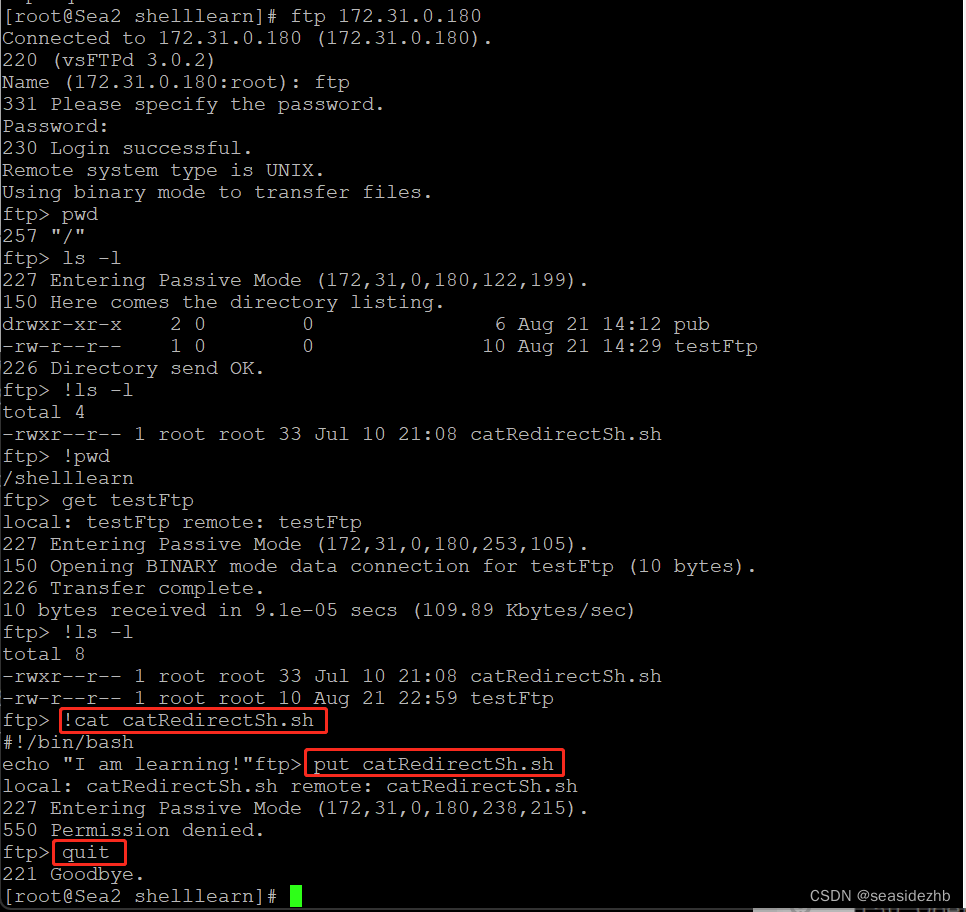

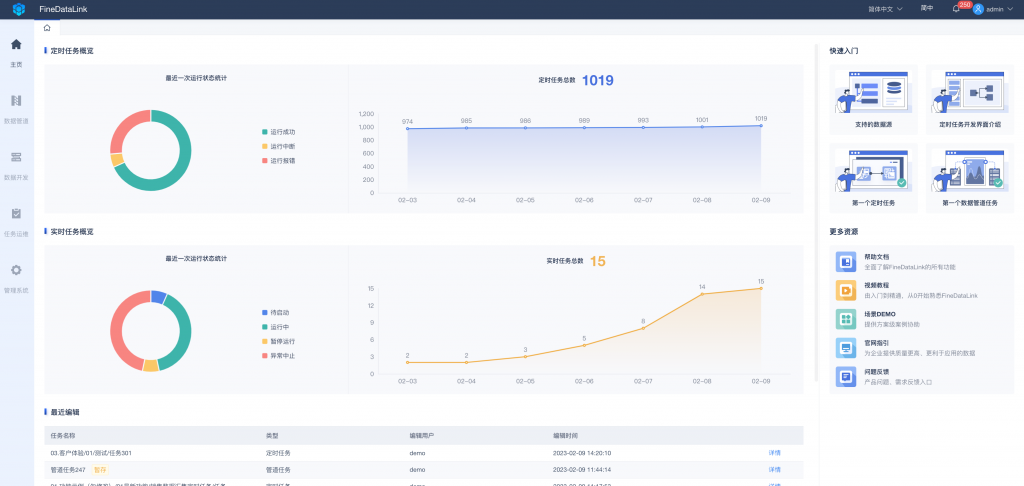

近日,来自清华大学、俄亥俄州立大学和加州大学伯克利分校的研究者设计了一个测试工具——AgentBench,用于评估LLM在多维度开放式生成环境中的推理能力和决策能力。研究者对25个LLM进行了全面评估,包括基于API的商业模型和开源模型。

他们发现,顶级商业LLM在复杂环境中表现出强大的能力,像GPT-4这样的顶级模型能够处理宽泛的现实任务,明显优于开源模型。研究者还表示,AgentBench是一个多维动态基准测试,目前由8个不同的测试场景组成,未来将覆盖更广的范围,更深入地对LLM进行系统性评估。

▷图源:arXiv官网