除了上篇文章介绍到的基于复杂关系建模的知识表示方法,我们还有多种基于平移模型而改进的知识图谱知识表示方法,并且它们都是对关系的深入建模。可以将它们归为两类,分别是知识图谱结构建模和知识图谱多源信息融合建模。这也对应了之前说的,知识图谱表示主要解决的问题就是实体与关系的表示,以及种类众多,外部信息如何融入进去。

知识图谱结构建模

一、基于关系路径的知识表示学习

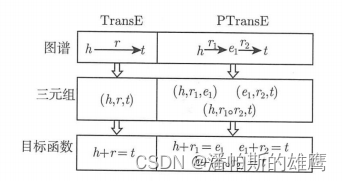

TransE及其扩展模型往往只考虑了实体之间的直接关系,但事实上

,知

识图谱中的

实体之间的

多步关系路径 蕴含了丰富的语义信息,考虑关系路径的特征对我们更好地进行知识表示。所谓的 关系路径是指从一个实体到另一个实体的关系序列,一般来说由若干个三元组构成且其中每个三元组的尾实体是另一个三元组的头实体。

那么应该如何表示出这种多步关系路径呢?我们假设存在一定数量的资源,从头部实体流出,且将沿着给定路径流动,使用最终流向尾部实体资源总量来衡量路径作为 之间连接路径的可靠性。

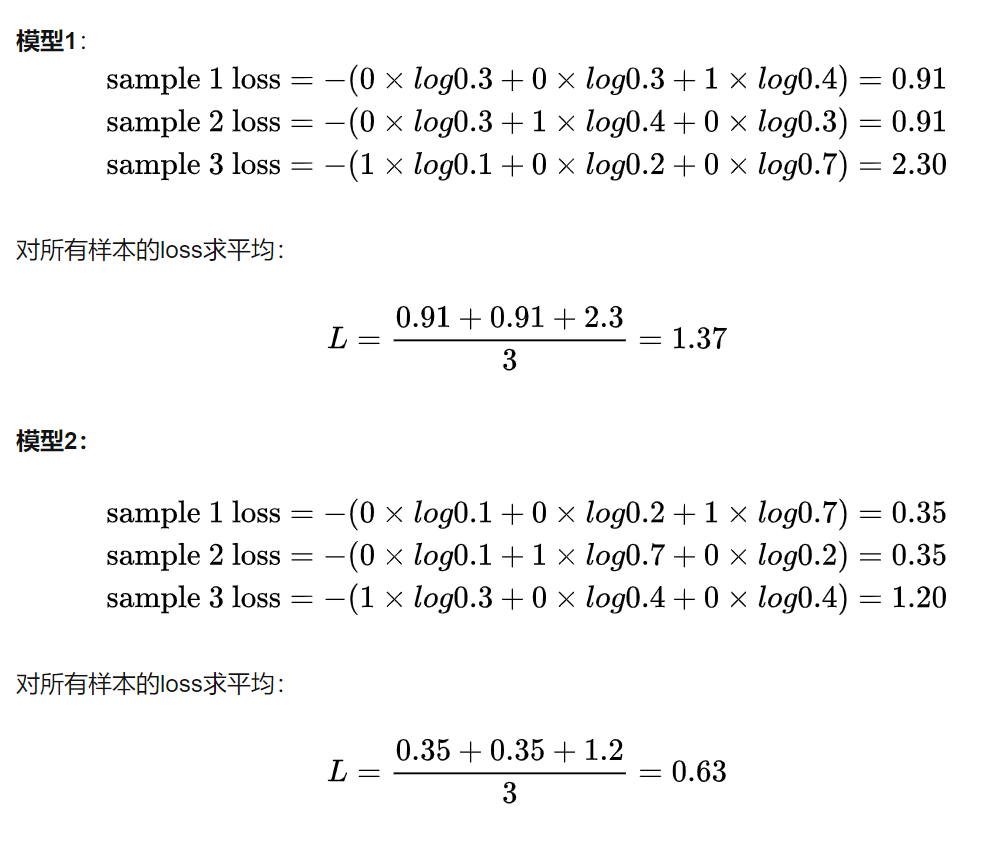

我们提出了3中关系路径的表示方法:

和: p = r 1 + r 2 + · · +rl 积: p= r1 · r2 · r3 ····· rl 循环神经网络: p = cl ,其中 cl 是 RNN 在序列r1, r2, ···, rl上产生的最后一个状态 二、基于属性关系建模的知识表示学习

TransE 模型的最大局限是无法准确地建模一对多、多对一和多对多关系,这促使我们认真审视知识图谱关系的多样性特征,以寻求针对此问题的改进方案。通过观察发现,在许多大规模知识图谱中, 关系可以划分为两大类 ,一类关系指示实体的特征 尾实体 通常是抽象概念,如性别和职业 ,而另 类关系则指示实体之间的联系 头尾实体都是真实世界的物体 ,我们将二者分别命名为属性和关系。

通过 将两种类型的实体关系用不同的方法分别建模将有助于知识表示模型对复杂关系的建模能力。

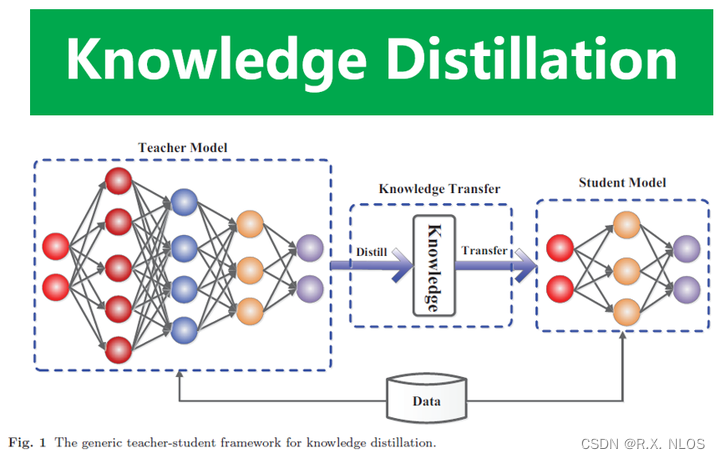

知识图谱融合多源信息建模 一、融合实体描述信息的知识表示学习

实体描述是对实体自身信息的浓缩精练的文字性介绍,通常由几句话或者一个段落组成。实体描述的来源十分丰富,既可以在知识图谱构建过程中由人工填写,也可以提取自百科类数据库的既有信息,还能从丰富的网页文本中抽取。实体描述蕴含着丰富的

实体信息,这些信息能够作为知识图谱中置信度较高的结构化信息的辅助信息,帮助模

型构建更准确的知识表示。

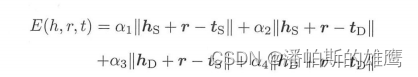

如上是这种思想的整体架构。由于需要将文本空间和知识空间联合表示学习,所以对应的评分函数也需要进行融合,如下图:

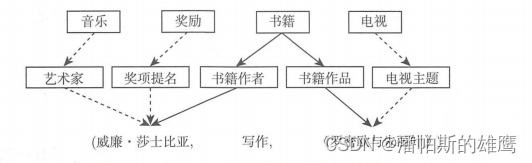

二、融合层次类型信息的知识表示学习

传统的知识表示方法(如TransE

及其扩展模型)仅使用知识图谱之间的关系信息作为监督信号对实体嵌入施加约束,但实际上

实体层次类型 也能够为表示学习提供大

量重

要的信息,加深模型对实体与三元组的理解。由于实体层次类型信息往往具有人工定义

的结构化体系,它可以被看作一 种较为准确的先验知识。 一

些广泛使用的大规模知识图

谱(如 Freebase

DBpedia

等)及常见的百科类数据库(如维基百科等)都维护着一套自己

的实体层次类型信息。

三、融合实体图像信息的知识表示学习

图像信息是人类能够自然接收并认知的信息之

一,

以图像形式储存的信息往往更加

灵活和丰富。研究结果表明,人类每日从外界进行的信息获取与交互行为中,很大一部

分是通过视觉来完成的。通过图像信息的帮助

,我

们往往得以

从多角度全方位地理解实体在文字或结构化信息之外的知识细节 。主体部分描述指定实体的实体图像能够提供对应实体自身外形、行为和其他相关实体的视觉信息。

可以使用基于深度神经网络的图像表示模块抽取实体图像的特征,然后将图像特征映射到知识空间中,并针对实体图像的多样例学习提出基于注意力的模型,最终构建实体基于图像的表示。