知识图谱顶会小记

论文标题

Temporal Knowledge Graph Reasoning with Historical Contrastive Learning

论文链接

https://arxiv.org/pdf/2211.10904.pdf

GitHub地址

https://github.com/xyjigsaw/CENET

关键词

Linked Open Data, Knowledge Graphs & KB Completion, Applications, Mining of Spatial, Temporal or SpatioTemporal Data, Web Search & Information Retrieval

主要内容

时序知识图谱

传统的知识图谱是一个静态知识库,它使用图结构的数据拓扑,以三元组(s,p,o)的形式集成时间,s是主体实体,o是对象实体,p是一个关系类型。在现实世界中,知识不断发展,形成了时序知识图谱的应用,从三元组变成了四元组。

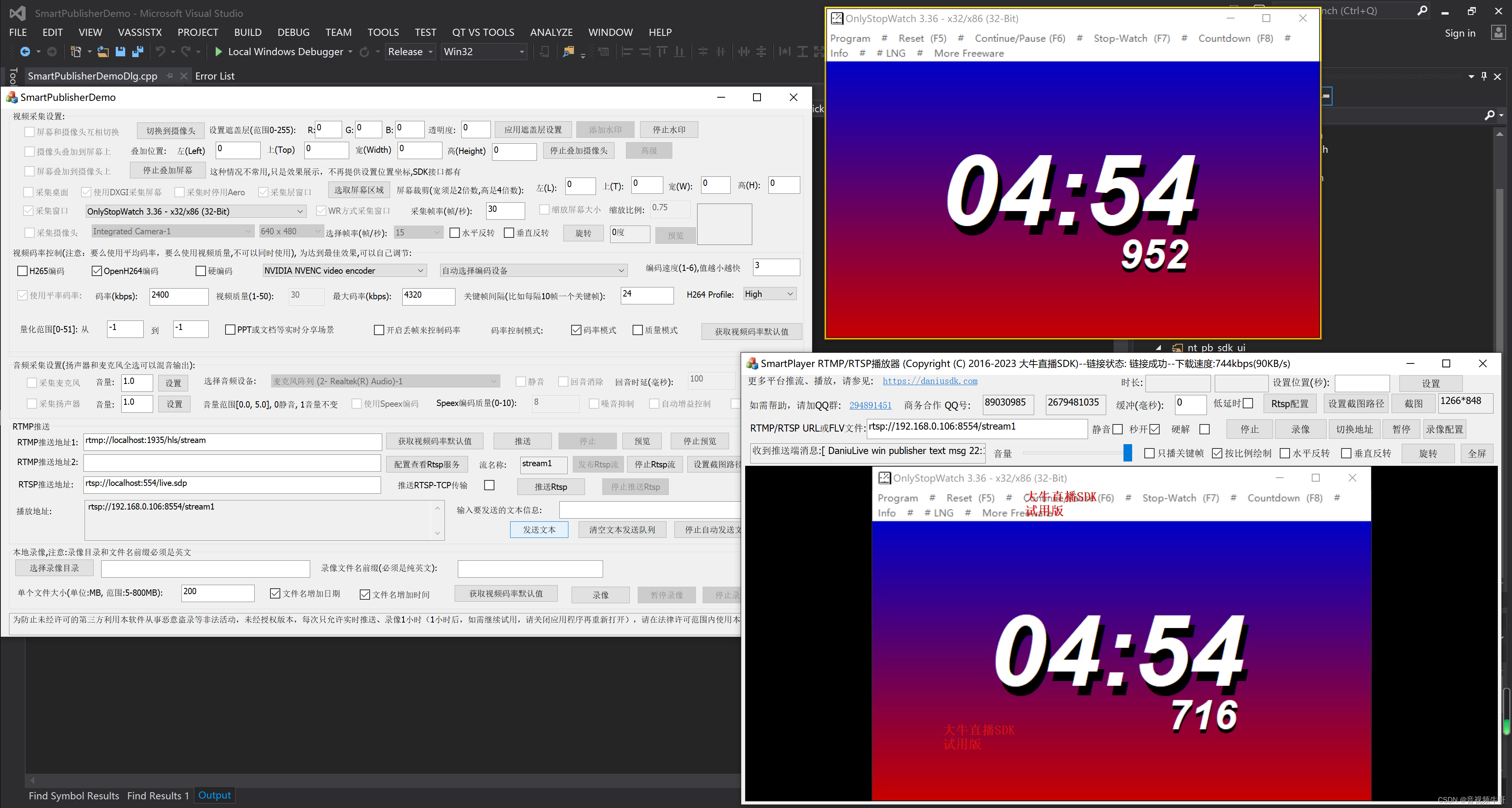

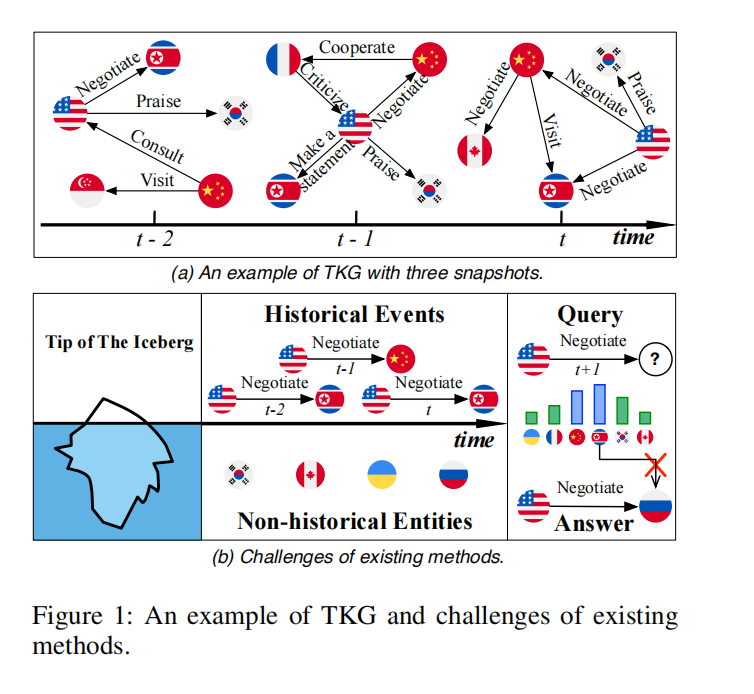

从下面图A可以看出来,一个时序知识图谱由多个快照组成,同一快照中的事实同时出现,一些事情会重复发生或者出现新的事件。

时序知识图谱为许多应用提供了新的视角,比如决策、股票预测和对话系统。

在本文中,关注使用时序知识图谱预测未来,也被称为图谱外推。作者的目标是预测在训练集中没有观测到的未来时间戳t,比如(s,p,?,t)等查询的缺失实体。

提出问题

本文专注于在TKG上预测未来事件。为了对TKG的结构和时间特征进行建模以用于未来事件预测,一些主流模型利用自回归的方法可以和容易的预测重复或者周期性事件 。然而,在ICEWS也就是综合危机预警系统中,以前从来没有发生的新时间约占40%。

预测这些新事件很有挑战性的,因为他们在整个时间轴上有更少的时间交互痕迹。但是在这些事件中,由于关注频繁出现的事件,大多数现有方法经常在这些查询中获得不正确的结果;此外,在推理过程中,现有的方法对整个图中整体候选实体的概率分数进行排序,没有任何偏差,但是我们认为当接近不同事件的缺失实体时,偏差是必要的。

对于重复的或周期性的事件,模型被期望优先考虑一些频繁发生的实体,而对于新的事件,模型应该更多地关注那些具有较少历史交互的实体。

本文工作

在这篇文章中,将超越历史信息的极限,从整个知识中挖掘潜在的时间模式。为了更清晰地阐述我们的设计,我们将与当前查询中的实体相关联的过去事件称为该查询历史事件,其他事件称为非历史事件,它们对应的实体分别被称为历史实体和非历史实体。我们直观的认为,TKG不仅与历史事件有关,而且还与未观察到的潜在因素间接相关。

我们提出一种新的TKG推理模型,称为CENET(对比事件网络)。给定真实的尾实体为 o 的查询(s, p, ?, t)。CNENT 考虑其历史和非历史事件,并通过对比学习识别重要实体。特别地,将采用基于复制机制的评分策略来建模历史和非历史事件的相关性。此外,所有的查询都可以分为两个类:为实体为历史实体或者非历史实体。

因此,CENET自然地使用监督对比学习来训练这两类查询的表示,进一步帮助训练输出为布尔值的分类器,以识别哪种实体应该得到更多的关注。在推理过程中,CENET结合了历史和非历史依赖关系的分布,并根据分类结果进一步考虑了基于掩码策略的高度相关的实体。

CENET能够同时学习历史和非历史依赖性,以区分最有潜力的实体,这些实体可以最好地匹配给定的查询。同时,它还训练查询的表示,通过对比学习来判断当前时刻是更依赖于历史事件还是非历史事件。这些表示进一步帮助训练一个二元分类器,其输出是一个布尔掩码,用于指示搜索空间中的相关实体。在推理过程中,CENET采用基于掩码的策略来生成最终结果。

本文贡献如下:

- 我们提出了一个被称为CENET的TKG模型,用于事件预测。CENET可以通过联合调查历史和非历史信息,不仅可以预测重复的和周期性的事件,还可以预测潜在的新事件;

- CENET是第一个将对比学习应用于TKG推理的模型,训练查询的对比来识别高度相关的实体;

- 作者在五个基准图上评估了他们提出的模型,结果表明,CENET在大多数指标上显著优于所有现有方法,在基于事件的数据集上至少相对于先前最先进的baseline提高了8.3%的Hits@1

related work

时序知识图谱推理

有两种方法,第一种是插值:目标在t0-tn之间,也是TKG补全;第二种是外推,预测tn之后可能发生的事件,比如tn之后的y q = (s, p, ?, t) (or (?, p, o, t))。

对比学习

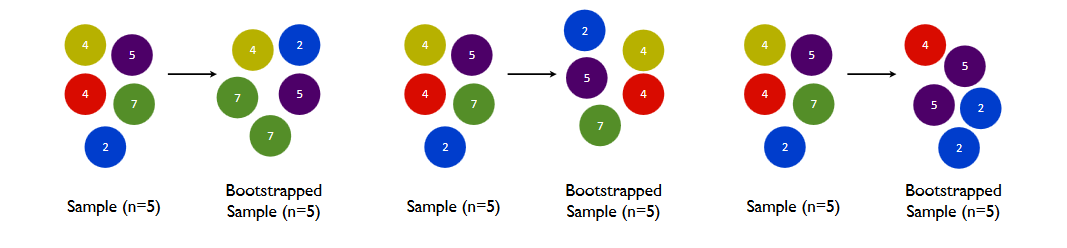

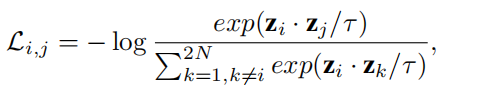

是一个自监督的学习范式,大多数方法都是从随机抽样的N个小样本中获得增例,得到2N给样本,优化 一对正样本的损失函数。

method

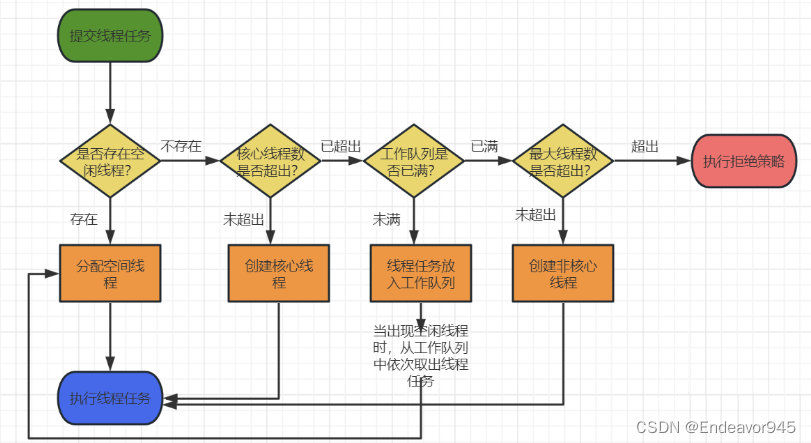

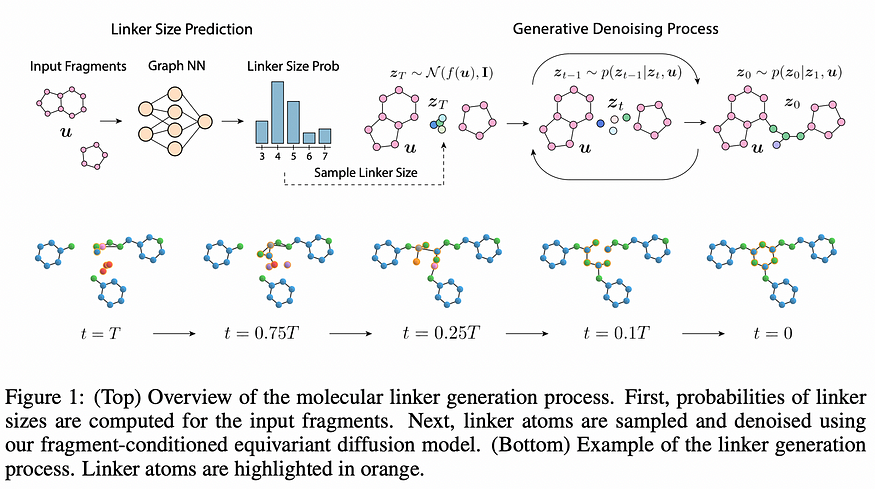

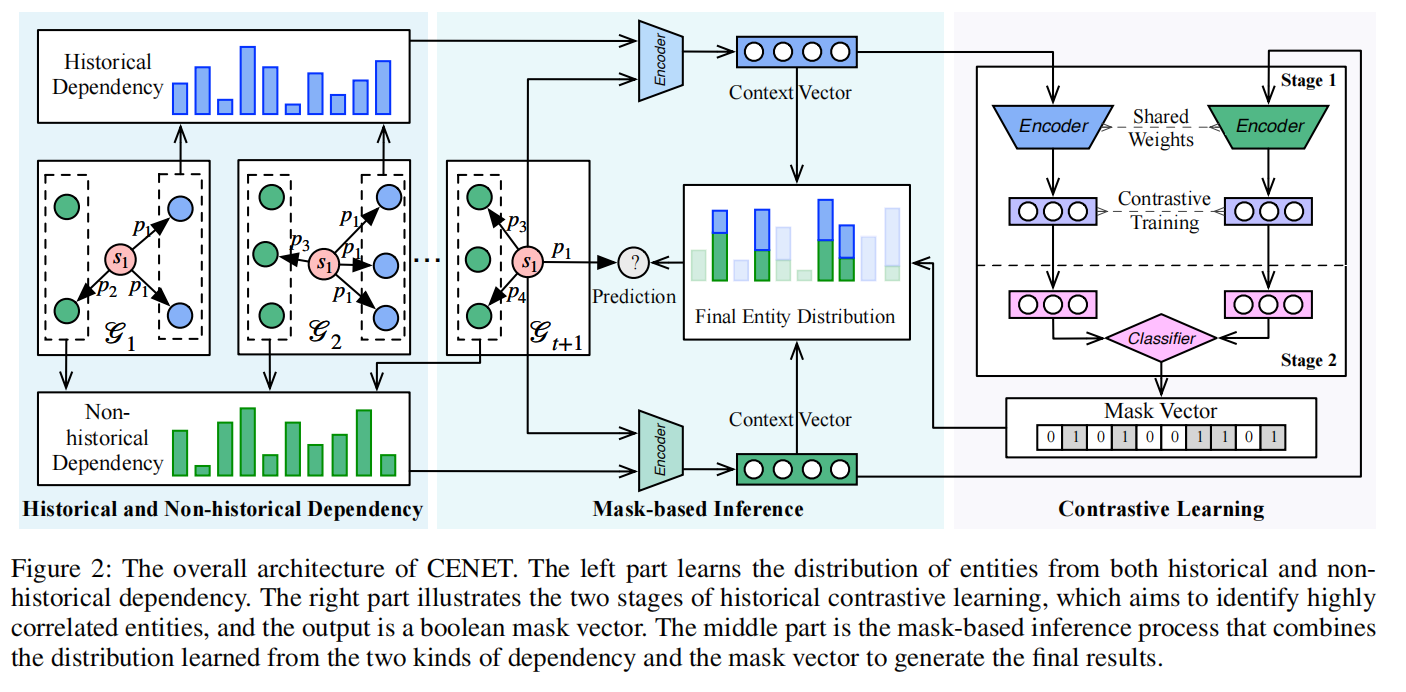

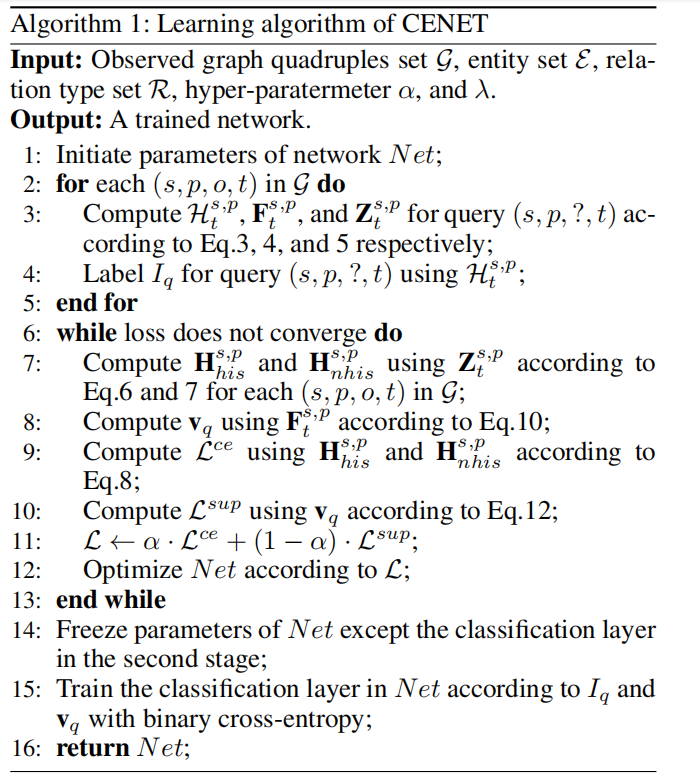

左边的部分是从历史和非历史的的依赖关系中学习实体的分布;右边的部分说明了历史对比学习的两个阶段,旨在识别高度相关的实体,输出一个布尔掩码向量;中间是基于掩码的推理过程,它结合了从两种依赖性中学习到的分布和掩码向量来生成最终结果。

CENET捕获了历史和非历史的依赖关系,同时它利用对比学习来识别高度相关的实体,进一步采用了基于掩码的推理过程进行推理。

准备工作

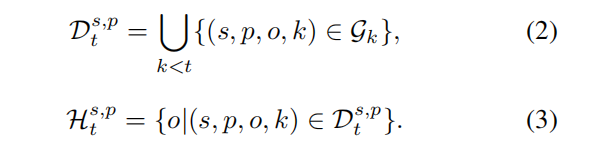

- (2)是历史事件集

- (3) 是历史实体集

历史和非历史的依赖关系

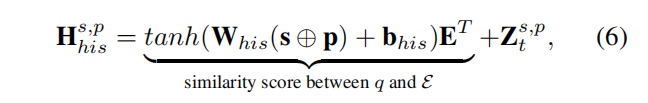

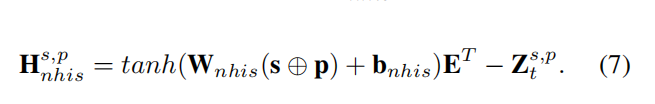

模型采用基于复制机制的评分策略来建模历史事件和非历史事件相关性

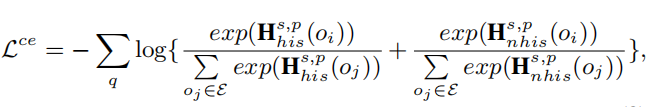

从历史和非历史事件中学习的训练目标是尽量减少一下损失

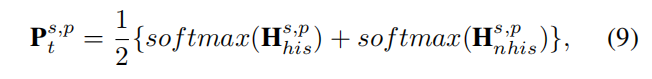

推理过程中,CENET将上述俩个潜在上下文向量的softmax结果作为所有对象实体的预测概率

其中具有最大值的实体是组件预测的最可能的实体。

历史对比学习

许多重复的和周期性的事件只与历史实体相关联,此外对于新的事件,现有的模型很可能会忽略那些历史交互较少的实体并预测那些经常与其它事件交互的错误实体。所提出的历史对比学习训练查询的对比表示,以在查询级别上识别少量高度相关的实体。

在有监督的对比学习中包括俩个阶段,引入Iq来表示缺失的对象是否在历史实体中,1的话就是在,0就是不在。引入两个阶段的目的是训练一个二值分类器,以推断查询q的布尔标量的值。

- 学习对比性表征:通过最小化有监督的对比损失来学习查询的对比表示。

- 训练二进制分类器:第一阶段训练结束之后,CENET冻结第一阶段的相应参数的权重,包括E,P及其编码器;然后将vq也就是给定查询q的嵌入向量输入到一个线性层,根据真实值Iq使用交叉熵损失训练一个二元分类器。现在,分类器可以识别查询q的缺失对象实体是否存在于历史实体集合中。推理过程中生成的布尔向量根据预测的Iq确定应该关注哪些类型的实体,以及尾实体是不是在历史实体中;布尔向量等于1的时候,实体在正位置中的概率增加,反之亦然,也就是说,如果缺失的对象被预测在历史实体中,那么历史集中的实体将得到更多关注否则非历史实体更有可能被考虑。

实验

数据集和baseline

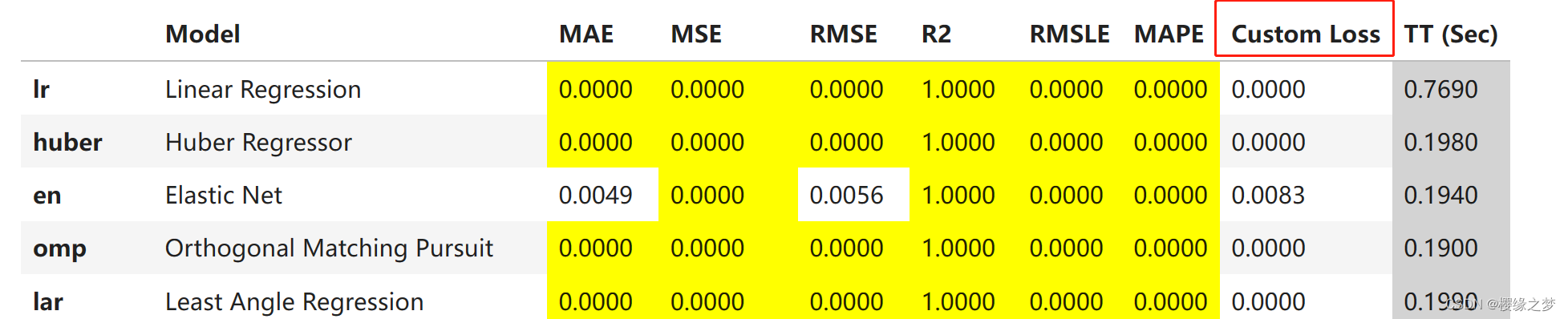

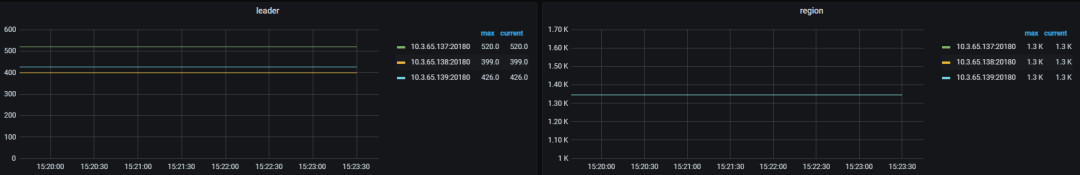

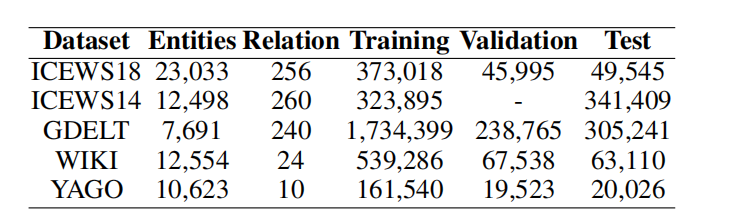

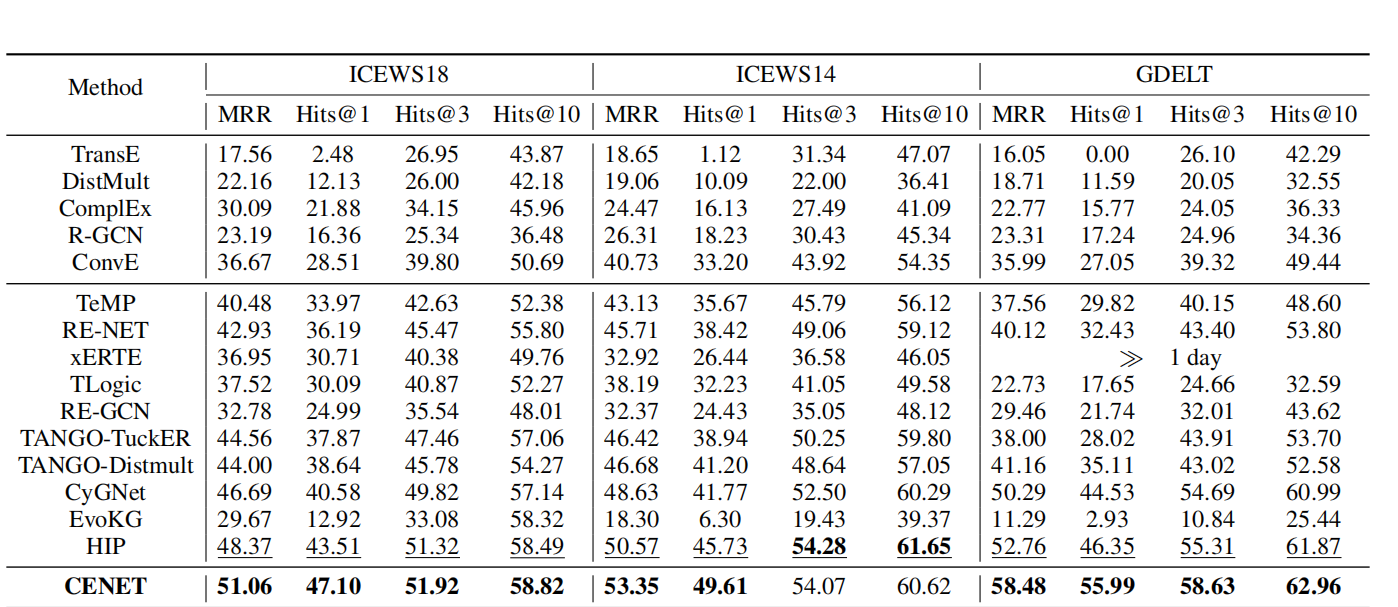

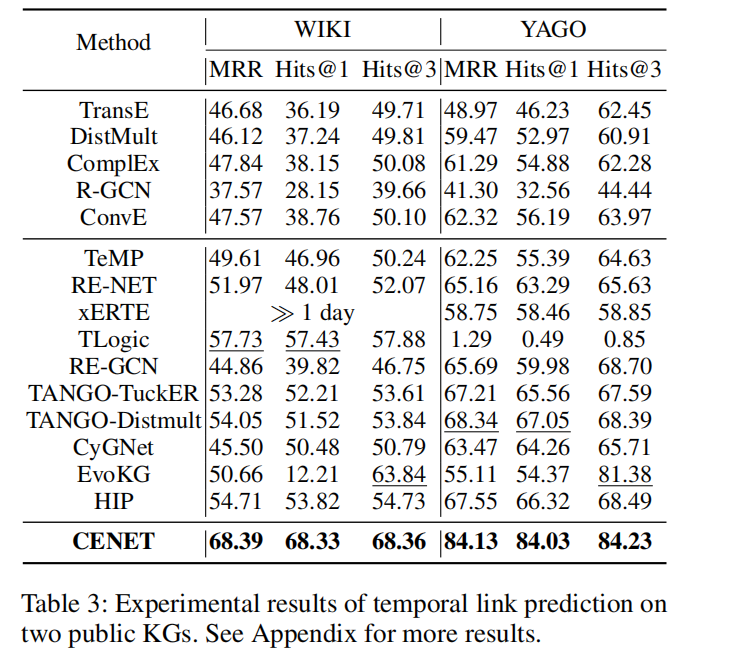

选取了15个业界最新的TKG推理模型作为基线,并采用Mean Reciprocal Ranks (MRR) 和 Hits@1/3/10 (the proportion of correct predictions ranked within top 1/3/10)作为评价指标。下表给出了结果。结果表明,CENET在大多数指标上明显优于所有现有方法,在基于事件的数据集上,与以前最先进的基线相比,Hits@1至少获得了8.3%的相对提升。

基于事件的TKG对比实验结果

公共KG对比实验结果

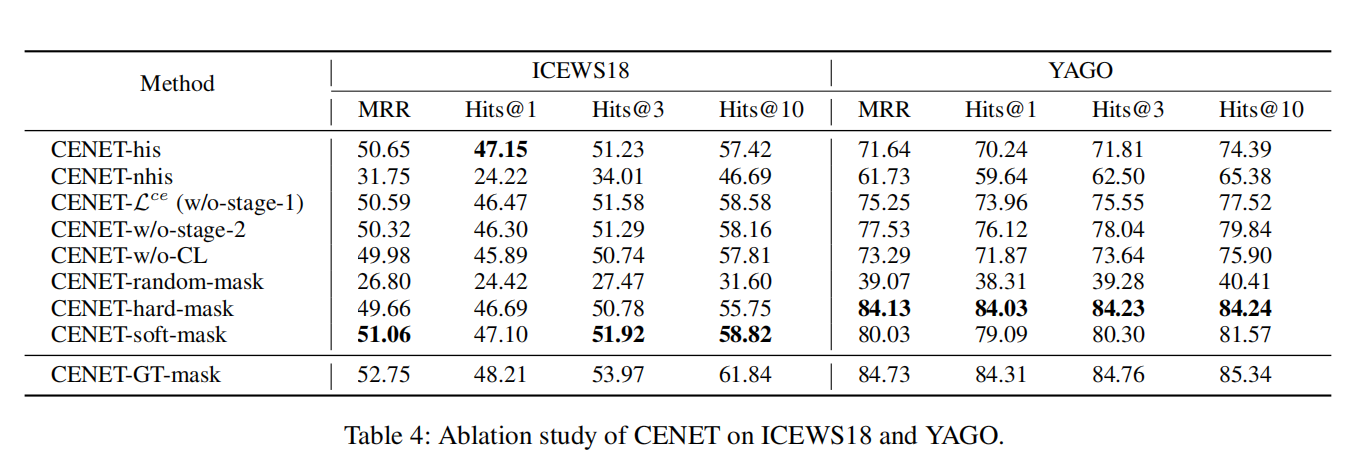

消融实验

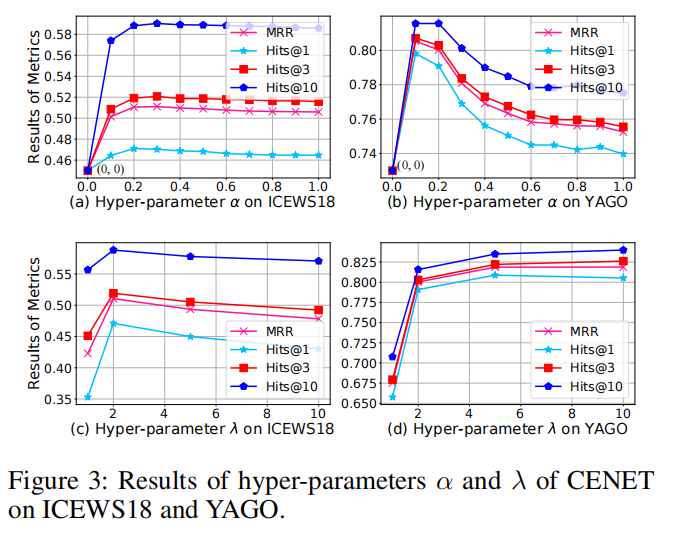

超参数分析

结论

在本文中,作者提出了一种新的时间知识图表示学习模型,对比事件网络(CENET),为事件预测。CENET的关键思想是学习整个实体集的一个令人信服的分布,并在对比学习的框架下从历史和非历史的依赖中识别出重要的实体。实验结果表明,CENET在大多数指标上都明显优于所有现有的方法,特别是对于Hits@1。

展望未来

探索知识图谱中的对比学习的能力比如找到更加合理的对比对。

引用

[1] Xu, Y., Ou, J., Xu, H., & Fu, L. (2023). Temporal Knowledge Graph Reasoning with Historical Contrastive Learning. Proceedings of the AAAI Conference on Artificial Intelligence, 37(4), 4765-4773.