文章目录

- 容器服务更新和发现

- 服务发现

- consul

- 概念

- 关键特性

- 总结

- 部署consul

- 架构

- 初始化部署

- 群集查看

- 部署registrator服务器

- consul-template 模板文件

- consul多节点

容器服务更新和发现

服务发现

- 什么是服务注册与发现

- 服务注册与发现是微服务架构中不可或缺的重要组件。

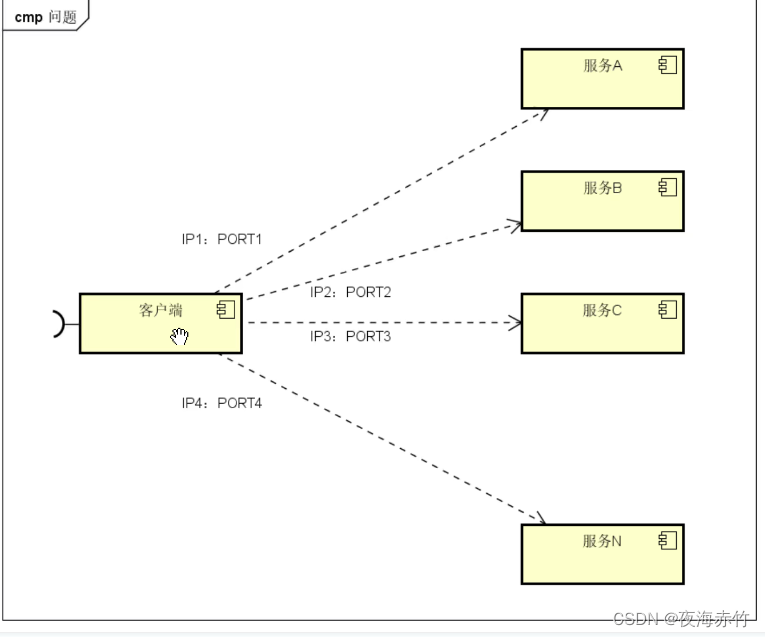

- 起初服务都是单节点的,不保障高可用性,也不考虑服务的压力承载,服务之间调用单纯的通过接口访问。

- 直到后来出现了多个节点的分布式架构,起初的解决手段是在服务前端负载均衡,这样前端必须要知道所有后端服务的网络位置,并配置在配置文件中。

- 这里就会有几个问题:

- 如果需要调用后端服务A-N,就需要配置N个服务的网络位置,配置很麻烦

- 后端服务的网络位置变化,都需要改变每个调用者的配置

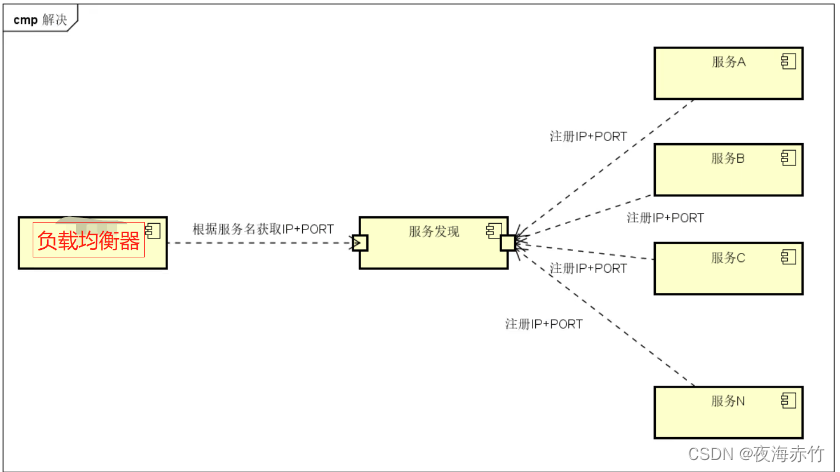

- 既然有这些问题,那么服务注册与发现就是解决这些问题的。

- 后端服务A-N可以把当前自己的网络位置注册到服务发现模块,服务发现就以K-V的方式记录下来,K一般是服务名,V就是IP:PORT。

- 服务发现模块定时的进行健康检查,轮询查看这些后端服务能不能访问的了。前端在调用后端服务A-N的时候,就跑去服务发现模块问下它们的网络位置,然后再调用它们的服务。

- 这样的方式就可以解决上面的问题了,前端完全不需要记录这些后端服务的网络位置,前端和后端完全解耦!

consul

概念

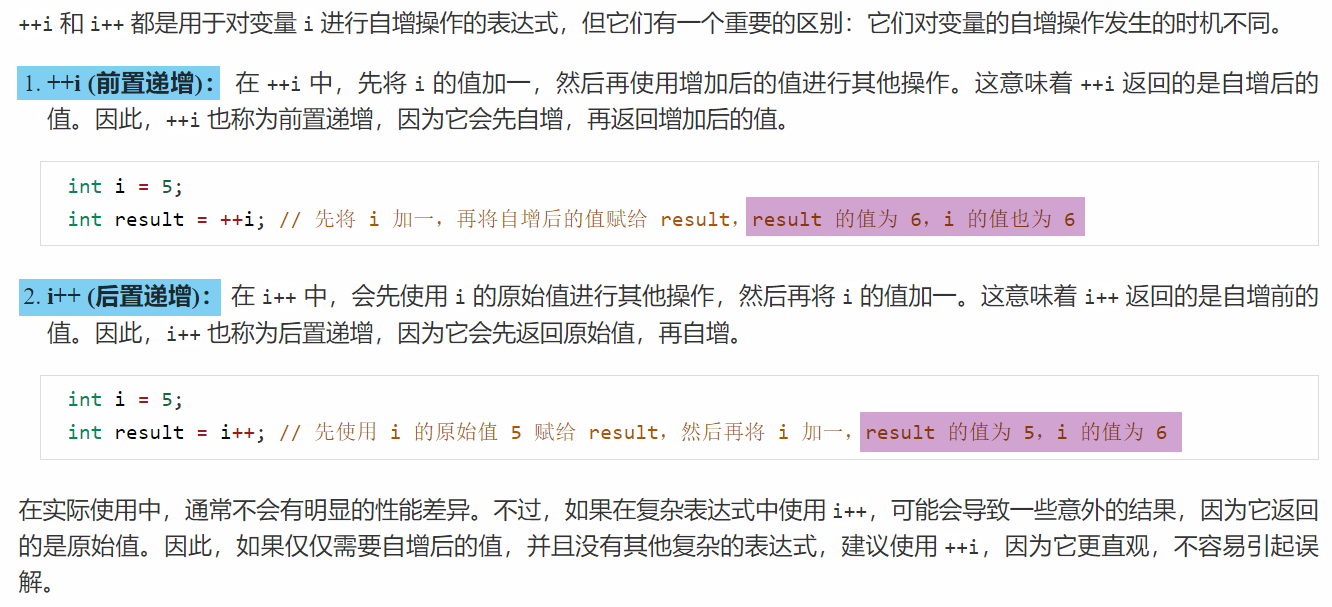

-

consul是google开源的一个使用go语言开发的服务管理软件。

-

支持多数据中心、分布式高可用的、服务发现和配置共享。采用Raft算法,用来保证服务的高可用。内置了服务注册与发现框架、分布一致性协议实现、健康检查、Key/Value存储、多数据中心方案,不再需要依赖其他工具(比如ZooKeeper等)。

-

服务部署简单,只有一个可运行的二进制的包。

-

每个节点都需要运行agent,他有两种运行模式server 和 client。 每个数据中心官方建议需要3或5个server节点以保证数据安全,同时保证server-leader的选举能够正确的进行。

-

在client模式下,所有注册到当前节点的服务会被转发到server节点,本身是不持久化这些信息。

-

在server模式下,功能和client模式相似,唯一不同的是,它会把所有的信息持久化到本地,这样遇到故障,信息是可以被保留的。

-

server-leader是所有server节点的老大,它和其它server节点不同的是,它需要负责同步注册的信息给其它的server节点,同时也要负责各个节点的健康监测。

关键特性

-

服务注册与发现:

- consul通过DNS或者HTTP接口使服务注册和服务发现变的很容易,一些外部服务,例如saas提供的也可以一样注册。

-

健康检查:

- 健康检测使consul可以快速的告警在集群中的操作。和服务发现的集成,可以防止服务转发到故障的服务上面。

-

Key/Value存储:

- 一个用来存储动态配置的系统。提供简单的HTTP接口,可以在任何地方操作。

-

多数据中心:

- 无需复杂的配置,即可支持任意数量的区域。

总结

-

服务自动发现和注册要解决什么问题?

- 如果后端应用服务器群集节点数量很多,负载均衡器配置和管理会比较麻烦(节点配置条目数量众多,后端节点的网络位置发生变化还需要修改所有使用这些后端节点的负载均衡器配置等问题)

-

consul模式

- client模式:负载转发注册信息给server节点,没有持久化能力

- server模式:持久化注册信息,在server节点之间同步注册信息

- server-leader节点:负载转发注册信息给其他server节点,并且对各节点做健康检查

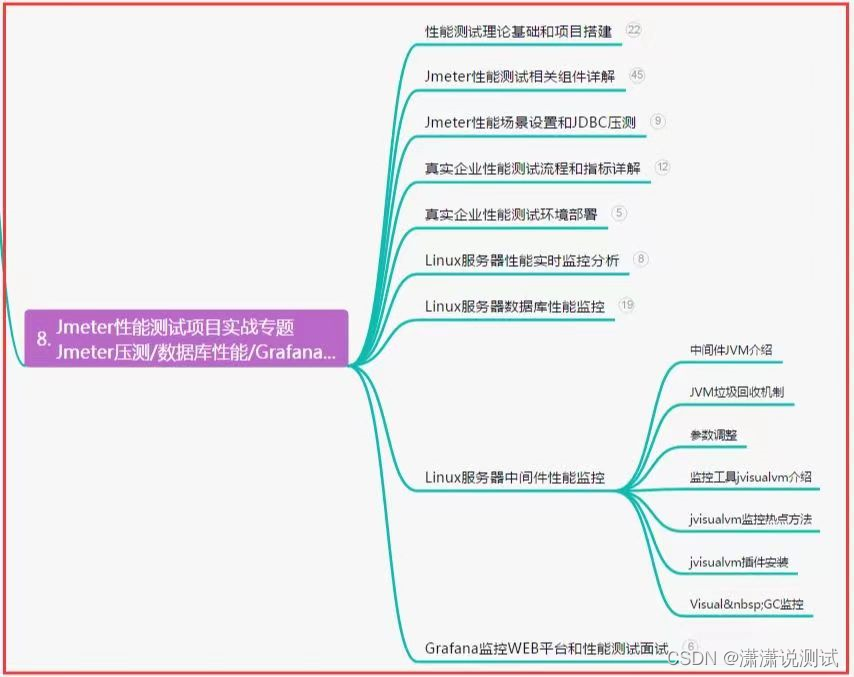

部署consul

架构

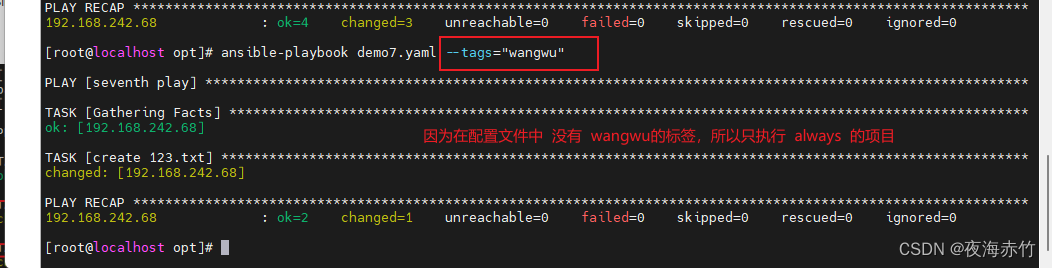

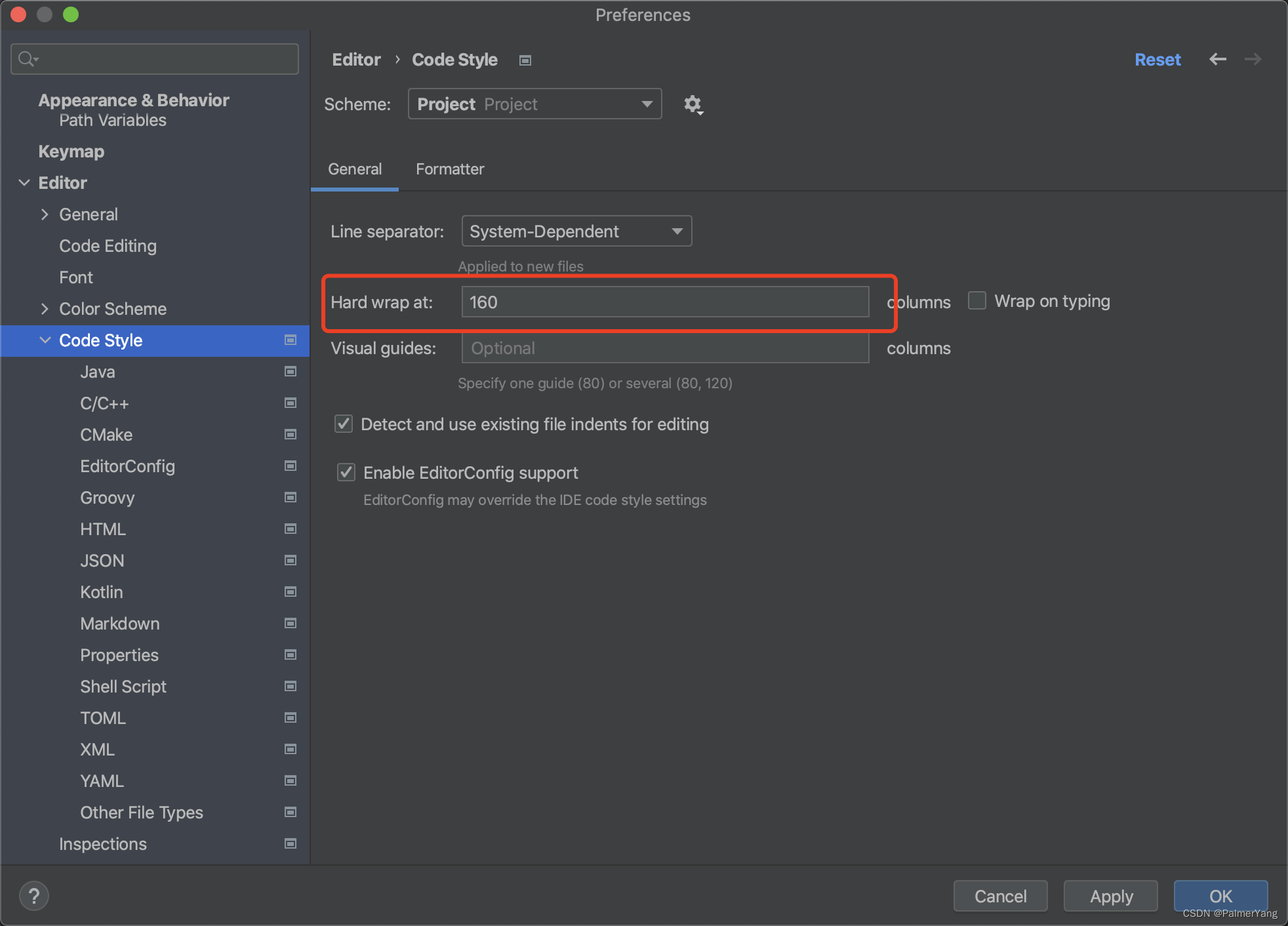

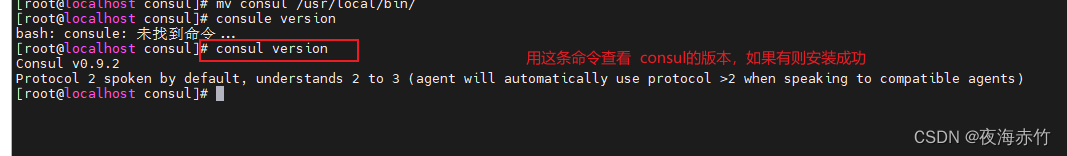

初始化部署

systemctl stop firewalld

systemctl disable firewalld

setenforce 0

###创建 condul 服务

mkdir /opt/consul

cp consul_0.9.2_linux_amd64.zip /opt/consul

cd /opt/consul

unzip consul_0.9.2_linux_amd64.zip

mv consul /usr/local/bin/

###设置代理,在后台启动 consul 服务端

##首先创建consul数据保存目录

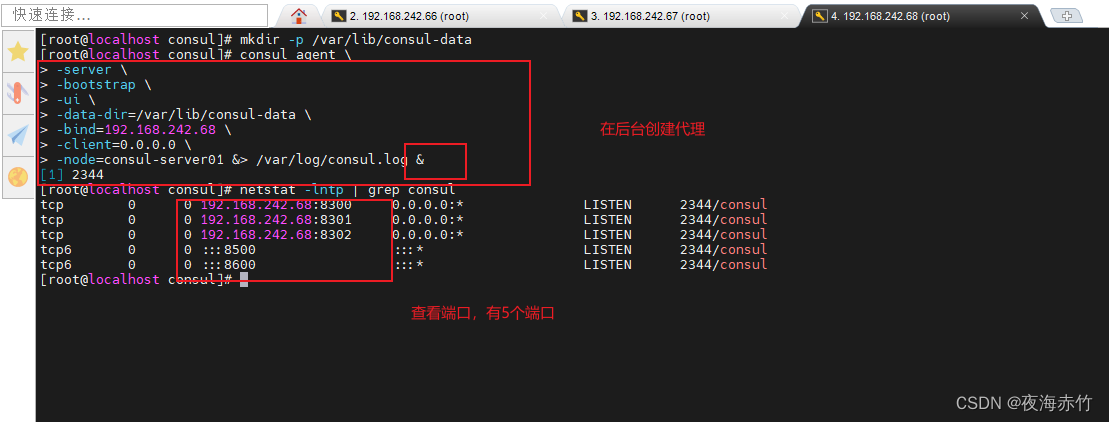

mkdir -p /var/lib/consul-data

##设置代理

consul agent \

-server \

-bootstrap \

-ui \

-data-dir=/var/lib/consul-data \

-bind=192.168.242.68 \

-client=0.0.0.0 \

-node=consul-server01 &> /var/log/consul.log &

##代理设置解释

-server: 以server身份启动。默认是client。

-bootstrap :用来控制一个server是否在bootstrap模式,在一个数据中心中只能有一个server处于bootstrap模式,当一个server处于 bootstrap模式时,可以自己选举为 server-leader。

-bootstrap-expect=2 :集群要求的最少server数量,当低于这个数量,集群即失效。

-ui :指定开启 UI 界面,这样可以通过 http://localhost:8500/ui 这样的地址访问 consul 自带的 web UI 界面。

-data-dir :指定数据存储目录。

-bind :指定用来在集群内部的通讯地址,集群内的所有节点到此地址都必须是可达的,默认是0.0.0.0。

-client :指定 consul 绑定在哪个 client 地址上,这个地址提供 HTTP、DNS、RPC 等服务,默认是 127.0.0.1。

-node :节点在集群中的名称,在一个集群中必须是唯一的,默认是该节点的主机名。

-datacenter :指定数据中心名称,默认是dc1。

###查看consul是否成功

netstat -lntp | grep consul

启动consul后默认会监听5个端口:

8300:replication、leader farwarding的端口

8301:lan cossip的端口

8302:wan gossip的端口

8500:web ui界面的端口

8600:使用dns协议查看节点信息的端口

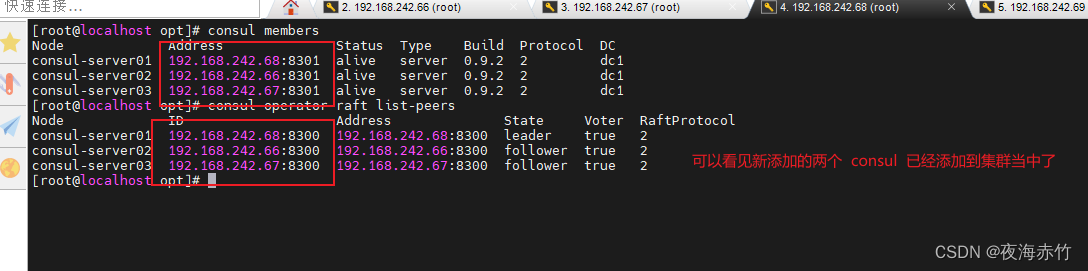

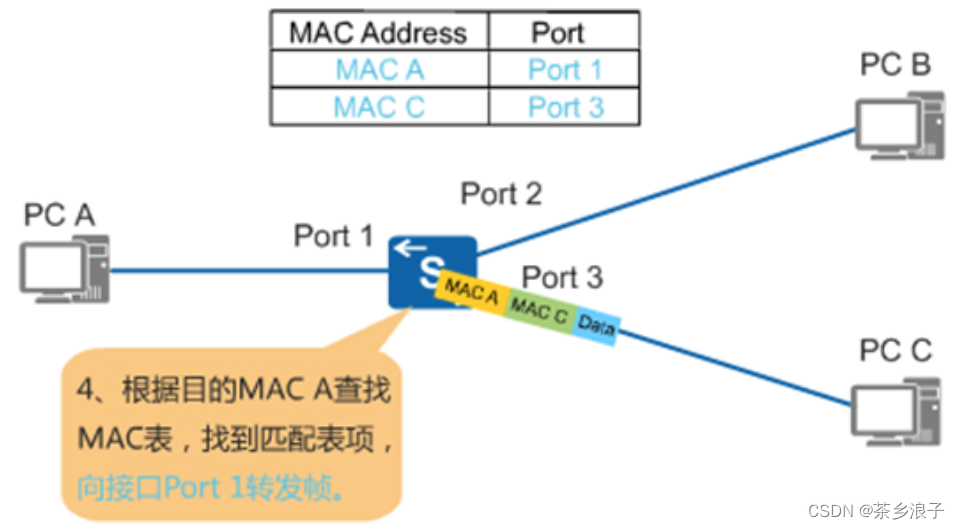

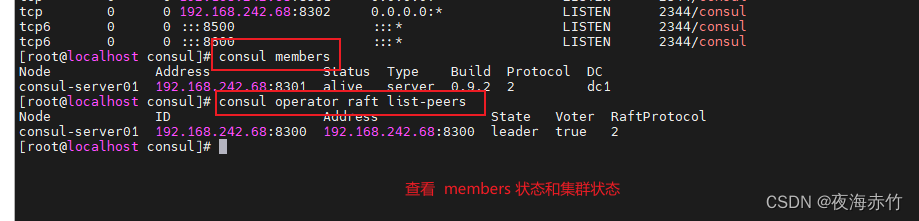

群集查看

##查看members状态

consul members

##查看集群状态

consul operator raft list-peers

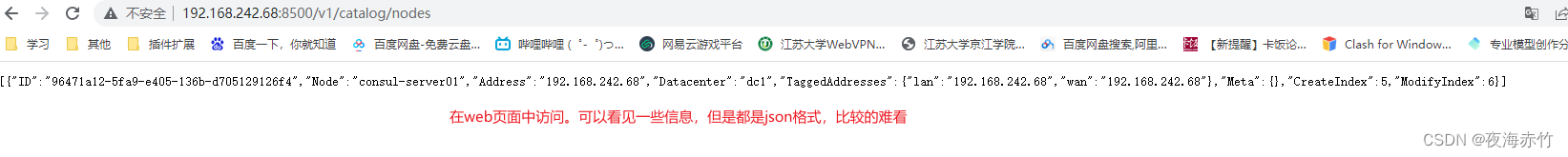

##通过http api 的方法获取集群信息

http://192.168.242.68:8500/v1/status/peers #查看集群server成员

http://192.168.242.68:8500/v1/status/leader #集群 server-leader

http://192.168.242.68:8500/v1/catalog/services #注册的所有服务

http://192.168.242.68:8500/v1/catalog/nginx #查看 nginx 服务信息

http://192.168.242.68:8500/v1/catalog/nodes #集群节点详细信息

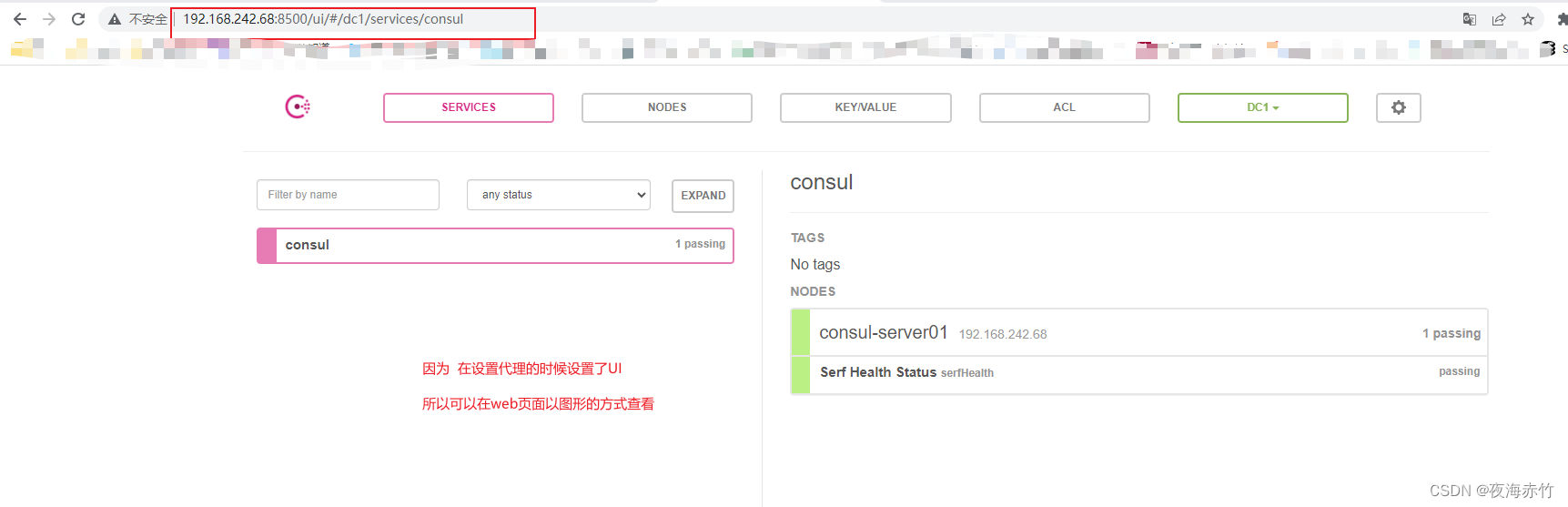

##因为在 代理设置的时候,设置了UI设置,可以使用UI查看

http://192.168.242.68:8500/ui

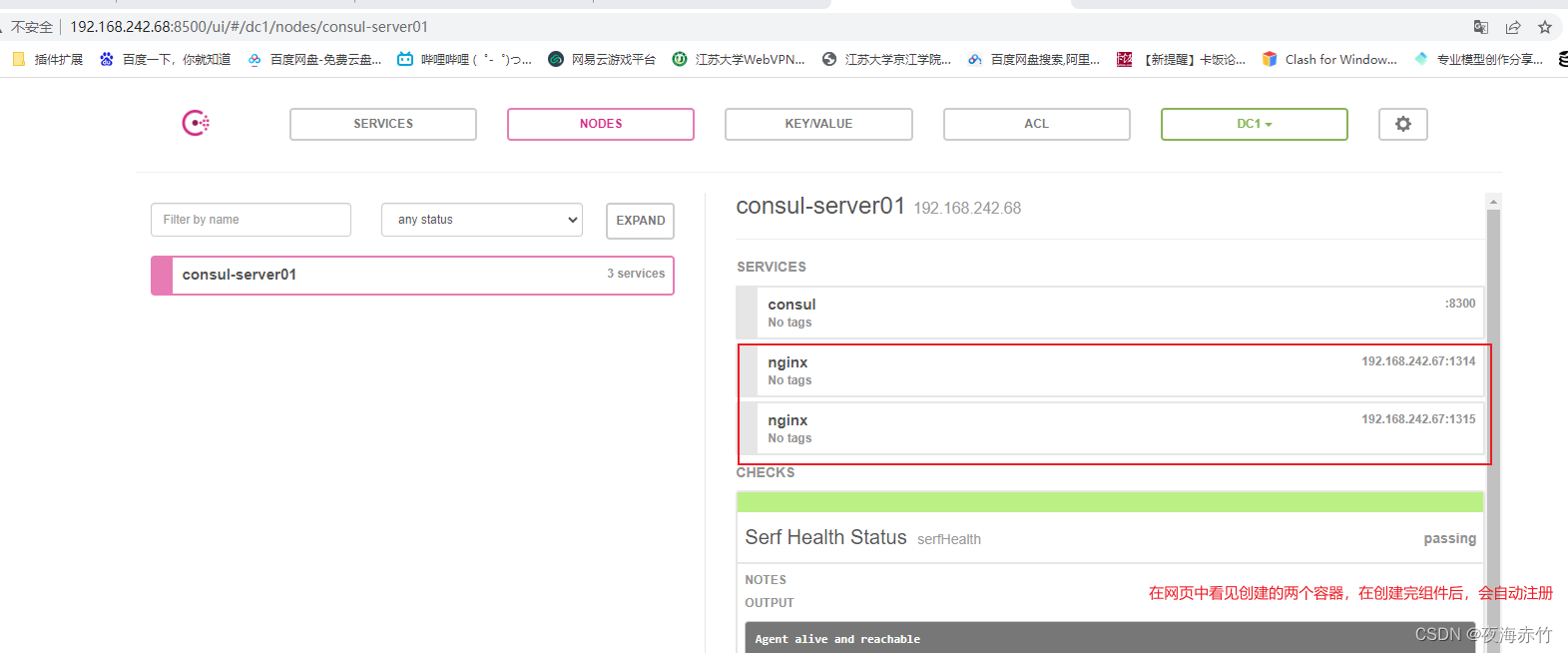

部署registrator服务器

在容器服务器中安装 registrator服务器

- Gliderlabs/Registrator 可检查容器运行状态自动注册,还可注册 docker 容器的服务到服务配置中心。

- 目前支持 Consul、Etcd 和 SkyDNS2。

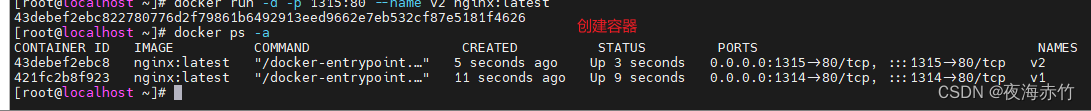

###在192.168.242.67服务器上创建容器

##当容器运行时,registrator会自动检测容器状态并自动注册

##拉取镜像

docke pull nginx

##创建几个实验容器

docker run -d -p 1314:80 -name v1 nginx:latest

docker run -d -p 1315:80 -name v2 nginx:latest

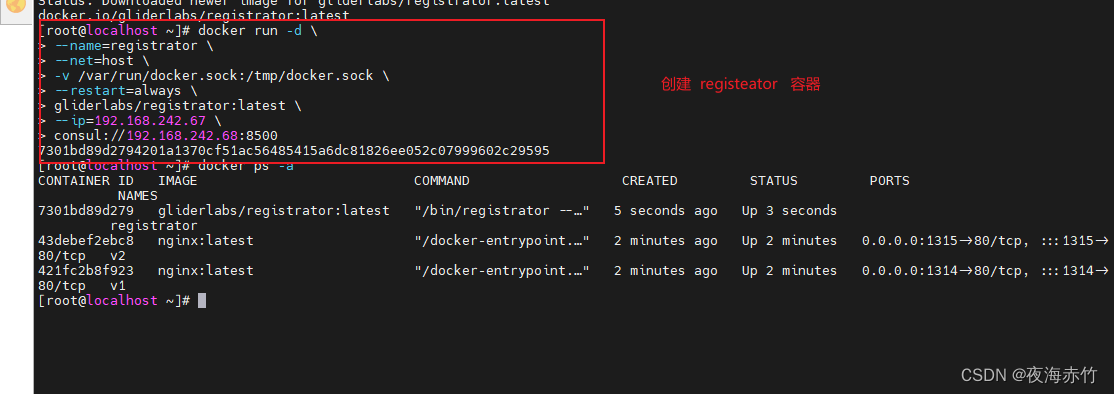

###安装 Gliderlabs/Registrator

##拉取镜像

docker pull gliderlabs/registrator

docker run -d \

--name=registrator \

--net=host \

-v /var/run/docker.sock:/tmp/docker.sock \

--restart=always \

gliderlabs/registrator:latest \

--ip=192.168.242.67 \

consul://192.168.242.68:8500

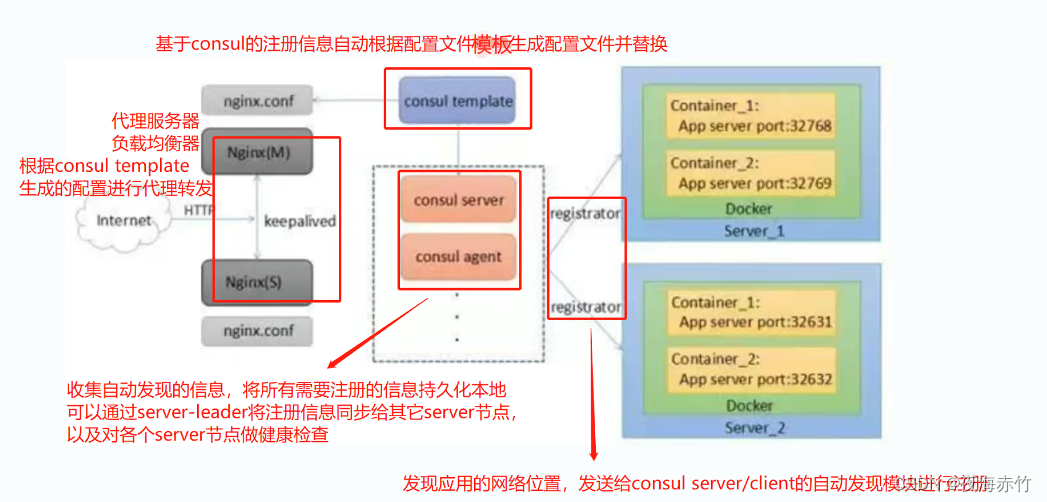

consul-template 模板文件

- Consul-Template是基于Consul的自动替换配置文件的应用。

- Consul-Template是一个守护进程,用于实时查询Consul集群信息,并更新文件系统上任意数量的指定模板,生成配置文件。更新完成以后,可以选择运行 shell 命令执行更新操作,重新加载 Nginx。

- Consul-Template可以查询Consul中的服务目录、Key、Key-values 等。

- 这种强大的抽象功能和查询语言模板可以使 Consul-Template 特别适合动态的创建配置文件。例如:创建Apache/Nginx Proxy Balancers 、 Haproxy Backends等。

##先在一个服务器上创建一个 nginx服务器

##不需要太多的配置

利用下面的repo创建nginx服务

[nginx-stable]

name=nginx stable repo

baseurl=http://nginx.org/packages/centos/7/$basearch/

gpgcheck=0

enabled=1

##在线下载nginx

yum -y install nginx

//创建日志文件目录

mkdir /var/log/nginx

##开启服务

systemctl start nginx

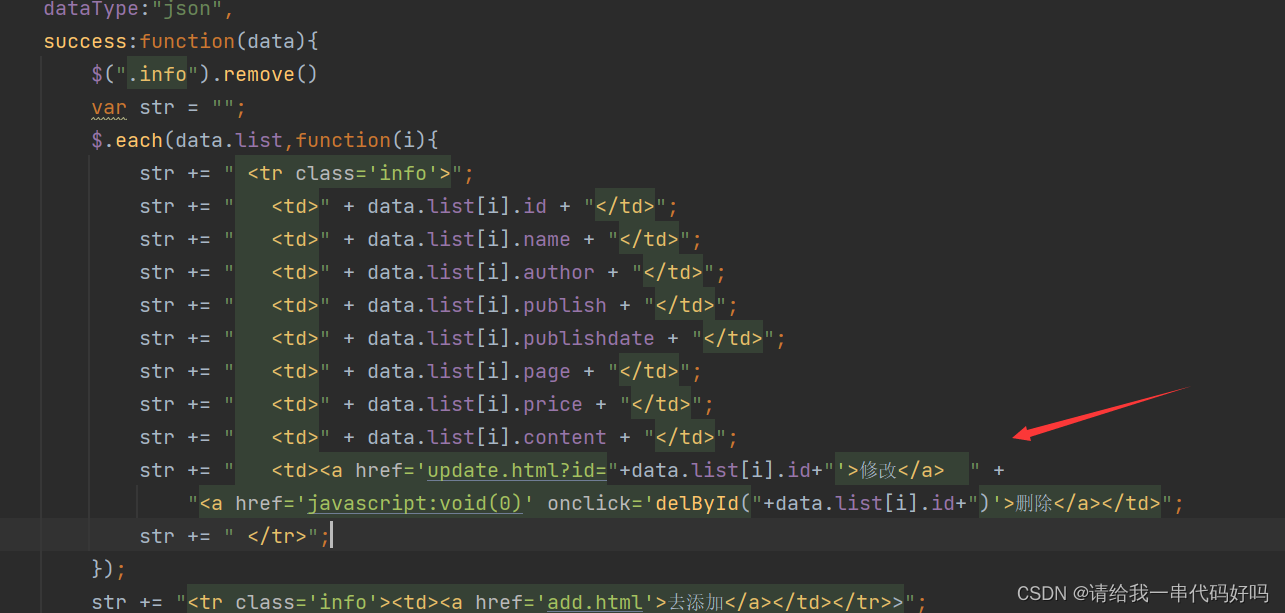

###准备 template nginx 模板文件

###在nginx服务器上部署

vim /opt/consul/nginx.ctmpl

#定义nginx upstream一个简单模板

upstream http_backend {

{{range service "nginx"}}

server {{.Address}}:{{.Port}};

{{end}}

}

#定义一个server,监听8000端口,反向代理到upstream

server {

listen 8000;

server_name 192.168.242.69;

access_log /var/log/nginx/ggl.com-access.log; #修改日志路径

index index.html index.php;

location / {

proxy_set_header HOST $host;

proxy_set_header X-Real-IP $remote_addr;

proxy_set_header Client-IP $remote_addr;

proxy_set_header X-Forwarded-For $proxy_add_x_forwarded_for;

proxy_pass http://http_backend;

}

}

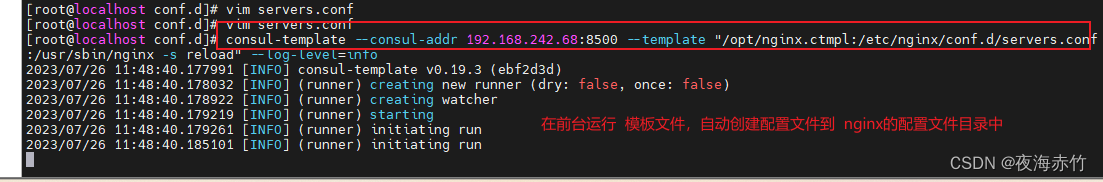

###配置并启动 template

unzip consul-template_0.19.3_linux_amd64.zip -d /opt/

cd /opt/

mv consul-template /usr/local/bin/

##在前台启动 template 服务,启动后不要按 ctrl+c 中止 consul-template 进程。

consul-template --consul-addr 192.168.242.68:8500 \

--template "/opt/nginx.ctmpl:/etc/nginx/conf.d/servers.conf:/usr/sbin/nginx -s reload" \

--log-level=info

###验证

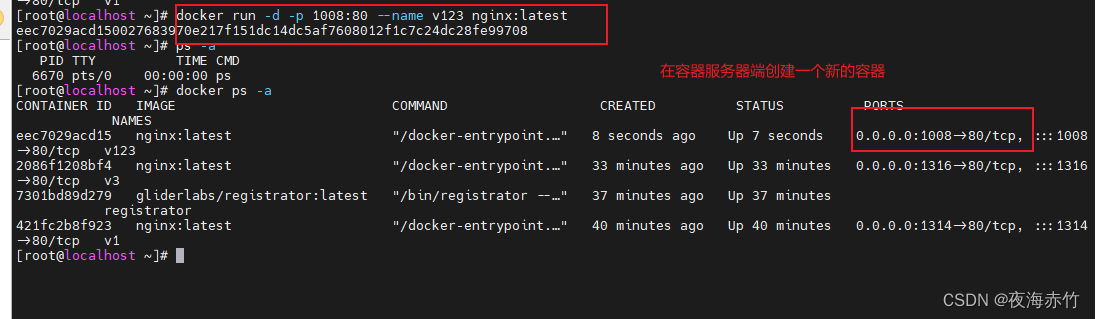

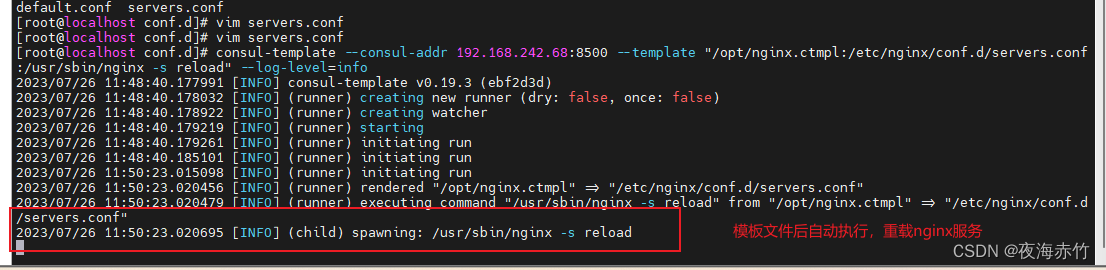

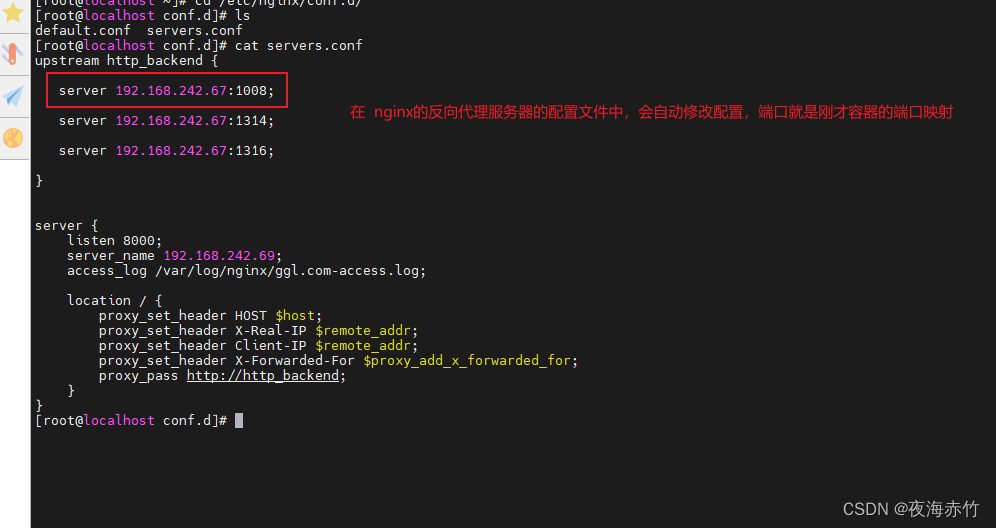

可以在容器服务器中,创建新的容器,查看nginx的反向代理服务器配置是否会自动修改

###验证负载均衡

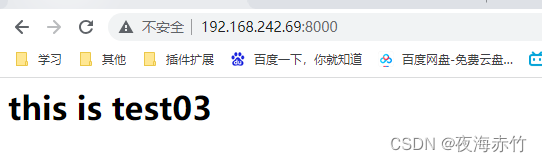

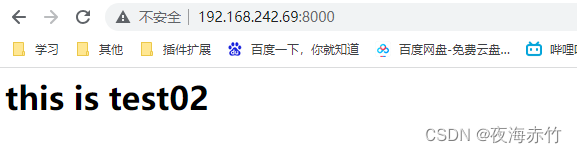

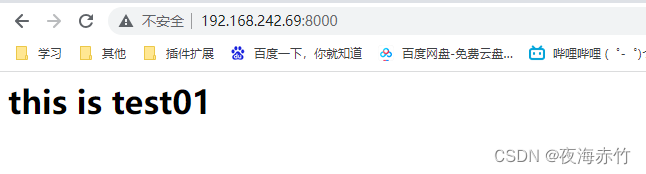

##在容器中创建web页面,刷新页面,查看能否实现负载均衡

docker exec -it v1 bash

cd /usr/share/nginx/html/

echo "<h1>this is test01</h1>" > index.html

##访问web页面并进行刷新

http://192.168.242.69:8000

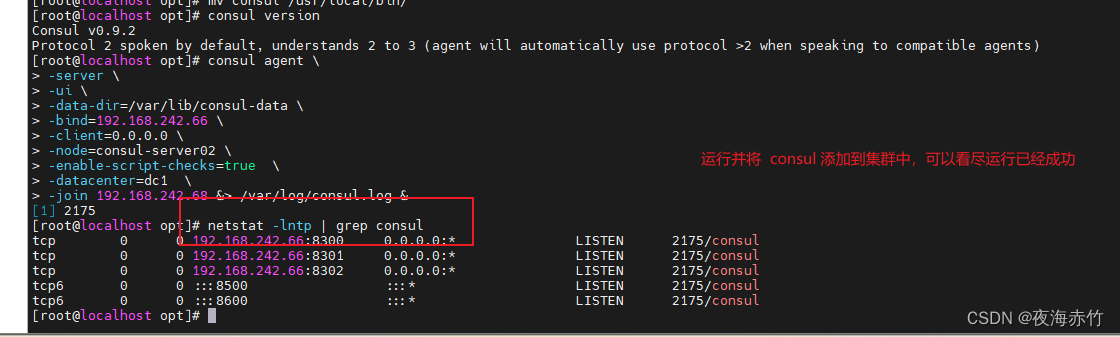

consul多节点

##在另外的一台docker服务器上部署consul,并将其加入到集群中

scp consul_0.9.2_linux_amd64.zip 192.168.242.66:/opt/

##通过scp发送需要的软件到目标服务器

unzip consul_0.9.2_linux_amd64.zip

mv consul /usr/local/bin/

##运行consul并加入到集群中

##首先创建consul数据保存目录

mkdir -p /var/lib/consul-data

consul agent \

-server \

-ui \

-data-dir=/var/lib/consul-data \

-bind=192.168.242.66 \

-client=0.0.0.0 \

-node=consul-server02 \

-enable-script-checks=true \

-datacenter=dc1 \

-join 192.168.242.68 &> /var/log/consul.log &

consul agent \

-server \

-ui \

-data-dir=/var/lib/consul-data \

-bind=192.168.242.67 \

-client=0.0.0.0 \

-node=consul-server03 \

-enable-script-checks=true \

-datacenter=dc1 \

-join 192.168.242.68 &> /var/log/consul.log &

-enable-script-checks=true :设置检查服务为可用

-datacenter : 数据中心名称

-join :加入到已有的集群中

##查看集群状态和成员

consul members

consul operator raft list-peers