文章目录

- Maximun likelihood extimation

- Maximum A Posterior Estimation

- Vicinal Risk Minimization, VRM

Maximun likelihood extimation

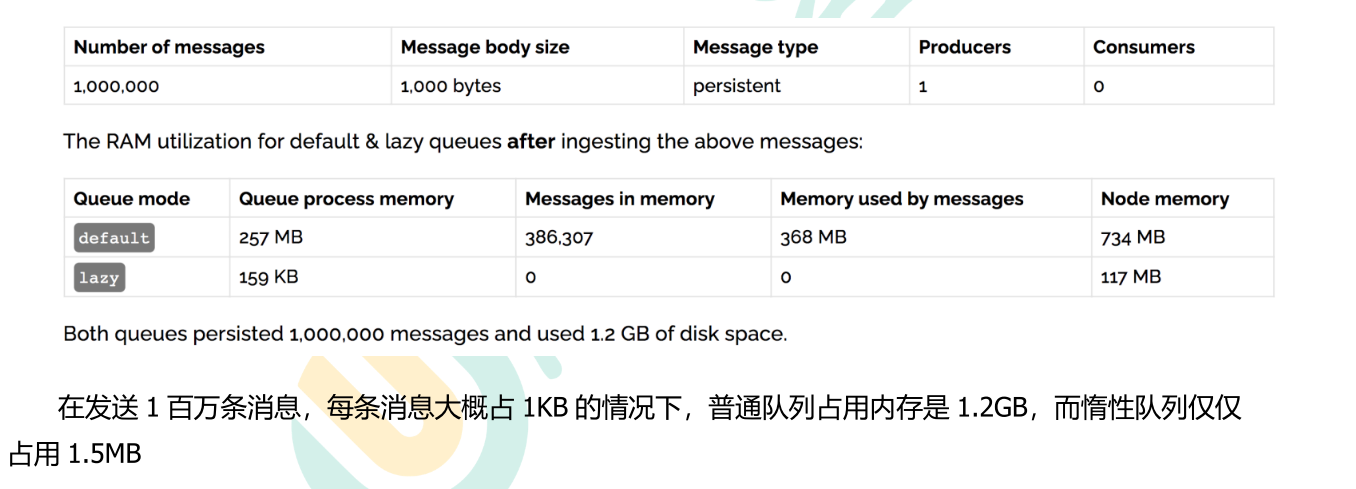

最大似然估计:样本->参数,完全相信观测到的数据,最优可能产生这些看到的数据的模型就是最理想的模型.

频率学派认为,参数是一个常数,不断实验就能逼近参数的真实值.

对应经验风险最小化的策略,弊端容易产生过拟合.改善过拟合用到结构风险最小化

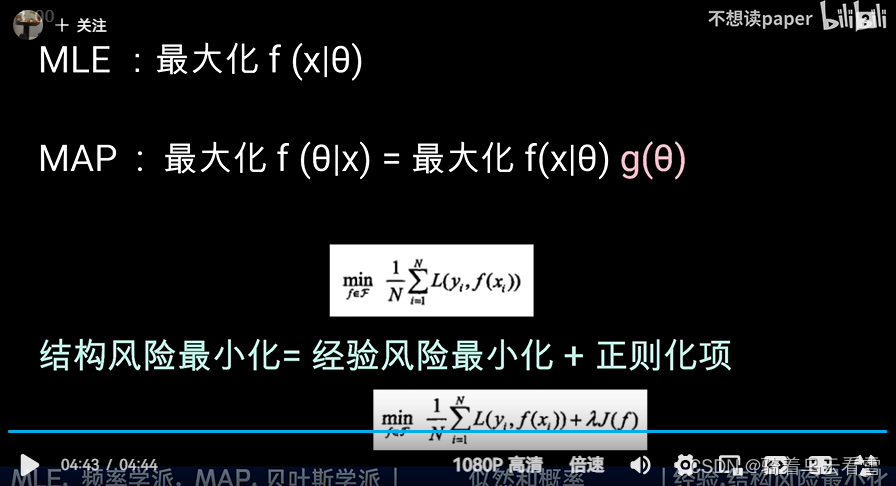

Maximum A Posterior Estimation

最大后验估计:不能完全相信观测到的数据,因为可能存在偏差.样本+经验模型->参数.

贝叶斯学派:参数是一个变量,不存在确定模型.而先验分布就是对概率分布的一个猜测.然后再用观察到的数据修正这个值.投硬币这个人每时每刻的状态都不同,所以实验的数据有偏差.

加了参数的先验概率.

可以认为,最大似然估计好坏取决于观测的数据的质量,而最大后验估计取决于后验模型的准确性.

可以看成通过先验概率引入正则化的效果.

Vicinal Risk Minimization, VRM

经验风险最小化(Empirical Risk Minimization, ERM)允许大型神经网络强行记住训练数据(而不是去学习、泛化),即使加了很强的正则化,或是在随机分配标签的分类问题中,这个问题也依然存在。使用ERM原则训练的神经网络,当在训练样本分布之外的数据上进行评估时,预测结果会发生显著的变化,这被称为对抗性样本。一种解决方法是邻域风险最小化(Vicinal Risk Minimization, VRM),即通过数据增强在原始样本的基础上构造更多的样本,但数据增强中需要人类知识来描述训练数据中每个样本的邻域,比如翻转、缩放等。因此VRM也有两点不足

数据增强过程依赖数据集,因此需要专家知识

数据增强只建模同一类别之间的邻域关系