这边来的少,但发个文章通报下近况,长期做AI产研、投融资工作后,后续主要在企业数字化与大模型结合的方向上,后续进展还是请关注:琢磨事。

上一篇提到最终大模型的格局很可能是有一个偏通用大模型,比如chatGPT,它会颠覆现有信息集散的基本格局,同时还会有很多面对垂域的大模型,每一个都会像是一个个成功了的沃森(AI大模型没有商业模式?)。但没说为什么这么认为,这篇首先讲这个。回答这个问题首先要回到一个类似关公战秦琼的问题:chatGPT如果去下围棋能干过AlphaGo么?

chatGPT 和AlphaGo下围棋,谁赢?

估计没人会不同意人工智能行业十几年来让人印象最深的两个标志性事件是:2016年AlphaGo战败李世石和柯洁和2022年chatGPT展现通用智能能力。

而很有趣的事情在于这两次突破正好一个对应于垂直领域(AlphaGo),一个对应于相对通用的领域(chatGPT)。

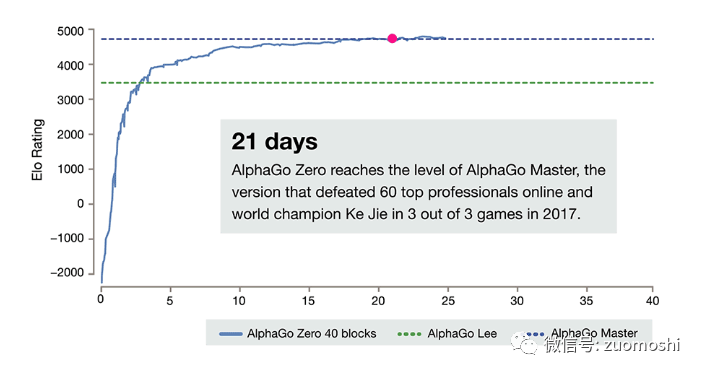

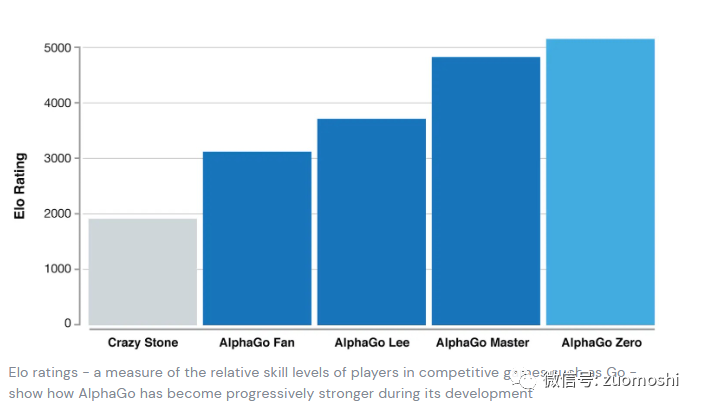

从训练方式上看AlphaGo做到了自己就是数据源,这意味着经常说的数据飞轮效应对AlphaGo在后期变成内置的了。升级到后面的版本(AlphaGo Zero)的时候已经不再使用人类的棋谱,而是自己和自己玩,然后结果非常可怕,大概下面这样:

21天AlphaGo Zero通过自己对战自己达到战败自己哥哥AlphaGo Master的水平。典型的人工智能自己驱动数据飞轮,谁也不靠。

这对判断谁赢有什么帮助呢?其实这非常关键。

判断谁赢,纯靠技术是不行的,因为过去十年最大的经验就是如果从技术角度对未知领域进行判断,那谁也判断不准。所以我们换种模式。

AlphaGo相当于把一个边界足够清楚的事走到顶了,经历了一个人工智能到顶的全过程。所以我们从中可以总结出一个人工智能到顶的关键阶段:

这三个阶段是:现有全量数据阶段--自我数据生成阶段--启动数据→智能飞轮,领域高点。

在现有全量数据阶段AlphaGo在学习人类的棋谱,在战败李世石后,它就进入自我数据生成阶段,然后数据→智能飞轮启动阶段。

这是一种递进的关系,全量数据意味着对场景描述已经比较充分,人工智能可以比人的干好。只有过了这个阶段,它才可能自己产生有价值的数据,而一旦它可以自己产生有价值的数据,那后续的进化就会非常快。

但形成这种数据的闭环并不容易,领域越宽越难。

如果目标是处理真实世界的所有问题,那就得有一个能穷尽世界各种变量的元宇宙才行。这就是做垂直领域最核心的优势,只要选的比较好,那就有可能更快的到达类似“AlphaGo”的围棋之神的境界。

回到我们最初的问题:即使没下过,GPT4论下围棋也肯定不如AlphaGo,AlphaGo已经通过数据飞轮达到领域高点,GPT4相当于刚会下,大致等于专业拳击手对小朋友。

这个结论其实非常关键,这既能回答垂直领域大模型是否能够存在,还能回答垂直领域大模型的基础战略到底应该是什么样。

但要想真的做垂直领域大模型,还需要考虑的问题是解决垂直领域问题除了大模型还要什么,大模型到底在其中占多少权重。是大模型往那儿一摆,垂直领域的问题就解决了么?还是说会有更关键的决定性因素?

大模型在"沃森"类系统中的权重

郭士纳之后IBM好像彻底变成了个只会赚钱的公司,创新的业务比如IBM Watson总是给我们一些负面的消息。但这个时候不能忽视的恰恰是它,因为它落过地,也许技术没行,但对场景的总结和描述一定就是大模型也需要解决的问题。

成功的案例可能会更耀眼,但失败的案例往往可以让我们学到更多。(考虑chatGPT 2022年底才出来,我们实在也找不到更好的成功的案例。)

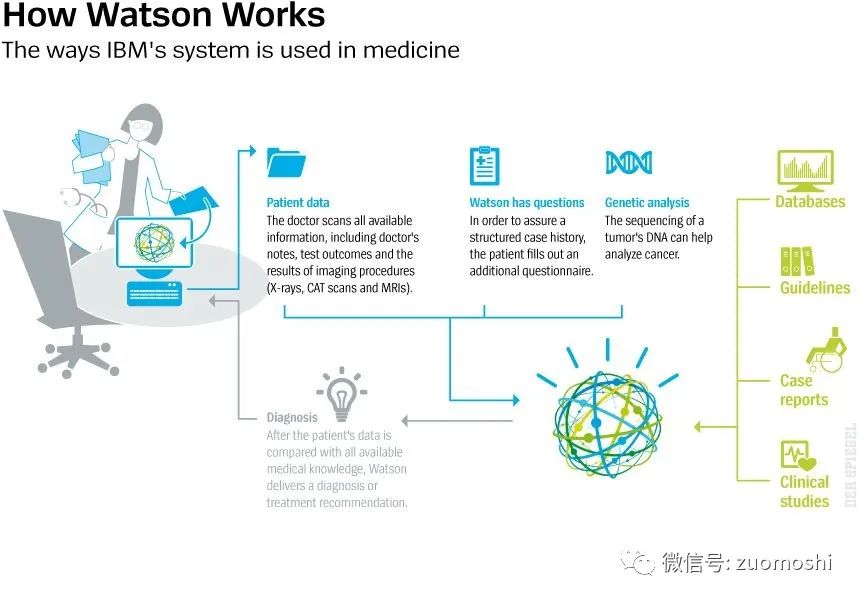

沃森的产品架构大概这样:

现在代表Watson那个球完全可以替换成大模型,然后你就会发现其它的部分未来再做落地的时候一个要少不了,还可能需要增加。

我们来简单翻译下上图的各种输入,沃森作为一个辅助诊疗的系统,它第一个需要的是关于病人当前症状的数据比如X光等,而病人的数据有可能是不完整的所以它可能会主动激发一些问题,让病人进行回答,让它能够形成判断,最后病人的基因数据也需要作为一个关键数据提供给它。

除了病人的数据外,它还需要具备这个领域相关的知识,比如那些诊疗方法是不被允许的,过往类似的病情都是如何处理的,新药等。这就是上图右侧的部分。

这个表述比较形象,但会有点杂乱,不利于推测后续垂直领域大模型的关键点,所以我们换个视角对此进行再分类,这就可以更清晰的看到垂域大模型所对应的系统构成。

需要最终面对对象(也就是患者)的全量数据。全量数据包括:当前这个时间点的数据(当前病症)、历史数据(病例)、基础特质(基因)。这其中当前数据有可能需要在时间和空间上都需要进行展开,时间上的展开比如24小时心电图,空间的展开比如传染病的时候你的行动轨迹等。这代表了对象的充分数字化。

垂直域的大模型自身必须是一个活的专家。也就是说它的领域知识不止要全量还要是活的,所以不管是行业规则还是最新研究成果都要形成有机的联动。这里面规则可能更关键,因为它需要立刻生效。

这两部分数据的获取会导致所有AIoT的相关部分全需要被挪过来,你需要大规模管理设备(对接医疗设备等),需要云原生,需要数据库,需要内容审核和对接等。大模型相当于在原来的基础上强化了脑袋,并不是把一切推翻重来。

在这个过程中大模型提供了构建有价值的认知类系统的机会,但在最终成型的认知系统重远不是全部,从创造价值所占的权重的角度看也许只有30%。这看似有点矛盾,但可以拿移动互联网做类比,没有Android和iOS就没有移动互联网,但如果把移动互联网看成一个整体,从创造价值的角度看,他们的权重也许就不到1%。

这是从沃森这样系统中可以直接看到或者联想到的部分。

那数据飞轮在那儿呢?答案是一时半会这类系统不会有数据飞轮。

人以及病例毕竟不是棋谱可以人工智能自动生成。按照我们:现有全量数据阶段--自我数据生成阶段--数据→智能飞轮,领域智能高点的阶段划分,这好像完全到不了自我数据生成阶段,因为在漫长的时间里人是不能充分量化的,新的创造也是会实时发生的。也就是说沃森这种系统会长期处在第一个阶段。

这也帮我们引出垂直领域大模型相关的第三个话题:不是所有垂域都有数据飞轮效应。万物皆数的程度和数据飞轮效应正相关。

万物皆数与数据飞轮

像围棋这种领域数字化的成本极低,因为本质上这是一个数字空间的游戏。纯粹数字空间的事其实不多,虽然过去都产生比较大的影响,比如搜索、社交网络、IM等。

到电商和O2O的时候数字化的成本就变关键了,必须有一个简单的方法能够让物理的商品或者外卖小哥能充分数字化,然后才能获得数字和算法所带来的红利。

大模型的作用域和后者类似,都是需要走出纯粹的数字空间。

这样一来万物皆数反倒是更关键。就像没有米饭做的再好也没意义一样。当大模型离开了纯粹的数字空间(chatGPT在这里)一样要走过O2O的历程,否则你就没法解决现实问题。在这里感知和认知需要无缝的融合。

这是完全不一样的游戏规则,这个环节最关键的反倒是传感器,传感器的小尺寸和成本大幅下降,让物理世界的数字化成为可能。但它的部署很麻烦,每一个场景的数字化的成本估计和大模型的研发是类似的。同时他们俩又是双生的。

这类场景确实还会进一步细分,一部分更贴近数据飞轮效应,一部分则相去甚远。比如同样牵涉人,但教育应该就比医疗更好做,税务就比战争好做。

所以大模型落地的顺序大致会是:纯粹的数字领域,比较低成本可以做到万物皆数的领域,高成本但还是可以做到万物皆数的领域。

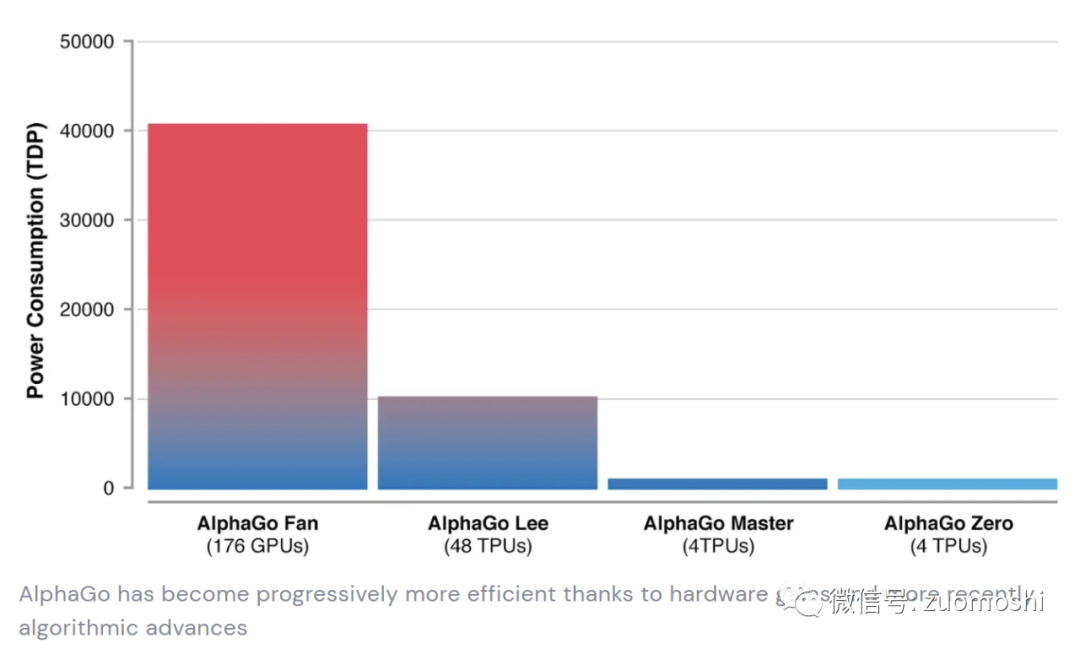

下面这个是纯粹猜测,数据→智能飞轮,领域智能高点这个阶段里可能算力需求会下降。这只是一个观察,非技术性的结论。

计算成本的考量

在能力增加的时候AlphaGo所需的算力是下降的

https://www.deepmind.com/blog/alphago-zero-starting-from-scratch

显然的GPT还在继续放大的路上,从最新透漏出来的消息看,GPT-4在120层中总共包含了1.8万亿参数,而GPT-3只有约1750亿个参数。按照这趋势GPT5不太可能变小,还是变的更大。

这也许是因为问题域太大,而限定边界的话就可能可以更早的进入优化阶段。AI未必不能优化自己。

相信什么样的回答就有什么样的选择

上面说了很多观点,每个上的判断和选择都影响未来几年大模型的真正走势。

关键是这只是看着能行,没人能给准确判断。这就变成了一个相信的问题。相信什么就有什么样的选择,而什么样的选择就会有什么样的结果。我们来对此做个简单总结:

相信通用大模型不能覆盖垂域大模型么?

相信这种三段划分么?现有全量数据阶段--自我数据生成阶段--数据飞轮,领域智能高点

相信最终价值链条中大模型只创造30%么?

相信万物皆数的成本和大模型本身其实一样关键么?

从现在看未来的时候,这些关键节点上的判断非常关键,会影响资源的投入。

OpenAI 首席科学家说的对:你先要选对,然后你的信念就是结果。

小结

从做事的角度看,纯粹数字空间的大模型对绝大多数人而言机会几乎为0,垂直领域大模型早期会加大亏损,但增加最终商业模式跑通的可能性。短期一定会出很多垂域大模型,因为下围棋的话chatGPT总是干不过AlphaGo。长线看通用大模型和垂域大模型的竞争会一直都在,但如果通用大模型真的覆盖每一个AlphaGo这样的领域,那意味着什么呢?

关于大模型的各方面还写了些其它文章:

到底什么是OpenAI成功的关键点,到底谁能干好大模型?

从教育到就业,AI大模型到真产生影响还有多远

碳基中心 VS 硅基中心:把Vision Pro和便利蜂放一起比比

AI带来了巨大的机遇,未能善用AI的企业将面临衰退