目录

0.学前准备

1.什么是AI绘画

2.当前主流的AI绘画工具

3.什么是SD(stable diffusion)

4.SD能做什么

1.文生图

2.图生图

3.AI换模特,背景

5.使用stable diffusion配置要求

6.环境配置与安装

需要注意的地方:

扩展知识:

1.python

2.git

3.控制界面

7.SD的原理

结语

不需要了解相关知识的可以直接跳转到第五节安装

0.学前准备

学习本课程需要先下载stable diffusion以及相关模型,觉得网盘下载太慢的也可以去源地址下载,C站(国内404),L站,抱脸网三选一即可

| 百度网盘地址 | 夸克网盘地址 | C站地址 | L站地址 | 抱脸网地址 | |

| stable diffusion | 链接:百度网盘 请输入提取码 提取码:9vzk | 链接:夸克网盘分享 提取码:t6J2 | X | X | X |

| anything模型 | 链接:夸克网盘分享 提取码:PWLu | https://civitai.com/models/9409/or-anything-v5ink | 万象熔炉 | Anything V5/V3|LiblibAI | Linaqruf/anything-v3.0 · Hugging Face | |

| chilloutmix模型 | 链接:夸克网盘分享 提取码:Ny9P | https://civitai.com/models/6424/chilloutmix(需要登陆) | 必备模型|ChilloutMix|LiblibAI | swl-models/chilloutmix · Hugging Face |

1.什么是AI绘画

ai绘画简单来说 就是利用人工智能技术进行绘画创作,它通过程序和算法模拟人类的绘画过程,从而实现自主创作。但是AI绘画并不是无中生有,而是基于训练模型,进行二次创作,举个容易理解的例子,比如你(模型)想写出 颜真卿风格的字体,就需要对着颜真卿的书法(素材)不停的临摹(训练),等练上成百上千次后,就很容易写出相似的字体(自主创作)。AI绘画正是如此,所以AI绘画出来的图像风格都是基于训练模型(训练模型后面讲)

2.当前主流的AI绘画工具

当前主流的有以下几种 Midjourney,Stable Diffusion,Disco Difusion,Novel AI,因为 我没有使用过Disco Difusion,Novel AI,所以先用Midjourney,Stable Diffusion做对比

| 优点 | 缺点 | 适合人群 | 是否收费 | |

| Midjourney | 1.画风多样 2.操作简单 3.出图快质量高 4.电脑要求低 | 1.需要收费 2.自定义功能少 3.出图结果随机性大 4.图片受平台管控 | 1.电脑配置低 2.对控图要求低 | 是 |

| Stable Diffusion | 1.免费开源 2.出图速度快 3.高定制化,可以根据需求安装各种插件定制图片 4.出图高度可控 5.图片不受任何限制 | 1.对电脑配置要求高 2.有一定的入门门槛 3.容易出现质量极差的图片 | 1.电脑中高配置 2.对控图要求高,输出结果自由可控 | 否 |

其实 使用 sd最重要的原因是 免费,而且对于输出结果高度可控,由于可控,那么对于后期的变现会更加简单,也不会受到平台的管控,但是 Stable diffusion有一定的操作技巧,并不是傻瓜式操作,所以是通过调节stable diffusion的各个参数去实现自己的需求,而不是单纯的由AI去控制图片的生成。

3.什么是SD(stable diffusion)

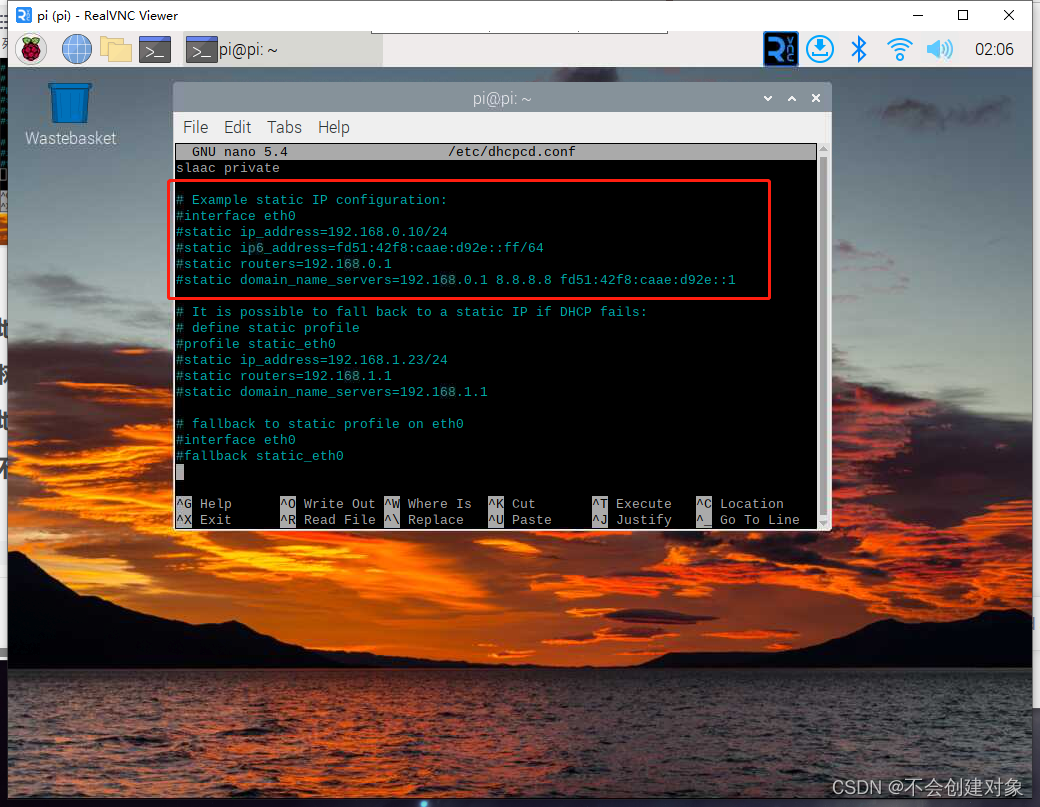

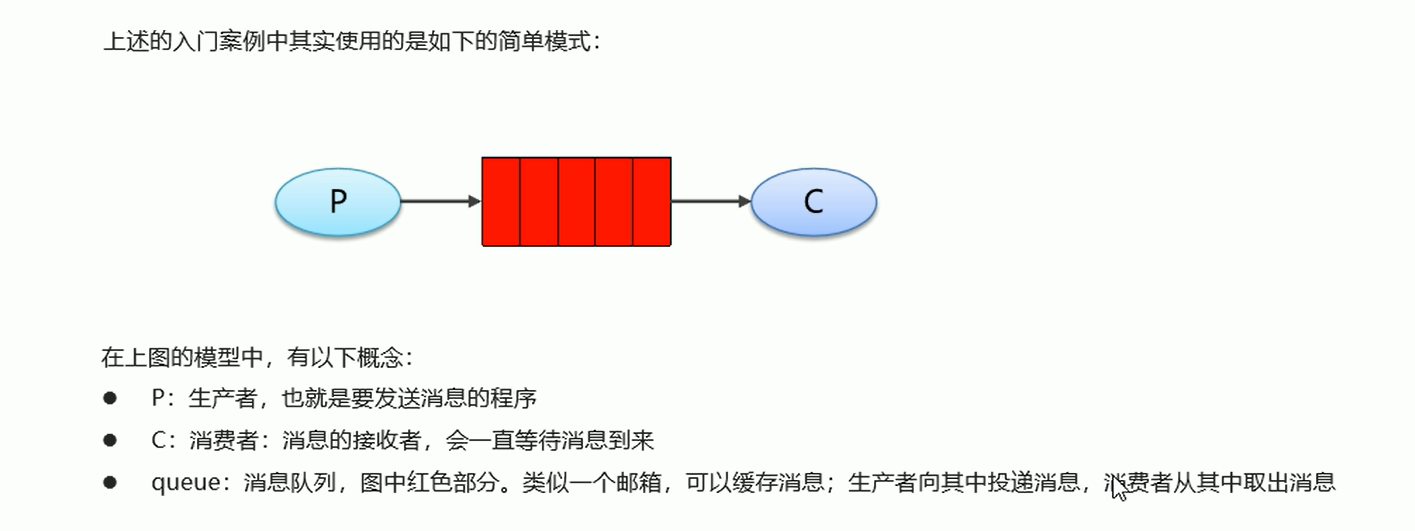

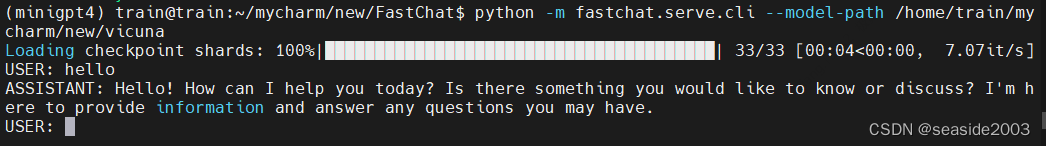

当你去学习一个新的东西,你需要先了解这个东西是什么,然后再去学习会更加简单,那什么是SD呢,stable diffusion 是一款基于人工智能技术开发的绘画软件,最原始的stable diffusion 是基于命令行参数进行运行的,类似这样的,对于没有编程基础的小白玩家,学习AI绘画之前还要命令行参数,甚至还要记住各种参数的涵义

stable-diffusion 命令行界面

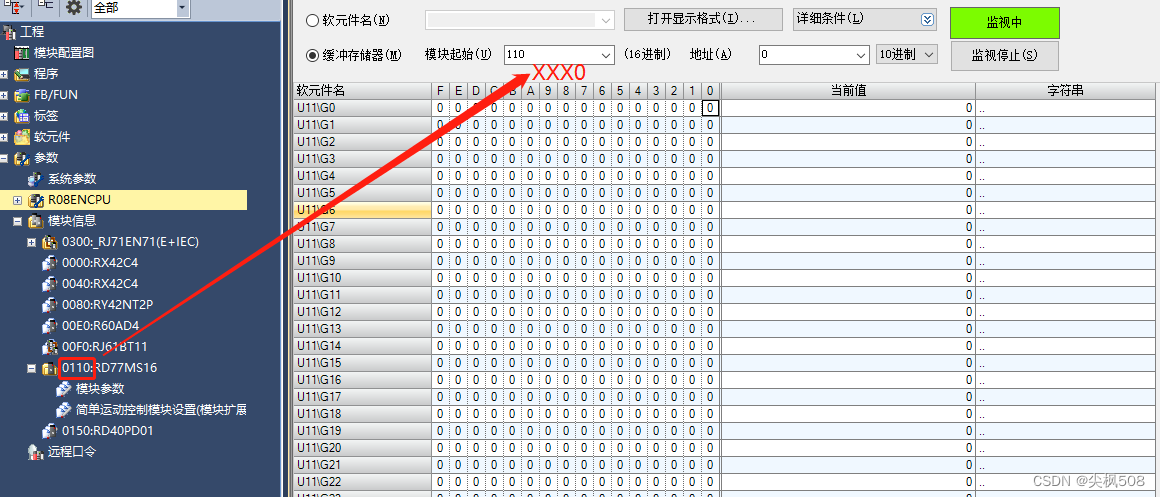

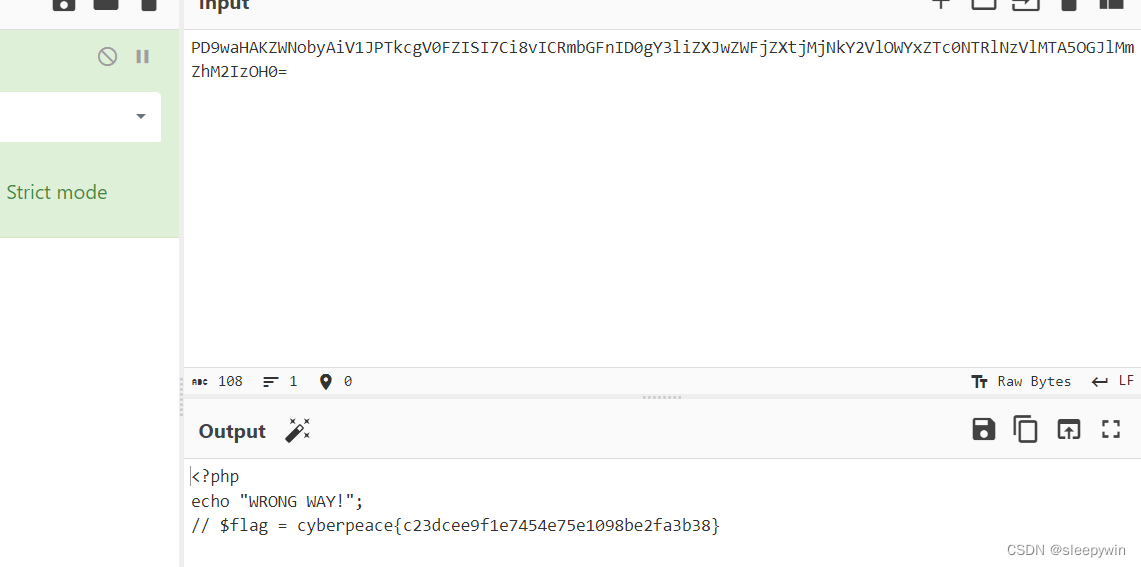

此时一位名叫 AUTOMATIC1111 的大佬出手了(项目地址AUTOMATIC1111 · GitHub),他建立了一个叫stable-diffusion-webui的开源项目,把所有的命令行参数都以界面的形式展示了,也就是我们后面课程会用到的软件,本质上是在stable diffusion上面的套了个壳,但是却使普通人也可以愉快的进行艺术创作,达到了所见即所得的高度,市面上例如 秋叶的整合包,小李xiaoli的整合包,都是基于stable-webui进行的二次开发

stable-diffusion-web-ui界面

4.SD能做什么

stable diffusion 因为其高度的可定制化和控图能力,可以用于 商品建模,虚拟角色创作,线稿上色,艺术设计,服装设计,建筑设计,原画生成等各个方面

下面举几个常用的例子

1.文生图

根据文字描述生成对应的图片

例如:二次元 穿着衣服的女孩

2.图生图

例如:三次元转二次元

3.AI换模特,背景

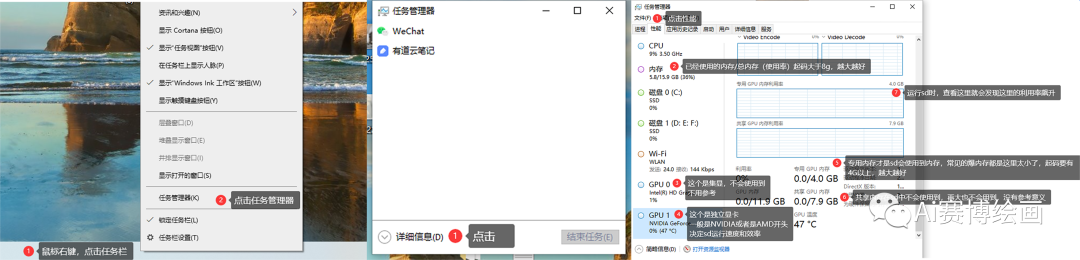

5.使用stable diffusion配置要求

操作系统:所有操作系统都可以,建议使用window10

磁盘要求:起码 50G以上,越大越好(放在固态硬盘,提升加载速度)

显卡:4G以上独立显卡(最好是英特尔的独立显卡,AMD显卡支持不足,但是也能用),AMD显卡会报以下错误,需要进行特殊配置,不在本篇进行讨论

![]()

内存:8G以上

CPU:不做强制要求

如何查看内存,磁盘以及显卡

6.环境配置与安装

1.先下载整合包

2.解压sd-webui-aki-v4(解压存放不要在C盘)

3.如果是第一次安装 先点击 启动器运行依赖-dotnet-6.0.11.exe 下载相关依赖

4.进入sd-webui-aki-v4.2解压目录点击启动器

4.点击一键启动

5.运行控制台,出现Runing on local url 时,复制后面的地址

6.出现这个界面时,则说明运行成功了

需要注意的地方:

1.解压文件存放地址 不要带有中文,空格,特殊字符(%#&这种)如果带有中文之类的,后期可能会出现各种奇奇怪怪的错误

错误示范

E:\AI绘画\sd-webui-aki-v4

E:\(新版)AI 绘画\sd-webui-aki-v4

正确示范

E:\sd-webui\sd-webui-aki-v4

2.如果控制台出现类似 connection error 这种错误,或者download failed 这种错误,需要使用科学上网,具体操作需要自己研究

扩展知识:

1.python

stable-diffusion-web-ui 是基于python开发的,一般来说一个软件要运行,要有运行环境

python就是 stable-diffusion-web-ui 的运行环境,大多数教程需要先配置python的运行环境,而整合包 已经自己配置好相关python环境了,不需要额外配置

2.git

对于 不是编程的同学,你简单的理解为是一个下载器就行了,可以从一个叫github的开源社区 下载相应的应用插件,或者sd相关补充插件,整合包已经配置好git了,不需要进行额外配置

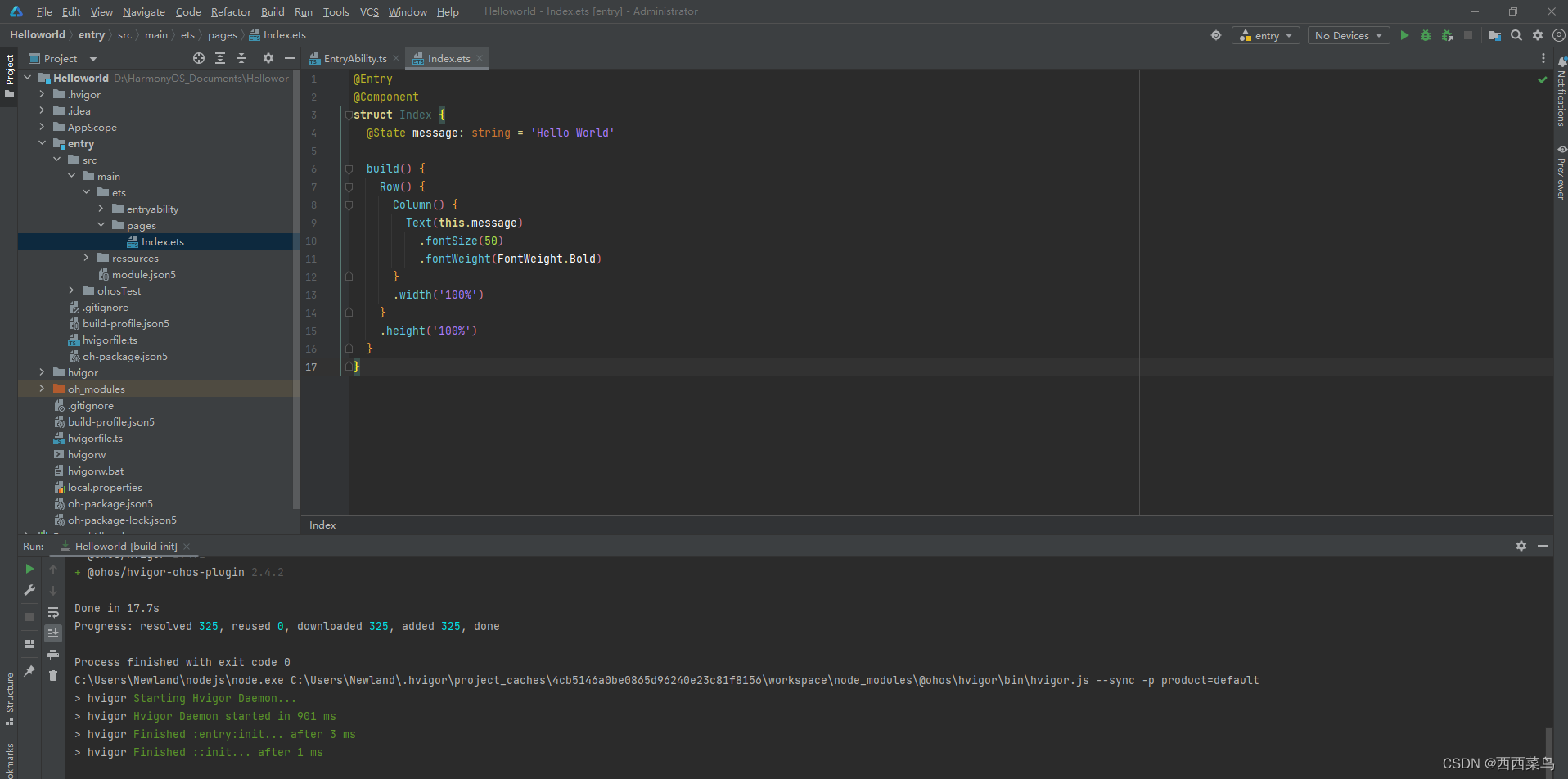

3.控制界面

我们浏览器看到的界面并不是实际上的运行系统,而真正的运行系统是控制台,界面无论关闭多少次,只要输入对应的地址,就可以多次打开

但是如果控制台关闭了,那么界面就无法打开了,而且当出现错误了,控制台会打印错误信息,供同学们排查,核心是在控制台,而不是界面,当界面出现问题的时候,先去查看控制台的信息,控制台包含所有的消息,当向别人提问的时候,务必将控制台界面截图给别人

7.SD的原理

原理涉及到机器学习以及扩散模型的方面,单拿一个知识点,都可以写十几篇论文,对于不是专门研究这方面的,我个人认为倒不用过于深究,我们只是使用者,并不是开发者。如果感兴趣的话可以研究

知乎大佬这篇Stable Diffusion原理详解,以大佬的解释,我个人觉得 最容易理解的是这句

结语

第一章我们简单的了解了一下 什么是AI绘画,以及什么是SD,以及SD的快速安装,当完成SD安装,就已经成功了一大步了,下一章我们来学习 如何使用文生图,提示词的使用,以及文生图各个参数的含义