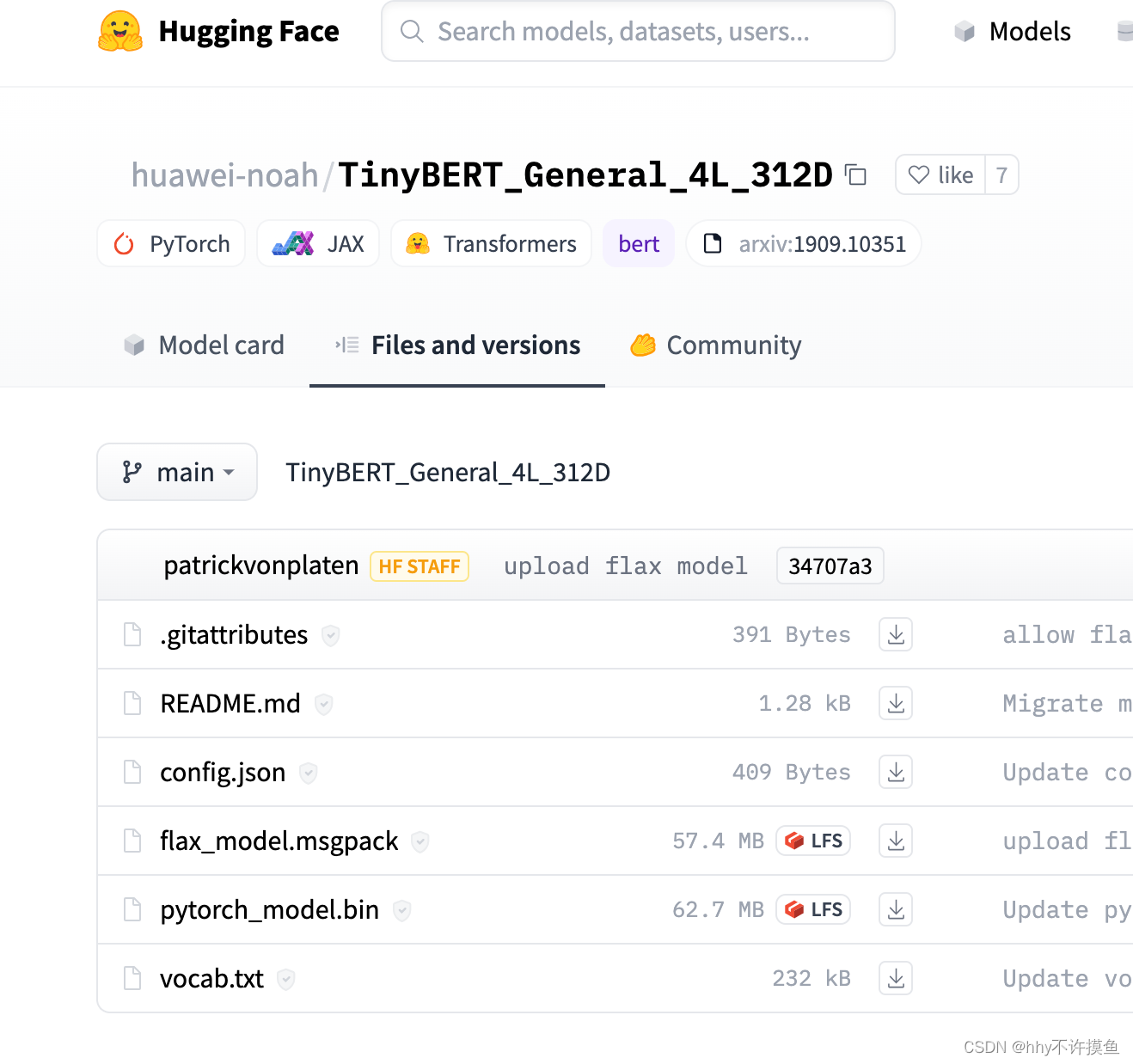

在使用HuggingFace的transformer下的BertForMaskedLM进行预训练语言模型的load时,bert会占用很大的显存。

这里可以考虑使用TinyBERT,速度和显存上都能得到很大的优化。

具体的方法进入https://huggingface.co/huawei-noah/TinyBERT_General_4L_312D/tree/main链接中,download其中的model参数,以及词典表、config。

在load模型时load这些文件就可以了。

使用Hugging Face预训练Bert处理下游任务显存占用过多

news2026/2/14 11:35:15

本文来自互联网用户投稿,该文观点仅代表作者本人,不代表本站立场。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。如若转载,请注明出处:http://www.coloradmin.cn/o/754003.html

如若内容造成侵权/违法违规/事实不符,请联系多彩编程网进行投诉反馈,一经查实,立即删除!相关文章

day01——项目导入+环境搭建

目录

软件开发整体介绍

软件开发流程

需求分析 设计阶段

编码阶段

测试阶段

上线运维

角色分工

软件环境

苍穹外卖项目介绍

项目介绍

功能架构

产品原型

编辑

技术选型 开发环境搭建——前端环境搭建 开发环境搭建——后端环境搭建

熟悉项目结构

编辑 使…

入门开发教程之网站品质教程

目录 网站品质 教程

网站品质教程

背景

要素

可访问性

可用性

可靠性

可维护性

提升网站品质

针对性调整

优化网页速度

提供多种访问方法

结论 网站品质教程

背景

在今天这个数字化时代,网站已经成为了各个行业展示产品和服务的重要媒介。而网站品质是…

百分点科技苏萌受邀出席首届全国统计与数据科学联合会议

7月11-13日,首届全国统计与数据科学联合会议在北京举行,会议由中国现场统计研究会、中国数学会概率统计分

会、全国工业统计学教学研究会和中国商业统计学会联合主办,北京大学统计科学中心承办,旨在促进统计与数据科学领域发展&a…

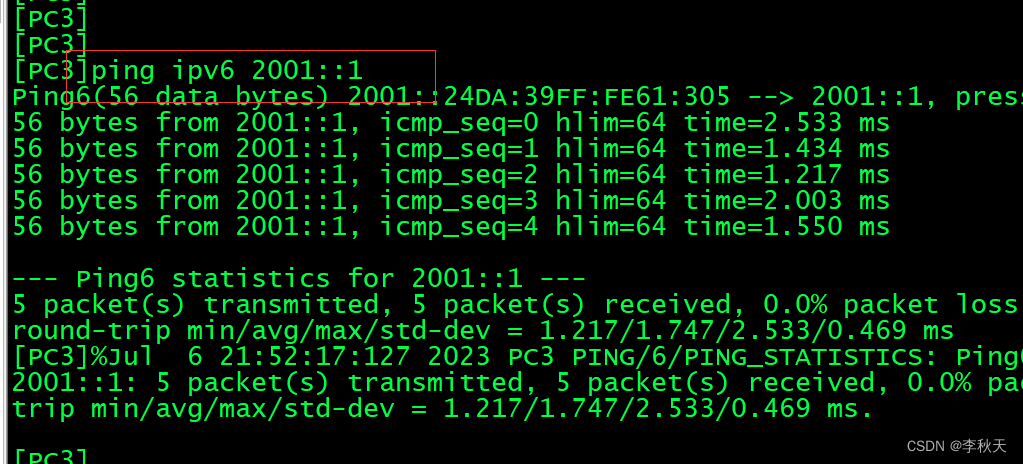

H3C-Cloud Lab实验-IPv6实验

实验拓扑图: 实验需求:

1、在R1和PC3上开启IPv6链路本地地址自动生成,测试是否能够使用链路本地地址互通

2、为R1配置全球单播地址2001::1/64,使PC3能够自动生成与R1同一网段的IPv6地址3、测试R1和PC3是否能够使用全球单播地址互…

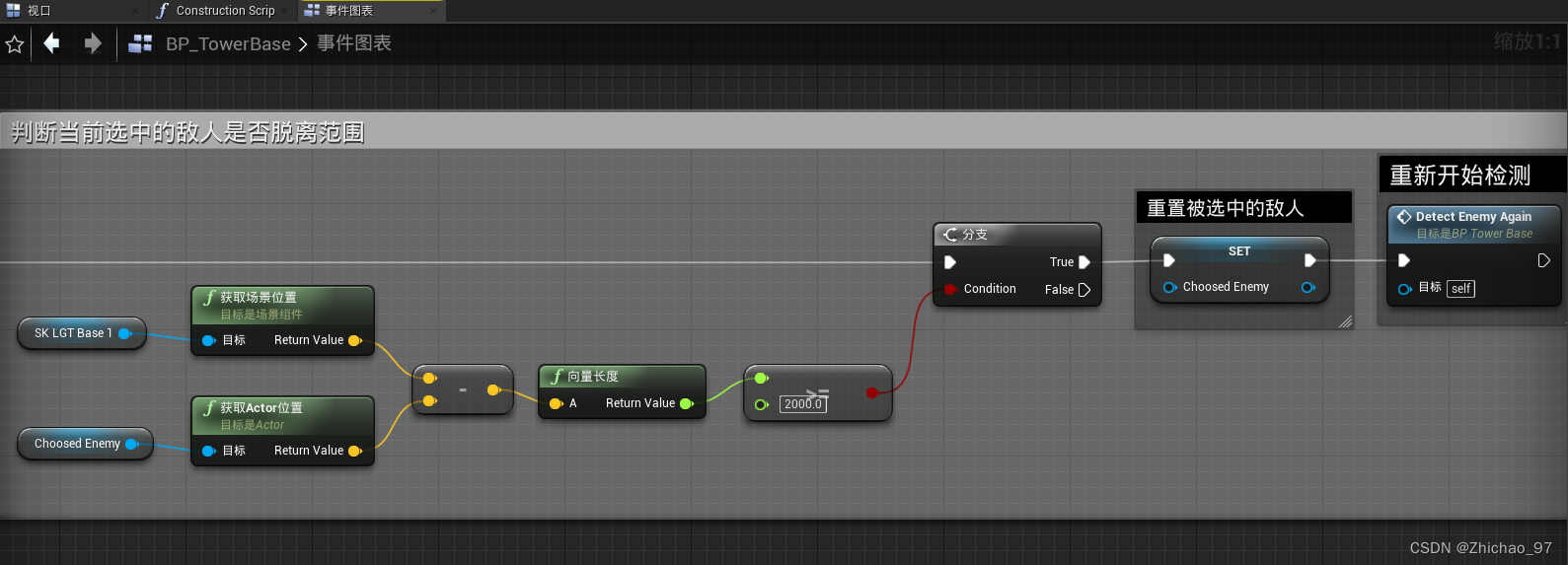

【UE4 塔防游戏系列】05-制作可跟踪旋转的炮塔

目录

效果

步骤

一、设置游戏观察视角

二、设置PlayerController

三、制作可跟踪旋转的炮塔 效果 步骤

一、设置游戏观察视角

在视口中调整好位置,能够看到敌人行走的全部路线即可。然后在此处创建CameraActor 打开关卡蓝图,设置使用这个相机的…

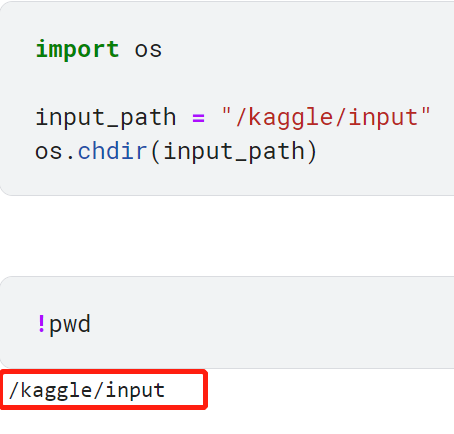

【Kaggle】初学者几个冷门的操作总结

文章目录 一、如何看当前的目录?二、Kaggle如何切换路径?三、与包安装或设置有关的错误四、如何把 Kaggle 上的 input 数据转到 output 中? 一、如何看当前的目录?

在 Linux 中,你可以使用 pwd 命令来查看当前所在的目…

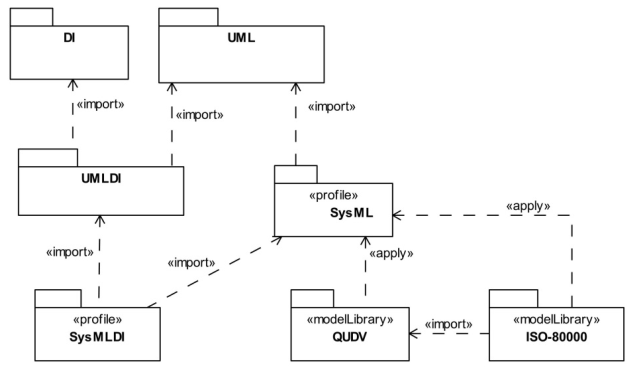

UML与SYSML的关系

UML与SysML的联系

UML(统一建模语言)和SysML(系统建模语言)是两种与建模相关的语言,它们之间存在联系和区别。

SysML的图分类如下图所示。

联系

SysML是基于UML的,它重用了UML 2的子集,并提…

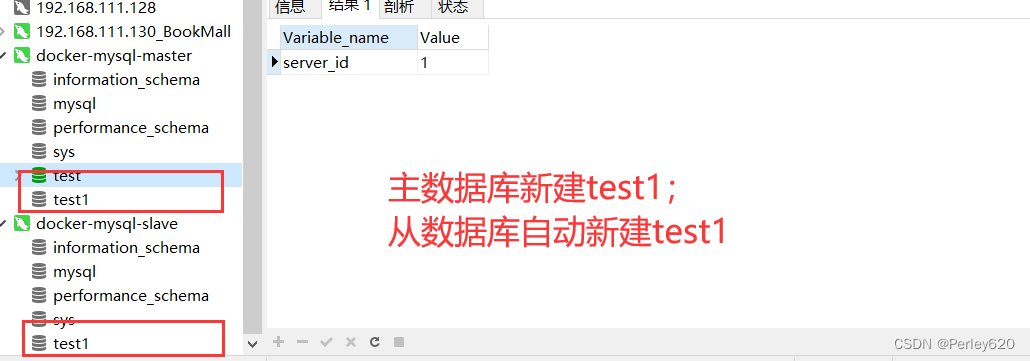

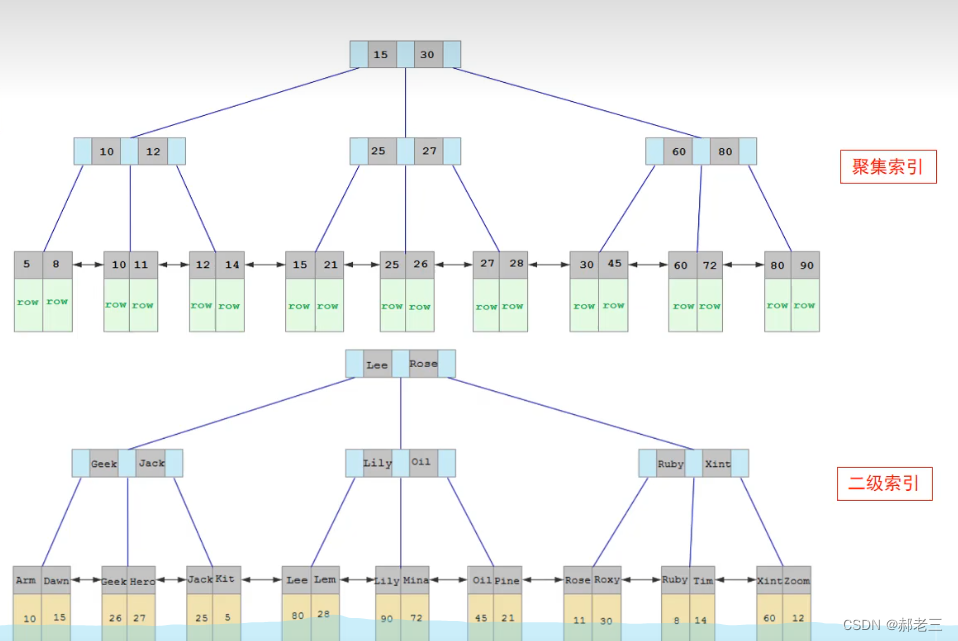

MySQL持久化数据——主从分离 Linux下创建2个MySQL的Docker容器 挂载方式启动 配置主从

目录 引出数据库的事务1.原子性2.一致性3.隔离性4.持久性 MySQL持久化数据0.在宿主机centos创建主的文件夹1.拷贝my.cnf配置文件2.挂载方式启动主mysql3.修改my.cnf文件的权限【bug】mysql: [ERROR] unknown variable server-id200. 3.修改主的my.cof文件4.创建主从账号slave5.…

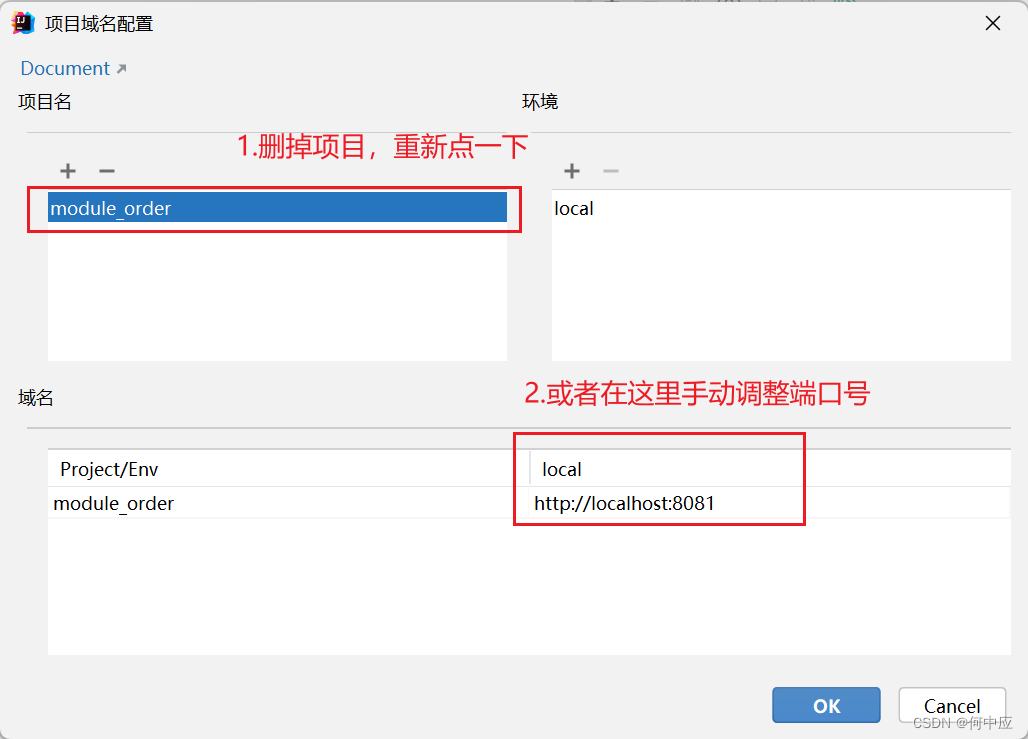

使用fast测试的错误

错误:Connection refused: connect 分析&解决

检查服务的端口号和fast生成请求时的端口号是否一致,不一致会报上面的错误 分析:设置服务配置的方法很多,可以写在配置文件里,也可以写在命令行里,当有多…

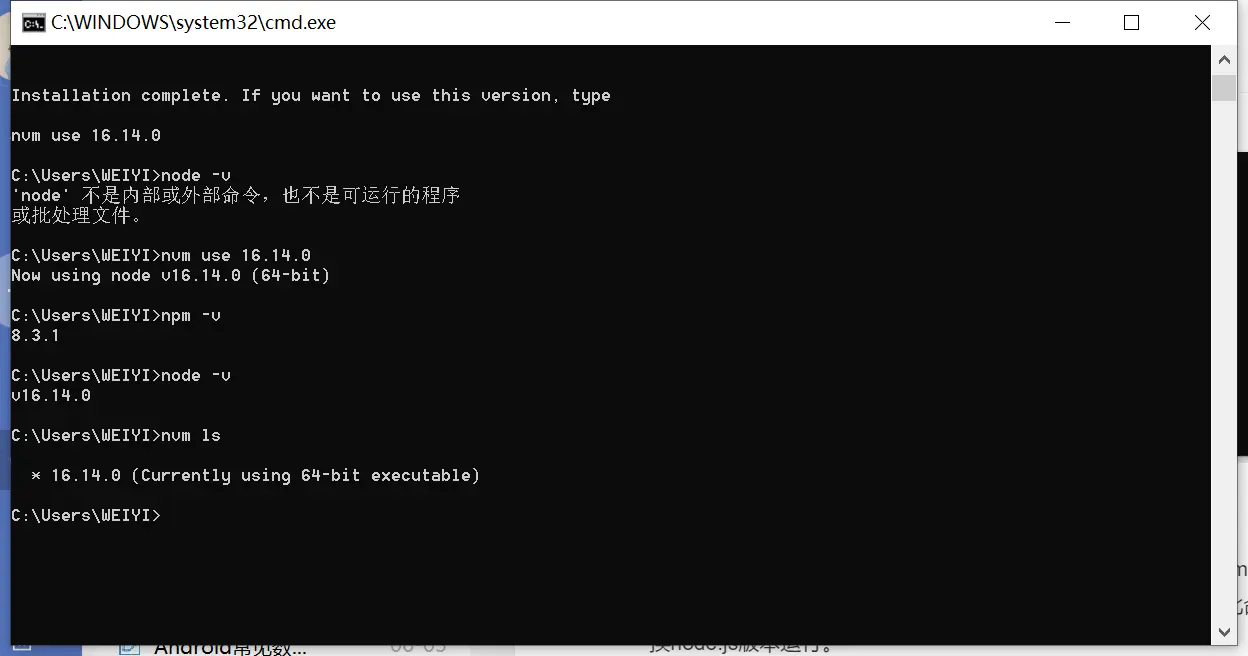

windows nodejs 版本切换

一、按健winR弹出窗口,键盘输入cmd,然后敲回车。然后进入命令控制行窗口,并输入where node查看之前本地安装的node的路径。 二、找到上面找到的路径,将node.exe所在的父目录里面的所有东西都删除。 三、从官网下载安装包 https://github.com/…

轻量级性能测试工具 wrk 应该如何使用?

项目设计之初或者是项目快要结束的时候,大佬就会问我们,这个服务性能测试的结果是什么,QPS 可以达到多少,RPS 又能达到多少?接口性能可以满足未来生产环境的实际情况吗?有没有自己测试过自己接口的吞吐量&a…

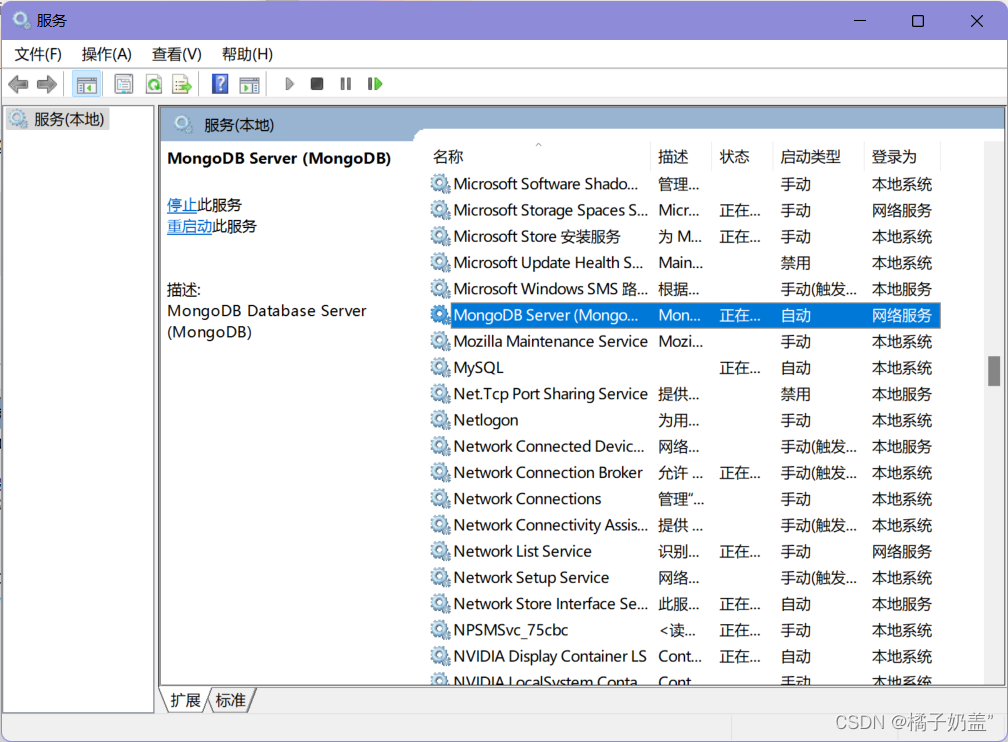

MongoDB安装配置教程(详细版)

前言:MongoDB是前端开发人员普遍使用的数据库,因为MongoDB不需要图形界面,是一个基于分布式文件存储的开源数据库系统。MongoDB 将数据存储为一个文档,数据结构由键值对(key>value)组成;MongoDB 文档类似于 JSON 对…

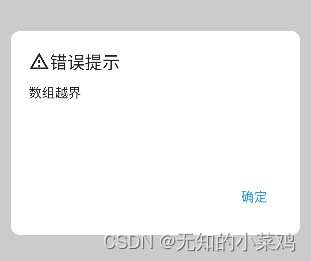

Flutter:自定义错误显示

为什么要自定义错误处理

以下面数组越界的错误为例:

class _YcHomeBodyState extends State<YcHomeBody> {List<String> list [苹果, 香蕉];overrideWidget build(BuildContext context) {return Center(child: Column(children: [Text(list[0]),Tex…

小区物业管理信息系统设计与实现(论文+源码)

小区物业管理信息系统设计与实现(论文源码) 本篇 论文源码私我 以上内容只是精简版 还有很多原创类型论文 摘 要

随着互联网的发展,网络技术的发展变得极其重要,所以依靠计算机处理业务成为了一种社会普遍的现状。管理方式也自然而然的向着现代化技术方…

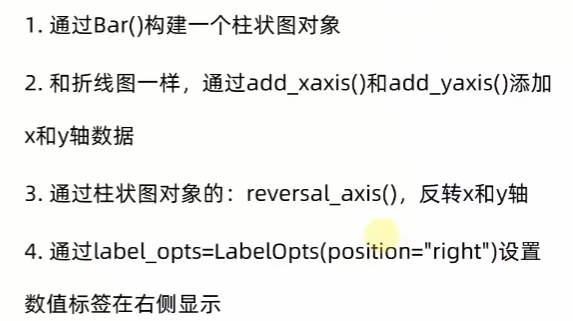

python_day8_timeline

带时间线的柱状图

导包

from pyecharts.charts import Bar, Timeline

from pyecharts.options import *

from pyecharts.globals import *创建柱状图1

bar1 Bar()

bar1.add_xaxis([中国, USA, 不列颠])

bar1.add_yaxis(GDP, [30, 20, 10],label_optsLabelOpts(position&quo…

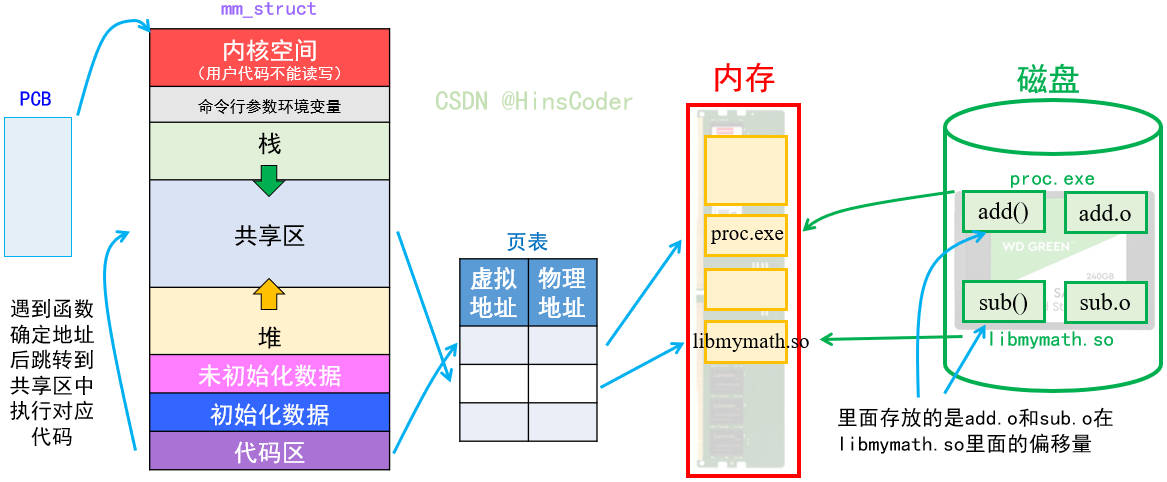

【Linux详解】——文件系统(磁盘结构、软硬链接、动静态库)

📖 前言:本期介绍文件系统。 目录 🕒 1. 磁盘结构🕘 1.1 物理结构🕘 1.2 存储结构🕘 1.3 逻辑结构 🕒 2. 文件系统🕘 2.1 对 IO 单位的优化🕘 2.2 磁盘分区与分组&#x…

一套电子病历系统源码(EMR)

EMR电子病历系统源码

电子病历系统面向门诊医生和病房临床医生,实现了医生日常阅读、书写病历和医院管理病历的需求,它包括知识库管理、病历模版制作、医生书写病历、开各种检查检验申请单、查询各种报告单、电子病历浏览、病历质量控制等功能。

它将病…

JMeter基础 — JMeter聚合报告详解

提示:聚合报告组件的使用和察看结果树组件的使用方式相同。本篇文章主要是详细的介绍一下聚合报告组件内容,不做示例演示。 1、聚合报告介绍

在使用JMeter进行性能测试时,聚合报告(Aggregate Report)可以说是必用的监听器。

(1&…

【微信小程序创作之路】- 小程序窗口整体配置(导航栏、标题)

【微信小程序创作之路】- 小程序窗口导航栏配置

第五章 微信小程序窗口导航栏配置 文章目录 【微信小程序创作之路】- 小程序窗口导航栏配置前言一、入口文件的配置二、页面配置三、全局默认窗口配置1.navigationBarTitleText:导航栏标题文字2.navigationBarBackgr…