通过GPT在短时间内生成完整诈骗话术,套路啊套路

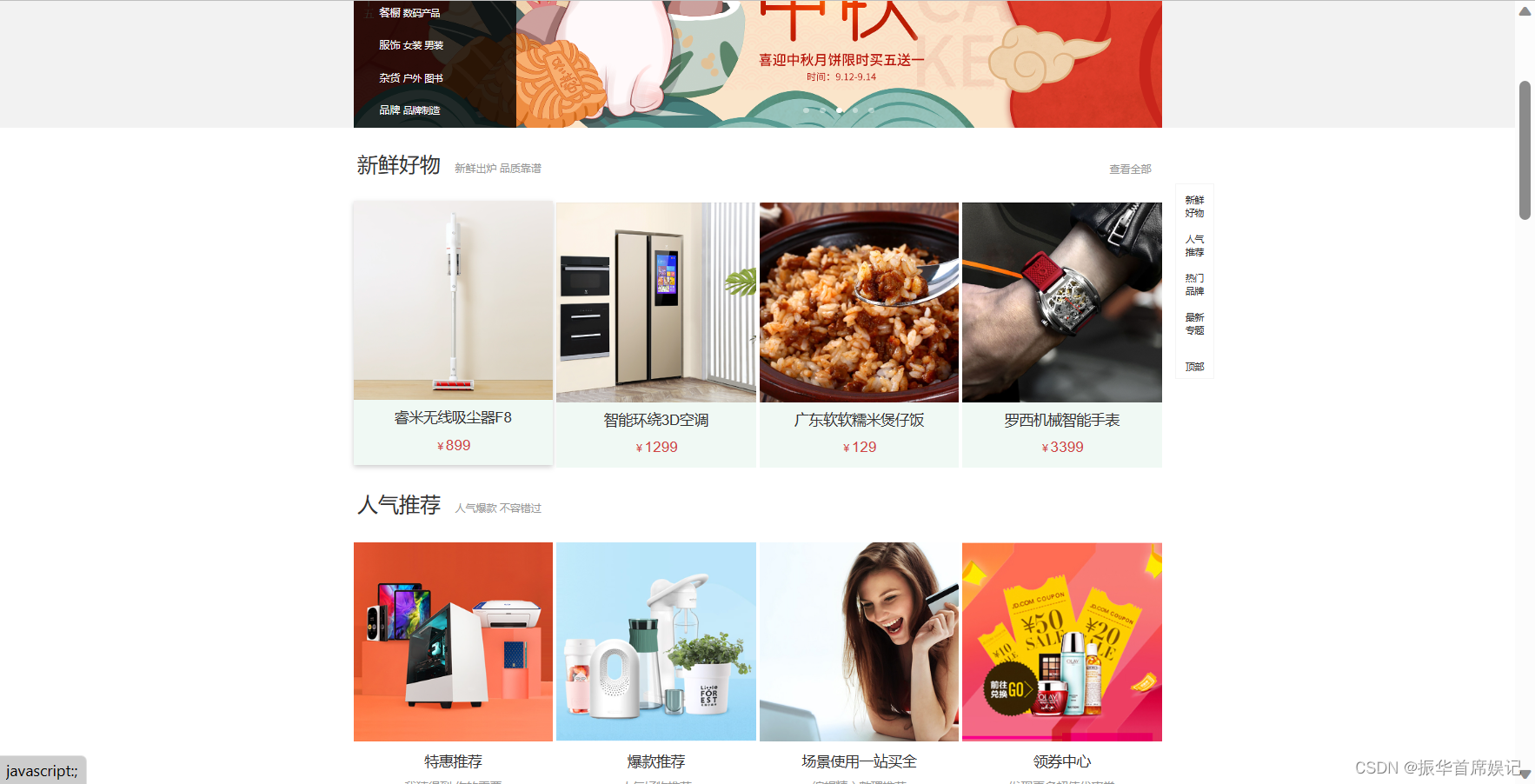

“虚拟角色”可以虚拟客服,还可以虚拟恋人玩杀猪盘

让受害人以为自己“坠入爱河”

套路还是从前的套路

但骗子用上了新的工具

又换上了很多马甲

防不胜防

你以为OpenAI不知道骗子会用这个工具来做坏事吗?

当然知道,人家还添加了安全保护机制。

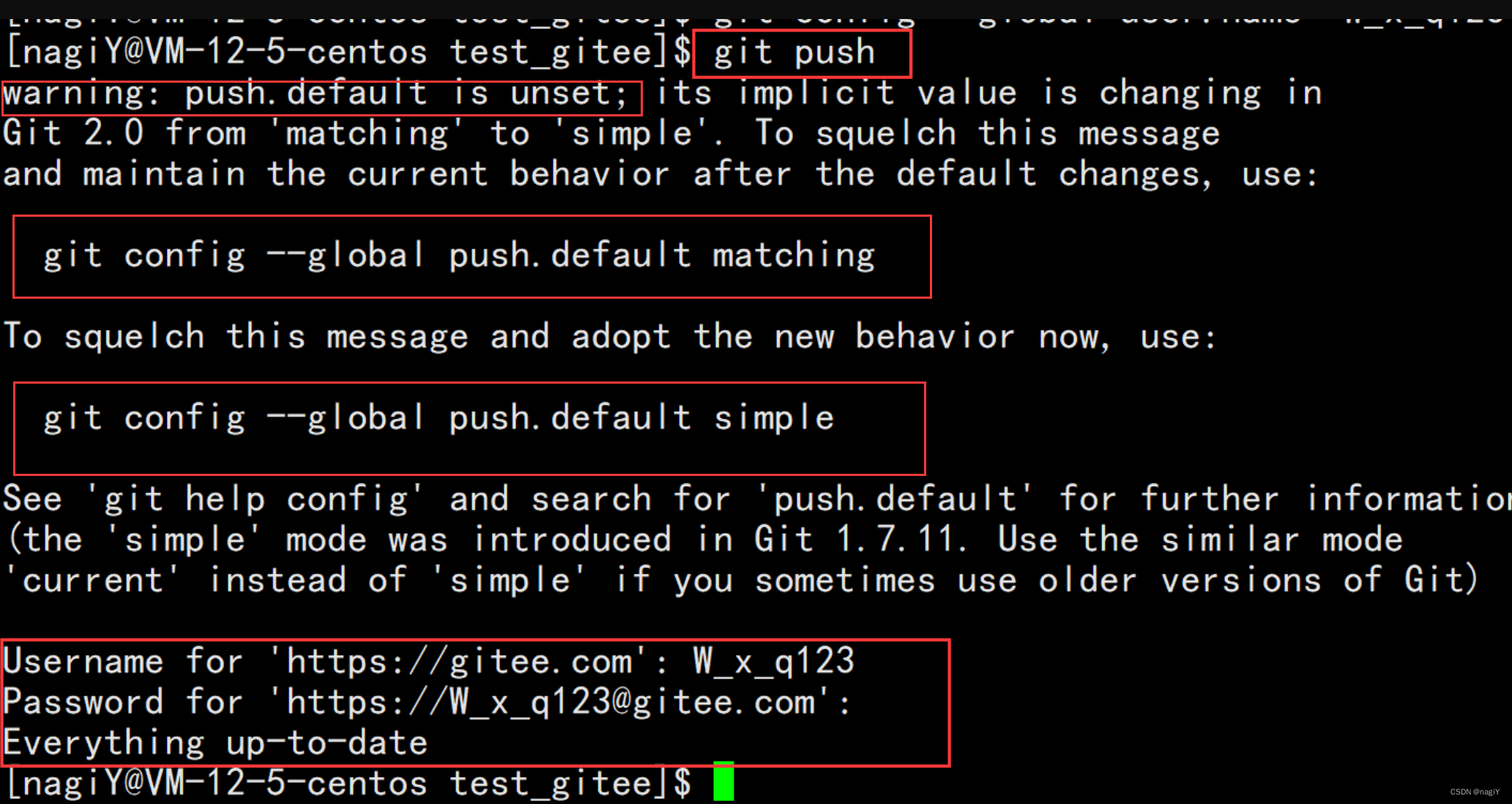

但防不住骗子有文化啊。人家也会突破安全机制的嘛。

就像当年坏人用群发短信的功能实施诈骗,逼得运营商不得不把对个人发送短信的数量进行限制,对企业用的端口也查得越来越严。

——但骗子能换工具啊,不用短信可以换微信、换直播、换快闪群……

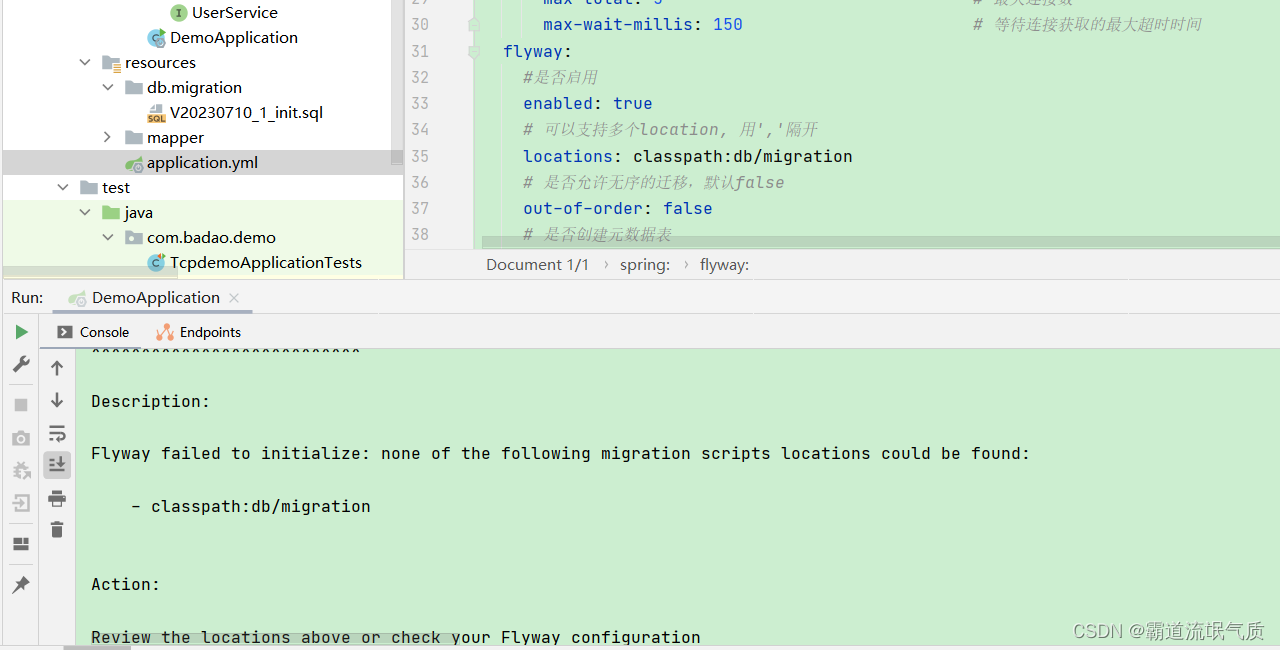

现在坏人突破网站的安全机制,还能用ChatGPT快速编程,写软件来继续做坏事;比如写钓鱼邮件,群发,获得你的个人信息;还有加密工具远程锁定你的电脑,再勒索你;再比如生成脚本,远程攻击你的交换网络,等等。

用AI谈一场“虚拟恋爱”,只算得上是骗子的入门级骗法。

人工智能强大的生产效率,能产生的是大批量的边际成本几乎为0的“虚拟恋人”。

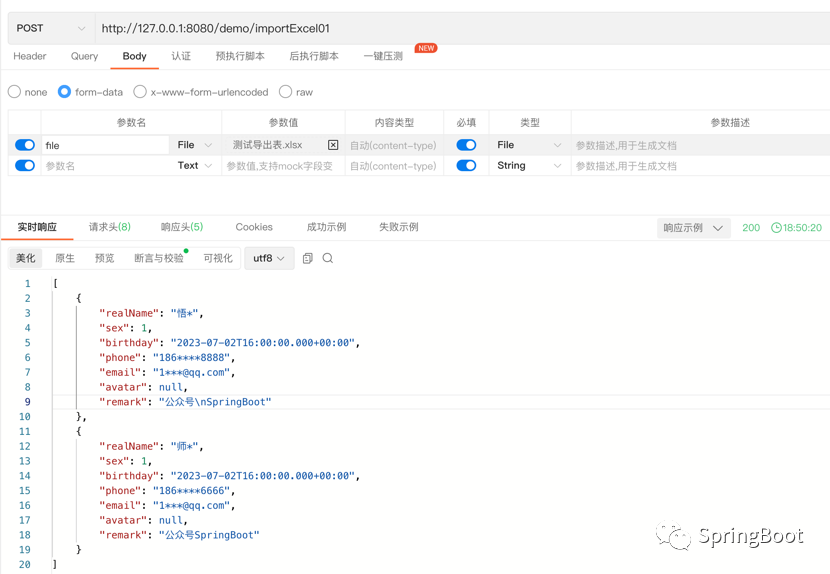

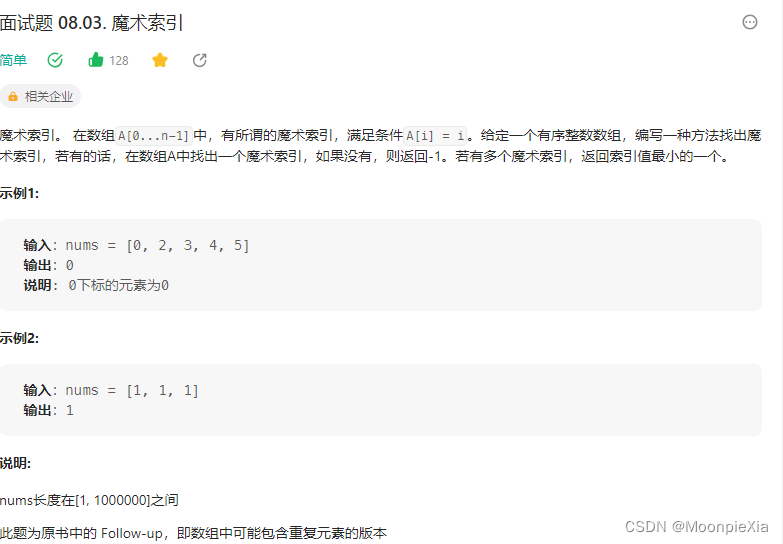

利用强大的技术,一条诈骗信息几秒钟内就可以生成,从自我介绍、兴趣爱好,到一份扣人心弦的“情书”。

再结合“用户画像”的玩法,录入目标用户的特征,对话术进行个性化升级改造,生成的情书就不是千篇一律的情话,而是私人定制的缠绵。

再用生成式AI,创建一个“虚拟恋人”,引诱目标用户坠入爱河

接下来就是重头戏了,用GPT辅助编写收款程序,用链接获取银行卡信息,就可以一气呵成骗到钱。

当然,这种“杀猪盘”的玩法并不新鲜,杭州的一些社区群里,经常会有防骗通报发出来,似乎每周都有人被“杀猪”。

不同的是,曾经的杀猪盘,或许是真人,陪你聊天,发你信息,至少是付出了真人的脑力和时间;现在用AI可以模仿真人的脸、模仿真人的声音,模仿真人的视频,还能24小时输出文字,不用休息,让人无法分辨屏幕的另一端到底是人还是一段代码。

为了测试人是否对AI情话产生“信赖”,4个月前,全球最大的安全技术公司迈克菲(McAfee)用AI生成一封情书,并发给全球5000个用户。

这些用户知情,这情书可能是人工智能生成的,但这并不影响依然有33%的人相信这些情话出自真人,而不是一团代码。

而坚信这情书是由AI生成的用户,只有31%

剩下的36%的用户,表示无法区分是人工的手笔,还是人工智能的手笔。

对于毫无戒心的人来说,人工智能更容易得手。

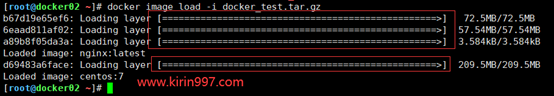

除了“虚拟恋人”,黑客们还在用GPT批量生成勒索软件和恶意代码。

你要知道ChatGPT的养料,所拥有的知识含量,比我这个号的所有粉丝看过的书多得多,坏人用起高智慧工具来,你根本不知道自己被套路了。

就是那种你被骗了——还在帮骗子数钱那种。

不是因为GPT的出现才让骗子这么容易得手。

每一次技术的进步,都有被坏人利用的空间,就像有人在抖音骗钱,还明目张胆地骗一样。

当然,他们每分每秒都可能在更新骗术。

不受监管的人工智能,在不知不觉中就成为我们的巨大威胁。所以监管很重要。