提示:文章写完后,目录可以自动生成,如何生成可参考右边的帮助文档

LVS负载均衡群集 NAT模式

- 一、理解负载均衡群集的原理

- 1.企业群集应用概述

- 2.企业群集分类

- 3.负载均衡群集架构

- 4.负载均衡群集工作模式分析

- 5.NAT模式

- 6.TUN模式

- 7.DR模式

- 二、LVS虚拟服务器

- 1.Linux Virtual Server

- 2.LVS的负载调度算法

- 三、LVS负载均衡群集-NAT模式部署

- ipvsadm 工具选项说明

- 实验环境

- 1.部署共享存储

- 2.配置节点服务器

- 3.配置负载调度器

- 4.测试效果

一、理解负载均衡群集的原理

1.企业群集应用概述

群集的含义

- Cluster,集群、群集

- 由多台主机构成,但对外只表现为一个整体,只提供一个访问入口 (域名或IP地址),相当于一台大型计算机。

问题

- 互联网应用中,随着站点对硬件性能、响应速度、服务稳定性、数据可靠性等要求越来越高,单台服务器已经无法满足负载均衡及高可用的要求

解决方法

- 使用价格昂贵的小型机、大型机

- 使用多台相对廉价的普通服务器构建服务群集

通过整合多台服务器,使用 LVS来达到服务器的高可用和负载均衡,并以同一个IP地址对外提供相同的服务。

在企业中常用的一种群集技术–LVS (Linux Virtual Server,Linux虚拟服务器)

2.企业群集分类

根据群集所针对的目标差异,可分为三种类型

- 负载均衡群集

- 高可用群集

- 高性能运算群集

负载均衡群集 (Load Balance Cluster)

- 提高应用系统的响应能力、尽可能处理更多的访问请求减少延迟为目标,获得高并发、高负载(LB)的整体性能

- LB的负载分配依赖于主节点的分流算法,将来自客户机的访问请求分担给多个服务器节点,从而缓解整个系统的负载压力。例如,“DNS轮询” “反向代理”等

高可用群集 (High Availability Cluster)

- 提高应用系统的可靠性、尽可能地减少中断时间为目标,确保服务的连续性,达到高可用(HA) 的容错效果

- HA的工作方式包括双工和主从两种模式,双工即所有节点同时在线:主从则只有主节点在线,但当出现故障时从节点能自动切换为主节点。例如,“故障切换” “双机热备” 等

高性能运算群集 (High Performance Computer Cluster)

- 以提高应用系统的CPU运算速度、扩展硬件资源和分析能力为目标,获得相当于大型、超级计算机的高性能运算 (HPC)能力

- 高性能依赖于“分布式运算”、“并行计算”,通过专用硬件和软件将多个服务器的CPU、内存等资源整合在一起,实现只有大型、超级计算机才具备的计算能力。例如,“云计算”“网格计算”等

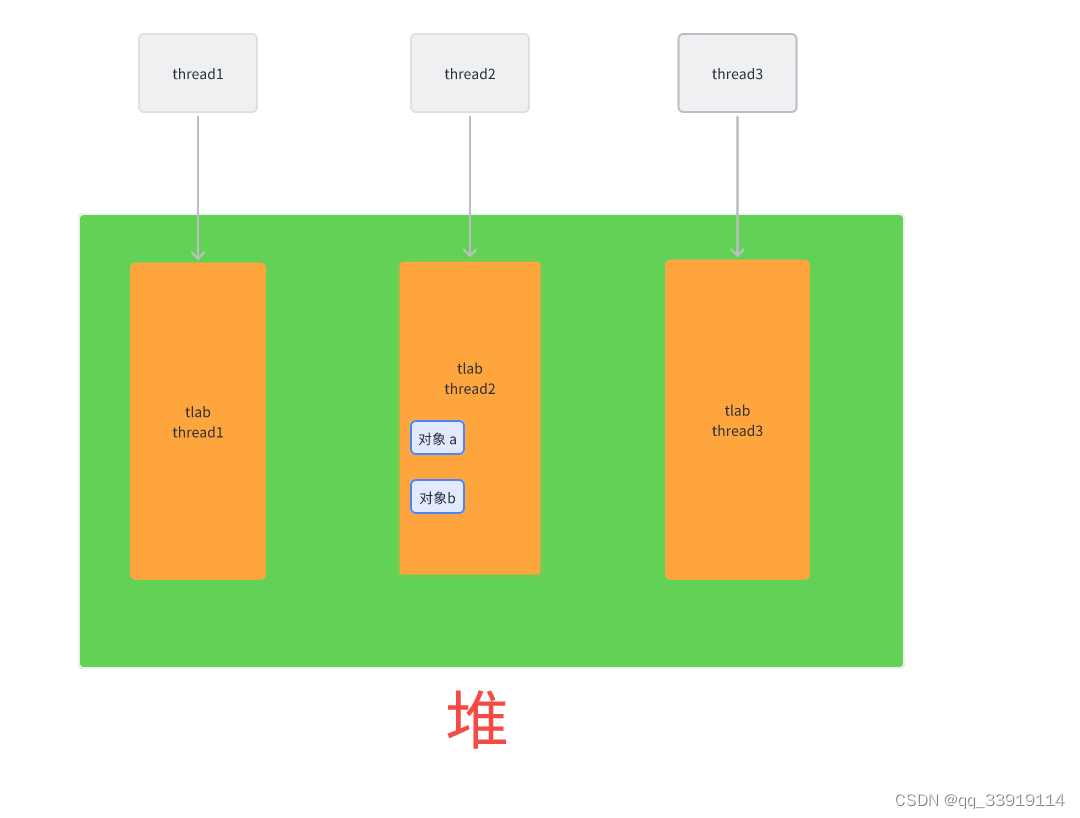

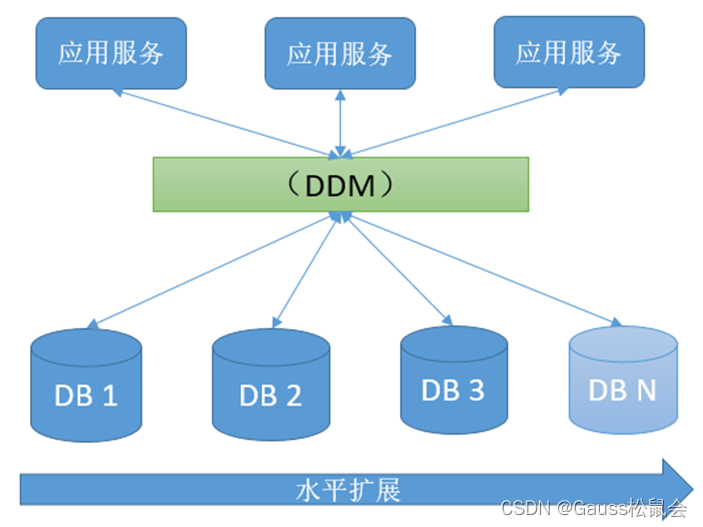

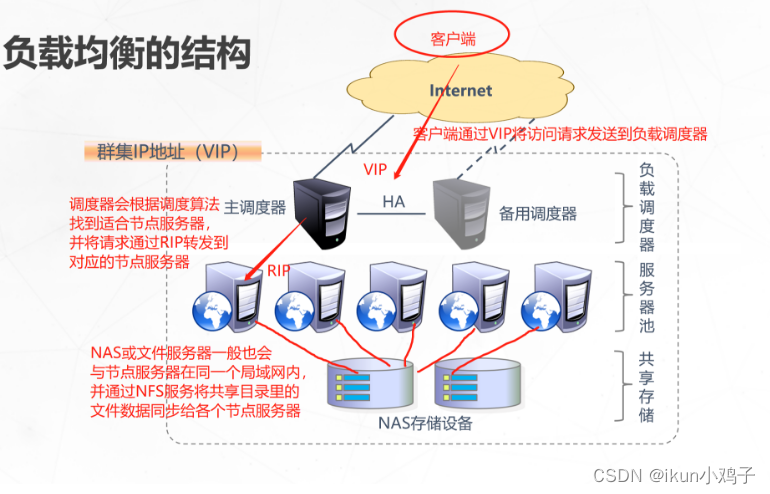

3.负载均衡群集架构

负载均衡的结构

-

第一层,负载调度器(Load Balancer或Director)

访问整个群集系统的唯一入口,对外使用所有服务器共有的VIP地址,也称为群集IP 地址。通常会配置主、备两台调度器实现热备份,当主调度器失效以后能够平滑替换至备用调度器,确保高可用性。 -

第二层,服务器池 (Server Pool)

群集所提供的应用服务、由服务器池承担,其中每个节点具有独立的RIP地址(真实IP),只处理调度器分发过来的客户机请求。当某个节点暂时失效时,负载调度器的容错机制会将其隔离,等待错误排除以后再重新纳入服务器池。 -

第三层,共享存储 (Share Storage)

为服务器池中的所有节点提供稳定、一致的文件存取服务,确保整个群集的统一性共享存储可以使用NAS设备,或者提供 NFS共享服务的专用服务器。

4.负载均衡群集工作模式分析

- 负载均衡群集是目前企业用得最多的群集类型

群集的负载调度技术有三种工作模式

- 地址转换

- P隧道

- 直接路由

5.NAT模式

地址转换

- Network Address Translation ,简称NAT模式

- 类似于防火墙的私有网络结构,负载调度器作为所有服务器节点的网关,即作为客户机的访问入口,也是各节点回应客户机的访问出口

- 服务器节点使用私有IP地址,与负载调度器位于同一个物理网络,安全性要优于其他两种方式

6.TUN模式

IP隧道

- IP Tunnel,简称TUN模式

- 采用开放式的网络结构,负载调度器仅作为客户机的访问入口,各节点通过各自的Internet连接直接回应客户机,而不再经过负载调度器

- 服务器节点分散在互联网中的不同位置具有独立的公网IP地址,通过专用IP隧道与负载调度器相互通信

7.DR模式

直接路由

- Direct Routing,简称DR模式

- 采用半开放式的网络结构,与TUN模式的结构类似,但各节点并不是分散在各地,而是与调度器位于同一个物理网络

- 负载调度器与各节点服务器通过本地x络连接,不需要建立专用的IP隧道

二、LVS虚拟服务器

1.Linux Virtual Server

- 针对Linux内核开发的负载均衡解决方案

- 1998年5月,由我国的章文嵩博士创建

- 官方网站: http://www.linuxvirtualserver.org/

- LVS实际上相当于基于IP地址的虚拟化应用,为基于IP地址和内容请求分发的负载均衡提出了一种高效的解决方法

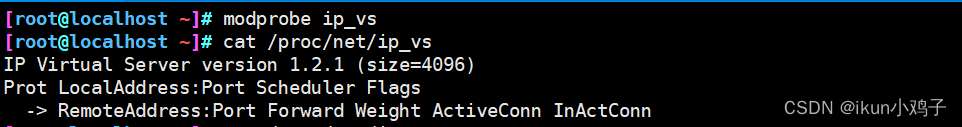

- LVS现在已成为 Linux 内核的一部分,默认编译为 ip_vs 模块必要时能够自动调用。在 CentOS 7 系统中,以下操作可以手动加载ip_vs 模块,并查看当前系统中ip_vs 模块的版本信息。

2.LVS的负载调度算法

- 轮询 (Round Robin)

将收到的访问请求按照顺序轮流分配给群集中的各节点(真实服务器均等地对待每一台服务器,而不管服务器实际的连接数和系统负载 - 加权轮询 (Weighted Round Robin)

根据调度器设置的权重值来分发请求,权重值高的节点优先获得任务,分配的请求数越多

保证性能强的服务器承担更多的访问流量 - 最少连接(Least Connections)

根据真实服务器已建立的连接数进行分配,将收到的访问请求优先分配给连接数最少的节点 - 加权最少连接(Weighted Least Connections)

在服务器节点的性能差异较大时,可以为真实服务器自动调整权重性能较高的节点将承担更大比例的活动连接负载

三、LVS负载均衡群集-NAT模式部署

ipvsadm 工具选项说明

| 工具 | 说明 |

|---|---|

| -A: | 添加虚拟服务器 |

| -D: | 删除整个虚拟服务器 |

| -s: | 指定负载调度算法(轮询:rr、加权轮询:wrr、最少连接:lc、加权最少连接:wlc) |

| -a: | 表示添加真实服务器(节点服务器) |

| -d: | 删除某一个节点 |

| -t: | 指定 VIP地址及 TCP端口 |

| -r: | 指定 RIP地址及 TCP端口 |

| -m: | 表示使用 NAT群集模式 |

| -g: | 表示使用 DR模式 |

| -i: | 表示使用 TUN模式 |

| -w: | 设置权重(权重为 0 时表示暂停节点) |

| -p 60: | 表示保持长连接60秒(默认关闭连接保持) |

| -l: | 列表查看 LVS 虚拟服务器(默认为查看所有) |

| -n: | 以数字形式显示地址、端口等信息,常与“-l”选项组合使用。ipvsadm -ln |

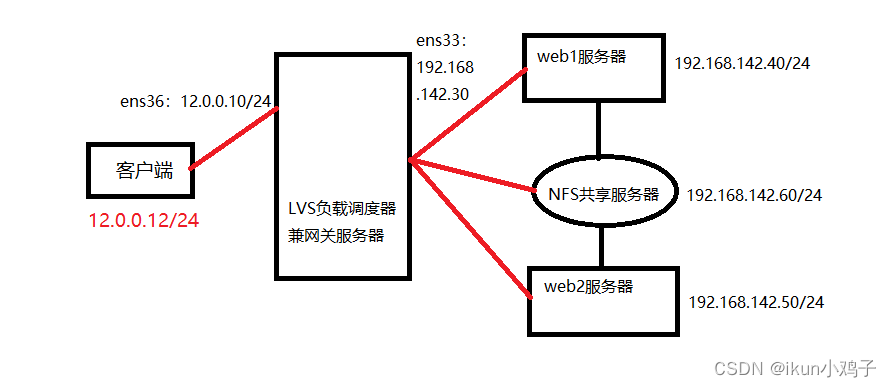

实验环境

负载调度器:内网关 ens33:192.168.142.30,外网关 ens36:12.0.0.10

Web节点服务器1:192.168.142.40

Web节点服务器2:192.168.142.50

NFS服务器:192.168.142.60

客户端:12.0.0.12

1.部署共享存储

systemctl stop firewalld.service

systemctl disable firewalld.service

setenforce 0

yum install nfs-utils rpcbind -y

systemctl start rpcbind.service

systemctl start nfs.service

systemctl enable nfs.service

systemctl enable rpcbind.service

mkdir /opt/ztm /opt/hss

chmod 777 /opt/ztm /opt/hss

echo 'this is ztm web!' > /opt/ztm/index.html

echo 'this is hss web!' > /opt/hss/index.html

vim /etc/exports

/usr/share *(ro,sync)

/opt/ztm 192.168.142.0/24(rw,sync)

/opt/hss 192.168.142.0/24(rw,sync)

--发布共享---

exportfs -rv

2.配置节点服务器

systemctl stop firewalld.service

systemctl disable firewalld.service

setenforce 0

yum install httpd -y

systemctl start httpd.service

systemctl enable httpd.service

yum install nfs-utils rpcbind -y

showmount -e 192.168.142.60

systemctl start rpcbind

systemctl enable rpcbind

--192.168.142.40---

mount.nfs 192.168.142.60:/opt/ztm /var/www/html

vim /etc/fstab

192.168.142.60:/opt/ztm /var/www/html nfs defaults,_netdev 0 0

mount -a

--192.168.142.50---

mount.nfs 192.168.142.60:/opt/hss /var/www/html

vim /etc/fstab

192.168.142.60:/opt/hss /var/www/html nfs defaults,_netdev 0 0

mount -a

3.配置负载调度器

systemctl stop firewalld.service

systemctl disable firewalld.service

setenforce 0

`配置SNAT转发规则`

vim /etc/sysctl.conf

net.ipv4.ip_forward = 1

或 echo '1' > /proc/sys/net/ipv4/ip_forward

sysctl -p

iptables -t nat -F

iptables -F

iptables -t nat -A POSTROUTING -s 192.168.142.0/24 -o ens36 -j SNAT --to-source 12.0.0.10

`加载LVS内核模块`

modprobe ip_vs #加载 ip_vs模块

cat /proc/net/ip_vs #查看 ip_vs版本信息

for i in $(ls /usr/lib/modules/$(uname -r)/kernel/net/netfilter/ipvs|grep -o "^[^.]*");do echo $i; /sbin/modinfo -F filename $i >/dev/null 2>&1 && /sbin/modprobe $i;done

`安装ipvsadm 管理工具`

yum -y install ipvsadm

--启动服务前须保存负载分配策略---

ipvsadm-save > /etc/sysconfig/ipvsadm

或者 ipvsadm --save > /etc/sysconfig/ipvsadm

systemctl start ipvsadm.service

`配置负载分配策略(NAT模式只要在服务器上配置,节点服务器不需要特殊配置)`

ipvsadm -C #清除原有策略

ipvsadm -A -t 12.0.0.10:80 -s rr [-p 60]

ipvsadm -a -t 12.0.0.10:80 -r 192.168.142.40:80 -m [-w 1]

ipvsadm -a -t 12.0.0.10:80 -r 192.168.142.50:80 -m [-w 1]

ipvsadm #启用策略

ipvsadm -ln #查看节点状态,Masq代表 NAT模式

ipvsadm-save > /opt/ipvsadm #保存策略

ipvsadm-save > /etc/sysconfig/ipvsadm

删除群集中某一节点服务器

ipvsadm -d -t 12.0.0.1:80 -r 192.168.142.61:80

删除整个虚拟服务器

ipvsadm -D -t 12.0.0.1:80

停止服务(清空策略),如果selinux没关

systemctl stop ipvsadm 闭/etc/sysconfig/ipvsadm内容也会清空

启动服务(根据/etc/sysconfig/ipvsadm恢复策略)

systemctl start ipvsadm

恢复LVS 策略

ipvsadm-restore < /opt/ipvsadm

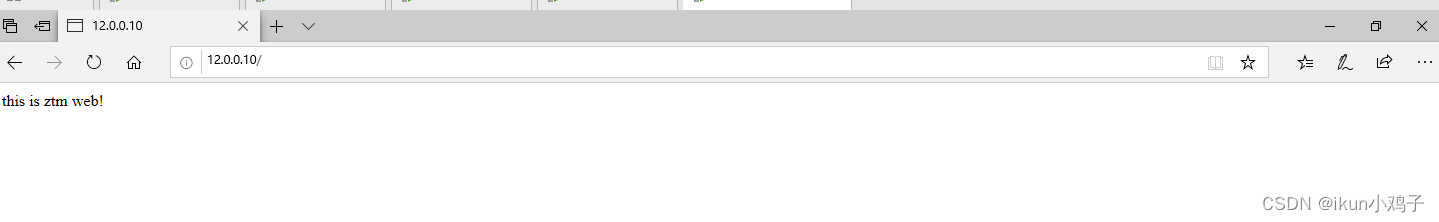

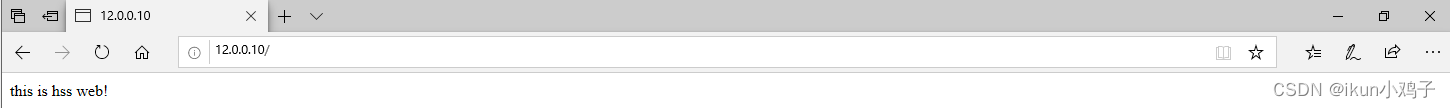

4.测试效果

在一台IP为12.0.0.12的客户机使用浏览器访问 http://12.0.0.10/ ,不断刷新浏览器测试负载均衡效果,刷新间隔需长点(或者关闭Web服务的连接保持)。