【动手学习深度学习】逐行代码解析合集

07多层感知机的简洁实现

视频链接:动手学习深度学习–softmax回归简洁实现

课程主页:https://courses.d2l.ai/zh-v2/

教材:https://zh-v2.d2l.ai/

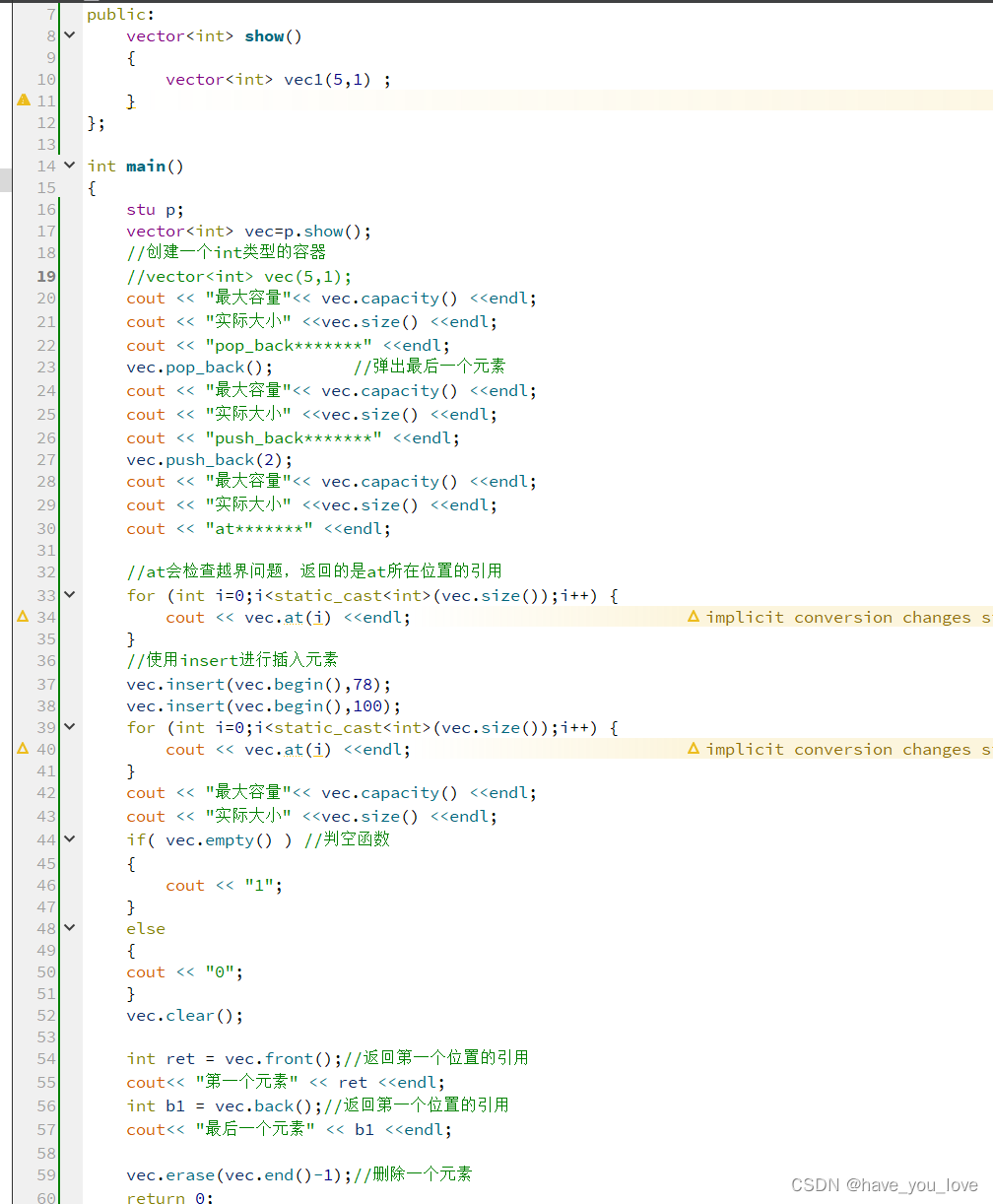

1、代码

import torch

from torch import nn

from d2l import torch as d2l

import os

os.environ["KMP_DUPLICATE_LIB_OK"]="TRUE"

"====================1、模型===================="

# 与softmax回归的简洁实现相比, 唯一的区别是我们添加了2个全连接层(之前我们只添加了1个全连接层)

# 第一层是隐藏层,它包含256个隐藏单元,并使用了ReLU激活函数,第二层是输出层。

net = nn.Sequential(nn.Flatten(),

nn.Linear(784, 256),

nn.ReLU(),

nn.Linear(256, 10))

def init_weights(m):

if type(m) == nn.Linear:

nn.init.normal_(m.weight, std=0.01)

net.apply(init_weights);

# 训练过程的实现与我们实现softmax回归时完全相同,

# 这种模块化设计使我们能够将与模型架构有关的内容独立出来。

batch_size, lr, num_epochs = 256, 0.1, 10

loss = nn.CrossEntropyLoss(reduction='none')

trainer = torch.optim.SGD(net.parameters(), lr=lr)

train_iter, test_iter = d2l.load_data_fashion_mnist(batch_size)

d2l.train_ch3(net, train_iter, test_iter, loss, num_epochs, trainer)

d2l.plt.show()

"====================2、小结===================="

# (1)我们可以使用高级API更简洁地实现多层感知机。

# (2)对于相同的分类问题,多层感知机的实现与softmax回归的实现相同,

# 只是多层感知机的实现里增加了带有激活函数的隐藏层。

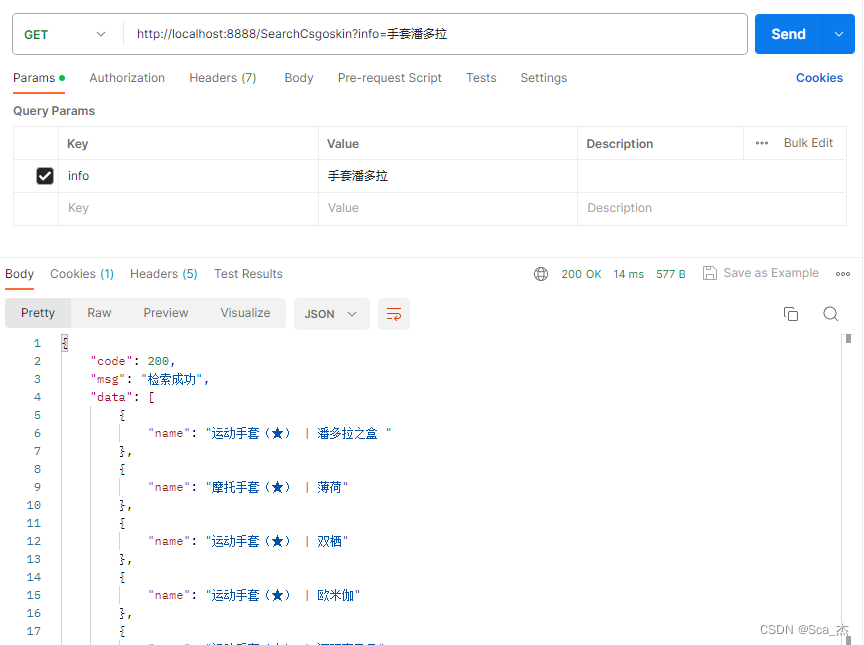

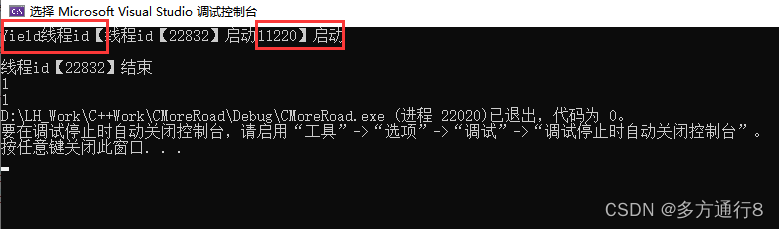

2、运行结果