由于计算机性能的快速提升, 学习可观测样本的概率密度并随机生成新样本的生成模型成为热点。相比于需要学习条件概率分布的判别模型生成模型的训练难度大、模型结构复杂, 但除了能够生成新样本外, 生成模型在图像重构、缺失数据填充、密度估计、风格迁移和半监督学习等应用领域也获得了巨大的成功。当前可观测样本的数量和维数都大幅度增加, 浅层的生成模型受到性能瓶颈的限制而无法满足应用需求, 从而被含有多个隐藏层的深度生成模型替代, 深度生成模型能够学习到更好的隐表示, 模型性能更好。

深度生成模型的目标函数是数据分布与模型分布之间的距离, 可以用极大似然法进行求解。从处理极大似然函数的方法的角度, 可将深度生成模型分成如下三种。

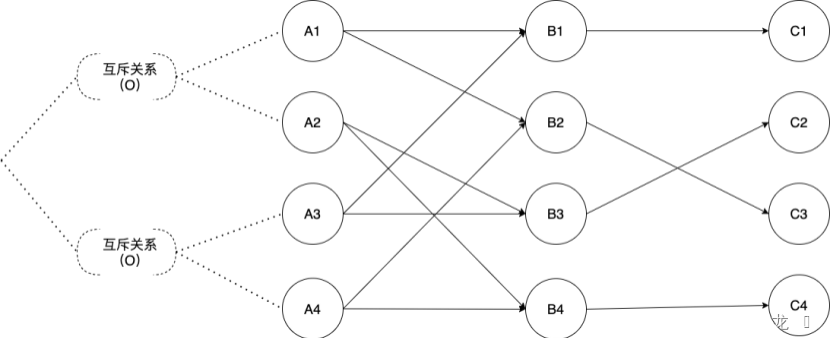

第一种方法是通过变分或抽样的方法求似然函数的近似分布, 这种方法可称为近似方法, 主要包括受限玻尔兹曼机和变分自编码器。用抽样方法近似求解似然函数的受限玻尔兹曼机属于浅层模型, 以该模型为基础模块的深度生成模型包括深度玻尔兹曼机和深度置信网络两种; 变分自编码器用似然函数的变分下界作为目标函数, 这种使用变分下界替代似然函数的近似方法的效率比受限玻尔兹曼机的抽样方法高很多, 实际效果也更好, 变分自编码器具有代表性的模型包括重要性加权自编码、辅助深度生成模型等。

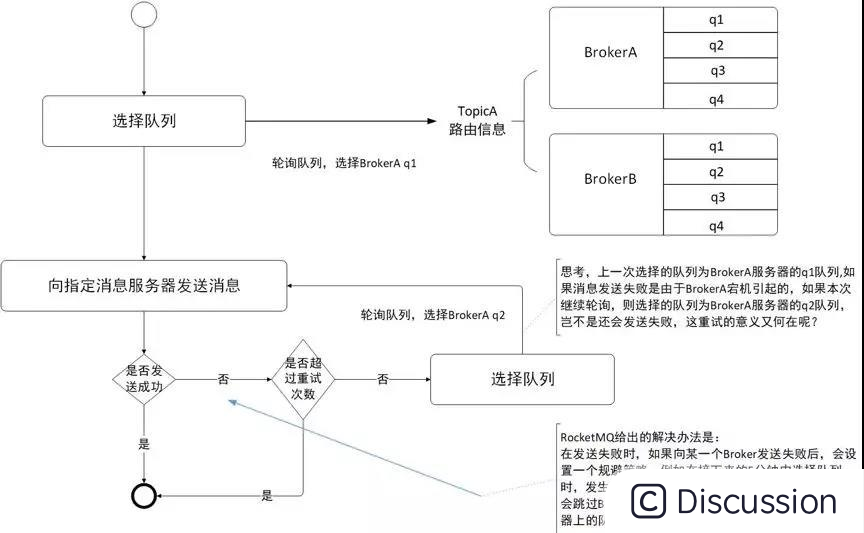

第二种方法是避开求极大似然过程的隐式方法, 其代表模型是生成对抗网络。生成对抗网络利用神经网络的学习能力来拟合两个分布之间的距离, 巧妙地避开了求解似然函数的难题, 是目前最成功、最有影响力的生成模型, 其具有代表性的模型很多, 例如深度卷积生成对抗网络、WGAN和当前生成能力最好的BigGAN; 另外利用参数化马尔科夫过程代替直接参数化似然函数的生成随机网络也属于此类方法。

第三类方法是对似然函数进行适当变形, 变形的目的是为了简化计算, 此类方法包括流模型和自回归模型两种模型。流模型利用可逆网络构造似然函数之后直接优化模型参数, 训练出的编码器利用可逆结构的特点直接得到生成模型。流模型包括常规流模型、变分流模型和可逆残差网络三种。自回归模型将目标函数分解为条件概率乘积的形式, 这类模型有很多, 具有代表性的包括像素循环神经网络、掩码自编码器以及成功生成逼真的人类语音样本的 WaveNet 等。

深度生成式模型未来的挑战

1) 评估指标与评估系统

和判别式模型、基于矩阵与线性代数的模型、基于几何的模型相比, 深度生成模型存在训练过程复杂、结构不易理解和使用、训练速度慢等问题, 在大规模数据上学习模型很困难, 在不同的应用领域应该有相应的有效评估指标和实用的评估系统是急需研究的问题。

2) 不确定性

深度生成模型的动机和构造过程通常有严格的数学推导, 但在实际过程往往限于求解的难度不得不进行近似和简化, 使模型偏离原来的目标。训练好的模型难以在理论上分析透彻, 只能借助实验结果反向判断调整方法, 对生成模型的训练造成很大困扰, 是限制模型进一步发展的重要因素。因此了解模型的近似和简化对模型性能、误差和实际应用的影响是发展生产模型的重要方向。

3) 样本多样性

如何使深度生成模型生成的图像、文本和语音等样本具有多样性是一个值得研究的问题。度量多样性最基本的标准是熵, 因而把生成模型与最大互信息结合的Info-VAE和Info-GAN等模型既能限制生成模型的灵活性又能提升样本的多样性; 把训练样本看作多个概率分布的噪声混合后的随机变量, 提取不同噪声的特征表示, 得到不同层次的特征表示, 在训练目标函数里显式地引入不同的归纳偏置。

4) 泛化能力

机器学习理论认为好的模型要具有更好的泛化能力。重新思考深度学习的泛化能力,从模型复杂性、偏差-方差权衡等观点, 理论上讨论各种深度生成模型的学习机制, 丰富模型的理论基础, 从而真正确立深度生成模型在深度学习中的显著地位是值得思考的问题。

5) 更高效的模型结构和训练方法

代表着最先进的一批生成模型如BigGAN、Glow 和VQ-VAE等已经可以生成足够清晰的图片样本, 但这样的大型模型背后是远超常规的计算量, 是所有大型生成模型的弊端: 高昂的计算机硬件设备以及长时间的训练让很多人难以进入该领域的前沿研究, 所以更加高效的模型结构和训练方法是未来发展方向之一。

6) 应用领域扩展

深度生产模型的应用范围相对较小, 如何将其他深度生成模型的思想以及成果运用在常见场景中、如何加速与这些领域的融合,是未来进一步发展深度生成模型的关键方向, 如智能家居物联网和自动驾驶等领域都有待深度生成模型的使用。目前生成模型通常用于传统机器学习和人工智能专属领域, 对于工业生产等其他领域的应用也有待进一步开发。

7) 生成离散数据

如GAN 等深度生成模型的训练依赖于参数的完全可微, 因此无法直接生成如独热编码等离散数据。这个问题限制了此类深度生成模型在NLP领域的应用, 目前已经有初步的解决办法, 例如使用Gumbel-softmax、用连续函数近似等, 但效果有待进一步提升。因此研究深度生成模型生成离散数据是提高文本生成能力的关键问题, 是值得深入研究的领域。

8) 度量方法

生成模型可以使用不同的度量方法, 例如GAN使用的是KL散度和JS散度, WGAN使用Wasserstein 距离替换了原来的散度, 可以提升模型的生成能力和训练稳定性。因此通过理论分析, 使用新的度量方法可能会进一步提高模型性能。

知乎咨询:哥廷根数学学派

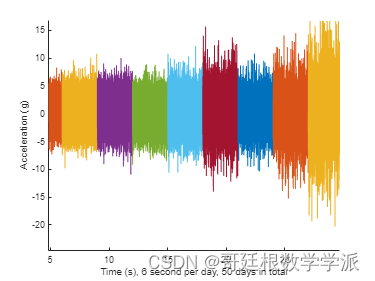

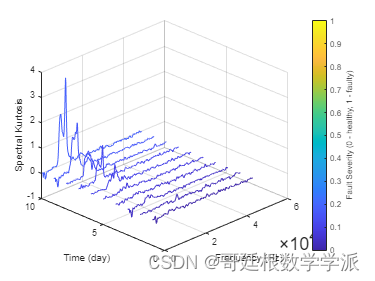

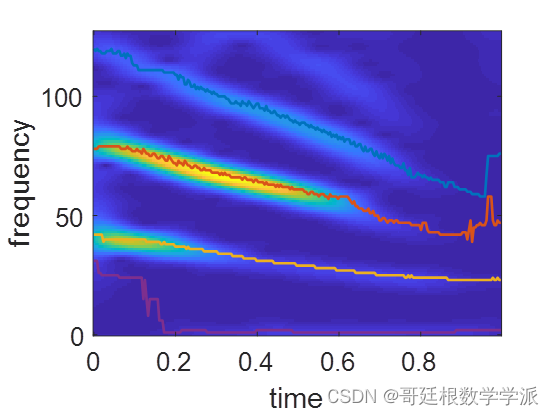

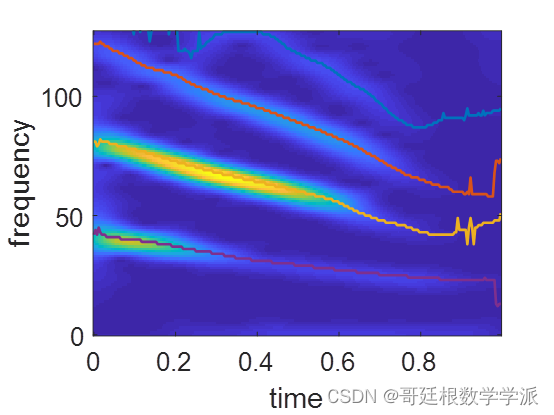

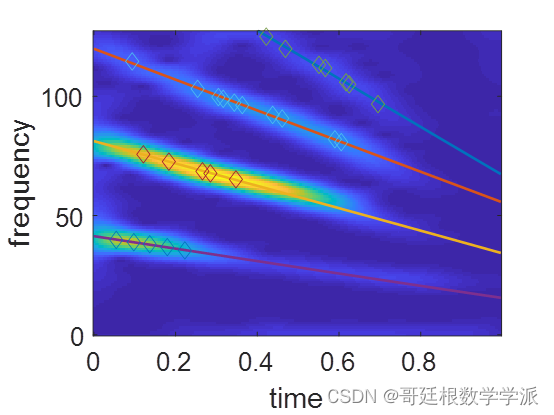

擅长现代信号处理(改进小波分析系列,改进变分模态分解,改进经验小波变换,改进辛几何模态分解等等),改进机器学习,改进深度学习,机械故障诊断,改进时间序列分析(金融信号,心电信号,振动信号等)

算法代码地址,浏览器打开:mbd.pub/o/GeBENHAGEN