论文

题目:DEEP FEATURE SELECTION-AND-FUSION FOR RGB-D SEMANTIC SEGMENTATION

收录于:ICME 2021

论文:Deep Feature Selection-And-Fusion for RGB-D Semantic Segmentation | IEEE Conference Publication | IEEE Xplore

[2105.04102] Deep feature selection-and-fusion for RGB-D semantic segmentation (arxiv.org)代码:暂未找到

摘要

场景深度信息可以帮助视觉信息进行更准确的语义分割。然而,如何有效地将多通道信息集成到具有代表性的特征中仍然是一个悬而未决的问题。现有的工作大多使用DCNN来隐式融合多通道信息。但随着网络的深入,一些关键的区分特征可能会丢失,这降低了分割性能。提出了一种统一高效的特征选择与融合网络(FSFNet),该网络包含一个对称的跨通道残差融合模块,用于多通道信息的显式融合。此外,网络还包括详细特征传播模块,用于维护网络转发过程中的低层详细信息。实验结果表明,与现有方法相比,该模型在两个公共数据集上取得了相当的性能。

引言

语义分割指根据语义信息对图像进行分类。RGB-D图像包含RGB图和Depth深度图,两者可相辅相成。如何有效将RGB图和Depth信息进行融合,依旧是一个问题。现有方法虽进行整合,但利用不充分。下采样时会降低分辨率导致信息丢失,使用跳接有助于细节恢复,但不具有针对性。

针对上述问题,本文提出了一种新的特征选择融合网络,从多通道表示和解码特征两个方面对RGB-D语义分割模型中的特征进行显式增强。网络的核心思想是从一个通道中选择有区别的信息来补充另一个通道,以获得良好的信息表示。此外,这项工作还针对编码器中丢失的信息,使用一些方法加以改善。

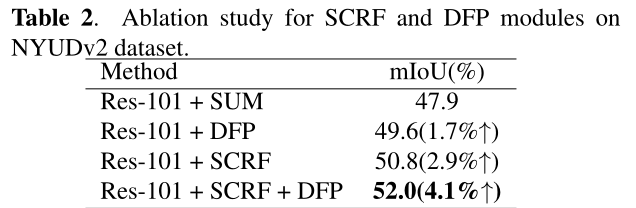

这两个方面分别对应于两个模块。对于前者,设计了对称交叉通道残差融合模块(SCRF),有效地融合了两个通道的互补信息,同时在编码阶段的信息交互过程中保持了特定通道的特异性。对于后者,设计了一个详细的特征传播模块(DFP),以鼓励网络关注编码器中丢失的重要细节,并在解码器中重复使用它们来提高分割性能。这两个模块都被设计成两个步骤:特征选择和特征融合。

本文的主要工作如下:

- 为了解决RGB-D语义分割中的多通道信息融合问题,设计了FSFNet中的SCRF模块。该模块的核心是跨通道残差连接,它既保留了残差连接的优点,又能明确地选择和融合互补信息,形成区分和有效的表示。

- 针对下采样过程中一些重要信息的丢失,设计了网络中的DFP模块。DFP模块首先通过注意力机制选择在编码阶段可能丢失的重要信息。然后,该模块将所选择的特征与解码器特征进行传播和融合以用于进一步分割。

- 对于提出的模块,FSFNet使用相对简单的架构来实现出色的性能。通过一系列的实验验证了FSFNet及其模块的有效性,并在NYUDv2和SUN RGB-D数据集上取得了较好性能。

方法

RGB-D语义分割模型,通常为编码器-解码器结构。本文改进编码器,将两个模式的互补特征进行选择融合,生成一个特定表示。再增加一条残差分支减少细节丢失。

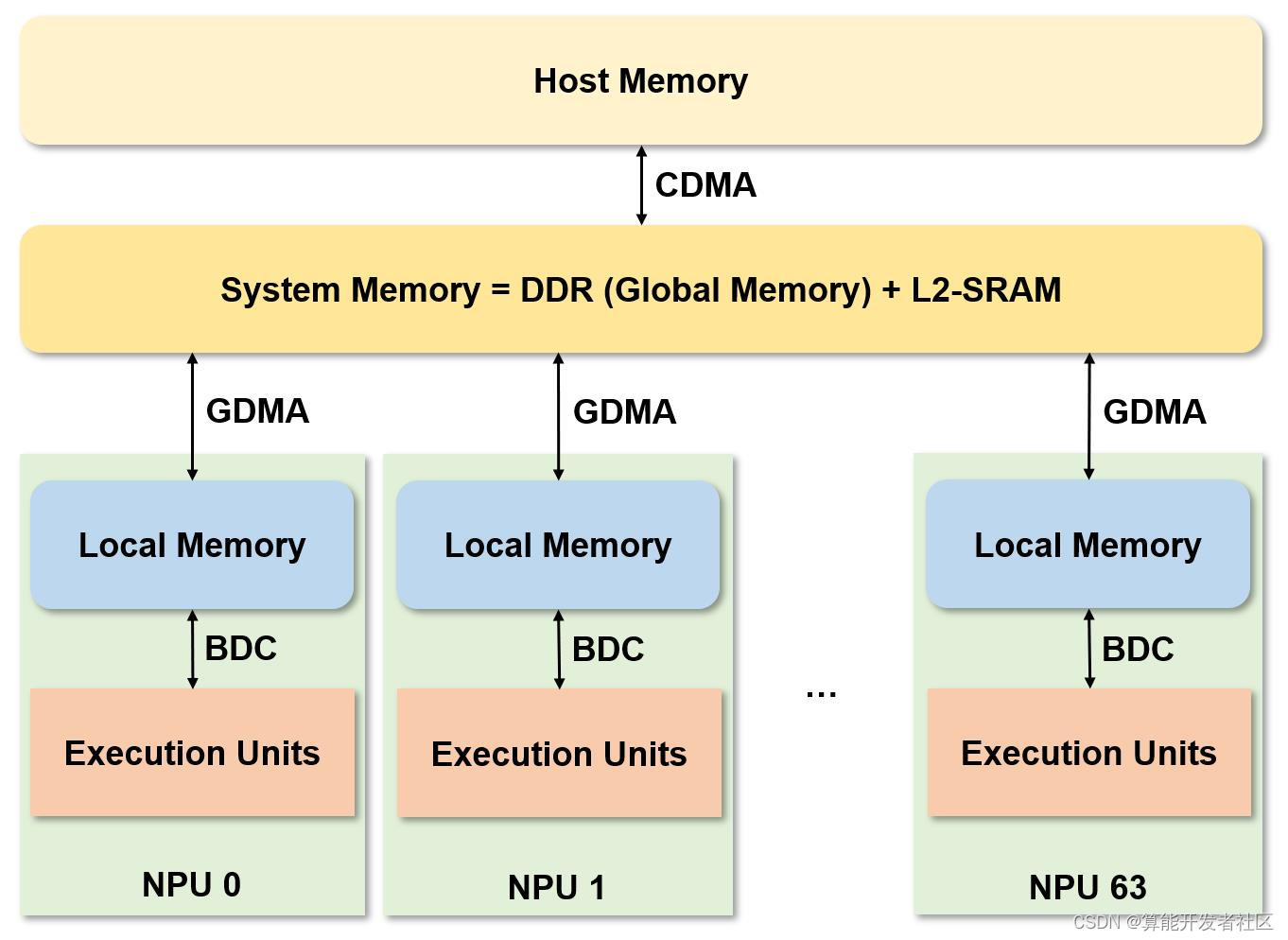

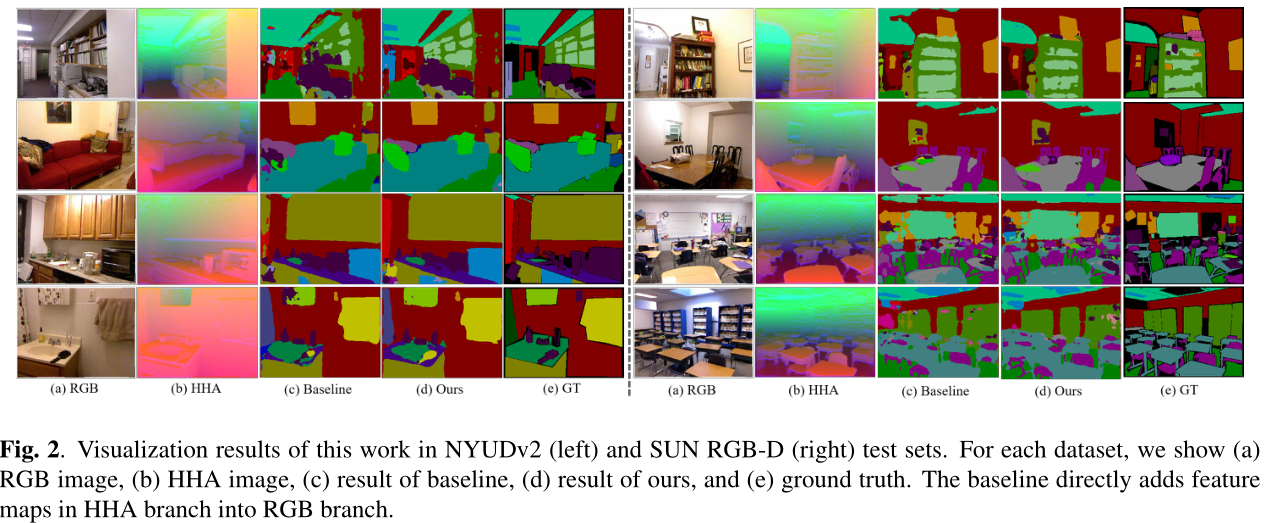

网络以三通道RGB图和三通道HHA图像为输入,通过级联的SCRF模块选择和增强两种模式的信息表示能力,同时鼓励尽可能保存特定模式的特定特征。另外,DFP模块选择编码器的部分细节,并将其传输到解码器的相应阶段,以充分利用丢失的重要细节。

框架

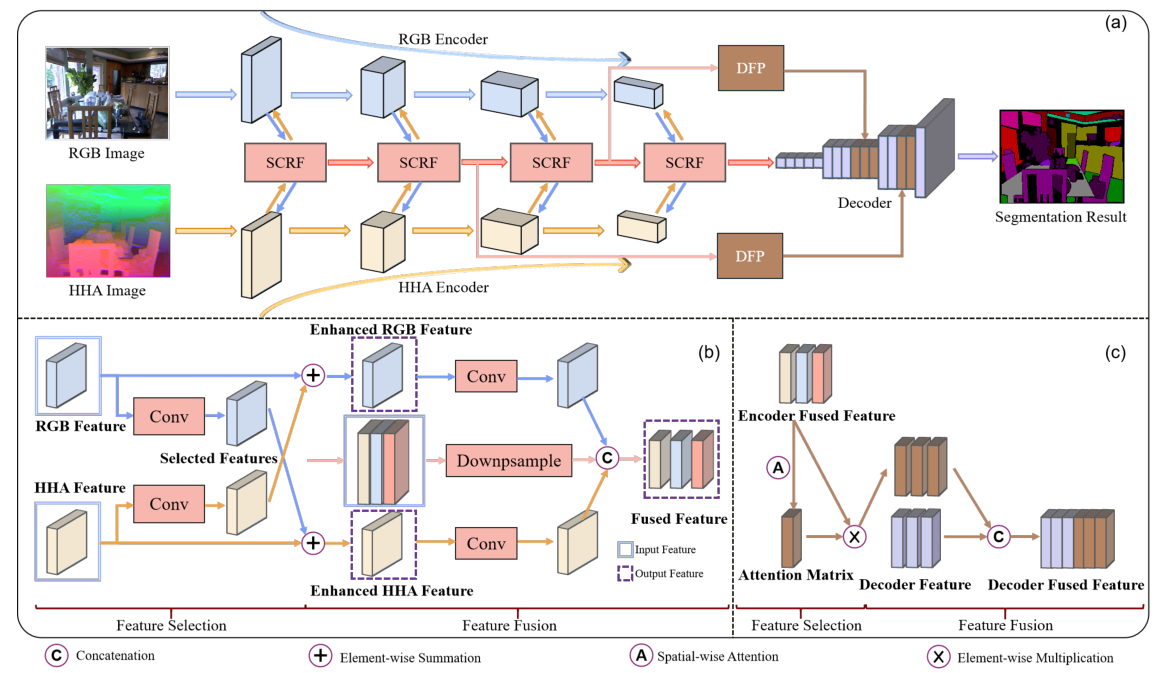

(a) 整体框架。在给定RGB和HHA图像作为输入的情况下,上下编码分支分别从输入中提取特定模式的特征。中间的融合分支使用级联的SCRF模块来融合两种模式特征。融合分支中间两层的融合特征由DFP模块选择并传播到相应的解码层进行联合预测。

(b) SCRF模块的详细信息。它是基于跨模态残差连接的。SCRF首先从一个通道中选择与另一个通道互补的特征,然后在通道和级别之间执行特征融合。

(c) DFP模块的详细信息。该算法首先利用空间方向的关注度,从编码级中间两层的融合特征中选取重要但可能丢失的细节信息,然后与解码级的相应特征进行融合,进行最终的联合分割。

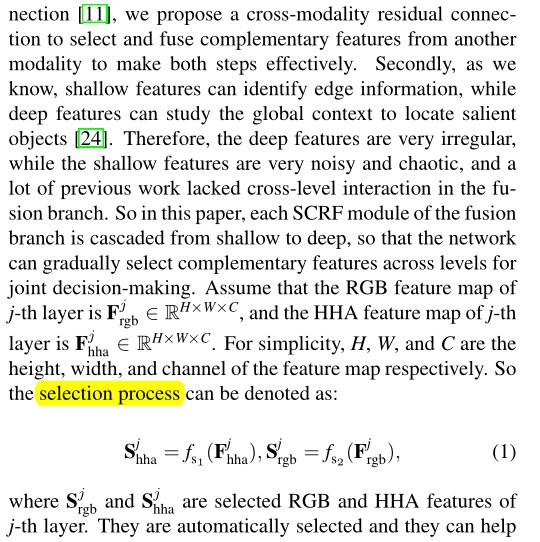

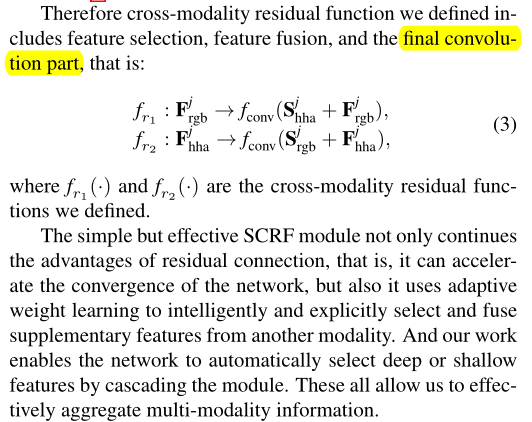

Symmetric Cross-modality Residual Fusion (SCRF) 对称交叉模态残差融合

利用互补部分进行建模,完成跨模态信息融合。两个步骤:特征选择和特征融合。

Detailed Feature Propagation (DFP) 详细特征传播

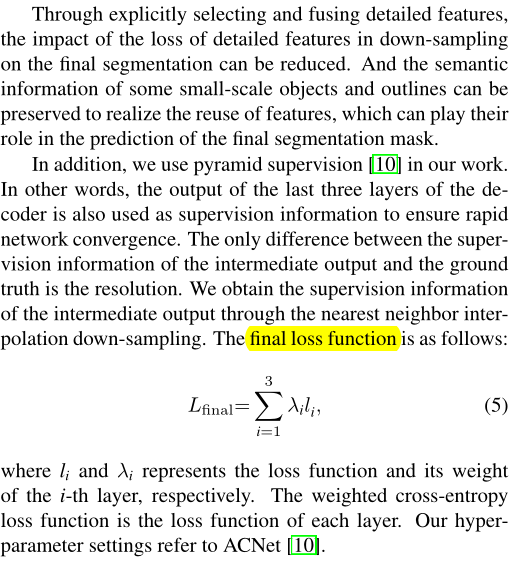

Loss 损失函数

实验

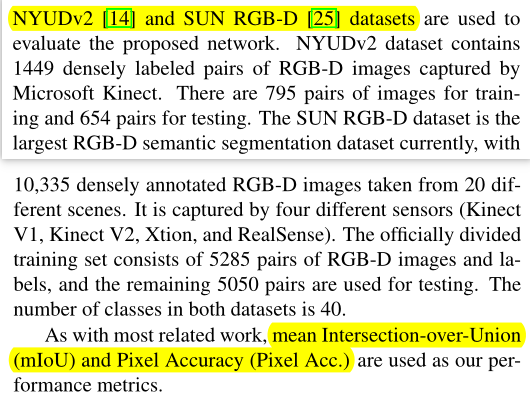

数据集和评价指标

实验细节

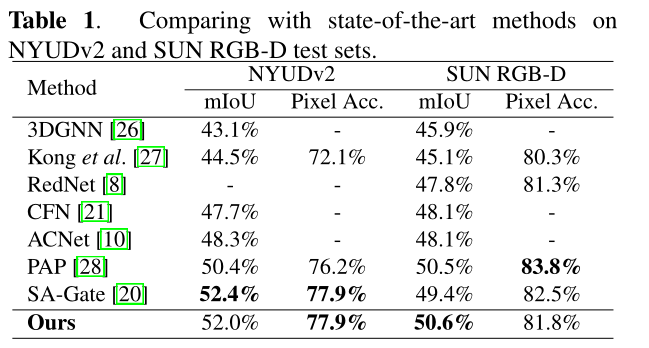

实验结果

![[附源码]Python计算机毕业设计Django学生宿舍维修管理系统](https://img-blog.csdnimg.cn/aaf0e93f60464383a62f7221f7fced84.png)

![[安装] Doris集群搭建环境](https://img-blog.csdnimg.cn/img_convert/bfef8c5f6930dc0d573e1bc97dc3c3ed.png)