1.课程整体目录:

2.课程地址

飞桨AI Studio - 人工智能学习与实训社区

2.1 回归

2.1.1线性回归和逻辑回归的联系和区别

【ML】线性回归和逻辑回归的联系和区别_逻辑回归和线性回归的区别_机器不学习我学习的博客-CSDN博客

2.1.2 线性回归和逻辑回归重要公式推导

从这里开始看:飞桨AI Studio - 人工智能学习与实训社区

2.1.3 梯度下降算法优化版本-Deep Learning 最优化方法之AdaGrad

Deep Learning 最优化方法之AdaGrad - 知乎

2.1.4梯度下降和随机梯度下降区别

1.DradientDescent 训练20次更新一次参数,StochasticGradientDescent训练一次更新一次参数;

2.随机梯度下降虽然计算的梯度很跳跃,但是训练的更快,且最后的效果和趋势和传统梯度下降是一样的。

2.2分类

2.2.1 判别式模型(discriminative model)和生成模型(generative model)区别

判别式模型(discriminative model) 和生成式模型(generative model)的区别_数据娃掘的博客-CSDN博客

分类问题项目实践-例子非常好,要多写几遍!!!!

飞桨AI Studio - 人工智能学习与实训社区

2.3决策树代码

飞桨AI Studio - 人工智能学习与实训社区

2.4支持向量机

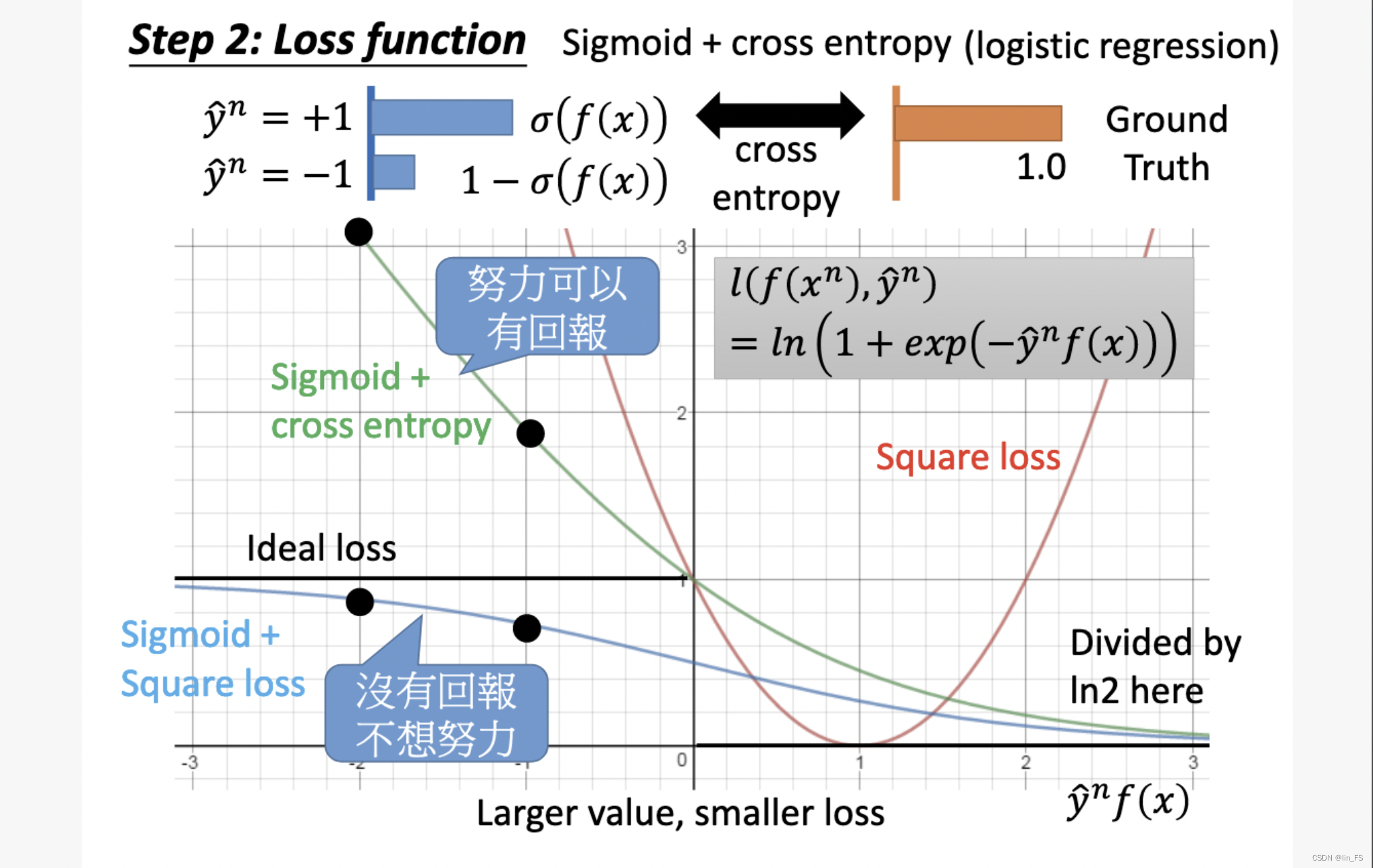

1) square loss

不合理点:当y和f(x)相乘值很大时,对应的loss也很大

2)sigmoid + square loss

3)sigmoid+sqare loss 和 sigmoid+cross entropy对比:

在异常值较大的点,sigmod + corss entropy 梯度下降更快

4)deep learning 和svm区别

5)svm本质

6)SVM项目实践-例子非常好,要多写几遍!!!!

飞桨AI Studio - 人工智能学习与实训社区

7)总结:svm function中引入kernel trick,loss function中引入hing loss

2.5集成学习

3.机器学习进阶

飞桨AI Studio - 人工智能学习与实训社区

![强化学习从基础到进阶-案例与实践[1]:强化学习概述、序列决策、动作空间定义、策略价值函数、探索与利用、Gym强化学习实验](https://ai-studio-static-online.cdn.bcebos.com/ad0c6b8721694dc096453a95414e9f57e03bf8684e9c4381bbff3f17fdada4d6)