By 超神经

内容一览:TVM 共有三种安装方法:从源码安装、使用 Docker 镜像安装和 NNPACK Contrib 安装。本文讲解如何通过 Docker 镜像 和 NNPACK Contrib 安装。

关键词:TVM Docker 基础教程

欢迎回到 TVM 文档讲解 101,这个系列将继续 TVM 的日常教学。

上期 Part 1 我们已经介绍了如何通过源码安装 TVM,本期将继续进行学习 TVM 前的准备工作。讲解通过 Docker 镜像和 NNPACK Contrib 安装 TVM。

Part 1 传送门:从源码安装

TVM 安装之 Docker 镜像安装

开发者可以利用 Docker 工具脚本,建立开发环境。这也有助于运行 TVM Demo 和教程。

需要用到 Docker

https://docs.docker.com/engine/installation/

如果使用 CUDA 则需要 nvidia-docker。

https://github.com/NVIDIA/nvidia-docker/

获取 TVM 源码发行版或克隆 GitHub 仓库,以获取辅助脚本:

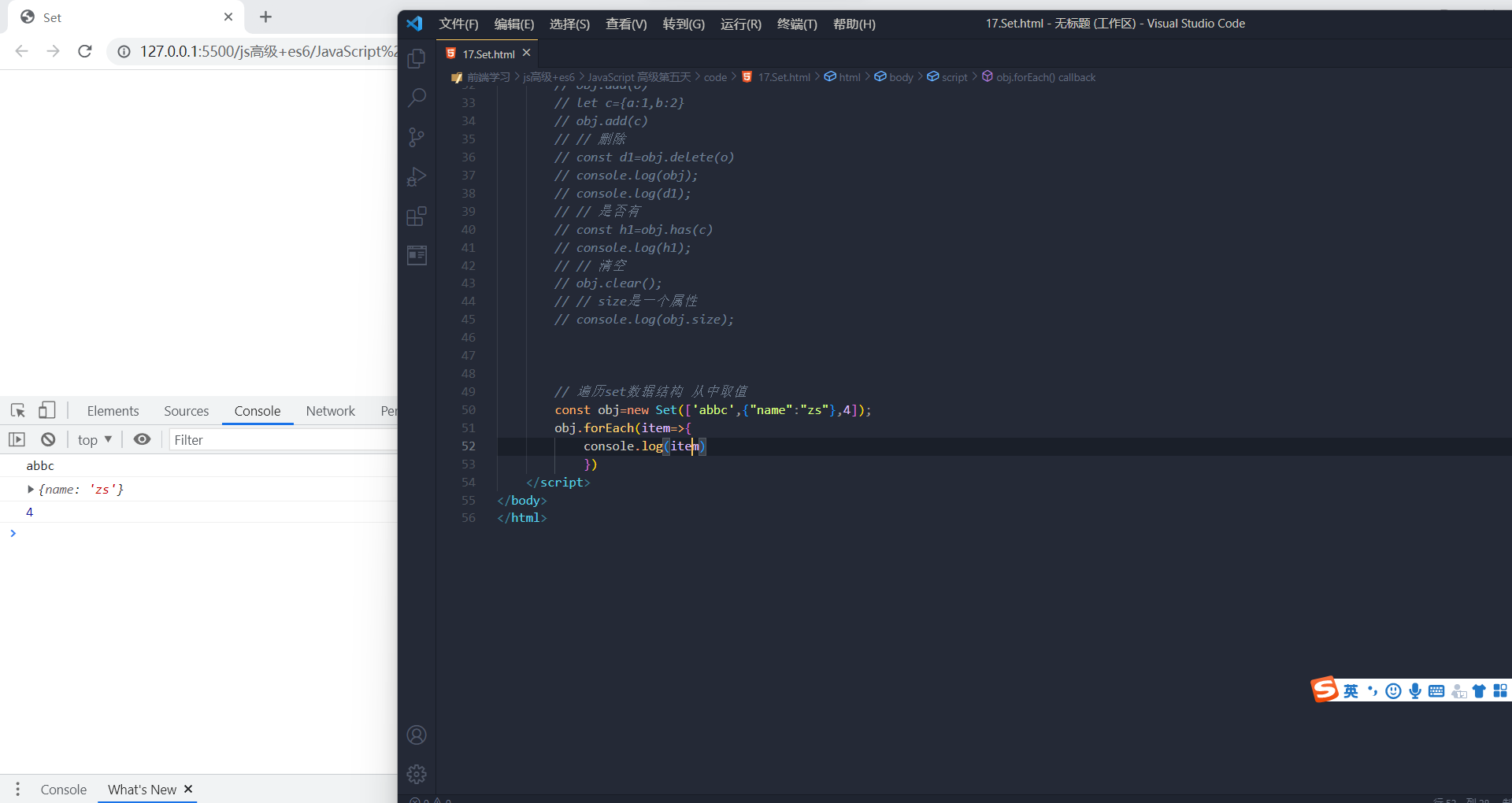

git clone --recursive https://github.com/apache/tvm tvm使用以下命令来启动 Docker 镜像:

/path/to/tvm/docker/bash.sh <image-name>完成本地构建后,这里的 image-name 可以是一个本地的 Docker 镜像名称,例如:tvm.ci_cpu 。

该辅助脚本可实现:

* 挂载当前目录到 /workspace

* 将用户切换为调用 bash.sh 的用户(这样您就可以读/写主机系统)

* 在 Linux 上使用宿主机的网络。由于无法支持主机网络驱动器,请在 macOS 上使用桥接网络并暴露 8888 端口,以使用 Jupyter Notebook。

输入以下内容启动 Jupyter Notebook:

jupyter notebook如果你在 macOS 上启动 Jupyter Notebook 时看到报错 OSError: [Errno 99] Cannot assign requested address,可通过以下方式改变绑定的 IP 地址:

jupyter notebook --ip=0.0.0.0注意,在 macOS 上,由于我们使用桥接网络,Jupyter Notebook 将被报告在一个类似于 http://{container_hostname}:8888/?token=... 的 URL 上运行。在浏览器中粘贴时,需把 container_hostname 替换为 localhost。

Docker 源代码

查看 Docker 源代码: 构建自己的 Docker 镜像。

https://github.com/apache/tvm/tree/main/docker

运行以下命令来构建 Docker 镜像:

/path/to/tvm/docker/build.sh <image-name>你也可以利用非官方的第三方预建镜像,注意:这些镜像是用来测试的,并不是 ASF 的版本。

https://hub.docker.com/r/tlcpack/

TVM 安装之 NNPACK Contrib 安装

NNPACK 是用于神经网络计算的加速包,可以在 x86-64、ARMv7 或 ARM64 架构的 CPU 上运行。使用 NNPACK,像 MXNet 这样的高级库可以加快多核 CPU 计算机(包括笔记本电脑和移动设备)上的执行速度。

由于 TVM 已经有原生调整的调度,这里的 NNPACK 主要是为了参考和比较。对于常规使用,原生调整的 TVM 实现更佳。

TVM 支持 NNPACK 在卷积、最大池和全连接层中进行前向传播(仅限推理)。在本文档中,我们对如何将 NNPACK 与 TVM 一起使用进行了高级概述。

条件

NNPACK 的底层实现使用了多种加速方法,包括 fft 和 winograd。这些算法在某些特殊的批处理大小、内核大小和步幅设置上比其他算法效果更好,因此根据上下文,并非所有卷积、最大池或全连接层都可以由 NNPACK 提供支持。

NNPACK 仅支持 Linux 和 OS X 系统,目前不支持 Windows。

构建/安装 NNPACK

如果训练后的模型满足使用 NNPACK 的一些条件,则可以构建支持 NNPACK 的 TVM。

请按照以下简单步骤操作:使用以下命令构建 NNPACK 共享库。TVM 会动态链接 NNPACK。

注意:以下 NNPACK 安装指导已经在 Ubuntu 16.04 上进行了测试。

构建 Ninja

NNPACK 需要最新版本的 Ninja。所以我们需要从源代码安装 ninja。

git clone git://github.com/ninja-build/ninja.git

cd ninja

./configure.py --bootstrap设置环境变量 PATH 以告诉 bash 在哪里可以找到 ninja 可执行文件。例如,假设我们在主目录 ~ 上克隆了 ninja。然后我们可以在 ~/.bashrc 中添加以下行。

export PATH="${PATH}:~/ninja"构建 NNPACK

CMAKE 新版 NNPACK 单独下载 Peach 等依赖

https://github.com/Maratyszcza/PeachPy

注意:至少在 OS X 上,运行下面的 ninja install 会覆盖安装在 /usr/local/lib 中的 googletest 库。如果您再次构建 googletest 以替换 nnpack 副本,请务必将 -DBUILD_SHARED_LIBS=ON 传给 cmake。

git clone --recursive https://github.com/Maratyszcza/NNPACK.git

cd NNPACK

# 在 CFLAG 和 CXXFLAG 中添加 PIC 选项以构建 NNPACK 共享库

sed -i "s|gnu99|gnu99 -fPIC|g" CMakeLists.txt

sed -i "s|gnu++11|gnu++11 -fPIC|g" CMakeLists.txt

mkdir build

cd build

# 生成 ninja 构建规则并在配置中添加共享库

cmake -G Ninja -D BUILD_SHARED_LIBS=ON ..

ninja

sudo ninja install

# 在你的 ldconfig 中添加 NNPACK 的 lib 文件夹

echo "/usr/local/lib" > /etc/ld.so.conf.d/nnpack.conf

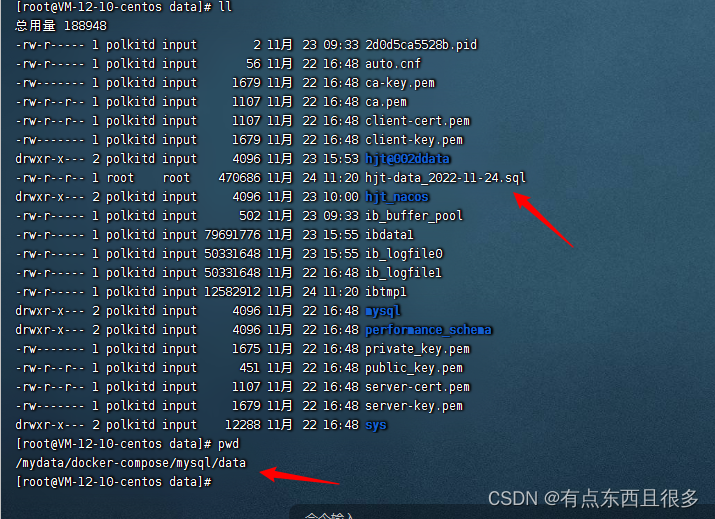

sudo ldconfig构建支持 NNPACK 的 TVM

git clone --recursive https://github.com/apache/tvm tvm* 在 config.cmake 中设置 set(USE_NNPACK ON) 。

* 将 NNPACK_PATH 设置为 $(YOUR_NNPACK_INSTALL_PATH) 配置后使用 make 构建 TVM

make点击阅读原文可查看原始文档,后续超神经将继续更新中文 TVM 教程,请持续关注~

—— 完 ——

扫描二维码,加入讨论群

获得更多优质数据集

了解人工智能落地应用

关注顶会&论文

回复「读者」了解更多

更多精彩内容(点击图片阅读)

![[附源码]计算机毕业设计人事系统Springboot程序](https://img-blog.csdnimg.cn/3b268a86e7a543d085712034519205c9.png)