OpenAI开发者平台最近推出了两个引人注目的GPT升级版本:gpt-3.5-turbo-0613和gpt-3.5-turbo-16k。这些新版本带来了一系列令人兴奋的功能和增强,为开发者提供了更加灵活和强大的自然语言处理工具。本文将为您介绍这两个版本的主要特点和优势。

gpt-3.5-turbo-0613和gpt-3.5-turbo-16k的推出为开发者提供了更强大和多样化的自然语言处理工具。函数调用功能和系统消息改进使得模型更加可控和定制化,而更长的上下文长度则扩展了模型的应用范围。开AI团队的这一升级进一步巩固了GPT系列模型的领先地位,并为开发者提供了更多创造力和创新性的空间。

我们很高兴地宣布OpenAI开发者平台的一些更新。

GPT-3.5 Turbo

该模型已经进行了更新,推出了一个新版本:gpt-3.5-turbo-0613,该版本可以更好地与系统消息进行交互,并且增加了一个新功能:函数调用。通过在提示中描述函数,模型可以智能地输出一个包含参数的JSON对象,根据用户的输入调用这些函数,非常适合与其他工具或API集成。请在我们的函数调用文档中了解更多信息。

此外,GPT-3.5 Turbo的输入标记费用降低了25%(现在是每1K输入标记0.0015美元),立即生效。

更长的上下文

我们还推出了gpt-3.5-turbo-16k。该模型的上下文长度是4k基础模型的四倍,定价为每1K输入标记0.003美元和每1K输出标记0.004美元。

模型过渡

您可以从今天开始使用新的gpt-3.5-turbo-0613模型。在6月27日,稳定版本的gpt-3.5-turbo将自动升级到这个新版本。如果您需要更多时间来过渡,您可以指定gpt-3.5-turbo-0301以继续使用旧版本,该版本将作为我们的升级和废弃流程的一部分保持可用直到9月13日。

——OpenAI团队

版本亮点

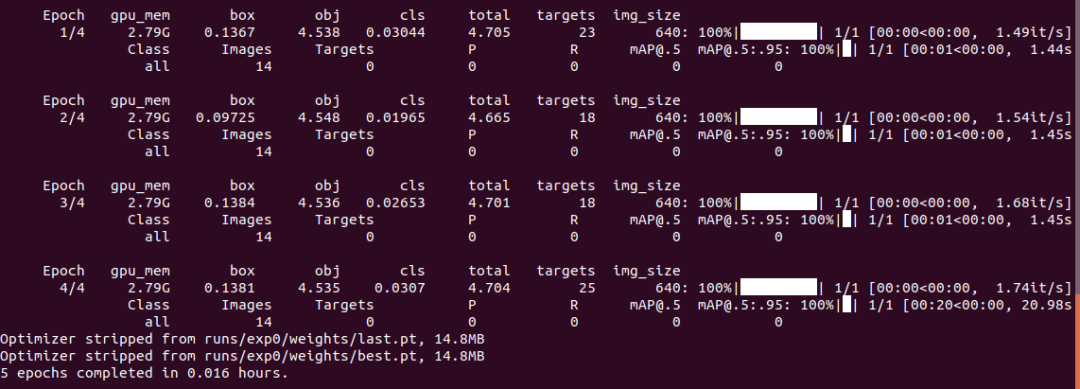

1、速度提升

可以看到gpt-3.5-turbo-0613明显比gpt-3.5-turbo(gpt-3.5-turbo-0301)的速度快

2、上下文长度加长

GPT-3.5-turbo-16k 相较于 GPT-3.5-turbo 拥有 4 倍的上下文长度,但成本是前者的两倍。

GPT-3.5-turbo-16k相较于GPT-3.5-turbo具有4倍的上下文长度。上下文长度指的是模型在生成输出时所考虑的前面文本的长度。具有更长的上下文长度可以提供更多的背景信息,帮助模型更好地理解用户的请求并生成更准确的响应。

GPT-3.5-turbo-16k的上下文长度为GPT-3.5-turbo的四倍,这意味着它可以考虑更长的文本片段作为输入,并使用该文本来生成响应。这对于需要更多上下文信息的任务非常有用,例如长对话、文本摘要、代码生成等。

通过增加上下文长度,GPT-3.5-turbo-16k扩展了模型的能力,使其能够更好地处理复杂的语境,并在更长的输入序列上表现出更好的性能。这为开发者提供了更多的灵活性和更广泛的应用场景选择。

================================

如果文章对你有帮助,请不要忘记加个关注、点个赞!!!