特征处理之特征降维

- 一、特征选择

- Filter(过滤式)

- 1,低方差特征过滤

- 2、相关系数

- Embedded (嵌入式)

- 二、主成分分析(PCA)

特征降维:如果特征本身存在问题或者特征之间相关性较强,对于算法学习预测会影响较大。降维是指在某些限定条件下,降低随机变量(特征)个数,得到一组“不相关”主变量的过程

降维的两种方式

1,特征选择

2,主成分分析(可以理解一种特征提取的方式)

一、特征选择

定义:数据中包含冗余或无关变量(或称特征、属性、指标等),特征选择旨在从原有特征中找出主要特征。

两种方法:

1,Filter(过滤式):主要探究特征本身特点、特征与特征和目标值之间关联

- 方差选择法:低方差特征过滤

- 相关系数

2,Embedded (嵌入式):算法自动选择特征(特征与目标值之间的关联)

- 决策树:信息熵、信息增益

- 正则化:L1、L2

- 深度学习:卷积等

模块

sklearn.feature_selection

Filter(过滤式)

1,低方差特征过滤

特征方差小表示某个特征大多样本的值比较相近,特征方差大表示某个特征很多样本的值都有差别,低方差特征过滤则是删除低方差的一些特征

API

sklearn.feature_selection.VarianceThreshold(threshold = 0.0)

# 删除所有低方差特征

Variance.fit_transform(X)

X:numpy array格式的数据[n_samples,n_features]

返回值:训练集差异低于threshold的特征将被删除。默认值是保留所有非零方差特征,即删除所有样本中具有相同值的特征。

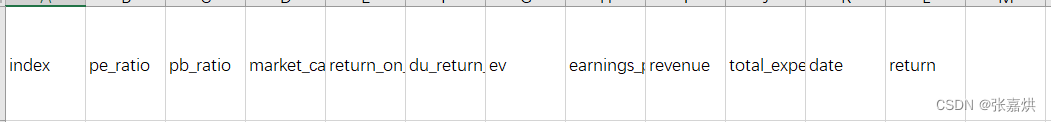

实操:筛选股票财务指标

对某些股票的指标特征进行筛选,数据在"factor_returns.csv"文件中,要求除去’index,‘date’,'return’列不考虑,所有特征如下。

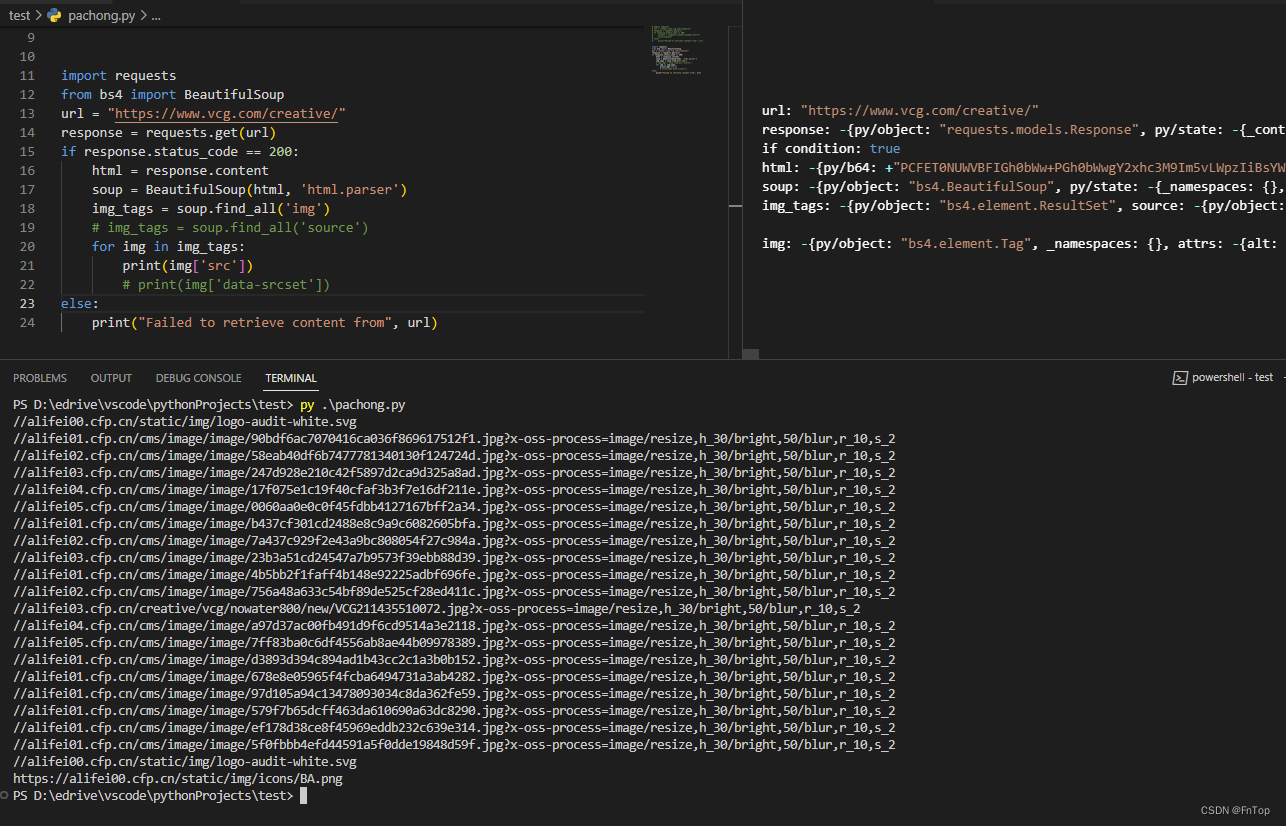

import pandas as pd

from sklearn.feature_selection import VarianceThreshold

data = pd.read_csv("factor_returns.csv")

print(data)

print("初始形状:\n", data.shape)

# 实例化一个转换器类

transfer = VarianceThreshold(threshold=1)

# 调用 fit_transform

data = transfer.fit_transform(data.iloc[:, 1:10])

print("删除低方差特征的结果:\n", data)

print("降维后形状:\n", data.shape)

2、相关系数

皮尔逊相关系数:反映变量之间相关关系密切程度的统计指标,根据该指标来选择特征降维。

特点:

相关系数的值介于–1与+1之间,即–1≤ r ≤+1。其性质如下:

- 当r>0时,表示两变量正相关,r<0时,两变量为负相关

- 当|r|=1时,表示两变量为完全相关,当r=0时,表示两变量间无相关关系

- 当0<|r|<1时,表示两变量存在一定程度的相关。且|r|越接近1,两变量间线性关系越密切;|r|越接近于0,表示两变量的线性相关越弱

- 一般可按三级划分:|r|<0.4为低度相关;0.4≤|r|<0.7为显著性相关;0.7≤|r|<1为高度线性相关

API

from scipy.stats import pearsonr

实操:股票的财务指标相关性计算,假设

factor = ['pe_ratio','pb_ratio','market_cap','return_on_asset_net_profit',

'du_return_on_e quity','ev','earnings_per_share','revenue','total_expense']

数据文件还是上述的 factor-returns.csv

import pandas as pd

from scipy.stats import pearsonr

data = pd.read_csv("factor_returns.csv")

# 列举所有特征

factor = ['pe_ratio', 'pb_ratio', 'market_cap', 'return_on_asset_net_profit',

'du_return_on_equity', 'ev','earnings_per_share', 'revenue', 'total_expense']

# 每个特征之间进行相关系数计算

for i in range(len(factor)):

for j in range(i, len(factor) - 1):

print("指标%s与指标%s之间的相关性大小为%f" % (factor[i], factor[j + 1],

pearsonr(data[factor[i]], data[factor[j + 1]])[0]))

计算出指标之间的相关系数之后,对于较大相关性的特征再做之后的处理,例如对特征按相关性进行加权求和。

Embedded (嵌入式)

对于Embedded方式,涉及到算法这里暂时不展开

二、主成分分析(PCA)

定义:高维数据转化为低维数据的过程,在此过程中可能会舍弃原有数据、创造新的变量。作用:对数据维数压缩,尽可能降低原数据的维数(复杂度),损失少量信息。

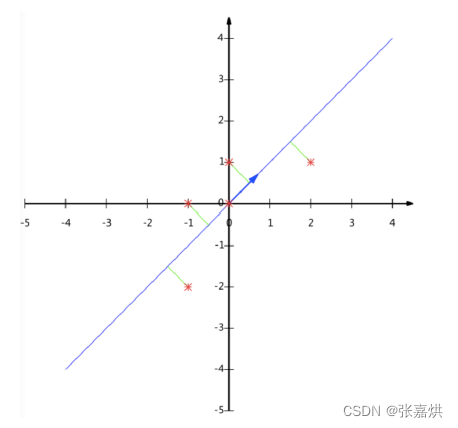

例如,假设给定5个点,如下图所示:

要求将这个二维的数据简化成一维? 并且损失少量的信息。这个过程如何计算的呢?首先找到一个合适的直线,通过一个矩阵运算得出下图即为主成分分析的结果

API

sklearn.decomposition.PCA(n_components=None)

# n_components:小数表示保留百分之几的信息,例如 n_components = 0.9 表示保留90%的信息

# 整数减少到多少特征,例如 n_components= 3 表示降维到3维

PCA.fit_transform(X)

# X:numpy array格式的数据[n_samples,n_features]

实操:对 data 数据进行主成分分析

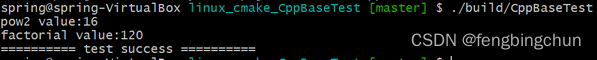

from sklearn.decomposition import PCA

data = [[2,8,4,5], [6,3,0,8], [5,4,9,1]]

# 实例化PCA, 小数——保留多少信息

transfer = PCA(n_components=0.9)

# 调用fit_transform

data1 = transfer.fit_transform(data)

print("保留90%的信息,降维结果为:\n", data1)

# 实例化PCA, 整数——指定降维到的维数

transfer2 = PCA(n_components=3)

# 2、调用fit_transform

data2 = transfer2.fit_transform(data)

print("降维到3维的结果:\n", data2)